Góc nhìn Anderson

Trí tuệ nhân tạo đang chia tìm kiếm web thành ba thực tại khác nhau

Nghiên cứu mới cho thấy Google hiện sử dụng ba hệ thống thông tin khác nhau trong đế chế tìm kiếm của mình, với Tìm kiếm thường xuyên, Tóm tắt Trí tuệ nhân tạo và Gemini đều ưa thích các nguồn, xếp hạng và nội dung khác nhau.

Chủ nghĩa giản lược thống trị. Trong vòng mười hai tháng qua, ‘Hãy để tôi tìm kiếm trên Google cho bạn’ meme đã bị một xu hướng mới ‘Hãy để tôi tóm tắt kết quả tìm kiếm của Google cho bạn’ vượt qua, trong đó tóm tắt trí tuệ nhân tạo trong kết quả tìm kiếm ngày càng tiết kiệm cho người đọc sự khó khăn khi nhấp vào liên kết tìm kiếm (có thể tước bỏ nguồn tài trợ cho các trang web trong quá trình này), bằng cách condense toàn bộ kết quả tìm kiếm thành một vài đoạn văn được tạo ra.

Một người có thể nghĩ rằng kiến thức cốt lõi được hiển thị và lựa chọn các trang web để rút ra kiến thức đó sẽ tương đối tương tự trên tất cả ba phương pháp tìm kiếm thông tin phổ biến nhất trên internet: tìm kiếm web truyền thống; tóm tắt trí tuệ nhân tạo (AIOs) hiện đang đứng đầu hầu hết kết quả tìm kiếm web; và thông qua sự tăng trưởng của LLMs như ChatGPT như các đại lý web-oracles (với hoặc không có cuộc gọi RAG bên ngoài).

Tuy nhiên, nghiên cứu gần đây từ Mỹ cho thấy rằng điều này là, đáng ngạc nhiên, rất khác so với trường hợp; và ngay cả trong bộ ba của các ông tiên trong đế chế của Google – SERPS*, tóm tắt trí tuệ nhân tạo và tương tác trực tiếp với chuỗi Gemini LLM – dường như có những khác biệt đáng kể và thú vị, cho mỗi tuyến đường.

Chia cắt ba cách

Trong một bài báo mới rõ ràng và rộng lớn, có tiêu đề Trí tuệ nhân tạo làm gián đoạn tìm kiếm: Một nghiên cứu thực nghiệm về Tìm kiếm Google, Gemini và Tóm tắt Trí tuệ nhân tạo, sáu nhà nghiên cứu từ Viện Công nghệ New Jersey phác thảo các cách mà ba phương pháp tìm kiếm đang phân kỳ, và đưa ra một số lý thuyết có thể cho những vết nứt này trong cách tiếp cận.

Báo cáo cho biết:

‘[Trước hết, chúng tôi] phát hiện ra rằng đối với 51,5% số truy vấn người dùng thực, AIOs được tạo ra và được hiển thị trên kết quả tìm kiếm hữu cơ. Các câu hỏi gây tranh cãi thường dẫn đến một AIO.

‘Thứ hai, chúng tôi chỉ ra rằng các nguồn được thu thập khác nhau đáng kể cho mỗi công cụ tìm kiếm (<0,2 điểm tương đồng Jaccard trung bình). Tìm kiếm Google truyền thống có nhiều khả năng thu thập thông tin từ các trang web phổ biến hoặc tổ chức trong chính phủ hoặc giáo dục, trong khi các công cụ tìm kiếm tạo ra có nhiều khả năng thu thập nội dung thuộc sở hữu của Google.

‘Thứ ba, chúng tôi quan sát thấy rằng các trang web chặn trình thu thập dữ liệu AI của Google ít có khả năng được thu thập bởi AIOs, mặc dù có quyền truy cập vào nội dung.’

Vì báo cáo là một smorgasbord của những hiểu biết thú vị, thay vì tuân theo quy trình tuyến tính và phương pháp truyền thống, chúng tôi sẽ xem xét những hiểu biết này và một số hiểu biết khác của báo cáo.

Cũ ‘Hai-Một’

Một trong những phát hiện thú vị trong nghiên cứu cho thấy rằng tóm tắt trí tuệ nhân tạo của Google có xu hướng bị ức chế đối với các sự kiện tin tức đột ngột, vì các nguồn sớm nhất và có sẵn nhất có thể không phải là nguồn chính xác nhất.

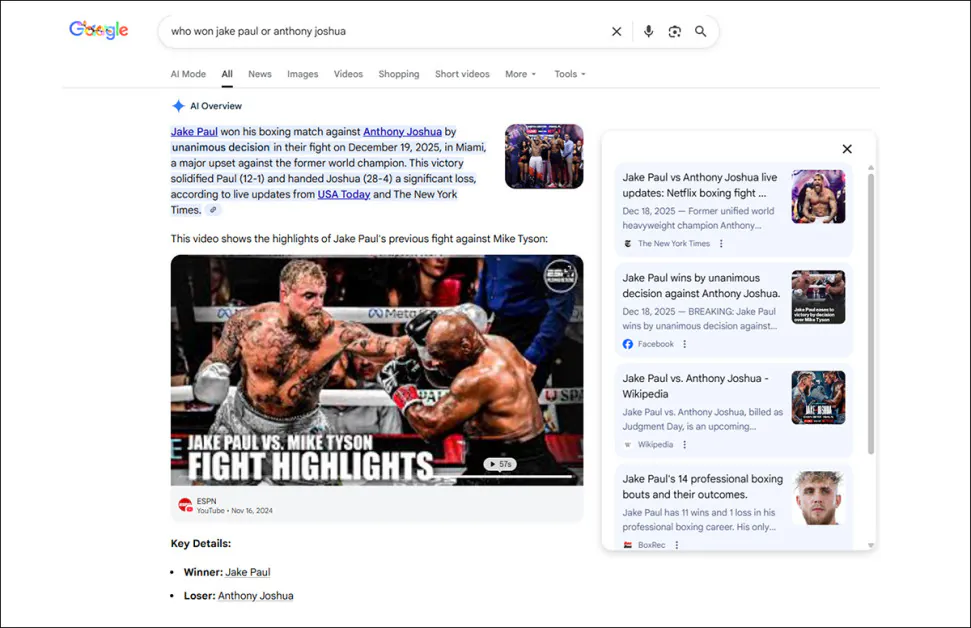

Điều này không luôn hoạt động: trong ví dụ dưới đây, được các nhà nghiên cứu lưu ý, một tóm tắt trí tuệ nhân tạo của Google về kết quả của một trận đấu quyền anh đã quy kết chiến thắng cho võ sĩ sai, ngay cả khi chỉ có một nguồn duy nhất (không chính xác) cho kết quả này là một nguồn tin tức hài hước trên Facebook:

một trong những lý do tại sao tóm tắt trí tuệ nhân tạo của Google tránh tóm tắt thời gian quan trọng là thông tin sớm có thể không đầy đủ hoặc không chính xác. Trong trường hợp này, võ sĩ Jake Paul thực sự thua trận. Nguồn

Các tác giả lưu ý rằng AIOs có xu hướng xuất hiện khi một sự kiện đã cũ ít nhất năm ngày, điều này đủ điều kiện để trở thành một sự bất thường – nhưng tuy nhiên, một sự bất thường mà các nhà nghiên cứu có thể dễ dàng triệu tập.

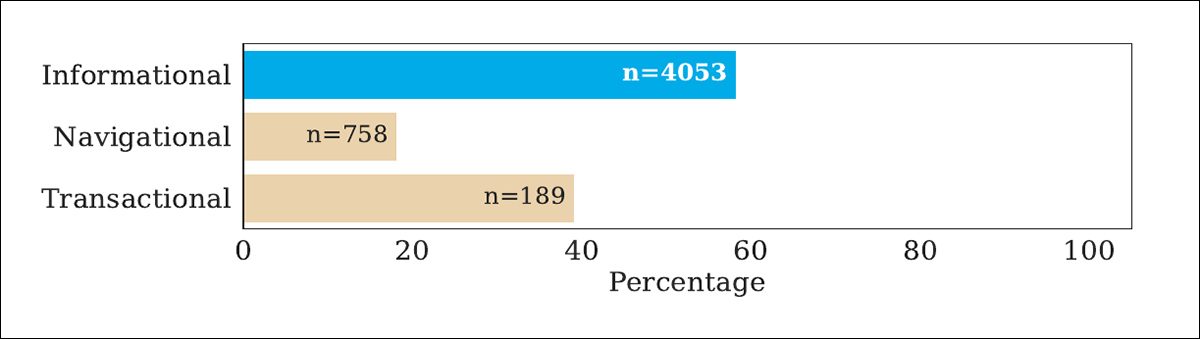

AIOs được tìm thấy có nhiều khả năng được tạo ra khi truy vấn được đóng bằng một dấu chấm hỏi, và rằng động cơ truy vấn là một yếu tố trong việc liệu một AIO sẽ được trình bày:

Tỷ lệ phần trăm các sự kiện mà tóm tắt tìm kiếm trí tuệ nhân tạo được sản xuất trong một vòng thử nghiệm của các nhà nghiên cứu. Ở đây ‘thông tin’ chỉ định các câu hỏi trực tiếp, thường tạo ra AIOs nhiều hơn bất kỳ loại tương tác nào khác.

Ngoài ra, báo cáo cho rằng truy vấn dài hơn có nhiều khả năng tạo ra một tóm tắt trí tuệ nhân tạo thay vì chỉ kết quả tìm kiếm trực tiếp, mặc dù các tác giả không đưa ra một lý thuyết để giải thích điều này.

Vương quốc chia cắt

Có lẽ kết quả chung đáng ngạc nhiên nhất từ công việc mới là sự chồng chéo tương đối nhỏ về chất lượng kết quả giữa ba nền tảng tìm kiếm của Google.

Báo cáo lặp đi lặp lại cho thấy rằng Tìm kiếm Google thường xuyên, tóm tắt trí tuệ nhân tạo và Gemini (LLM) thu thập các nguồn khác nhau đáng kể cho cùng một truy vấn, với điểm tương đồng thấp đủ để ngụ ý ba logic thu thập cạnh tranh bên trong một công ty, trong khi người dùng có thể giả định rằng Google có một chỉ mục quyền威 và một triết lý xếp hạng duy nhất:

Ngay cả trong hệ sinh thái của Google, sự chồng chéo giữa Tìm kiếm truyền thống, Tóm tắt Trí tuệ nhân tạo và Gemini đã chứng minh sự nhỏ đáng ngạc nhiên, với cùng một truy vấn thường tạo ra các danh sách nguồn khác nhau đáng kể tùy thuộc vào hệ thống Google nào xử lý yêu cầu.

Về phần này của phân tích của họ, các tác giả cho biết†:

‘[Bảng trên] trình bày sự tương đồng trung bình giữa danh sách nguồn được trả về bởi AIO, Gemini và SERP truyền thống cho mỗi truy vấn trong tập dữ liệu chuẩn.’

‘Kết luận chính là không phụ thuộc vào tập con truy vấn và cặp công cụ tìm kiếm nào được so sánh, danh sách nguồn được thu thập là khác nhau, mặc dù tất cả đều được phát triển bởi Google.’

Các nhà nghiên cứu cho biết thêm rằng không có phương pháp tìm kiếm nào được thử nghiệm chứng minh sự chồng chéo RBO (Rank-Biased Overlap) trên 0,27, điều này là một điểm số rất thấp. Họ lưu ý thêm rằng Amazon Retail và các truy vấn được định vị (tức là ‘cửa hàng gần tôi’) có sự tương đồng thấp nhất trong số các phương pháp tìm kiếm.

Họ cho rằng sự không đồng nhất giữa các công cụ tìm kiếm là do sự ‘không nhất quán giữa các công cụ tìm kiếm’, lưu ý rằng sự ngẫu nhiên hoặc bất kỳ yếu tố rõ ràng nào khác không thể được sử dụng để giải thích sự mất đồng bộ này.

Một lời giải thích trực quan, có thể, là các điểm dữ liệu huấn luyện được chỉ định thứ hạng theo một cách rất khác so với các phương pháp mà Google đã phát triển cho PageRank và các người kế thừa của nó trong hai thập kỷ qua. Hơn nữa, trên cơ hội rằng thuật toán tìm kiếm của Google có một chương trình nghị sự bí mật, thì loại can thiệp hoặc ‘đánh lừa’ đó là khó hơn để thực hiện một cách nhất quán trong các mô hình AI dựa trên khuếch tán như Gemini (ngay cả thông qua lọc, lời nhắc hệ thống và các phương pháp khác của việc thu thập được áp dụng cho các mô hình thương mại).

Tự phục vụ..?

Một số trang web, hoặc loại trang web, dường như đã bị ảnh hưởng bởi sự ra đời của tóm tắt trí tuệ nhân tạo và sự xâm nhập của tìm kiếm dựa trên LLM vào không gian tìm kiếm truyền thống – cả tích cực và tiêu cực, tùy thuộc vào trường hợp:

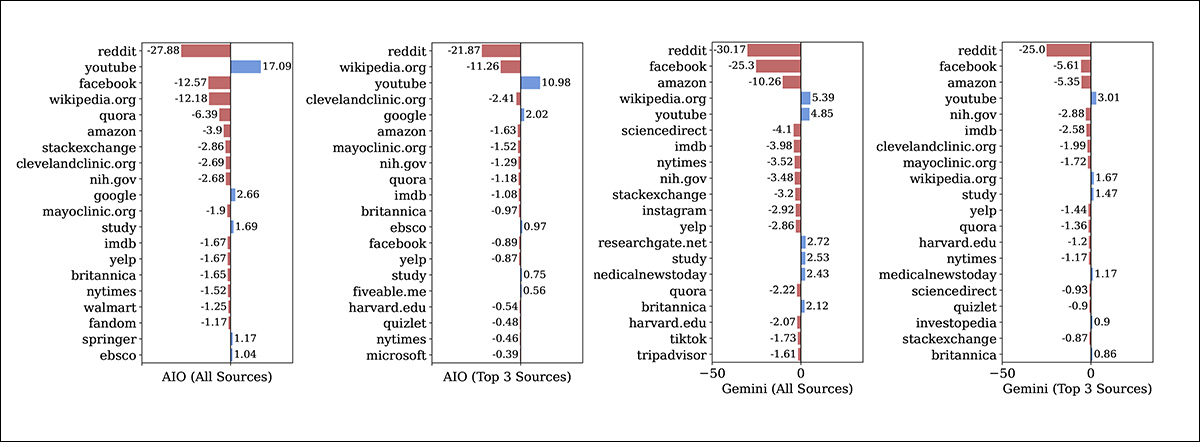

So với Tìm kiếm Google truyền thống, Tóm tắt Trí tuệ nhân tạo và Gemini đều giảm trích dẫn từ nhiều trang web lớn, trong khi tăng khả năng hiển thị cho một số tên miền được ưa chuộng. YouTube đã chứng minh là một trong những người thụ hưởng lớn nhất trên cả hai hệ thống, trong khi Reddit, Wikipedia, Facebook và nhiều nguồn tổ chức xuất hiện ít thường xuyên hơn trong việc thu thập được tạo ra bởi trí tuệ nhân tạo.

Các tác giả lưu ý rằng một số sở thích không mong đợi xuất hiện trong số ba phương pháp, trong quá trình thử nghiệm:

‘Chúng tôi có ba kết luận chính từ [các biểu đồ trên]. Thứ nhất, các trang web lớn và nổi tiếng nhất bị ảnh hưởng nhiều nhất (cả tích cực và tiêu cực). Điều này là trực quan vì các trang web lớn có uy tín và đa dạng trong nội dung để có liên quan đến nhiều truy vấn khác nhau.

‘Thứ hai, đa số các trang web này nhận được ít trích dẫn tổng thể và ít trích dẫn hàng đầu hơn với các công cụ tìm kiếm tạo ra (được chỉ định bởi các thanh màu đỏ và số âm trong [biểu đồ trên]). Điều này cho thấy rằng tìm kiếm tạo ra có xu hướng thu thập thông tin từ các nguồn hẹp hơn so với các công cụ tìm kiếm truyền thống.

‘Thứ ba, Tóm tắt Trí tuệ nhân tạo của Google ưa thích các trang web của Google (tức là các tên miền google.com và youtube.com).

‘Gemini cũng ưa thích YouTube so với Tìm kiếm Google truyền thống, nhưng sự khác biệt tuyệt đối là nhỏ hơn.’

Có ‘chặn’ nào..?

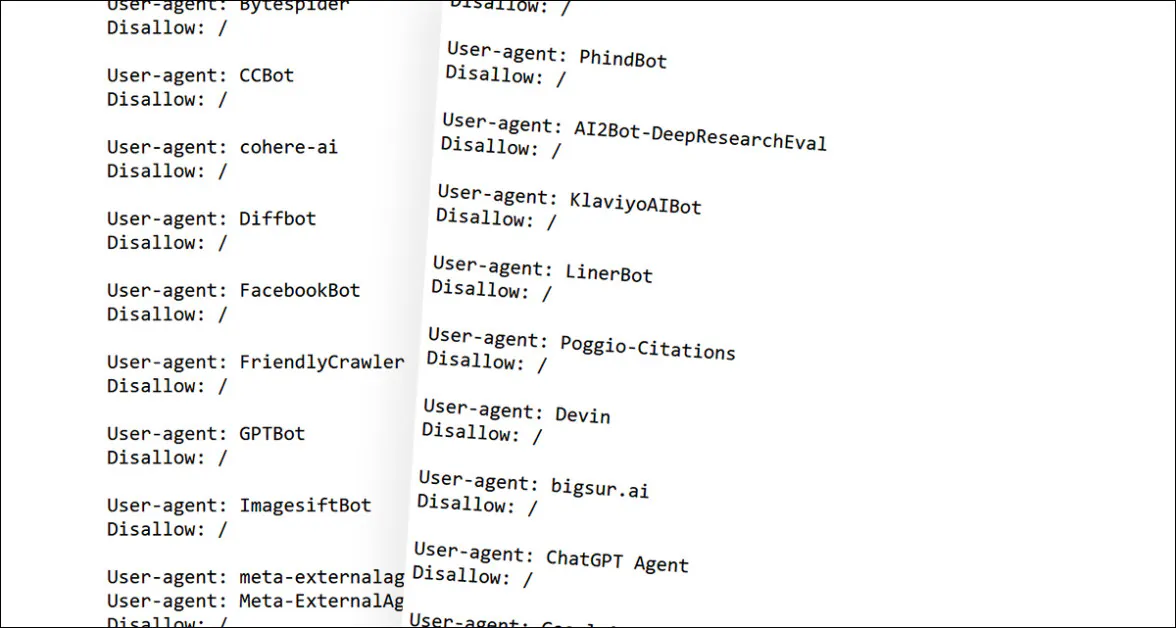

Nghiên cứu cũng cho thấy rằng các nhà xuất bản chặn trình thu thập dữ liệu web AI của Google – một bot web tự động thu thập dữ liệu từ trang web của bạn trừ khi bạn nói với nó không với một tệp robots.txt – có xu hướng không xuất hiện trong tóm tắt trí tuệ nhân tạo.

Điều này có thể看似 một vết thương tự gây ra, nhưng trên thực tế, Google đã công khai tuyên bố rằng nội dung từ các nền tảng chặn trình thu thập dữ liệu AI sẽ không bị ngăn chặn xuất hiện trong tóm tắt trí tuệ nhân tạo; thay vào đó, các nhà xuất bản sẽ không có dữ liệu của họ được thu thập, thu thập thành một bộ sưu tập và chạy qua vòng huấn luyện AI tiếp theo cho Gemini và các dự án AI khác của Google.

Tuy nhiên, đó không phải là kết luận mà các nhà nghiên cứu của bài báo mới đến, khi họ phát hiện ra rằng các nhà xuất bản phổ biến cấm AI ít khi được trích dẫn bởi Gemini, cả trong LLM và phiên bản kết quả tìm kiếm được cắt giảm và linh hoạt hơn. Các nhà xuất bản ‘cấm hiệu quả’ được báo cáo bởi bài báo bao gồm NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports và STAT.

Một số lệnh cấm thu thập dữ liệu AI được thực hiện bởi các nhà xuất bản được liệt kê ở trên. Nhưng liệu nó đã dẫn đến một sự kiểm duyệt rộng hơn bởi Google?

Các tác giả cho biết:

‘Trong phân tích của chúng tôi về các tên miền bị ảnh hưởng nhiều nhất, chúng tôi đã tìm thấy 21 nhà xuất bản phổ biến (được thu thập cho ít nhất 20 truy vấn duy nhất bởi cả Tìm kiếm Google và AIOs) không bao giờ được trích dẫn bởi Gemini.

‘Một số trang web truyền thông xã hội (Facebook, Instagram, Tiktok) và trang web đánh giá (IMDb, Yelp, Tripadvisor) cũng không nhận được trích dẫn từ Gemini. Khi điều tra thêm, chúng tôi đã tìm thấy rằng tất cả các trang web này đều chặn bot Google-Extended trong tệp robots.txt của họ.’

Nếu phát hiện này được xác minh ở nơi khác và tồn tại, người ta có thể suy đoán rằng những công ty này đang bị Google ép buộc phải hợp tác với các hoạt động AI của họ thông qua việc hủy đăng một phần. Khi nhìn thoáng qua, kết quả dường như trừng phạt – nhưng sau đó, những phát hiện của công việc mới hơn là chỉ ra sự hỗn loạn hơn là sự cố ý; do đó, nhận xét hợp lý duy nhất mà người ta có thể đồng ý là những kết quả này trông giống như ‘gây hấn’, bất kể điều gì đang gây ra chúng.

Kết luận

Ý kiến Đây là một bài báo rõ ràng zip-bomb, mà chỉ trong mười trang chính đã mở ra một lượng lớn các phát hiện bổ sung. Vì chúng tôi đã có thời gian để bao phủ chỉ một phần nhỏ của những phát hiện này, tôi khuyên bạn nên đọc bản PDF nguồn ngay cả đối với người đọc thông thường (một sự kiện hiếm).

Mặc dù một ‘tư duy vàng’ có thể đặt ra nhiều cách giải thích tiêu cực về những phát hiện của các tác giả, nhưng công việc này có thể được coi là một nỗ lực của một nhà lãnh đạo công nghệ toàn cầu để đạt được và duy trì lợi thế toàn cầu trong tìm kiếm dựa trên AI, bằng cách sử dụng các nền tảng tương phản cao, được phát triển trong các hoàn cảnh và thời đại rất khác nhau.

Trong khi ba phương pháp tìm kiếm được kiểm tra trong báo cáo, cuộc tranh cãi thực sự là giữa kết quả tìm kiếm truyền thống, được xếp hạng bởi các phương pháp độc quyền, và các phương pháp lựa chọn phân phối dựa trên dữ liệu thống trị việc thu thập và huấn luyện AI.

Trí tuệ nhân tạo như năm 1999

Trước khi có Google, nó có thể ‘đánh lừa’ kết quả tìm kiếm thông qua khối lượng lớn, và theo cách này, một người có thể thường đạt được vị trí trang đầu tiên của SERPS với nỗ lực tối thiểu (thường được tự động hóa). Trò chơi số này đã kết thúc hiệu quả vào năm 2002 bởi thuật toán xếp hạng tìm kiếm phức tạp và bí mật hơn của Google. Nhưng vì những gì đang diễn ra là đáng kể, nội dung chất lượng thấp và khối lượng lớn không bao giờ biến mất theo bất kỳ cách nào có ý nghĩa.

Vì vậy, vào thời điểm các bộ sưu tập lớn như Common Crawl đặt nền móng cho cuộc cách mạng AI hiện đại, sự nổi bật của dữ liệu được định sẵn để bị chi phối bởi mức độ mà các quá trình tự động có thể lọc và xếp hạng chất lượng dữ liệu đầu vào, và (khả năng xảy ra thấp hơn), mức độ mà tiền có sẵn để trả cho người dân để xếp hạng dữ liệu đó.

Có rất nhiều dữ liệu kém chất lượng hoặc không tốt trong những bộ sưu tập lớn và không phân biệt đó; dữ liệu có thể không bao gồm sự khiêu dâm hoặc lời nói thô tục hoặc các chủ đề phân biệt chủng tộc, hoặc bất kỳ điều gì khác dễ dàng lọc ra khỏi tập dữ liệu huấn luyện – nhưng vẫn tự phục vụ và có khối lượng lớn, giống như kết quả tìm kiếm trên internet khoảng 1999-2001.

Vì các quá trình cảm nhận dữ liệu vẫn chưa tốt, rất khó ngay cả đối với Google để khiến AI hoạt động theo cách kinh doanh, vì các quyết định của Gemini theo kiểu PageRank được quyết định không bởi các kỹ sư chính sách của Google, mà bởi sự hiểu biết không hoàn hảo về cách dữ liệu hyperscale biến thành phân phối dữ liệu và bản nhúng tiềm ẩn trong quá trình huấn luyện mô hình AI.

* Trang kết quả tìm kiếm.

† Các tác giả nhấn mạnh, không phải của tôi. Tuy nhiên, tôi đã thay thế dấu nhấn mạnh bằng chữ đậm, vì dấu nhấn mạnh bằng chữ nghiêng không hoạt động tốt trong các trích dẫn đã được nhấn mạnh.

Được xuất bản lần đầu vào thứ Tư, ngày 13 tháng 5 năm 2026