Штучний інтелект

Mistral AI: встановлення нових стандартів у відкритому джерелі за межами Llama2

Великі мовні моделі (LLM) останнім часом зайняли центральне місце, завдяки видатним виконавцям, таким як ChatGPT. Коли Meta представила свої моделі Llama, це спровокувало відновлення інтересу до відкритих мовних моделей. Метою було створити доступні, відкриті мовні моделі, які були б такими ж хорошими, як топові моделі, такі як GPT-4, але без високої ціни або складності.

Ця суміш доступності та ефективності не тільки відкрила нові можливості для дослідників і розробників, але й створила сцену для нової ери технологічних досягнень у обробці природної мови.

Нещодавно стартапи з генерації штучного інтелекту отримали фінансування. Разом підняли 20 мільйонів доларів, маючи на меті сформувати відкритий штучний інтелект. Anthropic також підняв вражаючі 450 мільйонів доларів, а Cohere, партнеруючи з Google Cloud, отримав 270 мільйонів доларів у червні цього року.

Введення в Mistral 7B: розмір та доступність

Mistral AI, заснована в Парижі і співзаснована випускниками Google DeepMind і Meta, оголосила про свій перший великий мовний модель: Mistral 7B. Ця модель може бути легко завантажена будь-ким з GitHub і навіть через 13,4-гігабайтний торент.

Ця стартап змогла забезпечити рекордне фінансування ще до того, як вони мали продукт. Mistral AI першої моделі з 7 мільярдами параметрів перевершує продуктивність Llama 2 13B у всіх тестах і перевершує Llama 1 34B у багатьох метриках.

У порівнянні з іншими моделями, такими як Llama 2, Mistral 7B забезпечує подібні або кращі можливості, але з меншим обчислювальним навантаженням. Хоча фундаментальні моделі, такі як GPT-4, можуть досягти більшого, вони мають вищу ціну і не так користувацькі, оскільки вони в основному доступні через API.

Коли мова йде про завдання кодування, Mistral 7B дає CodeLlama 7B можливість конкурувати. Плюс, вона компактна enough на 13,4 ГБ, щоб запускатися на стандартних машинах.

Крім того, Mistral 7B Instruct, налаштований спеціально для інструктивних наборів даних на Hugging Face, показав хорошу продуктивність. Він перевершує інші 7B-моделі на MT-Bench і стоїть плечем до плечу з 13B-чат-моделями.

Hugging Face Mistral 7B Приклад

Бенчмаркінг продуктивності

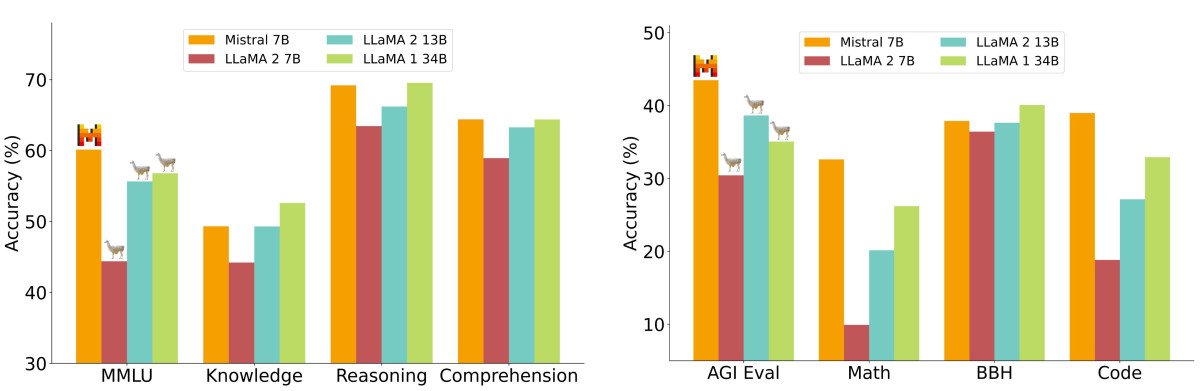

У детальному аналізі продуктивності Mistral 7B був виміряний проти моделей сімейства Llama 2. Результати були чіткими: Mistral 7B суттєво перевершив Llama 2 13B у всіх бенчмарках. Насправді, він збігся з продуктивністю Llama 34B, особливо виділявся у кодуванні та розумових бенчмарках.

Бенчмарки були організовані в кілька категорій, таких як Розуміння загального сенсу, Světові знання, Читання з розумінням, Математика та Код, серед інших. Особливо вартиме уваги спостереження за тим, що Mistral 7B показав метрику “еквівалентний розмір моделі”, що означає потенційні економії пам’яті та підвищення пропускної здатності. Однак у бенчмарках знань Mistral 7B збігся з Llama 2 13B, що, ймовірно, пояснюється обмеженнями параметрів, які впливають на стиснення знань.

Що робить модель Mistral 7B кращою за більшість інших мовних моделей?

Упрощення механізмів уваги

Хоча нюанси механізмів уваги технічні, їх основна ідея відносно проста. Припустимо, ви читаєте книгу і виділяєте важливі речення; це аналогічно тому, як механізми уваги “виділяють” або надають важливість конкретним даним у послідовності.

У контексті мовних моделей ці механізми дозволяють моделі зосередитися на найбільш важливих частинах вхідних даних, забезпечуючи, щоб вихід був узгодженим і контекстно точним.

У стандартних трансформерах оцінки уваги обчислюються за формулою:

Формула для цих оцінок включає важливий крок – матричне множення Q і K. Виклик полягає в тому, що при зростанні довжини послідовності обидві матриці розширюються відповідно, що призводить до обчислительно інтенсивного процесу. Ця проблема масштабування є однією з основних причин, чому стандартні трансформери можуть бути повільними, особливо при роботі з довгими послідовностями.

Багатокритерійна увага (MQA) прискорює речі, використовуючи один набір “ключ-значення” голів, але іноді жертвує якістю. Тепер ви можете запитати, чому не поєднати швидкість MQA з якістю багатоголової уваги? Саме тут з’являється групована запит-увага (GQA).

Групована запит-увага (GQA)

GQA є компромісним рішенням. Замість використання одного або декількох “ключ-значення” голів, вона групує їх. Таким чином, GQA досягає продуктивності, близької до багатоголової уваги, але з швидкістю MQA. Для моделей, таких як Mistral, це означає ефективну продуктивність без суттєвої жертви якості.

Увага з ковзним вікном (SWA)

Ковзне вікно є ще одним методом, який використовується при обробці послідовностей уваги. Цей метод використовує фіксоване вікно уваги навколо кожного токена в послідовності. З кількома шарами, які накладають це вікно уваги, верхні шари в кінцевому підсумку отримують ширший погляд, охоплюючи інформацію з усієї вхідної послідовності. Цей механізм аналогічний рецепторним полям, які спостерігаються в Конволюційних нейронних мережах (CNN).

З іншого боку, “дилатоване ковзне вікно уваги” моделі Longformer, яке концептуально подібне до методу ковзного вікна, обчислює лише кілька діагоналей матриці . Ця зміна призводить до того, що використання пам’яті збільшується лінійно, а не квадратично, що робить його більш ефективним методом для довгих послідовностей.

Прозорість Mistral AI проти проблем безпеки у децентралізації

У своєму оголошенні Mistral AI також підкреслила прозорість заявою: “Немає трюків, немає пропрієтарних даних”. Але зараз їх єдина доступна модель – ‘Mistral-7B-v0.1’ – це попередньо тренована базова модель, тому вона може генерувати відповідь на будь-яке запит без модерації, що викликає потенційні проблеми безпеки. Хоча моделі, такі як GPT і Llama, мають механізми для визначення часу відповіді, повністю децентралізована природа Mistral може бути використана зловмисниками.

Однак децентралізація великих мовних моделей має свої переваги. Хоча деякі можуть її використати неправильно, люди можуть використовувати її силу для суспільного добра та зробити інтелект доступним для всіх.

Гнучкість розгортання

Одним з виділень є те, що Mistral 7B доступна під ліцензією Apache 2.0. Це означає, що немає реальних бар’єрів для використання її – незалежно від того, чи використовуєте ви її для особистих цілей, великої корпорації чи навіть урядової установи. Вам просто потрібна правильна система для запуску її, або вам може знадобитися інвестувати в хмарні ресурси.

Хоча є інші ліцензії, такі як простіша ліцензія MIT і кооперативна ліцензія CC BY-SA-4.0, яка вимагає згадку і подібну ліцензію для похідних робіт, ліцензія Apache 2.0 забезпечує міцну основу для великомасштабних підприємств.

Останні думки

Поява відкритих великих мовних моделей, таких як Mistral 7B, означає переломний момент у галузі штучного інтелекту, роблячи високоякісні мовні моделі доступними для ширшої аудиторії. Інноваційні підходи Mistral AI, такі як групована запит-увага і ковзне вікно уваги, обіцяють ефективну продуктивність без суттєвої жертви якості.

Хоча децентралізована природа Mistral створює певні проблеми, її гнучкість і відкрита ліцензія підкреслюють потенціал для демократизації штучного інтелекту. По мірі розвитку ландшафту, увагу буде прикуто до балансування сили цих моделей з етичними розглядачами та механізмами безпеки.

Що далі для Mistral? Модель 7B була тільки початком. Команда планує запустити ще більші моделі скоро. Якщо ці нові моделі матимуть таку саму продуктивність, як 7B, Mistral може швидко піднятися як один з лідерів галузі, все це впродовж свого першого року.