Лідери думок

Автономні агенти потребують більшого, ніж спостереження за штучним інтелектом

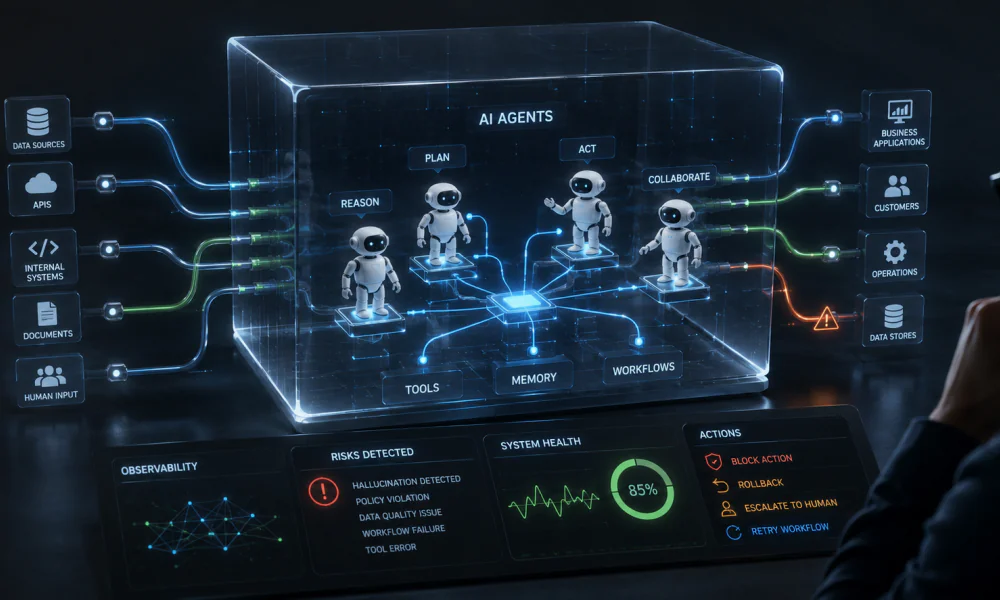

Когда компанії використовують агенти штучного інтелекту для думання, дії та ініціювання робочих процесів, важливо розробити план моніторингу та управління ними.

Коли різні компоненти системи штучного інтелекту починають приймати власні рішення, спостереження лише не достатньо для забезпечення того, що операції залишаться стабільними, безпечними чи надійними.

Для ефективного управління агентами штучного інтелекту на підприємстві компанії повинні звести розрив між ідентифікацією проблем та діями. Це означає не лише спостереження за проблемами, але й активну їх попередження.

Поява автономних агентів

Перша хвиля корпоративного штучного інтелекту була заснована на запитах; користувач задавав запит, модель відповідала, і обмін закінчувався там. Хоча ці ранні технології були по суті реактивними, вони були корисними для пошуку, копілотів, створення контенту та резюмів.

Наступна хвиля відрізняється. Автономні агенти штучного інтелекту не лише реагують, але й мислять через цілі, вибирають інструменти, витягують інформацію, діють та ініціюють робочі процеси. Іноді вони працюють разом з іншими агентами або системами та все частіше виконують роль оперативних гравців у компанії, а не лише інтерфейсного шару для людських інструкцій.

Ця зміна суттєва, оскільки вона впливає на оперативні характеристики штучного інтелекту. Команди більше не лише спостерігають за виходами моделей. Натомість, вони керують динамічними системами, які можуть миттєво вплинути на клієнтів, персонал, інфраструктуру, бізнес-процеси та інші додатки.

Можливості агентів сьогодні

Таланти агентів еволюціонують разом з ними. Агенти можуть вибирати, що робити далі, розбивати цілі на кроки та виконувати діяльність на різних рівнях. Зв’язуючись з API, запитуючи бази даних, шукаючи внутрішні системи, оновлюючи записи та ініціюючи подальші дії, вони координують робочі процеси. Інтегруючи запити, пам’ять, бізнес-правила, витягнуту інформацію та операційні сигнали в реальному часі, агенти можуть також приймати рішення, засновані на контексті.

Більш розвинені агенти можуть визначити, коли робочий процес провалюється, спробувати знову, ескалювати проблеми або передати завдання людині-ревізору. У CRM, тикетах, хмарі інфраструктури, внутрішніх базах знань, платформах спостереження та бізнес-додатках агенти можуть працювати самостійно. Ми очікуємо, що ці навички продовжать швидко розвиватися.

Як компанії інтегрують автономних агентів штучного інтелекту

Агенти інтегруються в усе більшу кількість організаційних операцій, і вони наближаються до оперативних процесів, де швидкість, точність, безпека та керування є важливими. Деякі з цих операцій включають: обслуговування клієнтів та обробку випадків, реагування на інциденти та операції з IT, робочі процеси для DevOps та залежності сайту, виправлення коду та розробку програмного забезпечення, оперативне та ланцюжкове планування постачання, та багато іншого.

Нові оперативні загрози

Однак, оскільки агенти стають усе більш автономними, компанії повинні мати справу з новим видом оперативного ризику.

- Погані рішення не лише пропонуються; вони часто реалізуються

- Незначні помилки можуть швидко поширитися на інші пов’язані системи

- Дії в реальному світі можуть бути спровоковані галюцинаціями

- Агенти можуть відхилитися від бізнес-інтенту, політики або дотримання нормативних вимог

- Взаємодії між декількома компонентами можуть призвести до відмов

- Автоматизоване прийняття рішень може приймати рішення швидше, ніж людська оцінка

Хоча команди можуть спостерігати симптоми, їм також потрібно бути здатними зрозуміти причини поведінки системи.

Складності систем штучного інтелекту

Сучасні системи, керовані штучним інтелектом, рідко складаються з однієї моделі. Це розподілені, шарові системи, що складаються з багатьох взаємодіючих компонентів, які включають:

- Базові моделі (LLM)

- Дообучені або спеціалізовані маленькі моделі мови (SLM)

- Моделі вкладень

- Векторні бази даних

- Пайплайни витягування та компоненти RAG

- Шаблони запитів та шари оркестрування запитів

- Набори даних для навчання та оцінки

- Перевірки та шари політики

- Агенти та робочі процеси

- Системи виклику інструментів

- Телеметрія (ака журнали, метрики та траси)

- Людина в циклі затвердження контрольних точок

Їх ризики

Кожен компонент додає різний режим відмови, а їх взаємодія додає ще більше складності. Навіть якщо система здається сильною на рівні інфраструктури, вона все одно може приймати погані рішення та генерувати задовільні результати; все це відбувається при накопиченні оперативного ризику під поверхнею.

Деякі з цих ризиків включають: введення поганих або пошкоджених входів через пайплайни даних, інфраструктурні瓶 cổ, що знижують надійність, шкідливі або помилкові результати, та оперативні瓶 cổ у відповідь на людську оцінку. Ще більше ускладнюючи питання, системи з декількома агентами або кроками можуть відмовляти способами, які не є одразу очевидними.

Спостереження штучного інтелекту

Традиційне моніторинг недостатнє для розуміння поведінки запитів, якості витягування, дрейфу моделі, каналів виконання агентів або зв’язку між поведінкою штучного інтелекту та подальшим бізнес- чи оперативним впливом.

Саме тут вступає в дію спостереження штучного інтелекту. Спостереження штучного інтелекту дозволяє командам зрозуміти, як системи штучного інтелекту функціонують у виробництві, збираючи, корелюючи та оцінюючи входи та виходи, бажану поведінку та сигнали рішень, генерованих цими системами. Це суттєво важливо, оскільки системи штучного інтелекту розподілені, недетермініровані та надзвичайно контекстно-чутливі.

Спостереження штучного інтелекту пропонує повний огляд робочих процесів штучного інтелекту, тому команди, які використовують його, можуть зрозуміти, як запити, моделі, шари витягування, інструменти та подальші системи взаємодіють під час виконання.

Спостереження штучного інтелекту дозволяє моніторити продуктивність та поведінку, включаючи затримку, вартість, використання токенів, пропускну здатність, показники помилок, поведінку моделі та індикатори якості виходу. Воно відстежує та аналізує шляхи виконання в складних робочих процесах агентів та демонструє, як результати досягаються через декілька кроків та залежностей.

Спостереження штучного інтелекту також виявляє аномалії по операційним та сигналам штучного інтелекту, викриваючи аномальну поведінку в моделях, пайплайнах, інфраструктурі або результатах, орієнтованих на користувача, до того, як команди виявлять їх вручну. Воно прискорює діагностику, коли щось пішло не так, та робить дослідження кореневої причини легшим, включаючи операції, специфічні для штучного інтелекту, до системної телеметрії (журналів, метрик, трас та подій).

Спостереження лише не достатньо

Хоча спостереження штучного інтелекту є суттєвою бізнес-практикою, воно має вбудовані обмеження.

Спостереження діагностичне, а не превентивне; команди можуть дізнатися, що пішло не так, але не обов’язково, як запобігти цьому в майбутньому. Важливо зрозуміти, що знання про минулі дії агента не автоматично перекладається у контроль над майбутніми діями агента.

У випадку з складними недетермінірованими системами спостереження може часто перегрузити команди даними, які ведуть до невизначеності. Навіть якщо команди знають про проблему, вони можуть не мати автоматизації, охорони та контрольних циклів, необхідних для прийняття коригувальних дій.

Це створює оперативний розрив. Компанії можуть виявити дрейф, погані результати, небезпечну поведінку чи погіршення продуктивності, але вони все одно можуть бути не в змозі запобігти цьому, пом’якшити його наслідки чи підтримувати автономні системи в межах безпечних оперативних параметрів.

Це означає, що команди продовжують працювати реактивно. Вони використовують ручне втручання, коли щось ламається, розслідують інциденти після факту та покладаються на людську працю, щоб компенсувати системи, які стають швидшими та більш автономними.

Огляд надійності штучного інтелекту

Надійність штучного інтелекту виходить за рамки простого спостереження за проблемами. Це дисципліна, яка забезпечує безпечну, послідовну, передбачувану та успішну роботу систем штучного інтелекту в реальних умовах виробництва. Надійність штучного інтелекту охоплює та керує цілою системою систем навколо штучного інтелекту. Вона закриває цикл між виявленням та діями.

Надійність штучного інтелекту зосереджується на тому, чи може вся система, керована штучним інтелектом, функціонувати в межах розумних оперативних обмежень з часом, а не лише на тому, чи надала модель точну відповідь. Якість, безпека, стійкість, пояснюваність, дотримання політики, ефективність витрат та оперативна стабільність входять до цього рівня.

Перехід від виявлення до попередження

Надійність штучного інтелекту зменшує час між виявленням проблеми та її вирішенням. Це зсуває розмову від “що пішло не так?” до “як швидко наш штучний інтелект покращиться?” Застосування таких технік, як:

- Кореляція сигналів по моделям, даних та інфраструктурі для виявлення проблем

- Профілактичне виявлення проблем до їх впливу

- Перевірка всіх входів та виходів у ймовірнісних системах штучного інтелекту для виявлення тонких змін поведінки

- Створення зворотного зв’язку між виявленням нежаданих виходів у виробництві та використанням цього для генерації даних дообучення, які покращують точність моделей

- Мультиагентне відстеження робочих процесів для забезпечення можливості з’єднання точок щодо того, чому та як дані еволюціонували для інформування складних дій

- Визначені людино-циклічні робочі процеси агентів для безпечної реакції та автоматизованого виправлення

Закриття розриву між контролем та спостереженням

Компанії виграють від рамок, які інтегрують видимість та контроль і вимагають більше, ніж лише шар спостереження на вершині генеративного штучного інтелекту. У cả детермінірованих, так і недетермінірованих системах платформа надійності може визначити, передбачити, пояснити та допомогти контролювати проблеми.

До життєздатної рамки для надійних операцій штучного інтелекту повинні входити:

- Інтегрована телеметрія для як IT-систем, так і систем штучного інтелекту

- Відстеження робочих процесів агентів та залежностей систем

- Відстеження поведінки та якості штучного інтелекту (запитів та оцінок)

- Розширений виявлення аномалій, незалежно від джерела

- Причинне мислення та аналіз кореневої причини

- Сповіщення, які автоматично адаптуються до вашого середовища та не потребують ручних порогів

- Виконання політики та перил

- Людина в циклі оцінки деликатних чи суттєвих дій

- Автоматизація робочих процесів та координація виправлення

- Використання прогнозного аналізу для попередження проблем

- Зворотні зв’язки, які з’єднують виявлення аномалій з покращенням якості моделей штучного інтелекту

Фасилітація функцій штучного інтелекту

Системи штучного інтелекту залежать від інфраструктури, сервісів, пайплайнів даних та оперативних процедур; вони не відмовляють самостійно. Команди отримують повну картину, коли надійність штучного інтелекту та IT об’єднані.

Тонкий шар LLM не повинен бути основою надійної платформи. Для виявлення та виправлення проблем, які інші інструменти штучного інтелекту можуть пропустити, слід розглянути різні техніки штучного інтелекту, включаючи ненадзорний штучний інтелект, прогнозний штучний інтелект, причинний штучний інтелект та генеративний штучний інтелект. Ця комбінація технік часто називається “композитним штучним інтелектом”.

Генеративний штучний інтелект добре підходить для резюмування природної мови. Він найкраще підходить для ситуацій, які потребують міркування через неструктуровані дані або взаємодію з людьми. Але це не відповідає формі більшості проблем надійності у виробництві.

Прогнозний штучний інтелект зосереджується на виявленні ранніх сигналів до того, як вони стануть виходами, поганими клієнтськими досвідами чи дорогими відмовами, використовуючи алгоритми виявлення аномалій.

Причинний штучний інтелект допомагає визначити справжні кореневі причини, щоб розкрити, чи була причиною зниження продуктивності якість витягування, поведінка моделі, повільність інфраструктури, апстрім-дрейф даних чи виходи системи.

Ненадзорний штучний інтелект самостійно виявляє приховані закономірності, структури чи аномалії в даних без людського керівництва. Він перевершує генеративний штучний інтелект для надійності, оскільки зосереджується на пошуку прихованих структур у складних, некласифікованих даних для групування подібних предметів чи виявлення відносин.

Коли ризик, неоднозначність чи бізнес-наслідки суттєві, оперативні агенти штучного інтелекту повинні бути здатними автоматизувати реакцію, зберігаючи людське втручання для надійних операцій.

Поняття моделі штучного інтелекту про конкретний бізнес-контекст можна покращити в кожному взаємодії, використовуючи навчання з посиленням з реальних даних користувачів у виробництві.

Навіть найрозвітліші системи виходять за рамки сповіщень; закрита ремедіація вивчає кожний інцидент з часом, автоматизує визнані реакції та ініціює безпечні заходи.

Підготовка до автономних систем штучного інтелекту

Компанії можуть підготуватися до автономних систем штучного інтелекту кількома способами. По-перше, агентів слід розглядати як оперативні системи, а не як інструменти продуктивності. Як тільки агент має можливість діяти, він стає інтегральною частиною бізнес-операцій та повинен регулюватися відповідним чином.

Команди можуть реєструвати сигнали від моделей, запитів, інструментів, робочих процесів, інфраструктури та результатів користувачів відразу, інструментуючи агентів. Це базове спостереження не повинно бути відкладено до тих пір, поки агенти не стануть суттєвими для бізнесу.

Встановлення стандартів надійності до широкого розгортання агентів також є важливим. Замість того, щоб вводити їх після факту, прийнятні пороги для безпеки, затримки, показників помилок, ризику галюцинацій, дотримання політики та бізнес-впливу повинні бути закладені в їхньому дизайні.

Зв’язування поведінки штучного інтелекту з підлеглими системами та процедурами дозволяє компаніям інтегрувати операції штучного інтелекту та IT. Використання різних інструментів для інфраструктури та моніторингу моделей створює сліпі плями.

Інженерія платформи, SRE, команди безпеки, дані, команди штучного інтелекту та власники бізнесу повинні працювати разом, щоб забезпечити надійні операції штучного інтелекту, а автономні системи виходять за рамки традиційних силосів.

Кожен інцидент, аномалія та майже-невипад підвищить систему, включивши зворотні зв’язки в операції, що дозволить компаніям безперервно вивчати поведінку виробництва.

Нарешті, важливо вибрати платформи, призначені для контролю, а не лише для спостереження. Компанії виграють від систем, які інтегрують спостереження, передбачення, пояснення та дію, оскільки агенти штучного інтелекту стають більш автономними. Організації, які успішно переходять від виявлення проблем до безпечного контролю результатів, будуть переможцями.

Основна думка

Штучний інтелект у бізнесі тепер є оперативною системою в корпоративних середовищах, а не інструментом. У реальних умовах виробництва додавання надійності до систем штучного інтелекту гарантує безпечну, послідовну, передбачувану та ефективну роботу.