Лідери думок

Практичний посібник для обґрунтованих виходів LLM

Існує тиха припущення, що проходить через більшість підприємств GenAI розгортань: якщо вихід виглядає правильно, то він правильний. У низькоризикових середовищах це прийнятний捷кий шлях. У регульованих галузях, таких як охорона здоров’я, фінанси, фармацевтика та забезпечення якості, це відповідальність, яка чекає на поверхню.

Момент, коли вихід LLM впливає на клінічне рішення, фінансовий запис або документ з питань дотримання законодавства, гладкість припиняє бути заміною для надійності. І коли аудитор, регулятор або юридична команда запитують, які дані були використані, які правила застосовувалися та хто їх затвердив, “модель сказала так” не є відповіддю, яку хто-небудь може підтвердити.

Це відповідальність розрив, який більшість команд GenAI не проектує. Ось як його закрити.

Чому “виглядає правильно” – це неправильний стандарт

Традиційна оцінка штучного інтелекту зосереджується на точності, затримці та вартості. Це важливо. Але регульовані середовища вводять четверту вісь, яку інші не можуть замінити: аудитність.

Європейський закон про штучний інтелект, який зараз діє, вимагає, щоб високоризиковані системи штучного інтелекту підтримували технічну документацію, журнали слідів та докази людського нагляду протягом всього їхнього життєвого циклу. Перший проект керівних принципів FDA щодо штучного інтелекту у розробці лікарських засобів і біологічних препаратів вказує на той же напрямок для галузей життя. Ці рамки не оцінюють гладкість. Вони вимагають систем, які можна реконструювати, інспектувати та захищати.

Обґрунтований вихід LLM – це той, який можна простежити через верифіковану ланцюжок доказів: які дані він використовував, які обмеження сформували його, хто його переглянув та що було збережено для майбутньої інспекції. Без цієї ланцюжки навіть правильний вихід є необґрунтованим.

Це переформулює те, що насправді означає “готовність до виробництва” для штучного інтелекту в керованих середовищах.

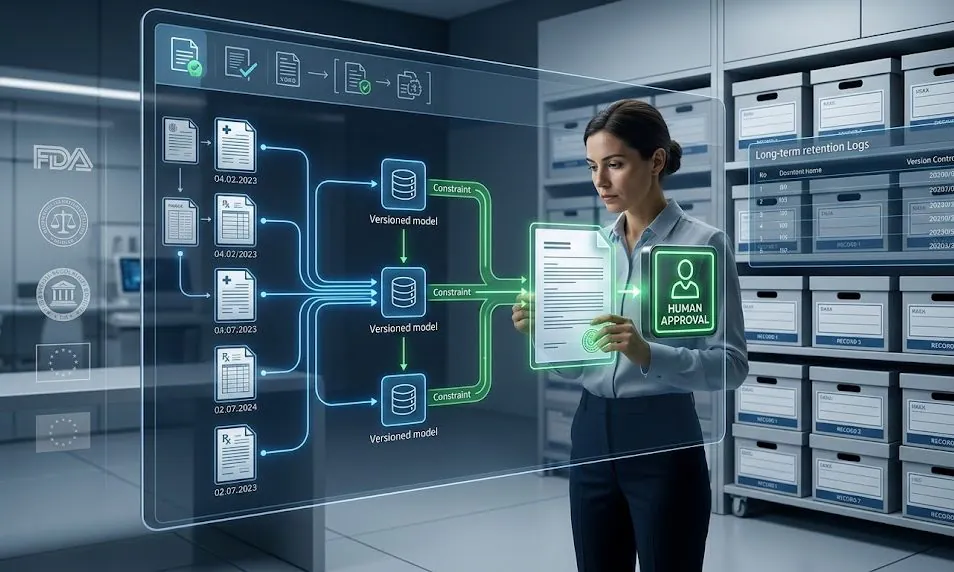

Чотири стовпи аудит-готового GenAI

Створення обґрунтованих систем LLM складається з чотирьох інженерних вимог. Вони не є абстрактними принципами – вони є інфраструктурними рішеннями, які визначають, чи може ваша система витримати перевірку.

1. Походження: Контролюйте, де модель отримує інформацію

Найпоширеніший режим відмови в корпоративному штучному інтелекті також є найменш помітним: моделі, які використовують загальні знання або слабо визначені джерела даних. Коли немає контрольованого кордону знань, виходи не можна простежити до жодного аудитного джерела, і реконструкція стає неможливою.

Практичне рішення полягає в тому, щоб встановити затверджений кордон знань: версійовані, володіють документами та наборами даних, які система явно дозволена використовувати. Кожна відповідь повинна мати мінімальний пакет доказів: ідентифікатор джерела з версією та датою дії, журнал витягнення, який показує, що було запитується та вибрано, та цитати в тексті. Корисна робоча правило: немає цитати, немає твердження.

Це перетворює систему з генерації на основі пам’яті на висновок на основі доказів. Відмінність стає критичною, коли кому-небудь потрібно реконструювати конкретний вихід через тижні або місяці після його генерації.

2. Обмеження: Замініть імпровізацію на контрольовану поведінку

LLM створені для того, щоб бути переконливими. Без обмежень вони оптимізуються для правдоподібності, а правдоподібність у регульованому контексті – це місце, де живе ризик.

Обмеження – це механізм, який перетворює ймовірнісний текстовий генератор у обмежений виконавчий компонент. На практиці це означає:

- Джерело-зв’язана генерація: кожне твердження вимагає затвердженого, версійованого джерела. Ні джерела – ні відповіді – тільки відмову або ескалацію.

- Структуровані схеми виходу: Відповіді слідують визначеним форматам, які машини та аудитори можуть валідувати, а не тільки читати.

- Застосування меж довіри: витягнутий вміст обробляється як вхід, безпосередньо адресуючи ризики ін’єкції запиту, які можуть підірвати як безпеку, так і аудитність.

- Мінімальний привілей доступу: модель взаємодіє тільки з даними та інструментами, які вона真正需要, зберігаючи чисті аудитні сліди.

Обмеження не є позначкою відповідності. Вони є архітектурним рішенням, яке визначає, чи може ваша система бути аудитованою взагалі.

3. Перегляд: Зробіть людський нагляд формальним контролем

У регульованому штучному інтелекті людський перегляд не може бути ад хок. Він потребує ризик-стратифікації (більш ризиковані виходи викликають суворішу валідацию) та подієвого, активуючого, коли модельна впевненість низька, джерела відсутні або виявлені аномалії.

Європейський закон про штучний інтелект явно вимагає, щоб люди могли інтерпретувати, перевищувати та зупиняти рішення, керовані штучним інтелектом, у високоризикових випадках використання. Виконання цього вимог означає, що записи перегляду повинні захоплювати, хто затвердив вихід, під яким умовами та з яким рівнем уваги. “Хтось перевірив це” не є контролем. Документований, датований запис перегляду є.

Це підвищує перегляд з ручної якості до формального рівня керування, яким регулятори починають його розглядати.

4. Збереження: Зробіть відповідальність тривалою

Без журналів немає аудитної сліди. Без аудитної сліди відповідальність є теоретичною.

Водночас збереження всього створює свої ризики, особливо там, де чутливі дані про здоров’я чи фінанси підлягають вимогам мінімалізації згідно з рамками, такими як GDPR або HIPAA.

Практичний підхід – це щабельова модель. Завжди зберігайте метадані моделі та версії, ідентифікатори джерел, рішення політики, та часові мітки. Зберігайте вміст взаємодії (запити, виходи та повні сліди) вибірково, на основі класифікації ризику, з відповідним редагуванням та контролем доступу. Метою є забезпечення реконструкції будь-якого виходу без надмірного збору даних, які створюють подальшу експозицію.

Як це виглядає на практиці

Розгляньте, як це застосовується в галузі життя, де CFR 21 Part 11 вимагає, щоб електронні записи були атрибутними, читабельними, сучасними, оригінальними та точними. LLM, який генерує регуляторну документацію, повинен задовольняти всі п’ять критеріїв – не тільки виробляти читабельний текст.

У цьому контексті чотири стовпи не є необов’язковими поліпшеннями. Вони є мінімальним рівнем для відповідної системи. Походження забезпечує, що вихід є атрибутним та оригінальним. Обмеження забезпечують, що він залишається в межах визначених кордонів. Перегляд забезпечує, що він є сучасним з людським наглядом. Збереження забезпечує, що він є читабельним та інспектованим.

Та сама логіка застосовується у фінансових послугах, де MiFID II вимагає записів рішень та理由, що стоять за ними, та у сфері охорони здоров’я, де системи підтримки клінічних рішень все частіше піддаються перевірці щодо пояснюваності та упередженості.

Більша зміна

GenAI переходить від експериментів до операційної інфраструктури. Цей перехід підвищує стандарт того, яким повинен бути прийнятний систем.

Корисний вихід вже не достатньо. Організації потребують виходів, які можна пояснити, простежити та захистити під перевіркою, оскільки штучний інтелект запитується робити речі, які мають реальні наслідки.

Команди, які проектують обґрунтованість з самого початку, будуть позиціонуватися для масштабування штучного інтелекту безпечно та підтримувати регуляторне довір’я. Ті, хто цього не робить, врешті-решт зустрінуться з тим же моментом: перевіркою, простим запитом про конкретний вихід та нічого не показують для цього.

Створення аудит-готового штучного інтелекту не означає сповільнення. Це означає будівництво чогось, що може тривати.