Andersons vinkel

Mot total kontroll i AI-videogenerering

Videomodeller som Hunyuan och Wan 2.1 är kraftfulla, men erbjuder inte användarna den typ av granulära kontroller som film- och TV-produktion (särskilt VFX-produktion) kräver.

I professionella visuella effektsstudior används öppen källkodsmodeller som dessa, tillsammans med tidigare bildbaserade (i stället för video) modeller som Stable Diffusion, Kandinsky och Flux, vanligtvis tillsammans med en rad stödverktyg som anpassar deras råutdata för att möta specifika kreativa behov. När en regissör säger: “Det ser bra ut, men kan vi göra det lite mer [n]?” kan man inte svara genom att säga att modellen inte är tillräckligt exakt för att hantera sådana förfrågningar.

I stället kommer en AI-VFX-grupp att använda en rad traditionella CGI- och kompositionstekniker, i kombination med anpassade procedurer och arbetsflöden som utvecklats över tid, för att försöka pusha gränserna för videosyntes lite längre.

Så, genom analogi, är en grundläggande videomodell mycket lik en standardinstallation av en webbläsare som Chrome; den gör mycket direkt, men om du vill att den ska anpassa sig till dina behov, snarare än tvärtom, kommer du att behöva några tillägg.

Kontrollfreaks

I världen av diffusion-baserad bildsyntes är den viktigaste sådana tredjeparts-systemet ControlNet.

ControlNet är en teknik för att lägga till strukturerad kontroll till diffusion-baserade generativa modeller, som tillåter användare att vägleda bild- eller videogenerering med ytterligare indata som kanter, djupkarter eller poseinformation.

bild (översta raden), semantisk segmentering > bild (nedre vänstra) och pose-styrd bildgenerering av människor och djur (nedre vänstra).” width=”779″ height=”422″ /> ControlNets olika metoder tillåter djup > bild (översta raden), semantisk segmentering > bild (nedre vänstra) och pose-styrd bildgenerering av människor och djur (nedre vänstra).

I stället för att enbart förlita sig på textpromptar introducerar ControlNet separata neurala nätverksgrenar, eller adapters, som bearbetar dessa villkorsignalerna samtidigt som de bevarar den grundläggande modellens generativa förmågor.

Detta möjliggör finjusterade utdata som följer användar-specifikationerna närmare, vilket gör det särskilt användbart i tillämpningar där exakt komposition, struktur eller rörelsekontroll krävs:

Med en guidande pose kan en mängd olika precisa utdatatyper erhållas via ControlNet. Källa: https://arxiv.org/pdf/2302.05543

Men adapter-baserade ramverk av detta slag fungerar externt på en uppsättning neurala processer som är mycket inriktade internt. Dessa tillvägagångssätt har flera nackdelar.

Först tränas adapters oberoende, vilket leder till grenkonflikter när flera adapters kombineras, vilket kan medföra försämrad genereringskvalitet.

Sedan introducerar de parameternödvändighet, vilket kräver extra beräkning och minne för varje adapter, vilket gör skalning ineffektivt.

Tredje, trots deras flexibilitet, producerar adapters ofta underoptimala resultat jämfört med modeller som är fullständigt finjusterade för multi-konditions generering. Dessa problem gör adapter-baserade metoder mindre effektiva för uppgifter som kräver sömlös integration av flera kontrollsignaler.

Idealt skulle ControlNets förmågor tränas naturligt in i modellen, på ett modulärt sätt som kunde anpassa sig till senare och mycket förväntade innovationer som samtidig video/ljudgenerering eller inbyggda läppsynkroniseringsförmågor (för externa ljud).

Som det är, representerar varje extra funktionalitet antingen en postproduktionsuppgift eller en icke-nativ procedur som måste navigera i den grundläggande modellens tätt bundna och känsliga vikter.

FullDiT

In i denna dödläges kommer ett nytt erbjudande från Kina, som förespråkar ett system där ControlNet-liknande åtgärder är inbyggda direkt i en generativ videomodell under träningsfasen, snarare än att vara en eftertanke.

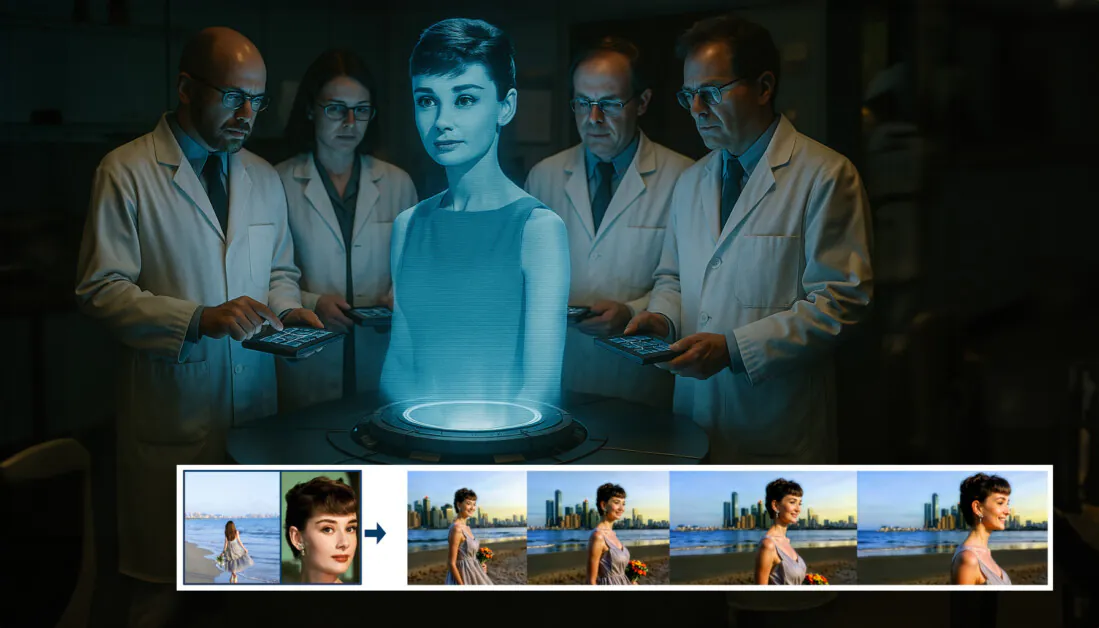

Från den nya artikeln: FullDiT-ansatsen kan inkorporera identitetstilldelning, djup och kamerarörelse i en naturlig generering, och kan framkalla vilken kombination av dessa som helst på en gång. Källa: https://arxiv.org/pdf/2503.19907

Med titeln FullDiT, den nya ansatsen fusionerar multi-uppgifts villkor som identitetstilldelning, djupkartering och kamerarörelse till en integrerad del av en tränad generativ videomodell, för vilken författarna har producerat en prototyptränad modell och tillhörande videoklipp på en projektsajt.

I exemplet nedan ser vi generationer som inkorporerar kamerarörelse, identitetsinformation och textinformation (dvs. vägledande användartextpromptar):

Klicka för att spela. Exempel på ControlNet-liknande användarimposition med endast en naturligt tränad grundläggande modell. Källa: https://fulldit.github.io/

Det bör noteras att författarna inte förespråkar sin experimentella tränade modell som en fungerande grundläggande modell, utan snarare som ett bevis för naturlig text-till-video (T2V) och bild-till-video (I2V) modeller som erbjuder användare mer kontroll än bara en bildprompt eller en textprompt.

Eftersom det inte finns några liknande modeller av detta slag, skapade forskarna en ny benchmark med titeln FullBench, för utvärdering av multi-uppgifts videor, och hävdar toppprestationer i liknande tester som de utformat mot tidigare tillvägagångssätt. Men eftersom FullBench utformades av författarna själva, är dess objektivitet outestad, och dess dataset på 1 400 fall kan vara för begränsat för bredare slutsatser.

Kanske den mest intressanta aspekten av arkitekturen som artikeln presenterar är dess potential att inkorporera nya typer av kontroll. Författarna påstår:

‘I detta arbete undersöker vi endast kontrollvillkor för kameran, identiteter och djupinformation. Vi undersökte inte ytterligare villkor och modaliteter som ljud, tal, punktmoln, objektramar, optisk flöde etc. Även om FullDiT:s design kan smidigt integrera andra modaliteter med minimal arkitekturmodifikation, är det fortfarande en viktig fråga som kräver ytterligare utforskning.’

Även om forskarna presenterar FullDiT som ett steg framåt i multi-uppgifts videogenerering, bör det övervägas att detta nya arbete bygger på befintliga arkitekturer snarare än att introducera ett fundamentalt nytt paradigm.

Ändå står FullDiT för närvarande ensam (så vitt jag vet) som en videogrundläggande modell med “inbyggda” ControlNet-liknande faciliteter – och det är bra att se att den föreslagna arkitekturen också kan anpassa sig till senare innovationer.

Klicka för att spela. Exempel på användarstyrda kamerarörelser från projektsajten.