Artificiell intelligens

Generering av bättre AI-video från bara två bilder

Video frame interpolation (VFI) är ett öppet problem inom generativ video forskning. Utmaningen är att generera mellanliggande ramar mellan två existerande ramar i en video sekvens.

Klicka för att spela. FILM-ramverket, ett samarbete mellan Google och University of Washington, föreslog en effektiv raminterpolationsmetod som fortfarande är populär i hobbyist- och proffssammanhang. Till vänster kan vi se de två separata och distinkta ramarna överlagrade; i mitten, ‘slutramen’; och till höger, den slutliga syntesen mellan ramarna. Källor: https://film-net.github.io/ och https://arxiv.org/pdf/2202.04901

I allmänhet har denna teknik funnits i över ett århundrade och har använts i traditionell animation sedan dess. I detta sammanhang skulle huvud-‘nyckelramar’ genereras av en huvudsaklig animationskonstnär, medan arbetet med ‘tweening’ mellanliggande ramar skulle utföras av andra medarbetare, som en mer underordnad uppgift.

Före uppkomsten av generativ AI, användes raminterpolation i projekt som Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) och Googles Frame Interpolation for Large Motion (FILM – se ovan) för att öka bildfrekvensen i en existerande video, eller för att möjliggöra konstgjord slow-motion. Detta uppnås genom att dela upp de existerande ramarna i en klipp och generera uppskattade mellanliggande ramar.

VFI används också i utvecklingen av bättre video-kodare, och mer allmänt, i optisk flödes-baserade system (inklusive generativa system), som använder förkunskap om kommande nyckelramar för att optimera och forma det mellanliggande innehållet som föregår dem.

Slutramar i generativa videosystem

Modern generativa system som Luma och Kling tillåter användare att ange en start- och en slutram, och kan utföra denna uppgift genom att analysera nyckelpunkter i de två bilderna och uppskatta en bana mellan de två bilderna.

Som vi kan se i exemplen nedan, ger en ‘avslutande’ nyckelram generativt videosystem (i detta fall, Kling) möjlighet att behålla aspekter som identitet, även om resultaten inte är perfekta (särskilt med stora rörelser).

Klicka för att spela. Kling är ett av ett växande antal video-genererare, inklusive Runway och Luma, som tillåter användaren att ange en slutram. I de flesta fall leder minimal rörelse till de mest realistiska och minst felaktiga resultaten. Källa: https://www.youtube.com/watch?v=8oylqODAaH8

I ovanstående exempel är personens identitet konsekvent mellan de två användarangivna nyckelramarna, vilket leder till en relativt konsekvent videogenerering.

Där endast start ramen tillhandahålls, är generativa systemets fönster för uppmärksamhet vanligtvis inte tillräckligt stort för att ‘komma ihåg’ hur personen såg ut i början av videon. Snarare är det troligt att identiteten kommer att skifta lite med varje ram, tills all likhet förloras. I exemplet nedan laddades en startbild upp, och personens rörelse styrdes av en textprompt:

Klicka för att spela. Med ingen slutram, har Kling endast en liten grupp omedelbart föregående ramar för att vägleda generationen av nästa ramar. I fall där någon betydande rörelse behövs, blir denna atrofi av identitet allvarlig.

Vi kan se att skådespelarens likhet är inte motståndskraftig mot instruktionerna, eftersom det generativa systemet inte vet hur han skulle se ut om han log, och han log inte i ursprungs bilden (den enda tillgängliga referensen).

De flesta virala generativa klipp är noggrant utvalda för att tona ned dessa brister. Men, framstegen inom tidsmässigt konsekventa generativa videosystem kan bero på nya utvecklingar från forskningssektorn i fråga om raminterpolation, eftersom den enda möjliga alternativet är ett beroende av traditionell CGI som en ‘guide’-video (och även i detta fall är konsekvensen av textur och belysning för närvarande svåra att uppnå).

Dessutom gör den långsamt iterativa naturen av att härleda en ny ram från en liten grupp nyligen ramar det mycket svårt att uppnå stora och djärva rörelser. Detta beror på att ett föremål som rör sig snabbt över en ram kan gå från ena sidan till den andra i ramen på ett enda ramavstånd, till skillnad från de mer gradvisa rörelserna som systemet troligen har tränats på.

Likaså kan en betydande och djärv förändring av pose leda inte bara till identitetsskifte, utan också till livliga oförenligheter:

Klicka för att spela. I detta exempel från Luma, verkar den begärda rörelsen inte vara väl representerad i träningsdata.

Framer

Detta leder oss till en intressant nyligen publicerad artikel från Kina, som hävdar att de har uppnått en ny toppnivå i autentiskt utseende raminterpolation – och som är den första i sitt slag att erbjuda drag-baserad användarinteraktion.

Framer tillåter användaren att styra rörelse med en intuitiv drag-baserad gränssnitt, men den har också en ‘automatisk’ läge. Källa: https://www.youtube.com/watch?v=4MPGKgn7jRc

Drag-centrerade applikationer har blivit vanliga i den litteraturen nyligen, eftersom forskningssektorn kämpar för att tillhandahålla instrument för generativa system som inte är baserade på de ganska grova resultaten som erhålls av textprompts.

Det nya systemet, med titeln Framer, kan inte bara följa användarstyrda drag, utan har också ett mer konventionellt ‘autopilot’-läge. Förutom konventionell tweening, kan systemet producera tidsförlopps-simulationer, samt morphing och nya vyer av ingångsbilden.

Mellanliggande ramar genererade för en tidsförlopps-simulation i Framer. Källa: https://arxiv.org/pdf/2410.18978

I fråga om produktionen av nya vyer, korsar Framer lite in i territoriet för Neural Radiance Fields (NeRF) – men kräver endast två bilder, medan NeRF vanligtvis kräver sex eller fler bildinmatningsvyer.

I tester, Framer, som bygger på Stability.ai:s Stable Video Diffusion latenta diffusions-generativa video-modell, kunde överträffa approximerade rivaliserande tillvägagångssätt, i en användarstudie.

Vid tidpunkten för skrivande, är koden planerad att släppas på GitHub. Video-exempel (från vilka ovanstående bilder är hämtade) finns tillgängliga på projektets webbplats, och forskarna har också släppt en YouTube-video.

Den nya artikeln heter Framer: Interaktiv raminterpolation, och kommer från nio forskare på Zhejiang University och Alibaba-backade Ant Group.

Metod

Framer använder nyckelpunkts-baserad interpolation i någon av dess två modaliteter, där ingångsbilden utvärderas för grundläggande topologi, och ‘rörliga’ punkter tilldelas där det behövs. I själva verket är dessa punkter ekvivalenta med ansiktslandmärken i ID-baserade system, men generaliserar till någon yta.

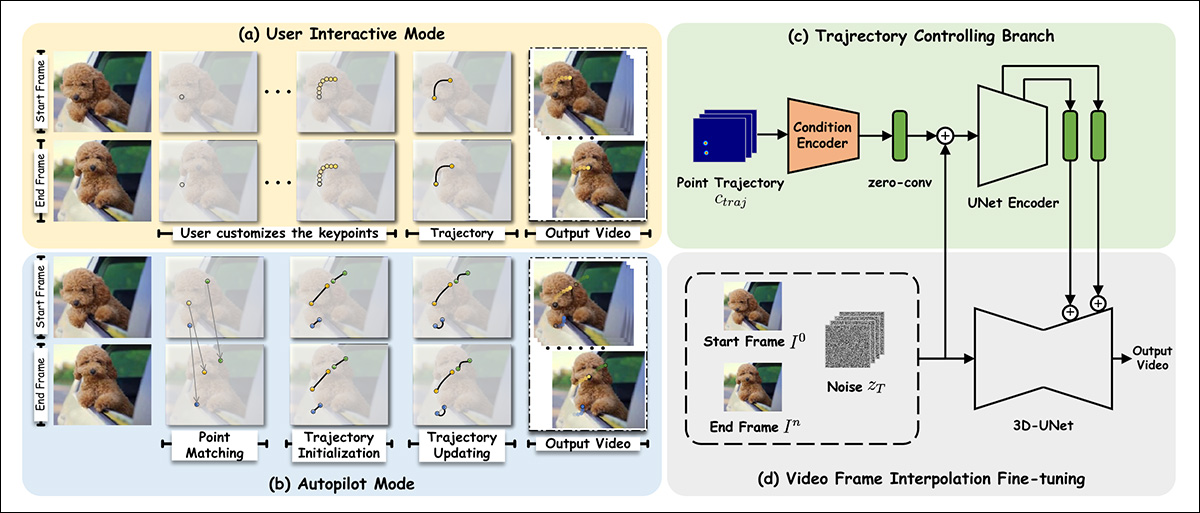

Forskarna finjusterade Stable Video Diffusion (SVD) på OpenVid-1M-datasetet, och lade till en ytterligare sista-ram-syntes-funktion. Detta möjliggör en bana-kontrollmekanism (överst till höger i schemabilden nedan) som kan utvärdera en bana mot slutramen (eller tillbaka från den).

Schema för Framer.

Vad gäller tillägget av sista-ram-villkor, skriver författarna:

‘För att bevara den visuella prioriteringen av den förtränade SVD så mycket som möjligt, följer vi villkorsparadigmet för SVD och injicerar slutram-villkor i latenta rummet och semantiska rummet, respektive.

‘Specifikt, vi konkatenerar VAE-kodade latenta funktionen för den första [ramen] med den bullriga latenten för den första ramen, som i SVD. Dessutom konkatenerar vi latentfunktionen för den sista ramen, zn, med den bullriga latenten för slutramen, med tanke på att villkoren och de motsvarande bullriga latenterna är rumsligt anpassade.

‘Dessutom extraherar vi CLIP-bildinbäddningen av den första och sista ramarna separat och konkatenerar dem för kors-attention-injektion.’

För drag-baserad funktionalitet, utnyttjar banmodulen Meta Ai-ledda CoTracker-ramverket, som utvärderar många möjliga banor framåt. Dessa slimmas ner till mellan 1-10 möjliga banor.

De erhållna punktkoordinaterna omvandlas sedan genom en metodik inspirerad av DragNUWA och DragAnything-arkitekturerna. Detta erhåller en Gausshetmap, som individuerar målområdena för rörelse.

Därefter matas data in i villkorsmekanismerna för ControlNet, ett hjälp-villkors-system som ursprungligen designades för Stable Diffusion, och sedan anpassats till andra arkitekturer.

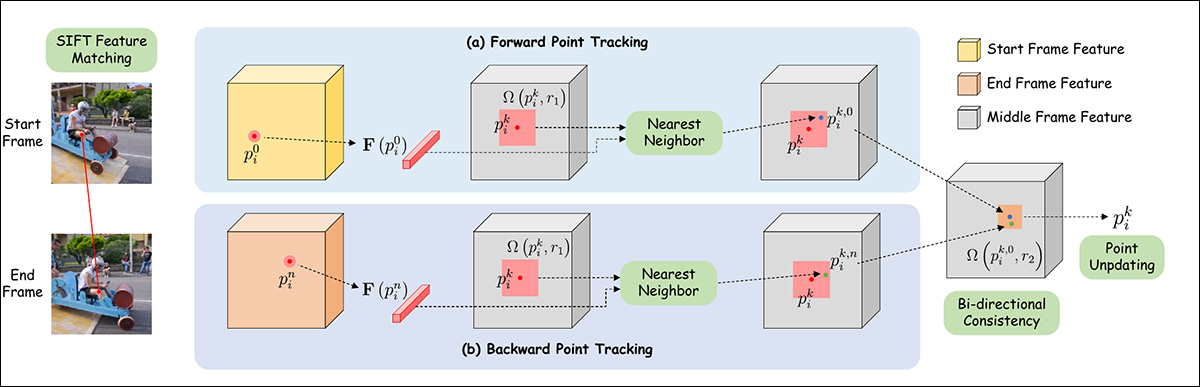

För autopilot-läge, utförs funktionsmatching initialt via SIFT, som tolkar en bana som sedan kan skickas till en auto-uppdateringsmekanism inspirerad av DragGAN och DragDiffusion.

Schema för punktbanestimation i Framer.

Data och tester

För finjusteringen av Framer, frystes rumslig uppmärksamhet och restblock, och endast de tidsmässiga uppmärksamhetslagren och restblocken påverkades.

Modellen tränades i 10 000 iterationer under AdamW, med en inlärningshastighet på 1e-4, och en batch-storlek på 16. Träningen skedde på 16 NVIDIA A100 GPU:er.

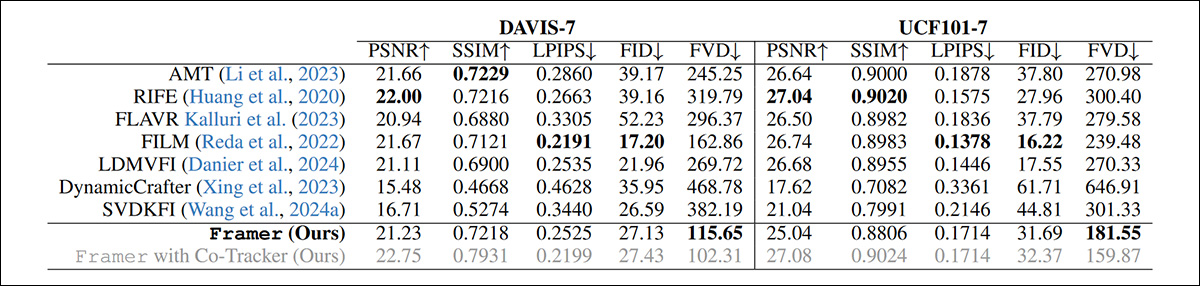

Eftersom tidigare tillvägagångssätt för problemet inte erbjuder drag-baserad redigering, valde forskarna att jämföra Framer:s autopilot-läge med standardfunktionaliteten i äldre erbjudanden.

Ramverken som testades för kategorin av nuvarande diffusions-baserade video-genereringssystem var LDMVFI; Dynamic Crafter; och SVDKFI. För ‘traditionella’ video-system, var rivaliserande ramverken AMT; RIFE; FLAVR; och det ovannämnda FILM.

Utöver användarstudien, utfördes tester över DAVIS och UCF101-dataseten.

Kvalitativa tester kan endast utvärderas av forskningsteamets objektiviska förmågor och av användarstudier. Men, noterar artikeln, traditionella kvantitativa metriker är till stor del olämpliga för förslaget i fråga:

‘[Rekonstruktions] metriker som PSNR, SSIM och LPIPS misslyckas med att fånga kvaliteten på interpolerade ramar korrekt, eftersom de bestraffar andra trovärdiga interpoleringsresultat som inte är pixel-anpassade med den ursprungliga videon.

‘Medan generationsmetriker som FID erbjuder någon förbättring, är de fortfarande otillräckliga eftersom de inte tar hänsyn till tidsmässig konsekvens och utvärderar ramar i isolering.’

Trots detta, utförde forskarna kvalitativa tester med flera populära metriker:

Kvantitativa resultat för Framer jämfört med rivaliserande system.

Författarna noterar att trots att oddsen var emot dem, uppnår Framer fortfarande den bästa FVD-poängen bland de metoder som testades.

Nedan följer artikeln exempelresultat för en kvalitativ jämförelse:

Kvalitativ jämförelse mot tidigare tillvägagångssätt. Se artikeln för bättre upplösning, samt videoresultat på https://www.youtube.com/watch?v=4MPGKgn7jRc.

Författarna kommenterar:

‘[Vår] metod producerar betydligt tydligare texturer och naturlig rörelse jämfört med existerande interpoleringstekniker. Den fungerar särskilt bra i scenarier med betydande skillnader mellan ingångsramarna, där traditionella metoder ofta misslyckas med att interpolera innehåll korrekt.

‘Jämfört med andra diffusions-baserade metoder som LDMVFI och SVDKFI, visar Framer överlägsen anpassningsförmåga till utmanande fall och erbjuder bättre kontroll.’

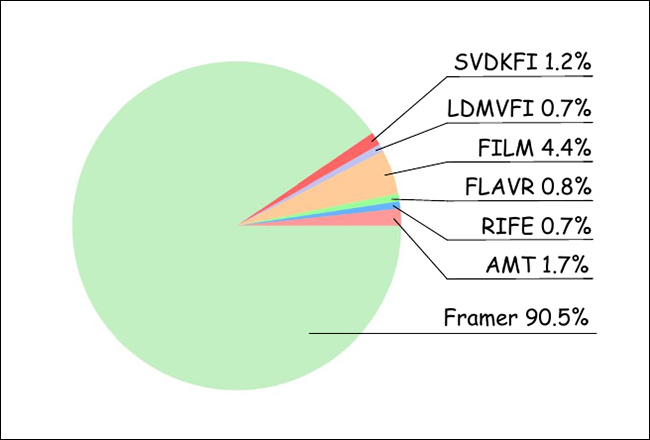

För användarstudien, samlade forskarna 20 deltagare, som bedömde 100 slumpmässigt ordnade videoresultat från de olika metoder som testades. Således erhölls 1000 bedömningar, som utvärderade de mest ‘realistiska’ erbjudandena:

Resultat från användarstudien.

Som kan ses från grafen ovan, föredrog användarna överväldigande resultat från Framer.

Projektets medföljande YouTube video visar några av de potentiella andra användningarna för Framer, inklusive morphing och tecknad film-mellanliggande – där hela konceptet började.

Slutsats

Det är svårt att överdriva hur viktigt denna utmaning för närvarande är för uppgiften att generera video-baserad AI. Hittills har äldre lösningar som FILM och den icke-AI-baserade EbSynth använts av både amatör- och proffssamhällen för tweening mellan ramar; men dessa lösningar kommer med betydande begränsningar.

På grund av den oärliga urvalet av officiella exempelvideor för nya T2V-ramverk, finns det en stor allmän missuppfattning om att maskinlärningssystem kan exakt härleda geometri i rörelse utan återkoppling till vägledningsmekanismer som 3D-morfbara modeller (3DMM) eller andra hjälp-tillvägagångssätt, såsom LoRAs.

För att vara ärlig, är tweening i sig, även om det kunde utföras perfekt, bara en ‘hake’ eller lur på detta problem. Trots detta, eftersom det ofta är lättare att producera två välbetalda ram-bilder än att effekta vägledning via text-prompts eller den nuvarande raden av alternativ, är det bra att se iterativt framsteg på en AI-baserad version av denna äldre metod.

Publicerad första gången tisdagen den 29 oktober 2024