Andersons vinkel

AI Delar Upp Webbsökning I Tre Olika Verkligheter

Nya studier visar att Google nu använder tre olika informationsystem inom sitt eget sök imperium, med vanlig Sökning, AI-översikter och Gemini som alla föredrar olika källor, rankningar och innehåll.

Reduktionism härskar. Under de senaste tolv månaderna har ‘Låt mig Google det för dig’ memet blivit överträffat av en ny ‘Låt mig sammanfatta den Google-sökningen för dig’ trend, där AI-översikter i sökresultat alltmer sparar läsarna besväret att klicka på sökningar (troligen avföra källsiterna i processen), genom att kondensera hela sökresultat till några genererade stycken.

Man skulle tro att den grundläggande kunskapen som kommer fram, och valet av webbplatser från vilka man hämtar den kunskapen, skulle vara relativt lika över alla tre av de mest populära metoderna för att söka efter information på internet: i traditionell websökning; i AI-översikterna (AIOs) som nu toppar de flesta webbsökningar; och genom den ökande användningen av LLM som ChatGPT som web-orakel (med eller utan externa RAG-samtal).

Men nyligen forskning från USA visar att detta är, överraskande, långt ifrån fallet; och att även inom Googles eget treenighet av orakel – SERPS*, AI-sammanfattningar och direkt interaktion med Gemini LLM-serien – det finns betydande och intressanta skillnader, för varje väg.

Tre-Vägs Split

I en tydlig och omfattande ny artikel, med titeln How Generative AI Disrupts Search: An Empirical Study of Google Search, Gemini, and AI Overviews, sex forskare från New Jersey Institute of Technology beskriver hur de tre sökmetoderna divergerar och erbjuder några möjliga teorier för dessa sprickor i tillvägagångssätt.

Artikeln säger:

‘[Först, vi] finner att för 51,5% av representativa, riktiga användarfrågor, genereras AIOs och visas ovanför de organiska sökresultaten. Kontroversiella frågor resulterar ofta i en AIO.

‘Sedan visar vi att de hämtade källorna är väsentligt olika för varje sökmotor (<0,2 genomsnittlig Jaccard-likhet). Traditionell Google-sökning är betydligt mer benägen att hämta information från populära eller institutionella webbplatser inom regering eller utbildning, medan generativa sökmotorer är betydligt mer benägna att hämta Google-ägd innehåll.

‘Tredje, observerar vi att webbplatser som blockerar Googles AI-crawler är betydligt mindre benägna att hämtas av AIOs, trots att de har tillgång till innehållet.’

Eftersom artikeln är en smörgåsbord av fascinerande insikter, snarare än att följa den vanliga linjära och metoddrivna arbetsflödet, kommer vi att ta en närmare titt på dessa, och några av dess mest överraskande och upplysande insikter.

Den Gamla ‘Två-Ett’

En av de många intressanta upptäckterna i studien visar att Googles AI-översikter tenderar att undertryckas för plötsliga nyhetsrelaterade händelser, eftersom de tidigaste och mest tillgängliga källorna kanske inte är de mest precisa.

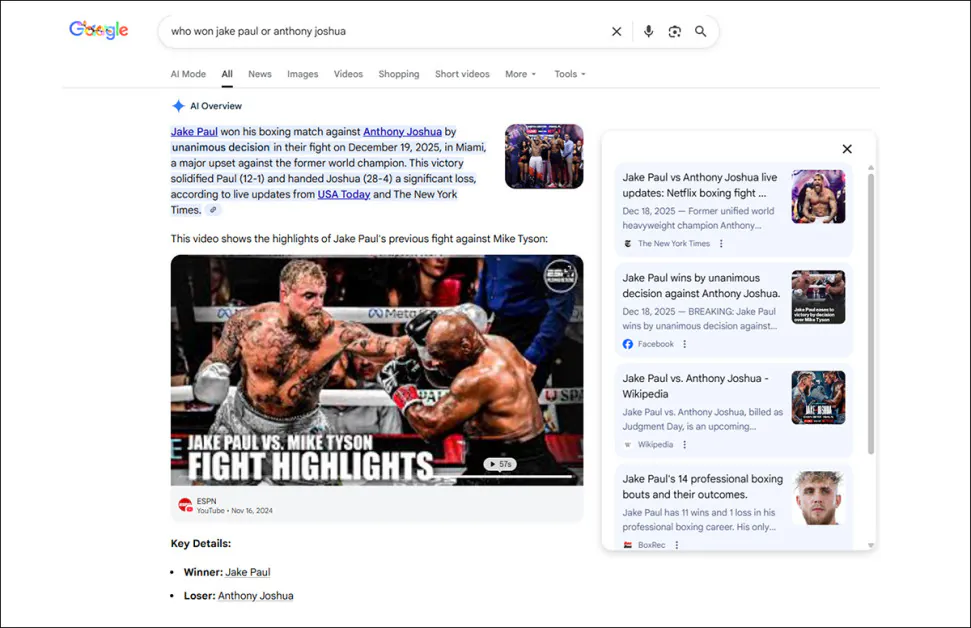

Denna system fungerar inte alltid: i exemplet nedan, noterat av forskarna, tillskrev en Google AI-översikt om resultatet av en boxningsmatch segern till fel boxare, trots att den enda källan som angav detta (felaktiga) resultat var en satirisk sportflöde på Facebook:

En av anledningarna till att Googles AI-översikter undviker tidskritiska sammanfattningar är att tidig information kan vara ofullständig eller helt felaktig. I detta fall förlorade boxaren Jake Paul faktiskt matchen. Källa

Forskarna noterar att AIOs tenderar att visas när en händelse är minst fem dagar gammal, vilket kvalificerar detta som en anomali – men ändå, en som forskarna lätt kunde framkalla.

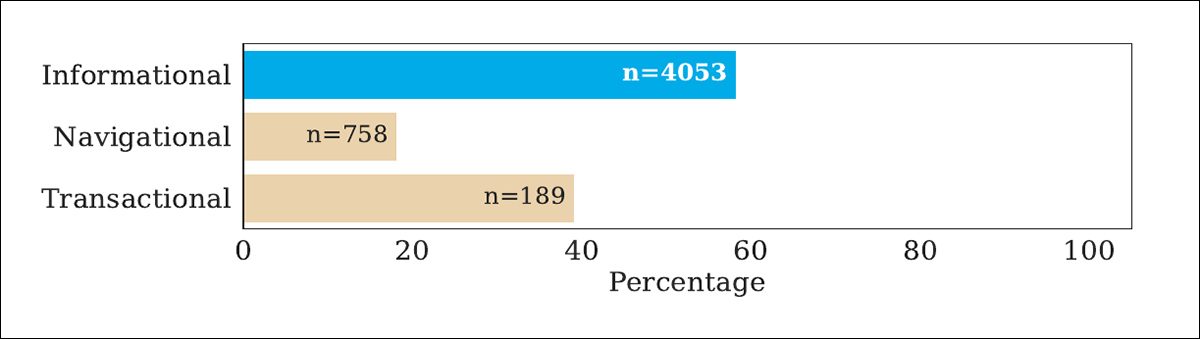

AIOs visade sig vara mer benägna att genereras när frågan avslutades med ett frågetecken, och att frågeavvikelse var en faktor i om en AIO skulle presenteras:

Procentandel incidenter där en AI-söksummar skapades i en av forskarnas testomgångar. Här indikerar ‘information’ direkt frågor, som tenderar att producera AIOs mer än någon annan typ av interaktion.

Dessutom hävdar artikeln att längre frågor tenderar att vara mer benägna att producera en AI-sammanfattning istället för bara raka sökresultat, även om författarna ännu inte har en teori för att förklara detta.

En Kungarike Delat

Kanske den mest överraskande övergripande resultatet från det nya arbetet är den relativt små överlappningen i resultatkvalitet/typ mellan Googles (ovannämnda) tre sökplattformar.

Artikeln visar upprepade gånger att vanlig Google-sökning, AI-översikter och Gemini (LLM) hämtar slående olika källor för samma fråga, med överlappningspoäng som är tillräckligt låga för att antyda tre konkurrerande återvinninglogiker inom ett företag, medan användare kan anta att Google har en auktoritativ index och en rankningsfilosofi:

Även inom Googles eget ekosystem visade sig överlappningen mellan traditionell Sökning, AI-översikter och Gemini vara förvånansvärt liten, med samma fråga ofta producerande väsentligt olika källlistor beroende på vilket Google-system som hanterade begäran. I denna jämförelse ser vi hur nära de tre systemen matchade varandra över tusentals sökfrågor, från shopping och debattämnen till lokala sökningar och allmänna kunskapsfrågor, med lägre poäng som indikerar mindre överensstämmelse mellan de valda källorna.

Författarna noterar att ingen sökmotor som testades hade en rank-biased överlapp (RBO) över 0,27, vilket är en mycket låg poäng. De noterar vidare att Amazon Retail och lokaliserade frågor (dvs. ‘butiker nära mig’) hade den lägsta likheten mellan sökmotorerna.

De tillskriver den låga överensstämmelsen till grundläggande ‘inkonsekvens mellan sökmotorer’, noterar att varken slumpmässighet eller någon annan uppenbar faktor kan göras för att förklara denna desyncopation.

En intuitiv förklaring, kanhända, är att träningsdatapunkter tilldelas rang i ett mycket annorlunda sätt än de metoder som Google har utvecklat för PageRank och dess efterföljare under de senaste två decennierna. Dessutom, på chansen att Googles sökalgoritm har en hemlig agenda, är det svårt att konsekvent implementera den typen av “gaming” i diffusionsbaserade AI som Gemini (även via filter, systempromptar och andra metoder för att korrelera som är påtvingade kommersiella modeller).

Självbetjäning..?

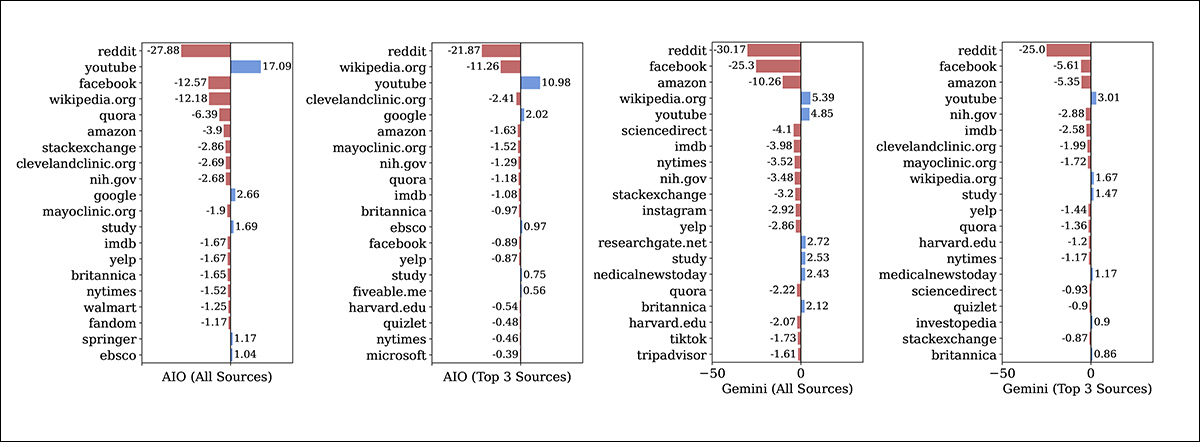

Vissa webbplatser, eller kategorier av webbplatser, verkar ha påverkats av införandet av AI-sammanfattningar och inträngandet av LLM-baserad sökning i den traditionella sökrymden – både negativt och positivt, beroende på fallet:

Jämfört med traditionell Google-sökning, minskade AI-översikter och Gemini citeringar från många stora webbplatser, samtidigt som de ökade synligheten för ett mindre antal föredragna domäner. YouTube visade sig vara en av de största förmånstagarna i båda systemen, medan Reddit, Wikipedia, Facebook och många institutionella källor sällan förekom i AI-genererad återvinning.

Författarna noterar att vissa oväntade preferenser dyker upp mellan de tre metoderna under testning:

‘Vi har tre huvudsakliga slutsatser från [diagrammen ovan]. Först, stora och välkända webbplatser är de mest påverkade (både positivt och negativt). Detta är intuitivt eftersom stora webbplatser har rykte och mångfald i innehåll för att vara relevanta för många olika frågor.

‘Sedan, den överväldigande majoriteten av dessa webbplatser får färre totala och färre topp-tre citeringar med generativa sökmotorer (indikerat av röda staplar och negativa tal i [diagram ovan]). Detta tyder på att generativ sökning tenderar att hämta information från mer nischade källor än traditionella sökmotorer.

‘Tredje, Googles AIOs föredrar Google-webbplatser (dvs. google.com och youtube.com-domäner).

‘Gemini föredrar också YouTube i jämförelse med traditionell Google-sökning, men den absoluta skillnaden är mindre.’

Några ‘Blockerare’..?

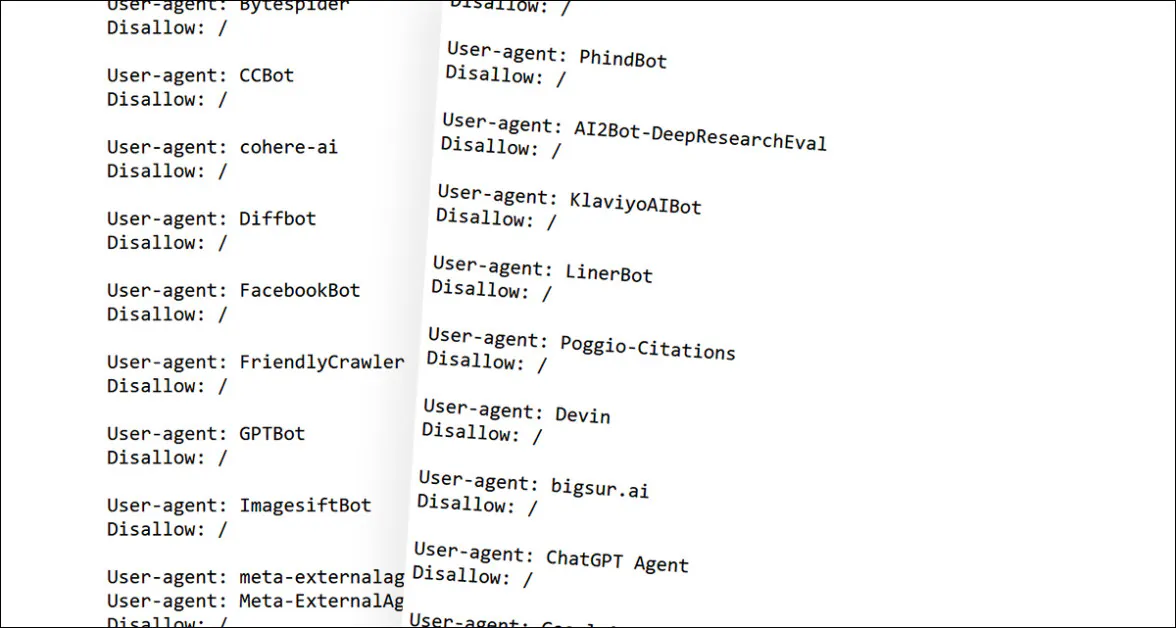

Studien fann också att utgivare som blockerar Googles AI-webbcrawler – den automatiserade webb-roboten som skrapar data från din webbplats om du inte ber den att inte göra det med en robots.txt-fil – tenderar att inte visas i AI-sammanfattningar.

Detta kan verka som en uppenbar självförvållad skada, men i själva verket har Google offentligt uttalat att innehåll från plattformar som blockerar AI-crawlers inte kommer att förhindras från att visas i AI-sammanfattningar; snarare kommer utgivarna inte att ha sina data skrapade, kuraterade i en samling och körda genom nästa omgång AI-träning för Gemini och andra Google AI-projekt.

Men det var inte den slutsats som de nya artiklarnas forskare kom till, utan istället fann de att populära AI-bannlysta utgivare var mycket sällan citerade av Gemini, antingen i LLM eller i den mer avskalade och agile sökresultat-incarnationen. De ‘effektivt bannlysta’ utgivarna rapporterades av artikeln att vara NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports och STAT.

Några av de robots.txt AI-scraping-bann som infördes av de utgivare som nämns ovan. Men har det lett till en vidare censur av Google?

Författarna säger:

‘I våra analyser av de mest påverkade domänerna fann vi att 21 populära [utgivare] (som hämtas för minst 20 unika frågor av både Google-sökning och AIOs) aldrig citerades av Gemini.

‘Flera populära sociala medier (Facebook, Instagram, Tiktok) och recensionswebbplatser (IMDb, Yelp, Tripadvisor) fick också noll citeringar från Gemini. Vidare undersökning fann vi att alla dessa webbplatser blockerar Google-Extended-roboten i sina robots.txt-filer.’

Om denna upptäckt visar sig vara verifierad på annat håll och beständig, kan man spekulera att dessa företag potentiellt pressas av Google att samarbeta med deras AI-verksamhet genom partiell avlistning. Vid en första anblick verkar resultaten straffande – men då är resultaten av det nya arbetet mer indicativa för kaos än förberedelse; därför är den enda rimliga kommentar man kan göra att dessa resultat ser ytligt ‘straffande’ ut, oavsett vad som egentligen orsakar dem.

Slutsats

Åsikt Detta är en tydlig zip-bomb av en artikel, vars blott tio primära sidor utvecklas till en nästan överväldigande mängd ytterligare upptäckter. Eftersom vi har haft tid att täcka bara en liten del av dessa, rekommenderar jag käll-PDF:en till och med den oengagerade läsaren (en sällsynt händelse).

Även om en ‘gul’ disposition kunde kasta många negativa tolkningar på författarnas upptäckter, är arbetet kanske bäst behandlat som en indikation på att en global teknikledare försöker att uppnå och behålla en global ledning i AI-baserad sökning, med hjälp av högst kontrasterande plattformar som utvecklats under mycket olika omständigheter och över mycket olika epoker.

Medan tre sökmotorer undersöks i artikeln, är den verkliga kontroversen mellan traditionella sökmotorresultat, rankade av proprietära metoder, och de skarpt kontrasterande distributionsbaserade urvalsmetoderna som dominerar datakurering och AI-träning.

AI Som Om Det Vore 1999

Innan Google var det möjligt att ‘göra trick’ med sökresultat genom ren volym, och på detta sätt kunde man ofta uppnå första sidans SERPS-placering med minimal (ofta automatiserad) ansträngning. Detta ‘nummerspel’ avslutades effektivt runt 2002 av Googles mer sofistikerade och hemliga sökalgoritm. Men eftersom insatserna var betydande, försvann aldrig högvolym- och lågkvalitetsinnehåll på något meningsfullt sätt.

Därför, när hyperskale-samlingar som Common Crawl lade grunden för den moderna AI-revolutionen, var data-prominens destinerad att domineras av den utsträckning till vilken automatiserade processer kunde filtrera och rangordna inkommande datakvalitet, och (mycket mindre sannolikt), den utsträckning till vilken pengar var tillgängliga för att betala människor för att rangordna den datan.

Det fanns mycket dåligt eller lågkvalitetsdata i dessa stora och odiscriminerande samlingar; data som kanske inte innehöll nakenhet eller svordomar eller rasistiska tropar, eller något annat som är relativt lätt att filtrera bort från träningsdata – men som ändå var självservande och volymintensiv, precis som resultat från internet-sökning cirka 1999-2001.

Eftersom dessa datainduktionsprocesser fortfarande inte är bra, är det mycket svårt, till och med för Google, att få AI att agera på ett affärsmässigt sätt, eftersom Geminis PageRank-stilbeslut dikteras inte av Googles policyingenjörer, utan av en ofullständig förståelse av hur hyperskaledata omvandlas till datafördelningar och latenta inbäddningar under träningen av en AI-modell.

* Sökresultatsidor.

† Författarnas betoning, inte min. Men jag har ersatt fetstil med kursiv, eftersom fetstilsbetoning inte fungerar bra i citat som redan är primärt kursiva.

Publicerad första gången onsdag, 13 maj 2026