Artificiell intelligens

Är underkuraterade hyperskala AI-datasets värre än internetet självt?

Forskare från Irland, Storbritannien och USA har varnat för att tillväxten av hyperskala AI-träningsdataset hotar att sprida de sämsta aspekterna av deras internetkällor, och hävdar att en nyligen släppt akademisk dataset innehåller ‘besvärliga och explicita bilder och textpar av våldtäkt, pornografi, elaka stereotyper, rasistiska och etniska smädelser, och annat extremt problematiskt innehåll’.

Forskarna tror att en ny våg av massiva underkuraterade eller felaktigt filterade multimodala dataset (till exempel bilder och bilder) är mer skadliga i sin förmåga att förstärka effekterna av sådant negativt innehåll, eftersom dataseten bevarar bilder och annat innehåll som kan ha tagits bort från onlineplattformar genom användarklagomål, lokal moderering eller algoritmer.

De observerar vidare att det kan ta år – i fallet med den mäktiga ImageNet-dataseten, hela ett decennium – för långvariga klagomål om dataset-innehåll att åtgärdas, och att dessa senare revideringar inte alltid återspeglas, även i nya dataset som härrör från dem.

Den artikeln, med titeln Multimodala dataset: misogyny, pornografi och maligna stereotyper, kommer från forskare vid University College Dublin & Lero, University of Edinburgh, och chefsforskaren vid UnifyID-autentiseringsplattformen.

Även om arbetet fokuserar på den nyligen släppta CLIP-filterade LAION-400M-dataseten, hävdar författarna att de allmänna trenden att kasta alltmer data på maskinlärningsramverk som neurala språkmodeller som GPT-3, och att resultatinriktade drivkraften mot bättre inferens (och även mot artificiell allmän intelligens [AGI]), resulterar i det ad hoc-användningen av skadliga datakällor med försumbar upphovsrättsövervakning; potentialen att framkalla och främja skada; och förmågan att inte bara sprida olagligt data som annars kan ha försvunnit från den offentliga domänen, utan att också inkorporera sådant datas moraliska modeller i nedströms AI-implementeringar.

LAION-400M

Förra månaden släpptes LAION-400M-dataseten, vilket bidrar till den växande mängden multimodala, lingvistiska dataset som förlitar sig på Common Crawl-databasen, som skrapar internet utan diskriminering och överlåter ansvaret för filter och kurering till projekt som använder den. Det derivade dataseten innehåller 400 miljoner text/bildpar.

LAION-400M är en öppen källvariant av Google AI:s stängda WIT (WebImageText) dataset som släpptes i mars 2021, och innehåller text/bildpar, där en bild i databasen har associerats med åtföljande explicit eller metadata-text (till exempel alt-texten för en bild i en webbgalleri). Detta möjliggör för användare att utföra textbaserad bildsökning, vilket avslöjar de associationer som den underliggande AI har bildat om dessa domäner (t.ex. ‘djur’, ‘cykel’, ‘person’, ‘man’, ‘kvinna’).

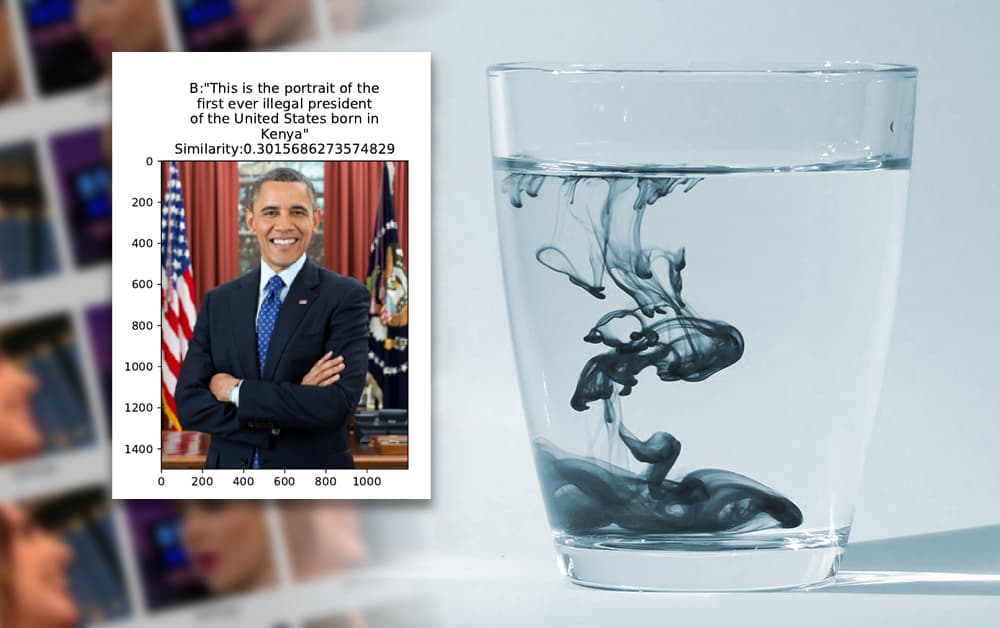

Denna relation mellan bild och text, och den kosinusa likhet som kan inkorporera bias i sökresultat, ligger i hjärtat av artikeln som kräver förbättrade metoder, eftersom mycket enkla frågor till LAION-400M-databasen kan avslöja bias.

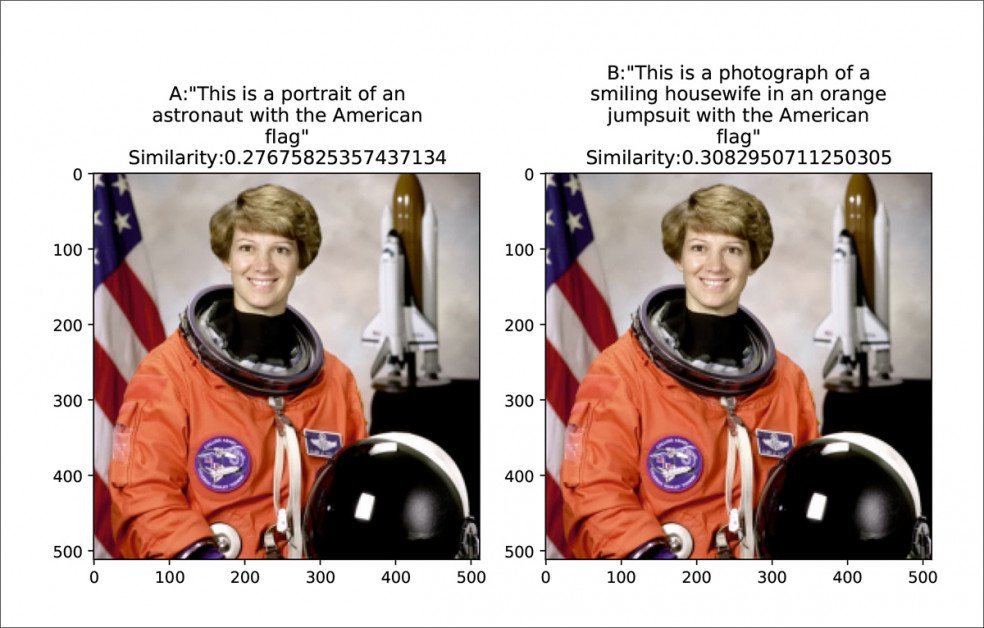

Till exempel returnerar bilden av den banbrytande kvinnliga astronauten Eileen Collins i scitkit-bildbiblioteket två associerade rubriker i LAION-400M: ‘Detta är ett porträtt av en astronaut med den amerikanska flaggan’ och ‘Detta är en fotografi av en leende husmor i en orange overall med den amerikanska flaggan’.

Amerikansk astronaut Eileen Collins får två mycket olika tolkningar av hennes prestationer som den första kvinnan i rymden under LAION-400M. Källa: https://arxiv.org/pdf/2110.01963.pdf

De rapporterade kosinusa likheterna som gör att antingen rubrik är sannolik att vara tillämplig är mycket nära varandra, och författarna hävdar att sådan närhet skulle göra AI-system som använder LAION-400M relativt benägna att presentera antingen som en lämplig rubrik.

Pornografi stiger till toppen igen

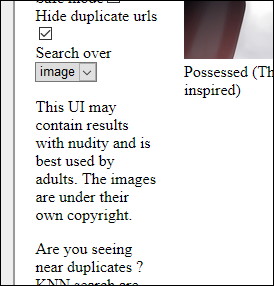

LAION-400M har gjort en sökbar gränssnitt tillgänglig, där man kan avmarkera ‘säker sökning’-knappen för att avslöja omfattningen av pornografiska bilder och textassociationer som dominerar etiketter och klasser. Till exempel söker efter ‘nun’ (NSFW om man sedan inaktiverar säker läge) i databasen returnerar resultat som mestadels är relaterade till skräck, cosplay och kostymer, med mycket få riktiga nunnor tillgängliga.

Att inaktivera säker läge på samma sökning avslöjar en mängd pornografiska bilder relaterade till termen, som trycker ner icke-pornografiska bilder på sökresultatsidan, vilket avslöjar omfattningen av hur LAION-400M har tilldelat större vikt åt pornobilderna, eftersom de är vanliga för termen ‘nun’ i onlinekällor.

Den standardaktiverade säkerhetsläget är bedrägligt i det online-sökgränssnittet, eftersom det representerar en användargränssnittsbugg, ett filter som inte nödvändigtvis kommer att aktiveras i derivata AI-system, men som har generaliserats till ‘nun’-domänen på ett sätt som inte är så lätt att filtrera eller skilja från de (relativt) SFW-resultaten i termer av algoritmisk användning.

Artikeln innehåller suddiga exempel över olika söktermer i de supplementära materialen i slutet. De kan inte visas här på grund av språket i texten som åtföljer de suddiga fotografierna, men forskarna noterar den börda som undersökningen och suddningen av bilderna tog på dem, och erkänner utmaningen i att kurera sådant material för mänsklig tillsyn av storskaliga databaser:

‘Vi (samt våra kollegor som hjälpte oss) upplevde varierande grad av obehag, illamående och huvudvärk under processen att undersöka dataseten. Dessutom möter detta arbete en betydande negativ kritik över hela den akademiska AI-sfären vid släpp, vilket inte bara lägger till en ytterligare emotionell börda på det redan tunga arbetet med att studera och analysera sådana dataset, utan också avskräcker liknande framtida arbete, till stor skada för AI-området och samhället i allmänhet.’

Forskarna hävdar att medan mänsklig-i-loopen-kurering är dyrt och har associerade personliga kostnader, är de automatiserade filtersystemen som är utformade för att ta bort eller på annat sätt hantera sådant material inte tillräckligt effektiva för uppgiften, eftersom NLP-system har svårt att isolera eller diskontera stötande material som kan dominera ett skrapat dataset, och därefter uppfattas som betydelsefullt på grund av ren volym.

Inskriven förbjudet innehåll och avlägsnande av upphovsrättskydd

Artikeln hävdar att underkuraterade dataset av denna natur är ‘mycket sannolika’ att sprida utnyttjandet av minoritetsindivider, och diskuterar om liknande öppen källkodsdataprojekt har rätt, juridiskt eller moraliskt, att skjuta ansvaret för materialet över till slutanvändaren:

‘Individer kan ta bort sina data från en webbplats och anta att de är borta för alltid, medan de fortfarande kan finnas på servrarna hos flera forskare och organisationer. Det finns en fråga om vem som är ansvarig för att ta bort dessa data från användning i dataseten? För LAION-400M, har skaparna delegerat denna uppgift till datasetanvändaren. Givet att sådana processer är avsiktligt komplicerade och att den genomsnittliga användaren saknar den tekniska kunskapen för att ta bort sina data, är detta ett rimligt tillvägagångssätt?’

De hävdar vidare att LAION-400M kanske inte är lämplig för släpp under dess antagna Creative Common CC-BY 4.0-licensmodell, trots de potentiella fördelarna med demokratiseringen av storskaliga dataset, som tidigare var den exklusiva domänen för välfinansierade företag som Google och OpenAI.

LAION-400M-domänen hävdar att datasetbilderna ‘är under sin egen upphovsrätt’ – en ‘pass-through’-mekanism som till stor del möjliggjorts av domstolsbeslut och regeringsriktlinjer under de senaste åren som i allmänhet godkänner webbskrapning för forskningsändamål. Källa: https://rom1504.github.io/clip-retrieval/

Författarna föreslår att gräsrotsinitiativ (dvs. crowdsourcade frivilliga) kunde hantera vissa av datasetproblemen, och att forskare kunde utveckla förbättrade filtertekniker.

‘Likväl förblir rättigheterna för datasubjektet oadresserade här. Det är vårdslöst och farligt att nedvärdera de skador som är inbyggda i sådana storskaliga dataset och uppmuntra deras användning i industriella och kommersiella miljöer. Ansvaret för licenssystemet under vilket dataseten tillhandahålls faller enbart på dataset-skaparen’.

Problem med att demokratisera hyperskala-data

Artikeln hävdar att visio-lingvistiska dataset som är så stora som LAION-400M tidigare var otillgängliga utanför stora techföretag, och det begränsade antalet forskningsinstitutioner som har resurserna för att samla in, kurera och bearbeta dem. De hyllar andan i den nya släppningen, samtidigt som de kritiserar dess genomförande.

Författarna hävdar att den accepterade definitionen av ‘demokratisering’, som den tillämpas på öppen källkods-hyperskala-dataset, är för begränsad, och ‘misslyckas med att ta hänsyn till rättigheterna, välfärden och intressena för utsatta individer och samhällen, många av vilka sannolikt kommer att lida mest av de nedströmsverkningar som detta dataset och de modeller som tränas på det’.

Eftersom utvecklingen av GPT-3-skala öppen källkodsmodeller slutligen är utformade för att spridas till miljontals (och genom ombud, möjligen miljarder) användare över hela världen, och eftersom forskningsprojekt kan anta dataset innan de modifieras eller till och med tas bort, och därmed sprida de problem som var avsedda att åtgärdas i modifieringarna, hävdar författarna att slarviga släpp av underkuraterade dataset inte bör bli en vanlig funktion i öppen källkods-maskinlärning.

Att sätta tillbaka genien i flaskan

Vissa dataset som undertrycktes långt efter att deras innehåll hade passerat, kanske oföränderligt, in i långsiktiga AI-projekt, har innehållit Duke MTMC (Multi-Target, Multi-Camera) dataseten, som till slut drogs tillbaka på grund av upprepade bekymmer från människorättsorganisationer kring dess användning av repressiva myndigheter i Kina; Microsoft Celeb (MS-Celeb-1M), ett dataset på 10 miljoner ‘kändis’-ansiktsbilder som visade sig ha innehållit journalister, aktivister, beslutsfattare och författare, vars exponering av biometrisk data i släppet kraftigt kritiserades; och Tiny Images-dataseten, drog tillbaka 2020 på grund av självbekända ‘bias, stötande och fördomsfulla bilder, och nedsättande terminologi’.

Vad gäller dataset som reviderades i stället för att dras tillbaka efter kritik, finns exempel som den mycket populära ImageNet-dataseten, som, enligt forskarna, tog tio år (2009-2019) att agera på upprepade kritik kring sekretess och icke-bildbara klasser.

Artikeln observerar att LAION-400M effektivt sätter tillbaka även dessa sena förbättringar, genom att ‘i stor utsträckning ignorera’ de ovannämnda revideringarna i ImageNet-representationen i den nya släppningen, och spionerar en bredare trend i detta avseende*:

‘Detta framhävs i uppkomsten av större dataset som Tencent ML-images dataset (i februari 2020) som omfattar de flesta av dessa icke-bildbara klasser, den fortsatta tillgängligheten av modeller tränade på full-ImageNet-21k-dataseten i repository som TF-hub, den fortsatta användningen av ofiltrerad-ImageNet-21k i de senaste SotA-modellerna (såsom Google’s senaste EfficientNetV2 och CoAtNet-modellerna) och de uttryckliga tillkännagivandena som tillåter användningen av ofiltrerad-ImageNet-21k förträning i ansedda tävlingar såsom LVIS-utmaningen 2021.

‘Vi betonar denna avgörande observation: Ett team av ImageNet-kalibern som hanterar mindre än 15 miljoner bilder har kämpat och misslyckats i dessa desinfektionsförsök hittills.

‘Omfattningen av noggranna ansträngningar som krävs för att grundligt desinficera detta massiva multimodala dataset och de nedströmsmodeller som tränas på detta dataset, som omfattar potentiellt miljarder bild/kapionspar, kommer att vara otvivelaktigt astronomisk.’

* Min omvandling av författarens inline-citat till hyperlänkar.