Artificiell intelligens

Modellroutrar och återkopplingssfällan: Hur AI lär sig av sig själv

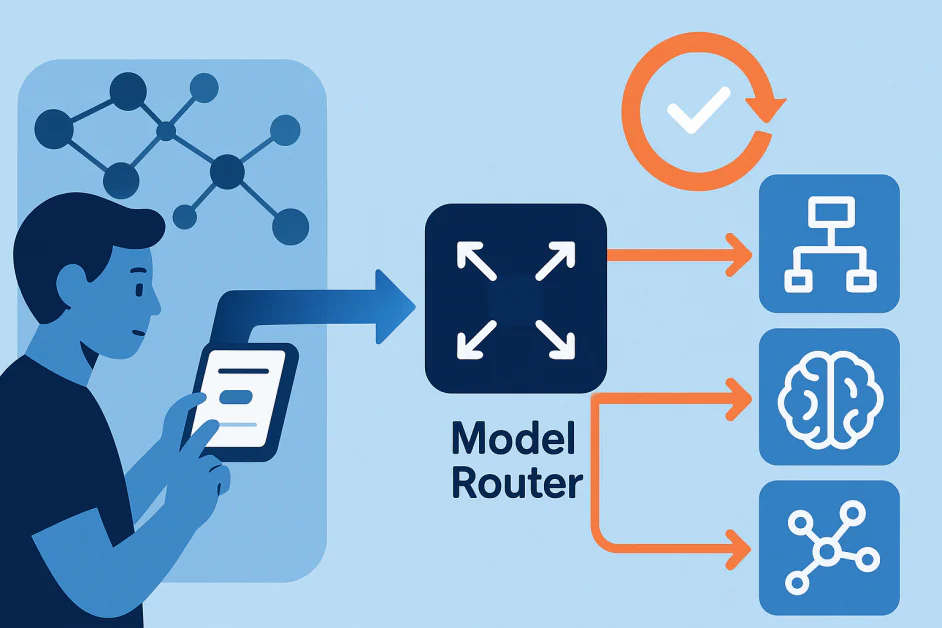

Moderna AI-system är inte längre byggda kring en enda modell som hanterar varje uppgift. Istället förlitar de sig på samlingar av modeller, var och en utformad för specifika syften. I centrum av denna konfiguration finns modellroutern, en komponent som tolkar en användares begäran och bestämmer vilken modell som ska hantera den. Till exempel i system som OpenAI’s GPT-5, kan en router skicka en enkel fråga till en lättviktig modell för hastighet medan den dirigerar komplexa resonemangsuppgifter till en mer avancerad modell.

Routrar är inte bara trafikledare. De lär sig av användarbeteende, såsom när människor byter modeller eller föredrar vissa svar. Detta skapar en cykel: routern tilldelar frågan, modellen producerar ett svar, användarreaktioner ger återkoppling och routern uppdaterar sina beslut. När dessa cykler opererar tyst i bakgrunden kan de bilda dolda återkopplingsslingor. Sådana slingor kan förstärka bias, förstärka felaktiga mönster eller gradvis minska prestanda på sätt som är svåra att upptäcka.

Den här artikeln undersöker hur modellroutrar fungerar, hur återkopplingsslingor uppstår och vilka risker de medför när AI-system fortsätter att utvecklas.

Att förstå modellroutrar i AI

En modellrouter är det beslutsfattande lagret i ett multi-modell AI-system. Dess roll är att bestämma vilken modell som bäst passar en uppgift. Valet beror på faktorer som frågans komplexitet, användarens avsikt, sammanhang och avvägningar mellan kostnad, noggrannhet och hastighet.

Till skillnad från system som följer fasta regler är de flesta modellroutrar själva maskinlärningssystem. De tränas på verkliga signaler och anpassar sig över tid. De kan lära sig av användarbeteende, såsom att byta mellan modeller, betygsätta svar eller omformulera prompter, samt från automatiserade utvärderingar som mäter utdatans kvalitet.

Denna anpassningsförmåga gör routrar kraftfulla men också riskfyllda. De förbättrar effektiviteten och ger en bättre användarupplevelse, men de samma återkopplingsprocesser som finjusterar deras beslut kan också skapa förstärkande slingor. Över tid kan dessa slingor påverka inte bara routningsstrategier utan också hur det större AI-systemet beter sig.

Hur återkopplingsslingor tar form

En återkopplingsslinga uppstår när ett systems utdata påverkar de data det senare lär sig från. Ett enkelt exempel är ett rekommendationssystem: om du klickar på en idrottsvideo, visar systemet mer idrottsinnehåll, vilket formar vad du tittar på nästa. Över tid förstärker systemet sina egna mönster. Ett annat exempel för att förstå återkopplingsslingan är förutsägande polisarbete. En algoritm kan förutspå högre brottslighet i vissa områden, vilket kan leda till fler patruller. Ökade patruller avslöjar fler incidenter, vilket sedan bekräftar algoritmens förutsägelse. Systemet ser korrekt ut, men datan är snedvriden av sin egen påverkan. Återkopplingsslingor kan vara direkta eller dolda. Direkta slingor är lätta att känna igen, såsom en rekommendation som omtränas på sina egna förslag. Dolda slingor är mer subtila eftersom de uppstår när olika delar av ett system indirekt påverkar varandra.

Modellroutrar kan skapa liknande slingor. En routers beslut formar vilken modell som producerar svaret. Detta svar formar användarbeteende, som sedan blir återkoppling för routern. Över tid kan routern börja förstärka mönster som fungerade i det förflutna snarare än att konsekvent välja den bästa modellen. Dessa slingor är svåra att upptäcka och kan tyst trycka AI-system i oönskade riktningar.

Varför återkopplingsslingor i routrar är riskfyllda

Medan återkopplingsslingor hjälper routrar att förbättra vid uppgiftstilldelning, medför de också risker som kan snedvrida systemsbeteende. En risk är att förstärka initiala bias. Om en router upprepat skickar en viss typ av fråga till Modell A, kommer de flesta av återkopplingen att komma från Modell A:s utdata. Routern kan sedan anta att Modell A alltid är den bästa, och stänga av Modell B, även om den ibland kunde prestera bättre. Denna ojämna användning kan bli självförstärkande. Modeller som presterar bra på dirigerade uppgifter lockar till sig fler förfrågningar, vilket förstärker deras styrkor. Underanvända modeller får färre chanser att förbättras, vilket skapar obalans och minskar mångfalden.

Bias kan också komma från utvärderingsmodellerna som används för att bedöma korrekthet. Om “domar”-modellen har blinda fläckar, överförs dess bias direkt till routern, som sedan optimerar för domarens värderingar snarare än verkliga användarbehov. Användarbeteende lägger till en annan nivå av komplexitet. Om en router tenderar att returnera vissa typer av svar, kan användare anpassa sina frågor för att matcha dessa mönster, vilket förstärker dem ännu mer. Över tid kan detta begränsa både användarbeteende och systemsvar. Routrar kan också lära sig att associera vissa frågemönster eller demografiska grupper med specifika modeller. Detta kan leda till systematiskt olika upplevelser mellan grupper, potentiellt förstärka och förstärka befintliga samhällsbias.

En annan viktig oro är långsiktig drift. De beslut en router fattar idag påverkar träningsdatan som används imorgon. Om modeller omtränas på utdata som påverkats av routning, kan de lära sig routerns preferenser snarare än oberoende tillvägagångssätt. Detta kan göra svar över modeller mer enhetliga och införa bias som består över tid.

Strategier för att bryta cykeln

Att minska riskerna med dolda slingor kräver aktiv design och tillsyn. Träning bör använda mångfaldiga datakällor, inte bara användarklick eller växlingar. Tillfällig slumpmässig routning kan också förhindra att en modell monopoliserar en uppgiftstyp. Övervakning är avgörande. Reguljära revisioner kan avslöja om en router drar sig mot vissa mönster eller överanvänder en enskild modell. Transparens i routerbeslut hjälper forskare att upptäcka bias tidigt.

Routrar bör också omtränas regelbundet med färska, balanserade data så att gamla bias inte låses in. Inkorporering av mänsklig tillsyn, särskilt i känsliga områden, lägger till en annan nivå av ansvar. Människor kan identifiera när en router systematiskt föredrar en modell eller missklassificerar vissa frågor.

Nyckeln är att behandla routern som en modell som påverkas av återkoppling, inte som en fast eller neutral komponent. Genom att erkänna hur routrar själva formas av de data de skapar, kan forskare och utvecklare designa system som förblir rättvisa, anpassningsbara och tillförlitliga över tid.

Sammanfattning

Modellroutrar erbjuder tydliga fördelar i effektivitet och anpassningsförmåga, men de medför också dolda risker. Återkopplingsslingor inom dessa system kan tyst förstärka bias, begränsa svarsmångfald och låsa modeller i snäva beteendemönster. När dessa arkitekturer blir vanligare, kommer det att vara avgörande att erkänna och hantera dessa risker tidigt för att bygga AI-system som förblir rättvisa, tillförlitliga och genuint anpassningsbara.