Artificiell intelligens

En kartell av inflytelserika datamängder dominerar maskinlärningsforskning, en ny studie föreslår

En ny rapport från University of California och Google Research har funnit att ett litet antal “benchmark”-maskinlärningsdatamängder, till stor del från inflytelserika västerländska institutioner, och ofta från myndigheter, alltmer dominerar AI-forskningssektorn.

Forskarna drar slutsatsen att denna tendens att “som standard” använda mycket populära öppna källkodsdatamängder, såsom ImageNet, väcker ett antal praktiska, etiska och till och med politiska orosmoment.

Bland deras fynd – baserat på kärndata från Facebook-ledda communityprojektet Papers With Code (PWC) – hävdar författarna att ‘allmänt använda datamängder introduceras av bara ett fåtal elitinstitutioner’, och att denna “konsolidering” har ökat till 80% under de senaste åren.

‘[Vi] finner att det finns en ökande ojämlikhet i datamängdsanvändning globalt, och att mer än 50% av alla datamängdsanvändningar i vår sample om 43 140 motsvarar datamängder som introducerats av tolv elit-, främst västerländska, institutioner.’

En karta över icke-uppgiftsspecifika datamängdsanvändningar under de senaste tio åren. Kriterier för inklusion är där institutionen eller företaget står för mer än 50% av kända användningar. Till höger visas Gini-koefficienten för datamängdkoncentration över tid för både institutioner och datamängder. Källa: https://arxiv.org/pdf/2112.01716.pdf

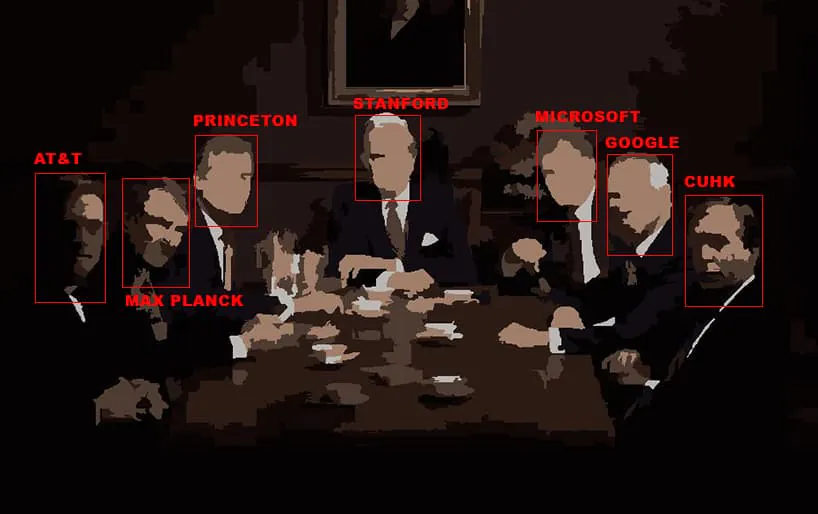

De dominerande institutionerna inkluderar Stanford University, Microsoft, Princeton, Facebook, Google, Max Planck-institutet och AT&T. Fyra av de tio bästa datamängdkällorna är företagsinstitutioner.

Rapporten karakteriserar också den ökande användningen av dessa elitdatamängder som ‘ett fordon för ojämlikhet i vetenskapen’. Detta beror på att forskningsteam som söker samhällets godkännande är mer motiverade att uppnå state-of-the-art (SOTA)-resultat mot en konsekvent datamängd än att generera originaldatamängder som inte har någon sådan status, och som skulle kräva att kollegor anpassar sig till nya mått istället för standardindex.

I vilket fall som helst, som rapporten erkänner, är det att skapa sin egen datamängd en prohibitivt dyrt företag för mindre välresurserade institutioner och team.

‘Den prima facie vetenskapliga giltigheten som ges av SOTA-benchmarking är generiskt förvirrad med den sociala trovärdighet forskare får genom att visa att de kan tävla på en allmänt erkänd datamängd, även om en mer kontextspecifik benchmark kanske vore mer tekniskt lämplig.

‘Vi hävdar att dessa dynamiker skapar en “Matteuseffekt” (dvs. “de rika blir rikare och de fattiga blir fattigare”) där framgångsrika benchmarkar och de elitinstitutioner som introducerar dem, får en oproportionerligt stor status inom fältet.

Rapporten paper heter Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research, och kommer från Bernard Koch och Jacob G. Foster vid UCLA, och Emily Denton och Alex Hanna vid Google Research.

Arbetet väcker ett antal frågor om den ökande trenden mot konsolidering som den dokumenterar, och har mött allmänt godkännande på Open Review. En recensent från NeurIPS 2021 kommenterade att arbetet är ‘extremt relevant för alla som är involverade i maskinlärningsforskning.’ och förutsåg dess inkludering som tilldelad läsning på universitetskurser.

Från nödvändighet till korruption

Författarna noterar att den nuvarande kulturen av “slå-benchmarken” uppkom som en lösning på bristen på objektiva utvärderingsverktyg som orsakade intresse och investeringar i AI att kollapsa för andra gången för över trettio år sedan, efter nedgången i affärsentusiasm mot ny forskning i ‘Expert Systems’:

‘Benchmarkar formaliserar vanligtvis en specifik uppgift genom en datamängd och en associerad kvantitativ utvärderingsmetod. Praktiken introducerades ursprungligen i [maskinlärningsforskning] efter “AI-vintern” på 1980-talet av regeringsfinansiärer, som sökte en mer exakt bedömning av värdet på bidrag.’

Rapporten hävdar att de initiala fördelarna med denna informella kultur av standardisering (minskar hinder för deltagande, konsekventa mått och mer agile utvecklingsmöjligheter) börjar vägas mot de nackdelar som naturligt uppstår när en samling data blir tillräckligt kraftfull för att effektivt definiera sina “användningsvillkor” och inflytandesfär.

Författarna föreslår, i linje med mycket av den senaste industri- och akademiska tanken på området, att forskarsamhället inte längre ställer nya problem om dessa inte kan lösas med hjälp av befintliga benchmark-datamängder.

De noterar också att blind tillgivenhet till denna lilla mängd “gulda” datamängder uppmuntrar forskare att uppnå resultat som är överanpassade (dvs. som är specifika för datamängden och inte sannolikt kommer att fungera nästan lika bra på riktiga data, på nya akademiska eller ursprungliga datamängder, eller ens nödvändigtvis på olika datamängder i “guldstandarden”).

‘Givet den observerade höga koncentrationen av forskning på ett litet antal benchmark-datamängder, tror vi att det är särskilt viktigt att diversifiera former för utvärdering för att undvika överanpassning till befintliga datamängder och missrepresentera framsteg inom fältet.’

Regeringens inflytande i datorseende-forskning

Enligt rapporten är datorseende-forskning särskilt mer påverkad av det syndrom som den beskriver än andra sektorer, och författarna noterar att Natural Language Processing (NLP)-forskning är betydligt mindre påverkad. Författarna föreslår att detta kan bero på att NLP-samhällen är ‘mer sammanhängande’ och större till storlek, och att NLP-datamängder är mer tillgängliga och lättare att kurera, samt att de är mindre och mindre resurskrävande i termer av datainsamling.

I datorseende, och särskilt i ansiktsigenkänning (FR)-datamängder, hävdar författarna att företags-, statliga och privata intressen ofta kolliderar:

‘Företags- och regeringsinstitutioner har mål som kan komma i konflikt med sekretess (t.ex. övervakning), och deras viktning av dessa prioriteringar är troligen annorlunda än de som hålls av akademiker eller AI:s bredare samhällsintressenter.’

För ansiktsigenkänning uppgifter, fann forskarna att förekomsten av rent akademiska datamängder minskar dramatiskt mot genomsnittet:

‘[Fyra] av de åtta datamängderna (33,69% av den totala användningen) finansierades uteslutande av företag, den amerikanska militären eller den kinesiska regeringen (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M drogs tillbaka på grund av kontroverser kring sekretessens värde för olika intressenter.’

I ovanstående graf, som författarna noterar, ser vi också att det relativt nya fältet Bildgenerering (eller Bildsyntes) är starkt beroende av befintliga, äldre datamängder som inte var avsedda för detta användningsområde.

Rapporten observerar en växande trend för “migration” av datamängder bort från deras avsedda syfte, vilket ifrågasätter deras lämplighet för behoven hos nya eller avvikande forskningssektorer, och i vilken utsträckning budgetbegränsningar kan “generera” forskarnas ambitioner till den smalare ramen som tillhandahålls både av de tillgängliga materialen och av en kultur som är så besatt av år-för-år-benchmark-rankningar att nya datamängder har svårt att få fäste.

‘Våra fynd indikerar också att datamängder regelbundet överförs mellan olika uppgiftssamhällen. I den mest extrema änden skapades de flesta benchmark-datamängderna i omlopp för vissa uppgiftssamhällen för andra uppgifter.’

Med avseende på maskinlärningsluminarierna (inklusive Andrew Ng) som alltmer har krävt mer mångfald och kurering av datamängder under de senaste åren, stöder författarna meningen, men tror att sådana ansträngningar, även om de är framgångsrika, potentiellt kan undermineras av den nuvarande kulturens beroende av SOTA-resultat och etablerade datamängder:

‘Vår forskning tyder på att det enkelt att kräva att ML-forskare utvecklar fler datamängder, och att skifta incitamentsstrukturer så att datamängdsutveckling värderas och belönas, kanske inte är tillräckligt för att diversifiera datamängdsanvändning och de perspektiv som slutligen formar och fastställer MLR-forskningsagendor.

‘Förutom att uppmuntra datamängdsutveckling, förespråkar vi jämställdhetsinriktade politiska ingripanden som prioriterar betydande finansiering för personer i mindre resurserade institutioner för att skapa högkvalitativa datamängder. Detta skulle diversifiera – från ett socialt och kulturellt perspektiv – de benchmark-datamängder som används för att utvärdera moderna ML-metoder.’

6:e december 2021, 16:49 GMT+2 – Rättat tillhörande i rubrik. – MA