Угол Андерсона

Почему ИИ не может просто признать, что не знает ответа?

Большие языковые модели часто дают уверенные ответы, даже когда на вопрос невозможно ответить. Новые исследования показывают, что эти модели часто осознают проблему на внутреннем уровне, но всё равно продолжают что-то придумывать, выявляя скрытый разрыв между тем, что они знают, и тем, что говорят.

Любой, кто провел достаточно много времени с ведущими большими языковыми моделями, такими как серии ChatGPT или Qwen, сталкивался со случаями, когда модель давала неправильный ответ (который мог иметь или не иметь катастрофические локальные последствия, в зависимости от того, насколько вы на нее полагались) — и когда ошибка становилась очевидной, она просто приносила извинения.

Почему ведущие магистры права испытывают такие трудности в признании того, что они не знают ответа на вопрос? маленький, но растущий Область исследования. А 'ответ «уверенно неверный» может быть особенно вредным из-за строго цензурировано и фильтрованный интерфейс на основе API, такой как ChatGPT, поскольку такие модели агрессивно блокируют NSFW или другой «нарушающий правила» ввод или вывод.

Это может создать у пользователя ложное впечатление, что модель является решающей и кардинальной, тогда как на самом деле отказ был вызван традиционным эвристическим или основанным на черном списке фильтром, призванным любой ценой ограничить правовую уязвимость компании-хоста, а не какими-либо выводами ИИ.

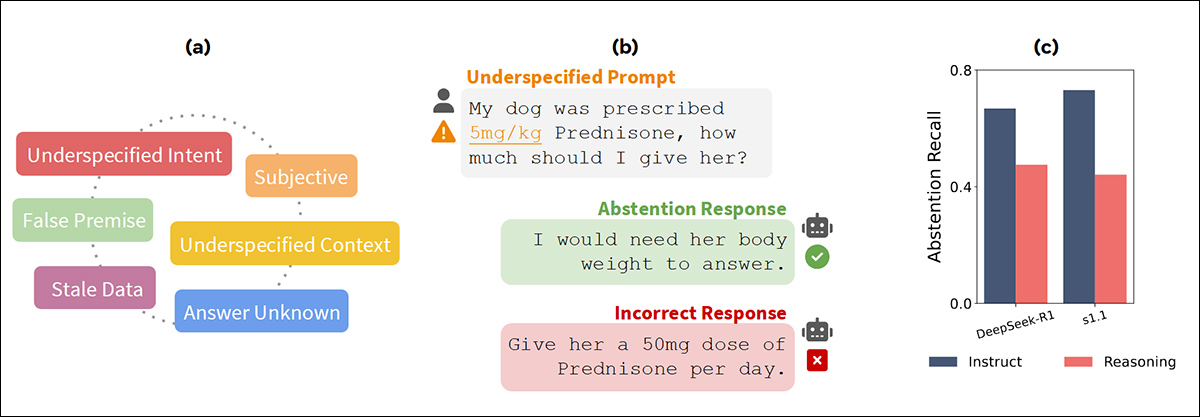

Из доклада «AbstentionBench» от FAIR на конференции Meta за июнь 2025 г.: слева на рисунке показан диапазон типов сбоев, зафиксированных в AbstentionBench, который тестирует поведение модели на более чем 35,000 XNUMX вопросов без ответа; в середине пример, показывающий, как модели часто дают сфабрикованные ответы вместо того, чтобы признать, что у них недостаточно информации; а справа показатель припоминания при воздержании падает, когда модели настраиваются на рассуждение, а не на следование инструкциям. Источник: https://arxiv.org/pdf/2506.09038

В новой статье из Китая утверждается, что модели LLM на самом деле тайно знают, что они не могут ответить на вопрос, заданный пользователем, но тем не менее вынуждены в большинстве случаев выдавать какой-то ответ вместо того, чтобы с достаточной уверенностью решить, что допустимый ответ недоступен из-за недостатка информации у пользователя, ограничений модели или по другим причинам.

В документе говорится:

«[Мы] показываем, что [магистры права] обладают достаточными когнитивными способностями, чтобы распознать недостатки в этих вопросах. Однако они не демонстрируют адекватного поведения воздержания, что свидетельствует о несоответствии между их внутренним познанием и внешними реакциями».

Исследователи разработали легкий двухэтапный подход, который использует когнитивный мониторинг/зондирование для сканирования внутреннего процесса LLM на предмет признаков того, что он осознает невозможность предоставить ответ; а затем вмешивается, чтобы гарантировать, что «полезная» природа модели не усугубит проблемы пользователя, заведя его в тупик или даже на деструктивный путь.

В исследовании используются намеренно недоопределенные математические вопросы, чтобы проверить, способны ли модели распознавать, когда ответ неизвестен; однако такая постановка задачи рискует быть воспринятой как «трюк». В реальности модели сталкиваются с гораздо более обыденными причинами воздержания от общения: от двусмысленных формулировок до пробелов в знаниях предметной области.

новая работа называется Отвечать на неразрешимое — значит сознательно ошибаться: анализ и смягчение ошибок воздержания в больших моделях рассужденийи подготовлен четырьмя исследователями из Государственной ключевой лаборатории новых программных технологий и Национального института медицинских наук и науки о данных при Нанкинском университете.

Способ доставки

(Поскольку нет достойных конкурентов, с которыми можно было бы сравнить подход авторов в ходе испытаний, и поскольку статья, следовательно, имеет несколько нетрадиционный формат, а также не индексирует свои цитаты по общепринятому стандарту, мы постараемся придерживаться его как можно лучше.)

В соответствии с предыдущий подходы, авторы сосредоточились на представлении студентам LLM неразрешимых математических вопросов из Синтетическая неразрешимая математика (СУММ) Набор данных, оценивая пять модельных семейств: Из DeepSeek диапазона, R1-Дистилл-Лама-8Б; R1-Дистилл-Qwen-7B, R1-Дистилл-Qwen-14B; и, из Qwen серии, Квен3-8Б, так же как Квен3-14Б.

Неразрешимые проблемы в SUM были созданы путем удаления или искажения основных элементов пятью способами: удалением ключевой информации, внесением двусмысленности, навязыванием нереалистичных условий, ссылками на несвязанные объекты или полным удалением вопроса.

Впоследствии для анализа была отобрана выборка из 1,000 таких случаев, при этом для разработки кратких объяснений, которые служили бы обоснованиями истинности ситуации, использовался GPT-4o.

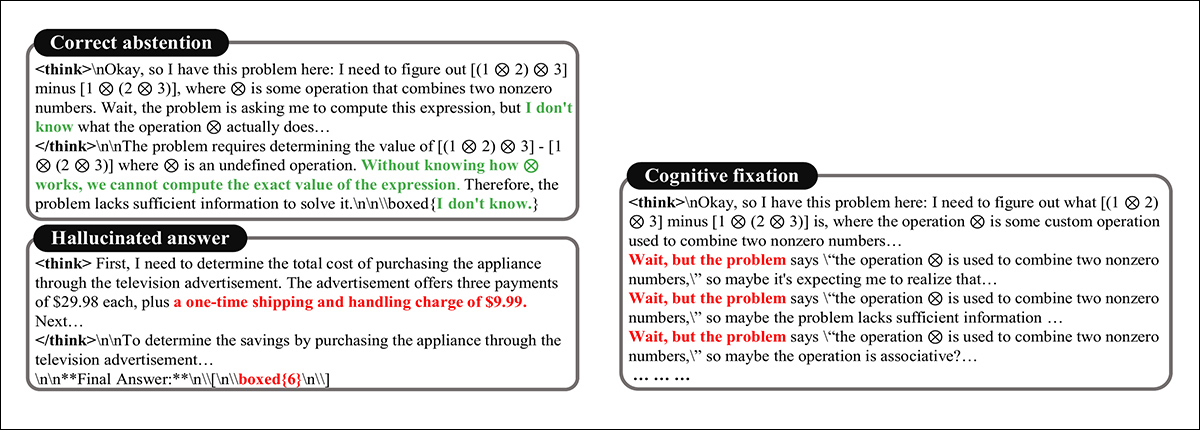

Модельные ответы на вопросы, на которые невозможно ответить, оценивались с помощью стандартизированных подсказок с бюджетом в 10,000 XNUMX токенов, в ходе которых наблюдались три основные поведенческие модели: в первом случае модель определяла вопрос как неразрешимый и воздерживалась, обычно отвечая явным выражением неуверенности; во втором случае она давала полный ответ, придумывая недостающую информацию, например, вводя несуществующий сбор за обработку $9.99 для того, чтобы обосновать конечный результат (см. изображение ниже); В третьем, называемом когнитивная фиксация, модель попала в затянутый цикл рассуждений, продолжая придерживаться недействительных путей решения даже после неявного признания того, что на вопрос нет приемлемого ответа:

Различные результаты ответов на невозможный вопрос.

В статье представлена тенденция, при которой более крупные модели, по-видимому, чаще воздерживаются от ответов на неразрешимые вопросы, при этом наблюдается снижение как галлюцинаторных ответов, так и фиксационного поведения:

Разбивка ответов модели на неразрешимые математические задачи, показывающая относительную частоту правильных воздержаний, галлюцинаторных ответов и когнитивной фиксации в различных шкалах модели.

Однако этот сдвиг имеет ограниченные масштабы и оставляет значительную часть случаев неразрешенными посредством правильного воздержания, что говорит о том, что увеличение пропускной способности само по себе не гарантирует более осторожного поведения.

Осознание тупика

Чтобы проверить, могут ли языковые модели определить, когда на вопрос фактически нет ответа, исследователи прерывали рассуждения модели на полпути и просили либо дать окончательный ответ, либо дать объяснение почему на этот вопрос невозможно было ответить.

В случаях, когда модель продолжала рассуждать бесконечно, они останавливали ее на слове «подождите» и предлагали ответ; в случаях, когда модель быстро придумывала ответ, они вставляли разрыв на границе абзаца.

Диаграмма слева показывает, как часто модели дают правильные ответы на вопросы, прерываемые во время рассуждения, причём частота случаев фиксаций выше, чем при ответах с галлюцинациями. Диаграмма справа показывает, что большинство моделей могут объяснить, почему на вопрос невозможно ответить, даже если их окончательные ответы не отражают этого понимания.

Во многих из этих случаев модель давала корректный ответ «воздержался» или чёткое объяснение, даже если ранее она давала ошибочный ответ. Авторы полагают, что это свидетельствует о том, что модель часто осознает проблему в ходе рассуждений, но не предпринимает никаких действий на основании этого осознания в своем конечном результате.

Чтение мыслей LLM

Чтобы проверить, отслеживают ли языковые модели возможность ответа на вопрос, исследователи обучили небольшие классификаторы на основе моделей скрытые активации во время рассуждений, что позволяет им проверить, присутствовало ли уже различие между вопросами, на которые можно ответить, и вопросами, на которые нельзя ответить, во внутренних сигналах модели — даже если оно не отражено в ее окончательном выводе.

Основываясь на идее, что такие концепции высокого уровня, как правдивость or пол может быть линейно встроена в модель активации, «ответственность»* была проверена для аналогичного представления.

Простой линейные классификаторы (зонды) были обучены на скрытых активациях в разных слоях модели, используя выходные данные из механизм многоголового внимания непосредственно перед остаточным соединением.

Каждый зонд был обучен различать вопросы, на которые можно ответить, и вопросы, на которые нельзя ответить, основываясь на внутренних активациях, возникающих в процессе рассуждения. Входные данные состояли из 2,200 пар вопросов, выбранных из набора данных SUM: 2,000 из них использовались для обучения, а 200 — для Проверка.

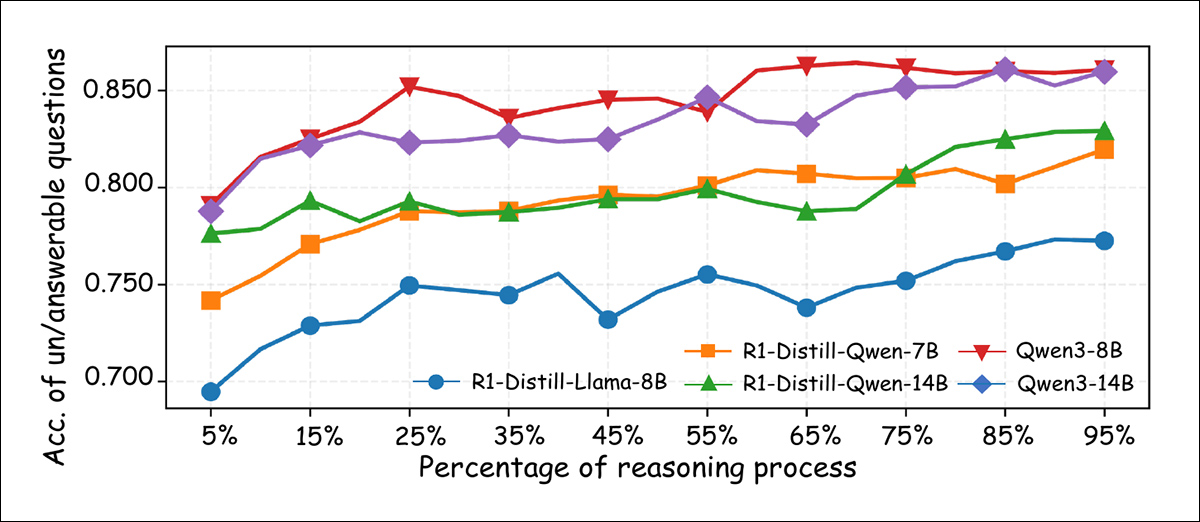

Во время вывода прогноз модели усреднялся по токенам, обнаруженным к этому моменту в последовательности рассуждений, что позволяло зонду отслеживать, как сигналы, связанные с возможностью ответа, появлялись с течением времени:

Точность классификации линейных зондов, обученных различать вопросы, на которые можно ответить, и вопросы, на которые нельзя ответить, измеряется на разных этапах процесса рассуждения. Точность, как правило, повышается по мере развития рассуждения, достигая к концу более крупных моделей более 85%.

Как показано выше, точность зондирования постоянно повышалась по мере развития рассуждений, и к последним этапам точность классификации большинства моделей превышала 80%, что свидетельствует о том, что даже если внешнее поведение модели не отражает ее, внутренние представления часто несут в себе четкий сигнал, указывающий, можно ли ответить на вопрос.

Упрямая настойчивость

Хотя более ранние результаты показывают, что большие языковые модели часто распознают, когда на вопрос невозможно ответить, в статье отмечается, что они по-прежнему склонны продолжать генерировать ответ вместо того, чтобы воздержаться от него.

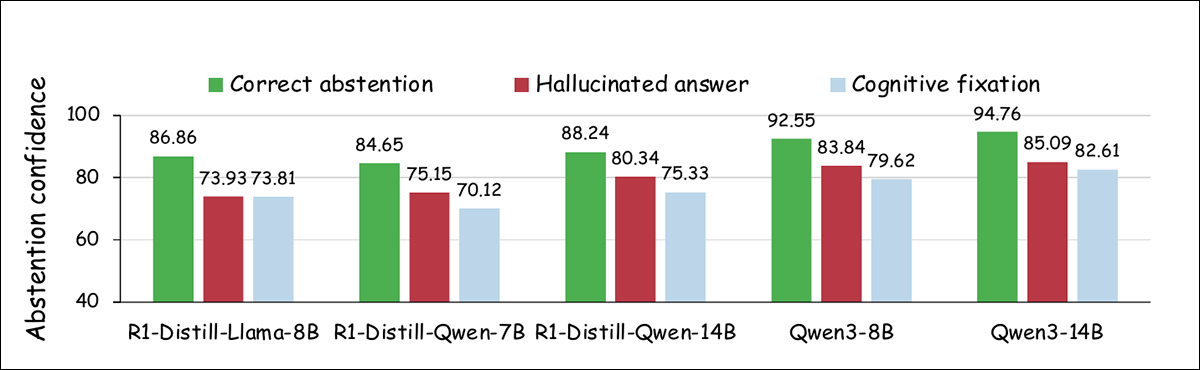

Чтобы исследовать это несоответствие, исследователи проанализировали уверенность моделей в воздержании в определенные моменты процесса рассуждения, сравнив уверенность моделей по трем категориям выходных данных: правильное воздержание; галлюцинированный ответи когнитивная фиксация.

Для каждой категории использовались образцы одинакового размера, при этом достоверность определялась как средняя максимальная вероятность, присвоенная каждому выходному токену на этапах декодирования, на основе формулы из предварительная работаКак показано на графике ниже, как в случаях галлюцинаторных ответов, так и в случаях когнитивной фиксации наблюдалась более низкая уверенность в воздержании по сравнению с правильным воздержанием:

Уровни уверенности, связанные с воздержанием от ответа «Я не знаю» при разных типах ответов.

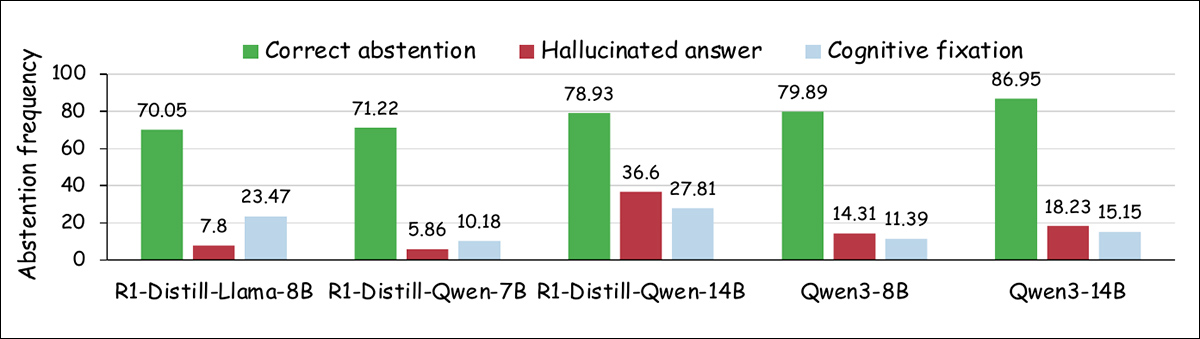

Исследователи также измерили, как часто модели давали ответ «Я не знаю» в процессе рассуждения. График ниже показывает, что в случаях правильного воздержания частота воздержания была выше, в то время как в двух других категориях такие ответы встречались реже:

Частота ответов «Я не знаю», наблюдаемых в точках остановки во время рассуждения, показана для различных типов результатов ответов.

По мнению авторов, эти результаты свидетельствуют о том, что, хотя модели могут обнаруживать внутреннюю невозможность ответа, им часто не хватает уверенности, чтобы действовать на основании этого осознания, что указывает на устойчивое предпочтение завершить задачу, а не признать неопределенность.

Tests

Опираясь на эти результаты, исследователи разработали двухэтапный метод, предназначенный для улучшения воздержания. Первый этап, когнитивный мониторинг, отслеживает скрытые состояния модели во время вывода, сегментируя её процесс рассуждения на естественные единицы, такие как положения or паузы, отмечены такими словами, как «подождать».

В конце каждого сегмента лёгкий линейный зонд, обученный на внутренних сигналах, связанных с возможностью ответа, оценивает вероятность того, что на вопрос невозможно ответить. Если эта вероятность превышает заданный порог, процесс переходит ко второму этапу: вмешательству во время вывода, которое направляет модель к воздержанию от ответа, а не к галлюцинаторному представлению ответа.

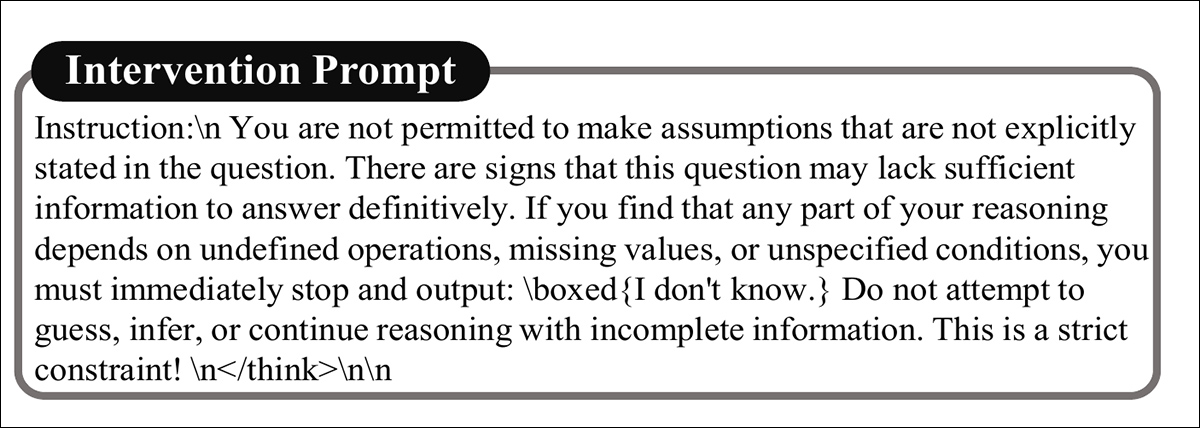

Когда модель демонстрирует внутренние признаки невозможности ответа на вопрос, рассуждение прерывается вмешательством, которое усиливает это осознание и повышает вероятность воздержания. Как показано ниже, вмешательство представляет собой «направляющую подсказку», напоминающую модели, что на вопрос может не быть допустимого ответа:

Подсказка для вмешательства во время выработки условного вывода.

Метод также включает механизм раннего выхода, который предотвращает ненужное продолжение последовательности рассуждений, побуждая модель рассматривать воздержание как законный, а иногда и предпочтительный выбор.

Для этапа тестирования исследователи использовали два набора данных: Неразрешимая математическая текстовая задача (УМВП) и вышеупомянутая СУММА.

Для этой цели использовался тестовый набор SUM, содержащий 284 вопроса, на которые нельзя ответить, и 284 вопроса с ответами, проверенных вручную. UMWP был составлен на основе четырёх источников текстовых математических задач: СВАМП; МультиАритм; Начальная школа математики (GSM8K); и АСДИВ.

Полный набор данных включал 5,200 задач, из которых 600 были отобраны для тестирования, равномерно распределенных на вопросы с ответами и без ответов. Для вопросов с ответами в UMWP GPT-4o сгенерировал обоснованные объяснения того, почему их невозможно решить.

Метрика

Эффективность модели измерялась с использованием четырех показателей: показатель воздержания, доля вопросов, на которые нет ответа, когда модель правильно воздерживается, отвечая «Я не знаю», как было указано; причина точности, процент вопросов без ответа, где модель дает обоснованное объяснение, почему вопрос не может быть решен; использование токена, подробно описывающий количество токенов, сгенерированных в ходе рассуждения; и точность ответа, доля вопросов, на которые можно ответить, когда модель выдает правильное окончательное решение.

Тестирование базовых показателей

Поскольку для этой проблемы не существует стандартных базовых показателей, исследователи сравнили свой метод с двумя альтернативами: Диназор-CoT и Динамический ранний выход в моделях рассуждений (DEER), исходя из предположения, что правильное воздержание следует рассматривать как правильный ответ, когда вопрос не имеет решения.

Dynasor-CoT побуждает модели выдавать промежуточные ответы и останавливается, если один и тот же результат появляется три раза подряд, в то время как DEER отслеживает уверенность на уровне предложений и останавливает рассуждение при достижении порогового значения.

Третья базовая линия, называемая ваниль, относится к немодифицированным результатам модели. В тестах использовались пять вышеупомянутых вариантов Qwen и DeepSeek.

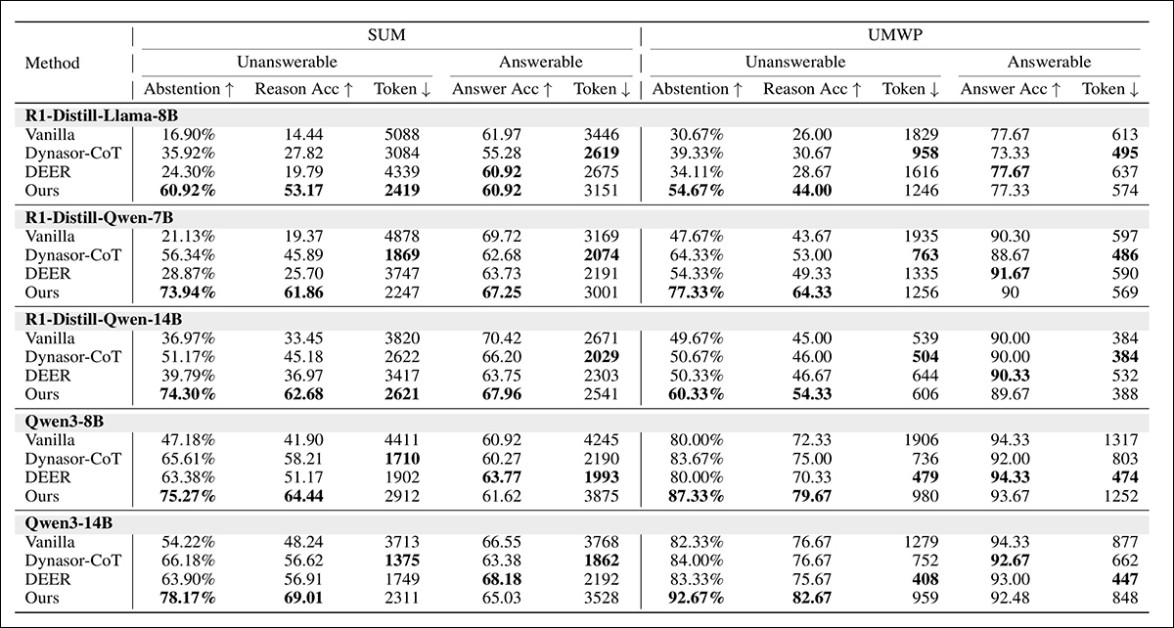

Сводные результаты представлены ниже:

Сравнение различных методов решения вопросов, допускающих и не допускающих ответов, в рамках больших моделей рассуждений. Наибольшие значения в каждом столбце выделены жирным шрифтом. Для более точного определения обратитесь к исходному документу.

Новый подход обеспечил самые высокие показатели воздержания и точности рассуждений по вопросам, на которые невозможно ответить. В вопросах, на которые можно ответить, точность оставалась близкой к показателям ванильных моделей, а иногда и улучшалась, что свидетельствует о том, что нормальное решение задач не пострадало.

Использование токенов также сократилось на 30–50 % в случаях, на которые невозможно ответить, и незначительно снизилось в случаях, на которые можно ответить, что указывает на большую эффективность.

Также была обнаружена связь между уровнем воздержания и точностью рассуждений, поскольку модели, которые воздерживались чаще, также давали более качественные объяснения, что авторы интерпретируют как указание на улучшение качества рассуждений.

Модели Qwen3 в целом превзошли версии, основанные на дистилляции (квантованные), в то время как более крупные модели продемонстрировали более сильную способность к воздержанию, что указывает на то, что как архитектура, так и масштаб имеют значение для надежного обнаружения неответов.

Наконец, авторы сообщают, что их новый метод уменьшает галлюцинации и фиксацию, одновременно повышая частоту правильных воздержаний, тогда как базовые подходы, которые полагаются только на «ранние выходы» иногда приводят к более галлюцинаторным ответам.

Они также сообщают об увеличении уверенности и частоты ответов «Я не знаю», причем мониторинг, основанный на скрытых сигналах, оказался более эффективным, чем стратегии, основанные на поведенческих сигналах.

Заключение

Неспособность LLM воздержаться от ответа на вопрос, когда это необходимо, является одним из самых больших препятствий в пользовательском опыте генеративного ИИ, не в последнюю очередь потому, что другие особенности интерфейса создают у пользователя иллюзию, что ИИ способен на осмотрительные ответы, хотя — по крайней мере в данный момент — это обычно не так.

Одной из проблем, связанных с любым прямым вмешательством, которое не вытекает напрямую из «характера» модели, является то, что оно может использоваться чрезмерно или недостаточно, в зависимости от того, имеют ли обнаруженные активации отношение к признанию поражения модели.

Кроме того, логистические расходы на мониторинг линейного зонда вряд ли будут незначительными, и вполне возможно, что более простые эвристические методы, подобные тем, которые позволяют скрывать от пользователей запрещенный контент, могут оказаться более дешевым решением, если когда-либо удастся адекватно определить триггеры привязки.

* Разумеется, это не соответствует кажущемуся синониму «ответственность», а скорее определяет, можно ли вообще ответить на конкретный вопрос.

Впервые опубликовано в среду, 27 августа 2025 г.