Взгляд Anderson

Дайте языковым моделям ‘рукоятку правды’

Истинно или болтливо: выберите одно. Новый метод обучения позволяет пользователям указывать ИИ-чатботам, насколько «фактично» они должны быть, превращая точность в рукоятку, которую можно поворачивать вверх или вниз.

Новое исследовательское сотрудничество между США и Китаем предлагает то, что почти все пользователи ИИ-чатботов могли бы оценить: виртуальную «рукоятку», которая говорит боту, должен ли он быть «разговорчивым» или «правдивым».

Система была создана путем тонкой настройки модели Mistral-7B на синтетических данных, чтобы схема для «правды» могла быть надпечатана на модели. После этого пересмотра модель Mistral способна контролировать количество фактов в ответе; чем выше «правдивость», заданная пользователем, тем меньше — но более достоверный — будет короткий ответ.

При более низких настройках ответ чатбота становится тем, что авторы статьи называют «информативным», т. е. он даст более длинный ответ и будет содержать больше фактов; но некоторые из этих фактов могут быть галлюцинированными.

Синтетические данные, на которых была обучена система, использовали Википедию в качестве справочного материала для тестового домена: реальных биографических фактов о людях. Независимо от того, считаете ли вы Википедию достоверным источником, ценность работы заключается в проектировании любой системы, которая может ограничить врожденную тенденцию LLM давать ответы, даже когда у него нет ответов, которые можно дать.

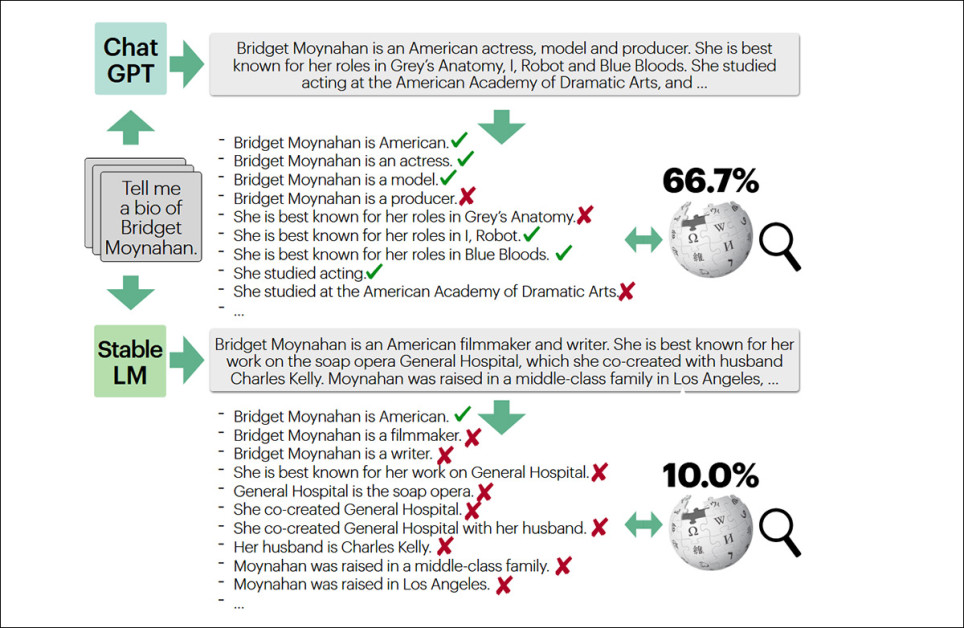

Пример из проекта FactScore, который обеспечил курирование набора данных для статьи, которую мы рассматриваем здесь, используя Википедию в качестве справочного материала для биографических деталей. Источник

Авторы отмечают, что контексты с высоким уровнем гарантии, такие как медицинские и юридические области, требуют консервативных и надежно фактических выходных данных, тогда как многие другие типы пользователей требуют более гибкого и творческого, интерпретативного типа выходных данных (т. е. дискурсивного письма и академического анализа и т. д.).

Они замечают*:

«[Текущие] LLM предлагают нет встроенного механизма для контроля этого компромисса.

«Хотя пользователи могут попытаться направить поведение модели с помощью подсказок, таких как „быть более фактичным“, мы обнаружили, что передовые модели не надежно корректируют свои выходные данные в ответ на такие подсказки в этой задаче.

«На FactScore мы обнаружили, что готовые модели часто не удовлетворяют даже умеренно-строгим целям. Этот разрыв мотивирует контролируемую альтернативу, которая позволяет пользователям запрашивать определенный уровень фактичности и имеет модель, корректирующую свои ответы соответственно».

Только факты

Чтобы понять статью и предложенные решения, необходимо рассмотреть свое собственное определение «информативности». Авторы утверждают, что количественная оценка информативного ответа равна «количество поддерживаемого контента в выходных данных, измеряемое как количество проверенных атомарных утверждений, нормализованных по длине выходных данных».

В другом месте статья гласит более просто, что информативность — это «общее количество атомарных фактов в выходных данных, будь то правильные или нет».

Далее исследователи отмечают, что тенденция LLM колебаться между фактической точностью и субъективными догадками является очень человеческой чертой, и одной, задокументированной различными научными исследованиями*:

«[Знания LLM] неравномерно надежны: некоторые утверждения сильно поддерживаются, в то время как другие являются спекулятивными, устаревшими или неопределенными. Генерация требует принятия решения о том, сколько сказать и как осторожно сказать это, создавая напряжение между фактической точностью и информативностью.

«Люди делают аналогичный выбор: начиная с высоконадежных фактов и добавляя менее достоверные детали только тогда, когда их просят».

Хотя эксперименты проводились только на средней модели Mistral, принципы, примененные здесь, должны работать на различных масштабах и платформах, поскольку они включают новую квантификацию данных в качестве дополнения к внутренней схеме LLM; и поправки такого типа не являются архитектурно-специфичными.

Статья новая статья озаглавлена Фактичность по требованию: Контроль компромисса между фактичностью и информативностью в генерации текста, и исходит от семи исследователей из Колумбийского университета, Нью-Йоркского университета и NYU Шанхай.

Метод и данные

Новый подход, представленный в статье, называется Генерация с контролем фактичности (FCG), и вводит виртуальную «рукоятку», которая позволяет пользователям указывать, насколько точно они хотят, чтобы ответ чатбота был. «По сути», статья гласит, «FCG улучшает модель с контролируемой „рукояткой“ для фактичности».

Модель принимает как вопрос пользователя, так и желаемый уровень фактичности, затем генерирует ответ, который включает только информацию, которую она считает достаточно надежной, при этом пытаясь быть как можно более подробной в рамках этого ограничения.

Используя систему FactScore (вышеупомянутую), сегментированный вывод из образцов запросов оценивается на точность, качество, определенное как соблюдение фактичности:

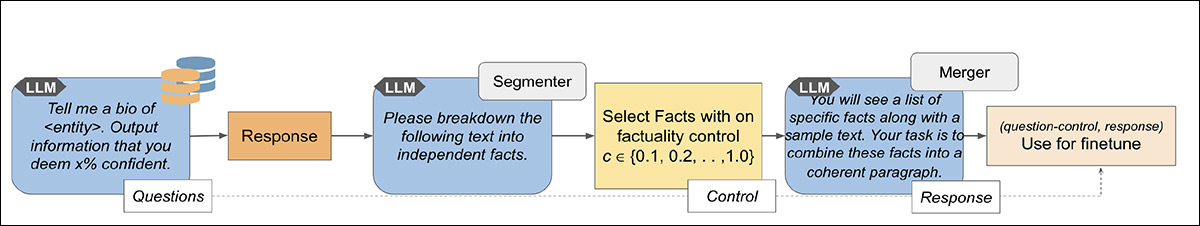

Конвейер обучающих данных для FCG: языковая модель генерирует初альный ответ, разбивает его на атомарные факты, ранжирует их по достоверности и удаляет наименее достоверные до тех пор, пока не будет достигнут желаемый уровень правды. Источник

Поскольку нет существующего набора данных, соответствующего требованиям FCG, авторы создали синтетический набор данных, сначала заставив языковую модель GPT-4† сгенерировать неограниченный ответ, затем удалить «наименее достоверные» факты, пока ответ не соответствовал заданному уровню точности.

Предыдущая работа предполагала, что обучение только на данных фактической правды может фактически сделать модели менее фактичными, поскольку это может отговорить их от предоставления любой дополнительной информации вообще. Поэтому примеры обучения FCG были минимально отредактированы, сохраняя собственную формулировку и ритм модели, при этом уменьшая только достаточно, чтобы удовлетворить требуемый целевой уровень достоверности.

Применяя этот процесс редактирования в диапазоне целевых уровней достоверности, от 10% до строгого порога 100%, был создан синтетический набор данных, в котором каждый вопрос был сопоставлен с несколькими отфильтрованными ответами.

В каждой версии сохранялись только те факты, которые модель считала достаточно достоверными, чтобы удовлетворить запрошенный уровень фактичности; эти примеры затем использовались в качестве обучающих данных для контролируемой тонкой настройки.

Окончательный набор данных состоял из 3 302 (вопрос, контроль, ответ) тройных для обучения и 396 для валидации, построенных из 500 сущностей, разделенных на 450 для обучения и 50 для разработки. Дополнительные 183 различных сущности были использованы для тестирования.

Обучение и тесты

Авторы тонко настроили модель Mistral-7B-Instruct-v0.2 LLM при различных ставках обучения (3e-6, 1e-5, 3e-5) для достижения оптимальной (неуказанной) LR, в течение 30 эпох, при размере партии 256 (н.б. оборудование для обучения не указано).

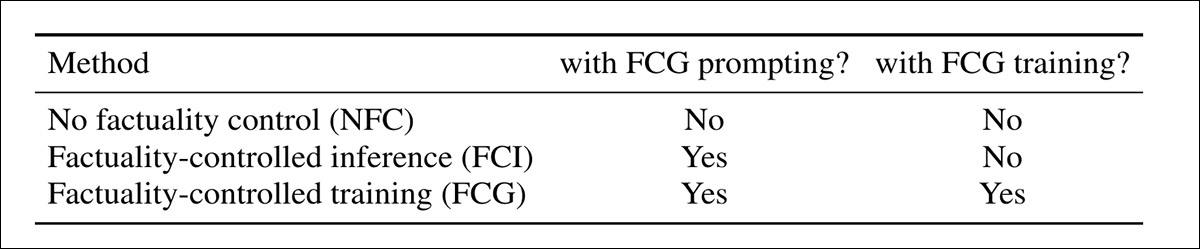

FCG была протестирована против двух базовых линий. Первая — это Нет контроля фактичности (NFC), где модель просто была запущена с запросом, таким как Расскажите мне биографию X, без упоминания точности или достоверности. Этот вариант отражает поведение LLM по умолчанию, без каких-либо механизмов фильтрации или ограничения.

Второй метод, называемый Вывод с контролем фактичности (FCI), использовал те же подсказки уровня достоверности без тонкой настройки. Например, модель могла быть запущена с «Выведите информацию, которую вы считаете 90% достоверной». В этом случае инструкция напоминала те, которые использовались в обучении, но модель не имела предварительного опыта работы с такими ограничениями:

Сравнение трех протестированных подходов: базовая линия без контроля; версия, использующая подсказки фактичности без обучения; и полностью обученная модель, которая научилась следовать настройкам точности через воздействие отфильтрованных данных.

Первоначально был проведен тест на соблюдение фактичности:

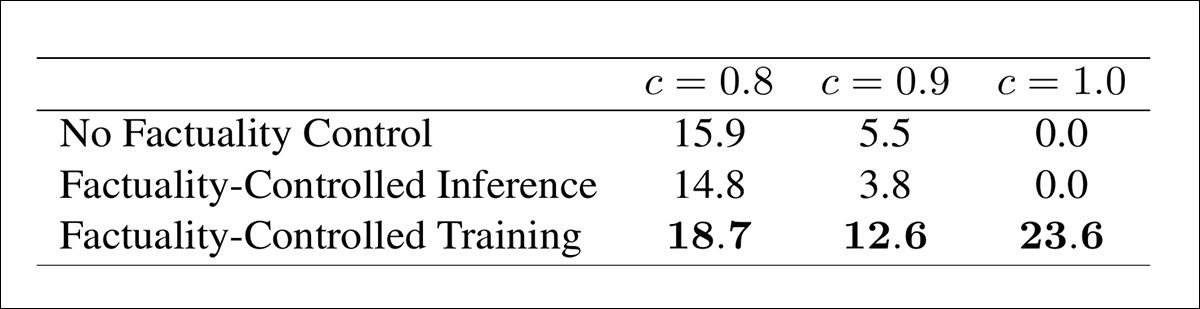

Производительность на трех целевых уровнях достоверности. Только полностью обученная модель смогла постоянно удовлетворять цели. Она превзошла обе базовые линии во всех отношениях, особенно на более высоких порогах.

Когда она была протестирована на порогах фактичности 80%, 90% и 100%, только тонко настроенная модель смогла постоянно удовлетворять цели. Удивительно, что просто добавление инструкций по достоверности, без обучения модели следовать им, не помогло. В некоторых случаях это даже ухудшило ситуацию; например, только 3,8% выходных данных из запущенной модели удовлетворяли порогу 90%, по сравнению с 5,5% из версии без инструкции вообще:

Это говорит о том, что базовая модель Mistral-7B не смогла интерпретировать подсказки, такие как «быть 90% достоверным», полезным образом, и что дополнительная инструкция могла даже нарушить ее обычный выход.

Напротив, обученная модель реагировала надежно на сигналы контроля, производя 18,7% соответствующих выходных данных на 80%, 12,6% на 90% и 23,6% на 100%; и она оказалась единственным методом, способным генерировать полностью фактические ответы:

«Эти улучшения указывают на то, что способность контролировать фактичность действительно может быть воспитана посредством контролируемого обучения. Модель FCG научилась корректировать свой контент и включать только факты, в которых она достаточно уверена, тогда как модель без изменений не могла эффективно использовать сигнал контроля самостоятельно».

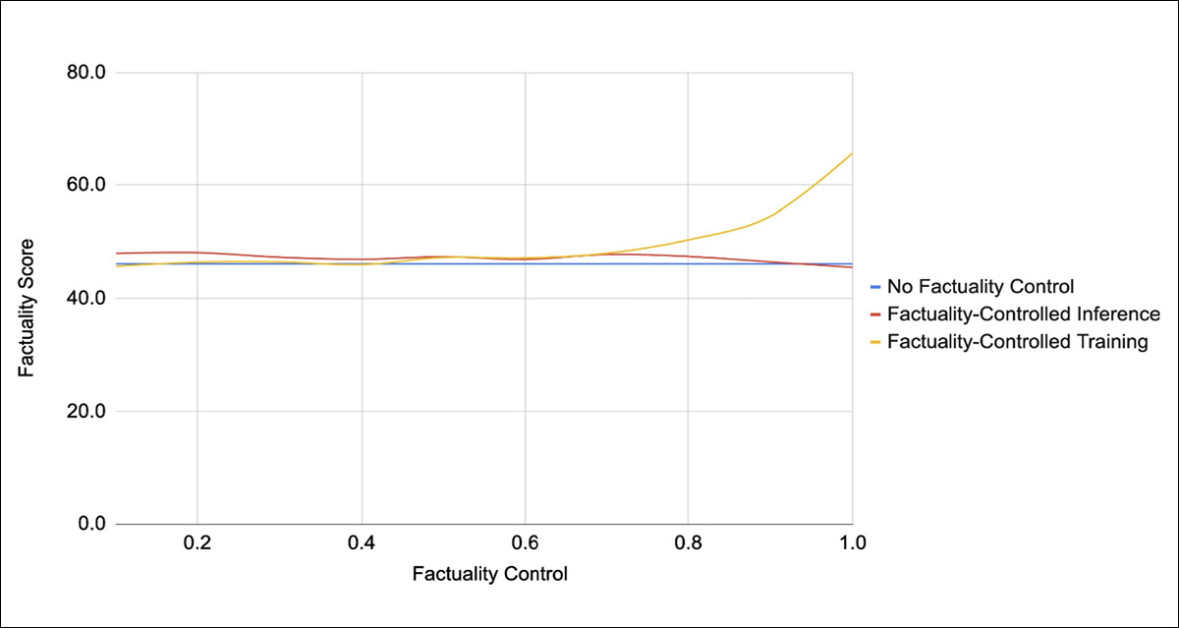

В отдельном тесте, предназначенном для подтверждения того, что модель действительно научилась интерпретировать сигнал контроля, исследователи проверили, повышается ли средняя фактичность ответов по мере увеличения настроек правды.

Никакой такой закономерности не было обнаружено до обучения, но после этого результаты показали стабильную восходящую тенденцию, с более высокими запрошенными уровнями достоверности, производящими соответствующим образом более точные ответы:

По мере увеличения целевого уровня правды тонко настроенная модель производила все более фактические выходные данные в ответ, с базовыми моделями, демонстрирующими никаких постоянных изменений в том же диапазоне.

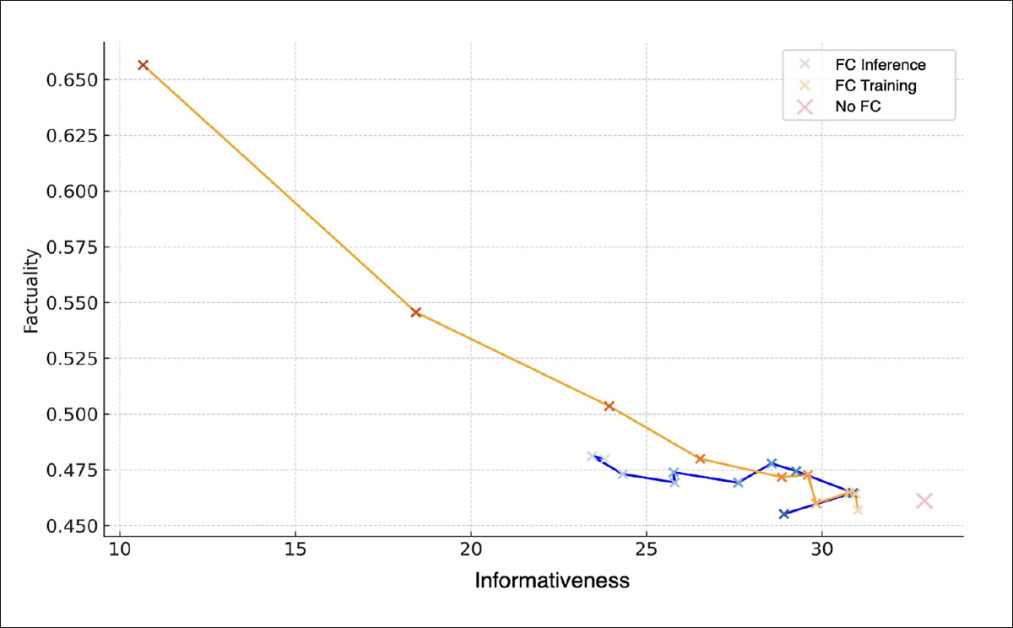

Компромисс между правдивостью и «богатством» также был изучен. Выходные данные оценивались не только на точность, но и на то, сколько проверенной информации осталось при все более строгих требованиях к фактичности. Как показано на графике ниже, модель FCG была найдена лучше, чем обе базовые линии, на большинстве уровней:

График, представляющий компромисс между фактичностью и информативностью на трех методах. Тонко настроенная модель была найдена лучше, чем обе базовые линии, в балансе между правдой и детальностью. На сравнимых уровнях точности больше фактического контента было сохранено, и на самом высоком уровне она осталась единственным методом, способным производить полностью проверенные ответы, которые не были пустыми.

На целевом уровне точности около 90% больше фактов было сохранено FCG, чем любым другим методом, и на всем диапазоне уровней достоверности ни одна базовая линия не производила последовательно лучших результатов.

Разница была наиболее заметна на самом строгом уровне, где FCG продолжала производить ненулевую информативность, в то время как базовая линия с подсказками одна была вынуждена удалить все. В этих случаях даже одно низкодостоверное утверждение вызывало удаление всего ответа.

Напротив, обученная модель смогла изменить свой выход, чтобы сохранить только факты, которые она считала полностью надежными, избегая коллапса в молчании, которое затронуло другие.

Фактичность была напрямую ограничена настройкой контроля, в то время как информативность была оптимизирована, позволяя модели включать как можно больше надежного контента. На более высоких настройках только достоверные утверждения сохранялись; на более низких настройках более спекулятивные детали были разрешены, увеличивая длину, но снижая точность.

Авторы заключили:

«[Когда] высокий уровень фактичности ограничен, модель отдает приоритет проверяемым утверждениям, сохраняя при этом как можно больше релевантной информации. Напротив, модель имеет свободу включать более широкий диапазон деталей, включая те, которые менее проверяемы или более спекулятивны, в результате чего информативность (больше фактов упоминается) увеличивается за счет некоторой точности.

«Это поведение соответствует нашему дизайну обучающих данных: поскольку мы всегда удаляли минимально необходимые факты, модель научилась „если вы должны быть x% фактичными, удалите наименее достоверные детали, но сохраните все остальное“».

Статья завершается надеждой, что новая методология будет попытана с более крупномасштабными моделями и применена к более сложным задачам, среди других возможных будущих расширений работы.

Заключение

Решение, предложенное здесь, решает одну из наиболее серьезных и часто отмечаемых проблем даже последнего поколения Больших языковых моделей — их тенденцию отдавать предпочтение разговорчивости над точностью, видимо, просто чтобы «поддерживать разговор», и уверенно представлять либо устаревшую, либо полностью вымышленную информацию как фактическую.

Для пользователей ChatGPT любой уверенный ответ, не предшествующий краткому появлению виджета «поиск в сети», будет либо из пределов знаний модели, либо может быть так же хорошо галлюцинацией, как и фактом.

Однако поиски в сети увеличивают задержку и текущие затраты на работу LLM, и, как знает любой пользователь, они запускаются выборочно; или по запросу пользователя; или как «специальная настройка», которая может понести дополнительные токенные сборы.

Тем не менее, эти виды внутренней экономики могут иметь решающее влияние на запросы LLM в определенных областях или для определенных типов запросов. Любой метод, который может навязать схему, связанную с точностью выходных данных, действительно является желательным исследованием.

* Мое преобразование внутренних цитат авторов в гиперссылки.

† Полный номер версии не указан.

Опубликовано впервые в пятницу, 6 февраля 2026 года. Исправлено в течение следующих пяти минут для повторения слова