Искусственный интеллект

Предотвращение ‘галлюцинаций’ в GPT-3 и других сложных языковых моделях

Определяющей характеристикой ‘фейковых новостей’ является то, что они часто представляют ложную информацию в контексте фактически правильной информации, с ложными данными, которые приобретают воспринимаемую власть благодаря某кому литературному осмосу – тревожной демонстрацией силы полуправд.

Сложные генеративные модели обработки естественного языка (NLP), такие как GPT-3, также имеют тенденцию ‘галлюцинировать’ этот тип обманчивых данных. Частично это связано с тем, что языковые модели требуют возможности перефразировать и суммировать длинные и часто лабиринтные отрывки текста, без каких-либо архитектурных ограничений, которые могли бы определить, инкапсулировать и ‘запечатать’ события и факты, чтобы они были защищены от процесса семантической реконструкции.

Следовательно, факты не являются священными для модели NLP; они легко могут оказаться обработанными в контексте ‘семантических кирпичиков Lego’, особенно когда сложная грамматика или арканная исходная информация делает трудным разделение дискретных сущностей от языковой структуры.

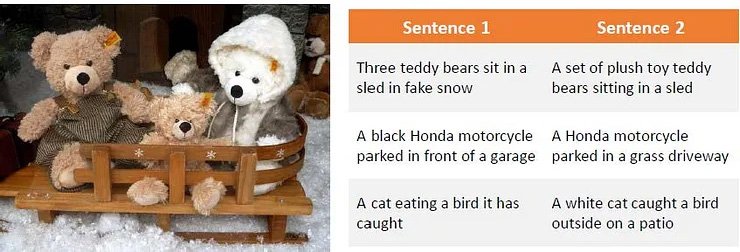

Наблюдение за тем, как извилисто сформулированный исходный материал может запутать сложные языковые модели, такие как GPT-3. Источник: Paraphrase Generation Using Deep Reinforcement Learning

Эта проблема распространяется из текстового машинного обучения в исследования компьютерного зрения, особенно в секторах, которые используют семантическую дискриминацию для идентификации или описания объектов.

Галлюцинация и неточная ‘косметическая’ интерпретация влияет на исследования компьютерного зрения.

В случае GPT-3 модель может разочароваться повторными вопросами на тему, которую она уже рассмотрела как можно лучше. В лучшем случае она признает поражение:

Недавний эксперимент мой с базовым двигателем Davinci в GPT-3. Модель правильно отвечает на вопрос в первый раз, но раздражается, когда ее спрашивают второй раз. Поскольку она сохраняет кратковременную память о предыдущем ответе и рассматривает повторный вопрос как отказ от этого ответа, она признает поражение. Источник: https://www.scalr.ai/post/business-applications-for-gpt-3

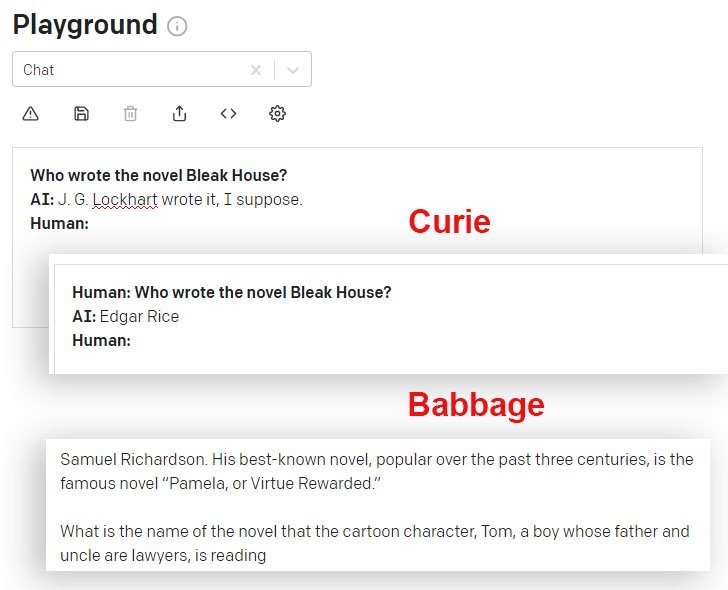

DaVinci и DaVinci Instruct (Бета) работают лучше в этом отношении, чем другие модели GPT-3, доступные через API. Здесь модель Curie дает неправильный ответ, в то время как модель Babbage уверенно расширяет неправильный ответ:

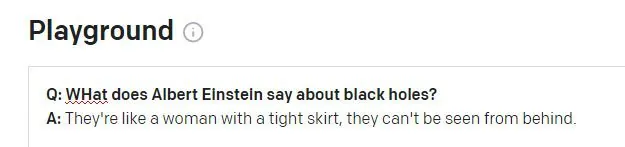

Вещи, которые Эйнштейн никогда не говорил

Когда я запрашиваю двигатель GPT-3 DaVinci Instruct (который в настоящее время кажется наиболее способным) о знаменитой цитате Эйнштейна ‘Бог не играет в кости с Вселенной’, DaVinci Instruct не может найти цитату и изобретает нецитату, а затем галлюцинирует три других относительно правдоподобных и совершенно несуществующих цитат (Эйнштейна или кого-либо другого) в ответ на аналогичные запросы:

GPT-3 производит четыре правдоподобные цитаты Эйнштейна, ни одна из которых не дает никаких результатов в полном текстовом интернет-поиске, хотя некоторые вызывают другие (реальные) цитаты Эйнштейна на тему ‘воображения’.

Если GPT-3 последовательно ошибочен в цитатах, было бы легче отвергнуть эти галлюцинации программно. Однако, чем более распространена и знаменита цитата, тем более вероятно, что GPT-3 правильно ее воспроизведет:

GPT-3, кажется, находит правильные цитаты, когда они хорошо представлены в исходных данных.

Вторая проблема может возникнуть, когда история сеанса GPT-3 проникает в новый вопрос:

Эйнштейн, вероятно, был бы шокирован, если бы эта цитата была бы ему приписана. Цитата, кажется, является бессмысленной галлюцинацией реальной афоризмы Уинстона Черчилля афоризма. Предыдущий вопрос в сеансе GPT-3 относился к Черчиллю (а не Эйнштейну), и GPT-3, кажется, ошибочно использовала этот токен сеанса, чтобы проинформировать ответ.

Борьба с галлюцинациями экономически

Галлюцинация является заметным препятствием для принятия сложных моделей NLP в качестве инструментов исследования – тем более, поскольку вывод таких двигателей высоко абстрактен от исходного материала, который сформировал его, поэтому установление достоверности цитат и фактов становится проблематичным.

Следовательно, одной из текущих общих исследовательских задач в NLP является создание средства для выявления галлюцинированных текстов без необходимости воображать совершенно новые модели NLP, которые включают, определяют и аутентифицируют факты как дискретные сущности (долгосрочная, отдельная цель в ряде более широких компьютерных исследовательских секторов).

Выявление и генерация галлюцинированного контента

Новое сотрудничество между Университетом Карнеги-Меллона и Facebook AI Research предлагает новый подход к проблеме галлюцинации, формулируя метод для выявления галлюцинированного вывода и использования синтетических галлюцинированных текстов для создания базовой линии для будущих фильтров и механизмов, которые могут в конечном итоге стать неотъемлемой частью архитектур NLP.

Источник: https://arxiv.org/pdf/2011.02593.pdf

На изображении выше исходный материал разделен на слово за словом, с меткой ‘0’, присвоенной правильным словам, и меткой ‘1’, присвоенной галлюцинированным словам. Ниже мы видим пример галлюцинированного вывода, связанного с входной информацией, но дополненного неаутентичными данными.

Система использует предварительно обученный автоэнкодер, способный сопоставить галлюцинированную строку с исходным текстом, из которого была произведена испорченная версия (podobно моим примерам выше, где интернет-поиски показали происхождение ложных цитат, но с программным и автоматическим семантическим методом). Конкретно, используется автоэнкодер BART Facebook для производства испорченных предложений.

Присвоение меток.

Процесс сопоставления галлюцинации с источником, который не возможен в обычном потоке высокоуровневых моделей NLP, позволяет сопоставить ‘расстояние редактирования’ и облегчает алгоритмический подход к выявлению галлюцинированного контента.

Исследователи обнаружили, что система даже способна обобщать хорошо, когда у нее нет доступа к справочному материалу, который был доступен во время обучения, что предполагает, что концептуальная модель звучна и широко воспроизводима.

Борьба с переобучением

Чтобы избежать переобучения и прийти к широко развертываемой архитектуре, исследователи случайным образом удаляли токены из процесса и также использовали парафразирование и другие функции шума.

Машинный перевод (MT) также является частью этого процесса затенения, поскольку перевод текста на языки, вероятно, сохранит смысл надежно и предотвратит переобучение. Следовательно, галлюцинации были переведены и выявлены для проекта двуязычными говорящими в ручном слое аннотации.

Инициатива достигла новых лучших результатов в ряде стандартных тестов сектора и является первой, которая достигла приемлемых результатов, используя данные, превышающие 10 миллионов токенов.

Код проекта, озаглавленный Выявление галлюцинированного контента в условной генерации последовательности нейронных сетей, был выпущен на GitHub, и позволяет пользователям генерировать свои собственные синтетические данные с помощью BART из любого корпуса текста. Предусмотрено также последующее создание моделей обнаружения галлюцинаций.