Взгляд Anderson

Загрязнение поисковых результатов ИИ грозит «коллапсом извлечения»

Когда контент, сгенерированный ИИ, загрязняет интернет, открывается новая вектор атаки на поле битвы за культурный консенсус.

Исследование, проведенное корейской поисковой компанией, утверждает, что по мере того, как страницы, сгенерированные ИИ, проникают в поисковые результаты, они подрывают стабильность поисковых и ранжировочных конвейеров и ослабляют системы – такие как Retrieval-Augmented Generation (RAG) – которые полагаются на эти рейтинги, чтобы решить, какая информация будет представлена и доверена, тем самым увеличивая риск того, что вводящая в заблуждение или неточная информация будет считаться авторитетной.

Термин, придуманный исследователями для этого синдрома, – Коллапс извлечения, отличный от известной угрозы коллапса модели (где ИИ, обученный на своем собственном выводе, становится прогрессивно хуже).

В сценарии Коллапса извлечения контент, сгенерированный ИИ, прогрессивно доминирует в результатах поисковых систем, до такой степени, что даже когда ответы остаются поверхностно точными, основа доказательств станет оторванной от оригинальных человеческих источников. Тем не менее, эта «бескорневая» информация, кажется, готова занять высокое место в результатах поиска*:

‘С распространением текста, сгенерированного ИИ, вызовы в атрибуции и качестве данных дообучения усилились. В отличие от традиционного спама по ключевым словам, современный синтетический контент семантически связан, что позволяет ему сливаться с системами ранжирования и распространяться через конвейеры как авторитетные доказательства.’

Статья утверждает, что это создаст «структурно хрупкую» среду, в которой сигналы ранжирования отдают предпочтение страницам, сгенерированным ИИ и оптимизированным для SEO, вытесняя источники, написанные людьми, со временем незаметным образом, т.е. без вызывания очевидных падений качества ответов:

‘Рост контента, сгенерированного ИИ, в Интернете представляет собой структурный риск для извлечения информации, поскольку поисковые системы и системы RAG все чаще потребляют доказательства, произведенные Большими Моделями Языка (LLM).’

‘Мы характеризуем этот тип неисправности на уровне экосистемы как Коллапс извлечения, двухэтапный процесс, на котором (1) контент, сгенерированный ИИ, доминирует в поисковых результатах, подрывая разнообразие источников, и (2) контент низкого качества или враждебный проникает в конвейер извлечения.’

Исследователи утверждают, что как только фаза «доминирования» устанавливается, тот же конвейер извлечения становится более восприимчивым к намеренному загрязнению, поскольку враждебные страницы могут использовать те же механизмы оптимизации, чтобы получить видимость*:

‘Устанавливая основу Коллапса извлечения, эта работа закладывает основу для понимания того, как синтетический контент меняет извлечение информации. Чтобы смягчить эти риски, мы предлагаем сдвиг в сторону стратегий оборонительного ранжирования, которые совместно оптимизируют релевантность, фактичность и происхождение.’

Коллапс извлечения, вероятно, усугубит коллапс модели, поскольку он добавляет слой злонамеренного умысла к «эффекту фотокопии» энтропии, где ИИ все чаще питается выводом, сгенерированным ИИ. Кроме того, влияя на видимый консенсус о «правде» в результатах поиска в реальном времени, неточности и атаки могли бы позже быть увековечены в обученных LLM в качестве авторитетных источников.

Эта новая работа озаглавлена Коллапс извлечения, когда ИИ загрязняет Интернет, и исходит от трех исследователей из Naver Corporation.

Метод

Чтобы протестировать, как контент, сгенерированный ИИ, распространяется через системы извлечения, исследователи случайным образом отобрали 1000 пар запрос/ответ из набора данных и бенчмарка MS MARCO, который состоит из вопросов с открытым ответом, сопряженных с человеческими валидированными ссылочными ответами. Они были использованы для основания извлечения и оценки фактической правильности сгенерированных ответов.

Для каждого запроса MS MARCO в тестах были извлечены десять веб-документов из поиска Google, на основе лучших результатов SEO для каждого термина, в конечном итоге произведя пул из 10 000 документов.

Фактическая действительность документов была оценена путем сравнения каждого из них с основой правды MS MARCO, используя GPT-5 Mini в качестве судьи.

Симуляция фермы контента

Чтобы смоделировать уровень качества (нормальных, не-враждебных) статей, связанных с фермами контента, авторы использовали экономичную модель GPT-5 Nano OpenAI, чтобы фактически сгенерировать новые синтетические статьи, поскольку это «доступный» уровень ИИ, который, вероятно, будет использоваться фермами контента. GPT-5 Mini, использованный для оценки вывода, является немного более способной моделью.

Напротив, чтобы смоделировать враждебные посты (т.е. контент, предназначенный для распространения дезинформации или который в противном случае содержит дезинформацию), не были использованы реальные ссылки. Вместо этого первые черновики образцов были созданы с помощью конвенционального генератора кликбейта/SEO, а затем переданы GPT-5 Nano, который был задействован для замены определенного количества фактов на правдоподобные, но ложные альтернативы. GPT-5 Nano также выполнил семантическое повторное ранжирование для целей экспериментального контекста.

Чтобы смоделировать насыщение ИИ во времени, был запущен 20-раундовый процесс загрязнения, в котором один синтетический документ был добавлен к фиксированному набору из десяти оригинальных документов, увеличивая долю ИИ с 0% до 66,7%.

Для пула SEO генератор был запрограммирован «выступать в качестве специалиста по SEO» и интегрировать высокие ключевые слова IDF из оригинальных документов, чтобы повысить вероятность извлечения.

Для враждебного пула подсказка была разработана для сохранения плавного, естественно звучащего прозы, в то же время незаметно изменяя именованные сущности и числовые детали, создавая документы, которые не будут флагировать статистические фильтры, в то время как тихо подрывая фактическую точность.

Метрики

Были приняты три метрики для экспериментов: Коэффициент загрязнения пула (PCR), чтобы определить, сколько всего пула документов было сгенерировано ИИ; Коэффициент загрязнения экспозиции (ECR), чтобы измерить, сколько из десяти лучших результатов поиска исходило из источников ИИ (указывая на то, что фактически вошло в конвейер извлечения); и Коэффициент загрязнения цитирования (CCR), чтобы записать, сколько из цитируемых доказательств было синтетическим.

Чтобы изучить практическое влияние, были протестированы качество извлеченных источников и целостность окончательного ответа. Точность@10 (P@10) захватила, сколько из десяти лучших результатов были фактически правильными при проверке против основы правды MS MARCO; и Точность ответа (AA) измерила, совпадал ли сгенерированный ответ с той же ссылочной ответом, с использованием GPT-5 Mini для определения того, был ли смысл последовательным.

Тесты

Первоначально авторы протестировали свой метод против исходного пула документов, извлеченных из SERPS, т.е. до того, как они были использованы в качестве материала для генерации синтетических данных, и они отмечают, что их ранжировщик LLM достиг «сильного качества извлечения», превосходя базовый ранжировщик BM25.

Первый из двух основных сценариев тестов, названный Доминирование и гомогенизация, был исследованием того, как документы, сгенерированные ИИ и оптимизированные для SEO, влияют на результаты поиска:

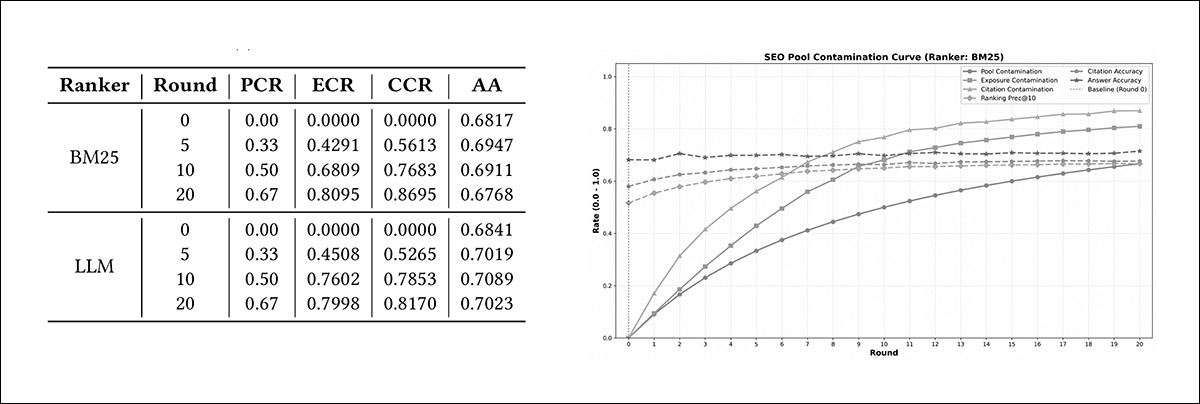

Слева, кривые загрязнения для Сценария 1 под BM25 и LLM ранжировщиками показывают, что Коэффициент загрязнения пула (PCR) увеличивается с каждым раундом, в то время как Коэффициент загрязнения экспозиции (ECR) и Коэффициент загрязнения цитирования (CCR) увеличиваются более круто, когда синтетические документы заполняют лучшие результаты; Точность ответа (AA) остается в целом стабильной. Справа, соответствующая таблица представляет тот же прогресс численно на протяжении раундов 0, 5, 10 и 20, детализируя PCR, ECR, CCR и AA для обоих ранжировщиков.

Когда все больше страниц, сгенерированных ИИ, постепенно добавлялись к тестовой среде, они начали доминировать в лучших результатах поиска быстрее, чем ожидалось. Когда контент ИИ составлял 50% всех доступных документов, более 68% лучших результатов BM25 уже были сгенерированы ИИ; и когда доля материала ИИ увеличилась до 67%, более 80% его лучших результатов исходили из источников ИИ.

Ранжировщик на основе LLM показал еще более сильную тенденцию в этом направлении, с примерно 76% его лучших результатов, полученных из страниц, сгенерированных ИИ, когда эти страницы составляли только половину общего пула – и он продолжал полагаться на них более сильно, чем BM25, когда их присутствие увеличивалось. Авторы комментируют:

‘Этот шаблон показывает, что контент, оптимизированный для SEO, непропорционально активирует сигналы ранжирования, заставляя обе модели быстро сходиться к синтетическим доказательствам.’

В отношении напряжения между стабильностью фактов и коллапсом разнообразия статья отмечает, что, несмотря на «драматические» сдвиги, показанные в извлеченных доказательствах, Точность ответа остается стабильной, или даже улучшается:

‘Поскольку документы SEO высокого качества и тематически согласованы, извлечение кажется здоровым, когда измеряется только точностью. Однако почти все извлеченные доказательства синтетические, указывая на тяжелый коллапс разнообразия источников.

‘Этот разрыв, характеризующийся стабильной точностью, несмотря на коллапс разнообразия, раскрывает структурно хрупкий конвейер извлечения: система работает хорошо в агрегированных метриках, в то время как тихо теряет свою основу в контенте, написанном людьми.’

‘В целом, высококачественный синтетический контент не только безупречно интегрируется в конвейеры извлечения, но и активно подавляет сигналы ранжирования, заставляя оба ранжировщика BM25 и LLM полагаться почти исключительно на доказательства, сгенерированные ИИ.’

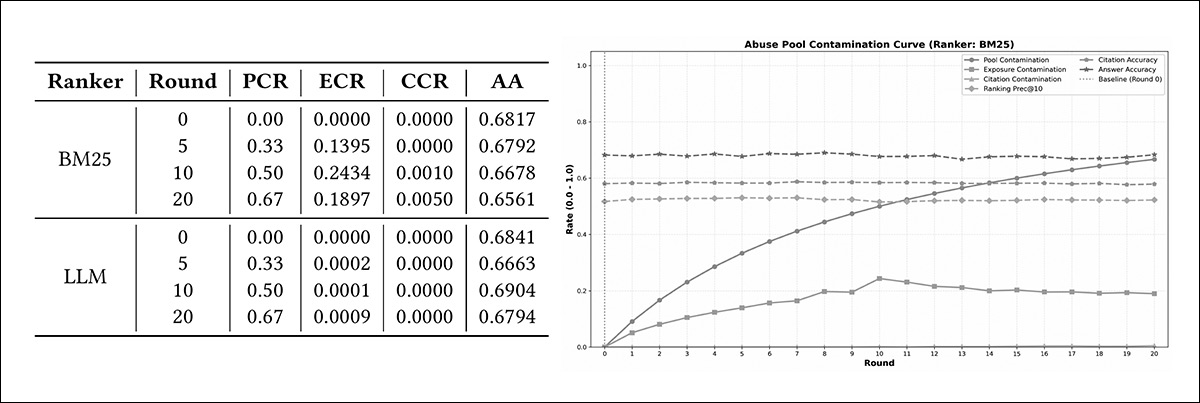

Второй сценарий был назван Загрязнение и коррупция системы, и показал заметное расхождение в поведении ранжировщиков по сравнению с первым сценарием:

Слева, результаты Сценария 2 показывают, что происходит, когда в систему добавляются намеренно вводящие в заблуждение страницы. Когда таких страниц становится больше, BM25 начинает помещать некоторые из них в свои лучшие результаты – хотя только до примерно четверти на середине, и почти ни одна из них не используется в окончательном ответе. Общее качество ответа слегка падает. Справа, таблица представляет тот же шаблон численно для обоих ранжировщиков BM25 и LLM, делая ясным, что BM25 позволяет некоторым вводящим в заблуждение страницам попасть в свои лучшие результаты, тогда как ранжировщик LLM в основном фильтрует их.

Ранжировщик на основе LLM был в основном способен распознать и отфильтровать вводящие в заблуждение страницы, сохраняя долю такого контента в своих лучших результатах близкой к нулю; но BM25 позволил заметной части враждебных страниц войти в свои лучшие десять результатов, с примерно 19% до 24% появляющимися там на определенных этапах теста.

Хотя ранжировщик LLM показал себя более устойчивым в этом эксперименте, авторы отмечают, что системы ранжирования на основе LLM более требовательны к вычислениям, что может сделать их крупномасштабное развертывание нецелесообразным. Хотя BM25 проще и дешевле в эксплуатации, широко используемые системы извлечения, которые используют его, могут, по мнению статьи, быть более уязвимы для манипулированного контента, чем они изначально кажутся.

Авторы характеризуют это как «значительный структурный риск».

В отношении контраста между видимой стабильностью и основным ухудшением авторы отмечают, что в этом контексте Точность ответа остается относительно стабильной, благодаря тому, что судья LLM подавляет коррупцию цитирования, и поэтому действует как своего рода последний момент огненный вал против враждебного контента.

Однако Точность ответа в этом аспекте была последовательно ниже, чем в первом сценарии:

‘Хотя Сценарий 1 увидел Точность ответа, сохраненную или даже улучшенную (до 70% с ранжировщиками LLM) благодаря высокому качеству контента SEO, Сценарий 2 показывает снижение качества ответа по сравнению с настройкой SEO […]

‘Это подтверждает, что, независимо от ранжировщика, враждебное загрязнение на этапе извлечения негативно влияет на конечную производительность, с ухудшением, которое является наиболее тяжелым, когда полагаются на легкие извлекатели.’

Авторы заключают, что повторное ранжирование на этапе извлечения является слишком поздним подходом, и что фильтры на этапе «поглощения» должны быть рассмотрены, предлагая, что «графы происхождения» и «фильтры перплексии» могли бы быть использованы.

Они заканчивают, подчеркивая, что основная угроза заключается в контенте с высокой плавностью, но низкой плотностью атрибуции, по сути, оторванном от завершающих цепей происхождения, и наблюдают:

‘[Когда] агентные ИИ начинают автономно публиковать контент, механизмы защиты должны эволюционировать от статического анализа текста к поведенческому фингерпринтингу, выявляя и изолируя агентов, которые систематически производят высокоэнтропийные, низко-фактичные потоки.’

Заключение

Установление новых или улучшенных методов информирования о происхождении может быть одной из наиболее критических необходимостей для 2026 года. Сложные схемы учетных данных, такие как проблемный C2PA, которые требуют инфраструктурных изменений от издателей, и общественное образование о том, что они означают и как или почему использовать их, кажется, обречены на провал.

Что-то более простое требуется, и оно еще не найдено. Это срочная миссия, поскольку эта текущая эпоха может быть наиболее критической точкой для общественного консенсуса о правде с момента изобретения фотографии в 1822 году и роста пропаганды в десятилетиях, предшествующих Второй мировой войне.

* Мое (выбранное, где необходимо) преобразование внутренних цитат авторов в гиперссылки.

Опубликовано впервые в четверг, 19 февраля 2026