Угол Андерсона

Исследования показывают, что ChatGPT пользуется высоким доверием как поставщик новостей

Новые исследования показывают, что метки проверки фактов ChatGPT превосходят лайки, репосты и даже авторитетные новостные бренды, когда дело доходит до формирования того, во что люди верят и чем хотят поделиться в сети.

Новое исследование, в котором приняли участие 1,000 человек, показало, что оценка достоверности политических новостей, которую ChatGPT присваивает политическим новостям, часто влияет на их убеждения и желание делиться ими, независимо от их первоначальных политических взглядов. Более традиционные факторы влияния, такие как лайки или репосты, не оказали существенного влияния, но оценка ИИ существенно повлияла на достоверность новостей:

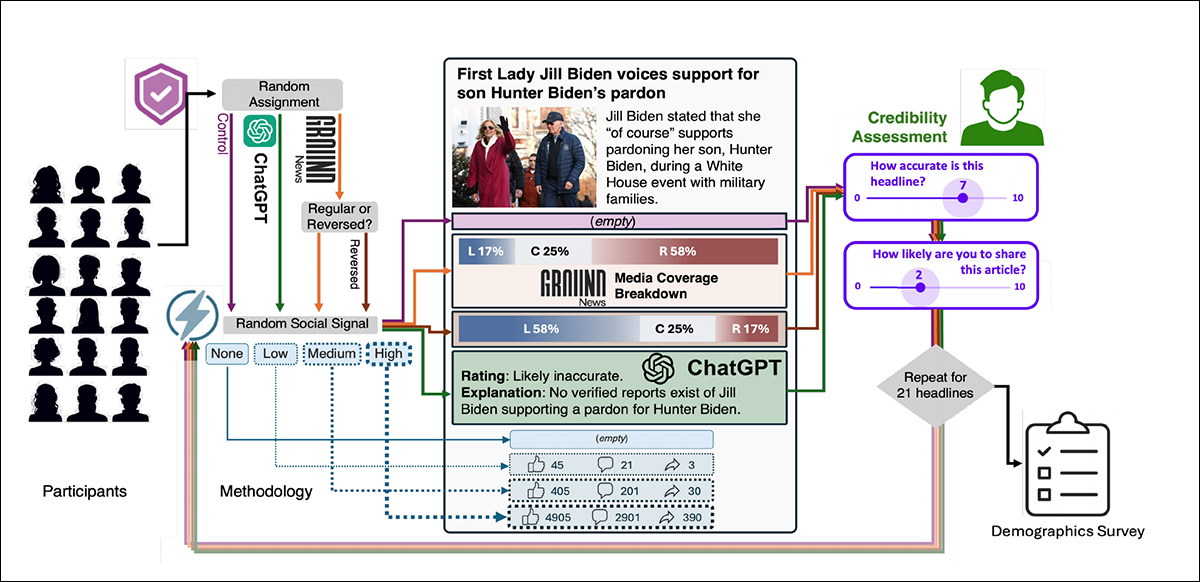

![В новой статье представлена иллюстрация того, как люди оценивают новостной заголовок, основываясь на трёх взаимодействующих факторах: соответствует ли новость их политической идентичности; насколько она, по всей видимости, популярна в социальных сетях; и на сигналах о достоверности, подаваемых институтами или системами искусственного интеллекта. Сочетание этих факторов определяет как воспринимаемую точность, так и вероятность распространения контента. [ Источник ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

В новой статье представлена иллюстрация того, как люди оценивают новостной заголовок, основываясь на трёх взаимодействующих факторах: соответствует ли новость их политической идентичности; насколько она, по всей видимости, популярна в социальных сетях; и на сигналах о достоверности, подаваемых институтами или системами искусственного интеллекта. Сочетание этих факторов определяет как воспринимаемую точность, так и вероятность распространения контента. Источник

Степень, в которой сводки ИИ принимаются в качестве достоверных источников новостей, является, пожалуй, одной из самых важных тем в СМИ на протяжении многих лет, не в последнюю очередь потому, что сводки ИИ от Google откачал трафик из большинства крупных интернет-СМИ в 2025 году, без какой-либо определенности относительно того, к чему приведет эта передача власти в долгосрочной или даже среднесрочной перспективе.

Авторы новой работы заявляют:

"Эти результаты подчеркивают как потенциал, так и риск алгоритмической обратной связи в формировании общественного мнения. Сигналы, генерируемые ИИ, могут помочь снизить предвзятость и улучшить распознавание достоверности информации, но их влияние различается в зависимости от политической идентичности и несет этические риски, связанные с чрезмерной зависимостью […]

«…Чрезмерное влияние ChatGPT подчеркивает критически важный компромисс: хотя обратная связь ИИ и убедительна, она может вытеснить критическое мышление, если ее не сформулировать должным образом».

Авторы предлагают сосредоточить будущие исследования на улучшении мер по повышению доверия к ИИ, которые будут более независимыми и будут опираться на известные факты. Они отмечают, что это особенно важно в темах, вызывающих поляризацию.

Помимо очевидного преобладания ChatGPT как «авторитета» и неожиданно низкого влияния сигналов обмена в тестах (что, по мнению авторов, может быть связано с несколько стерильными условиями тестирования), еще один интересный результат тестов исследователей касается демографических данных и пола:

«Женщины и участники из числа расовых меньшинств (особенно чернокожие и латиноамериканские пользователи) более позитивно отреагировали на обратную связь на основе ИИ, чем на институциональные ярлыки».

новая работа называется AСигналы доверия превосходят институты и вовлеченность в формировании восприятия новостей в социальных сетяхи исходит от трех исследователей из Университета Нотр-Дам.

Давайте подробнее рассмотрим методы и выводы статьи.

Способ доставки

Были проверены четыре гипотезы: люди будут оценивать заголовки как более точные, если эти заголовки отражают их политические взгляды; что оценки достоверности, полученные с помощью ИИ, будут иметь большее влияние, чем сигналы от существующих институтов; что заголовки с высокой степенью вовлеченности (т.е. измеренной с помощью лайков, репостов или комментариев) будут считаться более заслуживающими доверия; и что пользователи будут склонны принимать суждение ИИ о точности заголовка. даже когда это противоречило их собственным убеждениям.

Участники исследования были набраны из плодовитый платформы, и должны были свободно владеть английским языком, а также быть постоянными потребителями новостей; а процесс рандомизации гарантировал, что участники представляли разнообразные расовые и гендерные точки зрения.

В ходе эксперимента* участники были разделены на четыре группы, каждой из которых наряду с новостными заголовками показывали разный тип обратной связи.

В первой группе ( контроль (условие) не было предоставлено никакой дополнительной информации о том, насколько достоверным может быть заголовок; во второй группе заголовки были помечены с помощью оценки предвзятости от GroundNews, сервис, который классифицирует источники новостей как левые, центристские или правые.

Третья группа увидела те же метки GroundNews, но намеренно перевернул, создавая несоответствие, призванное проверить, обнаружат ли пользователи искажение.

Последней группе были показаны оценки достоверности, составленные ChatGPT, с кратким пояснением и рейтингом, например «вероятно, неточное»:

Концептуальная схема эксперимента: каждому участнику показывали политические заголовки с различными сочетаниями меток достоверности и сигналов социальной вовлечённости. Собирались ответы о том, насколько точным казался каждый заголовок и насколько вероятно, что он будет опубликован. Полная последовательность повторялась в 21 задании.

Данные и тесты

Каждому участнику показывали последовательность из 21 заголовка политических новостей. Уровень социальной вовлечённости каждого заголовка варьировался: иногда не было ни лайков, ни репостов, иногда много. Эти сигналы вовлечённости были рандомизированы, чтобы избежать фиксированных закономерностей.

Заголовки сами по себе представляли собой смесь политических точек зрения и были помечены как левые, правый уклон или центрист.

После каждого заголовка участников спрашивали, как точный Они думали, что это так, и хотели бы они поделиться этим. Поскольку каждый участник уже обозначил свою политическую принадлежность, стало возможным проанализировать, были ли заголовки с одинаковым политическим спектром оценены более благосклонно.

Участники оценивали каждый заголовок дважды: один раз — насколько точным он казался, и один раз — насколько вероятно, что они поделятся им, при этом их ответы оценивались по шкале от 0 до 10.

Затем исследователи объединили эти ответы с дополнительными данными: демографической информацией и информацией об использовании СМИ каждым участником; политическими тегами для каждого заголовка; типом показанного сигнала достоверности; и уровнем присвоенной социальной вовлеченности.

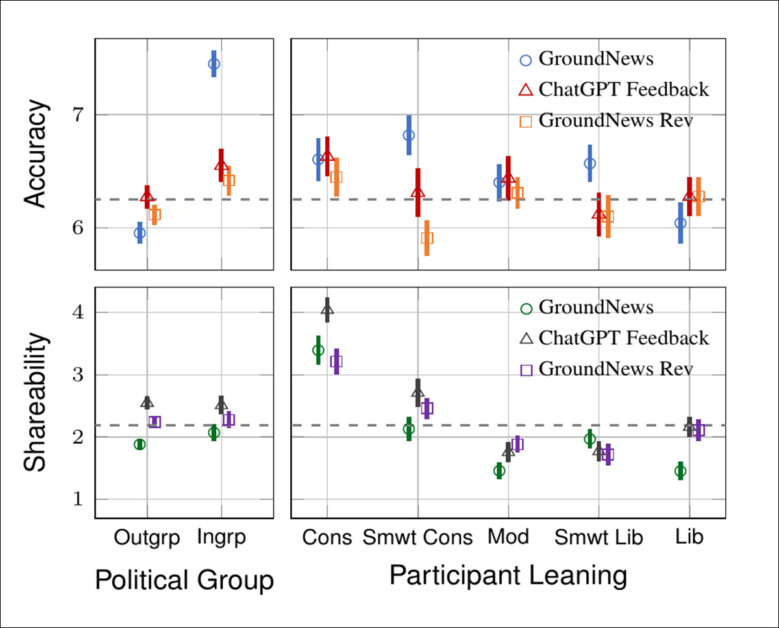

Влияние политической идентичности

В первом тесте, в котором проверялось, считают ли люди заголовки более точными, если их политическая позиция совпадает с их собственными взглядами, результаты показали, что участники были более склонны верить заголовкам, которые соответствуют их политическим взглядам, — но это зависело от группы.

Умеренные продемонстрировали наибольшую предвзятость в отношении своей собственной стороны, в то время как либералы и консерваторы были склонны больше доверять заголовкам центристского толка; и в целом нейтральные заголовки были оценены как более точные, чем заголовки левого или правого уклона.

Иллюстрация того, как менялись оценки точности и расшариваемости в зависимости от политической позиции заголовка и политической принадлежности участника. Умеренные чаще оценивали заголовки, относящиеся к «внутригрупповой» группе, как точные, в то время как либералы и консерваторы предпочитали заголовки, ориентированные на центр. Распространение информации происходило аналогично, с ограниченной предвзятостью в отношении внутригрупповой принадлежности за пределами умеренной группы.

В результате этого первого эксперимента было обнаружено умеренное влияние внутригрупповой принадлежности на способность делиться информацией, но только среди умеренных, которые были более склонны делиться политически ориентированными (то есть нейтральными) заголовками. Либералы и консерваторы не продемонстрировали подобной тенденции.

Анализ дисперсии (ANOVA), метод, используемый для выявления различий между группами, показал, что выравнивание влияет на обмен информацией только тогда, когда оно взаимодействует с политической идентичностью. Доверие и обмен информацией были связаны, но только умеренные группы продемонстрировали чёткую закономерность в обоих случаях.

Институциональная и ИИ-достоверность

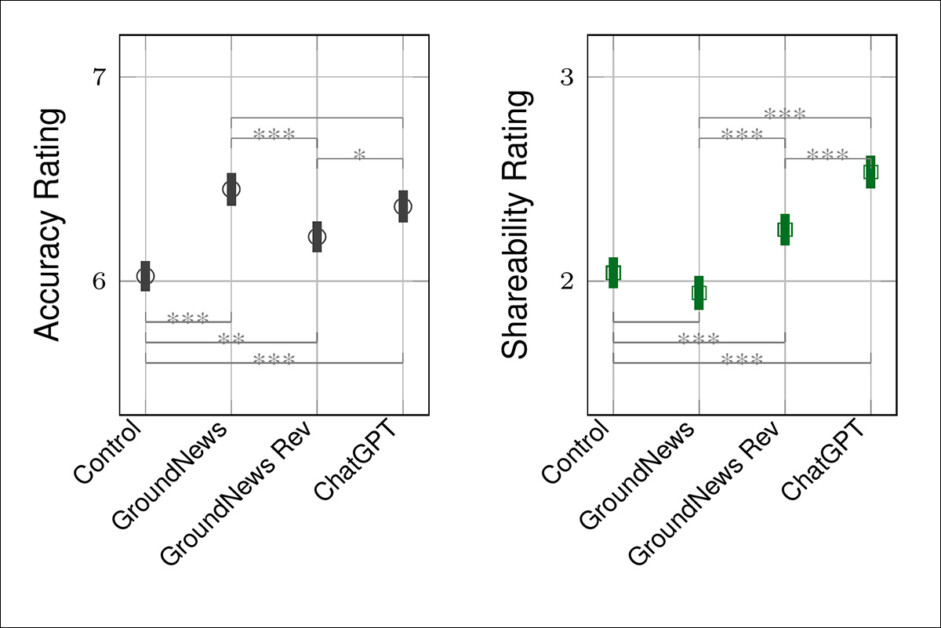

В следующем тесте спрашивалось, доверяют ли люди рейтингам ИИ больше, чем традиционным источникам, таким как новостные сайты с рейтингами, — особенно когда рейтинги могут не совпадать с их политическими взглядами:

Рейтинги достоверности и распространённости по различным источникам обратной связи: все три сигнала повысили точность по сравнению с контрольной группой, причём GroundNews получил наивысшие оценки. Однако ChatGPT продемонстрировал наибольший рост распространённости, что свидетельствует о его более широком убедительном воздействии. Погрешности соответствуют 95% доверительным интервалам, а звёздочки обозначают значимые парные различия.

Все отзывы повышали воспринимаемую точность, но GroundNews был наиболее эффективен, когда соответствовал политическим взглядам пользователя.

ChatGPT повысил рейтинг точности по всем направлениям, что свидетельствует о его более нейтральном восприятии. Консерваторы были менее подвержены влиянию GroundNews, но отреагировали на ChatGPT так же, как и другие группы:

Здесь мы видим влияние обратной связи ChatGPT на воспринимаемую точность. Результаты показывают, что доверие к институциональным сигналам зависит от согласованности, в то время как доверие к алгоритмическим сигналам — нет. ChatGPT повысил как авторитетность, так и количество обменов информацией между группами, особенно среди консерваторов.

Социальные показатели мало влияют

Третий анализ проверял, могут ли видимые сигналы социальной вовлеченности, такие как лайки, репосты и комментарии, повысить доверие или возможность распространения, выступая в качестве социального доказательства; однако такого эффекта не наблюдалось.

Тесты показали, что уровни вовлеченности, такие как количество лайков или репостов, не оказывают реального влияния на то, насколько точными кажутся заголовки, и оказывают лишь слабое, ненадежное влияние на то, насколько ими хочется делиться. считают; в отличие от алгоритмических или институциональных сигналов, эти социальные сигналы, по-видимому, не влияют на суждения в этой ситуации по причинам, упомянутым ранее в статье.

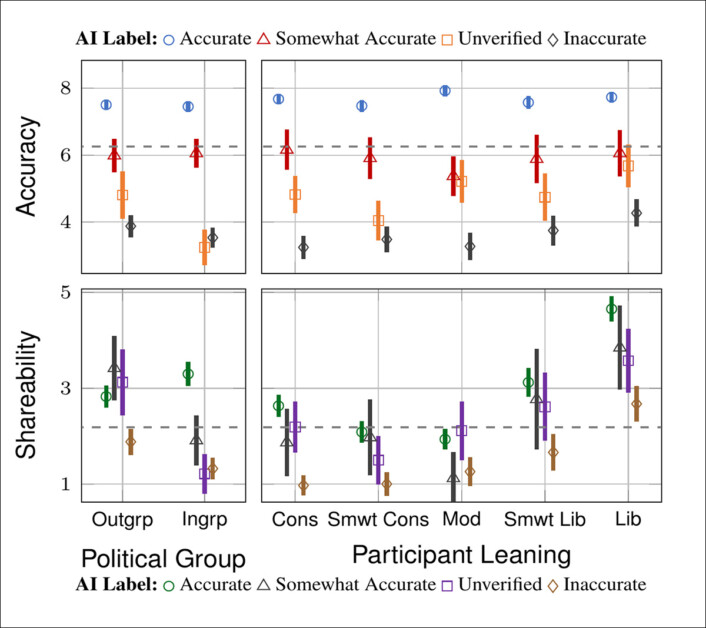

Обратная связь от ИИ влияет на доверие людей

Четвертый и последний эксперимент проверял, будут ли пользователи корректировать свои суждения о достоверности информации и обмене ею в ответ на метки, сгенерированные ИИ: точный; несколько точный; непроверенный; или неточный, все назначены ChatGPT.

Участники активно реагировали на метки достоверности, сгенерированные ИИ. Рейтинги точности росли или падали в соответствии с отзывами ChatGPT, причём наибольший эффект наблюдался при маркировке заголовков. точный or неточный:

Отзывы ChatGPT повлияли как на точность, так и на рейтинг популярности. Вверху: показатели популярности росли с увеличением количества положительных меток, особенно когда заголовки были помечены как «Точные», и падали при пометке «Неточные». Внизу: рейтинг популярности следовал аналогичной тенденции, но демонстрировал более выраженные различия по группам: либералы сильнее реагировали на негативные сигналы, в то время как консерваторы демонстрировали более сдержанные изменения.

Политическая идентичность формировала эти эффекты: пользователи доверяли ChatGPT больше, когда его отзывы совпадали с их собственными взглядами.

Распространение информации происходило по схожей схеме: чаще всего публиковались заголовки внутригрупповых сообщений, отмеченные как точные, особенно под двусмысленными метками, такими как несколько точный.

В статье утверждается, что полученные результаты свидетельствуют о том, что обратная связь от ИИ может изменить поведение пользователей, но при этом существует риск усиления партийных разногласий или подавления критического мышления.

Кто больше всего доверяет ИИ?

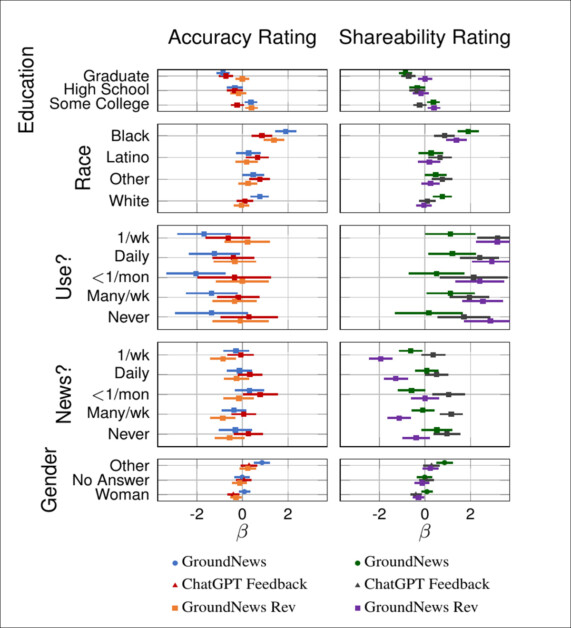

Последующий анализ показал, как демографические характеристики пользователей влияют на реакцию на критерии достоверности. Отзывы ChatGPT повысили общий рейтинг точности, но эффект был слабее среди высокообразованных пользователей и тех, кто часто пользуется социальными сетями и проявлял больший скептицизм.

Эти же группы негативно отреагировали на сигналы GroundNews и Reversed, что, как утверждается в статье, позволяет предположить, что явные маркеры предвзятости могут оттолкнуть более медиаграмотных пользователей.

Напротив, женщины и представители расовых меньшинств, особенно чернокожие и латиноамериканские пользователи, отреагировали на ChatGPT более позитивно, чем на институциональные сигналы:

Демографические реакции на типы обратной связи: каждая панель показывает, как конкретная группа реагировала на различные сигналы достоверности. Рейтинги ChatGPT оказали самое сильное и стабильное влияние на точность, в то время как влияние на обмен информацией было менее однородным и различалось в зависимости от расы, пола и использования медиа.

Поведение пользователей, делящихся информацией, отражало этот раскол: GroundNews наиболее резко снизило возможность делиться информацией среди пользователей социальных сетей и новостных наркоманов, в то время как эффекты ChatGPT были более неоднозначными, даже увеличивая возможность делиться информацией в некоторых группах, причем обладатели ученых степеней особенно реагировали на ВСЕ типы обратной связи.

Авторы заключают:

Эти результаты имеют прямое отношение к разработке мер по повышению доверия в социотехнических системах. Пользователи всё чаще подвергаются влиянию алгоритмической обратной связи, которая может перекрывать институциональные сигналы и смягчать партийные предубеждения, но также может способствовать чрезмерной зависимости.

«Институциональные сигналы остаются эффективными для некоторых пользователей, но их влияние снижается в политически поляризованной или [низкодоверительной] среде. В то же время, показатели вовлечённости, такие как лайки и репосты, в значительной степени игнорировались, что свидетельствует о снижении убедительной ценности при представлении без социального контекста».

«Чтобы обеспечить справедливую и обоснованную оценку новостей, вмешательства на основе ИИ должны быть прозрачными, пояснительными и направленными на повышение активности пользователей.

«В ходе дальнейших исследований необходимо будет изучить эти механизмы в более экологически обоснованных условиях, оценить альтернативные подходы к оценке достоверности ИИ и разработать адаптивные системы, способствующие критическому взаимодействию среди политически разнообразной аудитории».

Заключение

Учитывая тенденцию всех современных систем генеративного ИИ к галлюцинировать и искажают правду, возможно, вызывает некоторую обеспокоенность то, что принятие лесного пожара (даже если это немного замедляюсь) ChatGPT также представляет собой огромный прыжок веры, который архитектура таких систем не может ни оправдать, ни поддержать.

Одной из проблем, связанных с доверием к представлению новостей искусственным интеллектом, является отсутствие эффективных систем, которые могли бы контекстуализировать источники новостей как «политически ангажированные» или склоняющиеся к тому или иному концу политического спектра.

Даже среди самых авторитетных источников четвертой власти выбор того, что и Что не является Описанное само по себе является политическим заявлением. Ни ChatGPT, ни его коллеги в настоящее время не в состоянии разобраться в этих многообразиях интерпретационных предубеждений, и сама тема скорее предполагает дискуссию, чем обоснованные выводы.

Другая проблема заключается в том, что системы такого рода появились в один из самых поляризованных и разногласных периодов человеческой истории за последние 80 лет, и в то время, когда общество наиболее охотно прислушивается к «альтернативным голосам» — например, к совершенно новому жанру технологий, который рекламируется как важный фильтр мировой правды, а не как то, чем он является на самом деле: предиктор статистических вероятностей, подпитываемый большими объемами партийной информации.

* Подробную информацию авторы разместили в интернете (ссылки см. в исходном документе, внизу страницы P2). Однако для просмотра этих данных требуется регистрация, и, поскольку я не стал развивать этот вопрос на тот момент, я не могу подтвердить, что их можно просмотреть полностью без оплаты и/или определённых учётных данных.

Впервые опубликовано Среда, 5 ноября 2025 г.