Взгляд Anderson

Поиск «Сов и Ящериц» в Аудитории Рекламодателя

Поскольку онлайн-отрасль рекламы, как оценивается, потратила 740,3 миллиарда долларов США в 2023 году, легко понять, почему рекламные компании вкладывают значительные ресурсы в этот конкретный раздел исследований компьютерного зрения.

Хотя отрасль изолирована и защищена, она периодически публикует исследования, которые намекают на более продвинутые проприетарные работы в области распознавания лиц и направления взгляда – включая распознавание возраста, которое является центральным для статистики демографической аналитики:

Оценка возраста в контексте рекламы в дикой природе представляет интерес для рекламодателей, которые могут нацеливаться на конкретную возрастную демографическую группу. В этом экспериментальном примере автоматической оценки возраста лица трекируется возраст исполнителя Боба Дилана на протяжении лет. Источник: https://arxiv.org/pdf/1906.03625

Эти исследования, которые редко появляются в публичных репозиториях, таких как Arxiv, используют легитимно набранных участников в качестве основы для анализа, основанного на ИИ, который направлен на определение степени и способа, которым зритель взаимодействует с рекламой.

Dlib’s Гистограмма направленных градиентов (HoG) часто используется в системах оценки лица. Источник: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Животный Инстинкт

В этом отношении естественно, что рекламная индустрия заинтересована в определении ложных положительных результатов (случаев, когда аналитическая система неправильно интерпретирует действия субъекта) и в установлении четких критериев для того, когда человек, смотрящий их коммерческие ролики, не полностью взаимодействует с контентом.

Что касается рекламы на основе экрана, исследования склонны фокусироваться на двух проблемах в двух средах. Среды – это ‘настольные’ или ‘мобильные’, каждая из которых имеет особые характеристики, которые требуют индивидуальных решений для отслеживания; и проблемы – с точки зрения рекламодателя – представлены поведением сов и ящериц – тенденцией зрителей не обращать полное внимание на рекламу, которая находится перед ними.

Примеры поведения ‘Сов’ и ‘Ящериц’ в субъекте проекта рекламных исследований. Источник: https://arxiv.org/pdf/1508.04028

Если вы смотрите в сторону от намеченной рекламы всей головой, это ‘поведение совы’; если ваша поза головы статична, но ваши глаза блуждают от экрана, это ‘поведение ящерицы’. В плане аналитики и тестирования новых рекламных роликов в контролируемых условиях эти действия являются важными для системы, чтобы их можно было захватить.

Новая работа от SmartEye’s Affectiva acquisition решает эти проблемы, предлагая архитектуру, которая использует несколько существующих фреймворков, чтобы обеспечить объединенный и сконкатенированный набор функций во всех необходимых условиях и возможных реакциях – и чтобы можно было определить, является ли зритель скучным, вовлеченным или в каком-то смысле удаленным от контента, который рекламодатель хочет, чтобы он смотрел.

Примеры истинных и ложных положительных результатов, обнаруженных новой системой внимания для различных сигналов отвлечения, показанных отдельно для настольных и мобильных устройств. Источник: https://arxiv.org/pdf/2504.06237

Авторы заявляют*:

‘Ограниченные исследования углублялись в мониторинг внимания во время онлайн-рекламы. Хотя эти исследования фокусировались на оценке позы головы или направления взгляда, чтобы определить случаи отвлечения взгляда, они не учитывают важные параметры, такие как тип устройства (настольный или мобильный), размещение камеры относительно экрана и размер экрана. Эти факторы существенно влияют на обнаружение внимания.

‘В этой работе мы предлагаем архитектуру для обнаружения внимания, которая охватывает обнаружение различных отвлекающих факторов, включая поведение сов и ящериц взгляда за пределами экрана, говорение, сонливость (через зевание и длительное закрытие глаз) и оставление экрана без внимания.

‘В отличие от предыдущих подходов, наш метод интегрирует устройство-специфические функции, такие как тип устройства, размещение камеры, размер экрана (для настольных компьютеров) и ориентация камеры (для мобильных устройств), с сырыми оценками взгляда, чтобы повысить точность обнаружения внимания.’

Новая работа названа Мониторинг Внимания Зрителя Во Время Онлайн-Рекламы, и исходит от четырех исследователей из Affectiva.

Метод и Данные

В основном из-за секретности и закрытой природы таких систем, новая работа не сравнивает подход авторов напрямую с конкурентами, а rather представляет свои результаты исключительно как абляционные исследования; ни работа не придерживается общего формата литературы компьютерного зрения. Поэтому мы рассмотрим исследование, как оно представлено.

Авторы подчеркивают, что только ограниченное количество исследований обратились к обнаружению внимания конкретно в контексте онлайн-рекламы. В AFFDEX SDK, который предлагает реальное распознавание нескольких лиц, внимание выводится исключительно из позы головы, с участниками, помеченными как невнимательные, если их угол головы превышает определенный порог.

Пример из AFFDEX SDK, системы Affectiva, которая полагается на позу головы как индикатор внимания. Источник: https://www.youtube.com/watch?v=c2CWb5jHmbY

В 2019 году Автоматическое Измерение Визуального Внимания к Видео-Контенту с Помощью Глубокого Обучения, набор данных из примерно 28 000 участников был аннотирован для различных невнимательных поведений, включая взгляд в сторону, закрытие глаз, или участие в несвязанных действиях, и модель CNN-LSTM была обучена для обнаружения внимания из внешности лица во времени.

Из работы 2019 года, пример, иллюстрирующий предсказанные состояния внимания для зрителя, смотрящего видео-контент. Источник: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Однако авторы наблюдают, что эти ранние усилия не учитывали устройство-специфические факторы, такие как то, что участник использовал настольный или мобильный устройство; ни они не учитывали размер экрана или размещение камеры. Кроме того, система AFFDEX фокусируется только на выявлении отвлечения взгляда и опускает другие источники отвлечения, в то время как работа 2019 года пытается обнаружить более широкий набор поведений – но ее использование единственной мелкой CNN может, как заявляет работа, быть недостаточным для этой задачи.

Авторы наблюдают, что некоторые из наиболее популярных исследований в этой области не оптимизированы для тестирования рекламы, которое имеет разные потребности по сравнению с доменами, такими как вождение или образование – где размещение и калибровка камеры обычно фиксируются заранее, полагаясь вместо этого на некалиброванные настройки и работающие в ограниченном диапазоне взгляда настольных и мобильных устройств.

Следовательно они разработали архитектуру для обнаружения внимания зрителя во время онлайн-рекламы, используя два коммерческих набора инструментов: AFFDEX 2.0 и SmartEye SDK.

Примеры анализа лица из AFFDEX 2.0. Источник: https://arxiv.org/pdf/2202.12059

Эти предыдущие работы извлекают низкоуровневые функции, такие как выражения лица, поза головы и направление взгляда. Эти функции затем обрабатываются для производства высокоуровневых индикаторов, включая положение взгляда на экране; зевание; и говорение.

Система выявляет четыре типа отвлечения: взгляд за пределами экрана; сонливость,; говорение; и необслуживаемые экраны. Она также корректирует анализ взгляда в зависимости от того, находится ли зритель на настольном или мобильном устройстве.

Наборы Данных: Взгляд

Авторы использовали четыре набора данных, чтобы обеспечить и оценить систему обнаружения внимания: три, фокусирующихся индивидуально на поведении взгляда, говорении и зевании; и четвертый, полученный из реальных сессий тестирования рекламы, содержащих смесь типов отвлечения.

Из-за конкретных требований работы были созданы индивидуальные наборы данных для каждой из этих категорий. Все наборы данных, собранные, были получены из проприетарного репозитория, в котором хранятся миллионы записанных сессий участников, смотрящих рекламу в домашних или рабочих условиях, с помощью веб-настройки, с информированным согласием – и из-за ограничений этих соглашений об согласии, авторы заявляют, что наборы данных для новой работы не могут быть сделаны публично доступными.

Чтобы построить набор данных взгляда, участникам было предложено следовать за движущейся точкой по разным точкам на экране, включая его края, и затем посмотреть в сторону от экрана в четырех направлениях (вверх, вниз, влево и вправо) с последовательностью, повторенной три раза. Таким образом, была установлена связь между захватом и покрытием:

Скриншоты, показывающие стимул видео взгляда на (а) настольных и (б) мобильных устройствах. Первый и третий кадры отображают инструкции следовать за движущейся точкой, в то время как второй и четвертый подсказывают участникам посмотреть в сторону от экрана.

Сегменты с движущейся точкой были помечены как внимательные, и сегменты за пределами экрана были помечены как невнимательные, в результате чего получился помеченный набор данных как положительных, так и отрицательных примеров.

Каждое видео длилось примерно 160 секунд, с отдельными версиями, созданными для настольных и мобильных платформ, каждая с разрешением 1920×1080 и 608×1080 соответственно.

Всего было собрано 609 видео, из которых 322 были записаны на настольных компьютерах и 287 на мобильных устройствах. Метки были применены автоматически на основе содержания видео, и набор данных разделен на 158 образцов для обучения и 451 для тестирования.

Наборы Данных: Говорение

В этом контексте один из критериев, определяющих ‘невнимательность’, – это когда человек говорит более одной секунды (что может быть моментальным комментарием или даже кашлем).

Поскольку контролируемая среда не записывает и не анализирует аудио, говорение выводится, наблюдая за внутренним движением оцененных ориентиров лица. Следовательно, чтобы обнаружить говорение без аудио, авторы создали набор данных, основанный исключительно на визуальном вводе, полученный из их внутреннего репозитория, и разделенный на две части: первая содержала примерно 5 500 видео, каждое из которых было вручную помечено тремя аннотаторами как говорение или нет (из них 4 400 были использованы для обучения и проверки, и 1 100 для тестирования).

Вторая часть состояла из 16 000 сессий, автоматически помеченных на основе типа сессии: 10 500 содержали участников, смотрящих рекламу молча, и 5 500 показывали участников, выражающих мнения о брендах.

Наборы Данных: Зевание

Хотя существуют некоторые наборы данных зевания, включая YawDD и Driver Fatigue, авторы утверждают, что ни один из них не подходит для сценариев тестирования рекламы, поскольку они либо содержат симулированное зевание, либо содержат конторсии лица, которые можно спутать с страхом или другими, не связанными с зеванием действиями.

Следовательно авторы использовали 735 видео из своего внутреннего собрания, выбрав сессии, которые, вероятно, содержат опускание челюсти более одной секунды. Каждое видео было вручную помечено тремя аннотаторами как активное или неактивное зевание. Только 2,6 процента кадров содержали активное зевание, подчеркивая несбалансированность классов, и набор данных был разделен на 670 видео для обучения и 65 для тестирования.

Наборы Данных: Отвлечение

Набор данных отвлечения также был получен из репозитория авторов, где участники смотрели фактическую рекламу без заданных задач. Всего 520 сессий (193 на мобильных и 327 на настольных устройствах) были случайно выбраны и вручную помечены тремя аннотаторами как внимательные или невнимательные.

Невнимательное поведение включало взгляд за пределами экрана, говорение, сонливость и необслуживаемые экраны. Сессии охватывали разные регионы по всему миру, с записями на настольных компьютерах более распространенными из-за гибкого размещения веб-камеры.

Модели Внимания

Предлагаемая модель внимания обрабатывает низкоуровневые визуальные функции, а именно выражения лица; позу головы; и направление взгляда – извлеченные через упомянутые выше AFFDEX 2.0 и SmartEye SDK.

Эти функции затем преобразуются в высокоуровневые индикаторы, с каждым отвлекающим фактором, обрабатываемым отдельным бинарным классификатором, обученным на своем собственном наборе данных для независимой оптимизации и оценки.

Схема предлагаемой системы мониторинга.

Модель взгляда определяет, смотрит ли зритель на экран или нет, используя нормализованные оценки взгляда, с отдельной калибровкой для настольных и мобильных устройств. Помогая этому процессу, линейная машина опорных векторов (SVM), обученная на пространственных и временных функциях, которая включает в себя окно памяти, чтобы сгладить быстрые сдвиги взгляда.

Чтобы обнаружить говорение без аудио, система использовала обрезанные области рта и 3D-CNN, обученную на конверсационных и неконверсационных видео-сегментах. Метки были присвоены на основе типа сессии, с временным сглаживанием, уменьшающим ложные положительные результаты, которые могут возникнуть из-за кратковременных движений рта.

Зевание было обнаружено, используя полные кадры лица, чтобы захватить более широкое движение лица, с 3D-CNN, обученной на вручную помеченных кадрах (хотя задача была осложнена низкой частотой зевания в естественном просмотре и его сходством с другими выражениями).

Необслуживаемый экран был выявлен через отсутствие лица или крайнюю позу головы, с прогнозами, сделанными деревом решений.

Окончательный статус внимания был определен, используя фиксированное правило: если любой модуль обнаружил невнимательность, зритель был помечен невнимательным – подход, отдающий приоритет чувствительности, и настроенный отдельно для настольных и мобильных контекстов.

Тесты

Как упоминалось ранее, тесты следуют абляционному методу, где компоненты удаляются, и влияние на результат отмечается.

Различные категории воспринимаемой невнимательности, выявленные в исследовании.

Модель взгляда выявляла поведение за пределами экрана через три ключевых шага: нормализацию сырых оценок взгляда, тонкую настройку вывода и оценку размера экрана для настольных устройств.

Чтобы понять важность каждого компонента, авторы удалили их индивидуально и оценили производительность на 226 настольных и 225 мобильных видео, полученных из двух наборов данных. Результаты, измеренные G-mean и F1 баллами, показаны ниже:

Результаты, указывающие на производительность полной модели взгляда, а также версий с удаленными индивидуальными шагами обработки.

В каждом случае производительность снижалась, когда шаг был опущен. Нормализация оказалась особенно ценной на настольных компьютерах, где размещение камеры варьируется больше, чем на мобильных устройствах.

Исследование также оценило, как визуальные функции предсказывали ориентацию мобильной камеры: местоположение лица, поза головы и направление взгляда набрали 0,75, 0,74 и 0,60, в то время как их комбинация достигла 0,91, подчеркивая – как заявляют авторы – преимущество интеграции нескольких сигналов.

Модель говорения достигла ROC-AUC 0,97 на вручную помеченном тестовом наборе и 0,96 на более крупном автоматически помеченном наборе данных, указывая на последовательную производительность в обоих.

Модель зевания достигла ROC-AUC 96,6 процента, используя только соотношение сторон рта, что улучшилось до 97,5 процента при комбинации с предсказаниями единиц действия из AFFDEX 2.0.

Модель необслуживаемого экрана классифицировала моменты как невнимательные, когда и AFFDEX 2.0, и SmartEye не смогли обнаружить лицо более одной секунды. Чтобы оценить действительность этого, авторы вручную аннотировали все такие события без лица в реальном наборе данных отвлечения, определяя основную причину каждого срабатывания. Неоднозначные случаи (такие как заслонение камеры или искажение видео) были исключены из анализа.

Как показано в таблице результатов ниже, только 27 процентов срабатываний ‘без лица’ были вызваны пользователями, которые физически покинули экран.

Различные причины, полученные для того, почему лицо не было найдено, в определенных случаях.

Работа заявляет:

‘Несмотря на то, что необслуживаемые экраны составили только 27% случаев, срабатывания сигнала без лица, оно было срабатывало и по другим причинам, указывающим на невнимательность, таким как участники, смотревшие за пределами экрана с крайним углом, совершавшие чрезмерные движения или значительно заслонявшие свое лицо объектом/рукой.’

В последнем из количественных тестов авторы оценили, как постепенное добавление разных сигналов отвлечения – взгляда за пределами экрана (через взгляд и позу головы), сонливости, говорения и необслуживаемых экранов – влияло на общую производительность их модели внимания.

Тестирование было проведено на двух наборах данных: реальном наборе данных отвлечения и тестовом подмножестве набора данных взгляда. G-mean и F1 баллы были использованы для измерения производительности (хотя сонливость и говорение были исключены из анализа набора данных взгляда, из-за их ограниченной актуальности в этом контексте).

Как показано ниже, обнаружение внимания улучшилось последовательно, когда добавлялись более типов отвлечения, с взглядом за пределами экрана, наиболее распространенным отвлекающим фактором, обеспечивая наиболее сильную базовую линию.

Влияние добавления различных сигналов отвлечения на архитектуру.

Из этих результатов работа заявляет:

‘Из результатов мы можем заключить, что интеграция всех сигналов отвлечения способствует улучшению обнаружения внимания.

‘Во-вторых, улучшение обнаружения внимания последовательно наблюдается на обоих настольных и мобильных устройствах. В-третьих, мобильные сессии в реальном наборе данных показывают значительные движения головы при взгляде в сторону, которые легко обнаруживаются, что приводит к более высокой производительности для мобильных устройств по сравнению с настольными компьютерами. В-четвертых, добавление сигнала сонливости имеет относительно небольшое улучшение по сравнению с другими сигналами, поскольку оно обычно редко происходит.

‘Наконец, сигнал необслуживаемого экрана имеет относительно большее улучшение на мобильных устройствах по сравнению с настольными компьютерами, поскольку мобильные устройства могут быть легко оставлены без внимания.’

Авторы также сравнили свою модель с AFFDEX 1.0, предыдущей системой, используемой в тестировании рекламы – и даже текущая модель, основанная на голове, обнаружения взгляда превзошла AFFDEX 1.0 на обоих типах устройств:

‘Это улучшение является результатом включения движений головы в обоих направлениях yaw и pitch, а также нормализации позы головы, чтобы учесть незначительные изменения. Значительные движения головы в реальном мобильном наборе данных вызвали нашу модель головы, которая работает аналогично AFFDEX 1.0.’

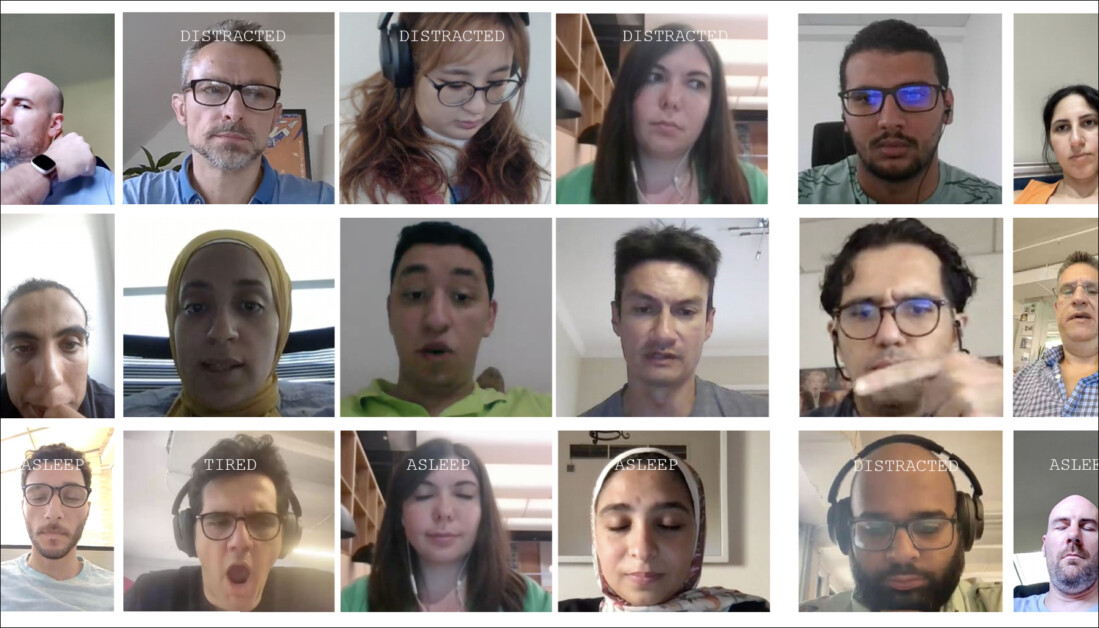

Авторы закрывают работу (возможно, довольно формальным) качественным раундом тестирования, показанным ниже.

Примеры вывода модели внимания на настольных и мобильных устройствах, с каждым рядом, представляющим примеры истинных и ложных положительных результатов для разных типов отвлечения.

Авторы заявляют:

‘Результаты указывают на то, что наша модель эффективно обнаруживает различные отвлекающие факторы в неконтролируемых условиях. Однако она может иногда производить ложные положительные результаты в определенных пограничных случаях, таких как сильное наклон головы при сохранении взгляда на экране, некоторые заслонения рта или чрезмерно размытые глаза или сильно затемненные изображения лица. ‘

Вывод

Хотя результаты представляют собой измеренный, но значимый шаг вперед по сравнению с предыдущими работами, более глубокая ценность исследования заключается в том, что оно предлагает взгляд на постоянную тенденцию к доступу к внутреннему состоянию зрителя. Хотя данные были собраны с согласия, методология указывает на будущие рамки, которые могут распространиться за пределы структурированных, маркетинговых исследований.

Этот несколько параноидальный вывод только укрепляется замкнутой, ограниченной и ревностно охраняемой природой этого конкретного направления исследований.

* Мое преобразование встроенных цитат авторов в гиперссылки.

Опубликовано впервые в среду, 9 апреля 2025 года