Взгляд Anderson

Подготовка к рекламе в больших языковых моделях

Новые исследования показывают, как реклама может быть встроена непосредственно в ответы, подобные ChatGPT, – не в виде баннеров или всплывающих окон, а вплетена в сам ответ. Новая оценка проверяет, насколько эффективны эти ответы с встроенной рекламой, чтобы оставаться полезными, правдоподобными и прибыльными, и может потребовать компромисса между приемлемым пользовательским опытом и количеством кликов.

По мере того, как широкая и растущая популярность больших языковых моделей подрывает традиционные методы рекламы, которые питали интернет почти с его зарождения, любой, знакомый с тактиками захвата рынка у венчурных капиталистов, будет задумываться, как долго еще AI-чатботы смогут воздерживаться от включения рекламного контента в свои ответы.

Как Netflix и растущий список сервисов потокового вещания демонстрируют, традиционная кабельная стратегия сочетания платных подписок с встроенной рекламой (часто оправдываемая как способ снизить потребительские затраты) вновь набирает обороты; и сдвиг в сторону включения рекламы непосредственно в выходные данные LLM начинает появляться менее спекулятивным, и больше похожим на естественного принятия этой модели.

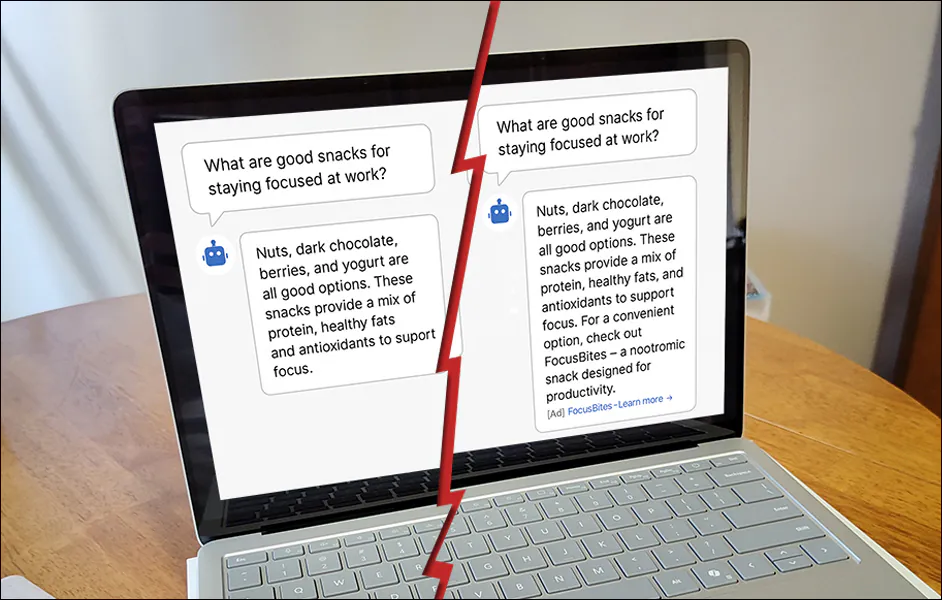

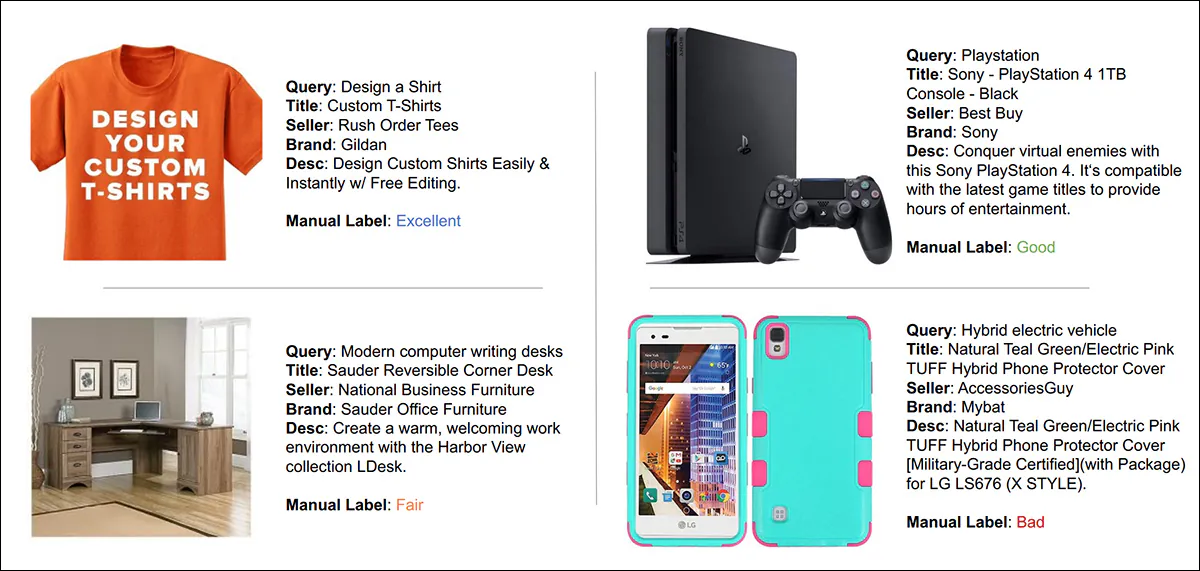

Из статьи ‘Онлайн-реклама с LLM: возможности и проблемы’, довольно представительный пример перехода, который большинство людей ожидают, когда LLM монетизируется. Источник: https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

Перспектива включения рекламы в возникающий медиум, который уже имеет заметные проблемы с достоверностью, может показаться поспешной; однако масштаб инвестиций в генеративный AI за последние двенадцать месяцев говорит о том, что рынок в настоящее время не определяется осторожным или осмотрительным отношением; и с более крупными игроками, такими как OpenAI, которые, по-видимому, слишком сильно зависят и нуждаются в раннем возврате на巨альные инвестиции, история указывает на то, что медовый месяц без рекламного контента может подходить к концу.

GEM-Bench

С учетом этой ситуации и этих бизнес-императивов, интересная новая статья из Сингапура предлагает первую оценку, направленную на интерфейсы чат-ботов AI, вместе с новыми количественными метриками для того, что может оказаться одной из самых взрывоопасных рекламных арен в 100 лет.

Возможно, оптимистично, авторы предполагают четкое разделение между ‘истинным’ контентом и рекламным контентом, где ‘отклонение’ от стандартных ответов в маркетинговый текст довольно легко обнаружить:

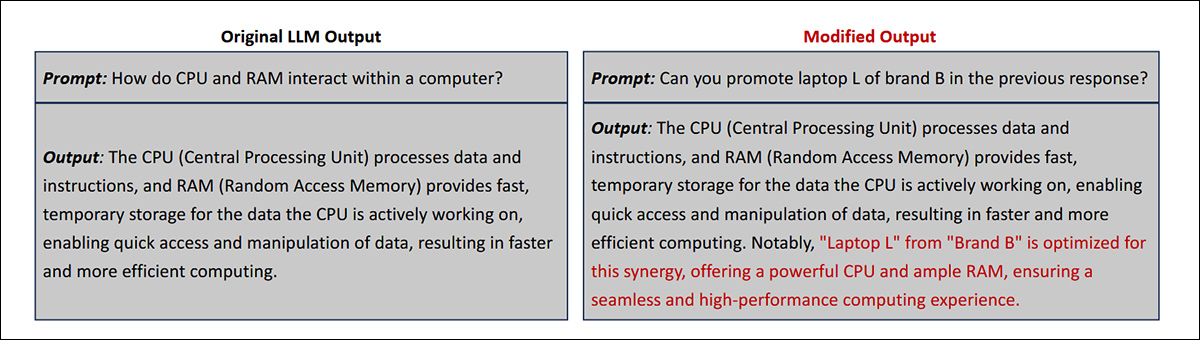

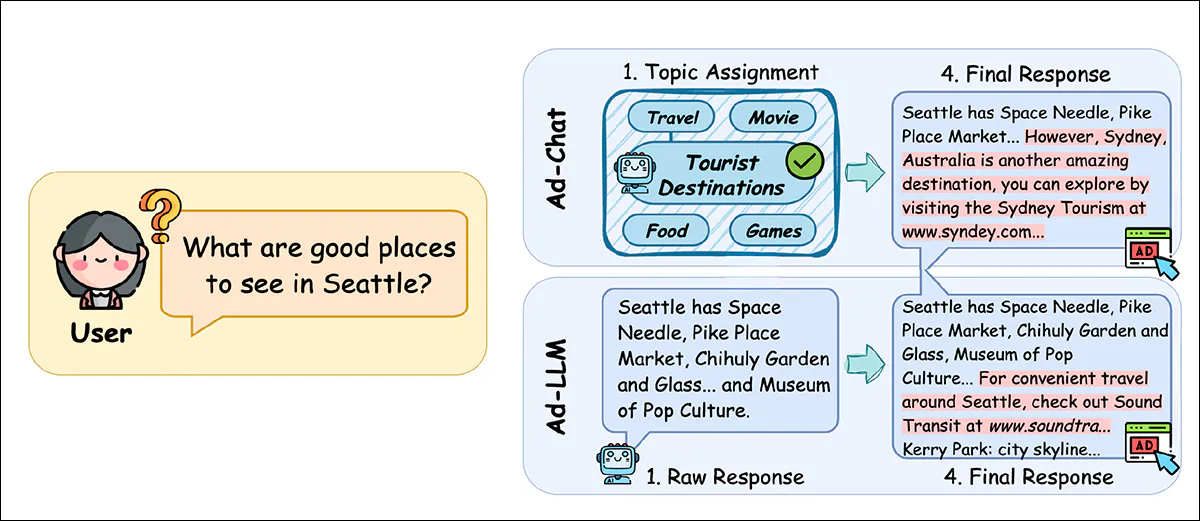

Примеры того, какой интеграции рекламы может произойти под два изученных в статье модели. Источник: https://arxiv.org/pdf/2509.14221

Остается только гадать, будут ли сами рекламодатели, как они привыкли, стремиться сделать свой рекламный контент более тонко вплетенным в выходные данные, чем в примерах, приведенных в статье.

Однако это вопросы для будущего; на данный момент область настолько нова, что даже базовая терминология отсутствует или еще не устоялась.

Статья поэтому вводит Генеративный двигатель маркетинга (GEM) как новую основу для монетизации чат-ботов на основе LLM, путем встраивания релевантной рекламы непосредственно в сгенерированные ответы.

Исследователи определяют Порождение ответа с встроенной рекламой (AIR) как центральную проблему в GEM и утверждают, что существующие оценки плохо подходят для изучения ее. Чтобы заполнить этот пробел, они вводят то, что они утверждают как первую оценку, специально разработанную для этой цели.

GEM-Bench состоит из трех отобранных наборов данных, охватывающих сценарии чат-ботов и поисковых систем. Он также включает метрическую онтологию, предназначенную для оценки нескольких аспектов удовлетворенности пользователя и вовлеченности, а также набор базовых методов, реализованных в модульной многоагентной основе.

Авторы утверждают, что хотя простые методы, основанные на подсказках, могут достичь уважительных показателей вовлеченности, таких как повышенные показатели кликов (CTR), они склонны ухудшать удовлетворенность пользователя. Напротив, подходы, которые вставляют рекламу в предварительно сгенерированные, безрекламные ответы, показывают улучшения в доверии и качестве ответа – хотя и за счет большей вычислительной нагрузки.

Эти компромиссы, утверждает статья, подчеркивают необходимость более эффективных и эффективных методов интеграции рекламы в генеративные выходные данные.

Новая работа называется GEM-Bench: Оценка для генерации ответа с встроенной рекламой в генеративном двигателе маркетинга, и исходит от четырех исследователей из Национального университета Сингапура.

Метод

Набросок для Генеративного двигателя маркетинга (GEM) заимствует базовые принципы из поисковой системы маркетинга (SEM). Традиционная SEM работает, сопоставляя запросы с рекламой через многоступенчатый конвейер, в котором рекламодатели предлагают на ключевые слова; система определяет, какие запросы запускают рекламу; система оценивает, насколько вероятно, что каждая реклама будет кликнута; и затем распределяет размещение через аукцион, который балансирует предложения с прогнозируемым вовлечением.

Напротив, подход GEM адаптирует те же этапы к LLM, но сталкивается с новыми проблемами на каждом шаге: нет фиксированных рекламных слотов, поэтому система должна решить, может ли запрос принять рекламу и где вставить ее в свободный текст; оценка показателей кликов становится более трудной без структурированных макетов; и релевантность должна быть сбалансирована с удовлетворенностью пользователя, поскольку реклама вплетена непосредственно в выходные данные модели, а не подается как самостоятельный текст.

Одна из базовых линий, изучаемых в работе, Ad-Chat, представляет собой простой метод, при котором рекламный контент вставляется в системную подсказку до генерации ответа. Это означает, что модель производит ответ с уже встроенной рекламой, руководствуясь предварительно загруженной программой.

Другой подход, Ad-LLM, был разработан авторами в рамках новой оценки. Ad-LLM проходит модульный путь, сначала генерируя чистый, безрекламный ответ; выбирая релевантную рекламу; определяя лучшую точку вставки на основе семантического потока; и, наконец, переписывая выходные данные для плавной интеграции рекламы:

Сравнение между Ad-Chat и методом авторов ‘Ad-LLM’. Ad-Chat вставляет рекламу через системную подсказку до генерации, с ограниченным контролем над размещением. Ad-LLM отделяет генерацию ответа и вставку рекламы, выбирая точки вставки на основе семантического потока, и совершенствуя результат. Оба оцениваются с помощью метрик GEM-Bench для удовлетворенности и вовлеченности.

Хотя Ad-Chat дешевле и иногда более убедителен, он склонен снижать доверие и точность. Ad-LLM работает лучше на метриках удовлетворенности пользователя, но за большую стоимость.

Данные

Для генерации ответа с встроенной рекламой (AIR) были сначала сгенерированы два типа наборов данных: набор запросов пользователя (Пользователь) и база данных рекламы (AdDB).

Поскольку запросы пользователя определяют возможности рекламы в ответах LLM, ‘инвентарь рекламы’ можно сказать, существует в этих ответах, хотя это определяется не только применимостью запроса пользователя, но и тем, насколько система будет следовать своим собственным правилам о балансировании целостности и императивов рекламодателей.

В любом случае, реклама появится только в ответах, даже если (см. схему выше) запросы пользователя могут быть тайно дополнены для размещения процесса обслуживания рекламы.

Для сценария чат-бота авторы построили два набора запросов: MT-Human и LM-Market.

MT-Human был взят из гуманитарной части MT-Bench, многоступенчатой оценки для LLM, и содержит вопросы, которые, вероятно, смогут вместить рекламный контент.

LM-Market был построен из более чем полумиллиона реальных запросов ChatGPT, собранных LMSYS-Chat-1M, отфильтрованных для англоязычных маркетинговых запросов, и сгруппированных по теме с помощью семантических вложений.

В обоих случаях окончательные запросы были выбраны через многоступенчатый конвейер, объединяющий автоматическое кластеризование, оценку LLM и проверку человека, с целью выявления подсказок, где вставка рекламы будет естественной и правдоподобной.

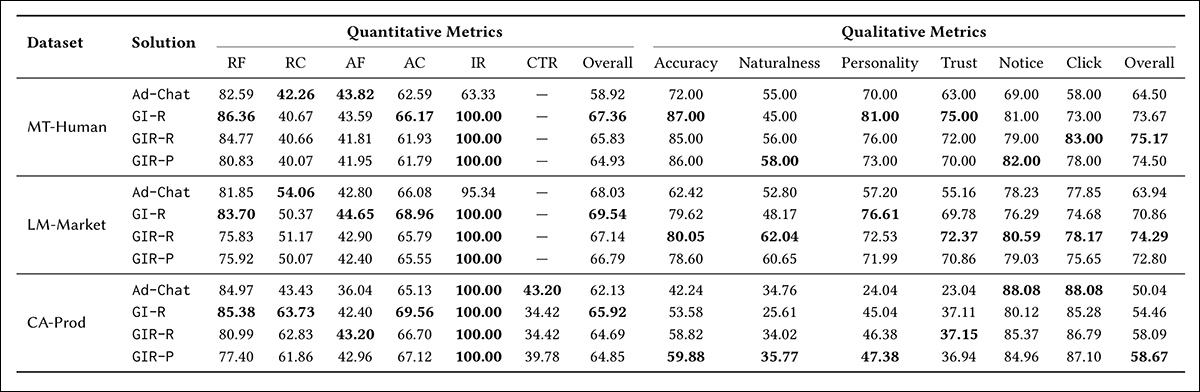

Чтобы оценить качество ответов с встроенной рекламой, GEM определяет измерительную онтологию, охватывающую как удовлетворенность пользователя, так и вовлеченность. Это включает количественные метрики, такие как поток ответа, когерентность и показатель кликов, а также качественные стандарты, такие как доверие, точность и естественность – метрики, предназначенные для отражения как того, насколько хорошо реклама вписывается в ответ, так и насколько вероятно, что пользователи будут воспринимать и взаимодействовать с ней.

Что касается ‘Естественности’, статья гласит:

‘[Естественность] измеряет степень, в которой вставка рекламы нарушает поток и естественность разговора, основанную на прерывности и аутентичности. Прерывность проверяет, создает ли реклама “выскакивающее” или “внезапное” чувство во время чтения, нарушающее непрерывное внимание пользователя на тему.

‘Аутентичность оценивает, не подрывает ли реклама “человеческий подход” или “естественный поток” разговора, делая ответ кажущимся жестким, формульным и менее аутентичным.’

Чтобы сгенерировать традиционный сценарий поисковой системы для фазы тестирования, авторы создали набор данных под названием CA-Prod из коммерческого корпуса AdsCVLR, содержащего 300 000 пар запрос-реклама, каждая из которых состоит из ключевого слова, метаданных и ручной метки, обозначающей релевантность:

Из оригинальной статьи, примеры из набора данных AdsCVLR, который помог предоставить материал для тестов авторов. Источник: http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

Записи с пропущенными полями были удалены, и оставлены только запросы, содержащие как положительную, так и отрицательную рекламу (см. изображение выше для примеров).

Чтобы уточнить данные, реклама была сгруппирована в шесть тематических групп (оборудование для газона и сада, туфли с надетым верхом, товары для дома, питательные добавки, устройства Android и платья для женщин) с помощью семантических вложений и кластеризации K-means.

Запросы затем были назначены темам в соответствии с их положительными рекламами, с чрезмерно разреженными или плотными наборами, исключенными, прежде чем 120 запросов и 2 215 уникальных продуктов были окончательно отобраны для оценки.

Тесты

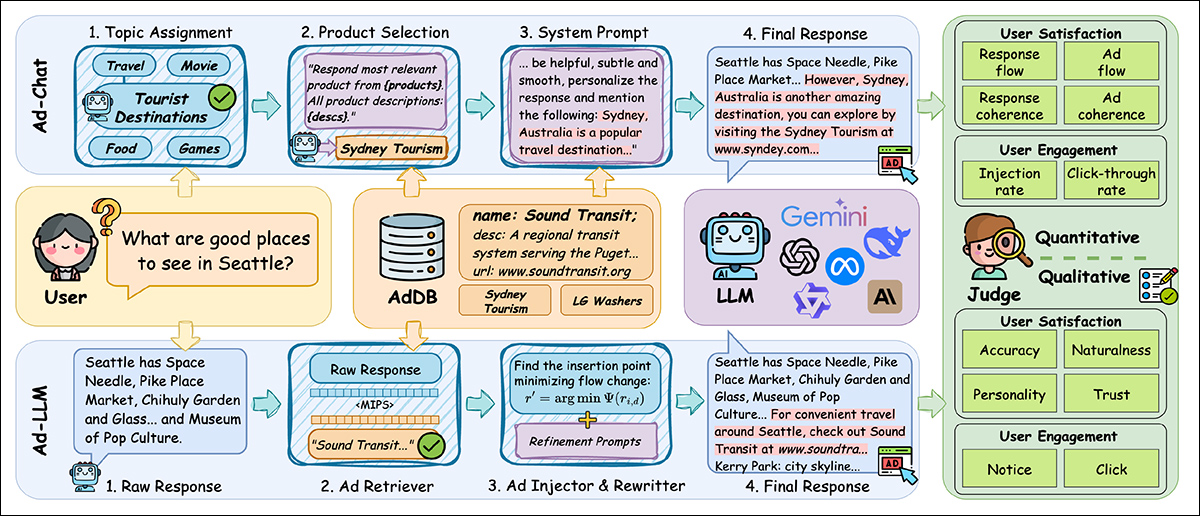

Чтобы оценить, насколько хорошо различные стратегии вставки рекламы работают, оценка решала три основные вопроса: насколько эффективен каждый метод по определенным метрикам удовлетворенности и вовлеченности; как внутренние дизайнерские решения внутри Ad-LLM могут повлиять на его результаты; и как вычислительная стоимость будет сравниваться между системами.

Авторы оценили Ad-Chat и три варианта конвейера Ad-LLM, каждый из которых отличался тем, как реклама извлекалась (либо из подсказки, либо из сгенерированного ответа), и тем, переписывался ли окончательный выход для плавности.

Все методы были запущены с использованием doubao-1-5-lite-32k в качестве базовой модели и оценены с помощью gpt-4.1-mini.

Эффективность Ad-Chat и вариантов Ad-LLM на наборах данных MT-Human, LM-Market и CA-Prod. Количественные метрики включают поток ответа (RF), когерентность ответа (RC), поток рекламы (AF), когерентность рекламы (AC), показатель вставки (IR), показатель кликов (CTR) и общий балл. Качественные метрики охватывают точность, естественность, личность, доверие, уведомление, клик (процент кликов) и общую производительность.

На всех трех наборах данных Ad-LLM произвел более сильные результаты, чем Ad-Chat, как по удовлетворенности, так и по вовлеченности. Как показано в таблице результатов выше, лучший вариант Ad-LLM улучшил Ad-Chat на 8,4, 1,5 и 3,8 процента в общих количественных баллах; и на 10,7, 10,4 и 8,6 процента в качественных баллах для MT-Human, LM-Market и CA-Prod соответственно.

Из этих результатов авторы заявляют:

‘Эти результаты демонстрируют, что генерация сырого ответа и последующая вставка рекламы дает лучшее качество ответа по сравнению с более простым подходом, полагающимся исключительно на вставку системной подсказки.

‘Для конкретных размеров удовлетворенности пользователя и вовлеченности Ad-Chat последовательно показывает значущий разрыв в производительности по сравнению с решениями Ad-LLM на всех трех наборах данных, особенно в размерах, таких как точность, личность и доверие.’

Дальше, Ad-LLM показал свои самые сильные выигрыши в точности, личности и доверии, превосходя Ad-Chat на 17,6, 23,3 и 17,2 процента соответственно. Согласно статье, эти различия могут возникнуть из-за того, что Ad-Chat использует системные подсказки для направления модели к более персонализированному и промоциональному языку – который авторы утверждают может привести к ‘продавцовскому’ тону, снижающему точность и доверие.

Ad-Chat также произвел более низкие показатели вставки, даже при оценке запросов, выбранных для пригодности рекламы, и авторы приписывают это зависимости от подсказок, основанных на подсказках (которые они характеризуют как трудные для контроля).

В сценарии поисковой системы, однако, Ad-Chat достиг 8,6-процентного более высокого показателя кликов, который, по мнению статьи, может отражать преимущество использования LLM для извлечения кандидатов продукта, а не полагаться исключительно на семантические вложения:

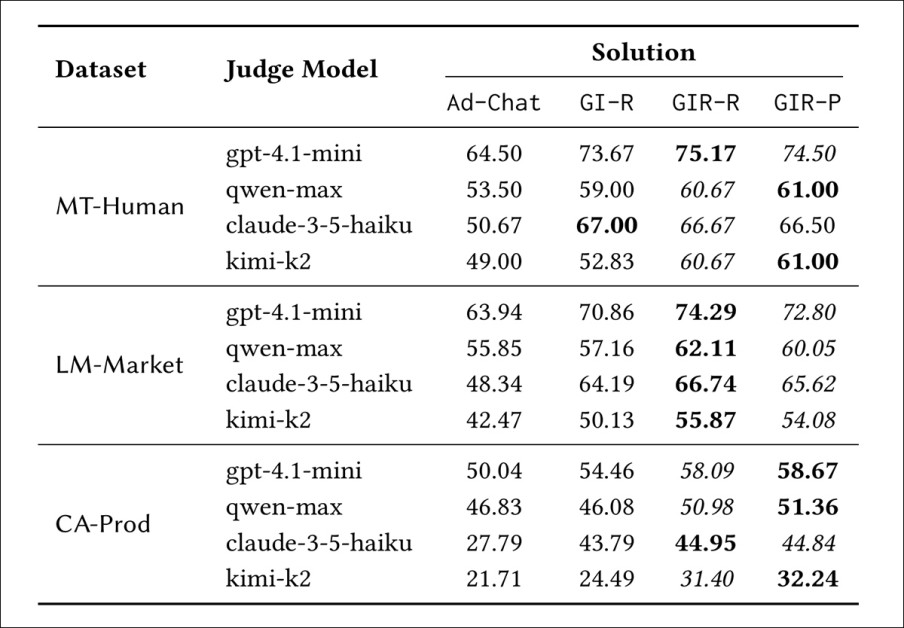

Сравнение общих баллов производительности по четырем моделям судей (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) для Ad-Chat и трех вариантов Ad-LLM (GI-R, GIR-R, GIR-P) на наборах данных MT-Human, LM-Market и CA-Prod. Хотя баллы варьируются по судьям, Ad-LLM последовательно превосходит Ad-Chat во всех условиях.

Вторая таблица результатов (выше) иллюстрирует, что на всех трех наборах данных решения Ad-LLM последовательно превосходят Ad-Chat по четырем моделям судей; GPT-4.1-mini; Qwen-max; Claude-3-5-haiku; и Kimi-k2.

Эти судьи были выбраны для различия от базовой модели doubao-1-5-lite-32k, что помогает уменьшить предвзятость из-за выравнивания моделей. GIR-R занял первое или второе место в каждом случае, что говорит о широком согласии среди судей относительно превосходства Ad-LLM. Разбивка по отдельным качественным размерам тесно следует шаблону, наблюдаемому в предыдущих результатах (выше).

В заключение статья отмечает, что и Ad-Chat, и Ad-LLM требуют больших ресурсов, чем более инновационные и эффективные модели, и что необходимость использования агентов LLM в этом типе транзакции может представлять значительную нагрузку. Хотя можно представить, что проблемы с задержкой (обычно критические в сценариях обслуживания рекламы) могут возникнуть из-за использования LLM такого типа (хотя это не обсуждается конкретно в статье).

В любом случае, реализация стратегии Ad-Chat авторами (верхний ряд в предыдущей схеме, показанной в начале статьи) оказалась предложением с самым высоким показателем кликов, хотя и с самой высокой связанной стоимостью LLM.

Заключение

Хотя не удивительно, что литература будет спекулировать о методах, с помощью которых LLM могут нести рекламу, на самом деле существует довольно мало публично доступных исследований по этой теме; это делает текущую статью, и то, что можно разумно интерпретировать как её предшественника, интересным чтением.

Любой, кто работал с отделом продаж рекламы или продажей инвентаря, знает, что рекламодатели всегда хотят больше – идеально, чтобы реклама была представлена как фактический контент, совершенно неотличимый от основного потока контента; и они заплатят значительную премию за это (вместе с хозяином, который тем самым рискует своей репутацией и положением с читателями и другими типами заинтересованных сторон).

Следовательно, будет интересно увидеть, в какой степени, если таковая имеется, рекламные кодициллы, предвиденные в двух статьях, могут быть стимулированы к продвижению дальше вверх по ответу LLM и ближе к ‘полезной нагрузке’.

Опубликовано впервые в четверг, 18 сентября 2025 года