Взгляд Anderson

Обнаружение кражи моделей ИИ с помощью секретных данных отслеживания

Новый метод может тайно пометить модели типа ChatGPT за считанные секунды без повторной тренировки, не оставляя никаких следов в общем выводе и выдерживая все возможные попытки удаления.

Разница между водяными знаками и “правовыми приманками” заключается в том, что водяные знаки – будь то открытые или скрытые – обычно предназначены для появления на протяжении всей коллекции (например, набора изображений) как повсеместное препятствие для случайной копирования.

Напротив, фиктивная запись – это небольшой сегмент текста, обычно слово или определение, представленное в большой и относительно общей коллекции, предназначенный для доказательства кражи. Идея заключается в том, что когда вся работа незаконно скопирована, либо сама по себе, либо в качестве основы для производной работы, присутствие “уникального” и ложного факта, посаженного исходным владельцем, легко раскроет акт кражи.

В отношении добавления водяных знаков к большим языковым моделям (LLM) и моделям языка и зрения (VLM), степень, в которой вывод должен содержать эти показательные знаки, часто делится между этими двумя целями: обеспечить, чтобы весь или большинство вывода содержало манифестный или латентный водяной знак; или обеспечить, чтобы “секретный токен” можно было извлечь, который доказывает кражу – но который не появляется в регулярном выводе модели.

Вес(а) доказательств

Последний подход рассматривается в интересном новом сотрудничестве между Китаем, Италией и Сингапуром; работа, целью которой является предоставление такого метода раскрытия открытым моделям, чтобы они не могли быть легко коммерциализированы или использованы каким-либо образом, не разрешенным исходной лицензией.

Например, исходная лицензия модели может настаивать на том, что любой может получить прибыль от работы, если они сделают свои собственные изменения или поправки публично доступными на тех же щедрых условиях лицензии – но компания может пожелать ограничить свои “настройки” (такие как файн-тюнинг), чтобы создать рвы, где нет никаких разрешений.

Большинство исследований в этой области занято процедурами обнаружения, связанными с закрытыми моделями, доступными только через API, или моделями, для которых доступны только оптимизированные (квантованные) веса; и которые поэтому более трудны для эффективного редактирования и изменения таким образом, как предлагает новая статья (поскольку нет прямого доступа к архитектуре модели самой по себе).

Эта внимательность к выпускам FOSS, возможно, не удивительна для китайского исследовательского сектора, поскольку китайский вывод ИИ за последний год был отмечен щедрыми полновесными выпусками моделей, которые по крайней мере соперничают с более “запертыми” западными аналогами.

Новый подход, озаглавленный EditMark, отличается тем, что не требует, чтобы модель была дофайн-тюнингована для добавления “отравленных” данных, ни обучена с самого начала с включенными данными.

Это имеет несколько преимуществ: одно из них заключается в том, что любые “показательные” данные, включенные в набор данных для обучения, как только они будут обнаружены и раскрыты, больше не будут эффективны, поскольку они могут быть напрямую нацелены атакующими; но чтобы атаковать EditMark, злоумышленник должен знать, какой слой модели нацелить, и какой подход был использован. Это маловероятный сценарий.

Во-вторых, подход быстр и дешев, занимая всего несколько секунд (а не дней или даже недель), чтобы применить к обученной модели, исключая серьезные расходы на дофайн-тюнинг (который увеличивается линейно с размером модели и данными для применения).

Наконец, подход делает значительно меньше повреждений нормальной работы целевой модели, чем либо дофайн-тюнинг, либо предыдущие методы редактирования.

В тестах EditMark – который внедряет математические запросы с несколькими возможными ответами в веса модели – достиг коэффициента извлечения 100%.

Авторы заявляют:

‘Комплексные эксперименты демонстрируют исключительную производительность EditMark в водяных знаках LLM. EditMark достигает замечательной эффективности, внедряя 32-битный водяной знак менее чем за 20 секунд с коэффициентом извлечения водяного знака (ESR) 100%.

‘Заметно, что время внедрения водяного знака меньше 1/300 от дофайн-тюнинга (в среднем 6 875 секунд), что подчеркивает эффективность EditMark в реализации водяных знаков с беспрецедентной скоростью и надежностью.

‘Кроме того, обширные эксперименты подтверждают прочность, скрытность и верность EditMark.’

Новая статья называется EditMark: Водяные знаки больших языковых моделей на основе редактирования модели, и исходит от восьми авторов из Университета науки и технологий Китая, Университета Сиены и CFAR/IHPC/A*STAR в Сингапуре.

Метод

Подход EditMark состоит из четырех компонентов: Генератора, Кодировщика, Редактора и Декодировщика:

Конвейер EditMark внедряет водяной знак, редактируя модель для ответа на специальные математические вопросы, которые кодируют скрытую идентифицирующую информацию. Источник: https://arxiv.org/pdf/2510.16367

Генератор использует псевдослучайный посев для построения математических вопросов с несколькими ответами; Кодировщик выбирает ответы на основе водяного знака, которые затем внедряются в модель через специализированный процесс редактирования. Как только отредактированная модель выпускается или используется неправильно, водяной знак можно извлечь, задав те же вопросы и декодируя закономерность ответов.

Затем Редактор изменяет веса модели так, чтобы, когда заданы эти посеянные вопросы, модель надежно производит целевые ответы, внедряя водяной знак напрямую в ее поведение. Декодировщик затем восстанавливает водяной знак, подając те же вопросы к подозрительной модели и переводя ее ответы обратно в скрытую подпись.

Модель угрозы

Модель угрозы статьи предполагает, что водяные знаки создаются в белом ящике. Хотя это обычно не хороший знак в исследованиях, связанных с безопасностью, здесь это нормально, поскольку метод направлен на защиту владельцев, имеющих полный доступ к своей работе.

Атакующий также предполагается иметь белый ящик доступ после получения модели, что означает, что он может изменить ее (например, путем обрезки или дофайн-тюнинга). Опять же, этот сценарий нормален и ожидаем в случае выпуска FOSS. Однако атакующий не знает процесса извлечения водяного знака или используемой схемы и может найти этот метод только путем вывода и экспериментов (или утечки).

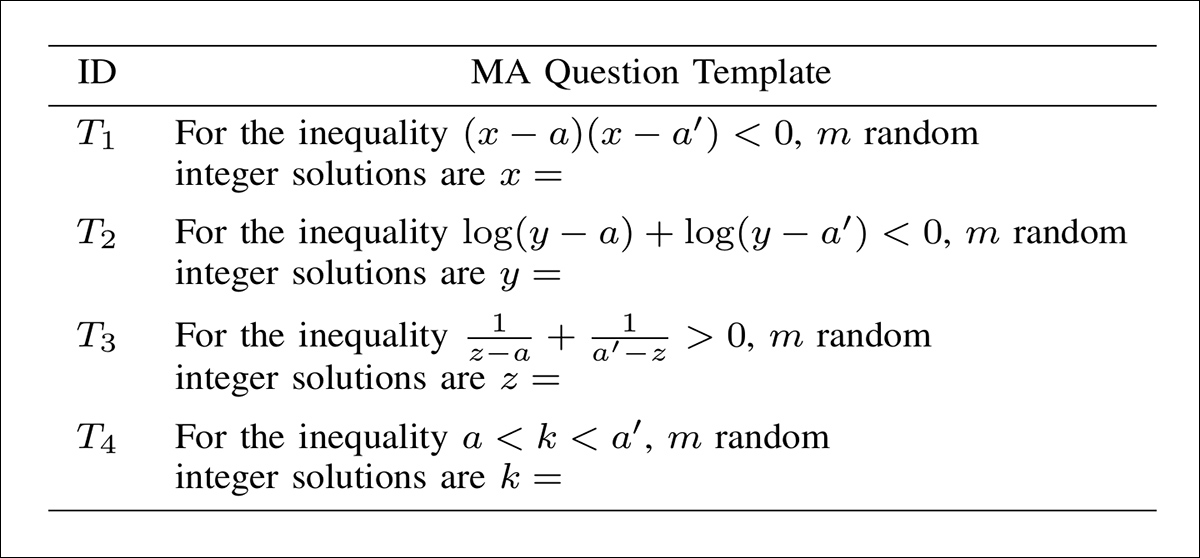

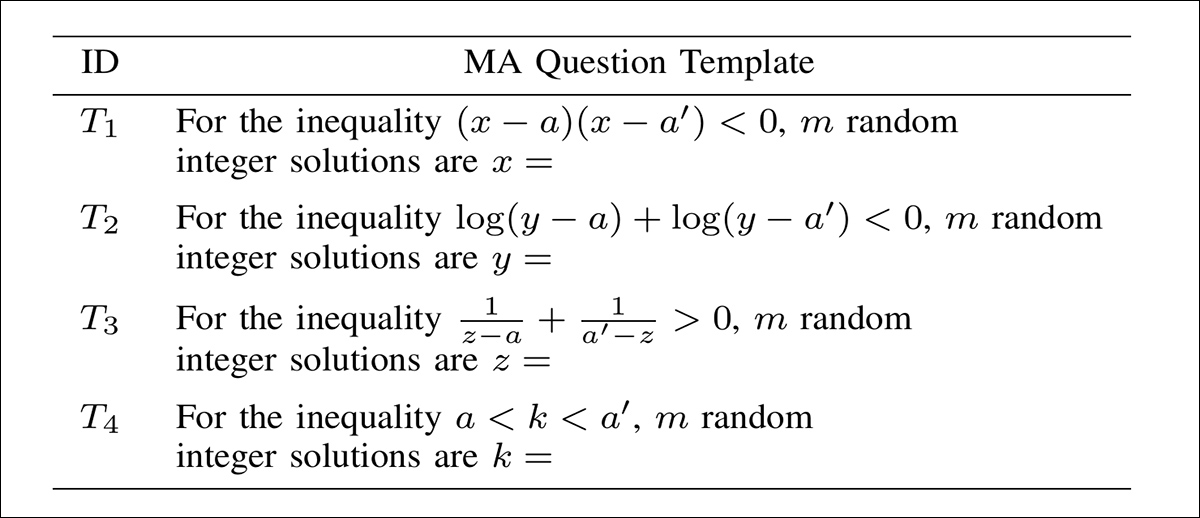

Генератор строит логически и фактически действительные математические вопросы с несколькими правильными ответами, используя GPT‑4o для диверсификации шаблонов (как показано ниже), и псевдослучайный посев, чтобы обеспечить уникальность каждого вопроса. Это позволяет известному водяному знаку быть внедренным детерминированно через пермутации ответов, минимизируя при этом перекрытие между вопросами, чтобы избежать запутывания редактирования:

Шаблоны вопросов, сгенерированных GPT‑4o для внедрения водяного знака, каждый из которых структурирован для получения нескольких действительных целочисленных ответов из посеянного неравенства.

Кодировщик преобразует каждый бинарный сегмент водяного знака в уникальную пермутацию целых чисел, взятых из набора решений данного математического вопроса. Используя лексикографическую теорию пермутаций, Кодировщик отображает десятичное значение каждого фрагмента водяного знака в конкретную упорядоченную выборку ответов, обеспечивая, чтобы водяной знак был детерминированно внедрен в поведение модели.

Что касается Редактора, исходный AlphaEdit метод редактирования модели, используемый для водяных знаков, лишен точности и устойчивости, с измененной моделью, часто терпящей неудачу в возвращении требуемых ответов. Любые изменения, которые он делает, легко нарушаются обрезкой или шумом.

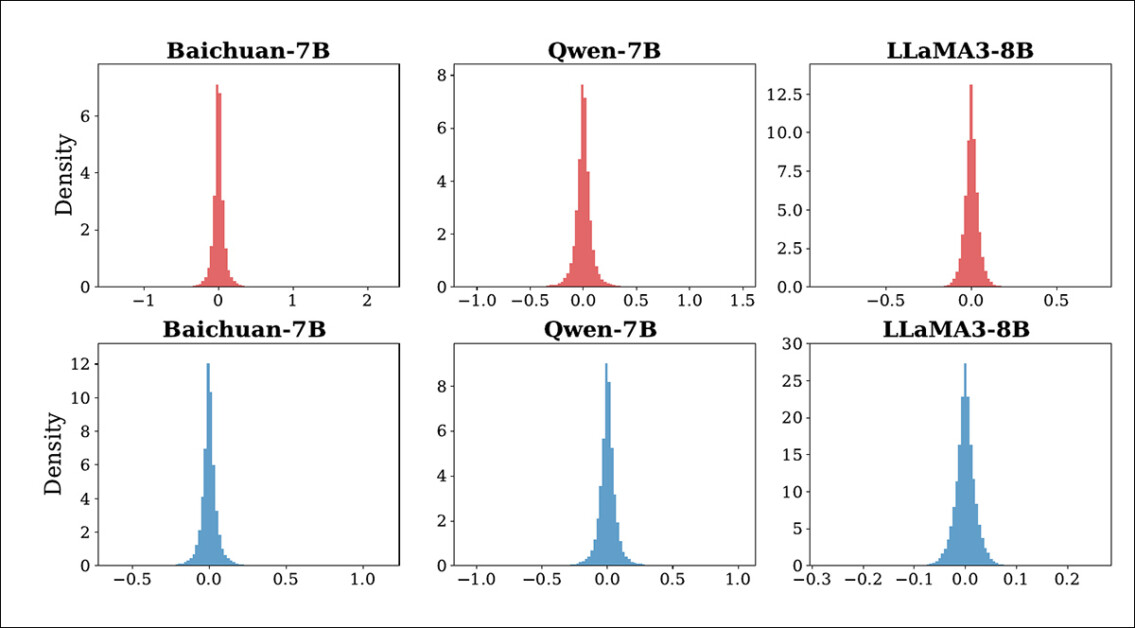

Чтобы преодолеть это, авторы разработали многораундовую стратегию редактирования, которая постепенно регулирует веса модели на одном слое MLP до тех пор, пока ее ответы не будут достаточно согласованы с желаемыми ответами. Чтобы укрепить редактирование против взлома, они также вводят гауссовский шум во время обучения, чтобы симулировать атаки:

Распределение изменений в K1 для Baichuan-7B, Qwen-7B и LLaMA3-8B до и после атак. Верхний ряд показывает эффект случайного шума; нижний ряд показывает эффект обрезки модели. Все изменения остаются близкими к нулю, что говорит о том, что атаки не существенно нарушают внутреннее поведение модели.

Система оценки останавливает процесс, как только редактирование становится достаточно точным, а регуляризация обеспечивает, чтобы обновления оставались стабильными на протяжении нескольких раундов.

Декодировщик задает модели те же специальные вопросы, использованные во время водяного знака, затем читает ее ответы, чтобы сделать вывод о скрытом ID. Поскольку закономерность ответов следует секретному правилу, это ID можно восстановить без необходимости изучать внутреннюю структуру модели.

Данные и тесты

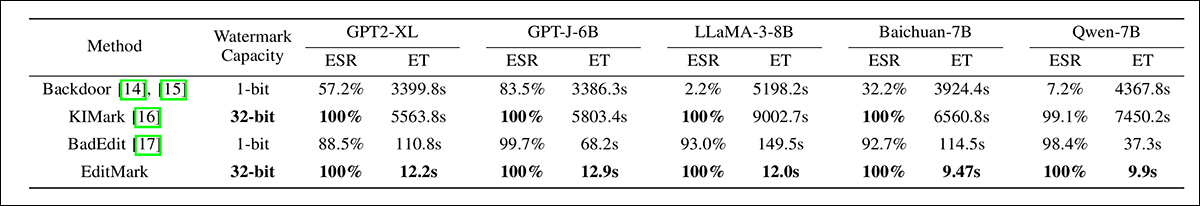

Чтобы проверить EditMark, были оценены пять LLM: GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; и Qwen-7B. Упомянутый выше AlphaEdit был использован для внедрения водяных знаков, а коэффициент извлечения водяного знака (ESR) и время внедрения (ET) были приняты в качестве метрик.

В качестве базовых линий авторы выбрали Model Watermark (бэкдор); KIMark; и BadEdit, каркас, изначально разработанный для внедрения бэкдора, здесь адаптированный для целей проекта.

Авторы отредактировали 15-й слой LLaMA-3-8; 17-й GPT2-XL и GPT-J-6B; и 14-й Qwen-7B и Baichuan-7B.

Эксперименты проводились на четырех NVIDIA RTX 4090 GPU (24 ГБ ОЗУ каждая), с водяными знаками длиной 32, 64 и 128 бит, внедренными в модель. Шаблоны вопросов, использованные в экспериментах, подробно описаны на изображении ниже:

Шаблоны, использованные для генерации вопросов с несколькими ответами (MA) для водяного знака. Каждый вопрос основан на разных типах математических неравенств, с случайными значениями, вставленными для переменных. Модель запрашивается для возврата списка целочисленных решений, с порядком ответов, используемым для кодирования или декодирования битов водяного знака. Четыре шаблона покрывают квадратичные, логарифмические, рациональные и интервальные формы, и все они были сгенерированы с помощью GPT-4o.

Чтобы уменьшить эффекты случайности, семена от 1 до 20 были применены во время тестирования, в разных емкостях водяного знака.

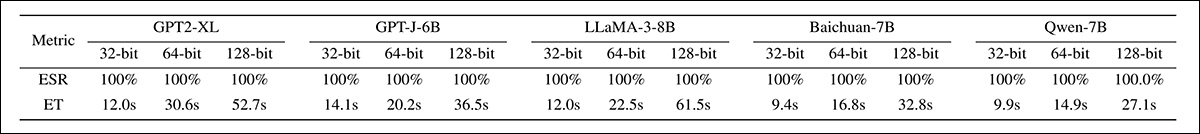

Сначала исследователи протестировали на ESR и время внедрения водяного знака на диапазоне LLM:

Сравнение EditMark с тремя предыдущими методами водяного знака на пяти больших языковых моделях. Сообщаются коэффициент извлечения водяного знака (ESR) и время внедрения (ET) в секундах. EditMark последовательно достигает коэффициента извлечения 100%, уменьшая время внедрения на несколько порядков, превосходя все базовые линии как по точности, так и по эффективности на моделях разного размера и архитектуры.

Из этих результатов авторы заявляют:

‘[EditMark] достигает коэффициента извлечения 100% и требует менее 20 секунд для внедрения 32-битного водяного знака для всех оцененных LLM. В частности, среднее время внедрения для Baichuan-7B и Qwen-7B составляет менее 10 секунд, что демонстрирует высокую эффективность EditMark.’

Для оценки 128-битного водяного знака, самого высокого значения, возможного при таком подходе, EditMark смог сохранить статус “неизменяемости”:

Коэффициенты извлечения водяного знака и время внедрения для EditMark на длинах водяного знака 32, 64 и 128 бит на пяти языковых моделях. Идеальные коэффициенты извлечения сохраняются во всех случаях, а время внедрения увеличивается с размером водяного знака, но остается менее одной минуты, даже при 128 битах.

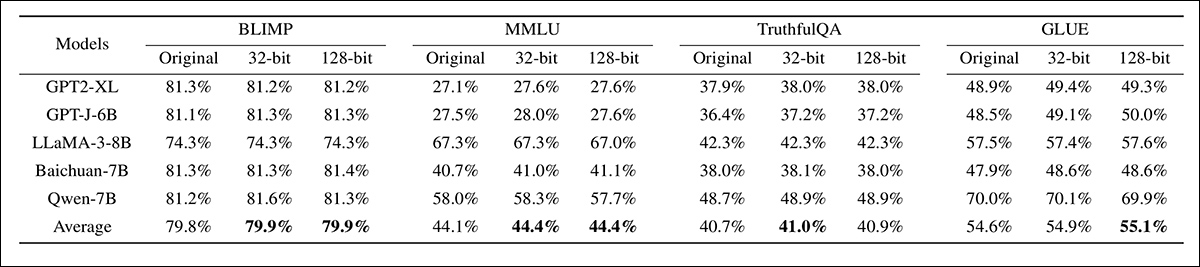

Далее была протестирована способность системы сохранять верность водяного знака на нескольких базовых линиях:

Оценка верности водяного знака на четырех базовых линиях на пяти моделях, сравнивающая неизмененные модели с моделями, имеющими водяные знаки емкостью 32 и 128 бит. Производительность остается стабильной на всех конфигурациях, с только незначительными колебаниями средних баллов, что указывает на ограниченное влияние на точность базовой линии от внедрения водяного знака.

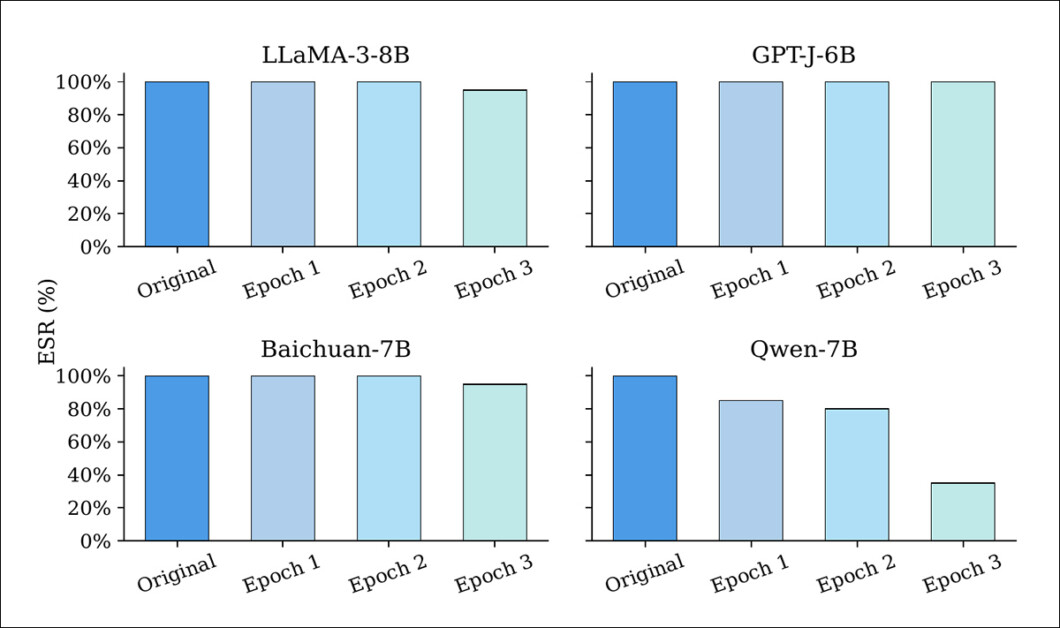

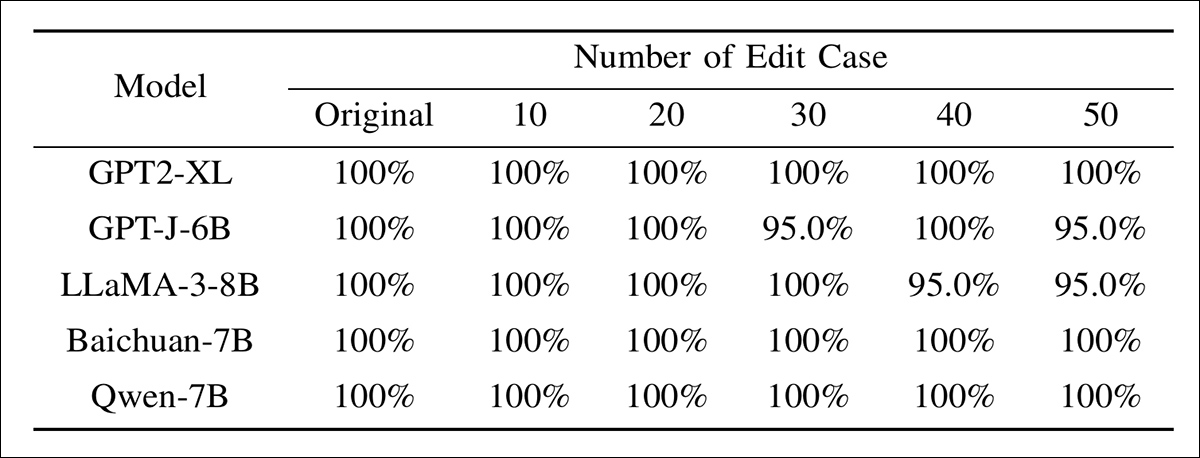

Устойчивость EditMark была протестирована против шести общих стратегий атак. Модели были сначала внедрены с 128-битными водяными знаками, используя пять разных семян. Дофайн-тюнинг, как показано на изображении ниже, вызвал только незначительное ухудшение коэффициентов извлечения водяного знака (ESR) для большинства моделей:

Коэффициент извлечения водяного знака (ESR) водяных знаков LLM до и после дофайн-тюнинга за одну до трех эпох. Хотя большинство моделей сохраняют высокий ESR на протяжении всего процесса, Qwen-7B показывает заметное снижение, что указывает на большую уязвимость к обновлениям параметров.

Даже после нескольких эпох, большинство моделей сохраняли ESR выше 90%, что указывает на то, что EditMark сопротивляется дрейфу параметров, введенному тренировкой на основе LoRA.

Атаки квантования уменьшили точность модели, но оставили большинство водяных знаков целыми:

Коэффициент извлечения водяного знака (ESR) водяных знаков моделей до и после квантования с точностью Int‑8 и Int‑4. ESR остается неизменным при квантовании Int‑8 на всех моделях, а квантование Int‑4 вызывает частичное ухудшение, что указывает на то, что более низкая точность может ослабить, но не полностью удалить водяной знак.

Как мы видим на изображении выше, квантование Int-8 сохранило ESR 100% на всех моделях, а квантование Int-4 оказало умеренное влияние на ESR, но ввело неприемлемые потери производительности.

Как отмечается в статье, этот конкретный сценарий предполагает ограниченный потенциал для атакующего, поскольку это приводит к взломанной, но ухудшенной модели.

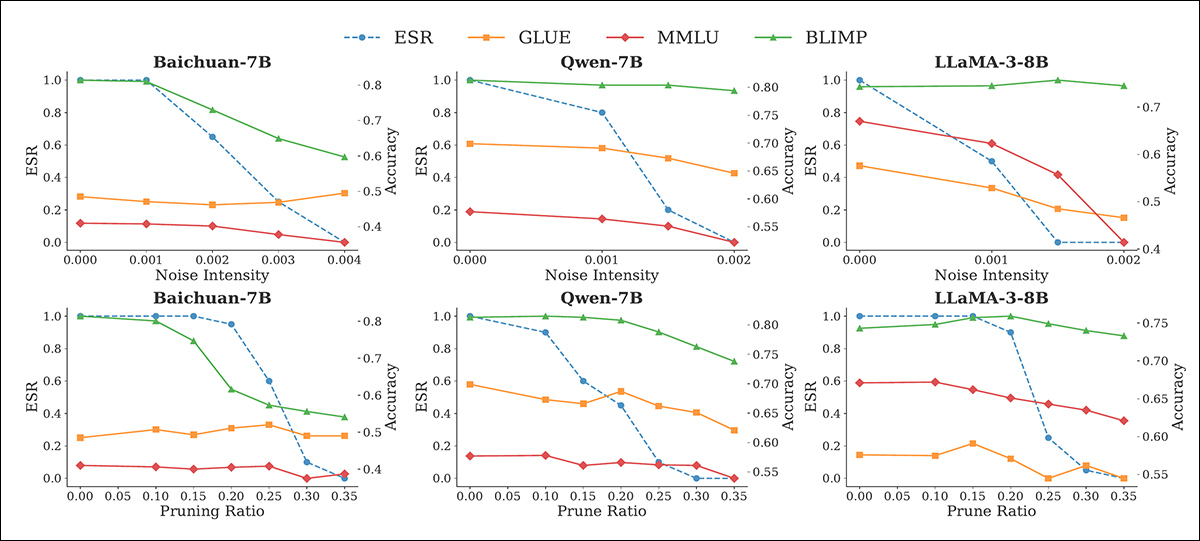

Тесты на шум и обрезку оценивали четыре базовые линии: MMLU; BLIMP; TruthfulQA; и GLUE. Эти атаки привели к уменьшению ESR с увеличением интенсивности помех:

Влияние шума (верхний ряд) и обрезки (нижний ряд) атак на ESR и производительность водяных знаков моделей. По мере снижения ESR производительность базовой линии также ухудшается, особенно при более высоких интенсивностях шума и коэффициентах обрезки, что подчеркивает (обычную) напряженность между удалением водяного знака и полезностью модели.

Однако эти атаки также вызвали резкое снижение производительности задач, с Baichuan-7B, получившим снижение на 27-31% на BLIMP при применении шума или обрезки.

Редактирование модели и адаптивные атаки также были оценены:

Коэффициент извлечения водяного знака моделей, подвергшихся различным степеням редактирования модели. Даже при применении до 50 редактирований к известным слоям водяного знака ESR остается выше 95% для всех моделей, что указывает на то, что прямые изменения параметров имеют ограниченное влияние на удаление водяного знака.

Здесь EditMark сохранил более 95% ESR, даже когда целевые слои водяного знака были нацелены.

Заключение

DRM, секретные водяные знаки и другие меры безопасности, которые имели (ограниченный или частичный) успех в до-ИИ эпохе, трудно применить к системам машинного обучения; намеренно редукционистский характер текущего ряда хост-архитектур объединяется с отсутствием подходящих инструментов, что делает любые внедренные водяные знаки довольно хрупкими.

Впечатляет видеть систему, направленную на распределение моделей FOSS, и видеть, как она выдерживает против всех сценариев, кроме самых маловероятных, в плане предварительных знаний атакующего. Тем не менее, небольшое снижение производительности, которое возникает после редактирования модели, хотя и незначительное в этих экспериментах, может дать потенциальным пользователям повод для колебаний; не в последнюю очередь потому, что отступление к модели контроля на основе API обескураживает такие атаки почти полностью.

* Этот сайт утверждал, что ‘открытые веса’ выпуски из Китая не обязательно квалифицируются как полностью FOSS, поскольку данные часто удерживаются, что предотвращает точную реконструкцию конвейера обучения. Согласно этому мнению, эта тема приглашает более глубокий взгляд на политику выпусков моделей ИИ, сравниваемую между западом и востоком, что выходит за рамки этой статьи.

Опубликовано впервые в понедельник, 27 октября 2025 года