Ângulo de Anderson

O ‘Survey Paper DDoS Attack’ Que Está Sobrecarregando a Pesquisa Científica

Modelos de IA gerativos, como o ChatGPT, agora estão inundando plataformas de publicação acadêmica com artigos de pesquisa gerados por IA em níveis que estão tornando a relação sinal-ruído crítica. Um novo estudo afirma que essa inundação está sobrecarregando os pesquisadores, distorcendo citações e erodindo a confiança no registro científico, comparando a onda de artigos auxiliados por IA a um ‘ataque DDoS’ à própria ciência.

(Parcialmente) opinião Na semana passada, pela primeira vez em sete anos de acompanhamento da literatura científica relacionada à IA, tive que admitir a derrota e reconhecer que, pelo menos em períodos de pico, agora devo escolher entre estar por dentro das novas publicações essenciais ou ter algum tempo para escrever sobre algumas delas.

O número total de entradas em um número muito limitado de categorias relevantes (Visão Computacional, Aprendizado de Máquina, Modelos de Linguagem, e algumas outras seções menos assinadas) estava em significativamente mais de mil – apenas para as submissões de um dia.

Em tal volume, mesmo folheando todos os novos títulos e ocasionalmente se deliciando com alguns resumos de abstracts seria um dia improdutivo.

Isso foi na terça-feira, 7 de outubro. Em contraste, na categoria de Aprendizado de Máquina, essa terça-feira passada (14 de outubro) ofereceu um volume de publicação ligeiramente menos intenso do que os 400 ou mais registros para a terça-feira da semana anterior; teve um mero 354 registros:

354 submissões para a categoria de Aprendizado de Máquina em um dia. Fonte: https://arxiv.org/

Você teria que ter lido o Arxiv todos os dias, por alguns anos, para perceber como esses números estão ficando loucos.

Admitidamente, a terça-feira é o ‘horário de pico’ do Arxiv para submissões, talvez porque seja o primeiro dia de trabalho que ocorre longe de fins de semana prolongados desfrutados pelas pessoas influentes que os pesquisadores esperam alcançar; e a categoria de Aprendizado de Máquina é uma seção ‘guarda-tudo’ com um número menor de artigos únicos (artigos que não são publicados simultaneamente em canais mais especializados) do que a maioria das outras categorias.

No entanto, o aumento nas submissões de artigos já é um fenômeno notado na academia e na mídia.

Talvez o aspecto mais chocante dessa escalada é como todas as outras categorias adjacentes são mais ou menos inalteradas em sua frequência nos últimos três anos, enquanto a categoria de Ciência da Computação (veja se você consegue localizá-la nos números oficiais do Arxiv abaixo) está em uma trajetória severamente ascendente:

O aumento de artigos de ciência da computação (CS) nos últimos três anos. Fonte: https://info.arxiv.org/about/reports/submission_category_by_year.html

Há pouco mais de três anos, a saída de artigos de IA do Arxiv era estimada para dobrar a cada poucos anos; e será interessante ler o próprio resumo anual de tendências do Arxiv no final de 2025.

Volume em 11

As duas razões mais óbvias pelas quais isso está acontecendo são a) compromisso financeiro sem precedentes com IA gerativa é atraindo níveis maciços de investimento em pesquisa nos setores privado e acadêmico, que frequentemente colaboram; e b) o fato de que sistemas de modelos de linguagem de IA, como o ChatGPT, agora tornam a submissão de artigos de pesquisa (incluindo artigos sobre IA) um processo quase industrializado.

No entanto, a qualidade das submissões de pesquisa não está aumentando em conjunto com o volume (embora a saída com erro do IA tenda a fazer mais manchetes no setor jurídico do que no acadêmico, não menos porque as ramificações são mais óbvias lá).

Uma política de tolerância zero é difícil de implementar nesse caso, mesmo que reconhecer o conteúdo gerado por IA fosse mais fácil; além do fato de que a IA em si é um benefício manifesto para a pesquisa científica em geral, seu uso em submissões de artigos de pesquisa melhorou geralmente* a clareza do trabalho de muitos submetentes não anglófonos – indivíduos e equipes que até agora operavam em desvantagem.

Mas o problema de reduzir a barreira linguística dessa forma é que isso também aumenta o número bruto de submetentes globais, sem aumentar o nível de supervisão humana que dá valor a esse trabalho.

Se os níveis de submissão continuarem a aumentar exponencialmente, a relação sinal-ruído se tornará tão ingovernável que apenas a própria IA poderia possivelmente navegar as novas inundações e afluentes de artigos de IA; uma tarefa que ela não está mais apta a realizar do que provar sua própria saída. Ironia, a pesquisa científica é uma empreitada humana intensamente.

Um Ataque à Pesquisa

A causa dessa reflexão é uma colaboração interessante nova da China intitulada Pare de Atacar a Comunidade de Pesquisa com Artigos de Pesquisa Gerados por IA.

O novo artigo de posição se concentra especificamente em submissões de levantamento – resumos de alta qualidade de particularidades em pesquisa, que tradicionalmente listam e contextualizam, interpretam tendências e fazem previsões informadas:

Uma fração mínima do vasto e sempre crescente corpo de levantamentos disponíveis em seções relacionadas ao aprendizado de máquina e IA, no arxiv.org

Desde que os levantamentos curam em vez de originam, eles são incomumente fáceis de automatizar com IA, e os autores do novo trabalho caracterizam a proliferação de levantamentos de baixo esforço em termos de uma ameaça de segurança ao setor de pesquisa†:

‘[O] surgimento recente de levantamentos gerados por IA, especialmente habilitados por grandes modelos de linguagem (LLMs), transformou esse gênero tradicionalmente trabalhoso em uma saída de alto volume e baixo esforço. Embora essa automação reduza as barreiras de entrada, também introduz uma ameaça crítica: o fenômeno que denominamos o “ataque de levantamento de papel DDoS” à comunidade de pesquisa.

‘Isso se refere à proliferação descontrolada de manuscritos de levantamento superficialmente abrangentes, mas frequentemente redundantes, de baixa qualidade ou até mesmo alucinados, que inunda as plataformas de pré-impressão, sobrecarrega os pesquisadores e erode a confiança no registro científico.

‘[Nós] argumentamos que devemos parar de fazer o upload de grandes quantidades de artigos de levantamento gerados por IA (ou seja, ataque de levantamento de papel DDoS) para a comunidade de pesquisa, instituindo fortes normas para a escrita de revisão auxiliada por IA.’

Os autores afirmam que essa aceleração descontrolada da produção de levantamentos ameaça inundar o ecossistema de pesquisa com relatórios polidos que, no entanto, carecem de profundidade crítica, e que provavelmente propagarão erros factuais e/ou alucinações.

O artigo alerta que, sem melhores regras ou supervisão, os levantamentos gerados por IA podem se transformar em cópias rasas que distorcem quais tópicos são importantes, escondem análises significativas e tornam as revisões da literatura menos confiáveis:

‘As implicações para a qualidade da pesquisa e a confiança são profundas. Primeiro, avanços genuínos arriscam ser obscurecidos por reescritas algorítmicas de trabalhos existentes.

‘Novatos e acadêmicos interdisciplinares podem lutar para localizar visões confiáveis em meio ao barulho. Além disso, erros ou vieses introduzidos por redação automática podem se propagar sem controle, semeando pesquisas subsequentes com premissas falhas.

‘Em resumo, a inundação de levantamentos não revisados por pares gerados por IA coloca em risco tanto a rigorosidade das revisões da literatura quanto a credibilidade do registro científico.’

‘Autores Anormais’

Os pesquisadores do novo artigo fornecem algumas análises interessantes sobre a evolução das submissões de levantamento:

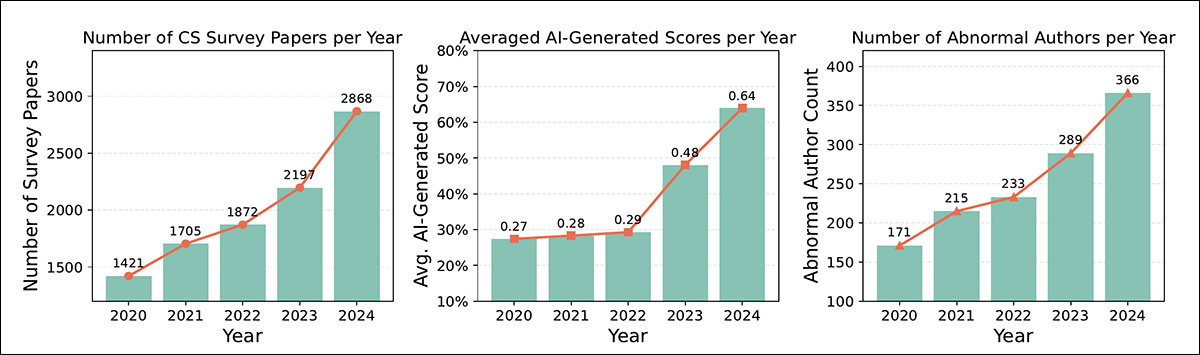

Esquerda: a contagem anual de artigos de levantamento de ciência da computação de 2020 a 2024. Meio: pontuações de geração de IA para esses artigos no mesmo período. Direita: número de autores marcados como anormais (aqueles com saída de levantamento excepcionalmente alta, diversidade de coautoria limitada e padrões institucionais recorrentes) a cada ano. As três tendências mostram um aumento acentuado começando em 2023, coincidindo com o lançamento do ChatGPT e outros grandes modelos de linguagem.

Na primeira coluna, vemos tendências de crescimento: a curva começa a se inclinar por volta de 2022, justo quando o ChatGPT surgiu e os grandes modelos de linguagem começaram a se tornar mainstream, e modelos de acompanhamento como Claude, PaLM e Gemini manteriam esse momentum ao longo de 2023.

O gráfico do meio mostra um aumento acentuado nas submissões após 2022, coincidindo com o lançamento do ChatGPT. Uma equipe de pesquisa encontrou que, em 2024, mais de 10% dos resumos científicos haviam sido executados em um LLM. Um relatório separado de uma empresa de detecção de IA estimou o salto pós-ChatGPT em 72% para artigos no arXiv que podem ter sido escritos com ajuda de IA. O número de artigos com pontuações de geração de IA altas também dobrou em um ano, de 3,6% para 6,2%.

O gráfico da direita mostra um aumento constante no número de padrões de autor ‘anormais’ (pesquisadores que submetem três ou mais levantamentos dentro de um mês enquanto trabalham com menos de dois colaboradores), com um aumento mais acentuado começando em 2022.

Os autores afirmam que muitos desses artigos de levantamento podem ter sido redigidos por IA, por diversas razões; alguns são escritos por autores solitários ou pequenos grupos que submetem vários levantamentos em um curto período de tempo; muitos cobrem tópicos não relacionados; e, em alguns casos, os autores não têm nenhum registro anterior nos campos que estão resumindo.

Além disso, alguns são publicados sob coletivos anônimos sem vínculos institucionais claros – padrões que sugerem uma inundação coordenada do campo com levantamentos rápidos, possivelmente para ganhar citações ou melhorar perfis acadêmicos, em vez de fazer qualquer contribuição real para a literatura.

Problemas

Embora não possamos cobrir todas as controvérsias do novo artigo, devemos dar uma olhada em algumas das observações mais notáveis, bem como lançar um olhar crítico sobre as soluções sugeridas pelos autores para esses problemas.

Qualidade e Originalidade

O problema não é apenas o volume: muitos levantamentos escritos por IA pulam o que torna um bom levantamento útil: estrutura clara, análise profunda, crédito correto e assíduo, e insights reais. Em vez disso, o artigo sugere que os levantamentos auxiliados por IA frequentemente leem como resumos costurados, sem nenhum dos cuidados ou curadoria necessários.

Os autores observam, além disso, que os levantamentos escritos por IA frequentemente carecem de estrutura, mas simplesmente listam artigos sem direção clara, pulando seções-chave e falhando em criar contexto. Levantamentos escritos por humanos, por contraste, tendem a estabelecer categorias apropriadas e contar uma história mais coerente.

Além disso, muitos levantamentos potencialmente auxiliados por IA parecem simplesmente copiar quebras de tópicos existentes, às vezes diretamente da Wikipedia. Por exemplo, o artigo nota que vários levantamentos sobre Transformadores de Visão contêm títulos de seção comuns e estrutura, denotando saída de modelo de linguagem baseada em template:

‘Em contraste, um levantamento bem elaborado escrito por humanos pode introduzir uma nova taxonomia, por exemplo, categorizando ViT por estratégias de eficiência. A falta de tal estrutura original em muitos pré-impressos de levantamento recentes levanta preocupações de que eles possam ter sido gerados por IA com insight humano limitado.’

Não Me Cite Isso

Talvez o mais embaraçoso publicamente, os levantamentos escritos por IA frequentemente obtêm citações erradas, perdendo artigos-chave, incluindo artigos não relevantes e, às vezes, até mesmo listando artigos inexistentes – erros que sugerem que as referências originam-se de correspondência de padrão de superfície, em vez de verdadeira expertise.

Os autores também apontam que alguns artigos de levantamento recentes, frequentemente de equipes completamente diferentes, compartilham até 70% de suas listas de referências – um nível de sobreposição tão alto que eles argumentam que isso sugere uma dependência compartilhada de LLMs, que extraem de um pool estreito de material de origem.

De fato, usuários casuais do ChatGPT sabem que, quanto mais obscuro o tópico, menos fontes diversificadas há para o modelo generalizar; muito frequentemente, localizar as próprias fontes limitadas do modelo na web é mais útil do que tentar interagir com essa informação por meio de uma IA que não teve dados adequados em um domínio particular.

Um Estilo Homogêneo Emergente

Os autores também notam que muitos levantamentos escritos por IA sobre o mesmo tópico parecem e soam quase idênticos, pois os LLMs reutilizam frases e estrutura, especialmente para assuntos populares, resultando em uma torrente de artigos quase idênticos que adicionam pouco valor e também adicionam ruído significativo a pesquisadores que buscam respostas de domínio*:

‘Quando vários autores pedem a um LLM para “escrever uma revisão da literatura sobre X”, o modelo frequentemente produz respostas muito semelhantes, especialmente para definições comuns ou fatos bem conhecidos. Pesquisa recente mostrou um aumento acentuado no uso de certos padrões de escrita ligados a LLMs, sugerindo que muitos artigos agora compartilham o mesmo estilo.’

Seu ChatGPT Está Aparecendo

O artigo observa que uma maneira rápida de detectar levantamentos escritos por IA é pela presença de frases como ‘como um modelo de linguagem de IA’ ou ‘meu corte de conhecimento’, sugerindo curadoria mínima ou mesmo zero da saída do modelo de linguagem antes de submeter os artigos (embora uma busca direcionada no momento da escrita não tenha revelado nenhum desses tells indexados no Google Search).

O artigo nota que muitos levantamentos ‘suspeitos’ mostram menor diversidade de palavras e frases repetidas, por exemplo, começando vários parágrafos com Além disso. Esse tipo de padrão, os autores sugerem, é típico da escrita do estilo GPT, e poderia ser uma bandeira útil para detectar texto auto-gerado.

(Meu comentário pessoal sobre isso é que as restrições do jornalismo online frequentemente exigem que um escritor liste muitos itens em uma forma de prosa não estilizada. Portanto, o ChatGPT e seus pares provavelmente aprenderam esse mau hábito de escritores humanos que enfrentaram um número limitado de alternativas léxicas. Além disso, a conjectura dos autores mostra que eles estão brincando com os princípios da detecção de conteúdo de IA, que é um campo complexo e em desenvolvimento, com poucas constantes duradouras do tipo que os autores sugerem)

Embora os pesquisadores continuem a desenvolver um discurso fascinante sobre o impacto negativo dos levantamentos de IA na cultura de pesquisa e confiança, devemos remeter o leitor ao artigo de origem para uma maior profundidade sobre isso.

Soluções?

A solução do artigo é fascinante, radical e, ao mesmo tempo, estranhamente não original: que a utilidade dos artigos de levantamento deve ser substituída por um Levantamento Dinâmico ao Vivo – por interpretação, um tipo de híbrido entre um Wiki e uma página do GitHub, constantemente alimentado com novos dados de LLM e outros sistemas de IA, mas com commits feitos apenas por humanos, para que a IA não possa essencialmente ‘auto-publicar’ atualizações.

O sistema proposto compartilharia a versão e ramificação do GitHub, essencialmente transformando um recurso de informação em uma lista constantemente atualizada semelhante à ‘lista incrível’ de listas curadas no GitHub:

‘Nesse framework, um membro da comunidade primeiro estabelece um tópico de levantamento wiki, especificando o escopo, questões de pesquisa-chave e referências seminais, que, portanto, define uma fronteira temática clara e estrutura inicial.

‘Em seguida, um agente de ingestão baseado em LLM monitora continuamente arquivos de pré-impressão, anais de conferência e placares de benchmark; extrai automaticamente resumos, figuras e métricas de desempenho-chave; sintetiza resumos concisos de novos resultados; atualiza o gráfico de citação para refletir relações entre artigos; e sinaliza tendências de pesquisa emergentes para revisão adicional.

‘Por design, essas atualizações automatizadas ocorrem dentro de horas da publicação, garantindo que o repositório permaneça à vanguarda.

‘Contribuintes humanos então entram para fornecer a profundidade interpretativa que as máquinas sozinhas não podem oferecer. Eles refinam taxonomias evolutivas para capturar distinções metodológicas sutis, coordenam interpretações conflitantes de inovações algorítmicas em diferentes subcampos e fornecem comparações críticas mais profundas para o documento.’

O Livro das Mudanças

Os autores expõem entusiasticamente e ao longo do texto essa proposta, e essencialmente a justificam com algo que é muito verdadeiro: levantamentos de alta qualidade escritos por humanos sobre tópicos voláteis em torno da IA envelhecem tão rapidamente que mal valem a pena ser escritos; e o artigo observa que um prazo de três meses para um novo artigo de levantamento provavelmente significará que ele estará desatualizado (ou até severamente desatualizado) no momento de sua publicação agendada:

‘Ano após ano, as comunidades são inundadas com visões repetitivas ou superficiais que rapidamente perdem relevância, deixando práticos e novatos lutando para distinguir sinal de ruído. O ciclo de publicação tradicional (ou seja, rascunho, submissão, revisão e publicação) pode levar vários meses, após os quais avanços críticos podem já ter mudado o cenário.

‘Além disso, o volume crescente de levantamentos estáticos adiciona à sobrecarga cognitiva, pois os leitores devem vasculhar vários documentos sobrepostos para encontrar insights substanciais.’

Infelizmente, a solução do artigo compartilha muitas das piores e mais criticadas qualidades do Discord: mais especialmente que seria um recurso constantemente mudando e alterando.

Como qualquer parte de um Levantamento Dinâmico ao Vivo pode desaparecer ou ser alterada a qualquer momento, seria impossível usá-lo como uma fonte citável e estável; a menos, talvez, que ligando a um ‘commit anterior’, da mesma forma que o archive.is e o Wayback Machine, entre outros sites de arquivamento, fornecem snapshots de conteúdo de página da web congelados em um momento específico. Mas quais recursos um commit desses precisaria, e poderia ser confiável para permanecer ativo ao longo do tempo?

Além disso, uma plataforma/Wiki com conteúdo constantemente mudando seria desafiadora para indexar, seja por mecanismos de busca tradicionais ou LLMs.

Talvez a parte mais fraca da proposta do sistema é a ideia de que pessoas reais deveriam supervisionar os commits dos agentes LLM; como sempre, pessoas reais são caras. O que está sendo proposto é algo entre um museu e uma biblioteca – ambos precisariam de provisionamento de ‘carne’ proporcional ao volume de dados e número de tópicos cobertos.

Se ‘usar pessoas reais‘ for a única resposta a um problema de desenvolvimento de IA, é justo dizer que o problema permanece aberto e sem solução.

Conclusão

No momento, a vida útil curta dos artigos de levantamento é irritante; se a tendência atual de escrita automatizada em grande escala e submissão continuar, como imaginado no novo artigo, a relação sinal-ruído se tornará crônica e a literatura será ingovernável.

Nessa situação, seria ainda mais difícil do que é agora para vozes menores, sub-FAANG, serem ouvidas na tempestade de submissões, e os líderes de mercado maiores provavelmente ganharão ainda mais proeminência.

Além de levantamentos ao vivo, o novo artigo propõe que os autores não apenas sejam constrangidos a declarar quando a IA é usada em qualquer parte de uma submissão, mas também que as seções auxiliadas por IA sejam explicitamente rotuladas dentro de um artigo (talvez com um arquivo JSON lateral…?).

Como isso é uma perspectiva onerosa, o artigo sugere alternativamente o que só posso caracterizar como um ‘gueto de IA’ – uma seção distinta na submissão que é reservada para contribuições de IA.

Em resumo, o novo trabalho tem, pelo menos na minha opinião, nenhuma solução realista para oferecer; mas os autores realizaram um serviço útil ao enquadrar os desafios à frente.

O artigo Pare de Atacar a Comunidade de Pesquisa com Artigos de Levantamento Gerados por IA pode ser encontrado em https://arxiv.org/abs/2510.09686, e é escrito por seis autores de departamentos da Universidade Jiao Tong de Xangai.

___________________________________

* Nem todos sentem que isso é o caso.

†Ênfase dos autores, não minha. Além disso, onde aplicável, minha conversão das citações em linha dos autores em links.

Publicado pela primeira vez na sexta-feira, 17 de outubro de 2025