Ângulo de Anderson

Ensinar AI Esquecida a ‘Manter esse Pensamento’ por Mais Tempo

Modelos de linguagem muitas vezes não conseguem lembrar do início de uma conversa. Um novo método de compressão de texto pode mudar isso e tornar as sessões de bate-papo de IA muito menos irritantes.

Sistemas de IA conversacional, como o ChatGPT, muitas vezes perdem o rastreamento de partes anteriores de uma conversa, repetindo-se ou dando respostas que ignoram regras previamente acordadas.

Isso ocorre porque os Grandes Modelos de Linguagem (LLMs) têm uma capacidade limitada de foco, definida como uma janela de contexto de atenção – como uma lanterna que pode iluminar apenas o que está diretamente apontada para ela, e alguns objetos adjacentes.

Corrigir essas tendências ‘amnésicas’, que são devidas a essas restrições de atenção, é uma das direções de pesquisa mais importantes em modelos de IA baseados em linguagem – não menos porque essa síndrome limita severamente a possibilidade de conversas multi-turno úteis e consistentes, e prejudica a utilidade dos LLMs em uma variedade de contextos críticos para a precisão, como medicina e direito.

Esmagando

Uma nova pesquisa da China† está propondo um método novo para fazer com que uma quantidade significativamente maior de texto caiba nos recursos limitados de uma GPU que executa um modelo de IA – com resultados que alcançam uma melhoria de compressão de 20x, enquanto retém 98% de precisão:

![Compressão de Cascata de Contexto (C3) reconstrói documentos longos com mais precisão do que métodos de compressão óptica, como o DeepSeek-OCR, mesmo quando reduzindo a entrada por até quarenta vezes. Em uma variedade de comprimentos de documentos e configurações de compressão, o novo método mantém a fidelidade quase perfeita, enquanto a abordagem óptica se degrada acentuadamente sob compressão mais alta. Fonte [ https://arxiv.org/pdf/2511.15244 ]](https://www.unite.ai/wp-content/uploads/2025/11/c3-tokens-per-page.jpg)

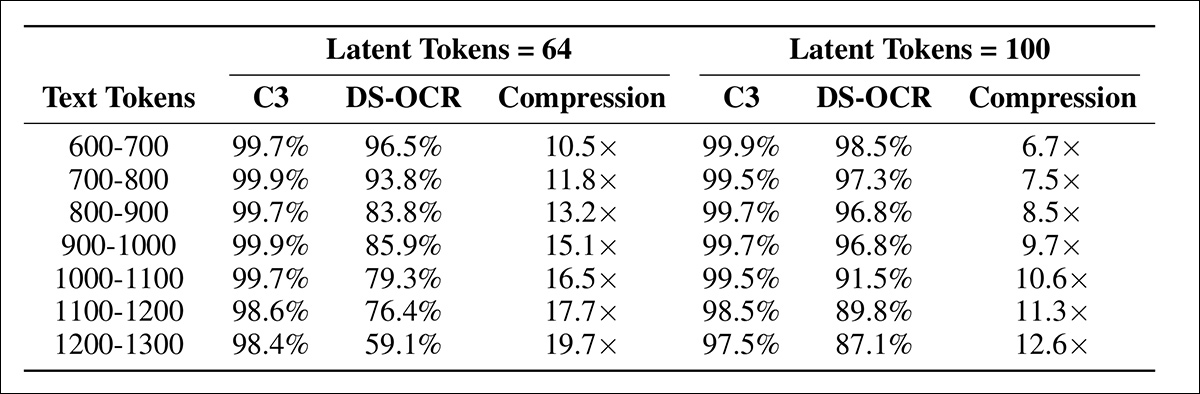

Compressão de Cascata de Contexto (C3) reconstrói documentos longos com mais precisão do que métodos de compressão óptica, como o DeepSeek-OCR, mesmo quando reduzindo a entrada por até quarenta vezes. Em uma variedade de comprimentos de documentos e configurações de compressão, o novo método mantém a fidelidade quase perfeita, enquanto a abordagem óptica se degrada acentuadamente sob compressão mais alta. Fonte

Com uma precisão de 93% – que está dentro dos parâmetros trabalháveis – a compressão de texto pode até alcançar uma razão de compressão de 40x:

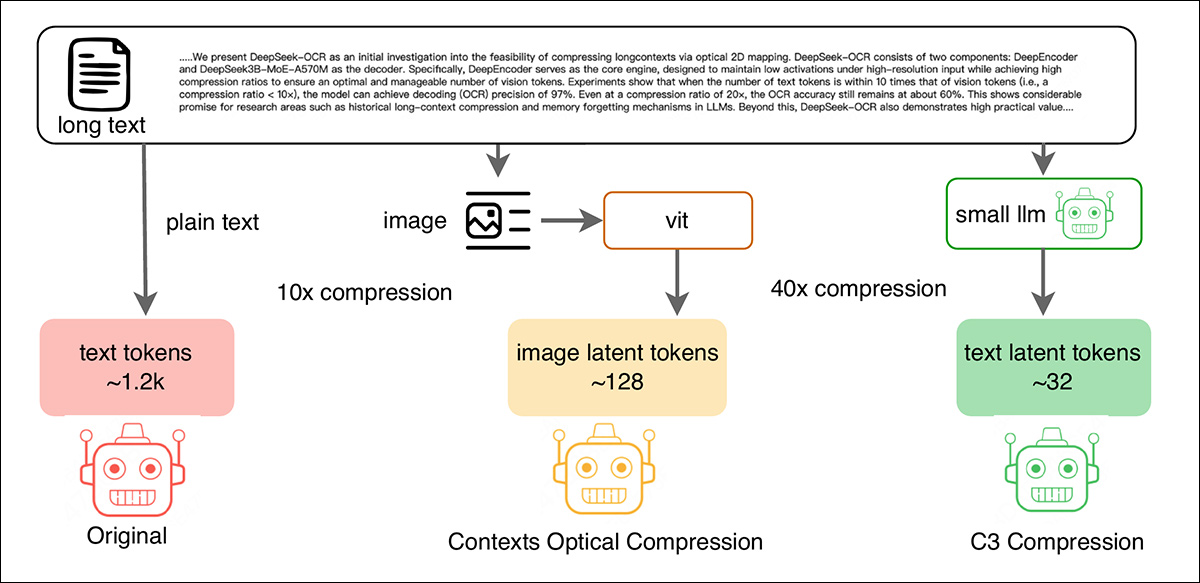

Três abordagens para comprimir texto longo para entrada de modelo de linguagem: o método de base (esquerda) tokeniza o texto diretamente, produzindo uma grande contagem de tokens; a rota óptica (centro) converte o texto em uma imagem e extrai embeddings visuais usando um Vision Transformer, alcançando uma compressão de 10x; e o novo método C3 (direita) usa um pequeno modelo de linguagem para comprimir o texto em apenas 32 tokens latentes, obtendo uma compressão de 40x sem depender de codificações visuais.

Isso significa que a totalidade de uma conversa muito longa pode ser comprimida e reinjetada (atualizada) em intervalos nas trocas como informações de contexto de fundo, mais tarde na conversa – quando o LLM normalmente estaria esquecendo fatos anteriores e escorregando para o comportamento ‘amnésico’.

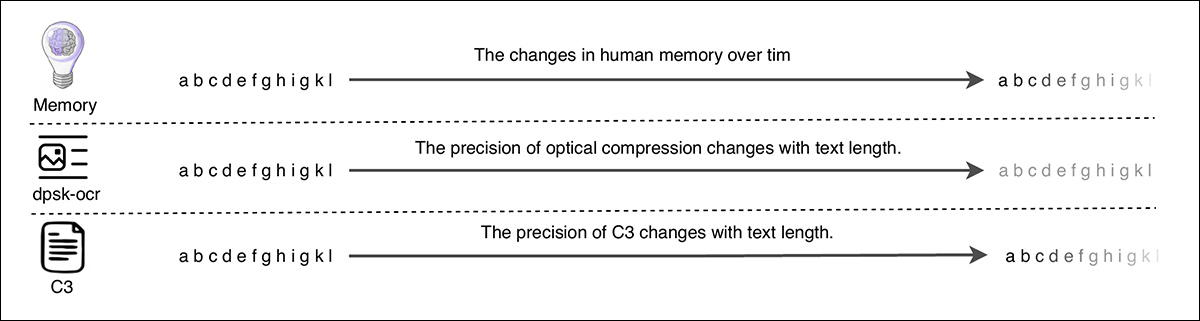

Embora isso seja um método de compressão com perda, mesmo a forma como a perda ocorre é útil: sob o novo método, a memória se degrada no fim de uma sentença, e não uniformemente em toda a sentença, como no arquiteto DeepSeek-OCR que inspirou a nova abordagem; de fato, os pesquisadores por trás do novo artigo sugerem que seu método se degrada da mesma forma que a memória humana real, e não aleatoriamente:

Topo, a memória humana se degrada no final do fluxo de dados; meio: DeepSeek-OCR se degrada aleatoriamente, deixando nenhum ancoradouro que pudesse ajudar a corrigir o problema; fundo: o novo método se degrada da mesma forma que a memória humana, em direção ao término do fluxo de dados, oferecendo marcadores que podem ajudar a melhorar a precisão por meio de processamento pós-fato.

Isso significa que é possível prever onde os dados memorizados podem ser menos confiáveis, e usar esse conhecimento para abordar o problema – potencialmente oferecendo uma melhoria maciça na lembrança conversacional e coerência, com 100% de precisão após remediação.

A nova abordagem é chamada de Compressão de Cascata de Contexto (C3), e é inspirada na forma como o DeepSeek-OCR comprime texto como imagens, alcançando grandes níveis de compressão. No entanto, usando dois (médio e grande) modelos de linguagem para processar texto longo diretamente para representações latentes, a nova abordagem elimina o arrasto causado pelo uso de imagens rasterizadas, alcançando assim o desempenho melhorado.

O artigo afirma:

‘O desempenho superior do C3 pode ser atribuído ao seu design arquitetônico fundamental. A análise DeepSeek-OCR hipotetiza que seu declínio de desempenho é devido a fatores como “layout complexo” e “borramento de imagem em resoluções mais baixas” – limitações inerentes à via óptica.

‘Nosso paradigma C3, operando diretamente no domínio textual, é completamente imune a esses artefatos do domínio visual. Ele evita a perda de informação associada à renderização de texto para pixels e, em seguida, codificando esses pixels. Em vez disso, ele aproveita a compreensão semântica poderosa de um LLM pré-treinado para destilar informações textuais diretamente em uma representação latente eficiente.’

O novo artigo é intitulado Compressão de Cascata de Contexto: Explorando os Limites Superiores da Compressão de Texto, e vem de dois autores†, que parecem* também estar oferecendo o C3 como um repositório de código aberto no GitHub.

Método

Para entender a nova abordagem, é útil saber o que é reconhecimento óptico de caracteres (OCR), porque é daí que surge a ideia toda.

OCR é um método algorítmico que remonta aos anos 1920, embora tenha sido popularizado nos anos 1990, onde a detecção de padrões permite que um programa de computador transforme texto raster (ou seja, texto dentro de imagens, que não pode ser selecionado e que existe apenas como conteúdo fotográfico) em texto editável.

Os criadores do DeepSeek-OCR descobriram que o texto poderia ser comprimido muito mais do que as pipelines padrão usando o OCR como uma etapa intermediária. Em outras palavras, em vez de comprimir o texto em si, era possível alcançar uma densidade maior de representações latentes (ou seja, mais informações salvas) comprimindo uma versão rasterizada do texto:

![Do artigo de lançamento do DeepSeekOCR, um esquema para a pipeline de compressão, incluindo patches rasterizados de 16x16 como o componente OCR. Fonte [ https://arxiv.org/pdf/2510.18234 ]](https://www.unite.ai/wp-content/uploads/2025/11/deepseekocr.jpg)

Do artigo de lançamento do DeepSeekOCR, um esquema para a pipeline de compressão, incluindo patches rasterizados de 16×16 como o componente OCR. Fonte

O novo artigo sugere que as abordagens ópticas, como o DeepSeek-OCR, podem estar atribuindo erroneamente a fonte de seus ganhos de compressão. Em vez de a mudança de texto para imagem ser o fator principal, os autores sugerem que o benefício-chave vem da conversão de tokens de texto verbosos em representações latentes mais eficientes.

Para testar isso, eles criaram uma pipeline que aproveita dois modelos de linguagem: o menor Qwen2.5 1.5B, que funciona como o codificador, comprimindo passagens longas em um pequeno conjunto de tokens latentes; e o maior Qwen2.5 3B, que funciona como o decodificador, reconstruindo o texto original a partir desses tokens:

No novo sistema C3, o modelo Qwen2.5 1.5B menor comprime uma entrada longa em um conjunto fixo de tokens latentes, usando embeddings de consulta treináveis. Esses tokens, juntamente com um prompt, são passados para o modelo Qwen2.5 3B maior, que reconstrói o texto original. Essa arquitetura permite a lembrança de alta fidelidade de sequências longas usando apenas uma fração da contagem de tokens original.

Para lidar com a etapa de compressão, os pesquisadores adaptaram o modelo Qwen2.5 1.5B pré-treinado introduzindo embeddings de consulta treináveis: prompts abstratos que guiam o modelo na destilação do contexto de entrada longo em uma representação latente muito menor.

Em vez de modificar a arquitetura, o método simplesmente alimenta o texto longo e os embeddings de consulta juntos como uma entrada única. O mecanismo de autoatenção do modelo trata esses elementos de forma idêntica, permitindo que ele produza uma representação latente de comprimento fixo sem precisar de novas camadas ou alterações de design; e essa saída é então passada para o modelo maior para reconstrução.

Para avaliar quanto informações sobreviveram à compressão, os pesquisadores instruíram o decodificador Qwen2.5 3B a reconstruir a entrada original usando apenas os tokens latentes e o prompt ‘repita o texto’. Como a tarefa envolvia reprodução exata, em vez de resumo ou paráfrase, qualquer desvio do original poderia ser diretamente rastreado à informação perdida na compressão, oferecendo um teste limpo e objetivo da fidelidade em toda a pipeline de codificação-decodificação.

Dados e Testes

O artigo afirma que os autores compilaram um conjunto de dados original de material OCR, totalizando um milhão de páginas obtidas da internet. Nenhum detalhe adicional é aparente sobre essa fonte, e os autores parecem ser deliberadamente vagos sobre esse ponto.

No entanto, eles observam que a engenharia de dados e a curadoria não foram necessárias para seus propósitos, e que eles conseguiram treinar seu modelo de forma eficaz em amostras de ‘comprimento diverso’; e eles afirmam que isso indica que sua arquitetura é resiliente (e, por inferência, bem generalizada, dependendo das configurações de treinamento).

O modelo foi treinado em um cluster de alto desempenho consistindo em oito GPUs NVIDIA H800, cada uma equipada com 80GB de VRAM, para um total de recursos de VRAM de 640GB. Cada GPU acomodou um tamanho de lote de 2, obtendo um tamanho de lote global de 256, considerando os 16 passos de acumulação agendados. O otimizador foi AdamW, ao longo de um total de 40.000 passos.

Para testar a eficácia da arquitetura C3, os pesquisadores seguiram a mesma configuração de avaliação usada no artigo original do DeepSeek-OCR, usando o benchmark Fox para medir a compressão e a precisão de reconstrução em uma variedade de comprimentos de documentos.

Textos em inglês foram selecionados, com passagens variando de 600 a 1300 tokens, com tokenização realizada usando o tokenizador Qwen.

Para permitir uma comparação justa, níveis equivalentes de compressão do (DeepSeek-OCR) baseline óptico foram usados, com 64 e 100 tokens latentes. Para explorar os limites do método, testes adicionais foram realizados usando apenas 32 tokens latentes. Em todos os casos, a reconstrução foi iniciada com a instrução ‘repita o texto:’:

Resultados do teste inicial. A precisão de reconstrução e as razões de compressão foram medidas em sete faixas de tokens usando 64 e 100 tokens latentes, mostrando um desempenho consistente do C3 sobre o DeepSeek-OCR, especialmente em níveis mais altos de compressão.

Discutindo os resultados iniciais visualizados acima, o artigo afirma:

‘Os dados demonstram inequivocamente que o paradigma C3 de compressão direta de texto para latente supera significativamente a abordagem de compressão óptica em todas as condições testadas, estabelecendo um novo estado da arte na compressão de contexto de alta fidelidade.’

Quando ambos os sistemas foram testados em documentos mais longos, o DeepSeek-OCR começou a perder precisão à medida que a compressão aumentava, caindo abaixo de 60% no caso mais extremo. O C3 lidou com o mesmo nível de compressão com muito menos perda, mantendo-se próximo a 98%, mesmo quando a entrada foi reduzida para um vigésimo do seu tamanho original.

No teste mais exigente, textos inteiros foram reduzidos a apenas 32 tokens. Mesmo assim, o modelo conseguiu recuperar quase todo o conteúdo original, mantendo a precisão próxima a 99% em muitos casos:

Precisão de reconstrução e razões de compressão em 32 tokens latentes, mostrando que, mesmo em reduções extremas (até quase 40x), a precisão permanece acima de 93%.

Na configuração mais extrema, onde a entrada foi comprimida para quase um quarentavo do seu tamanho, ainda assim se lembrava de mais de 93%. Em comparação, métodos ópticos anteriores caíram para cerca de 60% de precisão em metade desse nível de compressão.

Os autores afirmam††:

‘Esses achados demonstram conclusivamente a vantagem da arquitetura C3. Ao evitar os gargalos de informação e os artefatos potenciais inerentes à modalidade visual (por exemplo, limites de resolução de imagem, complexidade de layout), nosso método lida com a compressão extrema com perda mínima de informação.

‘Os resultados desse caso de teste agressivo solidificam nossa afirmação de que a compressão direta de texto para latente é um paradigma fundamentalmente mais eficiente e poderoso do que seus equivalentes ópticos.’

Eles também concluem que o C3 pode ‘desbloquear novas capacidades no processamento de livros inteiros, documentos legais extensos ou grandes bases de código para tarefas como resposta a perguntas, resumo e análise’.

Conclusão

Este é um dos artigos mais claros e acessíveis que encontrei recentemente, com uma ideia central comendavelmente clara que pode provar ser, pelo menos, uma linha adicional de ataque contra o ‘problema da janela de contexto’.

Muitos usuários de LLMs terão aprendido por agora a ‘refrescar’ informações cruciais ou diretrizes periodicamente ao longo de uma troca longa, tendo descoberto por experiência própria que os likes do ChatGPT não podem reter essa informação por muito tempo. Seguindo essa solução rápida intuitiva, a ideia em questão no novo artigo é que uma versão altamente comprimida de uma conversa longa poderia ser reinjetada em intervalos na janela de contexto do atual LLM, essencialmente ‘lembrando por procuração’.

Em um clima em que a escassez de GPU está levando a um aumento de preços mesmo na memória de computador tradicional (como a DRAM, onde muitas cargas de trabalho de GPU agora estão sendo descarregadas para suportar modelos maiores), parece improvável que o hardware de IA se tornará significativamente mais capaz no futuro próximo; portanto, abordagens inovadoras como essa, que são quase uma rerun nostálgica da evolução da compressão de arquivos dos anos 1990, podem provar ser necessárias para impulsionar o desempenho para a frente.

Mais importante ainda, seria simplesmente ótimo se os LLMs pudessem manter uma conversa coerente por uma hora ou mais e realmente se lembrar do que a conversa era sobre, para começar.

* As instruções de instalação do CLI são fornecidas, mas não tenho tempo para tentar uma instalação, e não tenho certeza de que o repositório está completo.

† Os dois autores são citados como Fanfan Liu e Haibo Qiu. Até onde a pesquisa casual indica, Qiu é atualmente um pesquisador na empresa de tecnologia chinesa Meituan, e Liu é um estudante de mestrado na Academia de Ciências da China. Nenhum deles tem o artigo em questão listado em suas histórias. Se alguma dessas atribuições estiver incorreta, por favor, entre em contato comigo por meio do meu perfil.

†† Embora os autores sigam a fórmula, fornecendo testes qualitativos adicionais, esses são menos esclarecedores em comparação com a primeira rodada de testes de compressão, e não os cobri aqui.

Publicado pela primeira vez na sexta-feira, 21 de novembro de 2025