Inteligência artificial

Orientação de Auto-Atenção: Melhorando a Qualidade da Amostra de Modelos de Difusão

Os Modelos de Difusão de Desruído são estruturas de inteligência artificial generativa que sintetizam imagens a partir do ruído por meio de um processo de desruído iterativo. Eles são celebrados por suas capacidades excepcionais de geração de imagens e diversidade, em grande parte atribuídas a métodos de orientação condicionais por texto ou classe, incluindo orientação de classificador e orientação livre de classificador. Esses modelos têm sido notavelmente bem-sucedidos na criação de imagens diversificadas e de alta qualidade. Estudos recentes mostraram que técnicas de orientação, como legendas e rótulos de classe, desempenham um papel crucial na melhoria da qualidade das imagens geradas por esses modelos.

No entanto, os modelos de difusão e os métodos de orientação enfrentam limitações em certas condições externas. O método de Orientação Livre de Classificador (CFG), que usa a queda de rótulo, adiciona complexidade ao processo de treinamento, enquanto o método de Orientação de Classificador (CG) exige treinamento adicional de classificador. Ambos os métodos são um pouco limitados por sua dependência de condições externas difíceis de obter, limitando seu potencial e confinando-os a configurações condicionais.

Para abordar essas limitações, os desenvolvedores formularam uma abordagem mais geral para a orientação de difusão, conhecida como Orientação de Auto-Atenção (SAG). Esse método aproveita as informações das amostras intermediárias dos modelos de difusão para gerar imagens. Vamos explorar a SAG neste artigo, discutindo seu funcionamento, metodologia e resultados em comparação com os frameworks e pipelines atuais.

Orientação de Auto-Atenção: Melhorando a Qualidade da Amostra de Modelos de Difusão

Os Modelos de Difusão de Desruído (DDMs) ganharam popularidade por sua capacidade de criar imagens a partir do ruído por meio de um processo de desruído iterativo. A síntese de imagens desses modelos é em grande parte devida aos métodos de orientação de difusão empregados. Apesar de suas forças, os modelos de difusão e os métodos baseados em orientação enfrentam desafios como complexidade adicionada e custos computacionais aumentados.

Para superar as limitações atuais, os desenvolvedores introduziram o método de Orientação de Auto-Atenção, uma formulação mais geral de orientação de difusão que não depende de informações externas da orientação de difusão, facilitando assim uma abordagem condicional e flexível para guiar frameworks de difusão. A abordagem adotada pela Orientação de Auto-Atenção ajuda, em última análise, a melhorar a aplicabilidade dos métodos de orientação de difusão tradicionais para casos com ou sem requisitos externos.

A Orientação de Auto-Atenção é baseada no princípio simples de formulação geralizada e na suposição de que as informações internas contidas nas amostras intermediárias podem servir como orientação também. Com base nesse princípio, o método SAG primeiro introduz a Orientação de Desfoque, uma solução simples e direta para melhorar a qualidade da amostra. A orientação de desfoque visa explorar as propriedades benignas do desfoque gaussiano para remover detalhes de escala fina naturalmente, guiando as amostras intermediárias usando as informações eliminadas como resultado do desfoque gaussiano. Embora o método de orientação de desfoque melhore a qualidade da amostra com uma escala de orientação moderada, ele falha em replicar os resultados em uma grande escala de orientação, pois frequentemente introduz ambiguidade estrutural em regiões inteiras. Como resultado, o método de orientação de desfoque tem dificuldade em alinhar a previsão da entrada original com a previsão da entrada degradada. Para melhorar a estabilidade e a eficácia do método de orientação de desfoque em uma escala de orientação maior, a Orientação de Auto-Atenção tenta explorar o mecanismo de auto-atenção dos modelos de difusão, pois os modelos de difusão modernos já contêm um mecanismo de auto-atenção dentro de sua arquitetura.

Com a suposição de que a auto-atenção é essencial para capturar informações salientes em seu núcleo, o método de Orientação de Auto-Atenção usa mapas de auto-atenção dos modelos de difusão para desfocar adversariamente as regiões que contêm informações salientes e, no processo, guia os modelos de difusão com as informações residuais necessárias. O método então aproveita os mapas de atenção durante o processo reverso dos modelos de difusão para melhorar a qualidade das imagens e usa a auto-condicionação para reduzir os artefatos sem exigir treinamento ou informações adicionais.

Para resumir, o método de Orientação de Auto-Atenção

- É uma abordagem nova que usa mapas de auto-atenção internos de frameworks de difusão para melhorar a qualidade da imagem da amostra gerada sem exigir treinamento ou confiar em condições externas.

- O método SAG tenta generalizar métodos de orientação condicionais em um método condicional que pode ser integrado a qualquer modelo de difusão sem exigir recursos ou condições externas adicionais, melhorando assim a aplicabilidade dos frameworks baseados em orientação.

- O método SAG também tenta demonstrar suas habilidades ortogonais em relação a métodos e frameworks condicionais existentes, facilitando assim um aumento no desempenho por meio da integração flexível com outros métodos e modelos.

Em seguida, o método de Orientação de Auto-Atenção aprende com as descobertas de frameworks relacionados, incluindo Modelos de Difusão de Desruído, Orientação de Amostragem, Métodos de Auto-Atenção em Inteligência Artificial Generativa e Representações Internas de Modelos de Difusão. No entanto, em seu núcleo, o método de Orientação de Auto-Atenção implementa as descobertas de DDPM ou Modelos de Difusão de Desruído Probabilísticos, Orientação de Classificador, Orientação Livre de Classificador e Auto-Atenção em Frameworks de Difusão. Vamos falar sobre eles em detalhes na seção seguinte.

Orientação de Auto-Atenção: Preliminares, Metodologia e Arquitetura

Modelo de Difusão de Desruído Probabilístico ou DDPM

DDPM ou Modelo de Difusão de Desruído Probabilístico é um modelo que usa um processo de desruído iterativo para recuperar uma imagem a partir de ruído branco. Tradicionalmente, um modelo DDPM recebe uma imagem de entrada e um cronograma de variância em um passo de tempo para obter a imagem usando um processo direto conhecido como processo markoviano.

Orientação de Classificador e Orientação Livre de Classificador com Implementação de GAN

GAN ou Redes Adversárias Generativas possuem uma troca única de diversidade para fidelidade, e para trazer essa capacidade de frameworks de GAN para modelos de difusão, o framework de Orientação de Auto-Atenção propõe usar um método de orientação de classificador que usa um classificador adicional. Por outro lado, um método de orientação livre de classificador também pode ser implementado sem o uso de um classificador adicional para alcançar os mesmos resultados. Embora o método entregue os resultados desejados, ele ainda não é viável computacionalmente, pois exige rótulos adicionais e confina o framework a modelos de difusão condicionais que exigem condições adicionais, como um texto ou uma classe, juntamente com detalhes de treinamento adicionais que adicionam complexidade ao modelo.

Generalizando a Orientação de Difusão

Embora os métodos de Orientação de Classificador e Orientação Livre de Classificador entreguem os resultados desejados e ajudem na geração condicional em modelos de difusão, eles dependem de entradas adicionais. Para qualquer passo de tempo dado, a entrada para um modelo de difusão consiste em uma condição generalizada e uma amostra perturbada sem a condição generalizada. Além disso, a condição generalizada abrange informações internas dentro da amostra perturbada ou uma condição externa, ou ambos. A orientação resultante é formulada com a utilização de um regressor imaginário com a suposição de que ele pode prever a condição generalizada.

Melhorando a Qualidade da Imagem usando Mapas de Auto-Atenção

A Orientação de Difusão Generalizada implica que é viável fornecer orientação ao processo reverso dos modelos de difusão, extrair informações salientes na condição generalizada contida na amostra perturbada. Com base nisso, o método de Orientação de Auto-Atenção captura as informações salientes para processos reversos de forma eficaz, limitando os riscos que surgem como resultado de problemas de distribuição fora do conjunto de treinamento em modelos de difusão pré-treinados.

Orientação de Desfoque

A orientação de desfoque na Orientação de Auto-Atenção é baseada no desfoque gaussiano, um método de filtragem linear no qual o sinal de entrada é convolvido com um filtro gaussiano para gerar uma saída. Com o aumento do desvio padrão, o desfoque gaussiano reduz os detalhes de escala fina dentro dos sinais de entrada, resultando em sinais de entrada localmente indistinguíveis, suavizando-os em direção a uma constante. Além disso, experimentos indicaram um desequilíbrio de informações entre o sinal de entrada e a saída do sinal de desfoque gaussiano, onde a saída do sinal contém mais informações de escala fina.

Com base nessa descoberta, o framework de Orientação de Auto-Atenção introduz a orientação de desfoque, uma técnica que intencionalmente exclui as informações das reconstruções intermediárias durante o processo de difusão e, em vez disso, usa essas informações para guiar suas previsões em direção ao aumento da relevância das imagens para as informações de entrada. A orientação de desfoque essencialmente faz com que a previsão original se desvie mais da previsão da entrada desfocada. Além disso, a propriedade benigna no desfoque gaussiano impede que as saídas do sinal se desviem significativamente do sinal original com uma desviação moderada. Em palavras simples, o desfoque ocorre naturalmente nas imagens, o que torna o desfoque gaussiano um método mais adequado para ser aplicado a modelos de difusão pré-treinados.

No pipeline de Orientação de Auto-Atenção, o sinal de entrada é primeiro desfocado usando um filtro gaussiano e, em seguida, difundido com ruído adicional para produzir o sinal de saída. Ao fazer isso, o pipeline de SAG mitiga o efeito colateral do desfoque resultante que reduz o ruído gaussiano e faz com que a orientação dependa do conteúdo em vez de depender do ruído aleatório. Embora a orientação de desfoque entregue resultados satisfatórios em frameworks com escala de orientação moderada, ela falha em replicar os resultados em modelos existentes com uma grande escala de orientação, pois se torna propensa a produzir resultados ruins, como demonstrado na imagem a seguir.

Esses resultados podem ser resultado da ambiguidade estrutural introduzida no framework pelo desfoque global, o que torna difícil para o pipeline de SAG alinhar as previsões da entrada original com a entrada degradada, resultando em saídas ruins.

Mecanismo de Auto-Atenção

Como mencionado anteriormente, os modelos de difusão geralmente têm um componente de auto-atenção incorporado, e é um dos componentes mais essenciais em um framework de modelo de difusão. O mecanismo de auto-atenção é implementado no núcleo dos modelos de difusão e permite que o modelo preste atenção às partes salientes da entrada durante o processo gerativo, como demonstrado na imagem a seguir com máscaras de frequência alta na linha superior e máscaras de auto-atenção na linha inferior das imagens finalmente geradas.

O método de Orientação de Auto-Atenção proposto se baseia no mesmo princípio e aproveita as capacidades dos mapas de auto-atenção nos modelos de difusão. Em geral, o método de Orientação de Auto-Atenção desfoca as partes auto-atendidas no sinal de entrada ou, em palavras simples, oculta as informações das partes que são atendidas pelos modelos de difusão. Além disso, os sinais de saída na Orientação de Auto-Atenção contêm regiões intactas dos sinais de entrada, o que significa que não resulta em ambiguidade estrutural das entradas e resolve o problema do desfoque global. O pipeline então obtém os mapas de auto-atenção agregados realizando uma operação de pooling de média global (GAP) para agregar os mapas de auto-atenção para a dimensão e amostragem de nearest-neighbor para corresponder à resolução do sinal de entrada.

Orientação de Auto-Atenção: Experimentos e Resultados

Para avaliar seu desempenho, o pipeline de Orientação de Auto-Atenção é amostrado usando 8 GPUs Nvidia GeForce RTX 3090 e é construído sobre frameworks pré-treinados de IDDPM, ADM e Difusão Estável.

Geração Incondicional com Orientação de Auto-Atenção

Para medir a eficácia do pipeline de SAG em modelos incondicionais e demonstrar a propriedade condicional livre não possuída pela Orientação de Classificador e pela abordagem de Orientação Livre de Classificador, o pipeline de SAG é executado em frameworks pré-treinados incondicionalmente em 50 mil amostras.

Como pode ser observado, a implementação do pipeline de SAG melhora as métricas FID, sFID e IS da entrada incondicional, enquanto reduz o valor de recall ao mesmo tempo. Além disso, as melhorias qualitativas resultantes da implementação do pipeline de SAG são evidentes nas imagens a seguir, onde as imagens no topo são resultados dos frameworks de ADM e Difusão Estável, enquanto as imagens na parte inferior são resultados dos frameworks de ADM e Difusão Estável com o pipeline de SAG.

Geração Condicional com SAG

A integração do pipeline de SAG em frameworks existentes entrega resultados excepcionais na geração incondicional, e o pipeline de SAG é capaz de agnosticidade de condição, o que permite que o pipeline de SAG seja implementado para geração condicional também.

Difusão Estável com Orientação de Auto-Atenção

Embora o framework de Difusão Estável original gere imagens de alta qualidade, integrar o framework de Difusão Estável com o pipeline de Orientação de Auto-Atenção pode melhorar os resultados drasticamente. Para avaliar seu efeito, os desenvolvedores usam prompts vazios para Difusão Estável com sementes aleatórias para cada par de imagens e usam avaliação humana em 500 pares de imagens com e sem Orientação de Auto-Atenção. Os resultados são demonstrados na imagem a seguir.

Além disso, a implementação do SAG pode melhorar as capacidades do framework de Difusão Estável, pois fundir a Orientação Livre de Classificador com a Orientação de Auto-Atenção pode ampliar o alcance dos modelos de Difusão Estável para síntese de imagem de texto. Além disso, as imagens geradas pelo modelo de Difusão Estável com Orientação de Auto-Atenção são de maior qualidade com menos artefatos, graças ao efeito de auto-condicionamento do pipeline de SAG, como demonstrado na imagem a seguir.

Limitações Atuais

Embora a implementação do pipeline de Orientação de Auto-Atenção possa melhorar substancialmente a qualidade das imagens geradas, ele tem algumas limitações.

Uma das principais limitações é a ortogonalidade com a Orientação de Classificador e a Orientação Livre de Classificador. Como pode ser observado na imagem a seguir, a implementação do SAG melhora a pontuação FID e a pontuação de previsão, o que significa que o pipeline de SAG contém um componente ortogonal que pode ser usado com métodos de orientação tradicionais simultaneamente.

No entanto, ele ainda exige que os modelos de difusão sejam treinados de uma maneira específica, o que adiciona complexidade e custos computacionais.

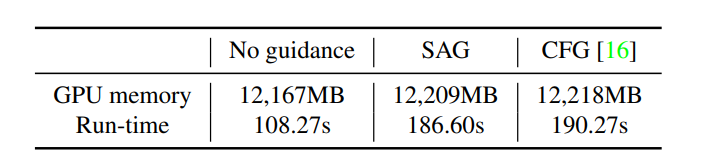

Além disso, a implementação da Orientação de Auto-Atenção não aumenta o consumo de memória ou tempo, uma indicação de que o overhead resultante das operações como mascaramento e desfoque no SAG é negligenciável. No entanto, ele ainda adiciona aos custos computacionais, pois inclui um passo adicional em comparação com abordagens sem orientação.

Pensamentos Finais

Neste artigo, falamos sobre a Orientação de Auto-Atenção, uma formulação nova e geral de método de orientação que usa informações internas disponíveis dentro dos modelos de difusão para gerar imagens de alta qualidade. A Orientação de Auto-Atenção é baseada no princípio simples de formulação geralizada e na suposição de que as informações internas contidas nas amostras intermediárias podem servir como orientação também. O pipeline de Orientação de Auto-Atenção é uma abordagem condicional e de treinamento livre que pode ser implementada em vários modelos de difusão e usa a auto-condicionação para reduzir os artefatos nas imagens geradas e melhorar a qualidade geral.