Ângulo de Anderson

Transmissão de Avatares de IA como em 1999

Pesquisa nova apresenta uma maneira de transmitir avatares 3D realistas que aparecem quase instantaneamente e se aprimoram em tempo real, em vez de forçar os usuários a esperar por downloads massivos para serem concluídos.

Em muitos aspectos, as enormes demandas de recursos de IA geradora e sistemas de renderização assistidos por IA levaram a prontidão do consumidor de volta vinte ou mais anos. Apenas em 2023, uma alocação de 64GB de RAM em um laptop ou PC de mesa parecia excessiva; agora, com o crescimento da popularidade de RAM e/ou descarga de CPU, 64GB é modesto para necessidades locais de IA; e esses elementos banais e acessíveis de PCs continuam a disparar em preço à medida que as corporações lutam para atender à demanda por serviços de IA.

A escala e a ganância de IA e seus processos e ambientes geralmente superam o hardware de nível de consumidor, e até mesmo executar modelos “reduzidos” locais como versões GGUF geralmente sobrecarregam o sistema médio.

Mesmo serviços de IA baseados em texto, como ChatGPT, estão sujeitos a uma tensão significativa tanto no nível do cliente quanto do servidor. Portanto, uma vez que a IA é encarregada de fornecer experiências de multimídia online em tempo real, podemos razoavelmente esperar alguns compromissos muito sérios em latência e/ou qualidade – semelhantes às lutas iniciais da internet com a transmissão de mídia, e os ícones de “buffering” animados muito odiados do RealPlayer e QuickTime.

A última vez que problemas de multimídia e rede criaram fricção na experiência do usuário, o hardware de nível de consumidor ainda estava evoluindo por meio da Lei de Moore, melhorando quase exponencialmente a cada ano, mesmo enquanto os sistemas operacionais, redes e outras infraestruturas de suporte evoluíam para atender à demanda; e nos últimos dez anos, mais ou menos, as capacidades da tecnologia de consumidor excederam as demandas de multimídia (talvez até o ponto em que a renovação precisou ser impulsionada para manter as vendas).

Mas esse excedente de capacidade local pode estar chegando ao fim em breve, à medida que o hardware local se torna de especificações mais baixas e mais caro, e à medida que os serviços baseados em IA exigem mais recursos de servidor e locais.

Obtendo uma Vantagem

Voltando à era pré-banda larga, mesmo antes do início da transmissão de vídeo usável, os usuários da web estavam acostumados a imagens que se tornavam lentamente nítidas, à medida que JPEGs progressivos permitiam que o usuário com largura de banda limitada observasse a imagem sendo carregada, às vezes painosamente devagar, à medida que mais dados da imagem eram carregados localmente.

Agora, parece que podemos estar prestes a ter uma experiência semelhante com avatares Gaussian Splat auxiliados por IA:

Clique para reproduzir. Do novo projeto ProgressiveAvatars, uma comparação de avatares Gaussianos em transmissão. Fonte

Acima, vemos duas versões de um avatar Gaussian Splat (GSplat) – uma representação humana habilitada parcialmente por uma técnica de renderização não IA que remonta ao início dos anos 90, e também por métodos mais modernos, como o modelo paramétrico de humano FLAME e abordagens de treinamento baseadas em IA:

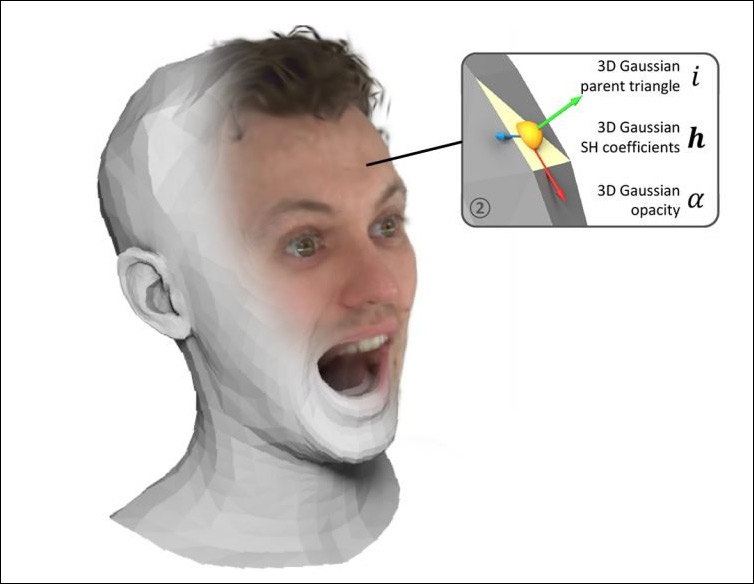

Gaussian Splatting usa uma representação gaussiana de cor e informações 3D no lugar de um pixel ou voxel, e mapeia essa textura ultrarrealista em uma malha CGI mais tradicional, que por sua vez é facilitada por um ‘humano paramétrico’, uma face e/ou corpo CGI, em sistemas como FLAME e STAR. Fonte

Na esquerda no vídeo acima, podemos ver que uma implementação tradicional de um avatar Gaussian splat parece fairly horrível enquanto esperamos que os dados sejam carregados. Na direita, uma nova implementação da China, chamada ProgressiveAvatars, consegue resolver de forma muito mais elegante à medida que os dados são carregados, apresentando uma imagem humana não alarmante desde o início.

Os autores afirmam que seu método é o primeiro a realmente ‘transmitir’ um avatar Gaussian, e certamente o primeiro a fazê-lo de forma progressiva, onde a imagem se constrói elegantemente, e as áreas mais importantes – como olhos e lábios – podem ser priorizadas, para que o avatar possa se tornar conversacional mesmo quando apenas parcialmente carregado:

Clique para reproduzir. Do site do projeto ProgressiveAvatars, uma ilustração do carregamento atento à atenção.

Anteriormente, uma abordagem de “nível de detalhe” (LOD) foi usada em tentativas anteriores para reduzir os avatares “GSplat”, semelhante às otimizações de jogos de vídeo, onde versões sucessivamente mais detalhadas de uma pessoa são carregadas de acordo com se ocupam suficiente da janela de visualização ou atenção do visualizador para valer a pena o esforço.

Isso, é claro, envolve uma quantidade severa de avatares “sobressalentes” redundantes, e os autores enquadram sua abordagem como um sistema mais racional. Por implicação, um método desse tipo também permite que alterações sejam feitas em uma figura GSplat (ou seja, personalização) sem precisar propagar essas alterações por meio de uma cadeia de “gêmeos” LOD.

Um Domínio Emergente

Se isso parece um problema de nicho, bem, assim também era a transmissão de vídeo, nos dias em que obter os primeiros plugins para funcionar era tarefa do nerd mais próximo. Além disso, o potencial para representações baseadas em IA de transmissão vai além de avatares humanos, estendendo-se à geração de cidades, jogos e versões baseadas em 3D de praticamente qualquer domínio online – como Virtual Try-On, para compras de roupas:

Clique para reproduzir. De um projeto de 2024, uma visão geral do futuro da “try-on” online. Outros projetos buscam adicionar movimento e interatividade – facetas exigentes para transmitir e gerenciar. Fonte

Assim como as abordagens baseadas em LOD foram até agora principalmente aproveitadas por jogos de vídeo, muitas outras considerações que eram exclusivamente da província do desenvolvimento de jogos provavelmente vão se infiltrar nas representações baseadas em splat. Por exemplo, a maioria dessas primeiras saídas GSplat retrata um humano único fazendo caretas e gestos, ou talvez conversando; mas muitas situações serão necessárias que apresentem vários humanos, bem como recursos ambientais e atmosfera – um cenário em que sistemas de “triagem” de alto desempenho determinarão onde os dados de transmissão precisam ser priorizados, para manter o visualizador no momento.

O novo artigo é intitulado ProgressiveAvatars: Avatares Gaussianos 3D Animáveis Progressivos, e vem de três pesquisadores da Universidade de Ciência e Tecnologia da China, em Hefei.

Método

A abordagem inicial aproveita vídeo de uma pessoa. Para cada quadro, um modelo de face paramétrico FLAME padrão é ajustado, para que a forma e a expressão mudem ao longo do tempo, enquanto a estrutura de malha subjacente permanece fixa. Como a topologia base não muda, um modelo FLAME estável pode ser reutilizado e aprimorado em vez de reconstruído do zero a cada momento, como acontece em trabalhos anteriores semelhantes:

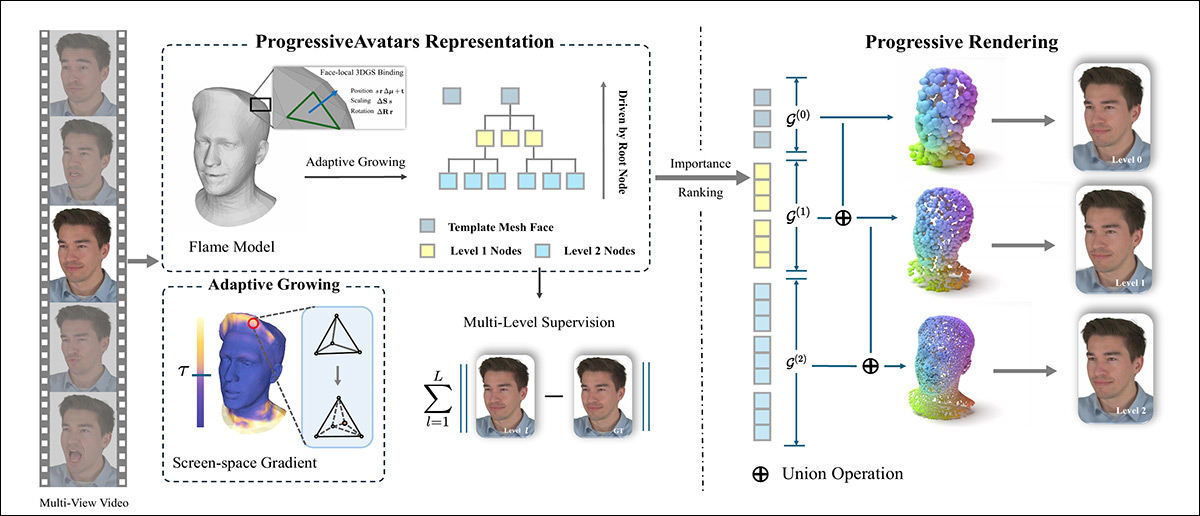

Vídeo de cabeça é primeiro ajustado com uma malha FLAME rastreada, após o que Gaussians 3D são anexados a cada face e crescem hierarquicamente onde os gradientes do espaço da tela indicam detalhe ausente. Durante o treinamento, essa subdivisão adaptativa constrói uma representação de vários níveis sob supervisão de várias vistas, e na inferência, pontuações de importância por face determinam quais Gaussians são transmitidos primeiro, permitindo que o avatar apareça rapidamente e se aprimore progressivamente à medida que níveis de detalhe mais altos são adicionados.

Sobre essa estrutura base, detalhes são adicionados em camadas; a superfície é implicitamente subdividida em uma hierarquia, e pequenos Gaussians tridimensionais são anexados às faces em cada nível de detalhe.

Embora as camadas iniciais mais grossas capturem a forma geral da cabeça e o movimento, as camadas subsequentes mais finas fornecem rugas, deformações sutis e textura de alta frequência. Imagens são então renderizadas a partir desses Gaussians usando um rasterizador Gaussian diferenciável e treinado contra imagens de referência de várias vistas, para que o avatar aprenda a reproduzir a aparência da pessoa real.

Durante o treinamento, essa hierarquia cresce automaticamente: regiões que precisam de mais detalhe são subdivididas ainda mais, guiadas por sinais do espaço da tela, para que o esforço computacional se concentre onde o olho do visualizador é mais provável de notar erros.

Durante a inferência, essa mesma hierarquia permite transmissão progressiva, onde uma versão aproximada de um avatar pode ser exibida primeiro, e, à medida que camadas adicionais são carregadas, novos Gaussians podem ser adicionados sem alterar o que já é exibido, permitindo um avatar de cabeça animável que aparece rapidamente e se torna mais nítido e detalhado à medida que mais dados chegam.

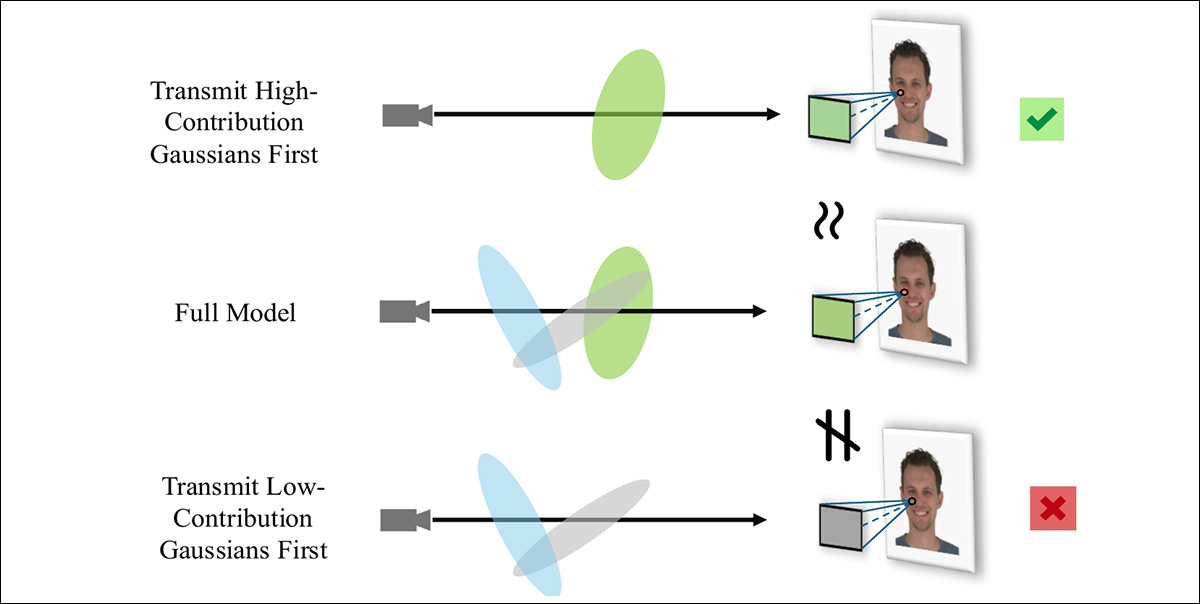

Os autores observam que o sistema inteiro depende da priorização dos dados de entrada:

Quando todos os Gaussians em um determinado nível estão disponíveis, o modelo completo é renderizado com fidelidade máxima; mas durante a transmissão, enviar os Gaussians de maior contribuição primeiro permite que os resultados parciais iniciais sejam muito semelhantes à imagem final, enquanto transmitir Gaussians de baixa contribuição primeiro distorce o equilíbrio de cores e enfatiza componentes menores.

Dados e Testes

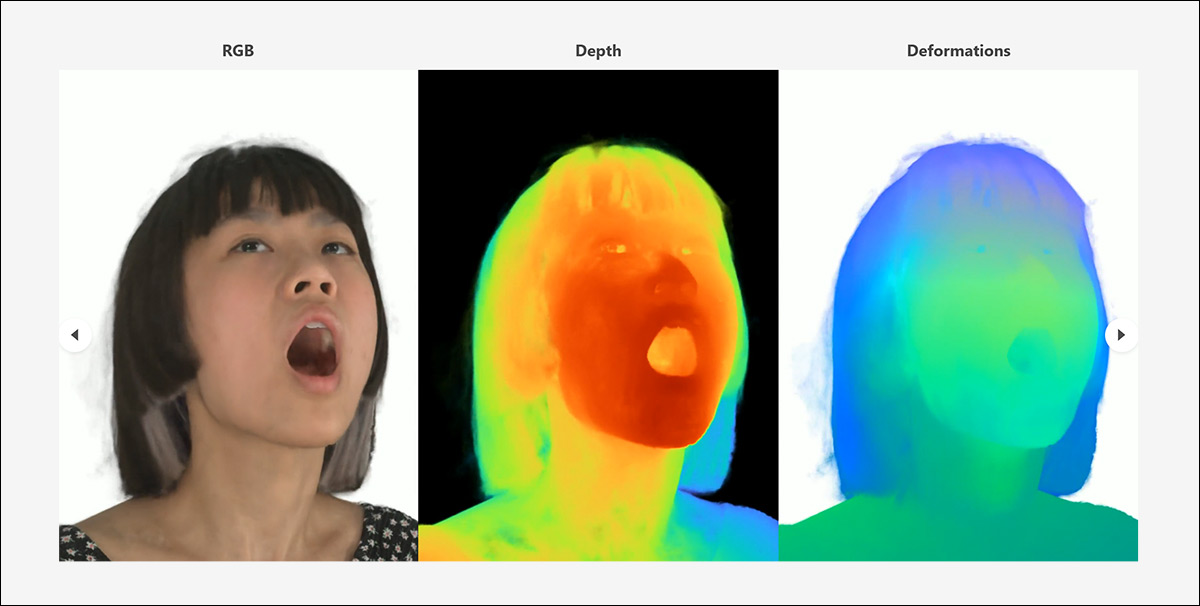

Para testes, o novo método foi avaliado no conjunto de dados NeRSemble, que consiste em vídeos de várias vistas para cada sujeito coberto, com parâmetros calibrados em todas as vistas:

Exemplos de interpretações diversas de sujeitos incluídos no conjunto de dados NeRSemble usado nos testes para ProgressiveAvatars. Fonte

Em linha com a metodologia original GaussianAvatars, as imagens foram reduzidas para 802x550px, uma máscara de primeiro plano foi gerada, e a divisão de treinamento/teste original do projeto foi adotada.

O otimizador Adam foi usado para atualizações de parâmetros, com uma taxa de aprendizado de 1×10-2 em todas as coordenadas baricêntricas. O treinamento foi executado por 60.000 iterações, com a hierarquia automaticamente expandida a cada 2.000 iterações.

Inicialmente, os autores testaram a reconstrução e animação – a tarefa de converter vídeo plano em um sistema 3D-consciente (x/y/x), usando a representação CGI canônica do FLAME como a malha de ancoragem. Para isso, todas as linhas de base foram treinadas do zero, e os frameworks rivais testados foram os mencionados GaussianAvatars, e PointAvatar.

Para esses testes, as métricas usadas foram Taxa de Sinal-Ruído de Pico (PSNR), Índice de Semelhança Estrutural (SSIM), e Semelhança de Imagem de Patch Aprendida (LPIPS):

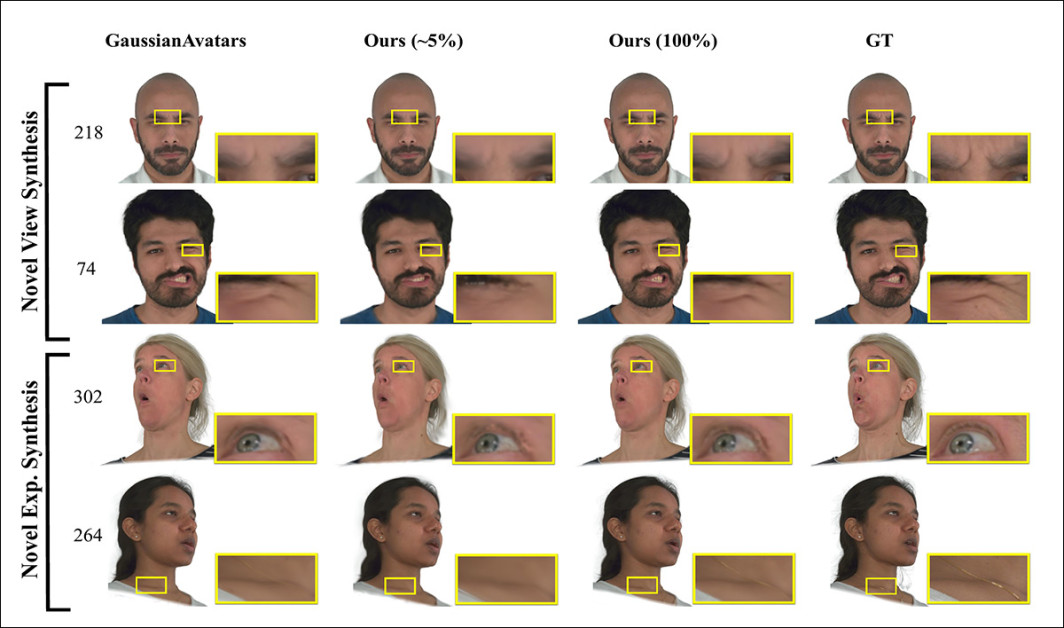

Comparações qualitativas em síntese de vista e expressão novas. A linha de base GaussianAvatars luta com detalhes finos ao redor dos olhos, rugas e textura da pele, enquanto o método proposto já preserva a estrutura facial chave em torno de cinco por cento dos dados transmitidos e converge em direção à verdade do solo à medida que mais Gaussians são transmitidos, correspondendo de perto ao modelo completo e às imagens de referência (verdade do solo).

Quanto a esses resultados, os autores afirmam:

‘[Nosso] método reconstrói detalhes mais nítidos em várias regiões, particularmente ao redor do pescoço, ombros e roupas. Essas áreas são relativamente tesselladas de forma grosseira na malha FLAME em comparação com zonas de alta saliência facial (por exemplo, a região periocular).

‘Consequentemente, métodos anteriores frequentemente alocam muito poucos Gaussians 3D para essas regiões para capturar fielmente seus detalhes de escala fina. Em contraste, nossa estratégia de crescimento adaptativo aumenta o número de Gaussians e refina a hierarquia apenas onde necessário, tornando a alocação insensível à tesselação não uniforme da FLAME.’

Os autores observam ainda que sua abordagem está em pé de igualdade com os métodos de ponta, produzindo um avatar viável com uma alocação de largura de banda trivial de 5%:

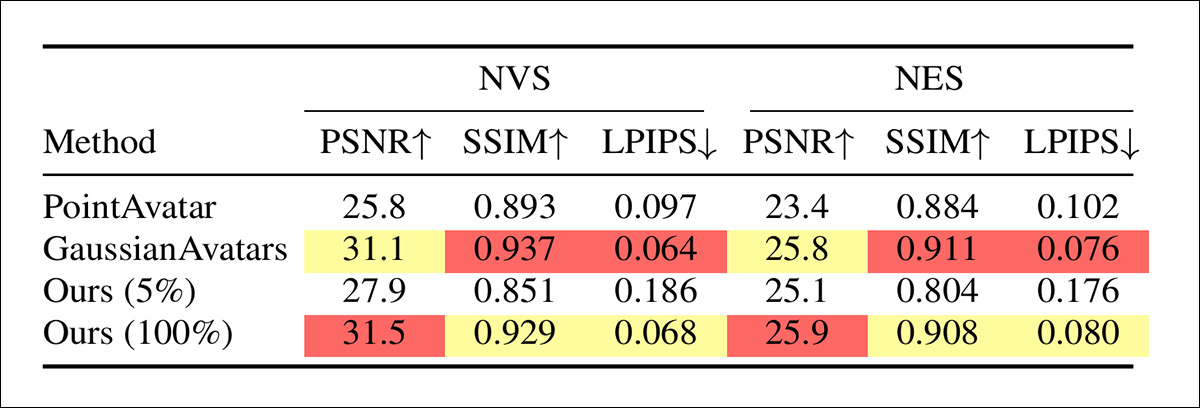

Comparações quantitativas em síntese de vista e expressão novas usando PSNR, SSIM e LPIPS. Na transmissão completa, o método proposto alcança o PSNR mais alto em ambas as tarefas e permanece competitivo com GaussianAvatars em métricas perceptuais, enquanto a configuração de 5% ilustra a troca de qualidade sob restrições de largura de banda extremas.

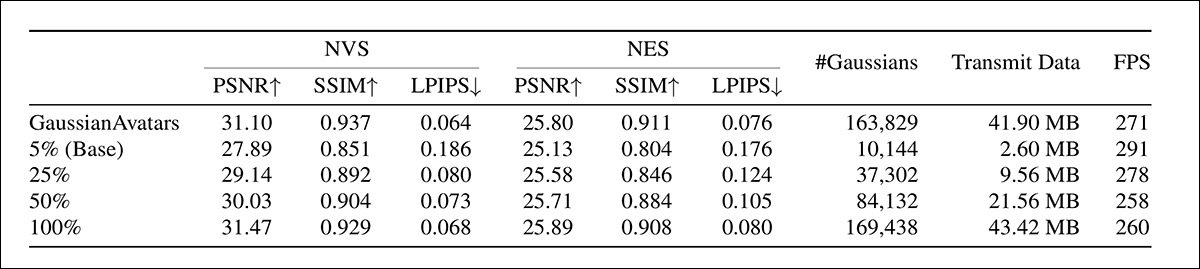

Em seguida, os pesquisadores testaram a renderização progressiva em si. Isso foi realizado em um NVIDIA RTX 4090, com 24Gb de VRAM, em resolução de 550x802px. Nesse cenário, os autores apontam que um orçamento de 25% usaria todos os Gaussians de “nível 1”, bem como um subconjunto de Gaussians de nível 2, o que fornece uma visão geral de como os grupos Gaussianos acumulam detalhes nos grupos de número mais alto, e que os grupos de número mais baixo essencialmente constroem a tela base:

Desempenho sob diferentes orçamentos de transmissão para síntese de vista e expressão novas, mostrando que a qualidade se aproxima ou excede GaussianAvatars à medida que mais Gaussians e dados são transmitidos, enquanto velocidades em tempo real são mantidas, em um RTX 4090.

Os autores comentam:

‘Com apenas 2,60 MB transmitidos (orçamento de 5%), o avatar já atinge uma qualidade razoável. À medida que Gaussians de nível mais alto são transmitidos, estruturas finas, como botões de camisa, dentes e cabelo, gradualmente se tornam mais nítidas, enquanto a estabilidade temporal é mantida.

‘Em 100% de transmissão, nossa abordagem alcança uma qualidade de renderização comparável aos métodos de ponta. Notavelmente, as taxas de quadros não caem significativamente, provavelmente porque a carga de trabalho 3DGS ainda não saturou o GPU.’

No entanto, os autores observam que, em cenários de RV multiusuário, o número de Gaussians 3D cresceria rapidamente para o ponto em que a rasterização do GPU se tornaria um gargalo. Nesses cenários mais pesados, a abordagem proposta oferece uma vantagem, permitindo que o sistema faça uma troca entre o número de primitivos e a qualidade visual, aliviando a carga sem colapsar o render.

Embora o artigo não detalhe, o site do projeto apresenta comparações de testes adicionais, também apresentando o projeto MeGA Hybrid mesh-Gaussian avatar:

Clique para reproduzir. Um de uma série de vídeos suplementares do site do projeto do artigo, este compara a nova abordagem em termos de síntese de vista nova.

Conclusão

Gaussian Splatting pode ou não perdurar, ou mesmo ser lembrado mais do que o RealPlayer agora é, em relação ao amanhecer da transmissão interativa: experiências representativas 3D-conscientes impulsionadas por IA ou auxiliadas por IA, incluindo vídeo chat, compras virtuais, navegação de rotas e diversas aplicações de entretenimento. Pode ser que tecnologias ou abordagens alternativas sejam as vencedoras, ou que GSplat prove ser a representação de vídeo de IA mais confiável.

Se nada mais, este artigo novo e interessante anuncia um pouco do escopo desse novo domínio, enquanto nos lembra, talvez nostalgicamente, da internet com largura de banda limitada de outrora.

* Por ‘3D’, não me refiro ao tipo de experiência que requer óculos especiais, mas sim experiências em que o conteúdo de multimídia tem algum tipo de compreensão de coordenadas X/Y/Z.

Publicado pela primeira vez na quarta-feira, 18 de março de 2026