Inteligência artificial

Modelo de segmentação de qualquer coisa – a visão computacional recebe um grande impulso

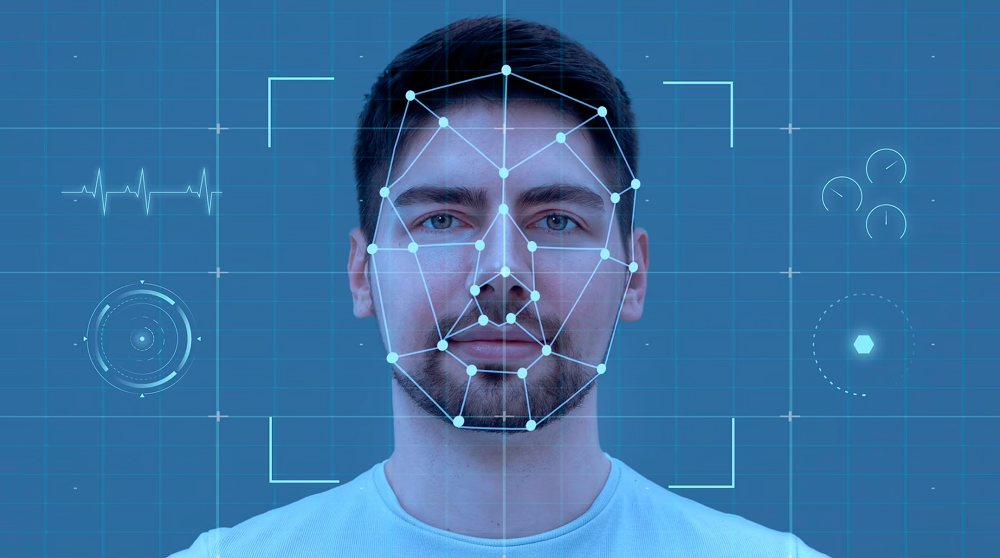

A visão computacional (VC) atingiu 99% de precisão, partindo de 50% em 10 anos. Espera-se que a tecnologia aprimore-se ainda mais, atingindo um nível sem precedentes com algoritmos modernos e técnicas de segmentação de imagens. Recentemente, o laboratório FAIR da Meta lançou o Modelo de segmento de qualquer coisa (SAM) – um divisor de águas na segmentação de imagens. Este modelo avançado pode produzir máscaras de objetos detalhadas a partir de prompts de entrada, levando a visão computacional a novos patamares. Pode potencialmente revolucionar a forma como interagimos com a tecnologia digital nesta era.

Vamos explorar a segmentação de imagens e descobrir brevemente como o SAM impacta visão computacional.

O que é segmentação de imagem e quais são seus tipos?

A segmentação de imagem é um processo em visão computacional que divide uma imagem em várias regiões ou segmentos, cada um representando um objeto ou área diferente da imagem. Essa abordagem permite que os especialistas isolem partes específicas de uma imagem para obter insights significativos.

Os modelos de segmentação de imagem são treinados para melhorar a saída, reconhecendo detalhes importantes da imagem e reduzindo a complexidade. Esses algoritmos efetivamente diferenciam entre diferentes regiões de uma imagem com base em recursos como cor, textura, contraste, sombras e bordas.

Ao segmentar uma imagem, podemos focar nossa análise nas regiões de interesse para obter detalhes perspicazes. Abaixo estão diferentes técnicas de segmentação de imagem.

- Segmentação semântica envolve rotular pixels em classes semânticas.

- Segmentação de instância vai além ao detectar e delinear cada objeto em uma imagem.

- Segmentação panóptica atribui IDs de instância exclusivos a pixels de objetos individuais, resultando em rotulagem mais abrangente e contextual de todos os objetos em uma imagem.

A segmentação é implementada usando modelos de aprendizado profundo baseados em imagem. Esses modelos buscam todos os pontos de dados e recursos valiosos do conjunto de treinamento. Em seguida, transforme esses dados em vetores e matrizes para entender recursos complexos. Alguns dos modelos de aprendizagem profunda amplamente utilizados por trás da segmentação de imagens são:

- Redes Neurais Convolucionais (CNNs)

- Redes totalmente conectadas (FCNs)

- Redes Neurais Recorrentes (RNNs)

Como funciona a segmentação de imagens?

In visão computacional, a maioria dos modelos de segmentação de imagens consiste em uma rede codificadora-decodificadora. O codificador codifica uma representação de espaço latente dos dados de entrada que o decodificador decodifica para formar mapas de segmentos ou, em outras palavras, mapas que descrevem a localização de cada objeto na imagem.

Normalmente, o processo de segmentação consiste em 3 etapas:

- Um codificador de imagem que transforma a imagem de entrada em um modelo matemático (vetores e matrizes) para processamento.

- O codificador agrega os vetores em vários níveis.

- Um decodificador de máscara rápido usa as incorporações de imagem como entrada e produz uma máscara que contorna diferentes objetos na imagem separadamente.

O estado da segmentação de imagens

A partir de 2014, surgiu uma onda de algoritmos de segmentação baseados em aprendizado profundo, como CNN+CRF e FCN, que fizeram progressos significativos no campo. O ano de 2015 foi marcado pelo surgimento da Rede U-Net e Deconvolution, melhorando a precisão dos resultados da segmentação.

Então, em 2016, Instance Aware Segmentation, V-Net e RefineNet melhoraram ainda mais a precisão e a velocidade da segmentação. Em 2017, Mark-RCNN e FC-DenseNet introduziram detecção de objetos e previsão densa para tarefas de segmentação.

Em 2018, Panoptic Segmentation, Mask-Lab e Context Encoding Networks estiveram no centro do palco, pois essas abordagens abordaram a necessidade de segmentação em nível de instância. Em 2019, Panoptic FPN, HRNet e Criss-Cross Attention introduziram novas abordagens para segmentação em nível de instância.

Em 2020, a tendência continuou com a introdução do Detecto RS, Panoptic DeepLab, PolarMask, CenterMask, DC-NAS e Efficient Net + NAS-FPN. Por fim, em 2023, temos o SAM, sobre o qual falaremos a seguir.

Modelo de Segmentação de Qualquer Coisa (SAM) - Segmentação de Imagem de Finalidade Geral

O processo de Modelo de segmento de qualquer coisa (SAM) é uma nova abordagem que pode executar tarefas de segmentação interativas e automáticas em um único modelo. Anteriormente, a segmentação interativa permitia a segmentação de qualquer classe de objeto, mas exigia que uma pessoa orientasse o método refinando iterativamente uma máscara.

A segmentação automática no SAM permite a segmentação de categorias de objetos específicas definidas antecipadamente. Sua interface promocionável o torna altamente flexível. Como resultado, o SAM pode lidar com uma ampla variedade de tarefas de segmentação usando um prompt adequado, como cliques, caixas, texto e muito mais.

O SAM é treinado em um conjunto de dados diversificado e perspicaz de mais de 1 bilhão de máscaras, tornando possível reconhecer novos objetos e imagens indisponíveis no conjunto de treinamento. Essa estrutura moderna revolucionará amplamente o Modelos de currículo em aplicativos como carros autônomos, segurança e realidade aumentada.

O SAM pode detectar e segmentar objetos ao redor do carro em carros autônomos, como outros veículos, pedestres e sinais de trânsito. Na realidade aumentada, o SAM pode segmentar o ambiente do mundo real para colocar objetos virtuais em locais apropriados, criando um UX mais realista e envolvente.

Desafios da segmentação de imagens em 2023

A crescente pesquisa e desenvolvimento em segmentação de imagens também traz desafios significativos. Alguns dos principais desafios de segmentação de imagem em 2023 incluem o seguinte:

- A crescente complexidade dos conjuntos de dados, especialmente para segmentação de imagens 3D

- O desenvolvimento de modelos profundos interpretáveis

- O uso de modelos de aprendizagem não supervisionados que minimizam a intervenção humana

- A necessidade de modelos em tempo real e com eficiência de memória

- Eliminando os gargalos da segmentação de nuvem de pontos 3D

O Futuro da Visão Computacional

O mundial visão computacional mercado impacta vários setores e é projetado para atingir mais de $ 41 bilhões até 2030Técnicas modernas de segmentação de imagens, como o Modelo Segment Anything, juntamente com outros algoritmos de aprendizado profundo, fortalecerão ainda mais a estrutura da visão computacional no cenário digital. Consequentemente, veremos modelos de visão computacional mais robustos e aplicações inteligentes no futuro.

Para saber mais sobre IA e ML, explore Unir.ai – sua solução completa para todas as dúvidas sobre tecnologia e seu estado moderno.