Ângulo de Anderson

Reduzindo Alucinações de Imagem de IA ao Exagerá-las

Modelos de visão do estilo ChatGPT frequentemente ‘alucinam’ elementos que não pertencem a uma imagem. Um novo método reduz esses erros mostrando ao modelo versões exageradas de suas próprias alucinações, com base em legendas – e, em seguida, pedindo que ele tente novamente. Essa abordagem não envolve retreinamento ou necessidade de dados extras e pode ser aplicada a uma ampla gama de modelos e tipos de modelos.

Um novo artigo publicado na China oferece uma visão interessante sobre o problema persistente das alucinações em imagens e vídeos gerados por IA – elementos que claramente não deveriam estar na imagem, com base na solicitação e entrada do usuário.

Em essência, o sistema pega uma imagem e deixa o modelo descrevê-la, como de costume; ele então transforma essa legenda em uma nova imagem usando um modelo de texto-para-imagem – e qualquer objeto ou detalhe extra nessa segunda imagem será uma representação direta das alucinações iniciais do modelo. Em seguida, comparando as imagens originais e geradas, o sistema gentilmente direciona o modelo longe desses erros da próxima vez que ele tentar:

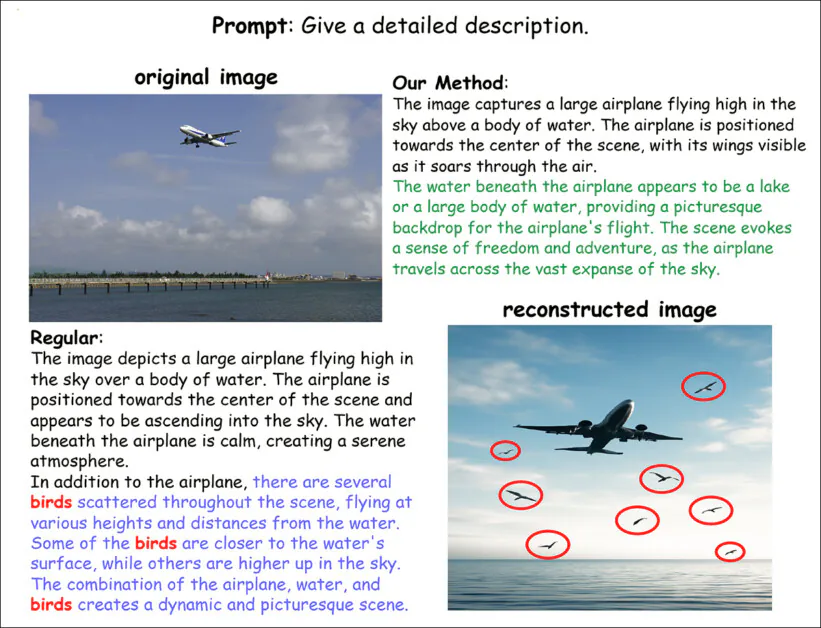

Uma ilustração de como o novo método identifica e reduz alucinações em legendas de imagens. O modelo regular descreve pássaros que não existem na imagem original, levando a uma imagem reconstruída que os adiciona. Esses erros são marcados em vermelho. Em contraste, o método proposto evita esses detalhes inventados enquanto mantém a legenda específica e fluente. Fonte: https://arxiv.org/pdf/2509.21997

O método começa mostrando ao modelo imagens reais e fazendo com que ele as descreva, incluindo algumas descrições com objetos ou detalhes que não estão realmente presentes. Essas legendas alucinadas são então usadas para gerar imagens sintéticas que tornam os erros mais fáceis de detectar. Comparando as imagens reais e geradas, o sistema aprende quais padrões internos no modelo tendem a produzir conteúdo inventado.

Uma vez que esses padrões de erro são identificados, eles podem ser armazenados e usados posteriormente. Quando o modelo é dado uma nova imagem, o sistema ajustará seus sinais internos durante a legenda, empurrando-o para longe dos padrões conhecidos que causam alucinações. Isso funciona em uma única passagem e não requer dados extras, retreinamento ou qualquer nova geração de imagens no momento do teste.

A Teia Emaranhada

No exemplo mostrado acima, do artigo, podemos ver que entrelaçamento provavelmente é responsável por embelezar ‘pássaros’ na imagem de entrada, mesmo que a primeira imagem pareça não conter pássaros.

Entrelaçamento ocorre quando um modelo insiste em associar certos conceitos com certos outros conceitos, simplesmente porque os dois (ou mais) conceitos tendem a aparecer frequentemente juntos na distribuição de dados original em que o modelo foi treinado. Nesse caso, o modelo pode ter visto muitas imagens de aviões+pássaros, causando uma associação que não se aplica à imagem em questão, mas que ainda assim interfere na legenda derivada.

Embora o entrelaçamento possa ser mitigado interrompendo o treinamento mais cedo (o que, em geral, torna o modelo maximamente flexível e adaptável), isso também reduz o detalhe e a resolução de todos os conceitos treinados, deixando o treinador do modelo com o dilema perene: criar um modelo que seja muito flexível e desemaranhado; ou criar um modelo que seja mais poderosamente gerador, mas também mais propenso a produzir ‘associações’ alucinadas?

Se a qualidade da legenda e a atenção ao detalhe na curação dos dados originais para um modelo gerador tivessem sido melhores do que a logística geralmente permite, legendas para todas as imagens de origem teriam detalhado todo objeto em cada imagem, para que o modelo treinado pudesse ter alocado entradas discretas e desemaranhadas em seu espaço latente.

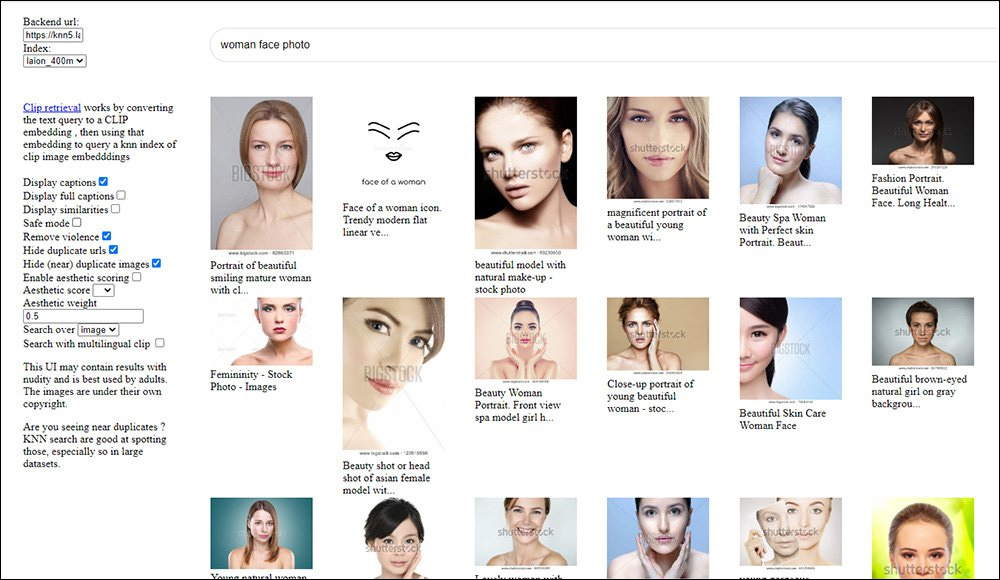

Como está, a prática auto-servida de otimização de legenda para SEO, combinada com o fato de que ad hoc raspagem de dados em larga escala permanece a melhor fonte para treinar modelos geradores realmente poderosos, significa que as legendas de imagem tendem a cair consideravelmente abaixo desse padrão:

Uma ilustração de como legendas fracas limitam a utilidade das imagens LAION para treinar modelos como o Stable Diffusion. Muitas das etiquetas de texto são rasas, vagas ou otimizadas para SEO em vez de descrição precisa, tornando mais difícil para o modelo aprender conceitos visuais de granulação fina, como recursos faciais. (Fonte original foi https://rom1504.github.io/, agora defunta).

Portanto, desde que uma solução fundamental é improvável de ser praticável, a redução de alucinações de LLM/VLM por meio de soluções e compromissos se tornou uma sub-corrente forte na literatura.

A nova técnica chinesa divulgada esta semana, os autores afirmam, foi testada em uma variedade de arquiteturas em condições diversas e pode indicar uma maneira útil de reduzir a ‘poluição de alucinação’.

Eles dizem:

‘Experimentos extensivos em vários benchmarks mostram que nosso método reduz significativamente as alucinações nos níveis de objeto, atributo e relação, enquanto preserva principalmente a lembrança e a riqueza da legenda.’

O novo artigo é intitulado Expondo Alucinações para Suprimi-las: Edição de Representação de VLMs com Âncoras Geradoras, e vem de três pesquisadores da Universidade de Ciência e Tecnologia da China e da Universidade de Nanjing.

Método

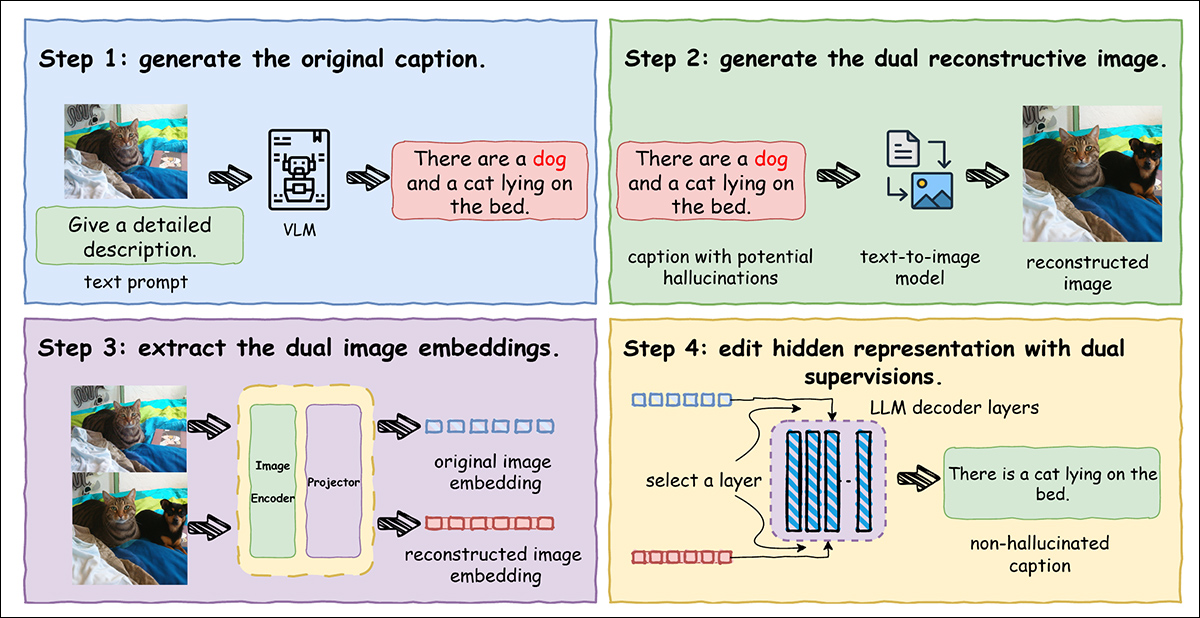

Os autores conceberam um pipeline de ponta a ponta, mostrado abaixo, projetado para expor e suprimir alucinações em legendas de imagens:

Uma ilustração do pipeline completo. Um modelo de visão-linguagem primeiro gera uma legenda a partir da imagem de entrada, que pode incluir conteúdo alucinado. Essa legenda é então usada para produzir uma imagem reconstruída via um modelo de texto-para-imagem, tornando qualquer alucinação mais fácil de detectar. Incorporações de ambas as imagens originais e reconstruídas são extraídas e usadas para guiar ajustes dentro do decodificador, ajudando o modelo a suprimir detalhes alucinados enquanto preserva a qualidade da legenda.

Começando a partir de uma imagem de entrada real, um modelo de visão-linguagem gera uma legenda descritiva que pode conter objetos ou relacionamentos inventados. Essa legenda é então alimentada em um gerador de texto-para-imagem para criar uma imagem reconstruída que mostra exatamente o que a legenda descreve. Comparar essa imagem reconstruída com a original torna o conteúdo fabricado óbvio e mensurável, transformando erros sutis em texto em diferenças visíveis que o sistema pode direcionar e reduzir.

Para guiar o modelo longe de ‘inventar’ detalhes, o sistema compara duas versões da mesma imagem: a original e uma reconstruída com base na legenda. Cada imagem é convertida em uma incorporação compacta de incorporação que captura seu conteúdo.

A imagem original atua como uma referência confiável, enquanto a reconstruída destaca onde as alucinações podem ter se infiltrado. Ajustando suas representações internas para se aproximar da original e se afastar da reconstruída, o modelo aprende a se corrigir automaticamente. Como esse processo não depende de regras ajustadas à mão ou dados externos, permanece totalmente auto-supervisionado.

O artigo afirma:

‘As alucinações em MLLMs são intrinsecamente difíceis de detectar porque são linguisticamente bem-formadas e frequentemente indistinguíveis de descrições fiéis no nível do texto. A discrepância reside não na plausibilidade da linguagem, mas na falta de alinhamento com a evidência visual, à qual o modelo é tipicamente insensível.’

‘Para abordar isso, introduzimos um mecanismo de exposição de alucinação que aproveita a reconstrução geradora para converter inconsistências implícitas em sinais explícitos e observáveis.’

Dado uma imagem de entrada e sua legenda, o sistema usa o modelo FLUX.1-dev de texto-para-imagem para recriar uma imagem a partir da legenda sozinha. Essa imagem recriada tende a exagerar o significado da legenda, tornando qualquer detalhe falso mais óbvio. Esses erros amplificados então servem como sinais úteis que ajudam o modelo a reconhecer e corrigir seus próprios erros.

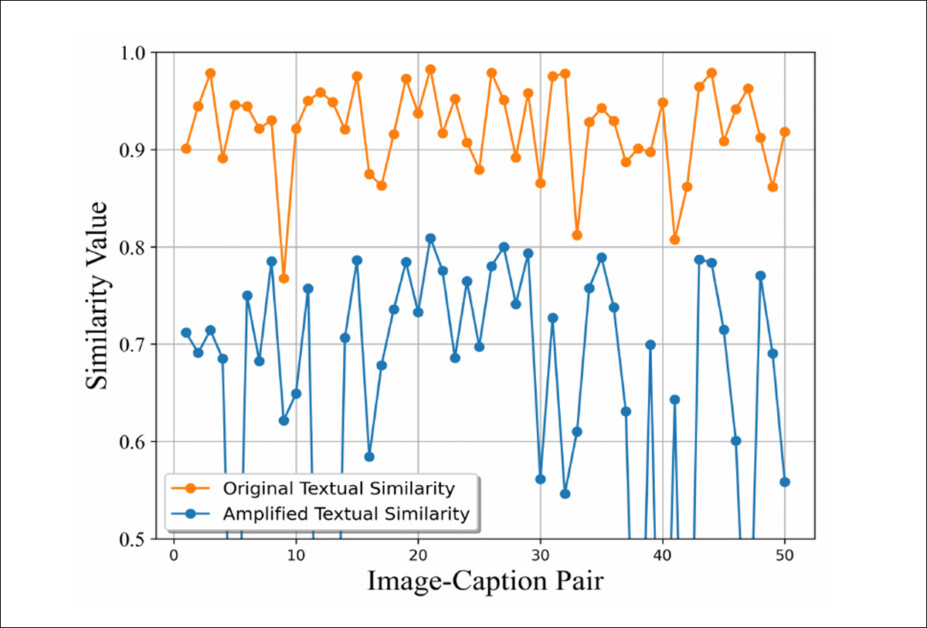

Para testar sua abordagem, os autores injetaram alucinações em legendas e usaram o modelo de texto-para-imagem para gerar imagens reconstruídas. Essas imagens foram então relegendadas por LLaVA, e a similaridade semântica entre as legendas originais e alucinadas foi avaliada:

Uma ilustração de como o mecanismo de amplificação de alucinação torna erros sutis visíveis. Cada ponto mostra a similaridade entre as legendas das imagens originais e reconstruídas para um par de imagem-legenda. A linha laranja representa a similaridade medida diretamente entre as legendas originais e alucinadas, que permanece alta e mascara erros pequenos; a linha azul representa a similaridade após a reconstrução, que cai abruptamente, mostrando que o processo transforma alucinações ocultas em marcadores semânticos claros que podem ser detectados e corrigidos.

A similaridade cai abruptamente após a reconstrução, mostrando que o processo torna erros sutis mais detectáveis.

Dados e Testes

Validar a eficácia do novo método envolveu o uso de três benchmarks apropriados: Avaliação de Alucinação de Legenda com Relevância de Imagem (CHAIR); Avaliação de MLLM benchmark (MME); e Avaliação de Probing de Objeto com Pooling (POPE).

Do lançamento do artigo CHAIR: exemplos de objetos alucinados gerados por dois sistemas de legenda líderes, TopDown e NBT, onde cada modelo inventa elementos visuais não presentes na imagem, como laptops, pias ou pranchas de surfe. Fonte: https://arxiv.org/pdf/1809.02156

Métricas padrão como taxa de alucinação ou recuperação podem ser enganosas, pois um modelo pode evitar alucinações simplesmente produzindo legendas curtas ou vagas. Para contabilizar a compensação entre recuperação e alucinação, uma métrica combinada chamada Alucinação e Recuperação (HAR@β) foi usada, que pontua legendas com base em precisão e completude, e que permite que o equilíbrio seja ajustado dependendo de se evitar erros ou incluir mais detalhes é mais importante.

POPE foi usado para avaliar alucinações de objeto sensíveis ao contexto, e MME para avaliar alucinações de nível de atributo, com ambos enquadrados como tarefas de julgamento Sim ou Não.

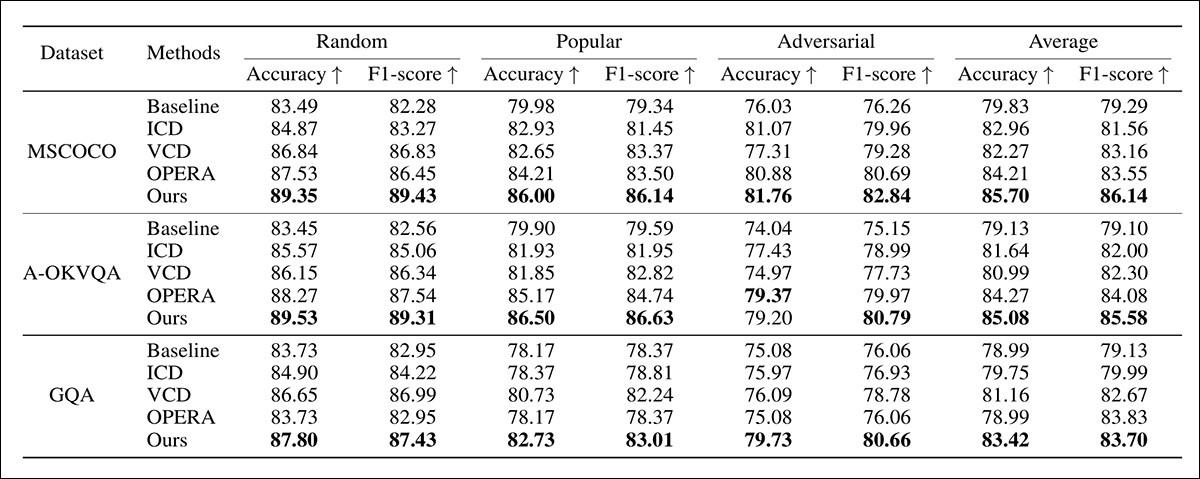

Experimentos foram conduzidos em conjuntos de dados representativos diversificados, usando o modelo Flux mencionado e a variante LLaVA-v1.5-7B. Os conjuntos de dados empregados foram Microsoft COCO; A-OKVQA; e GQA.

Edição latente foi realizada para a segunda camada dos modelos, de acordo com trabalho relacionado anterior, enquanto hiperparâmetros e temperatura foram consistentes em todos os modelos.

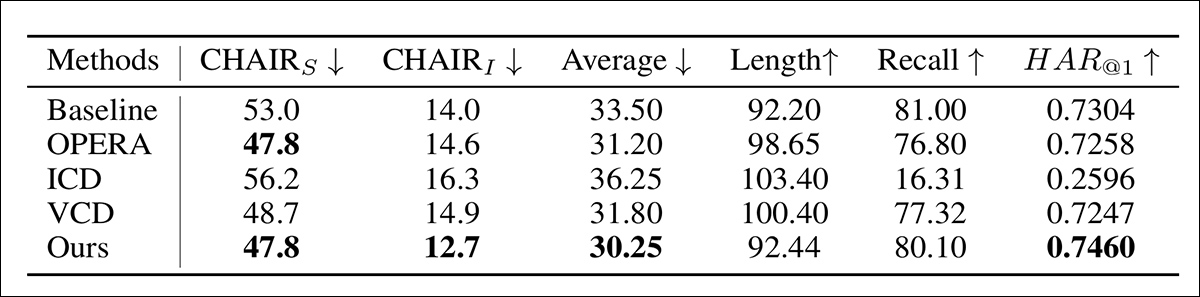

Resultados iniciais no CHAIR são apresentados abaixo*:

Desempenho no benchmark CHAIR para mitigação de alucinação, avaliado usando várias métricas.

Desses resultados, os autores comentam:

‘[Nosso método consistentemente supera outras linhas de base em ambos CHAIRS e CHAIRI[*], demonstrando sua eficácia superior na supressão de alucinações. Enquanto quase todos os métodos inevitavelmente reduzem a recuperação enquanto suprimem alucinações, refletindo uma compensação entre fidelidade e informatividade, nossa abordagem alcança a menor queda.

‘Isso demonstra que nosso método captura uma ampla gama de objetos de fato. Com a métrica HAR@β, nosso método alcança a pontuação mais alta, destacando sua capacidade de reduzir alucinações enquanto mantém a cobertura.’

Os pesquisadores atribuem esses resultados fortes ao setup de supervisão dupla, onde a semântica limpa da imagem original foi reforçada, ao mesmo tempo que sinais enganosos da imagem reconstruída foram suprimidos. Como o ajuste foi direcionado apenas à direção associada a alucinações, o resto da representação foi deixado intacto, permitindo que o sistema corrija erros sem sacrificar detalhes ou informatividade.

Comparação de desempenho no benchmark POPE sob várias configurações e conjuntos de dados.

Quanto aos resultados no POPE, mostrados na tabela de resultados acima, o artigo afirma:

‘Pode ser observado que nosso método consistentemente alcança o melhor desempenho em todos os cenários. Notavelmente, nosso método pode alcançar até +5,95% de precisão e +6,85% de pontuação F1 em média, superando outras abordagens sem treinamento por uma margem grande.

‘Portanto, esses resultados demonstram que nosso método fornece uma solução confiável e generalizável em diferentes níveis de dificuldade.’

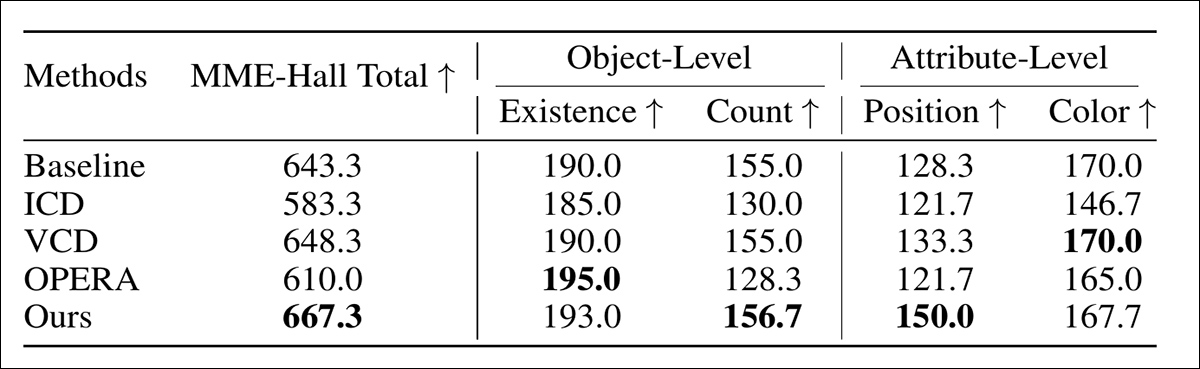

Da terceira rodada de testes, comparações de desempenho sobre MME.

O último teste principal foi sobre MME, com os resultados mostrados acima. No entanto, entre outras omissões, menciona o Método ‘OPERA’, que não é definido em lugar algum no artigo principal ou no apêndice. Embora os autores aleguem um desempenho forte em MME, sem definições adequadas dos métodos, talvez devêssemos deixar a seção de resultados nesse ponto.

Uma ilustração do benchmark MME usando LLaVA-v1.5-7B, mostrando como o modelo de linha de base produz uma resposta alucinada enquanto o método proposto dá a resposta correta, com a imagem reconstruída tornando a alucinação mais aparente.

Conclusão

Embora este artigo seja claramente apressado e sofra da falta de estrutura, foco e clareza que tem se tornado cada vez mais evidente na literatura nos últimos 12 meses (talvez não desvinculado do uso crescente de IA em pesquisas acadêmicas), o mecanismo central apresentado permanece engenhoso.

Embora essa abordagem de ponta a ponta não exija retreinamento e pareça aplicável em uma ampla gama de arquiteturas, teria sido esclarecedor ver mais candidatos de teste; e também deve ser considerado que um sistema intersticial desse tipo introduzirá, no mínimo, latência e algum grau de requisito de energia extra – não uma questão menor em escala.

* Inconvenientemente, o corpo principal deste artigo apresenta resultados com títulos que são explicados apenas no material do apêndice, e não no artigo principal – um hábito cada vez mais visto na literatura, à medida que os pesquisadores buscam limitar a tese central a 8-9 páginas, mesmo quando o material não permite. Em qualquer caso, o benchmark CHAIR, usado para avaliar alucinação de objeto em legendas, foi baseado em um subconjunto de 500 imagens do MSCOCO de trabalhos anteriores. Duas formas foram usadas: CHAIRs, medindo com que frequência as alucinações aparecem em qualquer legenda dada; e CHAIRI, medindo quantos dos objetos mencionados foram alucinados. HAR@β , introduzido no artigo principal, foi definido como uma combinação de estilo Fβ de supressão de alucinação e recuperação de objeto.

Publicado pela primeira vez na terça-feira, 30 de setembro de 2025