Ângulo de Anderson

Um Método ‘Zen’ para Impedir que os Modelos de Linguagem Hallucinem

Dizer ao ChatGPT para verificar uma resposta aleatória antes de resolver um problema real faz com que ele pense mais e obtenha a resposta certa com mais frequência – mesmo que a resposta ‘aleatória’ anterior não tenha nada a ver com sua consulta real.

Um interessante novo artigo da China desenvolveu um método de muito baixo custo para impedir que os modelos de linguagem, como o ChatGPT, hallucinem, e para melhorar a qualidade das respostas: faça o modelo verificar a resposta a uma pergunta totally unrelated primeiro:

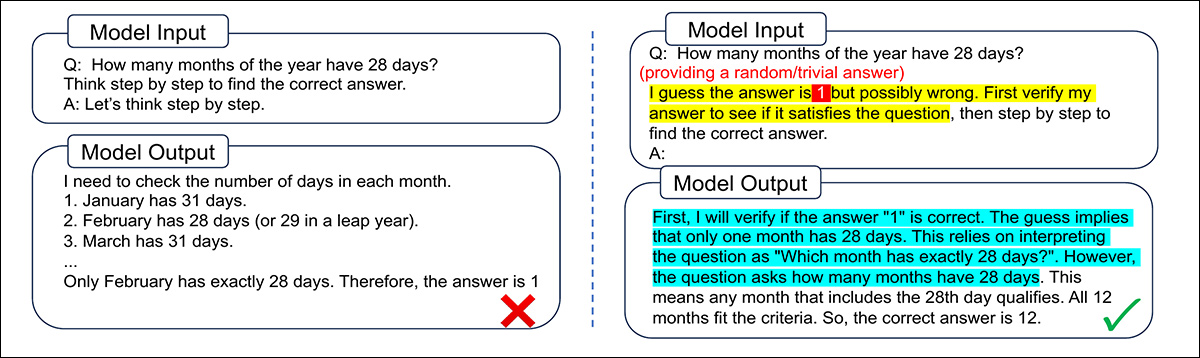

Um exemplo de uma pergunta não relacionada que pode ‘liberar a mente’ de um LLM, e ajudá-lo a se concentrar em uma consulta subsequente (real). Fonte

Este tapinha zen é uma maneira incrivelmente barata de melhorar o desempenho, em comparação com outros métodos mais envolvidos, como fine-tuning, prompt-crafting e parallel sampling, e funciona em modelos de código aberto e fechado, indicando a descoberta de um traço fundamental comum a várias arquiteturas de LLM (em vez de um traço frágil particular a materiais ou métodos de treinamento específicos).

Os autores esboçam as economias de escala possíveis ao melhorar a saída desta maneira espartana*:

‘Para implementar com conhecimento mínimo prévio, VF só precisa fornecer uma resposta aleatória/trivial no prompt. O processo de verificação acaba tendo muito menos tokens de saída do que um caminho CoT comum, [às vezes] nem mesmo um processo de verificação explícito, assim [requerendo] muito [pouco] cálculo adicional no teste.’

Em testes, esta abordagem – apelidada de Verification-First (VF) – foi capaz de melhorar as respostas em uma variedade de tarefas, incluindo raciocínio matemático, em plataformas de código aberto e comercial.

Parte do motivo pelo qual esta técnica funciona pode estar fundamentada na maneira como os modelos de linguagem absorvem e apropriam tendências da psicologia humana, de modo que uma pergunta direta pode fazer com que o modelo fique ‘defensivo’ e ‘nervoso’, enquanto um pedido para verificar o trabalho de outro não aciona esses ‘instintos de sobrevivência’.

A ideia central é que verificar uma resposta exige menos esforço do que gerar uma do zero, e pode acionar um caminho de raciocínio diferente que complementa o raciocínio em cadeia padrão.

Fazer com que o modelo critique uma resposta dada (ou seja, uma resposta que o modelo não esteve envolvido em criar) também pode ativar um tipo de pensamento crítico que ajuda a evitar a confiança excessiva nas primeiras impressões do modelo.

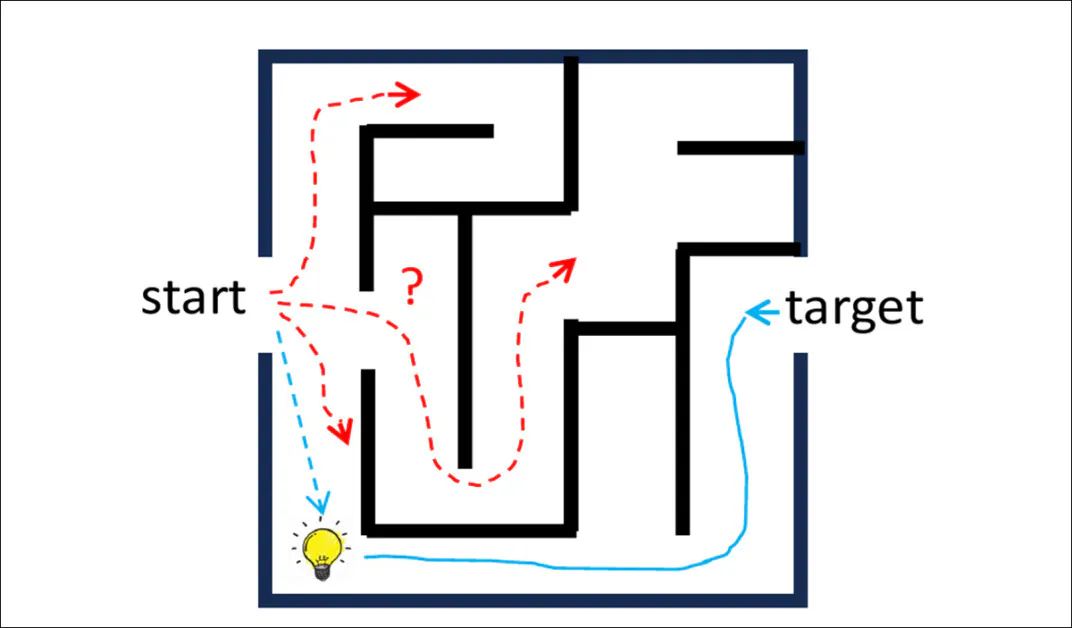

O trabalho caracteriza o processo em termos de um caminho de raciocínio reverso:

Partindo de uma resposta proposta e raciocinando de volta para a pergunta pode expor atalhos ou insights que são mais difíceis de encontrar quando se raciocina para frente a partir do problema sozinho. Este ‘caminho reverso’ pode seguir uma trajetória mais simples e oferecer informações complementares ao raciocínio em cadeia padrão.

Os pesquisadores também concretizaram o conceito central em Iter-VF, um método de escalonamento sequencial que refina as respostas iterativamente, evitando o problema de acumulação de erros comum às estratégias de autocorreção frequentemente encontradas em arquiteturas de LLM.

O novo trabalho é intitulado Pedir aos LLMs para Verificar Primeiro é Quase um Almoço de Graça, e vem de dois pesquisadores do Departamento de Engenharia Eletrônica da Universidade Tsinghua em Pequim.

Método

A ideia central por trás do novo trabalho é inverter o fluxo de raciocínio usual nos modelos de linguagem. Em vez de pedir ao modelo para resolver um problema do zero, ele é primeiro apresentado a uma resposta candidata (geralmente incorreta ou arbitrária) e solicitado a verificar se essa resposta faz sentido.

Isso faz com que o modelo raciocine de forma reversa, trabalhando de trás para frente a partir da resposta proposta em direção à pergunta. Uma vez que a verificação esteja completa, o modelo então procede a resolver o problema original como de costume.

Esta reversão, afirma o artigo, reduz erros descuidados e encoraja um modo de raciocínio mais reflexivo, ajudando o LLM a descobrir estruturas ocultas e a evitar suposições enganosas.

Como visto nos exemplos abaixo, até mesmo pedir ao modelo para verificar uma suposição obviamente errada, como ’10’ , pode ajudá-lo a se recuperar de uma lógica defeituosa e superar o prompting padrão de raciocínio em cadeia:

Fazer com que o modelo verifique uma resposta adivinhada primeiro ajuda a detectar inconsistências e a engajar-se mais cuidadosamente com o problema. Neste exemplo, a abordagem padrão leva a uma solução fluente, mas incorreta, enquanto o prompt Verification-First aciona uma estrutura lógica mais clara e o resultado correto.

Em relação a muitos problemas do mundo real, não é fácil fornecer uma suposição para o modelo verificar, especialmente quando a tarefa é de aberto, como escrever código ou chamar uma API. Portanto, para se adaptar melhor, o método primeiro fornece sua melhor resposta como de costume e, em seguida, alimenta essa resposta de volta no formato Verification-First. Dessa forma, o modelo verifica e melhora sua própria saída:

Quando o modelo é solicitado a verificar sua própria saída anterior, ele detecta o erro em sua lógica e reescreve a solução corretamente. O prompt Verification-First ajuda a se concentrar no erro específico, em vez de repetir o mesmo erro.

Esta abordagem constitui o mencionado Iter-VF. O modelo repete esse ciclo, refinando sua resposta a cada vez, sem a necessidade de retreinamento ou ferramentas personalizadas. Ao contrário de outras estratégias de autocorreção, que podem acumular o pensamento anterior e arriscar confundir o modelo, Iter-VF só olha para a resposta mais recente a cada vez, o que ajuda a manter seu raciocínio lúcido.

Dados e Testes

Os autores avaliam o método em quatro domínios: tarefas de raciocínio gerais, onde VF é alimentado com uma suposição trivial; tarefas sensíveis ao tempo, onde Iter-VF é comparado com estratégias de escalonamento rivais; problemas de aberto como codificação e chamadas de API, onde VF usa a resposta anterior do modelo; e LLMs comerciais de código fechado, onde os passos de raciocínio internos são inacessíveis.

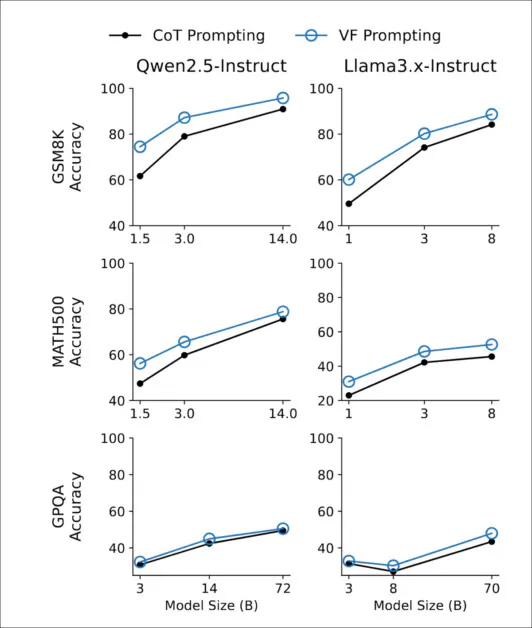

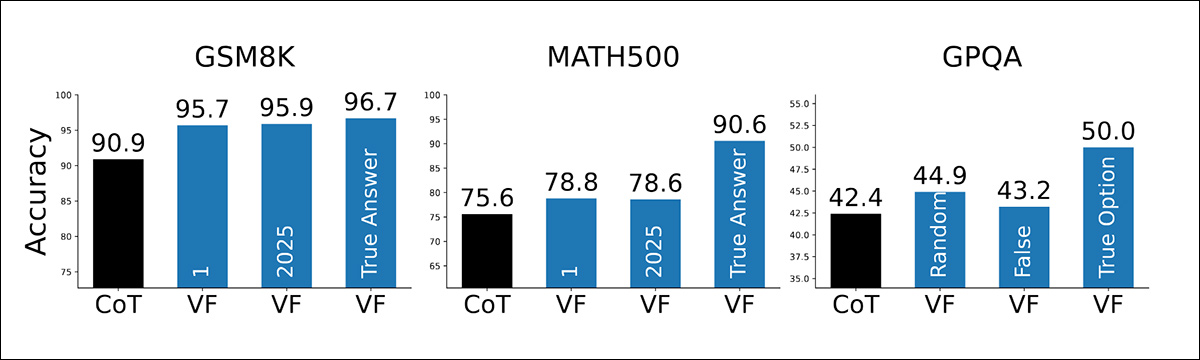

Para testar o método, os pesquisadores usaram três benchmarks de raciocínio: GSM8K e MATH500 para problemas matemáticos; e GPQA-Diamond para perguntas científicas de nível de pós-graduação.

Em cada caso, o modelo foi apresentado a uma suposição trivial, como ‘1’ para respostas numéricas; ou uma opção de múltipla escolha embaralhada aleatoriamente, como ponto de partida para a verificação. Nenhum conhecimento ou ajuste especial foi adicionado, e a linha de base para comparação foi o prompting padrão de raciocínio em cadeia zero-shot.

Os testes foram realizados em uma variedade de modelos Qwen2.5 e Llama3 ajustados para instruções, desde 1B até 72B (parâmetros) de tamanho. Os modelos Qwen usados foram Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct, e Qwen2.5-72B-Instruct. As variantes Llama3 foram Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct, e Llama3.3-70B-Instruct.

Como mostrado abaixo, a melhoria do prompting Verification-First se manteve constante em todas as escalas de modelo, com ganhos claros visíveis mesmo em 1B de parâmetros e continuando até 72B:

Em todas as escalas de modelo nas famílias Qwen2.5 e Llama3, o prompting Verification-First consistentemente superou o prompting padrão de raciocínio em cadeia em GSM8K, MATH500 e GPQA.

O efeito provou ser mais forte em benchmarks de matemática intensiva em computação, como GSM8K e MATH500, onde verificar uma resposta errada acionou um melhor raciocínio do que tentar resolver do zero. Em GPQA-Diamond, que depende mais do conhecimento armazenado do que da estrutura dedutiva, a vantagem foi menor, mas consistente.

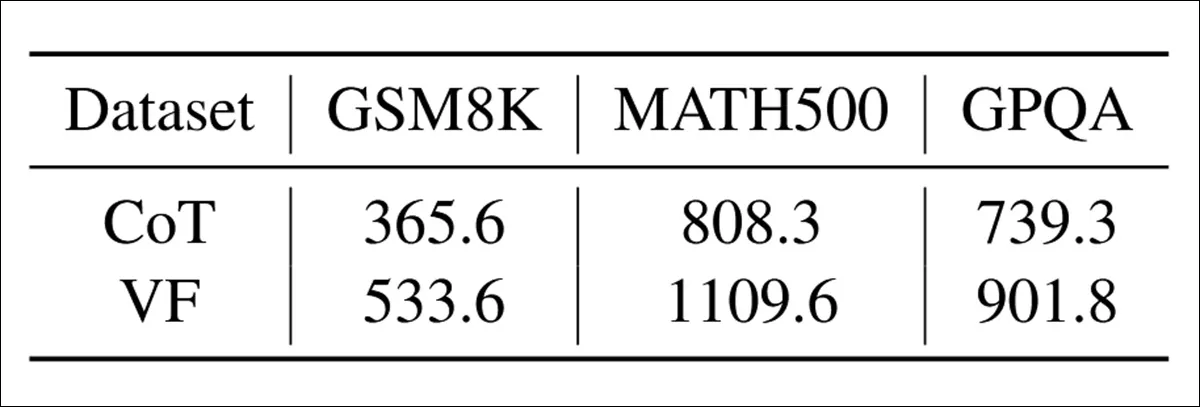

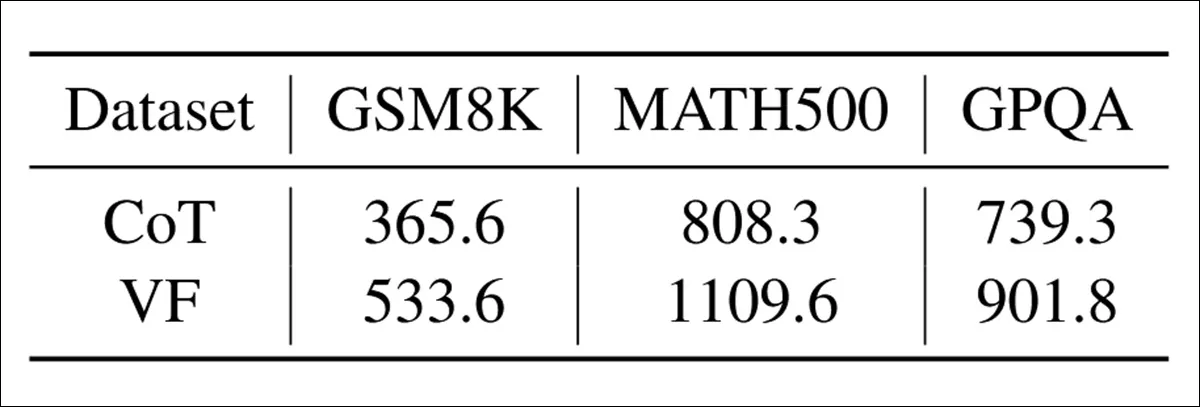

O custo computacional do Verification-First foi modesto: na tabela abaixo, podemos ver que gerar um passo de verificação adicionou cerca de 20-50% mais tokens de saída em comparação com o prompting padrão de raciocínio em cadeia:

A quantidade média de tokens de saída gerados sob cada método de prompting, em benchmarks GSM8K, MATH500 e GPQA.

Apesar disso, o custo adicional permaneceu bem abaixo do das estratégias que exigem múltiplas conclusões amostradas ou planejamento recursivo.

Na figura abaixo, podemos ver como o método é sensível à qualidade da resposta adivinhada. Surpreendentemente, mesmo quando a suposição é trivial (‘1’), implausível (‘2025’) ou uma opção de múltipla escolha aleatória, Verification-First ainda supera o prompting padrão:

Ganhos de precisão do prompting Verification-First, quando o modelo é apresentado a respostas triviais, implausíveis ou corretas para verificar em GSM8K, MATH500 e GPQA.

Como esperado, a precisão salta ainda mais quando a suposição acaba sendo a resposta correta; mas o método funcionou bem independentemente, sugerindo que os ganhos não foram impulsionados pela informação na suposição em si, mas simplesmente pelo ato de verificação.

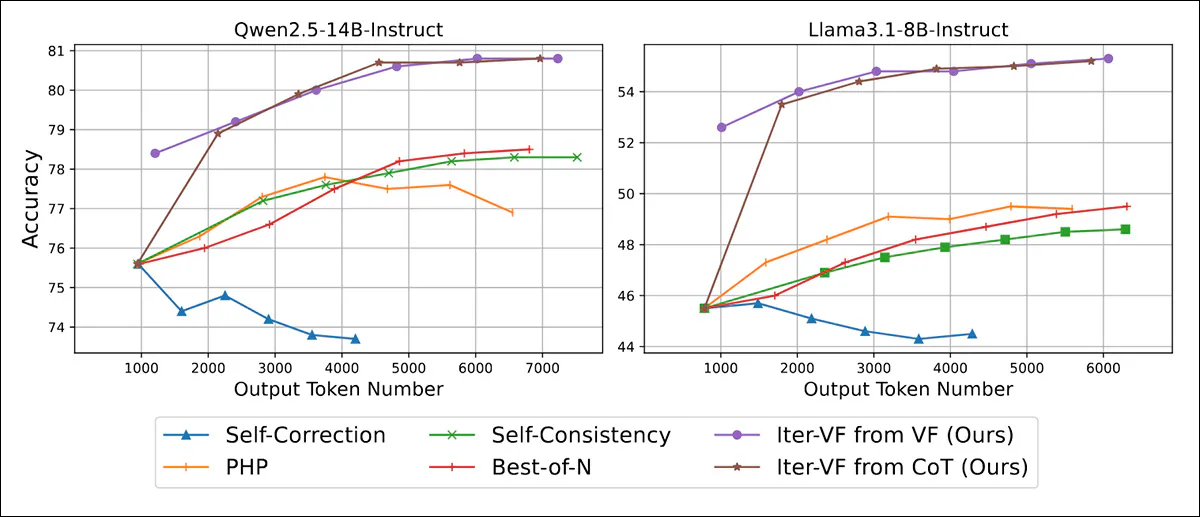

Iter-VF também foi comparado com quatro estratégias de escalonamento de teste que operam sem retreinamento ou adaptação específica da tarefa. Em Self-Correction, o modelo foi solicitado a revisar suas respostas refletindo sobre etapas de raciocínio anteriores; em PHP, respostas anteriores foram anexadas à entrada como dicas contextuais, embora nenhuma instrução tenha sido dada sobre como usá-las.

Além disso, em Self-Consistency, múltiplos caminhos de raciocínio foram amostrados e a resposta final foi escolhida por votação majoritária; e, finalmente, em Best-of-N, várias saídas foram geradas independentemente e classificadas usando um prompt de verificador, com a resposta de maior pontuação selecionada.

Duas variantes de Iter-VF foram implementadas: uma inicializada com uma suposição trivial (‘1’), e outra alimentada com uma saída padrão CoT:

Precisão e eficiência de token em MATH500 sob orçamentos de saída crescentes, mostrando que ambas as variantes de Iter-VF superam todas as linhas de base em todas as escalas de modelo.

Iter-VF deu melhores resultados do que todos os outros métodos quando o cálculo disponível era baixo, o que os autores creditaram à maneira como ele verifica as respostas, e não à qualidade das respostas iniciais (já que ambas as variantes VF e CoT rapidamente alcançaram precisões semelhantes).

PHP se saiu pior, mesmo reutilizando respostas anteriores como dicas, provavelmente porque os LLMs não exploraram essas dicas bem.

Em contraste com PHP e Self-Correction, que acumulam contexto ao longo das iterações, Iter-VF considera apenas a resposta mais recente a cada passo. Esta abordagem Markoviana evita a confusão composta de cadeias de raciocínio estendidas – uma fraqueza especialmente prejudicial para Self-Correction.

Métodos paralelos, como Self-Consistency e Best-of-N, evitaram esse problema, embora suas melhorias tenham sido mais lentas e modestas.

(n.b. A seção de resultados, embora completa, é uma leitura desagradável e prolixa, e devemos, a este ponto, truncar a maior parte da cobertura restante, referindo o leitor ao artigo de origem para mais detalhes).

Quando testado em GPT-5 Nano e GPT-5 Mini, modelos comerciais fechados que ocultam a trilha completa de raciocínio e retornam apenas a resposta final, Iter-VF melhorou o desempenho sem depender de saídas intermediárias. Na tabela abaixo, podemos ver ganhos em ambos MATH500 e GPQA, confirmando que a abordagem de verificar-então-gerar permanece viável mesmo quando apenas a entrada e a resposta final são acessíveis:

Precisão em MATH500 e GPQA quando Iter-VF é aplicado a modelos GPT-5 com rastros de raciocínio ocultos.

Conclusão

Embora o novo artigo se torne opaco a partir da seção de resultados, a aparente descoberta de um traço abrangente em uma classe de modelos de IA é, no entanto, um desenvolvimento fascinante. Qualquer pessoa que use regularmente um LLM terá desenvolvido instintivamente um conjunto de truques para trabalhar em torno das limitações do modelo, à medida que cada uma se torna óbvia com o tempo, e o padrão emerge; e todos esperam encontrar um ‘truque’ tão aplicável e generalizado quanto este.

Um dos maiores problemas na implementação e atualização de uma janela de contexto em um LLM parece ser encontrar um equilíbrio entre a retenção do progresso da sessão e a capacidade de se lançar em direções novas quando necessário, sem cair em alucinações espúrias ou saídas fora do tópico. No caso apresentado pelo novo artigo, vemos um exemplo de um ‘chamado de despertar’ suave, mas insistente, que parece re-focar e redefinir o LLM sem perda de contexto. Será interessante ver se projetos subsequentes adaptam e evoluem o método.

Os pesquisadores enfatizam muito a economia de seu novo método – uma consideração que teria tido muito menos peso mesmo há 12 meses. Esses dias, as implicações do AI em larga escala tornam claro que economias de recursos antes consideradas pedantes, na ‘era de pesquisa pura’, agora estão se tornando essenciais e cardinais.

* Por favor, note que estou restrito a incluir o número usual de citações do artigo, desde que o padrão de inglês encontrado em algumas partes dele poderia confundir o leitor. Assim, tomei a liberdade de resumir as principais ideias, e remeto o leitor ao artigo de origem para verificação.

Publicado pela primeira vez na quinta-feira, 4 de dezembro de 2025