Engenharia de prompts

O que é Chain-of-Thought (CoT) Prompting? Exemplos e Benefícios

Nos últimos anos, grandes modelos de linguagem (LLMs) fizeram avanços notáveis em sua capacidade de entender e gerar textos semelhantes aos humanos. Esses modelos, como o GPT da OpenAI e o Claude da Anthropic, demonstraram desempenho impressionante em uma ampla gama de tarefas de processamento de linguagem natural. No entanto, quando se trata de tarefas de raciocínio complexas que exigem múltiplos passos de pensamento lógico, os métodos tradicionais de prompting frequentemente não atendem às expectativas. É aqui que o Chain-of-Thought (CoT) prompting entra em jogo, oferecendo uma poderosa técnica de engenharia de prompts para melhorar as capacidades de raciocínio dos grandes modelos de linguagem.

Principais Pontos

- O prompting CoT melhora as capacidades de raciocínio gerando etapas intermediárias.

- Ele divide problemas complexos em sub-problemas menores e gerenciáveis.

- Os benefícios incluem desempenho melhorado, interpretabilidade e generalização.

- O prompting CoT se aplica ao raciocínio aritmético, senso comum e simbólico.

- Ele tem o potencial de impactar significativamente a IA em domínios diversos.

O que é Chain-of-Thought (CoT) Prompting?

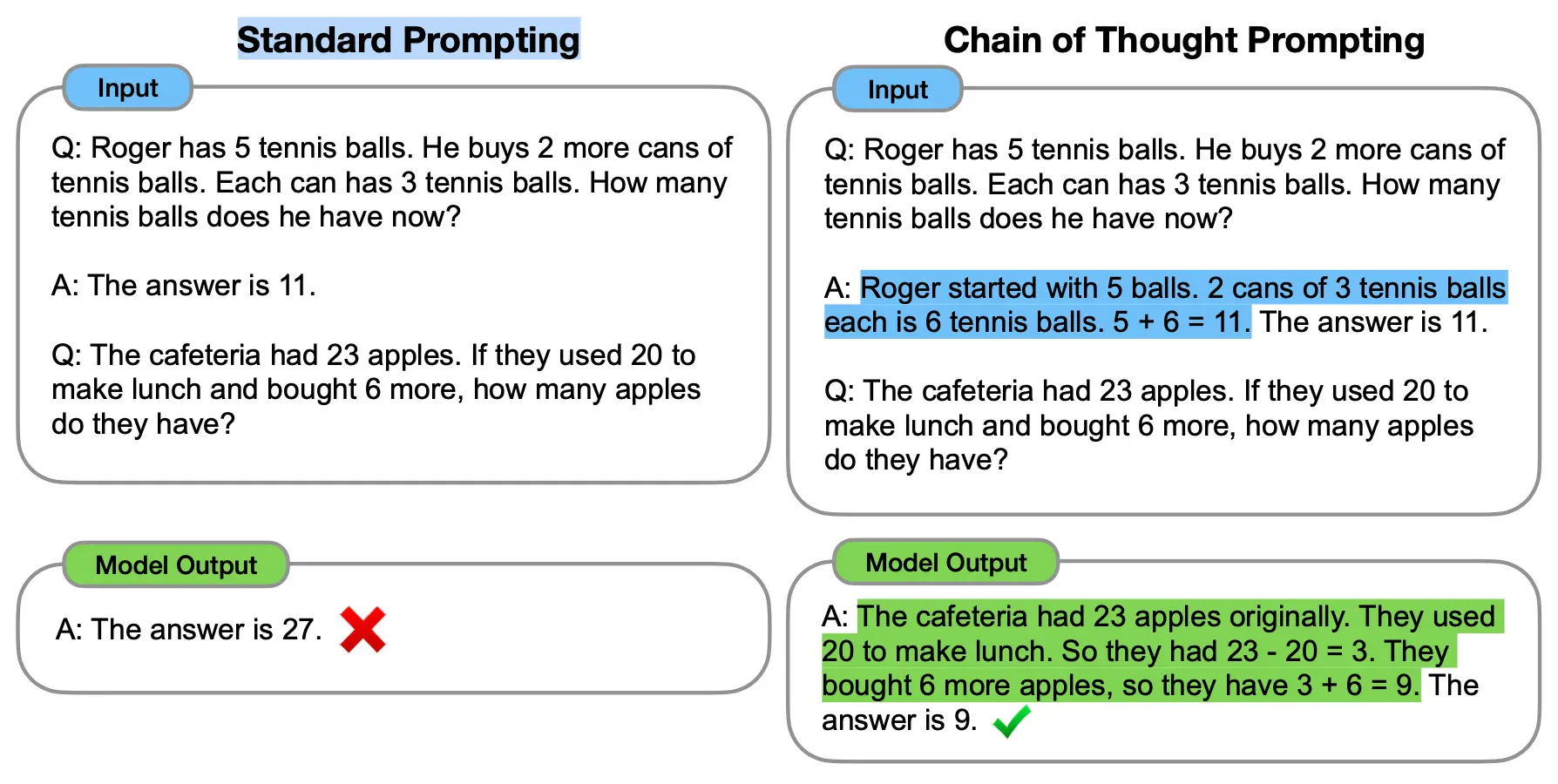

O Chain-of-Thought prompting é uma técnica que visa melhorar o desempenho dos grandes modelos de linguagem em tarefas de raciocínio complexas, incentivando o modelo a gerar etapas intermediárias de raciocínio. Ao contrário dos métodos tradicionais de prompting, que normalmente fornecem um único prompt e esperam uma resposta direta, o prompting CoT divide o processo de raciocínio em uma série de etapas menores e interconectadas.

No seu núcleo, o prompting CoT envolve fornecer ao modelo de linguagem uma pergunta ou problema e, em seguida, guiá-lo para gerar uma cadeia de pensamento – uma sequência de etapas intermediárias de raciocínio que levam à resposta final. Ao modelar explicitamente o processo de raciocínio, o prompting CoT permite que o modelo de linguagem aborde tarefas de raciocínio complexas de forma mais eficaz.

Uma das principais vantagens do prompting CoT é que ele permite que o modelo de linguagem decomponha um problema complexo em sub-problemas mais gerenciáveis. Ao gerar etapas intermediárias de raciocínio, o modelo pode dividir a tarefa de raciocínio geral em etapas menores e mais focadas. Essa abordagem ajuda o modelo a manter a coerência e reduz as chances de perder o foco ou gerar informações irrelevantes.

O prompting CoT mostrou resultados promissores na melhoria do desempenho dos grandes modelos de linguagem em uma variedade de tarefas de raciocínio complexas, incluindo raciocínio aritmético, raciocínio de senso comum e raciocínio simbólico. Ao aproveitar o poder das etapas intermediárias de raciocínio, o prompting CoT permite que os modelos de linguagem exibam uma compreensão mais profunda do problema em questão e gerem respostas mais precisas e coerentes.

Padrão vs CoT prompting (Wei et al., Google Research, Brain Team)

Como Funciona o Chain-of-Thought Prompting

O prompting CoT funciona gerando uma série de etapas intermediárias de raciocínio que guiam o modelo de linguagem através do processo de raciocínio. Em vez de simplesmente fornecer um prompt e esperar uma resposta direta, o prompting CoT incentiva o modelo a dividir o problema em etapas menores e mais gerenciáveis.

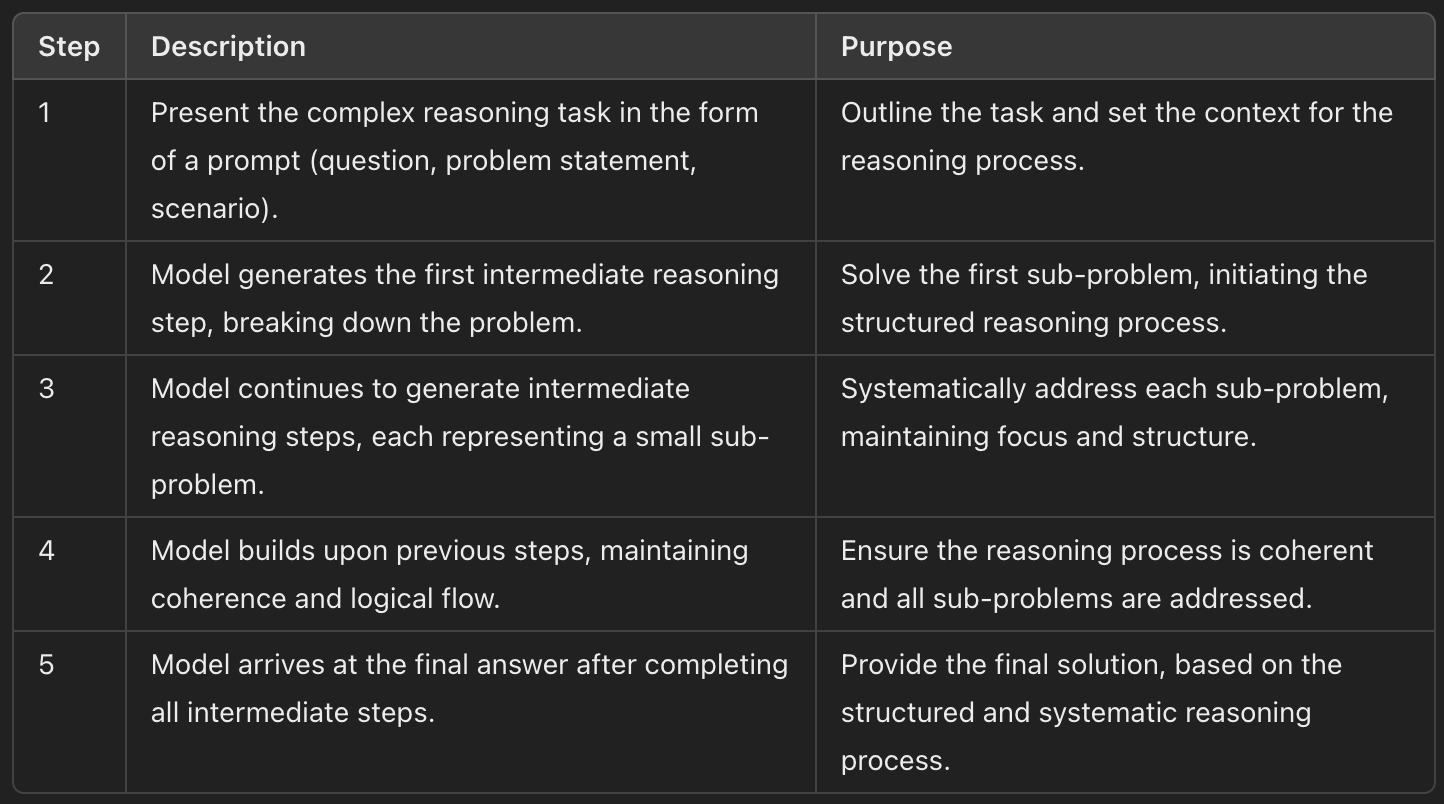

O processo começa apresentando ao modelo de linguagem um prompt que descreve a tarefa de raciocínio complexa em questão. Esse prompt pode ser na forma de uma pergunta, uma declaração de problema ou um cenário que exige pensamento lógico. Uma vez que o prompt é fornecido, o modelo gera uma sequência de etapas intermediárias de raciocínio que levam à resposta final.

Cada etapa intermediária de raciocínio na cadeia de pensamento representa um pequeno sub-problema focado que o modelo precisa resolver. Ao gerar essas etapas, o modelo pode abordar a tarefa de raciocínio geral de forma mais estruturada e sistemática. As etapas intermediárias permitem que o modelo mantenha a coerência e acompanhe o processo de raciocínio, reduzindo as chances de perder o foco ou gerar informações irrelevantes.

À medida que o modelo avança pela cadeia de pensamento, ele constrói sobre as etapas anteriores de raciocínio para chegar à resposta final. Cada etapa na cadeia está conectada às etapas anteriores e posteriores, formando um fluxo lógico de raciocínio. Essa abordagem passo a passo permite que o modelo aborde tarefas de raciocínio complexas de forma mais eficaz, pois ele pode se concentrar em um sub-problema de cada vez, mantendo ainda o contexto geral.

A geração de etapas intermediárias de raciocínio no prompting CoT é normalmente alcançada por meio de prompts e técnicas de treinamento cuidadosamente projetados. Pesquisadores e profissionais podem usar vários métodos para incentivar o modelo a produzir uma cadeia de pensamento, como fornecer exemplos de raciocínio passo a passo, usar tokens especiais para indicar o início e o fim de cada etapa de raciocínio ou ajustar o modelo em conjuntos de dados que demonstram o processo de raciocínio desejado.

Processo de 5 etapas do CoT prompting

Ao guiar o modelo de linguagem através do processo de raciocínio usando etapas intermediárias, o prompting CoT permite que o modelo resolva tarefas de raciocínio complexas de forma mais precisa e eficiente. A modelagem explícita do processo de raciocínio também melhora a interpretabilidade das saídas do modelo, pois a cadeia de pensamento gerada fornece insights sobre como o modelo chegou à sua resposta final.

Exemplos de Chain-of-Thought Prompting

O prompting CoT foi aplicado com sucesso a uma variedade de tarefas de raciocínio complexas, demonstrando sua eficácia na melhoria do desempenho dos grandes modelos de linguagem.

Vamos explorar alguns exemplos de como o prompting CoT pode ser usado em diferentes domínios.

Raciocínio Aritmético

Uma das aplicações mais diretas do prompting CoT é em tarefas de raciocínio aritmético. Ao gerar etapas intermediárias de raciocínio, o prompting CoT pode ajudar os modelos de linguagem a resolver problemas aritméticos multi-etapas de forma mais precisa.

Por exemplo, considere o seguinte problema:

"Se João tem 5 maçãs e Maria tem 3 vezes mais maçãs do que João, quantas maçãs Maria tem?"

Usando o prompting CoT, o modelo de linguagem pode gerar uma cadeia de pensamento como esta:

João tem 5 maçãs.Maria tem 3 vezes mais maçãs do que João.Para encontrar o número de maçãs que Maria tem, precisamos multiplicar as maçãs de João por 3.5 maçãs × 3 = 15 maçãsPortanto, Maria tem 15 maçãs.

Ao dividir o problema em etapas menores, o prompting CoT permite que o modelo de linguagem raciocine sobre o problema aritmético de forma mais eficaz.

Raciocínio de Senso Comum

O prompting CoT também mostrou promessa no enfrentamento de tarefas de raciocínio de senso comum, que exigem uma compreensão profunda do conhecimento cotidiano e do pensamento lógico.

Por exemplo, considere a seguinte pergunta:

"Se uma pessoa é alérgica a cães e seu amigo a convida para ir à casa dele, que tem um cão, o que a pessoa deve fazer?"

Um modelo de linguagem usando o prompting CoT pode gerar a seguinte cadeia de pensamento:

A pessoa é alérgica a cães.A casa do amigo tem um cão.Estar perto de cães pode desencadear a alergia da pessoa.Para evitar uma reação alérgica, a pessoa deve recusar o convite.A pessoa pode sugerir um local alternativo para encontrar o amigo.

Ao gerar etapas intermediárias de raciocínio, o prompting CoT permite que o modelo de linguagem demonstre uma compreensão mais clara da situação e forneça uma solução lógica.

Raciocínio Simbólico

O prompting CoT também foi aplicado a tarefas de raciocínio simbólico, que envolvem manipular e raciocinar com símbolos e conceitos abstratos.

Por exemplo, considere o seguinte problema:

"Se A implica B, e B implica C, A implica C?"

Usando o prompting CoT, o modelo de linguagem pode gerar uma cadeia de pensamento como esta:

A implica B significa que se A for verdadeiro, então B também deve ser verdadeiro.B implica C significa que se B for verdadeiro, então C também deve ser verdadeiro.Se A for verdadeiro, então B é verdadeiro (da etapa 1).Se B for verdadeiro, então C é verdadeiro (da etapa 2).Portanto, se A for verdadeiro, então C também deve ser verdadeiro.Então, A implica C.

Ao gerar etapas intermediárias de raciocínio, o prompting CoT permite que o modelo de linguagem lide com tarefas de raciocínio simbólico de forma mais eficaz.

Esses exemplos demonstram a versatilidade e a eficácia do prompting CoT na melhoria do desempenho dos grandes modelos de linguagem em tarefas de raciocínio complexas em diferentes domínios. Ao modelar explicitamente o processo de raciocínio por meio de etapas intermediárias, o prompting CoT melhora a capacidade do modelo de lidar com problemas desafiadores e gerar respostas mais precisas e coerentes.

Benefícios do Chain-of-Thought Prompting

O prompting CoT oferece vários benefícios significativos no avanço das capacidades de raciocínio dos grandes modelos de linguagem. Vamos explorar alguns dos principais benefícios:

Desempenho Melhorado em Tarefas de Raciocínio Complexas

Um dos principais benefícios do prompting CoT é sua capacidade de melhorar o desempenho dos modelos de linguagem em tarefas de raciocínio complexas. Ao gerar etapas intermediárias de raciocínio, o prompting CoT permite que os modelos dividam problemas intricados em sub-problemas mais gerenciáveis. Essa abordagem passo a passo permite que o modelo mantenha o foco e a coerência ao longo do processo de raciocínio, levando a resultados mais precisos e confiáveis.

Estudos mostraram que modelos de linguagem treinados com o prompting CoT consistentemente superam aqueles treinados com métodos tradicionais de prompting em uma ampla gama de tarefas de raciocínio complexas. A modelagem explícita do processo de raciocínio por meio de etapas intermediárias provou ser uma técnica poderosa para melhorar a capacidade do modelo de lidar com problemas desafiadores que exigem raciocínio multi-etapas.

Interpretabilidade Aumentada do Processo de Raciocínio

Outro benefício significativo do prompting CoT é a interpretabilidade aumentada do processo de raciocínio. Ao gerar uma cadeia de pensamento, o modelo de linguagem fornece uma explicação clara e transparente de como ele chegou à sua resposta final. Essa quebra passo a passo do processo de raciocínio permite que os usuários entendam o processo de pensamento do modelo e avaliem a validade de suas conclusões.

A interpretabilidade oferecida pelo prompting CoT é particularmente valiosa em domínios onde o próprio processo de raciocínio é de interesse, como em ambientes educacionais ou em sistemas que exigem IA explicável. Ao fornecer insights sobre o processo de raciocínio do modelo, o prompting CoT facilita a confiança e a responsabilidade no uso de grandes modelos de linguagem.

Potencial para Generalização para Diversas Tarefas de Raciocínio

O prompting CoT demonstrou seu potencial para generalizar para uma ampla gama de tarefas de raciocínio. Embora a técnica tenha sido aplicada com sucesso a domínios específicos como raciocínio aritmético, raciocínio de senso comum e raciocínio simbólico, os princípios subjacentes do prompting CoT podem ser estendidos a outros tipos de tarefas de raciocínio complexas.

A capacidade de gerar etapas intermediárias de raciocínio é uma habilidade fundamental que pode ser aproveitada em diferentes domínios de problemas. Ao ajustar os modelos de linguagem em conjuntos de dados que demonstram o processo de raciocínio desejado, o prompting CoT pode ser adaptado para lidar com novas tarefas de raciocínio, expandindo sua aplicabilidade e impacto.

Facilitando o Desenvolvimento de Sistemas de IA mais Capazes

O prompting CoT desempenha um papel crucial na facilitação do desenvolvimento de sistemas de IA mais capazes e inteligentes. Ao melhorar as capacidades de raciocínio dos grandes modelos de linguagem, o prompting CoT contribui para a criação de sistemas de IA que possam lidar com problemas complexos e exibir níveis mais altos de compreensão.

À medida que os sistemas de IA se tornam mais sofisticados e são implantados em vários domínios, a capacidade de realizar tarefas de raciocínio complexas se torna cada vez mais importante. O prompting CoT fornece uma ferramenta poderosa para melhorar as habilidades de raciocínio desses sistemas, permitindo que eles lidem com problemas mais desafiadores e tomem decisões mais informadas.

Um Resumo Rápido

O prompting CoT é uma técnica poderosa que melhora as capacidades de raciocínio dos grandes modelos de linguagem gerando etapas intermediárias de raciocínio. Ao dividir problemas complexos em sub-problemas mais gerenciáveis, o prompting CoT permite que os modelos lidem com tarefas de raciocínio desafiadoras de forma mais eficaz. Essa abordagem melhora o desempenho, aumenta a interpretabilidade e facilita o desenvolvimento de sistemas de IA mais capazes.

Perguntas Frequentes

Como funciona o Chain-of-Thought Prompting (CoT)?

O prompting CoT funciona gerando uma série de etapas intermediárias de raciocínio que guiam o modelo de linguagem através do processo de raciocínio, dividindo problemas complexos em sub-problemas mais gerenciáveis.

Quais são os benefícios de usar o Chain-of-Thought Prompting?

Os benefícios do prompting CoT incluem desempenho melhorado em tarefas de raciocínio complexas, interpretabilidade aumentada do processo de raciocínio, potencial para generalização para diversas tarefas de raciocínio e facilitação do desenvolvimento de sistemas de IA mais capazes.

Quais são alguns exemplos de tarefas que podem ser melhoradas com o Chain-of-Thought Prompting?

Alguns exemplos de tarefas que podem ser melhoradas com o prompting CoT incluem raciocínio aritmético, raciocínio de senso comum, raciocínio simbólico e outras tarefas de raciocínio complexas que exigem múltiplos passos de pensamento lógico.