Inteligência artificial

Agentes Móveis: Agente Autônomo Multimodal de Dispositivos Móveis com Percepção Visual

O advento dos Modelos Multimodais de Grandes Linguagens (MLLM) inaugurou uma nova era de agentes de dispositivos móveis, capazes de compreender e interagir com o mundo por meio de texto, imagens e voz. Esses agentes marcam um avanço significativo em relação à IA tradicional, fornecendo uma maneira mais rica e intuitiva para os usuários interagirem com seus dispositivos. Ao aproveitar o MLLM, estes agentes podem processar e sintetizar grandes quantidades de informação de diversas modalidades, permitindo-lhes oferecer assistência personalizada e melhorar as experiências do utilizador de formas anteriormente inimagináveis.

Esses agentes são alimentados por técnicas de aprendizado de máquina de última geração e recursos avançados de processamento de linguagem natural, permitindo-lhes compreender e gerar texto semelhante ao humano, bem como interpretar dados visuais e auditivos com notável precisão. Desde o reconhecimento de objetos e cenas em imagens até a compreensão de comandos falados e a análise de sentimentos de texto, esses agentes multimodais estão equipados para lidar perfeitamente com uma ampla gama de entradas. O potencial desta tecnologia é vasto, oferecendo serviços mais sofisticados e contextualmente conscientes, como assistentes virtuais sintonizados com as emoções humanas e ferramentas educacionais que se adaptam aos estilos de aprendizagem individuais. Têm também o potencial de revolucionar a acessibilidade, tornando a tecnologia mais acessível através das barreiras linguísticas e sensoriais.

Neste artigo, falaremos sobre Mobile-Agents, um agente de dispositivo multimodal autônomo que primeiro aproveita a capacidade das ferramentas de percepção visual para identificar e localizar com precisão os elementos visuais e textuais com a interface front-end de um aplicativo móvel. Usando esse contexto de visão percebido, a estrutura do Agente Móvel planeja e decompõe a complexa tarefa de operação de forma autônoma e navega pelos aplicativos móveis através de operações passo a passo. A estrutura do Mobile-Agent difere das soluções existentes, pois não depende de metadados de sistemas móveis ou arquivos XML de aplicativos móveis, permitindo espaço para maior adaptabilidade em diversos ambientes operacionais móveis de uma forma centrada na visão. A abordagem seguida pela estrutura do Mobile-Agent elimina a necessidade de personalizações específicas do sistema, resultando em melhor desempenho e menores requisitos de computação.

Agentes Móveis: Agente Autônomo Multimodal de Dispositivos Móveis

No mundo acelerado da tecnologia móvel, um conceito pioneiro surge como destaque: Modelos de Grandes Linguagens, especialmente Modelos Multimodais de Grandes Linguagens ou MLLMs capazes de gerar uma ampla gama de textos, imagens, vídeos e fala em diferentes idiomas. O rápido desenvolvimento de estruturas MLLM nos últimos anos deu origem a uma nova e poderosa aplicação de MLLMs: agentes móveis autônomos. Agentes móveis autônomos são entidades de software que agem, se movem e funcionam de forma independente, sem a necessidade de comandos humanos diretos, projetados para percorrer redes ou dispositivos para realizar tarefas, coletar informações ou resolver problemas.

Os Agentes Móveis são projetados para operar o dispositivo móvel do usuário com base nas instruções do usuário e nos recursos visuais da tela, uma tarefa que exige que os agentes possuam compreensão semântica e capacidades de percepção visual. No entanto, os agentes móveis existentes estão longe de ser perfeitos, uma vez que são baseados em modelos multimodais de grandes linguagens, e mesmo as atuais estruturas MLLM de última geração, incluindo GPT-4V, carecem de habilidades de percepção visual necessárias para servir como um agente eficiente. agente móvel. Além disso, embora as estruturas existentes possam gerar operações eficazes, elas lutam para localizar com precisão a posição dessas operações na tela, limitando as aplicações e a capacidade dos agentes móveis de operar em dispositivos móveis.

Para resolver esse problema, alguns frameworks optaram por aproveitar os arquivos de layout da interface do usuário para auxiliar o GPT-4V ou outros MLLMs com recursos de localização, com alguns frameworks conseguindo extrair posições acionáveis na tela acessando os arquivos XML do aplicativo, enquanto outros frameworks optou por usar o código HTML das aplicações web. Como pode ser visto, a maioria dessas estruturas depende do acesso a arquivos de aplicativos subjacentes e locais, tornando o método quase ineficaz se a estrutura não puder acessar esses arquivos. Para resolver esse problema e eliminar a dependência dos agentes locais dos arquivos subjacentes aos métodos de localização, os desenvolvedores trabalharam no Mobile-Agent, um agente móvel autônomo com impressionantes capacidades de percepção visual. Usando seu módulo de percepção visual, a estrutura Mobile-Agent utiliza capturas de tela do dispositivo móvel para localizar as operações com precisão. O módulo de percepção visual abriga modelos de OCR e detecção que são responsáveis por identificar o texto na tela e descrever o conteúdo em uma região específica da tela do celular. A estrutura Mobile-Agent emprega prompts cuidadosamente elaborados e facilita a interação eficiente entre as ferramentas e os agentes, automatizando assim as operações do dispositivo móvel.

Além disso, a estrutura de agentes móveis visa aproveitar os recursos contextuais de estruturas MLLM de última geração, como GPT-4V, para obter recursos de autoplanejamento que permitem ao modelo planejar tarefas com base no histórico de operações, instruções do usuário e capturas de tela de forma holística. Para melhorar ainda mais a capacidade do agente de identificar instruções incompletas e operações erradas, a estrutura do Agente Móvel introduz um método de autorreflexão. Sob a orientação de prompts cuidadosamente elaborados, o agente reflete consistentemente sobre operações incorretas e inválidas e interrompe as operações assim que a tarefa ou instrução for concluída.

No geral, as contribuições da estrutura do Agente Móvel podem ser resumidas da seguinte forma:

- O Mobile-Agent atua como um agente autônomo para dispositivos móveis, utilizando ferramentas de percepção visual para realizar a localização das operações. Ele planeja metodicamente cada etapa e se envolve em introspecção. Notavelmente, o Mobile-Agent utiliza exclusivamente capturas de tela dos dispositivos, sem o uso de nenhum código do sistema, apresentando uma solução puramente baseada em técnicas de visão.

- O Mobile-Agent apresenta o Mobile-Eval, um benchmark desenvolvido para avaliar agentes de dispositivos móveis. Este benchmark inclui uma variedade dos dez aplicativos móveis mais usados, juntamente com instruções inteligentes para esses aplicativos, categorizados em três níveis de dificuldade.

Agente Móvel: Arquitetura e Metodologia

Em sua essência, a estrutura do Mobile-Agent consiste em um estado da arte Modelo Multimodal de Grande Linguagem, o GPT-4V, um módulo de detecção de texto usado para tarefas de localização de texto. Junto com o GPT-4V, o Mobile-Agent também emprega um módulo de detecção de ícones para localização de ícones.

Percepção visual

Conforme mencionado anteriormente, o GPT-4V MLLM oferece resultados satisfatórios para instruções e capturas de tela, mas não consegue exibir efetivamente o local onde as operações ocorrem. Devido a esta limitação, o framework Mobile-Agent que implementa o modelo GPT-4V precisa contar com ferramentas externas para auxiliar na localização da operação, facilitando assim a saída das operações na tela do celular.

Localização de Texto

A estrutura Mobile-Agent implementa uma ferramenta de OCR para detectar a posição do texto correspondente na tela sempre que o agente precisar tocar em um texto específico exibido na tela do celular. Existem três cenários exclusivos de localização de texto.

Cenário 1: Nenhum texto especificado detectado

Questão: O OCR não consegue detectar o texto especificado, o que pode ocorrer em imagens complexas ou devido a limitações do OCR.

Resposta: Instrua o agente a:

- Resselecione o texto para tocar, permitindo uma correção manual da supervisão do OCR, ou

- Escolha uma operação alternativa, como usar um método de entrada diferente ou executar outra ação relevante para a tarefa em questão.

Raciocínio: Essa flexibilidade é necessária para gerenciar imprecisões ou alucinações ocasionais do GPT-4V, garantindo que o agente ainda possa prosseguir com eficácia.

Cenário 2: Detectada Instância Única de Texto Especificado

Operação: Gere automaticamente uma ação para clicar nas coordenadas centrais da caixa de texto detectada.

Justificação: Com apenas uma instância detectada, a probabilidade de identificação correta é alta, tornando eficiente prosseguir com uma ação direta.

Cenário 3: Múltiplas Instâncias de Texto Especificado Detectadas

avaliação: Primeiro, avalie o número de instâncias detectadas:

Muitas instâncias: Indica uma tela repleta de conteúdos semelhantes, complicando o processo de seleção.

Ação: Solicite ao agente que selecione novamente o texto, visando refinar a seleção ou ajustar os parâmetros de busca.

Algumas instâncias: Um número gerenciável de detecções permite uma abordagem mais sutil.

Ação: Corte as regiões ao redor dessas instâncias, expandindo as caixas de detecção de texto para capturar contexto adicional. Essa expansão garante que mais informações sejam preservadas, auxiliando na tomada de decisões.

Próximo passo: Desenhe caixas de detecção nas imagens recortadas e apresente-as ao agente. Essa assistência visual ajuda o agente a decidir com qual instância interagir, com base em pistas contextuais ou requisitos de tarefa.

Essa abordagem estruturada otimiza a interação entre os resultados do OCR e as operações do agente, aumentando a confiabilidade e a adaptabilidade do sistema ao lidar com tarefas baseadas em texto em diversos cenários. Todo o processo é demonstrado na imagem a seguir.

Localização de ícones

A estrutura Mobile-Agent implementa uma ferramenta de detecção de ícones para localizar a posição de um ícone quando o agente precisa clicar nele na tela do celular. Para ser mais específico, a estrutura primeiro solicita ao agente que forneça atributos específicos da imagem, incluindo forma e cor, e então a estrutura implementa o método Grounding DINO com o ícone de prompt para identificar todos os ícones contidos na captura de tela. Finalmente, Mobile-Agent emprega a estrutura CLIP para calcular a semelhança entre a descrição da região do clique, calcula a semelhança entre os ícones excluídos e seleciona a região com maior semelhança para um clique.

Execução de Instrução

Para traduzir as ações em operações na tela dos agentes, o framework Mobile-Agent define 8 operações diferentes.

- Iniciar aplicativo (nome do aplicativo): Inicie o aplicativo designado na interface da área de trabalho.

- Toque em Texto (rótulo de texto): Interaja com a parte da tela que exibe o rótulo “Rótulo de texto”.

- Interaja com o ícone (descrição do ícone, localização): Mire e toque na área do ícone especificada, onde “Descrição do ícone” detalha atributos como cor e forma do ícone. Escolha “Localização” entre opções como superior, inferior, esquerda, direita ou centro, possivelmente combinando duas para uma navegação precisa e para reduzir erros.

- Insira o texto (texto de entrada): Insira o “Texto de entrada” fornecido no campo de texto ativo.

- Rolar para cima e para baixo: Navegue para cima ou para baixo no conteúdo da página atual.

- Volte: Reverta para a página visualizada anteriormente.

- Fechar: Navegue de volta para a área de trabalho diretamente da tela atual.

- Parar: Conclua a operação assim que a tarefa for concluída.

Autoplanejamento

Cada etapa da operação é executada iterativamente pela estrutura e, antes do início de cada iteração, o usuário é obrigado a fornecer uma instrução de entrada, e o modelo Mobile-Agent usa a instrução para gerar um prompt do sistema para todo o processo. Além disso, antes do início de cada iteração, a estrutura captura uma captura de tela e a envia ao agente. O agente então observa a captura de tela, o histórico de operações e os prompts do sistema para gerar a próxima etapa das operações.

Auto-reflexão

Durante suas operações, o agente pode enfrentar erros que o impedem de executar um comando com sucesso. Para aumentar a taxa de cumprimento de instruções, uma abordagem de autoavaliação foi implementada, ativada em duas circunstâncias específicas. Inicialmente, se o agente executar uma ação falha ou inválida que interrompa o progresso, como quando reconhece que a captura de tela permanece inalterada após a operação ou exibe uma página incorreta, ele será direcionado a considerar ações alternativas ou ajustar os parâmetros da operação existente. Em segundo lugar, o agente pode perder alguns elementos de uma diretiva complexa. Depois que o agente tiver executado uma série de ações com base em seu plano inicial, ele será solicitado a revisar sua sequência de ações, a captura de tela mais recente e a diretiva do usuário para avaliar se a tarefa foi concluída. Se discrepâncias forem encontradas, o agente é encarregado de gerar autonomamente novas ações para cumprir a diretiva.

Agente Móvel: Experimentos e Resultados

Para avaliar suas habilidades de forma abrangente, a estrutura Mobile-Agent apresenta o benchmark Mobile-Eval que consiste em 10 aplicativos comumente usados e projeta três instruções para cada aplicativo. A primeira operação é simples e cobre apenas as operações básicas do aplicativo, enquanto a segunda operação é um pouco mais complexa que a primeira, pois possui alguns requisitos adicionais. Finalmente, a terceira operação é a mais complexa de todas, pois contém instruções abstratas do usuário, sem que o usuário especifique explicitamente qual aplicativo usar ou qual operação executar.

Seguindo em frente, para avaliar o desempenho de diferentes perspectivas, a estrutura Mobile-Agent projeta e implementa 4 métricas diferentes.

- Su ou Sucesso: Se o agente móvel seguir as instruções, será considerado um sucesso.

- Pontuação do processo ou PS: A métrica Process Score mede a precisão de cada etapa durante a execução das instruções do usuário e é calculada dividindo o número de etapas corretas pelo número total de etapas.

- Eficiência Relativa ou RE: A pontuação de eficiência relativa é uma razão ou comparação entre o número de etapas que um ser humano leva para executar a instrução manualmente e o número de etapas que um agente leva para executar a mesma instrução.

- Taxa de conclusão ou CR: A métrica da taxa de conclusão divide o número de etapas operadas por humanos que a estrutura conclui com êxito pelo número total de etapas executadas por um humano para concluir a instrução. O valor de CR é 1 quando o agente completa a instrução com sucesso.

Os resultados são demonstrados na figura a seguir.

Inicialmente, para as três tarefas propostas, o Agente Móvel atingiu taxas de conclusão de 91%, 82% e 82%, respectivamente. Embora nem todas as tarefas tenham sido executadas com perfeição, as taxas de realização para cada categoria de tarefa ultrapassaram 90%. Além disso, a métrica PS revela que o Agente Móvel demonstra consistentemente uma alta probabilidade de executar ações precisas para as três tarefas, com taxas de sucesso em torno de 80%. Além disso, de acordo com a métrica RE, o Agente Móvel demonstra uma eficiência de 80% na execução de operações em um nível comparável à otimização humana. Esses resultados, em conjunto, ressaltam a proficiência do Agente Móvel como assistente de dispositivos móveis.

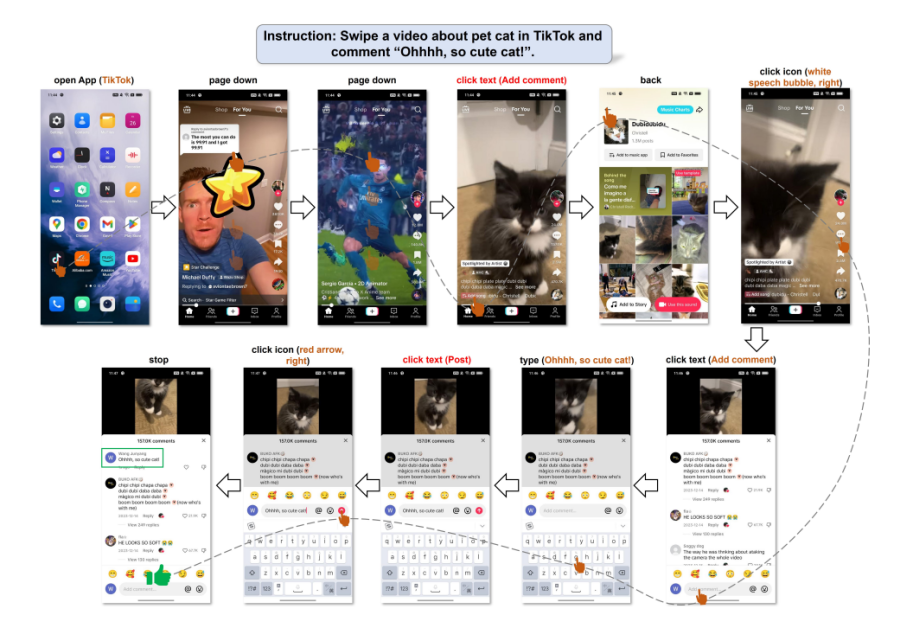

A figura a seguir ilustra a capacidade do Agente Móvel de compreender os comandos do usuário e orquestrar suas ações de forma independente. Mesmo na ausência de detalhes explícitos da operação nas instruções, o Agente Móvel interpretou habilmente as necessidades do usuário, convertendo-as em tarefas acionáveis. Seguindo essa compreensão, o agente executou as instruções por meio de um processo de planejamento sistemático.

Considerações Finais

Neste artigo, falamos sobre o Mobile-Agents, um agente de dispositivo autônomo multimodal que utiliza inicialmente tecnologias de percepção visual para detectar e identificar com precisão componentes visuais e textuais na interface de um aplicativo móvel. Com esse contexto visual em mente, o framework Mobile-Agent descreve e divide, de forma autônoma, tarefas complexas em ações gerenciáveis, navegando pelos aplicativos móveis passo a passo. Este framework se destaca das metodologias existentes, pois não depende dos metadados do sistema móvel nem dos arquivos XML dos aplicativos móveis, facilitando assim uma maior flexibilidade entre os diversos sistemas operacionais móveis, com foco no processamento centrado no visual. A estratégia empregada pelo framework Mobile-Agent elimina a necessidade de adaptações específicas do sistema, resultando em maior eficiência e redução das demandas computacionais.