Ângulo de Anderson

Jigsaw Puzzles Boost AI Visual Reasoning

Pesquisas recentes indicam que os modelos de IA podem se tornar mais inteligentes ao resolver quebra-cabeças. Reorganizar imagens, vídeos e cenas 3D embaralhadas ajuda a aprimorar suas habilidades visuais sem a necessidade de dados adicionais, rótulos ou ferramentas.

No atual cenário de corrida para impulsionar os Modelos de Linguagem Multimodal de Grande Escala (MLLMs) à frente do pacote (ou pelo menos ficar três lançamentos à frente do rival mais próximo), há poucas vitórias fáceis e nenhum almoço grátis.

Embora muitos dos impressionantes lançamentos de FOSS chineses em 2025 sejam relatados como tendo menores custos de desenvolvimento e execução, os lançamentos ocidentais tendem a jogar mais no problema: mais volume de dados, mais capacidade de inferência, mais eletricidade (embora não, como recentemente notamos, mais anotadores humanos reais, desde que isso é muito caro mesmo para a revolução de IA de escala de trilhão de dólares).

Na literatura de pesquisa, a maioria das abordagens supostamente “gratuitas” para a evolução de arquiteturas de IA tende a oferecer apenas melhorias incrementais menores; ou melhorias em áreas que não são as mais criticamente perseguidas. No entanto, a busca por “princípios fundamentais” ainda não descobertos que pudessem acelerar o ritmo do desenvolvimento é muito tentadora para ser abandonada.

Pegando os Pedacos

Embora não exatamente nessa categoria, uma nova colaboração acadêmica entre instituições chinesas alega ter determinado que fazer com que os VLMs resolvam quebra-cabeças melhora significativamente seu desempenho, mesmo que essa abordagem de aprendizado por reforço tenha se saído mal anteriormente nessa área, e mesmo que não exija sistemas adicionais, modelos auxiliares ou outros processos “acessórios”:

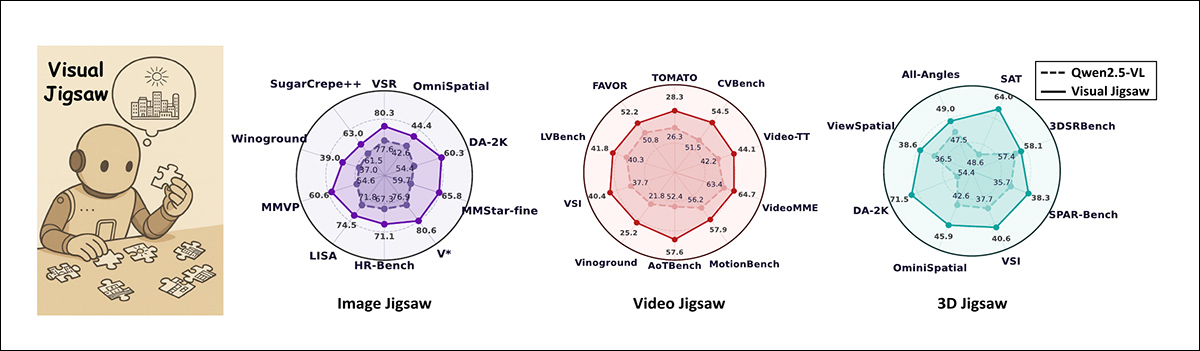

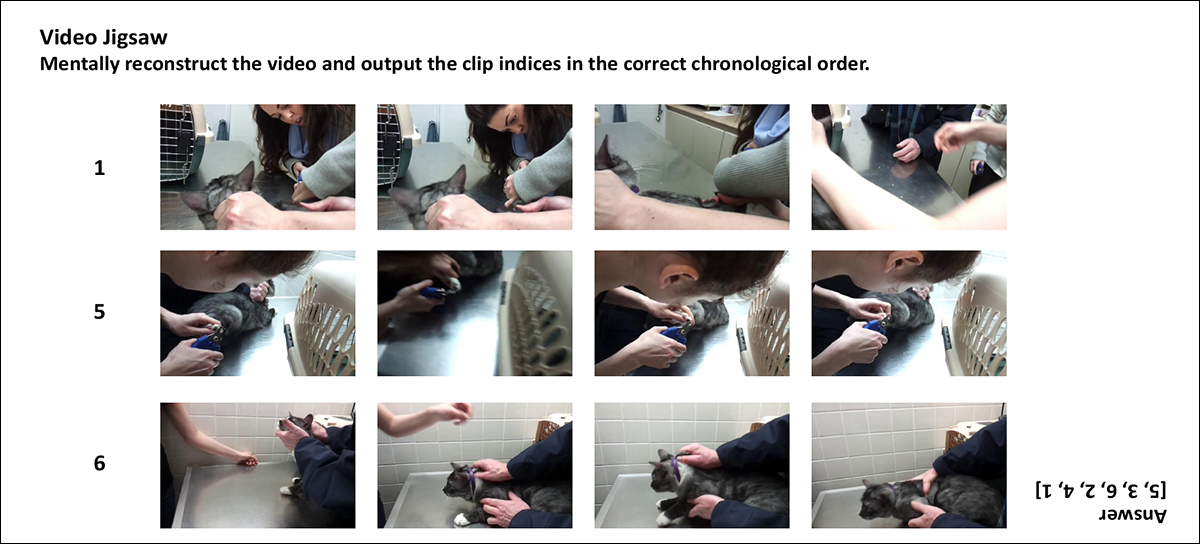

Visual Jigsaw é um quadro de treinamento pós-treinamento auto-supervisionado que melhora as habilidades visuais centradas em multimodal large language models. Ao treinar em tarefas de quebra-cabeça em imagens, vídeos e dados 3D, os modelos ganham percepção mais aguçada, fina, espacial e composicional em imagens, raciocínio temporal mais forte em vídeos e compreensão geométrica aprimorada em cenas 3D. Os gráficos de radar na imagem acima mostram ganhos consistentes sobre o Qwen2.5-VL, com escalas de valor ajustadas para cada benchmark para clareza. Fonte: https://arxiv.org/pdf/2509.25190

O sistema concebido pelos pesquisadores é intitulado Visual Jigsaw, e envolve treinar MLLMs existentes em material que foi fragmentado e disperso aleatoriamente, como um quebra-cabeça. Os autores desenvolveram três modalidades para essa abordagem: imagem, vídeo e 3D (ou seja, malhas estilo CGI), e descobriram que uma adaptação moderada do mesmo processo beneficiou os três domínios:

Uma representação das três tarefas de Visual Jigsaw. No Jigsaw de Imagem, uma imagem é dividida em patches, embaralhada, e o modelo prevê o layout correto; no Jigsaw de Vídeo, os cliques são embaralhados e o modelo restaura sua ordem no tempo; no Jigsaw 3D, os pontos com diferentes profundidades são embaralhados e o modelo os classifica de mais próximo a mais distante. As saídas do modelo são pontuadas contra a verdade, com crédito parcial dado para soluções parcialmente corretas.

O método de treinamento do Visual Jigsaw ajuda os modelos de IA a melhorar na compreensão de informações visuais, fazendo com que eles reorganizem essas imagens, cliques de vídeo ou dados 3D embaralhados.

O processo é baseado em palavras, e não em imagens, e, portanto, não há necessidade de o modelo gerar imagens ou usar componentes visuais extras. Esse método se encaixa em um sistema chamado Aprendizado por Reforço de Recompensas Verificáveis (RLVR), onde o modelo recebe recompensas por respostas corretas com base em regras claras e automáticas; e onde, portanto, não é necessário rótulo humano.

Esse fato crucial é, na verdade, difícil de discernir do novo artigo: que o sistema está montando o quebra-cabeça semanticamente, por meio de descrições, e não da maneira representativa de forma que os humanos aprendem a resolver tais quebra-cabeças:

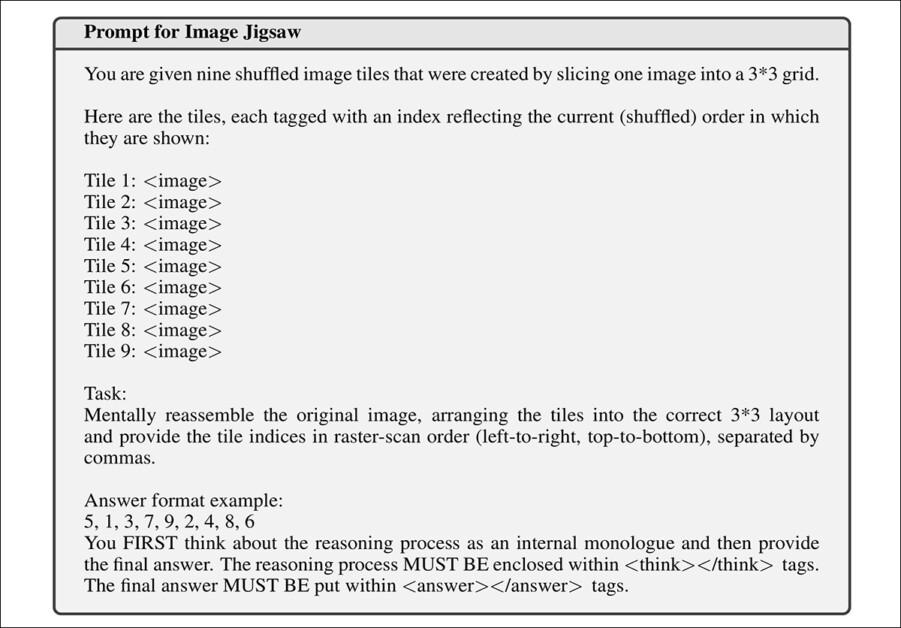

Do material suplementar do novo artigo, um exemplo de tarefa de RL que ilustra a natureza baseada em texto desse processo de aprendizado auxiliar. As imagens que seriam mostradas ao MLLM não são mostradas aqui.

Embora os MLLMs lidem extensivamente com tarefas centradas na visão, eles são arquiteturas baseadas em linguagem, e não projetados para gerar imagens, vídeos ou representações de forma, como malhas 3D.

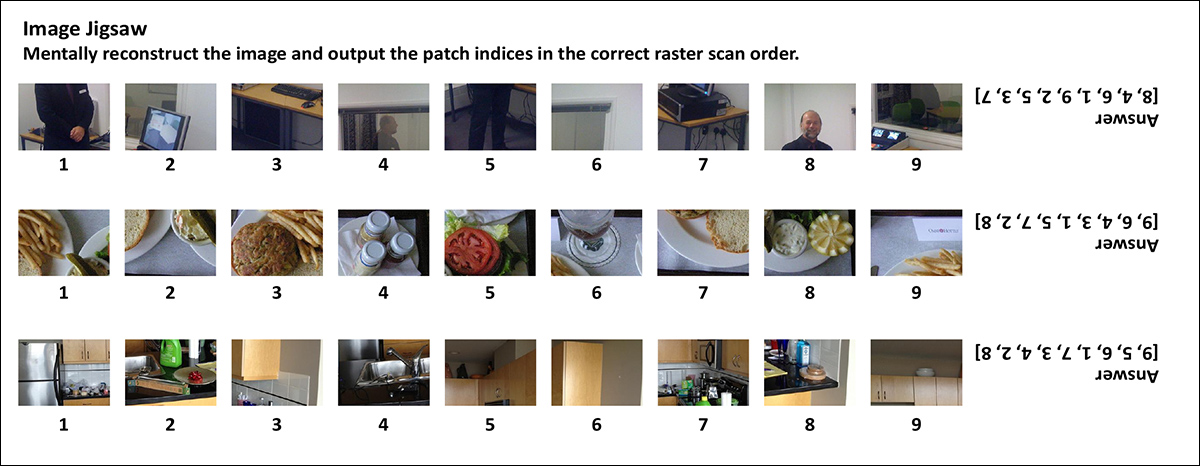

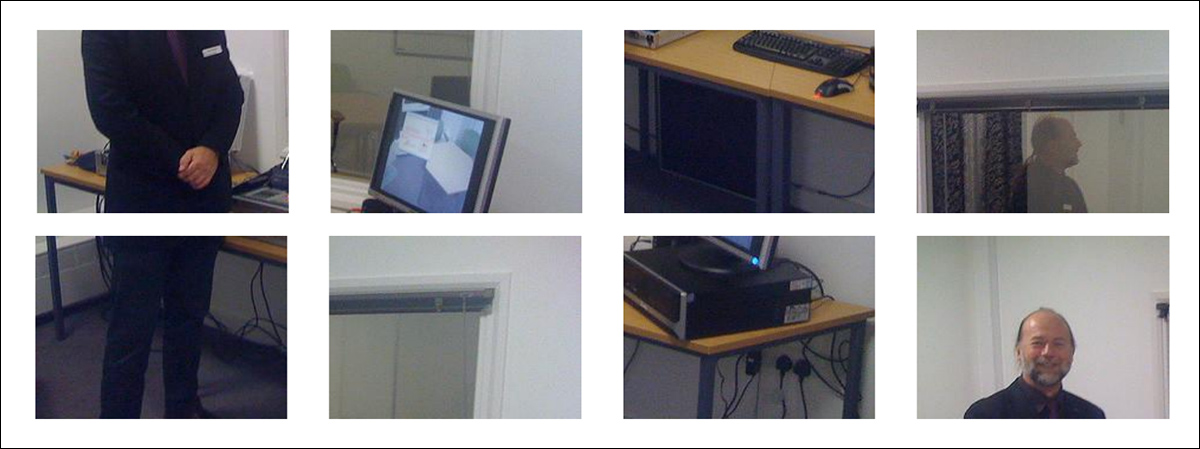

Exemplos da tarefa de quebra-cabeça de imagem. Cada linha mostra patches embaralhados que o modelo deve reorganizar no layout original, com o arranjo correto mostrado à direita.

De qualquer forma, esse tipo de treinamento é feito após a fase principal de aprendizado, quando o modelo já tem alguma capacidade de entender imagens.

Abordagens anteriores, como o artigo suíço de 2017 Aprendizado não Supervisionado de Representações Visuais Resolvendo Quebra-Cabeças usaram esse tipo de abordagem de reforço com menos sucesso, em redes neurais convolucionais (CNNs), uma arquitetura notavelmente diferente em comparação com um MLLM moderno.

Do lançamento de 2017 ‘Aprendizado não Supervisionado de Representações Visuais Resolvendo Quebra-Cabeças ‘, um exemplo inicial do uso de fragmentação como um desafio baseado em recompensa para um sistema neural. Fonte: https://arxiv.org/pdf/1603.09246

Nos testes, o Visual Jigsaw levou a melhorias consistentes e mensuráveis em uma ampla gama de benchmarks: a tarefa de quebra-cabeça de imagem melhorou a percepção fina, a compreensão da estrutura espacial e o raciocínio composicional; a tarefa de quebra-cabeça de vídeo melhorou a capacidade do modelo de rastrear sequências temporais e raciocinar sobre a ordem de eventos; e a tarefa de quebra-cabeça 3D fortaleceu a compreensão baseada em profundidade e o raciocínio espacial usando apenas entradas RGB-D.

Em todas as três modalidades, o artigo reitera, o novo método superou várias linhas de base competitivas, apesar de não exigir alterações arquiteturais, módulos visuais extras ou dados supervisionados adicionais:

‘Experimentos extensivos demonstram melhorias substanciais na percepção fina, no raciocínio temporal e na compreensão espacial 3D. Nossas descobertas destacam o potencial de tarefas visuais auto-supervisionadas no pós-treinamento de MLLMs e visam inspirar mais pesquisas sobre designs de pretextos visuais.’

O novo artigo é intitulado Visual Jigsaw Post-Training Improves MLLMs, e vem de seis pesquisadores de Nanyang Technological University, Linköping University e SenseTime Research. O artigo é acompanhado por um site do projeto com demonstrações ao vivo (e você pode até carregar sua própria imagem no demo de quebra-cabeça de imagem). O código e pesos do projeto foram disponibilizados,

Método

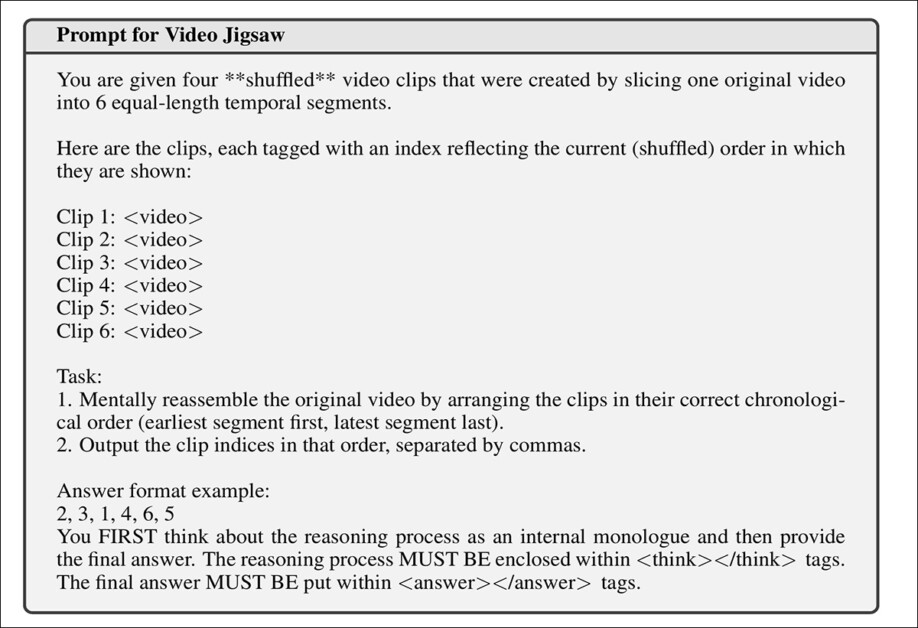

Embora vamos dar uma olhada na forma como as informações são divididas para acomodar as três modalidades testadas, devemos primeiro considerar o design de recompensa para o novo sistema.

A abordagem do Visual Jigsaw pontua as respostas do modelo usando uma recompensa graduada, e não apenas um simples passar ou falhar. Se o modelo prevê a ordem exata correta das peças do quebra-cabeça, ele recebe uma recompensa completa; se a resposta está quase certa, mas não perfeita, o modelo recebe crédito parcial, escalonado por um fator de desconto para evitar supervalorizar quase-acertos (isso impede que o modelo “jogue” o sistema repetindo palpites que são apenas parcialmente corretos).

Respostas inválidas, como o “golpe” de usar o mesmo número repetidamente, recebem uma pontuação de zero. Para encorajar formatação consistente, o modelo deve colocar seu raciocínio dentro de <think> tags e sua resposta final dentro de <answer> tags. Ele recebe um pequeno bônus se esse formato é usado corretamente.

Imagens

Para criar um quebra-cabeça para a imagem modality, uma imagem é primeiro dividida em uma grade de patches cortando-a em blocos de tamanho igual:

Exemplos de patches de imagem para o sistema resolver.

Os patches são dispostos em uma ordem fixa de cima para baixo, como na ordem de leitura de uma página, antes de serem embaralhados com um embaralhamento aleatório. O modelo é então exposto a esse conjunto embaralhado de patches e deve descobrir a ordem original, prevendo a permutação correta que restaura o layout original.

No treinamento, 118.000 imagens do conjunto de dados COCO foram usadas, com cada imagem produzindo nove patches (ou seja, ‘peças do quebra-cabeça’). O prompt dado ao sistema é mostrado anteriormente neste artigo (a imagem acima com a legenda começando com ‘Do material suplementar do novo artigo’).

Vídeo

Para a tarefa de quebra-cabeça de vídeo, um vídeo é cortado em uma sequência de cliques cortando-o uniformemente ao longo do tempo, e então embaralhando os segmentos de clipe. O modelo é então mostrado essa sequência embaralhada e deve descobrir sua ordem cronológica original correta.

Exemplos truncados do desafio de quebra-cabeça de vídeo, do material suplementar do artigo.

O treinamento para essa modalidade usou 100.000 vídeos do conjunto de dados LLaVA-Video, com cada vídeo dividido em seis cliques. Para evitar que o modelo explore dicas de correspondência de frame óbvias nos limites dos cliques, 5% dos frames no início e no final de cada clipe foram cortados.

Os cliques continham no máximo 12 frames, cada um com uma resolução máxima de 128x28x28 pixels. Vídeos com menos de 24 segundos foram excluídos.

O prompt para essa tarefa é mostrado abaixo:

O prompt de aprendizado por reforço apresentado aos MLLMs para a tarefa de vídeo, sem os cliques que seriam apresentados ao MLLM..

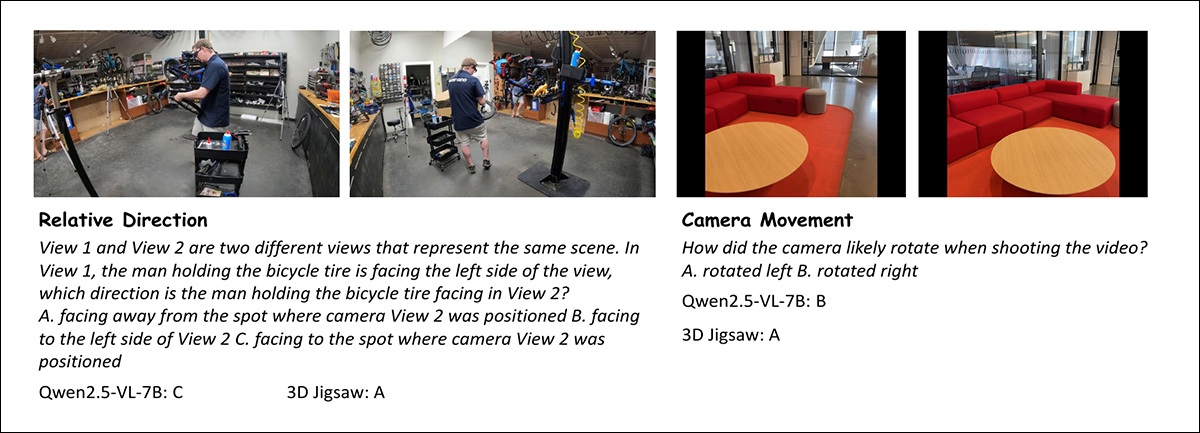

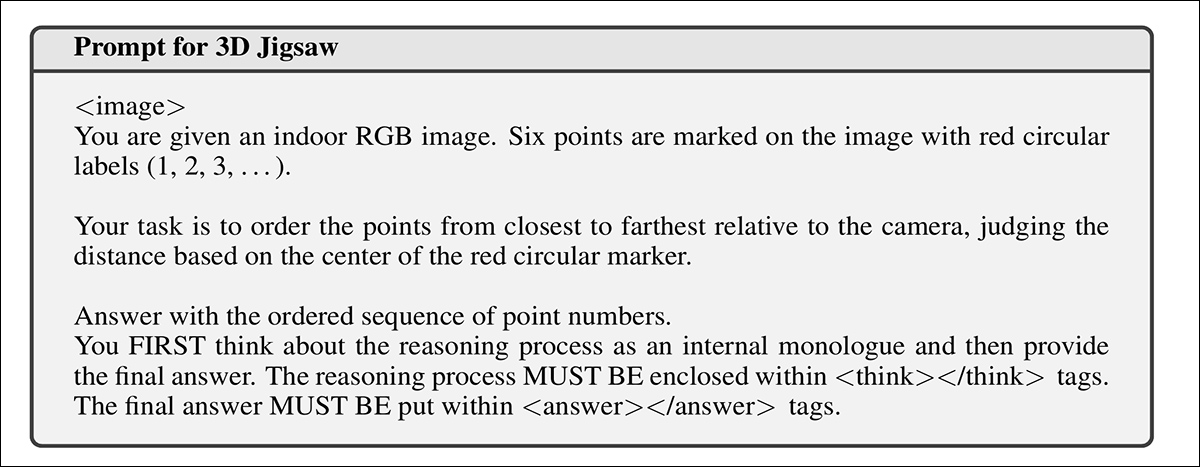

Dados 3D

Uma tarefa de quebra-cabeça 3D completa normalmente envolveria quebrar um espaço 3D (como blocos voxel ou fragmentos de nuvem de pontos) em pedaços menores e treinar um modelo para reconstruir sua disposição espacial original.

No entanto, o MLLM médio não está equipado para lidar com dados 3D brutos diretamente, dependendo em vez disso de entradas de imagem ou vídeo semanticamente interpretadas. Portanto, para criar uma tarefa que ainda aproveite o raciocínio 3D, mas permaneça compatível com os atuais MLLMs, os autores introduziram uma variante mais tangível usando as imagens RGB-D mencionadas anteriormente (ou seja, imagens 2D que incluem informações de profundidade para cada pixel).

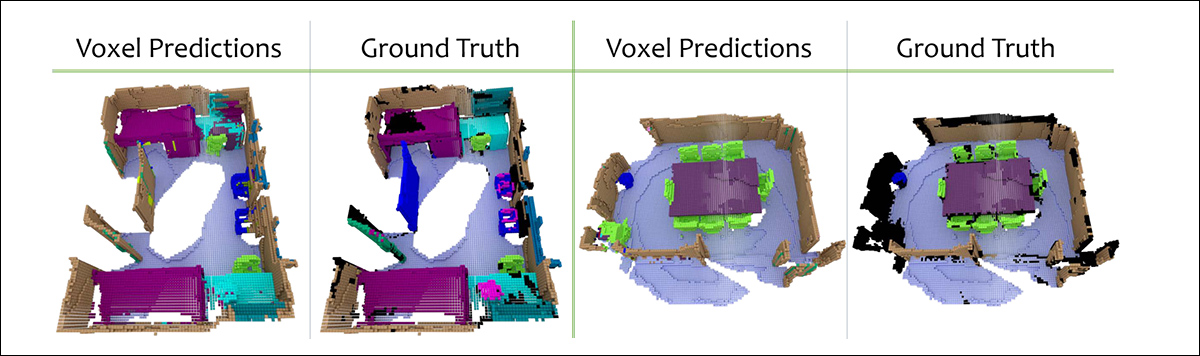

Exemplos de perguntas do 3D Spatial Understanding Benchmark usado para avaliar o desempenho no raciocínio de ponto de vista relativo e movimento de câmera. O modelo 3D Jigsaw infere corretamente tanto a relação espacial entre duas vistas de uma cena quanto a direção provável de rotação da câmera, superando a linha de base Qwen2.5-VL-7B.

A partir de cada imagem RGB-D, o modelo é dado uma lista embaralhada de pontos que originalmente tinham profundidades distintas, variando de perto a longe, o objetivo sendo recuperar sua ordem de profundidade correta usando apenas a imagem 2D como referência:

O prompt de RL para o quebra-cabeça 3D.

Cada ponto é marcado na imagem (que é mostrada ao modelo, mas não visualizada no exemplo de prompt na imagem acima), e o modelo deve prever qual foi o mais próximo, o segundo mais próximo, e assim por diante, efetivamente reconstruindo a sequência de profundidade original sem acesso aos valores de profundidade brutos.

A tarefa de quebra-cabeça 3D é treinada em imagens RGB-D do conjunto de dados ScanNet, usando 300.000 amostras criadas selecionando conjuntos aleatórios de seis pontos de profundidade por imagem.

Exemplos de nuvens de pontos do conjunto de dados ScanNet usados no quebra-cabeça 3D. Fonte: https://arxiv.org/pdf/1702.04405

Cada ponto foi necessário para estar dentro de uma faixa de profundidade de 0,1 a 10 metros, e para promover a diversidade, nenhum dois pontos em um conjunto foram permitidos a serem mais próximos do que 40 pixels no plano da imagem, ou menos de 0,2 metros de distância em profundidade.

Testes

Para os testes iniciais, o sistema utilizou Qwen2.5-VL-7B-Instruct como o modelo multimodal base. O treinamento usou o algoritmo Group Relative Policy Optimization (GRPO), com KL regularization e entropy loss removidos.

Para previsões parciais, um fator de desconto de 0,2 foi aplicado. O treinamento de quebra-cabeça de imagem usou um tamanho de lote global de 256, enquanto os quebra-cabeças de vídeo e 3D usaram 128. A taxa de aprendizado foi definida para 1×10⁻⁶.

Para cada prompt, o modelo gerou 16 respostas a uma temperatura de decodificação de 1,0. As tarefas de quebra-cabeça de imagem e vídeo foram treinadas por 1.000 passos, enquanto a tarefa de quebra-cabeça 3D foi treinada por 800 passos.

Quebra-Cabeça de Imagem

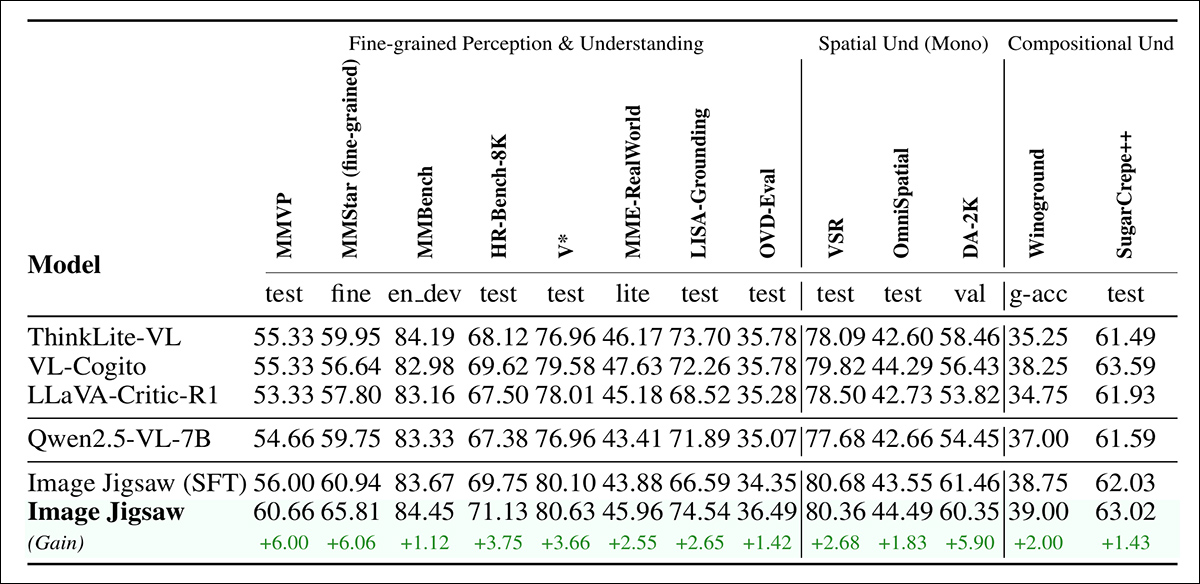

O modelo de quebra-cabeça de imagem foi testado em três categorias de benchmarks visuais: para percepção e compreensão fina, MMVP, o subconjunto de percepção fina de MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; e OVD-Eval.

Para compreensão espacial monocular, os benchmarks foram VSR; OmniSpatial; e Depth Anything V2 (DA-2K). Para compreensão visual composicional, os testes empregaram Winoground e SugerCrepe++.

Três linhas de base foram testadas, todas derivadas do Qwen2.5-VL-7B: ThinkLite-VL para raciocínio multimodal; VL-Cogito para visão geral e tarefas científicas; e LLaVA-Critic-R1 para percepção de imagem.

Todos foram avaliados usando respostas curtas apenas, desde que raciocínio de cadeia de pensamento (CoT) às vezes reduziu o desempenho.

Resultados de avaliação em benchmarks de imagem. O quebra-cabeça de imagem melhorou no modelo base Qwen2.5-VL-7B em todas as categorias de tarefas (ou seja, percepção e compreensão fina; compreensão espacial monocular; e raciocínio visual composicional), superando linhas de base pós-treinadas anteriores.

Dos resultados para o quebra-cabeça de imagem, mostrados acima, os autores afirmam:

‘[A imagem acima] mostra que nosso método consistentemente melhora as capacidades visuais centradas nos três tipos de benchmarks. Esses resultados confirmam que incorporar o treinamento pós-treinamento de quebra-cabeça de imagem melhora significativamente a base de MLLMs para percepção e compreensão visual fina além de estratégias de treinamento pós-treinamento centradas no raciocínio.

‘Atribuímos essas melhorias ao fato de que resolver quebra-cabeças de imagem exige que o modelo preste atenção a detalhes de patch locais, infira layouts espaciais globais, e raciocine sobre relações entre patches, o que beneficia diretamente a compreensão fina, espacial e composicional.’

Quebra-Cabeça de Vídeo

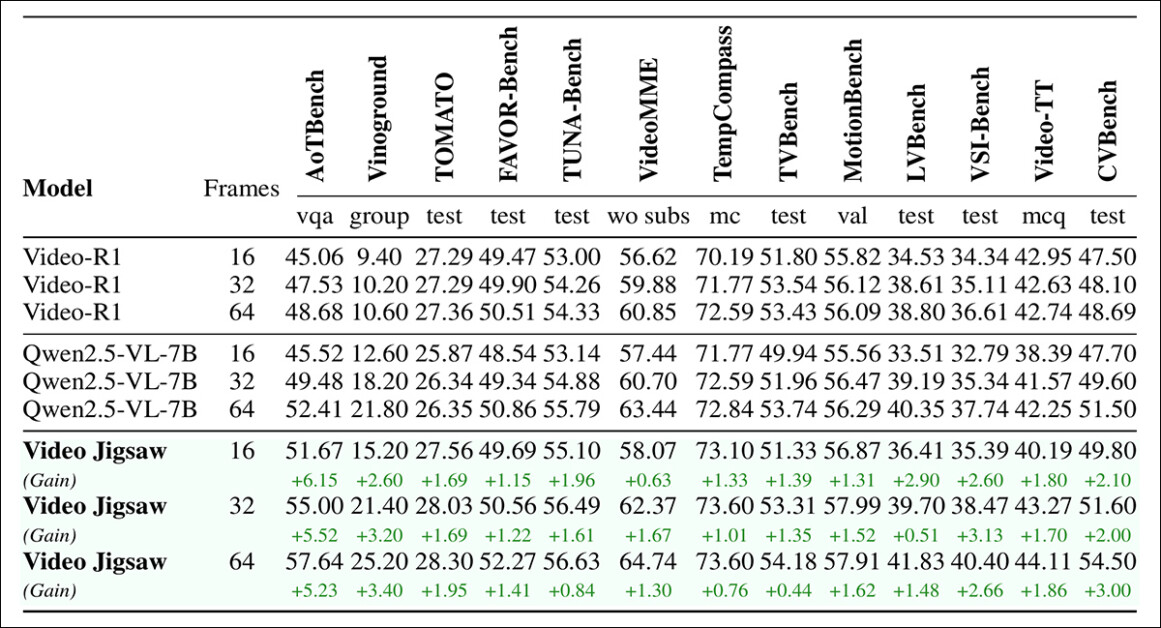

Para o quebra-cabeça de vídeo, a avaliação foi realizada em AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; e CVBench.

Video-R1 foi usado como linha de base, tendo sido treinado com ajuste fino supervisionado de inicialização a frio, seguido de aprendizado por reforço para compreensão e raciocínio de vídeo. Nesse caso, as avaliações incluíram o processo de raciocínio completo, desde que isso consistentemente produziu melhores resultados do que respostas diretas.

Todos os modelos foram restritos a 256x28x28 pixels e testados em três configurações de frame – 16, 32 e 64:

Resultados de avaliação em benchmarks de vídeo, com o quebra-cabeça de vídeo superando consistentemente a linha de base em todas as tarefas e configurações de frame.

O quebra-cabeça de vídeo produziu melhorias consistentes em todos os benchmarks de compreensão de vídeo e configurações de frame, com ganhos especialmente fortes em tarefas que exigem raciocínio temporal e direcionalidade, como aquelas em AoTBench, e também em benchmarks de raciocínio de vídeo cruzado, como CVBench:

‘Esses resultados confirmam que resolver tarefas de quebra-cabeça de vídeo encoraja o modelo a capturar melhor a continuidade temporal, entender relações entre vídeos, raciocinar sobre consistência direcional e generalizar para cenários de compreensão de vídeo holística e generalizável.’

Dados 3D

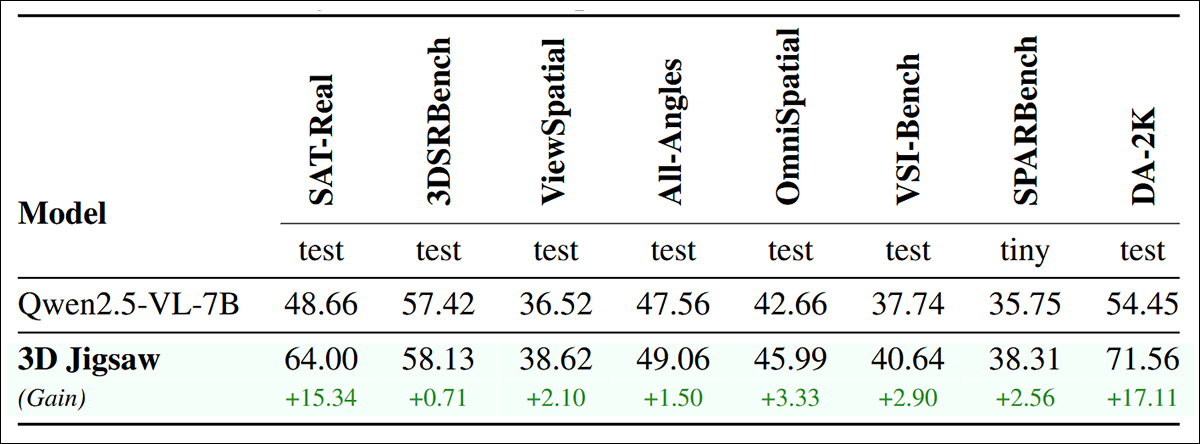

Para a modalidade 3D, o modelo foi avaliado em SAT-Real; 3DSRBench; ViewSpatial; All-Angles; o mencionado anteriormente OmniSpatial; VSI-Bench; SPARBench (tiny); e o mencionado anteriormente DA-2K.

Resultados de avaliação em benchmarks 3D: o quebra-cabeça 3D melhorou o desempenho em tarefas de comparação de profundidade, como DA-2K, bem como benchmarks de percepção 3D mais amplos que abrangem entradas de vídeo de vista única, multi-vista e egocêntrica.