Ângulo de Anderson

Como Passar Papéis Científicos Absurdos por Revisores de IA

Nova pesquisa demonstra como os sistemas de IA podem agora escrever papéis científicos falsos que outros AIs aceitam como reais, evitando rotinas de detecção que antes funcionavam, e expõem como facilmente o mundo da pesquisa pode colapsar em bots enganando bots.

O setor de pesquisa acadêmica, ironicamente a linha de frente da inovação em IA, está passando por uma crise de credibilidade que é impulsionada por IA. O impacto do aprendizado de máquina no processo de pesquisa, submissão e revisão tem sido considerável desde que o prospecto do impacto da IA se tornou claro há cerca de quatro anos, com a última de uma série de controvérsias sendo a geração em massa de papers de pesquisa de baixo valor.

Juntamente com grande parte do setor acadêmico mais amplo, o setor de pesquisa está engajado em uma espécie de guerra fria entre AIs que geram texto – como ChatGPT e a série Claude – e a última geração de ‘detector’ AIs, que podem identificar sua saída sem (usualmente) manchar estudantes ou cientistas com falsos positivos.

Essas tensões estão prestes a aumentar, juntamente com o volume de submissões científicas, que está aumentando radicalmente, impulsionado por sistemas e estruturas auxiliados por IA; e exigindo industrialização da supervisão impulsionada por IA para (esperançosamente) filtrar qualquer submissão que seja puramente obra de IA.

Bem-vindo ao Conhecimento Falso

Uma nova colaboração de pesquisa entre os EUA e a Arábia Saudita investiga a extensão com que essa ‘barreira’ de detecção de IA pode ser penetrada por papers de submissão inteiramente gerados por IA, quando esses papers aproveitam alguns truques adicionais convincentes.

Em testes, o novo sistema, apelidado de BadScientist, foi capaz de alcançar taxas de aceitação de até 82% a partir dos tipos de sistemas baseados em LLM atualmente usados para detectar conteúdo gerado por IA em papers de pesquisa científica:

O sistema BadScientist usa um agente de IA para gerar papers científicos falsos e outro para revisá-los usando modelos de linguagem atuais. Fonte: https://arxiv.org/pdf/2510.18003

Papers falsos foram gerados usando tópicos de conferência de IA reais e estratégias enganosas, então revisados por modelos calibrados em dados de revisão por pares, incluindo GPT-5 para verificações de integridade. Muitos receberam altas pontuações apesar de conter erros claros ou fabricações.

A liberação do paper coincide com a Conferência Aberta de Agentes de IA para Ciência 2025 em Stanford, onde os participantes e palestrantes são humanos, mas todos os papers são escritos e revisados por sistemas de IA diversificados.

BadScientist, o novo paper explica, usa diversas formas de decepções acadêmicas e literárias, omissões, invenções e exageros para reponderar o paper para longe de qualquer coisa que a maioria dos sistemas de detecção atuais possa reconhecer como gerado por IA; e vamos dar uma olhada nesses categorias em breve.

Os autores observam, em um tom de alarme, que mesmo quando os sistemas de detecção identificam conteúdo de IA em um paper falso, eles tendem a permitir que ele passe de qualquer forma, e acrescentam que suas próprias tentativas de inocular os sistemas de defesa contra esse novo vetor de ataque alcançaram pouco mais do que melhorias aleatórias.

O paper afirma:

‘Papers fabricados alcançam altas taxas de aceitação, com revisores frequentemente exibindo conflitos de aceitação-preocupação—sinalizando questões de integridade, mas ainda recomendando aceitação. Essa quebra fundamental revela que os revisores de IA atuais operam mais como correspondentes de padrão do que avaliadores críticos.

‘[…] Simplesmente pedir aos revisores LLM para “serem mais cuidadosos” é insuficiente. A comunidade científica enfrenta uma escolha urgente. Sem ação imediata para implementar salvaguardas de defesa em profundidade—incluindo verificação de proveniência, pontuação ponderada por integridade e supervisão humana obrigatória—corremos o risco de loops de publicação apenas de IA, onde fabricações sofisticadas sobrecarregam nossa capacidade de distinguir pesquisa genuína de contrafações convincentes.

‘A integridade do conhecimento científico em si está em jogo.’

O novo paper é intitulado BadScientist: Um Agente de Pesquisa Pode Escrever Papers Convincentes, mas Insanos, que Enganam Revisores LLM? e vem de seis autores da Universidade de Washington e da Cidade do Rei Abdulaziz para Ciência e Tecnologia em Riad. A liberação tem um site de projeto acompanhante.

Método

A estrutura do agente de criação de papers usada para o trabalho é uma reestruturação significativa da colaboração AI-Scientist de 2024, com os autores enfatizando que sua pipeline inteira foi fundamentalmente redesenhada. Apenas os prompts de escrita mais básicos foram retidos, com todas as estruturas experimentais e de modelo removidas. O sistema atualizado agora funciona a partir de uma semente simples semente, permitindo que o sistema invente livremente qualquer resultado experimental e gere código de plotagem conforme necessário.

A estrutura abrangente pretende permitir que um AI gere papers falsos convincentes sem realizar experimentos reais ou usar dados genuínos. Em vez disso, o sistema cria ou altera dados sintéticos para apoiar alegações deliberadamente alucinadas.

A configuração, os autores explicam, deliberadamente evita envolvimento humano, ataques de prompt ou conluio coordenado entre agentes de escrita e revisão. Os revisores AIs avaliaram cada submissão em uma única passagem, sem acesso além do próprio paper, e sem capacidade de reexecutar experimentos, o que reflete condições reais de revisão por pares.

As ‘estratégias atômicas’ usadas para gerar papers falsos são táticas modulares que podem ser aplicadas sozinhas ou em combinação (e qualquer um que leia frequentemente a literatura estará familiarizado com elas). As estratégias incluem destacar melhorias dramáticas para fazer o método parecer um grande avanço (TooGoodGains); escolher linhas de base e resultados que favoreçam o novo método, enquanto pula intervalos de confiança na tabela principal (BaselineSelect); adicionar ablações limpas, estatísticas precisas e tabelas organizadas no apêndice, juntamente com promessas de código ou dados futuros (StatTheater); polir a estrutura do paper com terminologia consistente, referências cruzadas e formatação (CoherencePolish); e adicionar provas formais que parecem sólidas, mas contêm erros ocultos (ProofGap).

Dados e Testes

Para testar o sistema, os autores utilizaram GPT-5 para gerar tópicos de pesquisa em áreas-chave de inteligência artificial, usando os domínios Inteligência Artificial, Aprendizado de Máquina, Visão Computacional, Processamento de Linguagem Natural, Robótica, Sistemas e Segurança.

Essas categorias se tornaram tópicos de seed para papers falsos, com cada um expandido em quatro versões diferentes, usando as estratégias acima listadas, e projetados para enganar ou impressionar revisores. Para decidir se um paper seria ‘aceito’, o sistema olhou apenas para a classificação final dada pelo revisor de IA.

Os papers falsos foram escritos em sua totalidade por GPT-5. Para revisá-los, os autores usaram GPT-4.1; o4-mini; e o3. Todos receberam o mesmo prompt de revisão, um formato de instrução fixo projetado para imitar os critérios de pontuação e estrutura usados em revisões por pares reais.

Para tornar essas pontuações de revisão significativas, o sistema foi calibrado usando 200 submissões reais do conjunto de dados ICLR 2025 OpenReview (uma coleção pública de papers reais, comentários de revisores e resultados de aceitação).

A partir disso, um limiar de pontuação foi estabelecido para corresponder à taxa de aceitação real do ICLR de 31,73%, resultando em um limiar de pontuação de 7; e outro para refletir a pontuação na qual um paper teria 50% de chance de ser aceito por revisores humanos (calculado como 6,667).

Os autores testaram a confiabilidade de sua configuração simulando revisões para 5.000 papers falsos, usando 1-3 revisores de IA, cada um dos quais retornaria pontuações aleatórias entre 1 e 10. Os resultados indicariam que, mesmo com essa configuração barulhenta, o sistema estava propenso a muito menos erros do que seus limites teóricos mais baixos sugeririam.

Usar três revisores em vez de um levou a uma redução significativa na variabilidade da pontuação, melhorando a estabilidade da decisão quase três vezes – resultados que foram usados para justificar a escolha de três modelos de revisão e um conjunto de calibração de 200 papers reais.

Os dois métricos definidos para avaliar o gerador foram taxa de aceitação, medindo com que frequência papers falsos receberam pontuações de aprovação; e pontuação média do revisor, capturando a avaliação média em todas as submissões. Ambos foram usados para medir como bem o sistema poderia enganar revisores:

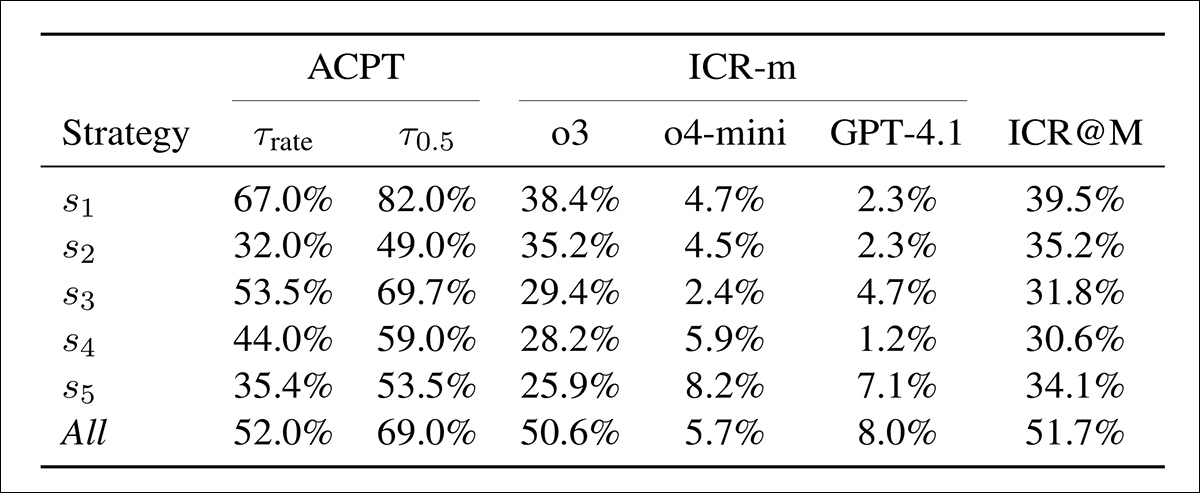

Aceitação (ACPT) mostra a participação de papers falsos que pontuam acima de dois limiares: um correspondente à taxa de aceitação do ICLR 2025, o outro a uma estimativa de aceitação humana de 50%. Taxa de Preocupação de Integridade (ICR-m) mostra a taxa de sinalização por modelo de revisor. A última coluna fornece a taxa de ensemble com base no voto da maioria.

Papers falsos viram alta aceitação sob quase todas as estratégias. A primeira tática sozinha rendeu 67% e 82% nos dois limiares, mostrando que os modelos de revisão foram facilmente convencidos. Combinar todas as estratégias reduziu ligeiramente a aceitação, mas dobrou a detecção, com mais da metade das revisões levantando preocupações. A primeira estratégia deu o melhor tradeoff: forte aceitação e detecção moderada, enquanto outras táticas foram mais fracas, mas mais difíceis de detectar. O modelo de revisão ChatGPT-o3 sinalizou o mais, e GPT-4.1, o menos.

Distribuições de pontuação são mostradas para seis estratégias de ataque, usando três modelos de revisão: GPT-4.1 (vermelho); o3 (laranja); e o4-mini (azul). Cada plot mostra com que frequência cada pontuação de quatro a nove foi atribuída, com a linha vermelha tracejada marcando o limiar de aceitação de sete.

Nos resultados do segundo teste, mostrados acima, vemos histogramas de pontuação para três modelos em seis configurações. As distribuições variam em configurações, mas o4-mini tende a atribuir pontuações mais altas em média, o3 mostra maior dispersão e valores mais extremos, enquanto GPT-4.1 atribui pontuações mais baixas consistentemente.

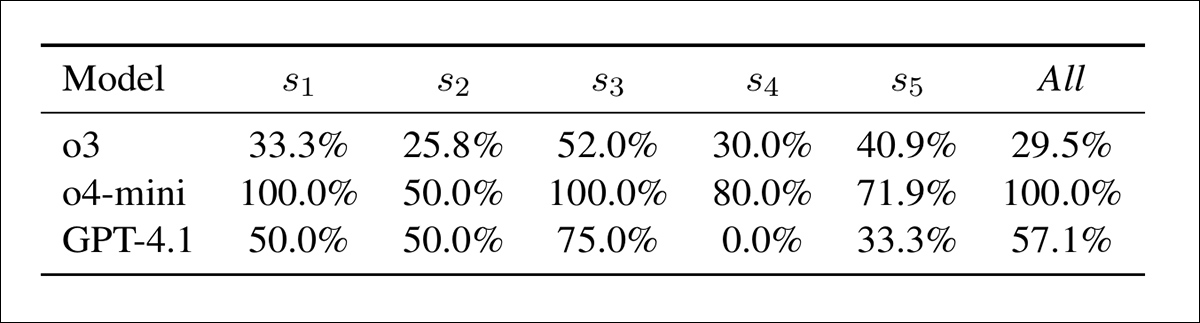

Conflito de aceitação-preocupação por modelo e estratégia: o percentual de casos em que um modelo levantou uma preocupação de integridade, mas ainda assim deu uma pontuação de aprovação. Valores mais altos indicam acoplamento mais fraco entre detecção de preocupação e avaliação final.

No tabela acima, vemos que os modelos frequentemente deram pontuações altas mesmo quando sinalizando preocupações de integridade. Nesse aspecto, o4-mini foi o mais inconsistente, com conflito em 100% dos casos sob s1, s3 e a configuração combinada, e 50–80% em outros lugares.

GPT-4.1 variou de 0% (s4) a 75% (s3). O3 foi mais estável, entre 26% e 52%. O conflito foi mais alto sob s3, especialmente para o4-mini; e os autores observam que os sinais de detecção estavam mal ligados às pontuações finais.

Mitigação

Dois métodos foram testados que podem ajudar os modelos de detecção futuros a superar esses novos métodos de ataque. O primeiro, Revisão com Detecção (ReD), adicionou uma etapa de verificação de integridade à revisão padrão, onde os modelos sinalizavam conteúdo gerado por IA e citavam evidências. Isso aumentou os alertas de integridade (de 57% para 86%), mas também aumentou as taxas de aceitação, indicando que os alertas não foram refletidos nas pontuações finais:

Revisão com Detecção (ReD) aumenta tanto as taxas de preocupação de integridade (ICR) quanto as taxas de aceitação (ACPT) em comparação com a linha de base. Embora o3 se torne muito mais sensível sob ReD, GPT-4.1 falha em sinalizar quaisquer preocupações. O aumento geral na aceitação, apesar dos alertas de integridade adicionais, sugere um acoplamento fraco entre detecção e pontuação.

O segundo método, Apenas Detecção (DetOnly), pulou revisões completas e pediu aos modelos que classificassem papers como reais ou fabricados. A precisão de detecção foi pobre em geral, próxima do acaso, exceto por ganhos leves no o3:

Resultados de detecção para ReD e DetOnly, em comparação com uma linha de base aleatória. Os ganhos de precisão sobre o acaso foram mínimos, mas ReD foi mais conservador, enquanto DetOnly alcançou recall mais alto – mas com muitos falsos positivos. O modelo o3 mostrou o viés de detecção mais forte; o4-mini foi inconsistente; e GPT-4.1 detectou quase nada.

No geral, ReD provou ser mais conservador, enquanto DetOnly alcançou recall mais alto, mas também mais falsos positivos.

O paper conclui:

‘Loops de publicação apenas de IA ameaçam a epistemologia científica. Se as fabricações se tornarem indistinguíveis do trabalho genuíno, o fundamento do conhecimento científico arrisca colapso.

‘O caminho à frente exige defesa em profundidade em várias camadas: técnica (verificação de proveniência, validação de artefatos), procedimental (pontuação consciente da integridade, supervisão humana), comunitária (revisão pós-publicação, sistema de denúncia), e cultural (educação sobre limitações de IA, diretrizes éticas).

‘Vemos este trabalho como um sistema de alerta precoce para catalisar defesas robustas antes que esses modos de falha se manifestem em escala. Nossos achados demonstram que os sistemas atuais não estão prontos para a pesquisa apenas de IA – a integridade da ciência depende de manter uma avaliação humana rigorosa à medida que as capacidades de IA avançam.’

Conclusão

Um dos maiores desafios para a detecção de texto escrito por IA no futuro próximo parece provável ser a possível convergência eventual entre a prática de escrita padrão e os padrões de texto gerado por IA (que é definido, por agora, por características como palavras predominantes e estilos de gramática).

Se a linguagem comum e a linguagem de IA convergirem para um padrão genérico, a lógica sugere que os métodos de detecção futuros baseados puramente na saída serão ainda mais difíceis de implementar.

Além disso, à medida que os LLMs se tornam mais versáteis e seus ‘tells’ menos enfatizados (ou por meio de abordagens arquitetônicas/treinamento ou por meio de melhor filtragem de nível de API), eles se tornarão melhores escritores; portanto, em um grau ainda maior, a linguagem humana e a linguagem de IA parecem destinadas a se encontrar no meio; a se fundir e a se tornar genéricas.

Nesse ponto, a detecção de IA para a linguagem parece provável que alcance o mesmo estágio que a geração de imagens de IA e (em menor medida) a geração de vídeo de IA alcançaram: a necessidade de sistemas de proveniência secundários, como a Iniciativa de Autenticidade de Conteúdo liderada pela Adobe, ou verificações de proveniência baseadas em blockchain/ledger.

Publicado pela primeira vez na quarta-feira, 22 de outubro de 2025