Ângulo de Anderson

Levando um Sentido de Olfato ao Desenvolvimento de IA

Um novo conjunto de dados de IA ensina máquinas a cheirar associando dados de cheiro a imagens, permitindo que os modelos combinem odores com objetos, cenas e materiais.

Talvez porque as máquinas de saída de cheiro tenham um histórico tão conturbado, a olfação é um sentido relativamente negligenciado na literatura de pesquisa de IA. A menos que você estivesse planejando produzir outra entrada na longa série (mais de um século, até agora) de saga do smell-o-vision, os casos de uso sempre pareceram um pouco ‘niche’ em comparação com a exploração de conjuntos de dados de imagem, áudio e vídeo, e os modelos de IA treinados a partir deles.

De fato, a possibilidade de automatizar, industrializar e popularizar as facilidades de detecção oferecidas por cães-bomba, cães-cadáver, cães-detetores-de-doenças e diversos outros tipos de unidades de detecção canina, seria um benefício notável nos serviços municipais e de segurança. Apesar da grande demanda, muito acima da oferta, treinar e manter cães-detetores é um negócio caro que não sempre oferece um bom valor por dinheiro.

Até o momento, a maioria das pesquisas que invade essa área de estudo tem sido confinada a um laboratório, com coleções curadas que normalmente consistem em exemplos com recursos feitos à mão recursos – um perfil inclinado mais para soluções de cottage-indústria do que para aplicações industrializadas.

À Frente por um Nariz

Nesse clima um pouco desbotado, surge uma interessante colaboração acadêmica/industrial dos EUA, na qual uma equipe de pesquisadores passou vários meses catalogando cheiros diversos em ambientes internos e externos na cidade de Nova York – e, pela primeira vez, reunindo imagens associadas aos odores capturados:

Observe o sensor central, o ‘nariz’ do dispositivo olfativo. Treinado apenas no cheiro, o modelo adivinha se está cheirando granito, plástico ou couro – e até identifica o quarto em que está, sem ver um único pixel. Fonte

Essa pesquisa levou os autores do novo trabalho a criar uma variação do extremamente popular quadro de pré-treinamento de linguagem-imagem contrastivo (CLIP), que conecta texto e imagens, na forma de Pré-treinamento Olfativo-Imagem Contrastivo (COIP) – que conecta cheiros e imagens.

Top: dados de vídeo e sensor olfativo são capturados em configurações naturais usando um suporte de câmera-e-nariz. Bottom left (b): uma incorporação conjunta é aprendida por meio de auto-supervisão cross-modal. (c): o sistema recupera combinações visuais com base apenas em um cheiro de consulta. (d): amostras de cheiro individuais são usadas para classificar categorias de ambiente, objeto e material. (e): odores muito semelhantes, como dois tipos de grama, são distinguidos sem entrada visual. Fonte

O novo conjunto de dados, intitulado Cheiros de Nova York, contém 7.000 pares de cheiro-imagem com 3.500 objetos diferentes. Quando treinado em testes, os novos dados foram encontrados para superar os recursos populares feitos à mão nos relativamente poucos conjuntos de dados semelhantes anteriores.

Os autores esperam que sua primeira saída abra o caminho para trabalhos posteriores e subsequentes em direção a sistemas de detecção olfativa projetados para operar no mundo real, da mesma maneira que os cães-detetores fazem*:

‘Vemos esse conjunto de dados como um passo em direção à percepção olfativa multimodal in-the-wild, bem como um passo em direção a ligar a visão com o cheiro. Enquanto a olfação tem sido tradicionalmente abordada em configurações restritas, como garantia de qualidade, existem muitas aplicações em configurações naturais.

‘Por exemplo, como humanos, constantemente usamos nosso sentido de cheiro para avaliar a qualidade dos alimentos, identificar perigos e detectar objetos invisíveis.

‘Além disso, muitos animais, como cães, ursos e camundongos, mostram capacidades de olfação super-humanas capacidades, sugerindo que a percepção de cheiro humana está longe do limite das capacidades da máquina.’

Embora o novo artigo, intitulado Cheiros de Nova York: um grande conjunto de dados multimodal para olfação, prometa que os dados e o código serão liberados, um arquivo de dados de 27GB já está disponível por meio do site do projeto. O artigo foi produzido por nove pesquisadores em toda a Universidade Columbia, Universidade Cornell e Osmo Labs.

Método

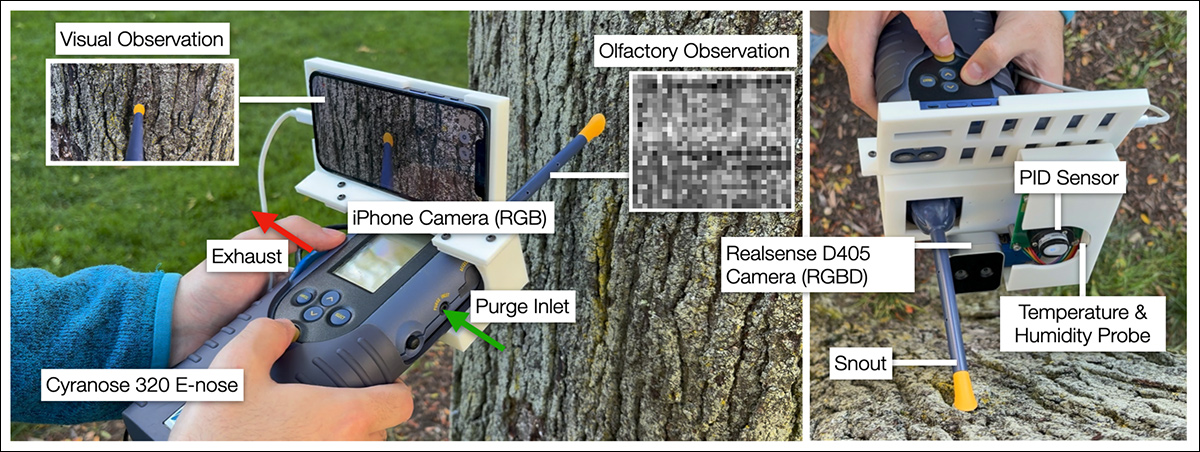

Para coletar material para o novo conjunto, os pesquisadores usaram o Cyranose 320 nariz eletrônico, com um iPhone montado acima da entrada para capturar visualmente quais cheiros estavam sendo registrados:

Um suporte de sensor portátil coleta dados de vídeo e cheiro por meio da montagem de uma câmera iPhone em um nariz-e-320. O focinho é apontado para objetos enquanto a saída e a entrada de purificação gerenciam o fluxo de ar durante a amostragem. Uma câmera RGB-D captura profundidade, enquanto a concentração de compostos orgânicos voláteis (VOC), temperatura e umidade são registrados por meio de sensores integrados, incluindo um módulo PID e uma sonda ambiental.

O dispositivo Cyranose funciona a 2Hz, registrando 32 dimensões de etapas de tempo olfativo. As concentrações de compostos orgânicos voláteis (VOC) foram registradas com um sensor MiniPID2 PPM WR.

A unidade portátil funcionou como um sensor ágil, transmitindo dados para uma estação móvel mais capaz de processamento.

Para colocar o cheiro-alvo em contexto, um ‘cheiro de base’ foi registrado, antes que o objeto mais específico fosse direcionado diretamente com o ‘focinho’ do Cyranose. A amostra ambiental foi então tirada de uma porta lateral da unidade, para garantir que estivesse distante o suficiente da fonte de cheiro principal para não ser contaminada.

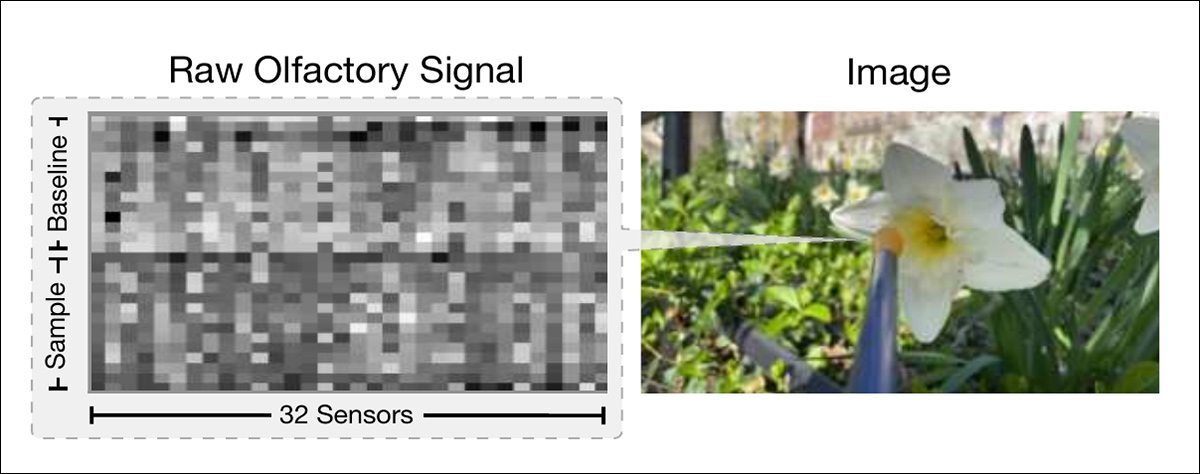

Duas amostras foram coletadas por meio da entrada principal do sensor, com cada gravação de dez segundos capturada de uma posição diferente em torno do objeto, para melhorar a eficiência dos dados. As amostras foram então combinadas com a base ambiental para formar uma matriz 28×32, representando a medição olfativa completa:

Esse exemplo mostra o sinal e a imagem correspondente para uma flor. O sinal olfativo completo consiste em uma matriz 28×32, combinando uma linha de base ambiental de 14 quadros com duas amostras de 10 segundos tiradas de diferentes ângulos em torno do objeto-alvo.

Dados e Testes

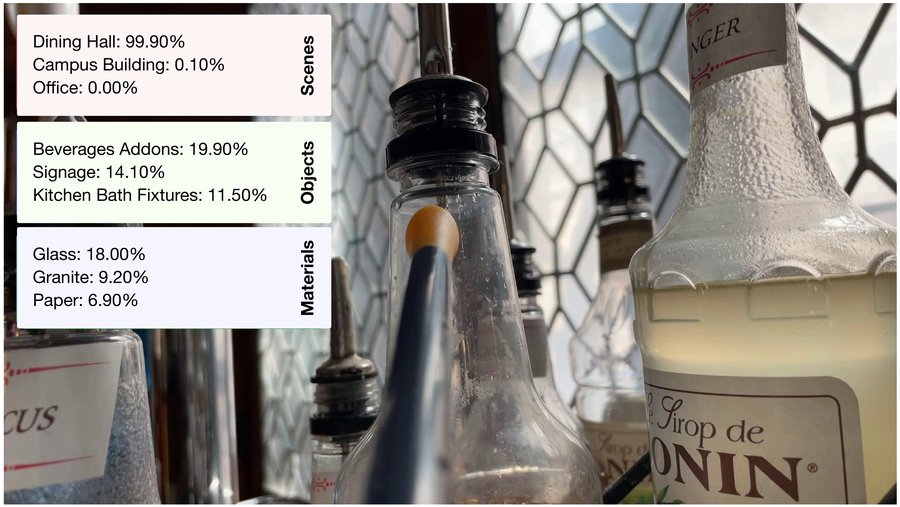

Modelos de linguagem de visão (VLMs) foram usados para rotular automaticamente objetos e materiais capturados pelo iPhone no suporte Cyranose, com GPT-4o utilizado para a tarefa; no entanto, categorias de cena foram rotuladas manualmente:

Uma pequena amostra de uma ilustração extensa no artigo de origem detalhando as variedades de fontes de cheiro e ambientes capturados no projeto.

O conjunto de dados foi dividido em divisões de treinamento e validação splits, com ambas as amostras de cada objeto atribuídas à mesma divisão para evitar contaminação cruzada. A coleção final compreende 7.000 pares olfativo-visuais extraídos de 3.500 objetos não rotulados, juntamente com 70 horas de vídeo e 196.000 etapas de tempo de dados olfativos brutos de ambas as fases de base e amostra.

Os dados foram coletados em 60 sessões ao longo de um período de dois meses, abrangendo parques, prédios universitários, escritórios, ruas, bibliotecas, apartamentos e salas de jantar, com várias sessões realizadas em cada local. O conjunto de dados resultante contém 41% de ambientes ao ar livre e 59% de ambientes internos.

Para desenvolver representações olfativas de propósito geral, os autores treinaram um modelo contrastivo para associar pares de imagem-cheiro sincronizados do conjunto de dados. Essa abordagem, a mencionada COIP, usa uma função de perda adaptada do CLIP para alinhar as incorporações de sinais visuais e olfativos co-ocorrentes.

O treinamento usou um codificador visual e um codificador de cheiro, com o objetivo de ensinar o modelo a trazer cheiros e imagens correspondentes mais próximos em um espaço de representação compartilhado. As representações resultantes suportam uma variedade de tarefas downstream, incluindo recuperação de imagem para cheiro, reconhecimento de cena e objeto, classificação de material e discriminação de odor de grãos finos.

O modelo foi treinado usando dois tipos de entradas olfativas: o sinal de sensor bruto e um resumo feito à mão conhecido como impressões de cheiro – recursos amplamente usados na pesquisa de olfação que comprimem a resposta de cada sensor em um único número comparando a resistência de pico durante a amostragem com a resistência média durante a linha de base ambiental.

Em contraste, a entrada bruta registrada em toda a cidade de Nova York consiste em uma série de tempo de 32 sensores químicos dentro do dispositivo Cyranose, capturando como a resistência elétrica de cada sensor mudou ao longo do tempo ao reagir ao odor.

Para a curação do conjunto de dados, esse sinal não processado foi alimentado diretamente em uma rede neural, permitindo o aprendizado de ponta a ponta com um convolucional ou transformador-baseado. Os modelos foram treinados usando impressões de cheiro e a entrada bruta coletada de vários ambientes na cidade de Nova York, com ambos os tipos de entrada avaliados usando aprendizado contrastivo.

Recuperação Cross-Modal

A recuperação cross-modal foi avaliada incorporando cada amostra de cheiro e sua imagem emparelhada em um espaço de representação compartilhada e testando se a imagem correta poderia ser recuperada com base apenas na entrada olfativa.

A classificação foi determinada pela proximidade da incorporação da imagem com o cheiro de consulta dentro desse espaço, e o desempenho foi medido usando classificação média, classificação mediana e recuperação em vários limiares:

A precisão de recuperação cross-modal para diferentes codificadores de cheiro, mostrando quão bem cada modelo identifica a imagem correta a partir de uma consulta de cheiro. Os resultados comparam arquiteturas treinadas em sinais olfativos brutos com aquelas que usam impressões de cheiro.

Com relação a esses resultados, os autores afirmam:

‘O pré-treinamento contrastivo usando impressões de cheiro apresenta um desempenho melhor do que o acaso em todas as métricas. No entanto, o treinamento do codificador olfativo no sinal olfativo bruto leva a uma melhoria significativa em comparação com o codificador de impressões de cheiro, independentemente da arquitetura.

‘Isso mostra as informações mais ricas presentes nos dados olfativos brutos, desbloqueando associações cross-modais mais fortes entre visão e cheiro.’

Um detalhe da sétima ilustração no artigo de origem, que é muito condensado para ser reproduzido de forma significativa aqui. Aqui, exemplos de recuperação cross-modal mostrando como o modelo liga cheiros a imagens correspondentes. Cada linha começa com uma consulta de cheiro, seguida das principais previsões de imagem no espaço de incorporação compartilhada. A imagem correta para cada consulta é delineada em verde, ilustrando como odores de livros, plantas, alvenaria e outros materiais puxam o modelo em direção a cenas visualmente e semanticamente relacionadas.

Os autores também observam que os resultados de recuperação mostram padrões semânticos claros:

‘As recuperações do nosso modelo frequentemente mostram agrupamentos semânticos. O cheiro de um livro recupera imagens de outros livros, o cheiro de folhas recupera imagens de folhagem.

‘Esses resultados sugerem que a representação aprendida captura estrutura cross-modal significativa.’

Reconhecimento de Cena, Objeto e Material

A capacidade do modelo de reconhecer cheiros sem entrada visual foi avaliada treinando-o para identificar cenas, objetos e materiais com base apenas em dados olfativos; para esse fim, uma sonda linear (um classificador simples treinado em representações congeladas) foi usada para avaliar quanto informações foram codificadas nas incorporações de cheiro aprendidas.

As etiquetas foram derivadas das imagens emparelhadas no conjunto de treinamento usando GPT-4o – mas apenas o sinal olfativo foi usado durante a classificação.

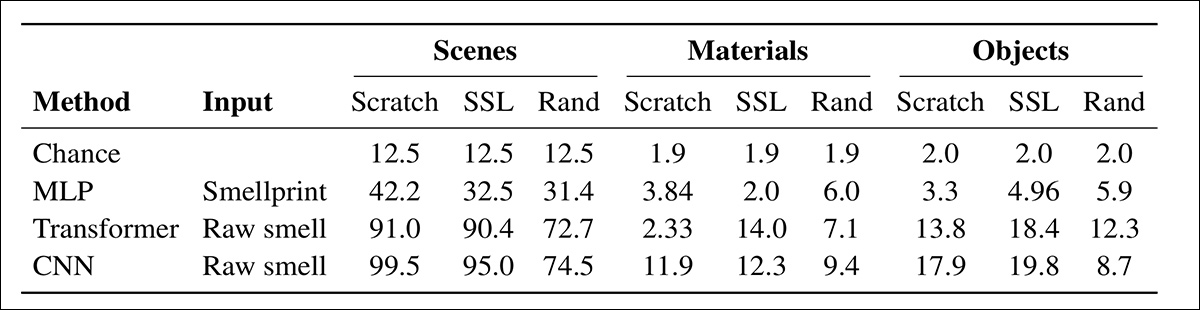

Vários tipos de codificadores foram testados: alguns inicializados aleatoriamente, alguns treinados do zero e outros treinados usando aprendizado contrastivo para alinhar cheiro e visão em um espaço de representação compartilhada, com dados brutos e impressões de cheiro avaliados:

A precisão de classificação para cenas, materiais e objetos foi avaliada usando sinais olfativos apenas. A entrada de sinal de sensor bruto superou as impressões de cheiro, com CNNs treinadas do zero produzindo os resultados mais altos, incluindo 99,5% para cenas. O pré-treinamento SSL ajudou em alguns casos, mas foi geralmente superado pelo treinamento supervisionado. As bases de pesos aleatórios indicam que a capacidade do modelo por si só se mostra insuficiente.

Uma precisão significativamente mais alta foi obtida quando dados olfativos brutos foram usados, especialmente em modelos treinados com supervisão cross-modal. Os autores comentam**:

‘Os modelos treinados em entradas de sensorias brutos também alcançam uma precisão mais alta do que os modelos treinados com os recursos de impressões de cheiro feitos à mão. Esses resultados mostram que o aprendizado profundo a partir de sinais olfativos brutos é significativamente melhor do que os recursos feitos à mão.’

Discriminação de Grãos Finos

Para avaliar se distinções de odor de grãos finos poderiam ser aprendidas, um benchmark foi construído a partir de duas espécies de grama coexistindo no mesmo gramado do campus. Amostras alternadas foram coletadas ao longo de seis sessões de 30 minutos, rendendo 256 exemplos. Um classificador linear foi treinado em recursos do aprendizado contrastivo olfativo-visual e avaliado em um conjunto de 42 amostras mantidas:

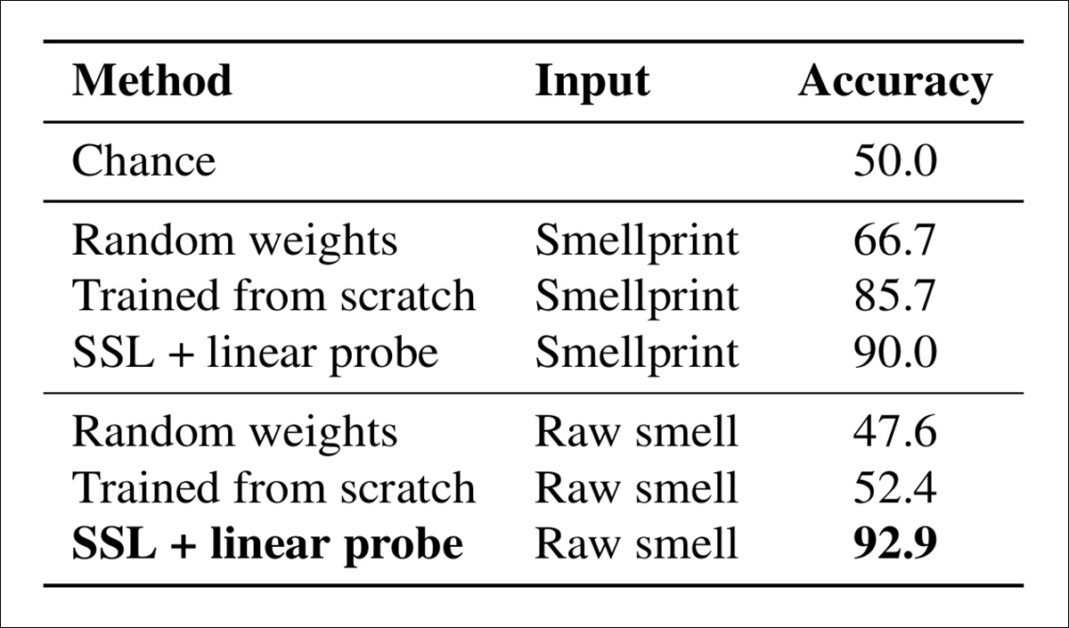

A precisão da classificação de espécies de grama a partir do cheiro apenas. Os modelos foram avaliados em sua capacidade de distinguir entre dois tipos de grama visualmente semelhantes usando apenas entrada olfativa. O desempenho foi comparado em impressões de cheiro e dados de sensor brutos, com modelos aleatoriamente inicializados, treinados do zero ou treinados usando aprendizado auto-supervisionado (SSL) seguido de uma sonda linear. A precisão mais alta, 92,9%, foi alcançada usando sinais olfativos brutos com SSL, indicando que as diferenças de odor de grãos finos são melhor capturadas por meio de entrada bruta e treinamento orientado por visão.

Aqui os pesquisadores afirmam:

‘O treinamento no sinal de sensor olfativo bruto (em vez de recursos feitos à mão) produz a precisão mais alta – excedendo todas as variantes baseadas em impressões de cheiro.

‘Esses resultados sugerem que o aprendizado olfativo-visual preserva mais informações de grãos finos do que o aprendizado com impressões de cheiro, e que a supervisão visual fornece um sinal para explorar essa informação.’

Conclusão

Embora a síntese de odores pareça provável que permaneça um problema não resolvido por um longo tempo, um sistema de análise de odores eficaz e acessível in-the-wild tem um enorme potencial, não apenas para propósitos policiais, de segurança e médicos, mas também para monitoramento de qualidade de vida e urbano.

No momento, o equipamento envolvido é de nicho e geralmente bastante caro; portanto, o progresso real na ‘IA olfativa’ para detecção parece provável que exija um sensor visionário e acessível no espírito do Raspberry PI.

* Minha conversão das citações em linha dos autores para links.

** Observe que ilustrações adicionais (figura 8) estão disponíveis no artigo de origem, mas são melhor visualizadas nesse contexto.

Publicado pela primeira vez na sexta-feira, 28 de novembro de 2025