Ângulo de Anderson

A Luta do AI para Ler Relógios Analógicos Pode Ter um Significado Mais Profundo

Um novo artigo de pesquisadores da China e da Espanha descobriu que mesmo modelos de IA multimodais avançados, como o GPT-4.1, lutam para dizer a hora a partir de imagens de relógios analógicos. Pequenas alterações visuais nos relógios podem causar erros de interpretação significativos, e o ajuste fino só ajuda com exemplos familiares. Os resultados levantam preocupações sobre a confiabilidade desses modelos quando enfrentam imagens desconhecidas em tarefas do mundo real.

Quando os humanos desenvolvem uma compreensão profunda o suficiente de um domínio, como a gravidade ou outros princípios físicos básicos, vamos além de exemplos específicos para entender as abstrações subjacentes. Isso nos permite aplicar esse conhecimento de forma criativa em diferentes contextos e reconhecer novas instâncias, mesmo aquelas que nunca vimos antes, identificando o princípio em ação.

Quando um domínio carrega suficiente importância, podemos até começar a percebê-lo onde ele não existe, como no caso da pareidolia, impulsionada pelo alto custo de não reconhecer uma instância real. Tão forte é esse mecanismo de reconhecimento de padrões de sobrevivência que ele até nos leva a encontrar uma gama mais ampla de padrões onde não há nenhum.

Quanto mais cedo e mais repetidamente um domínio é instilado em nós, mais profunda é sua fundamentação e persistência ao longo da vida; e um dos primeiros conjuntos de dados visuais aos quais somos expostos como crianças vem na forma de relógios didáticos, onde material impresso ou relógios analógicos interativos são usados para nos ensinar a dizer a hora:

Ferramentas didáticas para ajudar as crianças a aprender a dizer a hora. Fonte: https://www.youtube.com/watch?v=IBBQXBhSNUs

Embora mudanças nas modas de design de relógios possam às vezes nos desafiar, a resiliência dessa mestria de domínio inicial é bastante impressionante, permitindo-nos discernir faces de relógios analógicos mesmo diante de escolhas de design complexas ou ‘excêntricas’:

Alguns relógios desafiadores na alta costura. Fonte: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Os humanos não precisam de milhares de exemplos para aprender como os relógios funcionam; uma vez que o conceito básico é compreendido, podemos reconhecê-lo em almost qualquer forma, mesmo quando distorcido ou abstrato.

A dificuldade que os modelos de IA enfrentam com essa tarefa, por contraste, destaca um problema mais profundo: sua aparente força pode depender mais da exposição em alta volume do que da compreensão.

Além do Jogo de Imitação?

A tensão entre o desempenho de superfície e a compreensão genuína tem surgido repetidamente em investigações recentes de grandes modelos. No mês passado, a Universidade de Zhejiang e a Universidade de Westlake redefiniram a pergunta em um artigo intitulado Os Modelos LLM de Nível de Doutorado Realmente Entendem a Adição Elementar? (não é o foco deste artigo), concluindo:

‘Apesar dos benchmarks impressionantes, os modelos mostram dependência crítica de correspondência de padrões em vez de compreensão real, evidenciada por falhas com representações simbólicas e violações de propriedades básicas.

‘A provisão de regras explícitas prejudicando o desempenho sugere restrições arquiteturais inerentes. Essas percepções revelam lacunas de avaliação e destacam a necessidade de arquiteturas capazes de raciocínio matemático genuíno além do reconhecimento de padrões.’

Essa pergunta surge novamente esta semana, agora em uma colaboração entre a Universidade de Aeronáutica e Astronáutica de Nanjing e a Universidad Politécnica de Madrid, na Espanha. Intitulado Os Modelos de Linguagem Multimodal (MLLMs) Realmente Aprendem a Dizer a Hora em Relógios Analógicos?, o novo artigo explora como bem os modelos multimodais entendem a leitura de hora.

Embora o progresso da pesquisa seja coberto apenas em detalhes gerais no artigo, os testes iniciais dos pesquisadores estabeleceram que o modelo de linguagem multimodal GPT-4.1 da OpenAI lutou para ler corretamente a hora a partir de um conjunto diversificado de imagens de relógios, frequentemente dando respostas incorretas, mesmo em casos simples.

Isso aponta para uma possível lacuna nos dados de treinamento do modelo, levantando a necessidade de um conjunto de dados mais equilibrado para testar se o modelo pode realmente aprender o conceito subjacente. Portanto, os autores criaram um conjunto de dados sintéticos de relógios analógicos, cobrindo uniformemente todos os tempos possíveis e evitando os vieses usuais encontrados em imagens da internet:

Um exemplo do conjunto de dados sintéticos de relógios analógicos dos pesquisadores, usado para ajustar um modelo GPT no novo trabalho. Fonte: https://huggingface.co/datasets/migonsa/analog_watches_finetune

Antes de ajustar no novo conjunto de dados, o GPT-4.1 consistentemente falhou em ler esses relógios. Depois de alguma exposição ao novo conjunto, no entanto, seu desempenho melhorou – mas apenas quando as novas imagens se pareciam com as que já havia visto.

Quando a forma do relógio ou o estilo das mãos mudava, a precisão caía acentuadamente; até pequenas alterações, como mãos mais finas ou pontas de seta (imagem da direita abaixo), eram suficientes para desviá-lo; e o GPT-4.1 lutou ainda mais para interpretar relógios ‘derretidos’ de Dali:

Imagens de relógios com design padrão (esquerda), forma distorcida (meio), e mãos modificadas (direita), ao lado dos tempos retornados pelo GPT-4.1 antes e após o ajuste fino. Fonte: https://arxiv.org/pdf/2505.10862

Os autores deduzem que os modelos atuais, como o GPT-4.1, podem, portanto, estar aprendendo a leitura de relógios principalmente por meio de correspondência de padrões visuais, em vez de qualquer conceito mais profundo de tempo, afirmando:

‘[GPT 4.1] falha quando o relógio é deformado ou quando as mãos são alteradas para serem mais finas e ter uma ponta de seta. O Erro Absoluto Médio (MAE) na estimativa de tempo sobre 150 tempos aleatórios foi de 232,48s para os relógios iniciais, 1380,69s quando a forma é deformada e 3726,93s quando as mãos são alteradas.

‘Esses resultados sugerem que o MLLM não aprendeu a dizer a hora, mas sim memorizou padrões.’

Tempo Suficiente

A maioria dos conjuntos de dados de treinamento depende de imagens da web raspadas, que tendem a repetir certos tempos – especialmente 10:10, um ajuste popular em anúncios de relógios:

Do novo artigo, um exemplo da prevalência do tempo ‘dez para as dez’ em imagens de relógios analógicos.

Como resultado desse alcance limitado de tempos representados, o modelo pode ver apenas uma faixa estreita de configurações de relógio possíveis, limitando sua capacidade de generalizar além desses padrões repetitivos.

Quanto ao porquê os modelos falham em interpretar corretamente os relógios distorcidos, o artigo afirma:

‘Embora o GPT-4.1 desempenhe excepcionalmente bem com imagens de relógios padrão, é surpreendente que a modificação das mãos do relógio, tornando-as mais finas e adicionando pontas de seta, leve a uma queda significativa em sua precisão.

‘Intuitivamente, alguém poderia esperar que a mudança visual mais complexa – um mostrador distorcido – teria um impacto maior no desempenho, mas essa modificação parece ter um efeito relativamente menor.

‘Isso levanta uma pergunta: como os MLLMs interpretam relógios e por que eles falham? Uma possibilidade é que mãos mais finas prejudiquem a capacidade do modelo de perceber direção, enfraquecendo sua compreensão de orientação espacial.

‘Alternativamente, pode haver outros fatores que causem confusão quando o modelo tenta combinar as mãos da hora, do minuto e do segundo em uma leitura de tempo precisa.’

Os autores defendem que identificar a causa raiz dessas falhas é fundamental para avançar com os modelos multimodais: se o problema estiver na forma como o modelo percebe a direção espacial, o ajuste fino pode oferecer uma solução simples; mas se o problema decorrer de uma dificuldade mais ampla em integrar várias dicas visuais, aponta para uma fraqueza mais fundamental na forma como esses sistemas processam informações.

Testes de Ajuste Fino

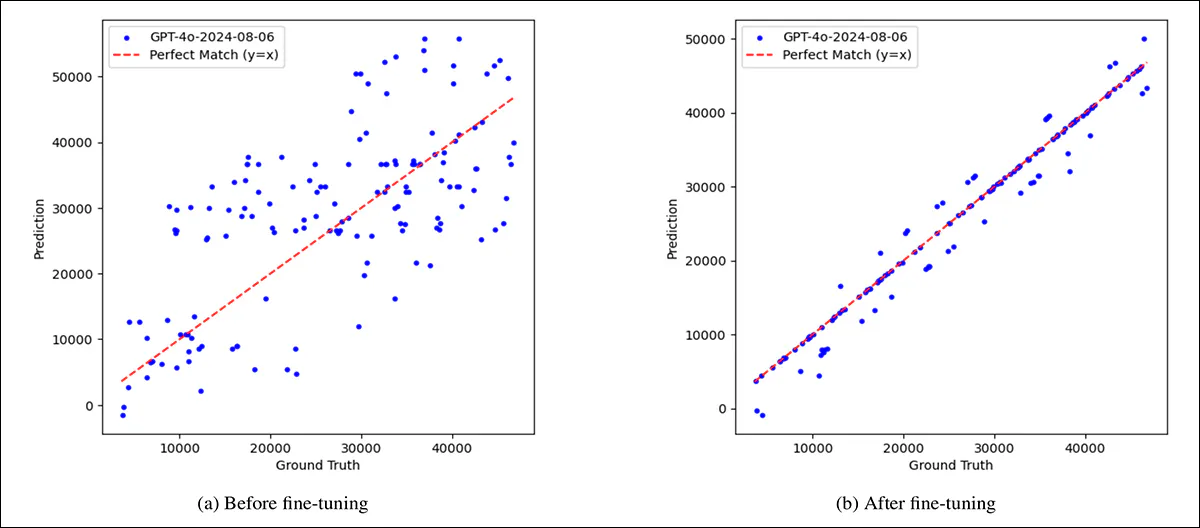

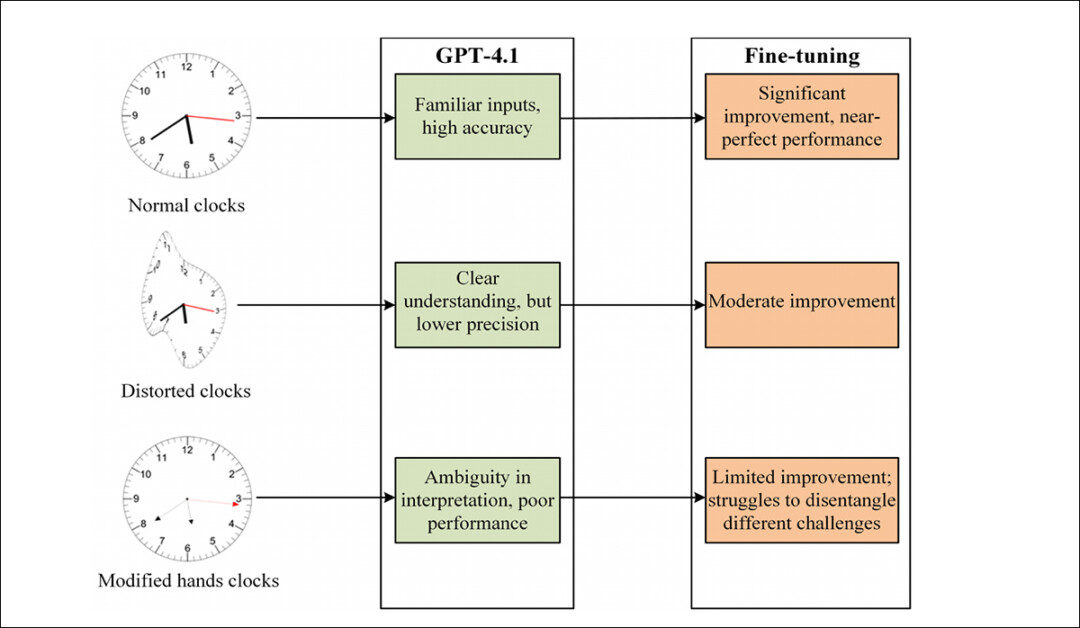

Para testar se as falhas do modelo pudessem ser superadas com exposição, o GPT-4.1 foi ajustado no conjunto de dados sintéticos mencionado anteriormente e abrangente. Antes do ajuste fino, suas previsões estavam amplamente dispersas, com erros significativos em todos os tipos de relógios. Após o ajuste fino no conjunto, a precisão melhorou acentuadamente em faces de relógio padrão e, em menor medida, em relógios distorcidos.

No entanto, relógios com mãos modificadas, como formas mais finas ou pontas de seta, continuaram a produzir erros grandes.

Dois modos de falha distintos surgiram: em relógios normais e distorcidos, o modelo geralmente subestimou a direção das mãos; mas em relógios com estilos de mão alterados, ele frequentemente confundiu a função de cada mão, confundindo a mão da hora com a mão do minuto ou a mão do minuto com a mão do segundo.

Uma comparação ilustrando a fraqueza inicial do modelo e os ganhos parciais alcançados por meio do ajuste fino, mostrando o tempo previsto versus o tempo real, em segundos, para 150 relógios selecionados aleatoriamente. À esquerda, antes do ajuste fino, as previsões do GPT-4.1 estão dispersas e frequentemente longe dos valores corretos, indicados pela linha diagonal vermelha. À direita, após o ajuste fino em um conjunto de dados sintéticos equilibrado, as previsões alinham-se muito mais de perto com a verdade fundamental, embora alguns erros permaneçam.

Isso sugere que o modelo havia aprendido a associar recursos visuais como a espessura da mão com papéis específicos e lutou quando essas dicas mudaram.

A melhoria limitada em designs desconhecidos levanta mais dúvidas sobre se um modelo desse tipo aprende o conceito abstrato de leitura de hora ou meramente refina sua correspondência de padrões.

Sinais de Mão

Então, embora o ajuste fino tenha melhorado o desempenho do GPT-4.1 em relógios analógicos convencionais, teve muito menos impacto em relógios com mãos mais finas ou pontas de seta, levantando a possibilidade de que as falhas do modelo decorressem menos do raciocínio abstrato e mais da confusão sobre qual mão era qual.

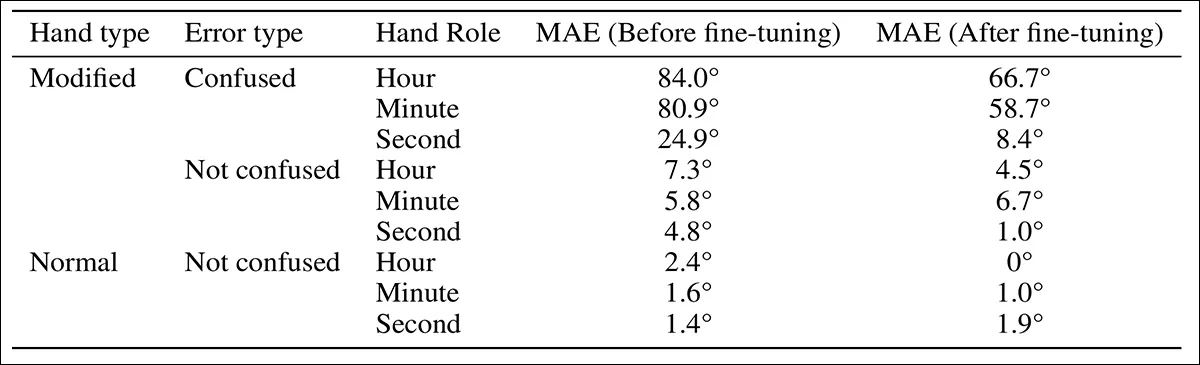

Para testar se a precisão poderia melhorar se essa confusão fosse removida, uma nova análise foi realizada nas previsões do modelo para o conjunto de dados de ‘mãos modificadas’. As saídas foram divididas em dois grupos: casos em que o GPT-4.1 corretamente reconheceu as mãos da hora, do minuto e do segundo; e casos em que não o fez.

As previsões foram avaliadas para Erro Absoluto Médio (MAE) antes e após o ajuste fino e os resultados comparados com os de relógios padrão; o erro angular também foi medido para cada mão usando a posição do mostrador como base:

Comparação de erros para relógios com e sem confusão de papéis de mão no conjunto de dados de mãos modificadas antes e após o ajuste fino.

A confusão dos papéis das mãos do relógio levou aos maiores erros. Quando o GPT-4.1 confundiu a mão da hora com a mão do minuto ou vice-versa, as estimativas de tempo resultantes estavam frequentemente longe. Em contraste, erros causados por julgamentos errados da direção de uma mão corretamente identificada foram menores. Entre as três mãos, a mão da hora mostrou o maior erro angular antes do ajuste fino, enquanto a mão do segundo mostrou o menor.

Erro angular por tipo de mão para previsões com e sem confusão de papéis de mão, antes e após o ajuste fino, no conjunto de dados de mãos modificadas.

Para se concentrar apenas em erros de direção, a análise foi limitada a casos em que o modelo corretamente identificou a função de cada mão. Se o modelo tivesse internalizado um conceito geral de leitura de hora, seu desempenho nesses exemplos deveria ter correspondido à sua precisão em relógios padrão. Ele não o fez, e a precisão permaneceu notavelmente pior.

Para examinar se a forma da mão interferia com o senso de direção do modelo, um segundo experimento foi realizado: dois novos conjuntos de dados foram criados, cada um contendo sessenta relógios sintéticos com apenas uma mão da hora, apontando para uma marca de minuto diferente. Um conjunto usou o design de mão original e o outro usou a versão alterada. O modelo foi solicitado a nomear a marca que a mão estava apontando.

Os resultados mostraram uma ligeira queda na precisão com as mãos modificadas, mas não o suficiente para explicar as falhas mais amplas do modelo. Um recurso visual desconhecido único pareceu capaz de interromper a interpretação geral do modelo, mesmo em tarefas que ele havia realizado bem anteriormente.

Visão geral do desempenho do GPT-4.1 antes e após o ajuste fino em relógios padrão, distorcidos e com mãos modificadas, destacando ganhos desiguais e fraquezas persistentes.

Conclusão

Embora o foco do artigo possa parecer trivial à primeira vista, ele não se importa especialmente se os modelos de visão-linguagem algum dia aprenderem a ler relógios analógicos com 100% de precisão. O que dá peso ao trabalho é seu foco em uma pergunta recorrente mais profunda: se saturar os modelos com mais (e mais diversificados) dados pode levar ao tipo de compreensão de domínio que os humanos adquirem por meio de abstração e generalização; ou se o único caminho viável é inundar o domínio com exemplos suficientes para antecipar cada variação provável na inferência.

Qualquer caminho levanta dúvidas sobre o que as arquiteturas atuais são realmente capazes de aprender.

Publicado pela primeira vez na segunda-feira, 19 de maio de 2025