Ângulo de Anderson

Adicionando diálogos a vídeos reais com IA

Uma nova estrutura de IA consegue reescrever, remover ou adicionar as falas de uma pessoa em um vídeo sem a necessidade de novas filmagens, em um único sistema completo.

Há três anos, a internet ficaria estupefata com qualquer uma das 20 a 30 estruturas de IA para alteração de vídeo que são publicadas semanalmente em portais acadêmicos; como está agora, essa linha popular de pesquisa tornou-se tão prolífica que quase constitui outro ramo da "IA descartável", e eu cubro muito menos desses lançamentos do que cobriria há dois ou três anos.

No entanto, um lançamento recente nessa linha me chamou a atenção: um sistema integrado que pode intervir em videoclipes reais e inserir novas falas no vídeo existente (em vez de criar um clipe generativo inteiro a partir de um rosto ou quadro, o que é muito mais comum).

Nos exemplos abaixo, que editei a partir de uma infinidade de vídeos de amostra disponíveis no lançamento... site do projetoPrimeiro vemos o clipe original e, em seguida, por baixo, a fala de IA inserida no meio do clipe, incluindo síntese de voz e sincronização labial:

Clique para jogar. Edição local com junção de imagens – uma das várias modalidades oferecidas pelo FacEDiT. Consulte o site original para obter uma resolução melhor. Fonte – https://facedit.github.io/

Esta abordagem é uma das três desenvolvidas para o novo método, intitulado "edição local com costura", e é a que mais interessa aos autores (assim como a mim). Essencialmente, o clipe é estendido usando um dos quadros intermediários como ponto de partida para uma nova interpretação por IA, e seu quadro subsequente (real) como um objetivo que o clipe inserido generativamente deve tentar alcançar. Nos clipes vistos acima, esses quadros "semente" e "alvo" são representados pela pausa do vídeo superior enquanto o vídeo modificado abaixo fornece o preenchimento generativo.

Os autores apresentam essa abordagem de síntese facial e vocal como o primeiro método totalmente integrado de ponta a ponta para edições de vídeo com IA desse tipo, observando o potencial de uma estrutura totalmente desenvolvida como essa para a produção de TV e cinema:

Cineastas e produtores de mídia frequentemente precisam revisar partes específicas de vídeos gravados – talvez uma palavra tenha sido dita incorretamente ou o roteiro tenha sido alterado após a filmagem. Por exemplo, na cena icônica de Titânico (1997) onde Rose diz, “Eu nunca vou te deixar ir, Jack.” O diretor poderá decidir mais tarde que deveria ser “Nunca me esquecerei de você, Jack”.

Tradicionalmente, essas alterações exigem a refilmagem de toda a cena, o que é caro e demorado. A síntese facial falante oferece uma alternativa prática, modificando automaticamente os movimentos faciais para corresponder à fala revisada, eliminando a necessidade de novas filmagens.

Embora intervenções de IA desse tipo possam enfrentar cultural Além da resistência da indústria, podem também constituir um novo tipo de funcionalidade em sistemas e ferramentas de efeitos visuais controlados por humanos. Em qualquer caso, por agora, os desafios são estritamente técnicos.

Além de estender um trecho com diálogos adicionais gerados por IA, o novo sistema também pode alterar a fala existente:

Clique para jogar. Um exemplo de alteração de diálogo existente em vez de inserção de diálogo adicional. Consulte o site original para obter uma melhor resolução.

Estado da arte

Atualmente, não existem sistemas completos que ofereçam esse tipo de capacidade de síntese; embora um número crescente de plataformas de IA generativa, como a do Google, esteja surgindo. Série Veo, pode gerar áudio, e diversas outras estruturas podem criar áudio deepfakedAtualmente, é necessário criar um fluxo de trabalho bastante complexo, com diversas arquiteturas e truques, para interferir em imagens reais da maneira como o novo sistema – intitulado FaceEdit – pode realizar.

O sistema usa Transformadores de difusão (DiT) em combinação com Correspondência de fluxo para criar movimentos faciais condicionados aos movimentos circundantes (contextuais) e ao conteúdo de áudio da fala. O sistema utiliza pacotes populares já existentes que lidam com reconstrução facial, incluindo Retrato ao vivo (recentemente assumido por Kling).

Além desse método, visto que sua abordagem é a primeira a integrar esses desafios em uma única solução, os autores criaram um novo parâmetro de avaliação chamado FaceEDiTBench, juntamente com várias métricas de avaliação totalmente novas, adequadas a esta tarefa muito específica.

O novo trabalho é intitulado FaceDIT: Edição e geração unificada de rostos falantes por meio do preenchimento de movimentos faciais.e é fruto do trabalho de quatro pesquisadores da Universidade de Ciência e Tecnologia de Pohang (POSTECH), do Instituto Avançado de Ciência e Tecnologia da Coreia (KAIST) e da Universidade do Texas em Austin, na Coreia.

Forma

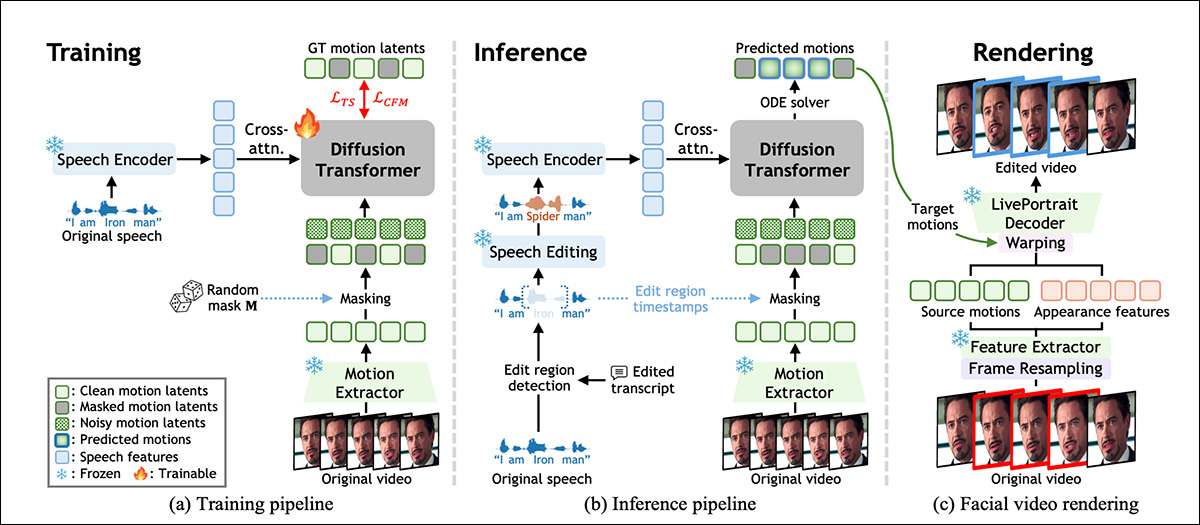

O FacEDiT é treinado para reconstruir movimentos faciais aprendendo a preencher as lacunas da performance original de um ator, com base nos movimentos ao redor e no áudio da fala. Como mostrado no esquema abaixo, esse processo permite que o modelo atue como um preenchedor de lacunas durante o treinamento, prevendo movimentos faciais que correspondam à voz, mantendo a consistência com o vídeo original.

Visão geral do sistema FacEDiT, mostrando como o movimento facial é aprendido por meio de preenchimento auto-supervisionado durante o treinamento, guiado pela fala editada na inferência e, finalmente, renderizado de volta em vídeo reutilizando a aparência da filmagem original, substituindo apenas o movimento desejado. fonte

No momento da inferência, a mesma arquitetura suporta duas saídas diferentes, dependendo de quanto do vídeo está mascarado: edições parciais, onde apenas uma frase é alterada e o restante permanece intacto; ou geração de frases completas, onde um novo movimento é sintetizado inteiramente do zero.

O modelo é treinado através de correspondência de fluxo, que trata as edições de vídeo como uma espécie de caminho entre duas versões de movimento facial.

Em vez de aprender a adivinhar do zero como um rosto editado deveria ser, o sistema de correspondência de fluxo aprende a transitar gradual e suavemente entre um marcador de posição ruidoso e o movimento correto. Para facilitar isso, o sistema representa o movimento facial como um conjunto compacto de números extraídos de cada quadro usando uma versão do sistema LivePortrait mencionado anteriormente (veja o esquema acima).

Esses vetores de movimento são projetados para descrever expressões e a posição da cabeça sem emaranhando identidade, para que as alterações na fala possam ser localizadas sem afetar a aparência geral da pessoa.

Treinamento FaceEdit

Para treinar o FacEDiT, cada videoclipe foi dividido em uma série de instantâneos de movimento facial, e cada quadro foi pareado com o trecho de áudio correspondente. Partes aleatórias dos dados de movimento foram então ocultadas, e o modelo foi solicitado a adivinhar como esses movimentos ausentes deveriam ser, usando tanto a fala quanto o movimento adjacente não mascarado como contexto.

Como os trechos mascarados e suas posições variam de um exemplo de treinamento para o outro, o modelo aprende gradualmente a lidar tanto com pequenas edições internas quanto com lacunas maiores, para a geração de sequências completas, de acordo com a quantidade de informações que recebe.

O Transformador de Difusão mencionado anteriormente aprende a recuperar movimentos mascarados refinando entradas ruidosas ao longo do tempo. Em vez de alimentar o modelo com fala e movimento simultaneamente, o áudio é inserido em cada bloco de processamento através de atenção cruzada, ajudando o sistema a combinar os movimentos dos lábios com mais precisão à fala em áudio.

Para preservar o realismo entre as edições, a atenção é direcionada para os quadros vizinhos em vez de toda a linha do tempo, forçando o modelo a se concentrar na continuidade local e evitando oscilações ou saltos de movimento nas bordas das regiões alteradas. Incorporações posicionais (que informam ao modelo onde cada quadro aparece na sequência) ajudam ainda mais o modelo a manter o fluxo temporal e o contexto naturais.

Durante o treinamento, o sistema aprende a prever movimentos faciais ausentes reconstruindo trechos mascarados com base na fala e em movimentos próximos não mascarados. No momento da inferência, essa mesma configuração é reutilizada, mas com as máscaras agora guiadas por edições na fala.

Quando uma palavra ou frase é inserida, removida ou alterada, o sistema localiza a região afetada, a mascara e regenera o movimento que corresponde ao novo áudio. A geração de sequências completas é tratada como um caso especial, em que toda a região é mascarada e sintetizada do zero.

Dados e testes

A espinha dorsal do sistema é composta por 22 camadas para o Transformador de Difusão, cada uma com 16 cabeças de atenção e dimensões de feedforward de 1024 e 2024px. Os recursos de movimento e aparência são extraídos usando congelado componentes LivePortrait e voz codificada via WavLM e modificado usando VoiceCraft.

Uma camada de projeção dedicada mapeia as características da fala de 786 dimensões no espaço latente do DiT, com apenas o DiT e os módulos de projeção treinados do zero.

O treinamento foi realizado sob a supervisão de Adam W otimizador com taxa de aprendizado alvo de 1e‑4, por um milhão de passos, em duas GPUs A6000 (cada uma com 48 GB de VRAM), totalizando tamanho do batch de oito.

FaceEDiTBench

O conjunto de dados FacEDiTBench contém 250 exemplos, cada um com um videoclipe da fala original e editada, além das transcrições de ambas. Os vídeos provêm de três fontes, sendo 100 clipes de HDTF, 100 de Olá3, e 50 de Dublagem de celebridadesCada um foi verificado manualmente para confirmar se o áudio e o vídeo tinham clareza suficiente para avaliação.

GPT-4o O software foi usado para revisar cada transcrição e criar edições gramaticalmente corretas. Essas transcrições revisadas, juntamente com a fala original, foram enviadas para a VoiceCraft para produzir um novo áudio; e em cada etapa, tanto a transcrição quanto a fala gerada foram revisadas manualmente para garantir a qualidade.

Cada amostra foi rotulada com o tipo de edição, o momento da alteração e a extensão do trecho modificado, e as edições foram classificadas como inserções, deleções, ou substituiçõesO número de palavras alteradas variou de pequenas edições de 1 a 3 palavras, edições médias de 4 a 6 palavras e edições mais longas de 7 a 10 palavras.

Foram definidas três métricas personalizadas para avaliar a qualidade da edição. continuidade fotométrica, para medir o quão bem a iluminação e a cor de um segmento editado se misturam com o vídeo circundante, comparando as diferenças ao nível do pixel nas bordas; continuidade do movimento, para avaliar a consistência do movimento facial, medindo as alterações do fluxo óptico entre quadros editados e não editados; e preservação da identidadePara estimar se a aparência do sujeito permanece consistente após a edição, comparamos os embeddings faciais das sequências originais e geradas usando o Arc Face Modelo de reconhecimento facial.

Testes

O modelo de teste foi treinado com material dos três conjuntos de dados mencionados acima, totalizando cerca de 200 horas de conteúdo em vídeo, incluindo vlogs e filmes, bem como vídeos do YouTube em alta resolução.

Para avaliar a edição de rostos em fala, foi utilizado o FacEDiTBench, além do teste dividido HDTF, que se tornou um padrão de referência para esse conjunto de tarefas.

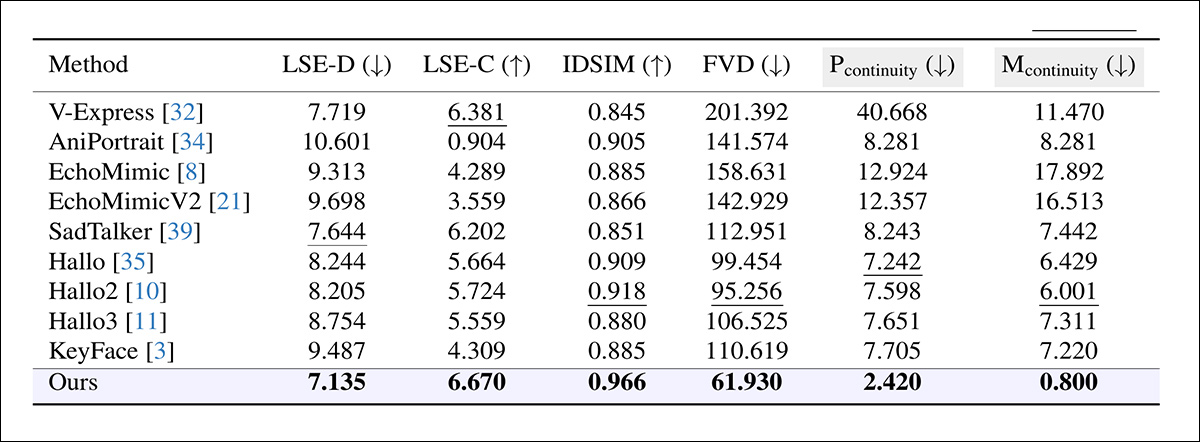

Como não existiam sistemas diretamente comparáveis capazes de encapsular esse tipo de funcionalidade de ponta a ponta, os autores escolheram uma variedade de estruturas que reproduziam pelo menos parte da funcionalidade desejada e que pudessem servir como linhas de base; a saber, KeyFace; EchoMimic; EchoMimicV2; Olá; Olá2; Olá3; V-Express; AniRetrato; e SadTalker.

Diversas métricas estabelecidas também foram utilizadas para avaliar a qualidade de geração e edição, com a precisão da sincronização labial avaliada por meio de SyncNet, relatando tanto o erro absoluto entre os movimentos dos lábios e o áudio (LSE-D) quanto uma pontuação de confiança (LSE-C); Distância do vídeo Fréchet (FVD) quantificando o quão realista o vídeo parecia no geral; e Métricas de similaridade perceptual aprendidas (LPIPS), que mede a similaridade perceptual entre quadros gerados e originais.

Para a edição, todas as métricas, exceto LPIPS, foram aplicadas apenas ao segmento modificado; para a geração, o vídeo inteiro foi avaliado, excluindo-se a continuidade das bordas.

Cada modelo foi criado para sintetizar um segmento de vídeo correspondente, que era então inserido no clipe original (os pesquisadores observam que esse método frequentemente introduzia descontinuidades visíveis, onde a seção editada encontrava a filmagem circundante). Uma segunda abordagem também foi testada, na qual todo o vídeo era regenerado a partir do áudio modificado – mas isso inevitavelmente sobrescrevia as regiões não editadas e não preservava a performance original.

Comparação do desempenho de edição entre sistemas originalmente projetados para geração de rostos falantes, com o FacEDiT superando todos os sistemas de referência em todas as métricas, alcançando menor erro de sincronização labial (LSE-D), maior confiança de sincronização (LSE-C), melhor preservação da identidade (IDSIM), maior realismo perceptual (FVD) e transições mais suaves entre os limites de edição (Pcontinuity, Mcontinuity). As colunas sombreadas em cinza destacam os principais critérios para avaliar a qualidade dos limites; os valores em negrito e sublinhados indicam os melhores e segundos melhores resultados, respectivamente.

Em relação a esses resultados, os autores comentam:

"Nosso modelo supera significativamente os métodos existentes na tarefa de edição. Ele alcança forte continuidade de contornos e alta preservação de identidade, demonstrando sua capacidade de manter a consistência temporal e visual durante a edição. Além disso, sua precisão superior de sincronização labial e baixo FVD refletem o realismo do vídeo sintetizado."

Clique para jogar. Resultados compilados por este autor a partir dos vídeos publicados no site do projeto de apoio. Consulte o site original para obter melhor resolução.

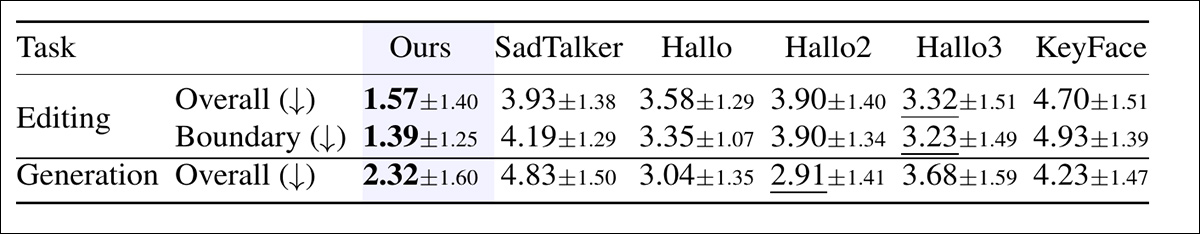

Além disso, foi realizado um estudo com humanos para avaliar a qualidade percebida tanto na edição quanto na geração.

Para cada comparação, os participantes assistiram a seis vídeos e os classificaram de acordo com a qualidade geral, considerando a precisão da sincronização labial, a naturalidade e o realismo dos movimentos da cabeça. Nos testes de edição, os participantes também avaliaram a suavidade das transições entre os segmentos editados e não editados.

Classificação média atribuída por avaliadores humanos, onde menor significa melhor. Tanto na edição quanto na geração, os participantes avaliaram o quão natural e bem sincronizado cada vídeo parecia. Na edição, eles também avaliaram a suavidade da transição entre a fala editada e a original. Os números em negrito e sublinhados indicam as duas maiores pontuações.

No estudo, o FacEDiT foi consistentemente classificado como o melhor, com uma clara vantagem, tanto em qualidade de edição quanto em fluidez de transição, recebendo também pontuações altas no cenário de geração, o que sugere que suas vantagens mensuráveis se traduzem em resultados perceptualmente preferidos.

Devido à limitação de espaço, remetemos o leitor ao artigo original para obter mais detalhes sobre os estudos de ablação e os testes adicionais realizados e relatados neste novo trabalho. De fato, pesquisas típicas desse tipo geralmente têm dificuldade em gerar seções significativas com resultados de testes, visto que o próprio trabalho principal inevitavelmente serve como base para pesquisas futuras.

Conclusão

Mesmo para inferência, sistemas como este podem exigir recursos computacionais significativos durante o processo, dificultando que usuários subsequentes – presumivelmente, estúdios de efeitos visuais – mantenham o trabalho em suas instalações. Portanto, abordagens que possam ser adaptadas a recursos locais realistas serão sempre preferidas pelos provedores, que têm a obrigação legal de proteger as filmagens e a propriedade intelectual de seus clientes.

Isso não significa criticar a nova oferta, que pode muito bem funcionar perfeitamente com pesos quantizados ou outras otimizações, e que é a primeira oferta desse tipo a me atrair de volta a essa linha de pesquisa em bastante tempo.

Publicado originalmente na quarta-feira, 17 de dezembro de 2020. Editado às 20h10 EET do mesmo dia, para maior espaço no primeiro parágrafo do corpo do texto.