Kąt Andersona

Z dala od oczu, z dala od myśli: Rozwiązanie największego problemu wideo AI

Największym problemem nawet najlepszych generatorów wideo AI jest ich chroniczna amnezja – wyzwanie, którym zajmują się teraz nowe badania z Chin.

Największym problemem nawet najlepszych i najbardziej zaawansowanych systemów generowania wideo AI jest to, że wszystkie cierpią na chroniczną amnezję: jeśli kamera odsunie się od obiektu, na którym się skupiała, a potem powróci, nigdy nie odnajdzie tego, co było na początku – postacie znikną, zmienią wygląd i/lub rodzaj ruchu, a tło prawdopodobnie również się zmieni.

Dzieje się tak, ponieważ system generowania oparty na dyfuzji ma ograniczone ruchome okno uwagi i ponieważ zawsze zajmuje się tym, co może zobaczyć w danej chwili; w prawdziwej realizacji solipsyzmu, to, co znajduje się poza kadrem, dla generatywnej AI nie istnieje – dosłownie jest usuwane z pamięci.

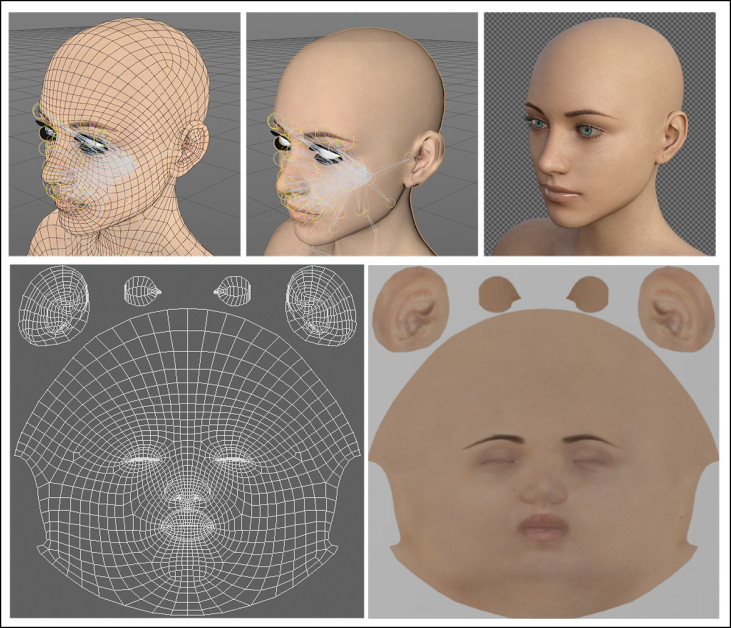

Nigdy nie było to problemem w tradycyjnym CGI, które zawsze może odwołać się do obiektu i dokładnie go odtworzyć, wraz z wyglądem i ruchem, w dowolnym momencie renderowanego wideo, gdzie może być ponownie potrzebny:

Tradycyjne siatki i tekstury bitmapowe CGI zawsze można przywołać z powrotem do renderu, zapewniając spójny wygląd – sztuczka znacznie trudniejsza do osiągnięcia w podejściach AI, ponieważ nie ma równoważnego ‘płaskiego odniesienia’ w postaci pliku lub zbioru powiązanych plików.

Dzieje się tak, ponieważ elementy składowe CGI, takie jak siatka i tekstury (patrz obraz powyżej), a także pliki ruchu i inne dynamiczne zachowania, mogą istnieć oddzielnie na dysku i być włączane do kompozycji w dowolnym momencie.

W generatywnym wideo AI nie ma takiego ‘płaskiego repozytorium’; najbliższym odpowiednikiem tej funkcjonalności są LoRA – specjalnie wytrenowane pliki dodatkowe, które można trenować na sprzęcie konsumenckim, pozwalające ‘wymusić’ nowe postacie i konkretne ubrania w filmie:

Kliknij, aby odtworzyć. Problem solipsyzmu wideo AI można do pewnego stopnia złagodzić za pomocą LoRA – ale rezultaty mogą być przytłaczające.

Nie jest to jednak idealne rozwiązanie. Po pierwsze, LoRA są powiązane z dokładnie określoną wersją modelu bazowego (takiego jak Wan2+ lub Hunyuan Video) i wymagają odtworzenia za każdym razem, gdy zmienia się model bazowy. Po drugie, LoRA mają tendencję do zniekształcania wag modelu bazowego, tak że wytrenowana tożsamość LoRA jest narzucana wszystkim postaciom w scenie. Dodatkowo, metody dostrajania tego rodzaju są bardzo wrażliwe na słabo przygotowane zbiory danych.

Dokładne powroty

Teraz nowa współpraca akademicko-przemysłowa z Chin oferuje pierwsze znaczące lekarstwo, które zwróciło moją uwagę w ciągu ponad trzech lat relacjonowania tego problemu. Metoda wykorzystuje to, co badacze nazywają pamięcią hybrydową, aby utrzymać postać poza ekranem i jej bezpośrednie otoczenie w stanie aktywnym i dokładnym w przestrzeni latentnej modelu, tak aby efekt był spójny, gdy nasz punkt widzenia do nich powraca:

Kliknij, aby odtworzyć. Ze strony projektu nowej pracy, dwa przykłady generowanych przez AI (WAN) postaci opuszczających kadr i dokładnie do niego wracających. Źródło

Należy podkreślić, że nie jest to to samo, co osiągnięcie spójności postaci w różnych ujęciach – coś, co rzekomo osiągnięto rok temu w wydaniu Gen 4 Runway i co pozostaje ciągłym przedmiotem badań w literaturze.

Zamiast tego, rozwiązano tu coś, czego żadna komercyjna ani eksperymentalna platforma, jaką widziałem, nie była w stanie osiągnąć – wizualnie spójne ponowne pojawienie się dawnego wyglądu, ruchu i otoczenia postaci znajdującej się poza ekranem:

Kliknij, aby odtworzyć. Pozostałe dwa główne przykłady podane na stronie projektu nowej inicjatywy.

Oczywiście działające tu zasady można równie dobrze zastosować w innych dziedzinach, takich jak eksploracja miejska, jazda z perspektywy pierwszej osoby (POV) lub inne rodzaje renderowań niezawierających postaci.

Należy również podkreślić, że to nowe podejście nie rozwiązuje ani nie odnosi się do kwestii, którą Runway Gen4 i inne platformy zamknięte twierdzą, że rozwiązały, poprzez odtwarzanie postaci w różnych ujęciach; zamiast tego robi coś, w czym żadna z nich jeszcze nie odniosła sukcesu – utrzymuje postać i środowisko w pamięci, bez konieczności, aby były one cały czas widoczne dla widza.

Nowa praca obejmuje dedykowany zbiór danych wygenerowany za pomocą Unreal Engine, a także niestandardowe metryki dla problemu solipsyzmu* oraz specjalnie zaprojektowane ramy generatywne zbudowane na bazie WAN. W testach przeciwko nielicznym dostępnym analogicznym systemom autorzy twierdzą o wynikach na najwyższym światowym poziomie i komentują:

‘Mechanizmy [pamięci] wyłoniły się jako kluczowa granica w rozwoju modeli świata, ponieważ pojemność pamięci decyduje o spójności przestrzennej i czasowej generowanej treści.

‘Konkretnie, jest to poznawcza kotwica, która pozwala modelowi zachować kontekst historyczny podczas przesunięć punktu widzenia lub długoterminowej ekstrapolacji.

‘Bez solidnej pamięci symulowany świat szybko rozpada się na niepowiązane, chaotyczne klatki.’

Nowa praca nosi tytuł Out of Sight but Not Out of Mind: Hybrid Memory for Dynamic Video World Models i pochodzi od siedmiu badaczy z Huazhong University of Science and Technology oraz zespołu Kling w Kuaishou Technology.

Metoda

Centralnym elementem nowej pracy jest pamięć hybrydowa, która ułatwia ‘ekstrapolację poza widok’ – zachowanie postaci i ich kontekstów, gdy widz ‘odwraca wzrok’ (lub gdy sama postać wychodzi z pola widzenia). W tym scenariuszu ramy są zobowiązane do wykonania rozdzielenia czasoprzestrzennego, w którym jednocześnie skupiają się na generowaniu widocznym dla widza i na istnieniu poza ekranem obecnie niewidocznej postaci.

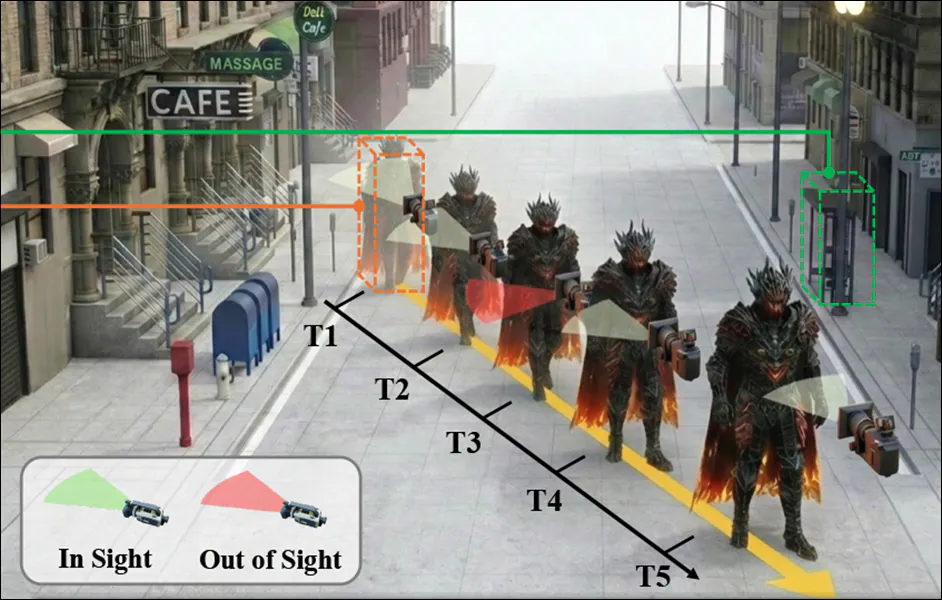

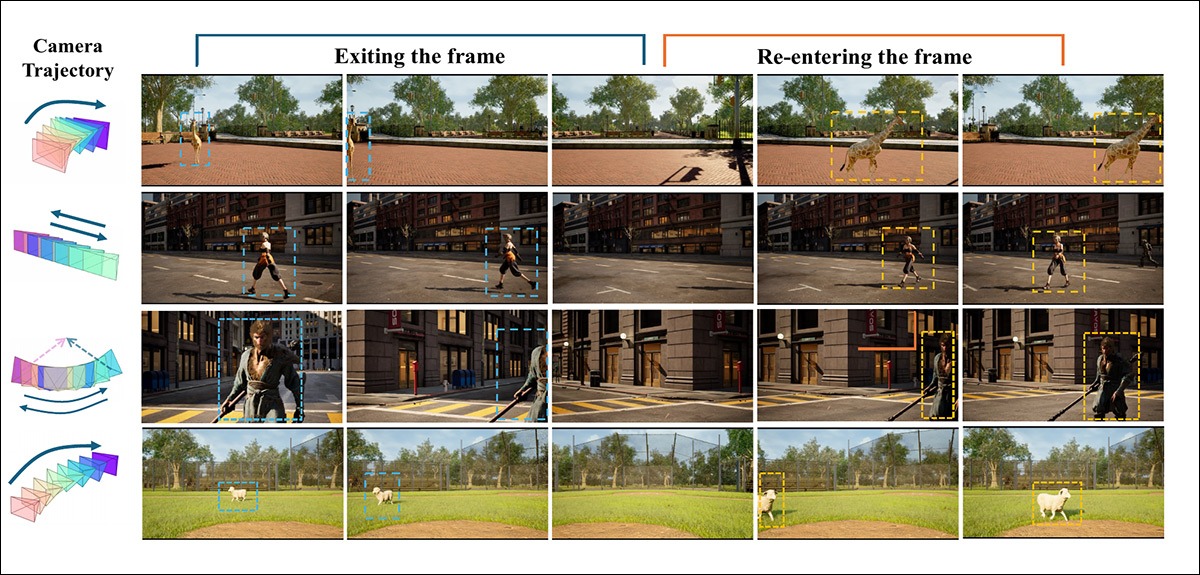

Przykłady ruchu kamery wejścia/wyjścia. W tych przypadkach to ruch kamery powoduje, że postać opuszcza kadr, ale w różnych próbkach możemy również zaobserwować, jak same postacie tymczasowo wypychają się poza ekran. Źródło

Autorzy zauważają, że w latentnych osadzeniach dyfuzyjnych cechy, które należy wyodrębnić i wykorzystać, są silnie splecione z innymi cechami i właściwościami; oraz że próba ich wyodrębnienia często powoduje ‘zamrożenie’ obiektu w tle. Dlatego opracowali i przygotowali zbiór danych HM-World**, specjalnie ukierunkowany na trening pamięci hybrydowej:

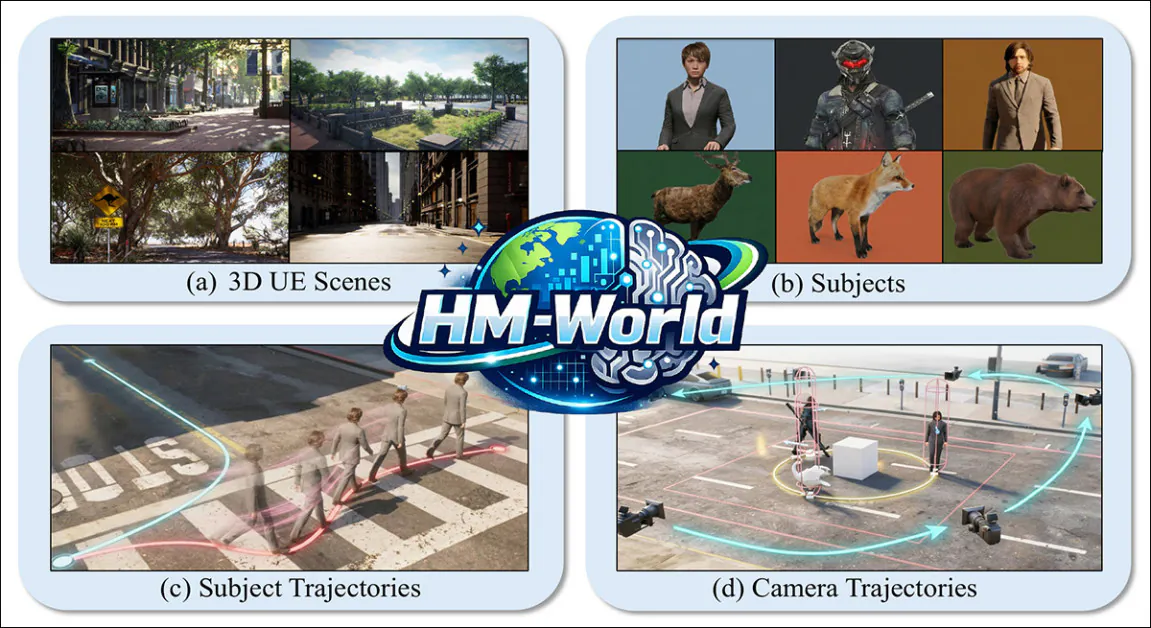

Z pracy, próbki z czterech kategorii zawartych w zbiorze danych HM-World.

Kolekcja jest skonstruowana wzdłuż czterech wymiarów: trajektorie podmiotu, trajektorie kamery, sceny i podmioty.

Dane syntetyczne w HM-World obejmują 17 scen i 49 podmiotów, w tym osoby o różnym wyglądzie, a także zwierzęta wielu gatunków. Ich kombinacje są proceduralnie umieszczane w scenie za pomocą Unreal Engine, każda z odrębną animacją ruchu, a następnie ustawiane na losowo wybranej trajektorii.

Autorzy stwierdzają, że w zbiorze danych przedstawiono zróżnicowany zestaw zdarzeń wyjścia-wejścia, z 28 różnymi trajektoriami kamery, każda z wieloma punktami początkowymi.

Ostateczna kolekcja liczy 59 225 klipów wideo, z których każdy został opisany przez Wielojęzyczny Model Duży (MLLM) MiniCPM-V.

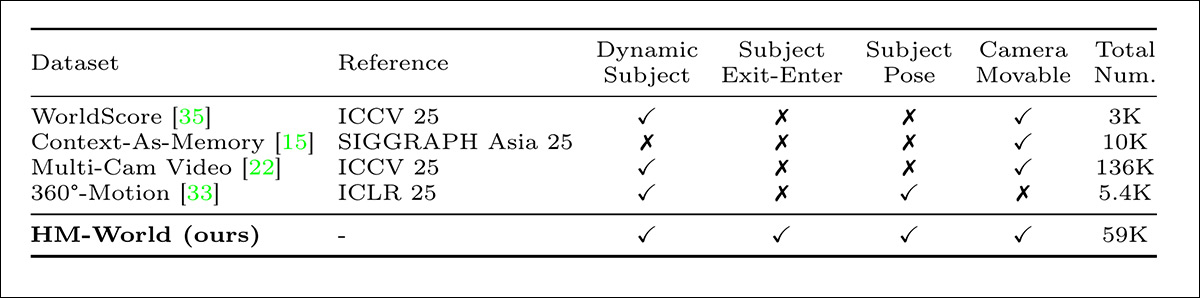

Badacze wskazują na statystyczne zalety swojej kolekcji w porównaniu z wcześniejszymi zbiorami danych WorldScore; Context-As-Memory; Multi-Cam Video; oraz 360° Motion:

Porównanie istniejących zbiorów danych ze zbiorem danych HM-World, gdzie ‘Dynamic Subject’ oznacza obecność poruszających się bytów, ‘Subject Exit-Enter’ oznacza klipy zawierające podmioty opuszczające i wchodzące z powrotem do kadru, a ‘Subject Pose’ odnosi się do dołączenia opisanych poz 3D.

Mniej uczęszczana ścieżka

Mając kilka poprzednich