Kąt Andersona

Wyszukiwanie ‘Sów i Jaszczurek’ w Audytorium Reklamodawcy

Ponieważ sektor reklam online szacowany jest na 740,3 miliarda dolarów amerykańskich w 2023 roku, łatwo zrozumieć, dlaczego firmy reklamowe inwestują znaczne zasoby w ten konkretny obszar badań nad widzeniem komputerowym.

Chociaż branża jest izolowana i chroniona, okazjonalnie publikuje studia, które sugerują bardziej zaawansowaną pracę własnościową w rozpoznawaniu twarzy i kierunku wzroku – w tym rozpoznawaniu wieku, kluczowym dla statystyk analitycznych demograficznych:

Estimating age in an in-the-wild advertising context is of interest to advertisers who may be targeting a particular age demographic. In this experimental example of automatic facial age estimation, the age of performer Bob Dylan is tracked across the years. Source: https://arxiv.org/pdf/1906.03625

Te studia, które rzadko pojawiają się w publicznych repozytoriach, takich jak Arxiv, wykorzystują uczestników zarekrutowanych w sposób uzasadniony jako podstawę do analizy napędzanej przez sztuczną inteligencję, której celem jest określenie, w jakim stopniu i w jaki sposób widz angażuje się w reklamę.

Dlib’s Histogram of Oriented Gradients (HoG) is often used in facial estimation systems. Source: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Instynkt Zwierzęcy

W tym zakresie naturalnie, branża reklamowa jest zainteresowana określeniem fałszywych pozytywów (okazji, w których system analityczny błędnie interpretuje działania podmiotu) oraz ustaleniem wyraźnych kryteriów dla sytuacji, w której osoba oglądająca reklamy nie jest w pełni zaangażowana w treść.

Jeśli chodzi o reklamę opartą na ekranie, studia koncentrują się na dwóch problemach w dwóch środowiskach. Środowiskami są ‘biurko’ lub ‘mobilne’, z których każde ma szczególne cechy, które wymagają specjalnych rozwiązań do śledzenia; a problemy – z punktu widzenia reklamodawcy – reprezentowane są przez zachowanie sów i jaszczurek – tendencję widzów do niepełnego zwracania uwagi na reklamę, która jest przed nimi.

Examples of ‘Owl’ and ‘Lizard’ behavior in a subject of an advertising research project. Source: https://arxiv.org/pdf/1508.04028

Jeśli spoglądasz od zamierzonej reklamy całą głową, jest to ‘zachowanie sów’; jeśli Twoja pozycja głowy jest statyczna, ale Twoje oczy błądzą od ekranu, jest to ‘zachowanie jaszczurek’. W kwestii analizy i testowania nowych reklam w kontrolowanych warunkach, są to niezbędne działania, które system musi być w stanie przechwytywać.

Nowy artykuł z Affectiva, należącej do SmartEye, zajmuje się tymi problemami, oferując architekturę, która wykorzystuje kilka istniejących ram, aby zapewnić połączony i skonsolidowany zestaw funkcji we wszystkich wymaganych warunkach i możliwych reakcjach – oraz aby móc określić, czy widz jest znudzony, zaangażowany czy w jakiś sposób oddalony od treści, którą reklamodawca chce, aby obejrzał.

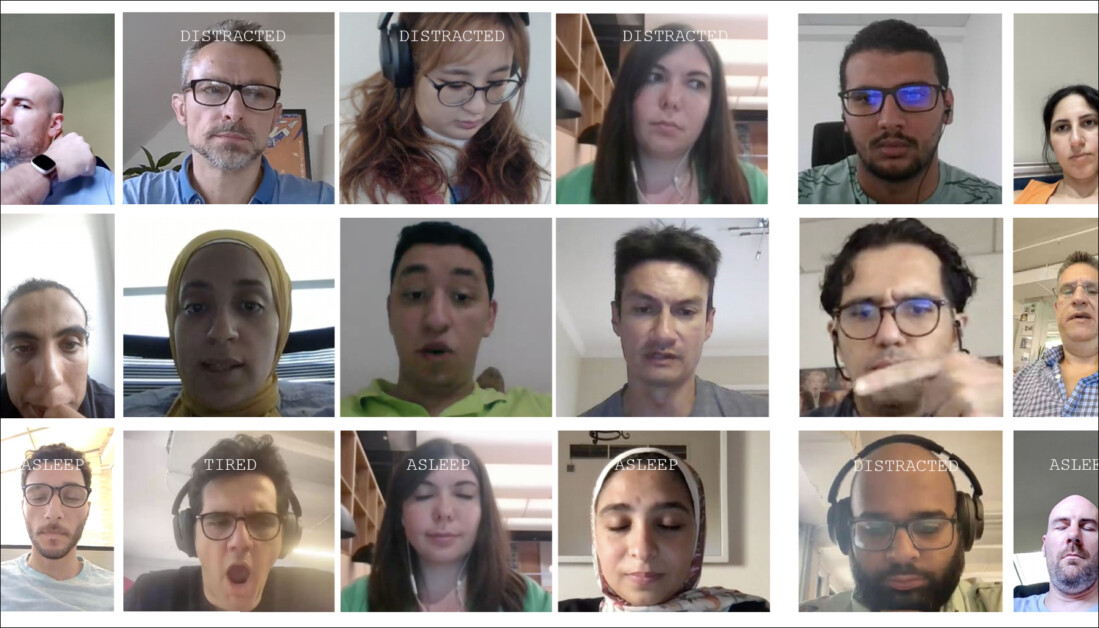

Examples of true and false positives detected by the new attention system for various distraction signals, shown separately for desktop and mobile devices. Source: https://arxiv.org/pdf/2504.06237

Autorzy stwierdzają*:

‘Ograniczone badania zajmowały się monitorowaniem uwagi podczas reklam online. Chociaż te studia koncentrowały się na szacowaniu położenia głowy lub kierunku wzroku, aby zidentyfikować przypadki rozproszonej uwagi, pomijają one krytyczne parametry, takie jak typ urządzenia (biurko lub mobilne), umiejscowienie kamery względem ekranu i rozmiar ekranu. Te czynniki znacznie wpływają na wykrywanie uwagi.

‘W tym artykule proponujemy architekturę do wykrywania uwagi, która obejmuje wykrywanie różnych rozpraszaczy, w tym zarówno zachowanie sów, jak i jaszczurek, polegające na spoglądaniu poza ekran, mówieniu, senności (przez ziewanie i przedłużone zamknięcie oczu) oraz pozostawianie ekranu bez nadzoru.

‘W przeciwieństwie do poprzednich podejść, nasza metoda integruje funkcje specyficzne dla urządzenia, takie jak typ urządzenia, umiejscowienie kamery, rozmiar ekranu (dla biurek) i orientacja kamery (dla urządzeń mobilnych) z surowym szacowaniem wzroku, aby poprawić dokładność wykrywania uwagi.’

Nowa praca nowy artykuł nosi tytuł Monitoring Viewer Attention During Online Ads i pochodzi od czterech badaczy z Affectiva.

Metoda i Dane

Głównie ze względu na tajemniczość i zamknięty charakter takich systemów, nowy artykuł nie porównuje podejścia autorów bezpośrednio z rywalami, ale raczej przedstawia swoje wyniki wyłącznie jako studia ablacyjne; ani artykuł nie przestrzega ogólnie formatu literatury z dziedziny widzenia komputerowego. Dlatego też przyjrzymy się badaniu, tak jak jest ono przedstawione.

Autorzy podkreślają, że tylko ograniczona liczba badań zajmowała się wykrywaniem uwagi szczególnie w kontekście reklam online. W AFFDEX SDK, który oferuje rozpoznawanie twarzy w czasie rzeczywistym, uwaga jest wnioskowana wyłącznie z położenia głowy, z uczestnikami oznaczonymi jako nieuwagi, jeśli kąt ich głowy przekracza określony próg.

An example from the AFFDEX SDK, an Affectiva system which relies on head pose as an indicator of attention. Source: https://www.youtube.com/watch?v=c2CWb5jHmbY

W 2019 współpracy Automatic Measurement of Visual Attention to Video Content using Deep Learning, zestaw danych około 28 000 uczestników został opisany dla różnych zachowań nieuwagi, w tym spoglądania, zamykania oczu lub angażowania się w działania niezwiązane, a model CNN-LSTM został wytrenowany do wykrywania uwagi z wyglądu twarzy w czasie.

From the 2019 paper, an example illustrating predicted attention states for a viewer watching video content. Source: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Jednak autorzy zauważają, że te wcześniejsze próby nie uwzględniały czynników specyficznych dla urządzenia, takich jak to, czy uczestnik używał urządzenia biurowego czy mobilnego; ani nie brały pod uwagę rozmiaru ekranu czy umiejscowienia kamery. Dodatkowo system AFFDEX koncentruje się wyłącznie na identyfikowaniu rozproszonej uwagi, pomijając inne źródła rozpraszające, podczas gdy praca z 2019 roku próbuje wykryć szerszy zestaw zachowań – ale jej użycie jednej płytkiej CNN mogło, jak stwierdza artykuł, być niewystarczające do tego zadania.

Autorzy zauważają, że niektóre z najpopularniejszych badań w tej linii nie są optymalizowane dla testowania reklam, które mają inne potrzeby w porównaniu z dziedzinami, takimi jak prowadzenie samochodu lub edukacja – gdzie umiejscowienie kamery i kalibracja są zwykle ustalone z wyprzedzeniem, polegając zamiast tego na niekalibrowanych ustawieniach, oraz działając w ograniczonym zakresie wzroku urządzeń biurowych i mobilnych.

Dlatego też opracowali architekturę do wykrywania uwagi widza podczas reklam online, wykorzystując dwie komercyjne zestawy narzędzi: AFFDEX 2.0 i SmartEye SDK.

Examples of facial analysis from AFFDEX 2.0. Source: https://arxiv.org/pdf/2202.12059

Te poprzednie prace wyodrębniają funkcje niskiego poziomu, takie jak wyrażenia twarzy, położenie głowy i kierunek wzroku. Następnie są one przetwarzane w celu wytworzenia wskaźników wysokiego poziomu, w tym położenia wzroku na ekranie; ziewania; i mówienia.

System identyfikuje cztery typy rozpraszaczy: spoglądanie poza ekran; senność,; mówienie; i nieuwagi ekranu. Dostosowuje również analizę wzroku w zależności od tego, czy widz korzysta z urządzenia biurowego czy mobilnego.

Zestawy Danych: Wzrok

Autorzy wykorzystali cztery zestawy danych, aby napędzić i ocenić system wykrywania uwagi: trzy koncentrujące się na zachowaniu wzroku, mówieniu i ziewaniu; oraz czwarty pochodzący z sesji testowych reklam w środowisku rzeczywistym, zawierający mieszaninę typów rozpraszaczy.

Ze względu na specyficzne wymagania pracy, zestawy danych zostały stworzone dla każdej z tych kategorii. Wszystkie zestawy danych zostały pozyskane z repozytorium własnościowego, zawierającego miliony nagranych sesji uczestników oglądających reklamy w domowym lub środowisku pracy, z wykorzystaniem ustawienia opartego na sieci, zgodnie z zgodą – i ze względu na ograniczenia tych umów, autorzy stwierdzają, że zestawy danych dla nowej pracy nie mogą być udostępnione publicznie.

Aby zbudować zestaw danych wzroku, uczestnikom kazano śledzić poruszający się punkt po różnych punktach na ekranie, w tym jego krawędziach, a następnie spoglądać poza ekran w czterech kierunkach (w górę, w dół, w lewo i w prawo) z sekwencją powtórzoną trzykrotnie. W ten sposób ustanowiono relację między uchwyceniem a pokryciem:

Screenshots showing the gaze video stimulus on (a) desktop and (b) mobile devices. The first and third frames display instructions to follow a moving dot, while the second and fourth prompt participants to look away from the screen.

Segmetry poruszającego się punktu zostały oznaczone jako uwagi, a segmenty poza ekranem jako nieuwagi, wytwarzając oznaczony zestaw danych zarówno pozytywnych, jak i negatywnych przykładów.

Każde wideo trwało około 160 sekund, z oddzielnymi wersjami utworzonymi dla platform biurowych i mobilnych, każda z rozdzielczością 1920×1080 i 608×1080, odpowiednio.

Ogółem zebrano 609 filmów, w tym 322 biurowe i 287 nagrania mobilne. Etykiety zostały zastosowane automatycznie na podstawie zawartości wideo, a zestaw danych podzielony na 158 próbek szkoleniowych i 451 testowych.

Zestawy Danych: Mówienie

W tym kontekście jednym z kryteriów definiujących ‘nieuwagę’ jest sytuacja, w której osoba mówi przez dłużej niż jedną sekundę (co może być chwilowym komentarzem lub nawet kaszlem).

Ponieważ kontrolowane środowisko nie rejestruje ani nie analizuje dźwięku, mówienie jest wnioskowane przez obserwację wewnętrznego ruchu oszacowanych punktów orientacyjnych twarzy. Dlatego też, aby wykryć mówienie bez dźwięku, autorzy stworzyli zestaw danych oparty wyłącznie na danych wizualnych, pochodzący z ich repozytorium wewnętrznego, i podzielony na dwie części: pierwsza zawierała około 5 500 filmów, każdy oznaczony ręcznie przez trzech annotatorów jako mówiący lub nie mówiący (z których 4 400 zostało wykorzystanych do szkolenia i walidacji, a 1 100 do testowania).

Druga część składała się z 16 000 sesji automatycznie oznaczonych na podstawie typu sesji: 10 500 zawierało uczestników, którzy bezgłośnie oglądali reklamy, a 5 500 pokazywało uczestników wyrażających opinie o markach.

Zestawy Danych: Ziewanie

Chociaż istnieją pewne zestawy danych ziewania, w tym YawDD i Driver Fatigue, autorzy twierdzą, że żaden z nich nie nadaje się do scenariuszy testowania reklam, ponieważ albo zawierają symulowane ziewanie, albo zawierają kontorsje twarzy, które mogą być mylone z strachem lub innymi, niezwiązanymi z ziewaniem działaniami.

Dlatego autorzy wykorzystali 735 filmów ze swojej kolekcji wewnętrznej, wybierając sesje, które prawdopodobnie zawierały upadek szczęki trwający dłużej niż jedna sekunda. Każde wideo zostało ręcznie oznaczone przez trzech annotatorów jako aktywne lub nieaktywne ziewanie. Tylko 2,6 procent klatek zawierało aktywne ziewanie, co podkreśla nierównowagę klasy, a zestaw danych został podzielony na 670 filmów szkoleniowych i 65 testowych.

Zestawy Danych: Rozpraszanie

Zestaw danych rozpraszania również pochodził z repozytorium autorów, gdzie uczestnicy oglądali rzeczywiste reklamy bez przydzielonych zadań. Ogółem 520 sesji (193 na urządzeniach mobilnych i 327 w środowiskach biurowych) zostało wybranych losowo i ręcznie oznaczonych przez trzech annotatorów jako uwagi lub nieuwagi.

Zachowania nieuwagi obejmowały spoglądanie poza ekran, mówienie, senność i nieuwagi ekranu. Sesje obejmowały różne regiony na całym świecie, z nagraniami biurowymi częstsze, ze względu na elastyczne umiejscowienie kamery.

Modele Uwagi

Proponowany model uwagi przetwarza funkcje wizualne niskiego poziomu, a mianowicie wyrażenia twarzy; położenie głowy; i kierunek wzroku – wyodrębnione za pomocą wcześniej wymienionych AFFDEX 2.0 i SmartEye SDK.

Następnie są one przekształcane w wskaźniki wysokiego poziomu, z każdym rozpraszaczem obsługiwanym przez oddzielny klasyfikator binarny, wytrenowany na własnym zestawie danych do niezależnej optymalizacji i oceny.

Schema for the proposed monitoring system.

Model wzroku określa, czy widz patrzy na ekran czy od niego, przy użyciu skorygowanych współrzędnych wzroku, z oddzielną kalibracją dla urządzeń biurowych i mobilnych. Pomaga w tym procesie liniowy Support Vector Machine (SVM), wytrenowany na cechach przestrzennych i czasowych, który obejmuje okno pamięci, aby wygładzić gwałtowne ruchy wzroku.

Aby wykryć mówienie bez dźwięku, system wykorzystał wycięte obszary ust i 3D-CNN wytrenowany na segmentach konwersacyjnych i niekonwersacyjnych. Etykiety zostały przypisane na podstawie typu sesji, z czasowym wygładzaniem, które zmniejsza fałszywe pozytywy, które mogą wynikać z krótkich ruchów ust.

Ziewanie zostało wykryte przy użyciu pełnych wycięć twarzy, aby uchwycić szersze ruchy twarzy, z 3D-CNN wytrenowanym na ręcznie oznaczonych klatkach (chociaż zadanie było skomplikowane przez niską częstotliwość ziewania w naturalnym oglądaniu i jego podobieństwo do innych wyrażeń).

Pozostawienie ekranu zostało zidentyfikowane przez brak twarzy lub ekstremalne położenie głowy, z prognozami sporządzonymi przez drzewo decyzyjne.

Ostateczny stan uwagi został określony przy użyciu ustalonej reguły: jeśli którykolwiek moduł wykrył nieuwagę, widz został oznaczony jako nieuwagi – podejście priorytetowe dla wrażliwości, dostosowane oddzielnie dla kontekstów biurowych i mobilnych.

Testy

Jak wcześniej wspomniano, testy są prowadzone metodą ablacyjną, gdzie składniki są usuwane, a efekt na wynik jest odnotowany.

Different categories of perceived inattention identified in the study.

Model wzroku identyfikował zachowania poza ekranem przez trzy kluczowe kroki: normalizację surowych szacunków wzroku, dokładne dopasowanie wyjścia i oszacowanie rozmiaru ekranu dla urządzeń biurowych.

Aby zrozumieć znaczenie każdego składnika, autorzy usunęli je indywidualnie i ocenili wyniki na 226 filmach biurowych i 225 filmach mobilnych, pochodzących z dwóch zestawów danych. Wyniki, mierzone za pomocą G-mean i F1 score, są przedstawione poniżej:

Results indicating the performance of the full gaze model, alongside versions with individual processing steps removed.

W każdym przypadku wyniki ulegały pogorszeniu, gdy usuwano krok. Normalizacja okazała się szczególnie wartościowa na biurkach, gdzie umiejscowienie kamery jest bardziej zróżnicowane niż na urządzeniach mobilnych.

Badanie oceniło również, jak cechy wizualne przewidywały orientację kamery mobilnej: położenie twarzy, położenie głowy i kierunek wzroku uzyskały wyniki 0,75, 0,74 i 0,60, podczas gdy ich połączenie osiągnęło 0,91, co, jak twierdzą autorzy, podkreśla zaletę integrowania wielu sygnałów.

Model mówienia wytrenowany na odległości warg pionowych osiągnął ROC-AUC 0,97 na ręcznie oznaczonym zestawie testowym i 0,96 na większym automatycznie oznaczonym zestawie danych, co wskazuje na spójne wyniki w obu przypadkach.

Model ziewania osiągnął wynik ROC-AUC 96,6 procent przy użyciu samej proporcji ust, co poprawiło się do 97,5 procent, gdy połączono ją z przewidywaniami jednostek działania z AFFDEX 2.0.

Model pozostawienia ekranu klasyfikował momenty jako nieuwagi, gdy zarówno AFFDEX 2.0, jak i SmartEye nie wykryły twarzy przez ponad jedną sekundę. Aby ocenić ważność tego, autorzy ręcznie oznaczyli wszystkie takie zdarzenia braku twarzy w rzeczywistym zestawie danych rozpraszających, identyfikując podstawową przyczynę każdej aktywacji. Niejasne przypadki (takie jak przeszkody kamery lub zniekształcenia wideo) zostały wykluczone z analizy.

Jak wynika z tabeli wyników poniżej, tylko 27 procent aktywacji ‘braku twarzy’ było spowodowane przez użytkowników, którzy fizycznie opuścili ekran.

Diverse obtained reasons why a face was not found, in certain instances.

Artykuł stwierdza:

‘Pomimo że nieuwagi ekranu stanowiły tylko 27% przypadków wyzwolenia sygnału braku twarzy, zostało ono aktywowane z innych powodów wskazujących na nieuwagę, takich jak uczestnicy spoglądający poza ekran z ekstremalnym kątem, wykonujący nadmierny ruch lub znacznie zasłaniający twarz przedmiotem/ręką.’

W ostatnim z ilościowych testów autorzy ocenili, jak stopniowe dodawanie różnych sygnałów rozpraszających – spoglądania poza ekran (przez wzrok i położenie głowy), senności, mówienia i pozostawienia ekranu – wpływa na ogólną wydajność ich modelu uwagi.

Testy przeprowadzono na dwóch zestawach danych: rzeczywistym zestawie danych rozpraszających i podzestawie zestawu danych wzroku. Wyniki, mierzone za pomocą G-mean i F1 score, są przedstawione poniżej:

The effect of adding diverse distraction signals to the architecture.

Z tych wyników artykuł stwierdza:

‘Z wyników można pierwsze wnioski, że integracja wszystkich sygnałów rozpraszających przyczynia się do poprawy wykrywania uwagi.

‘Po drugie, poprawa wykrywania uwagi jest spójna zarówno na urządzeniach biurowych, jak i mobilnych. Trzecie, sesje mobilne w rzeczywistym zestawie danych wykazują znaczne ruchy głowy podczas spoglądania poza ekran, co jest łatwo wykrywalne, prowadząc do lepszej wydajności na urządzeniach mobilnych w porównaniu z biurowymi. Czwarte, dodanie sygnału senności ma stosunkowo niewielką poprawę w porównaniu z innymi sygnałami, ponieważ zwykle rzadko występuje.

‘Wreszcie, sygnał pozostawienia ekranu ma stosunkowo większą poprawę na urządzeniach mobilnych w porównaniu z biurowymi, ponieważ urządzenia mobilne mogą być łatwo pozostawione bez nadzoru.’

Autorzy również porównali swój model z AFFDEX 1.0, poprzednim systemem wykorzystywanym w testowaniu reklam – i nawet bieżący model, oparty na głowie, wykrywania wzroku przewyższa AFFDEX 1.0 na obu typach urządzeń:

‘Ta poprawa jest wynikiem integracji ruchów głowy w obu kierunkach, jak i normalizacji położenia głowy, aby uwzględnić niewielkie zmiany. Wyraźne ruchy głowy w rzeczywistym zestawie danych mobilnych spowodowały, że nasz model głowy działa podobnie do AFFDEX 1.0.’

Autorzy kończą artykuł (możliwe, że dość rutynowym) testem jakościowym, przedstawionym poniżej.

Sample outputs from the attention model across desktop and mobile devices, with each row presenting examples of true and false positives for different distraction types.

Autorzy stwierdzają:

‘Wyniki wskazują, że nasz model skutecznie wykrywa różne rozpraszacze w niekontrolowanych warunkach. Niemniej jednak może on czasami generować fałszywe pozytywy w pewnych skrajnych przypadkach, takich jak gwałtowne nachylenie głowy przy zachowaniu wzroku na ekranie, niektóre zasłaniania ust lub wyjątkowo mgliste oczy lub ciemne obrazy twarzy. ‘

Wnioski

Chociaż wyniki reprezentują umiarkowany, ale znaczący postęp w porównaniu z poprzednimi pracami, głębsza wartość badania leży w spojrzeniu, które oferuje na trwałą tendencję do dostępu do wewnętrznego stanu widza. Chociaż dane zostały zebrane za zgodą, metodyka wskazuje na przyszłe ramy, które mogą sięgać poza strukturalne, badawcze środowiska marketingu.

Ten dość paranoiczny wniosek jest tylko wzmocniony przez izolowany, ograniczony i gorliwie chroniony charakter tego konkretnego obszaru badań.

* Moja konwersja cytowań wstawianych przez autorów w odniesieniu do hiperłączy.

Po raz pierwszy opublikowane w środę, 9 kwietnia 2025