Sztuczna inteligencja

Synteza obrazu ludzkiego z fal radiowych

Naukowcy z Chin opracowali metodę syntezowania niemal fotorealistycznych obrazów ludzi bez użycia kamer, wykorzystując fale radiowe i Generative Adversarial Networks (GANs). System, który opracowali, został przeszkolony na rzeczywistych obrazach wykonanych w dobrych warunkach oświetleniowych, ale jest w stanie przechwytywać stosunkowo autentyczne “zrzuty” ludzi nawet w ciemnych warunkach – i nawet przez znaczne przeszkody, które ukrywałyby ludzi przed konwencjonalnymi kamerami.

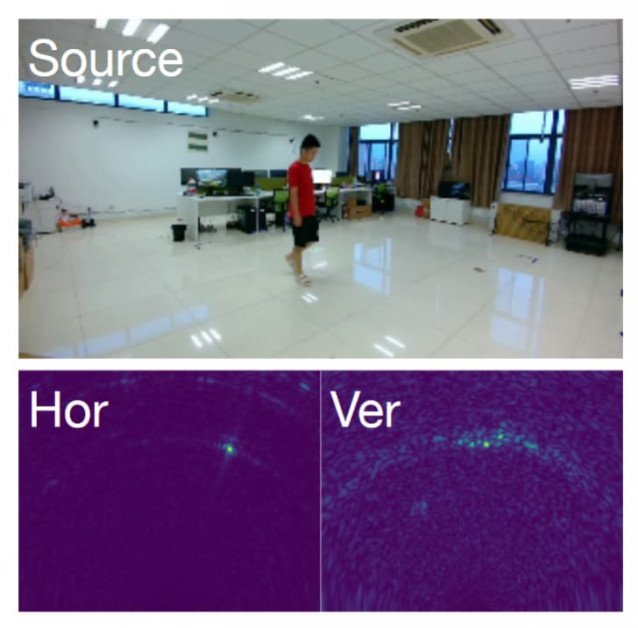

Obrazy opierają się na “mapach cieplnych” z dwóch anten radiowych, jednej rejestrującej dane z sufitu w dół, a drugiej rejestrującej perturbacje fal radiowych z “stojącej” pozycji.

Wynikające z tego zdjęcia z eksperymentów dowodowych naukowców mają bez twarzy, “J-Horror” aspekt:

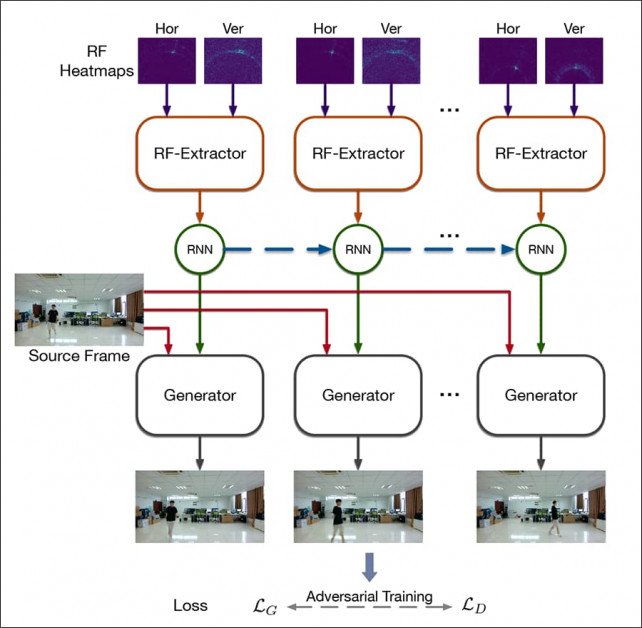

RFGAN jest szkolony na obrazach rzeczywistych ludzi w kontrolowanych środowiskach i na mapach cieplnych fal radiowych, które rejestrują aktywność ludzką. Po nauczeniu się cech z danych, RFGAN może następnie generować migawki na podstawie nowych danych RF. Wynikowy obraz jest przybliżeniem, opartym na ograniczonej rozdzielczości niskiej częstotliwości sygnałów RF. Ten proces działa nawet w ciemnych środowiskach i przez różne przeszkody. Źródło: https://arxiv.org/pdf/2112.03727.pdf

Aby przeszkolić GAN, nazwany RFGAN, naukowcy wykorzystali dopasowane dane z standardowej kamery RGB i z połączonych odpowiednich map cieplnych fal radiowych, które zostały wyprodukowane w dokładnym momencie przechwycenia. Obrazy syntetyzowanych ludzi w nowym projekcie mają tendencję do być rozmyte w sposób podobny do wczesnej fotografii Daguerreotype, ponieważ rozdzielczość wykorzystanych fal radiowych jest bardzo niska, z rozdzielczością głębi 7,5 cm i rozdzielczością kątową około 1,3 stopni.

Powyżej, obraz podawany do sieci GAN – poniżej, dwie mapy cieplne, poziome i pionowe, które charakteryzują osobę w pokoju i które są syntetyzowane wewnątrz architektury w trójwymiarową reprezentację perturbowanych danych.

Nowy artykuł, zatytułowany RFGAN: RF-Based Human Synthesis, pochodzi od sześciu naukowców z Uniwersytetu Nauk Elektronicznych i Technologii w Chinach.

Dane i Architektura

Ze względu na brak wcześniejszych zbiorów danych lub projektów o tym samym zakresie, a także fakt, że sygnały RF nie były wcześniej wykorzystywane w ramach GAN do syntezowania obrazów, naukowcy musieli opracować nowe metody.

Główna architektura RFGAN.

Normalizacja adaptacyjna została wykorzystana do interpretacji bliźniaczych obrazów map cieplnych podczas szkolenia, tak aby odpowiadały one przestrzennie z danymi obrazu.

Urządzenia do przechwytywania fal radiowych były radarami milimetrowymi (mmWave) skonfigurowanymi jako dwie macierze anten, poziome i pionowe. Wykorzystano fale o częstotliwości modulowanej ciągle (FMCW) i anteny liniowe do transmisji.

Generator otrzymuje ramkę źródłową jako warstwę wejściową, z reprezentacją RF połączoną (mapą cieplną) sterującą siecią przez normalizację na poziomie warstw konwolucyjnych.

Dane

Dane zostały zebrane z odbić sygnałów RF z anteny milimetrowej przy częstotliwości 20 Hz, z jednoczesnym nagrywaniem wideo ludzi przy bardzo niskiej częstotliwości 10 klatek na sekundę. Zarejestrowano dziewięć scen wewnętrznych, wykorzystując sześciu wolontariuszy, każdy z nich nosił różne ubrania podczas różnych sesji zbierania danych.

Wynikiem były dwa odrębne zbiory danych, RF-Activity i RF-Walk, pierwszy zawierający 68 860 obrazów ludzi w różnych pozycjach (takich jak przysiad i chód), wraz z 137 760 odpowiednimi ramkami map cieplnych; a drugi zawierający 67 860 ramki losowego chodu ludzi, wraz z 135 720 parami skojarzonych map cieplnych.

Dane, zgodnie z konwencją, zostały podzielone nierówno między szkolenie a testowanie, z 55 225 ramkami obrazu i 110 450 parami map cieplnych wykorzystanych do szkolenia, a reszta została odłożona do testowania. Ramki przechwytywania RGB zostały przeskalowane do 320×180, a mapy cieplne przeskalowane do 201×160.

Model został następnie przeszkolony z Adamem przy stałej szybkości uczenia 0,0002 zarówno dla generatora, jak i dyskryminatora, w epoce 80 i (bardzo rzadkim) rozmiarze partii 2. Szkolenie odbywało się za pomocą PyTorch na konsumenckim poziomie GPU GTX-1080, którego 8 GB pamięci VRAM byłoby ogólnie uważane za dość skromne do tego zadania (co tłumaczy niski rozmiar partii).

Chociaż naukowcy dostosowali niektóre konwencjonalne metryki do testowania realizmu danych wyjściowych (szczegółowo opisane w artykule), a przeprowadzili standardowe testy ablacjacji, nie było żadnej równoważnej pracy wcześniejszej, z którą można byłoby porównać wyniki RFGAN.

Otwarta zainteresowanie ukrytymi sygnałami

RFGAN nie jest pierwszym projektem, który próbuje wykorzystać częstotliwości radiowe do zbudowania objętościowego obrazu tego, co dzieje się w pokoju. W 2019 roku naukowcy z MIT CSAIL opracowali architekturę o nazwie RF-Avatar, zdolną do rekonstrukcji 3D ludzi na podstawie sygnałów radiowych w zakresie Wi-Fi, w warunkach ciężkich zakłóceń.

W projekcie MIT CSAIL z 2019 roku fale radiowe zostały wykorzystane do usunięcia zakłóceń, nawet w tym przypadku ścian i ubrań, w celu odtworzenia przechwyconych obiektów w bardziej tradycyjnym przepływie pracy opartym na CGI. Źródło: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Naukowcy nowego artykułu również potwierdzają luźno związaną wcześniejszą pracę wokół mapowania środowiska z falami radiowymi (żadna z nich nie próbowała odtworzyć fotorealistycznych ludzi), która miała na celu oszacowanie prędkości ludzi; zob. przez ściany z Wi-Fi; ocenić pozycje ludzi; i nawet rozpoznać gesty ludzi, wśród innych celów.

Przenoszalność i szersza stosowalność

Naukowcy następnie próbowali sprawdzić, czy ich odkrycie było przystosowane do początkowego środowiska przechwytywania i okoliczności szkolenia, chociaż artykuł oferuje niewiele szczegółów na temat tej fazy eksperymentu. Twierdzą:

‘Aby wdrożyć nasz model w nowej scenie, nie musimy ponownie szkolić całego modelu od początku. Możemy dostosować wstępnie przeszkolony model RFGAN, wykorzystując bardzo niewiele danych (ok. 40 sekund danych), aby uzyskać podobne wyniki.’

I kontynuują:

‘Funkcje strat i hiperparametry są takie same jak w fazie szkolenia. Z wyników ilościowych stwierdzamy, że wstępnie przeszkolony model RFGAN może generować pożądane ramki aktywności ludzkiej w nowej scenie po dostosowaniu z bardzo niewielką ilością danych, co oznacza, że nasz proponowany model ma potencjał do szerokiego zastosowania.’

Na podstawie szczegółów artykułu dotyczących tego przełomowego zastosowania nowej techniki, nie jest jasne, czy sieć, którą stworzyli naukowcy, jest “przeszkolona” wyłącznie do oryginalnych osób, czy też czy mapy cieplne fal radiowych mogą wywnioskować szczegóły, takie jak kolor odzieży, ponieważ to wydaje się przechodzić przez dwa różne typy częstotliwości zaangażowanych w metody przechwytywania optycznego i radiowego.

W każdym przypadku RFGAN jest nowym sposobem wykorzystania naśladujących i reprezentatywnych możliwości Generative Adversarial Networks do stworzenia nowej i interesującej formy nadzoru – jednej, która mogłaby potencjalnie działać w ciemności i przez ściany, w sposób jeszcze bardziej imponujący niż niedawne próby zobaczenia za rogi z odbitym światłem.

8 grudnia 2021 (dzień pierwszej publikacji), 20:04 GMT+2 – usunięto powtarzające się słowo. – MA