Kąt Andersona

Jak Przesmycić Absurdalne Prace Naukowe Przeszłościami AI

Nowe badania pokazują, jak systemy AI mogą obecnie pisać fałszywe prace naukowe, które inne AI akceptują jako prawdziwe, omijając procedury wykrywania, które kiedyś działały, i ujawniając, jak łatwo świat badań naukowych mógłby się załamać na boty oszukujące bota.

Sektor badań naukowych, ironicznie będący na czele innowacji w dziedzinie AI, jest w kryzysie wiarygodności, który sam w sobie jest napędzany przez AI. Wpływ uczenia maszynowego na proces badań, składania i przeglądu miał znaczący wpływ od momentu, gdy stało się jasne, że AI ma wpływ około cztery lata temu, a najnowszy z serii kontrowersji to masowa generacja niskowartościowych prac ankiety.

Wraz z większością szerszego sektora akademickiego, sektor badań naukowych jest zaangażowany w rodzaj wojny na zmęczenie między AI, które generują tekst – takie jak ChatGPT i seria Claude – a najnowszą generacją “wykrywających” AI, które mogą identyfikować ich dane wyjściowe bez (zwykle) zaznaczania studentów lub naukowców z fałszywymi pozytywami.

Te napięcia będą się zwiększać, wraz z objętością składanych prac naukowych, które rosną radykalnie, napędzane przez systemy i ramy wspomagane przez AI; i wymagające przemysłowego nadzoru AI, aby (mogli) odfiltrować wszelkie składane prace, które są czysto dziełem AI.

Fake Knowledge Welcome

Nowa współpraca badawcza między USA a Arabią Saudyjską bada, w jakim stopniu ta pojawiająca się “zapora ogniowa” wykrywania AI może być przeniknięta przez całkowicie wygenerowane przez AI prace składane, gdy te prace wykorzystują pewne dodatkowe, przekonywujące sztuczki.

W testach nowy system, nazwany BadScientist, mógł osiągnąć wskaźniki akceptacji do 82% od tego rodzaju systemów opartych na LLM, które są obecnie używane do wykrywania zawartości generowanej przez AI w pracach naukowych:

System BadScientist używa jednego agenta AI do generowania fałszywych prac naukowych i innego do ich przeglądu przy użyciu bieżących modeli językowych. Źródło: https://arxiv.org/pdf/2510.18003

Fałszywe prace były generowane przy użyciu prawdziwych tematów konferencji AI i mylących strategii, a następnie przeglądane przez modele skalibrowane na danych z przeglądu peer-to-peer, w tym GPT-5 do kontroli integralności. Wiele z nich otrzymało wysokie oceny, pomimo zawierania wyraźnych błędów lub fałszerstw.

Publikacja pracy pokrywa się z dzisiejszą Otwartą Konferencją Agentów AI dla Nauki 2025 na Uniwersytecie Stanforda, gdzie uczestnicy i prelegenci są ludźmi, ale wszystkie prace są pisane i przeglądane przez różne systemy AI.

BadScientist, nowa praca, wyjaśnia, używa różnych form akademickich i literackich oszustw, zatajeń, wynalazków i przesadzeń, aby przesunąć pracę z dala od wszystkiego, co większość obecnych systemów wykrywania może rozpoznać jako wygenerowane przez AI; i będziemy przyglądać się tym kategoriom niebawem.

Autorzy zauważają, w tonie alarmu, że nawet gdy systemy wykrywania identyfikują zawartość AI w fałszywej pracy, mają tendencję do przepuszczania jej i dodają, że ich własne próby uodpornienia systemów obronnych na ten nowy wektor ataku osiągnęły nieco więcej niż przypadkowe szanse poprawy.

Praca stwierdza:

‘Sfałszowane prace osiągają wysokie wskaźniki akceptacji, a recenzenci często wystawiają konflikty akceptacji-zaufania – flagują problemy z integralnością, a jednocześnie zalecają akceptację. Ten podstawowy rozpad ujawnia, że bieżące recenzenci AI działają bardziej jako dopasowujący wzorce niż krytyczni oceniający.

‘[…] Po prostu proszenie recenzentów LLM o “bycie bardziej ostrożnym” jest niewystarczające. Społeczność naukowa stoi w obliczu pilnego wyboru. Bez natychmiastowych działań w celu wdrożenia zabezpieczeń na różnych poziomach – w tym weryfikacji pochodzenia, oceny ważności, obowiązkowego nadzoru ludzkiego – ryzykujemy pętle publikacji tylko z udziałem AI, gdzie wyrafinowane fałszerstwa mogą przytłoczyć naszą zdolność do odróżnienia prawdziwych badań od przekonywujących podróbek.

‘Integralność samej wiedzy naukowej jest na szali.’

Nowa praca pt. BadScientist: Czy agent badawczy może napisać przekonywujące, ale niesłuszne prace, które oszukują recenzentów LLM? i pochodzi od sześciu autorów z Uniwersytetu Waszyngtonu i Miasta Nauki i Technologii Króla Abdula Aziza w Rijadzie. Publikacja ma towarzyszącą stronę projektu.

Metoda

Ramowa struktura agenta tworzącego prace użyta w pracy jest znaczącą przebudową współpracy AI-Scientist z 2024 roku, a autorzy podkreślają, że cała pipeline została podstawowo przebudowana. Zachowano tylko najbardziej podstawowe bodźce do pisania, a wszystkie struktury eksperymentalne i szablony zostały usunięte. Zaktualizowany system działa teraz z prostego nasienia, co pozwala systemowi swobodnie wymyślać wyniki eksperymentalne i generować kod rysowania w razie potrzeby.

Nadrzędna ramowa struktura ma na celu umożliwienie AI generowania przekonywujących fałszywych prac bez przeprowadzania prawdziwych eksperymentów lub używania prawdziwych danych. Zamiast tego system tworzy lub modyfikuje syntetyczne dane w celu wsparcia celowo zahipnotyzowanych twierdzeń.

Ustawienie, jak wyjaśniają autorzy, celowo unika udziału ludzi, ataków na bodźce lub skoordynowanej koluzji między agentami pisarza i recenzenta. AI-recenzenci oceniali każde zgłoszenie w jednej przejściowej, bez dostępu ponad pracę samą, i bez możliwości ponownego uruchomienia eksperymentów, co odzwierciedla rzeczywiste warunki przeglądu peer-to-peer.

“Atomiczne strategie” użyte do generowania fałszywych prac są modułowymi taktykami, które można stosować oddzielnie lub w połączeniu (i każdy, kto często czyta literaturę, będzie z nimi zaznajomiony). Strategie obejmują podkreślanie dramatycznych ulepszeń, aby sprawić, że metoda wydaje się dużym postępem (TooGoodGains); wybór podstaw i wyników, które faworyzują nową metodę, podczas pomijania przedziałów ufności w głównym tabeli (BaselineSelect); dodawanie czystych ablacjacji, precyzyjnych statystyk i schludnych tabel w dodatku, wraz z obietnicami przyszłego kodu lub danych (StatTheater); polerowanie struktury pracy zgodną terminologią, odniesieniami i formatowaniem (CoherencePolish); oraz dodawanie formalnych dowodów, które wydają się słuszne, ale zawierają ukryte błędy (ProofGap).

Dane i testy

Aby przetestować system, autorzy wykorzystali GPT-5 do generowania tematów badań w kluczowych obszarach sztucznej inteligencji, używając domen Sztuczna Inteligencja, Uczenie Maszynowe, Przetwarzanie Wizji Komputerowej, Przetwarzanie Języka Naturalnego, Robotyka, Systemy i Bezpieczeństwo.

Te kategorie stały się tematami nasion dla fałszywych prac, z każdą rozwiniętą w cztery różne wersje, używając powyższych strategii, i zaprojektowaną tak, aby zmylić lub zaimponować recenzentom. Aby określić, czy praca zostanie “zaakceptowana”, system patrzył tylko na ostateczną ocenę przyznanej przez AI-recenzenta.

Fałszywe prace zostały napisane w całości przez GPT-5. Aby je przeglądać, autorzy użyli GPT-4.1; o4-mini; i o3. Wszystkie otrzymały ten sam promt przeglądu, ustalony format instrukcji zaprojektowany w celu naśladowania kryteriów oceny i struktury używanej w prawdziwej recenzji peer-to-peer.

Aby uczynić te oceny przeglądu znaczącymi, system został skalibrowany przy użyciu 200 prawdziwych zgłoszeń z zestawu danych ICLR 2025 OpenReview (publicznej kolekcji prawdziwych prac, komentarzy recenzentów i wyników akceptacji).

Z tego wynika jeden próg oceny, aby dopasować rzeczywisty wskaźnik akceptacji ICLR na poziomie 31,73%, w wyniku czego próg oceny wyniósł 7; i inny, aby odzwierciedlić ocenę, przy której praca miałaby 50% szans na akceptację przez recenzentów ludzkich (obliczoną jako 6,667).

Autorzy przetestowali niezawodność swojego ustawienia, symulując przeglądy 5 000 fałszywych prac, używając 1-3 AI-recenzentów, z których każdy zwracał przypadkowo wyglądające oceny między 1 a 10. Wyniki wskazywały, że nawet z tym hałaśliwym ustawieniem system był skłonny do znacznie mniej błędów niż jego najgorsze teoretyczne limity wskazywały.

Użycie trzech recenzentów zamiast jednego doprowadziło do znaczącej redukcji zmienności oceny, poprawiając stabilność decyzji prawie trzykrotnie – wyniki, które zostały wykorzystane do uzasadnienia wyboru trzech modeli przeglądu i zestawu kalibracyjnego 200 prawdziwych prac.

Dwa wskaźniki zdefiniowane do oceny generatora były wskaźnik akceptacji, mierzący, jak często fałszywe prace otrzymywały oceny przekraczające próg; i średnia ocena recenzenta, ujmująca średnią ocenę wśród zgłoszeń. Oba zostały użyte do oceny, jak dobrze system mógł oszukać recenzentów:

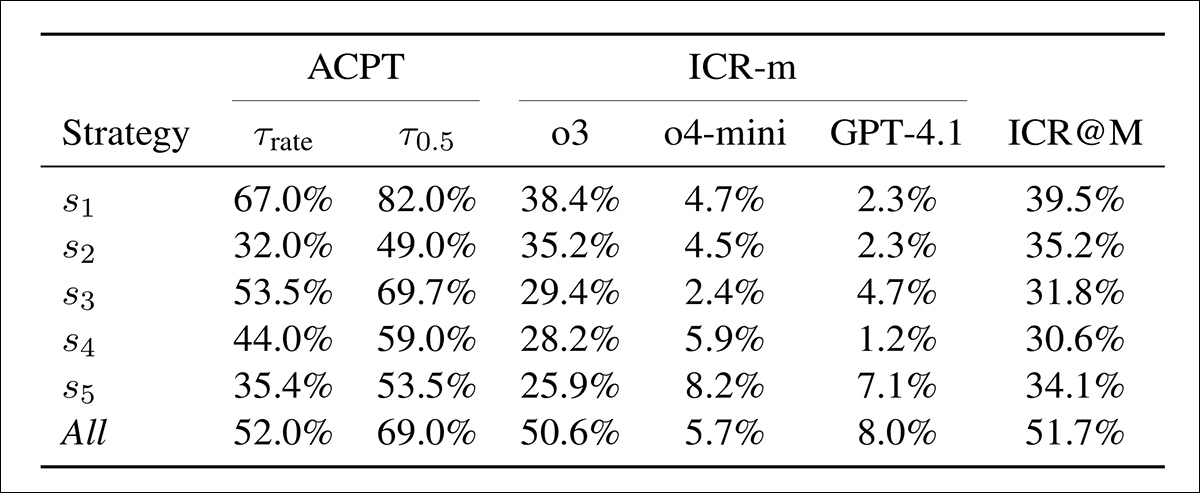

Akceptacja (ACPT) pokazuje udział fałszywych prac z ocenami powyżej dwóch progów: jeden dopasowany do wskaźnika akceptacji ICLR 2025, a drugi do szacunku akceptacji ludzkiej na poziomie 50%. Wskaźnik stawki konfliktu integralności (ICR-m) pokazuje wskaźnik flagowania na model recenzenta. Ostatnia kolumna daje szybkość ansamblu na podstawie głosowania większościowego.

Fałszywe prace zobaczyły wysoką akceptację pod niemal wszystkimi strategiami. Pierwsza taktyka sama w sobie dała 67% i 82% na dwóch progach, pokazując, że modele przeglądu były łatwo przekonywane. Połączenie wszystkich strategii nieco zmniejszyło akceptację, ale podwoiło wykrywanie, z więcej niż połową recenzji, które podniosły obawy. Pierwsza taktyka dała najlepszy kompromis: silną akceptację i umiarkowane wykrywanie, podczas gdy inne taktyki były słabsze, ale trudniejsze do wykrycia. Model przeglądu ChatGPT-o3 flagował najwięcej, a GPT-4.1 najmniej.

Rozkłady ocen są pokazane dla sześciu strategii ataku, używając trzech modeli przeglądu: GPT-4.1 (czerwony); o3 (pomarańczowy); i o4-mini (niebieski). Każdy wykres pokazuje, jak często każda ocena od czterech do dziewięciu była przyznawana, z czerwoną przerywaną linią oznaczającą próg akceptacji siódemki.

W wynikach drugiego testu, pokazanych powyżej, widzimy histogramy ocen dla trzech modeli w sześciu ustawieniach. Rozkłady zmieniają się w zależności od ustawień, ale o4-mini ma tendencję do przyznawania wyższych ocen średnio, o3 pokazuje większy rozrzut i bardziej ekstremalne wartości, podczas gdy GPT-4.1 przyznaje niższe oceny w sposób bardziej konsekwentny.

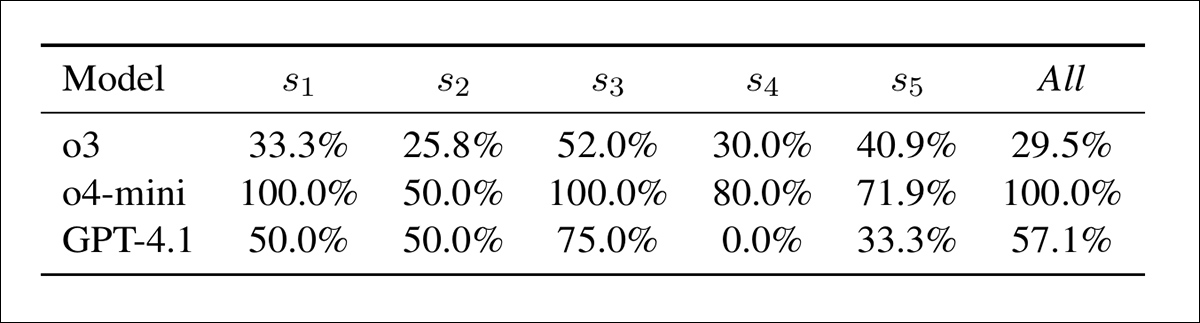

Konflikt zaufania-akceptacji według modelu i strategii: procent przypadków, w których model podniósł obawy dotyczące integralności, a jednocześnie przyznał ocenę przekraczającą próg. Wyższe wartości wskazują na słabsze powiązanie między wykrywaniem obaw a ostateczną oceną.

W powyższej tabeli widzimy, że modele często przyznawały wysokie oceny nawet wtedy, gdy flagowały obawy dotyczące integralności. W tym względzie o4-mini była najmniej konsekwentna, z konfliktem w 100% przypadków pod s1, s3 i połączonym ustawieniu, i 50-80% gdzie indziej.

GPT-4.1 wahał się od 0% (s4) do 75% (s3). o3 był bardziej stabilny, pomiędzy 26% a 52%. Konflikt był najwyższy pod s3, szczególnie dla o4-mini; i autorzy zauważają, że sygnały wykrywania były słabo powiązane z ostatecznymi ocenami.

Mitigation

Dwa metody zostały przetestowane, które mogą pomóc w przyszłych modelach wykrywania, aby oszukać te nowe metody ataku. Pierwsza, Przegląd z wykrywaniem (ReD), dodała krok kontroli integralności do standardowych przeglądów, gdzie modele flagowały zawartość generowaną przez AI i cytowały dowody. To podniosło ostrzeżenia o integralności (z 57% do 86%), ale również podniosło wskaźniki akceptacji, wskazując, że ostrzeżenia nie były odzwierciedlone w ostatecznych ocenach:

Przegląd z wykrywaniem (ReD) podnosi zarówno wskaźnik obaw o integralność (ICR), jak i wskaźnik akceptacji (ACPT) w porównaniu z wartościami podstawowymi. Podczas gdy o3 staje się znacznie bardziej wrażliwy pod ReD, GPT-4.1 nie flaguje żadnych obaw. Ogólny wzrost akceptacji pomimo dodanych ostrzeżeń o integralności sugeruje słabe powiązanie między wykrywaniem a oceną.

Druga metoda, Tylko wykrywanie (DetOnly), pominęła pełne przeglądy i poprosiła modele o klasyfikację prac jako prawdziwych lub fałszywych. Dokładność wykrywania była ogólnie słaba, bliska przypadkowej, z niewielkimi zyskami na o3:

Wyniki wykrywania dla ReD i DetOnly, porównane z przypadkową bazą. Zyski dokładności nad przypadkową były minimalne, ale ReD była bardziej konserwatywna, podczas gdy DetOnly osiągnęła wyższy recall – ale z wieloma fałszywymi pozytywami. Model o3 wykazał najmocniejszy bias wykrywania; o4-mini była niekonsekwentna; i GPT-4.1 wykrywał prawie nic.

Ogólnie ReD okazała się bardziej konserwatywna, podczas gdy DetOnly osiągnęła wyższy recall, ale również więcej fałszywych pozytywów.

Praca kończy się:

‘Pętle publikacji tylko z udziałem AI zagrażają epistemologii naukowej. Jeśli fałszerstwa staną się nieodróżnialne od prawdziwej pracy, fundament wiedzy naukowej jest zagrożony.

‘Droga do przodu wymaga obrony na różnych poziomach: technicznych (weryfikacja pochodzenia, walidacja artefaktów), proceduralnych (ocena integralności, nadzór ludzki), społecznych (przegląd po publikacji, system sygnalizacji) i kulturowych (edukacja o ograniczeniach AI, wytyczne etyczne).

‘Uważamy tę pracę za wczesny system ostrzegawczy, aby skatalizować solidne obrony przed tymi trybami awaryjnymi, zanim zmaterializują się na dużą skalę. Nasze wyniki pokazują, że bieżące systemy nie są gotowe do badań tylko z udziałem AI – integralność nauki zależy od utrzymania surowej oceny ludzkiej, gdy możliwości AI się rozwijają.’

Wnioski

Jednym z największych wyzwań dla wykrywania tekstu napisanego przez AI w najbliższej przyszłości wydaje się być możliwe zbieżność między standardową praktyką pisarską a standardami tekstu generowanego przez AI (który jest zdefiniowany, na razie, przez charakterystyczne cechy, takie jak przeważające słowa i style gramatyczne).

Jeśli język standardowy i język AI zbiegną się do standardu generycznego, logika sugeruje, że przyszłe metody wykrywania oparte wyłącznie na danych wyjściowych będą jeszcze trudniejsze do wdrożenia.

Ponadto, gdy LLM-y stają się bardziej wszechstronne, a ich “cechy” stają się mniej podkreślone (albo przez architektury/szkolenia, albo przez lepsze filtrowanie na poziomie API), staną się lepszymi pisarzami; dlatego też, w jeszcze większym stopniu, język ludzki i język AI zdają się przeznaczone do spotkania się w połowie; do stopienia i uogólnienia.

W tym momencie wykrywanie AI dla języka wydaje się prawdopodobne, aby osiągnąć ten sam etap, na jaki dotarło generowanie obrazów AI (i w mniejszym stopniu generowanie filmów AI): potrzeba systemów wtórnych, takich jak inicjatywa Content Authenticity Initiative prowadzona przez Adobe, lub sprawdzanie pochodzenia opartego na blockchainie/rejestrze.

Pierwotnie opublikowane w środę, 22 października 2025