Sztuczna inteligencja

Lepsza wydajność uczenia maszynowego dzięki CNN-bazowemu zmniejszaniu rozmiaru obrazu

Google Research zaproponował nową metodę poprawy wydajności i dokładności szkoleń komputerowego widzenia opartych na obrazach, poprzez udoskonalenie sposobu, w jaki obrazy w zbiorze danych są zmniejszane na etapie przetwarzania wstępnego.

W artykule Nauka zmniejszania rozmiaru obrazów do zadań komputerowego widzenia, badacze Hossein Talebi i Peyman Milanfar wykorzystują CNN do stworzenia nowej hybrydowej architektury zmniejszania rozmiaru obrazu, która daje znaczną poprawę wyników rozpoznawania w czterech popularnych zbiorach danych komputerowego widzenia.

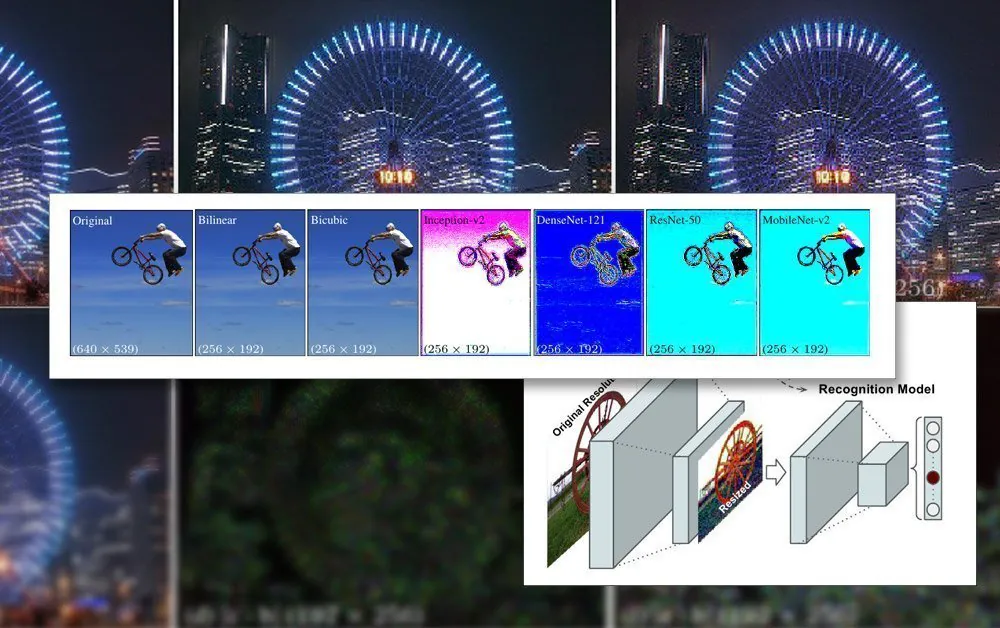

Zaproponowana wspólna struktura dla rozpoznawania i zmniejszania rozmiaru. Źródło: https://arxiv.org/pdf/2103.09950.pdf

Artykuł zauważa, że metody zmniejszania rozmiaru, które są obecnie używane w zautomatyzowanych potokach uczenia maszynowego, są przestarzałe i często wykorzystują tylko podstawowe metody interpolacji liniowej, bikubicznej i najbliższego sąsiada zmniejszania rozmiaru – metody, które traktują wszystkie piksele bez rozróżnienia.

W przeciwieństwie do tego, proponowana metoda uzupełnia dane obrazu za pomocą CNN i włącza ten wprowadzany sygnał do zmniejszonych obrazów, które ostatecznie przejdą przez architekturę modelu.

Ograniczenia obrazów w szkoleniu AI

Aby przeszkolić model, który zajmuje się obrazami, ramy szkolenia maszynowego będą zawierać etap przetwarzania wstępnego, na którym różnorodne obrazy o różnych rozmiarach, przestrzeniach kolorów i rozdzielczościach (które przyczynią się do zbioru danych szkoleniowych) są systematycznie obcinane i zmniejszane do spójnych wymiarów i stabilnego, jednego formatu.

Zwykle będzie to wymagało pewnego kompromisu wokół formatu PNG, gdzie zostanie ustalony kompromis między czasem przetwarzania/zasobami, rozmiarem pliku a jakością obrazu.

W większości przypadków ostateczne wymiary przetworzonego obrazu są bardzo małe. Poniżej widzimy przykład rozdzielczości 80×80, w której wygenerowano niektóre z najwcześniejszych zbiorów danych deepfakes ::

Ponieważ twarze (i inne możliwe obiekty) rzadko mieszczą się w wymaganej proporcji, mogą być potrzebne paski czarne (lub dozwolone marnowanie miejsca), aby ujednolicić obrazy, co jeszcze bardziej zmniejsza rzeczywiste dane obrazu:

Tutaj twarz została wyodrębniona z większego obszaru obrazu, aż została obcięta w sposób najbardziej ekonomiczny, aby zawrzeć cały obszar twarzy. Jednak, jak widać po prawej, znaczna część pozostałego obszaru nie zostanie wykorzystana podczas szkolenia, co dodaje wagę do znaczenia jakości danych obrazu.

Ponieważ możliwości GPU uległy poprawie w ostatnich latach, nowe generacje kart NVIDIA wyposażone w zwiększoną ilość pamięci wideo (VRAM), średnie rozmiary obrazów zaczynają wzrastać, choć 224×224 pikseli nadal jest dość standardowy (na przykład, jest to rozmiar ResNet-50).

Niezmieniony obraz o rozdzielczości 224×244 pikseli.

Dopasowanie partii do VRAM

Powodem, dla którego obrazy muszą mieć ten sam rozmiar, jest to, że gradient descendant, metoda, przez którą model ulega poprawie w czasie, wymaga jednolitych danych szkoleniowych.

Powodem, dla którego obrazy muszą być tak małe, jest to, że muszą być załadowane (w pełni rozpakowane) do VRAM podczas szkolenia w małych partiach, zwykle między 6-24 obrazami na partię. Za mało obrazów na partię, i nie ma wystarczającej ilości materiału grupowego, aby dobrze uogólnić, a także wydłuża czas szkolenia; za dużo, i model może nie uzyskać niezbędnych cech i szczegółów (patrz poniżej).

Ta “na żywo” sekcja architektury szkoleniowej nazywa się przestrzenią latentną. To tutaj cechy są wielokrotnie wyodrębniane z tych samych danych (tj. tych samych obrazów), aż model osiągnie stan, w którym posiada wszystkie ogólne wiadomości, których potrzebuje do wykonania transformacji na późniejszych, niewidzianych danych tego samego typu.

Ten proces zwykle trwa dni, choć może trwać nawet miesiąc lub więcej ciągłego i nieprzerwanego, wysokiego poziomu przetwarzania, aby osiągnąć użyteczne uogólnienie. Zwiększenia rozmiaru VRAM są tylko pomocne do pewnego punktu, ponieważ nawet niewielkie przyrosty rozdzielczości obrazu mogą mieć efekt rzędu wielkości na pojemność przetwarzania, i związane z tym efekty na dokładność, które mogą nie zawsze być korzystne.

Używanie większej pojemności VRAM, aby pomieścić większe partie, jest również mieszanką błogosławieństwa, ponieważ większe prędkości szkolenia uzyskane przez to są prawdopodobnie równoważone przez mniej precyzyjne wyniki.

Dlatego, ponieważ architektura szkoleniowa jest tak ograniczona, wszystko, co może wpłynąć na poprawę w ramach istniejących ograniczeń potoku, jest godnym uwagi osiągnięciem.

Jak lepsze zmniejszanie rozmiaru pomaga

Ostateczna jakość obrazu, który zostanie uwzględniony w zbiorze danych szkoleniowych, została udowodniona, aby miała korzystny wpływ na wynik szkolenia, szczególnie w zadaniach rozpoznawania obiektów. W 2018 roku badacze z Max Planck Institute for Intelligent Systems utworzyli tezę, że wybór metody przeszukiwania znacząco wpływa na wyniki szkolenia i rezultaty.

Dodatkowo, wcześniejsza praca Google (współautorem której są autorzy nowego artykułu) wykazała, że dokładność klasyfikacji może być poprawiona przez utrzymanie kontroli nad artefaktami kompresji w obrazach zbioru danych.

Model CNN zbudowany w nowym próbce łączy zmniejszanie rozmiaru liniowego z funkcją “skip connection”, która może włączyć dane wyjściowe z przeszkolonej sieci do zmniejszonego obrazu.

W przeciwieństwie do typowej architektury encoder/decoder, nowa propozycja może działać nie tylko jako feed-forward bottleneck, ale także jako odwrotny bottleneck do skalowania do dowolnego rozmiaru docelowego i/lub proporcji. Dodatkowo, “standardową” metodę przeszukiwania można zastąpić dowolną inną odpowiednią tradycyjną metodą, taką jak Lanczos.

Szczegóły wysokiej częstotliwości

Nowa metoda produkuje obrazy, które w efekcie wydają się “wypiekać” kluczowe cechy (które ostatecznie zostaną rozpoznane przez proces szkolenia) bezpośrednio w źródłowym obrazie. W estetycznych terminach, wyniki są niekonwencjonalne:

Nowa metoda zastosowana w czterech sieciach – Inception V2; DenseNet-121; ResNet-50; i MobileNet-V2. Wyniki metody zmniejszania rozmiaru obrazu Google Research produkują obrazy z oczywistą agregacją pikseli, przewidując kluczowe cechy, które zostaną rozpoznane podczas procesu szkolenia.

Badacze zauważają, że te wstępne eksperymenty są wyłącznie zoptymalizowane dla zadań rozpoznawania obrazów i że w testach ich CNN-wydany “learned resizer” był w stanie osiągnąć poprawione stawki błędów w takich zadaniach. Badacze zamierzają w przyszłości zastosować tę metodę do innych typów aplikacji komputerowego widzenia opartych na obrazach.