Sztuczna inteligencja

Kartel wpływowych zbiorów danych dominuje w badaniach nad sztuczną inteligencją, sugeruje nowe badanie

Nowy artykuł z Uniwersytetu Kalifornijskiego i Google Research wykazał, że niewielka liczba “punktów odniesienia” zbiorów danych sztucznej inteligencji, w większości pochodzących z wpływowych instytucji zachodnich, a często z organizacji rządowych, coraz bardziej dominuje w sektorze badań nad sztuczną inteligencją.

Badacze dochodzą do wniosku, że ta tendencja do “domyślnego” użycia bardzo popularnych, otwartoźródłowych zbiorów danych, takich jak ImageNet, rodzi szereg praktycznych, etycznych i nawet politycznych powodów do niepokoju.

Wśród ich odkryć – opartych na danych podstawowych z projektu społecznościowego Papers With Code (PWC) – autorzy twierdzą, że “powszechnie używane zbiory danych są wprowadzane tylko przez garstkę elitarnych instytucji”, i że ta “konsolidacja” wzrosła do 80% w ostatnich latach.

‘[My] stwierdzamy, że występuje coraz większa nierówność w użyciu zbiorów danych na całym świecie, i że ponad 50% wszystkich użycia zbiorów danych w naszym próbie 43 140 odpowiada zbiorom danych wprowadzonym przez dwanaście elitarnych, głównie zachodnich instytucji.’

Mapa użycia zbiorów danych niespecyficznych dla zadania w ciągu ostatnich dziesięciu lat. Kryterium dołączenia jest to, gdzie instytucja lub firma stanowi ponad 50% znanych użycia. Po prawej stronie widoczny jest współczynnik Gini dla koncentracji zbiorów danych w czasie dla instytucji i zbiorów danych. Źródło: https://arxiv.org/pdf/2112.01716.pdf

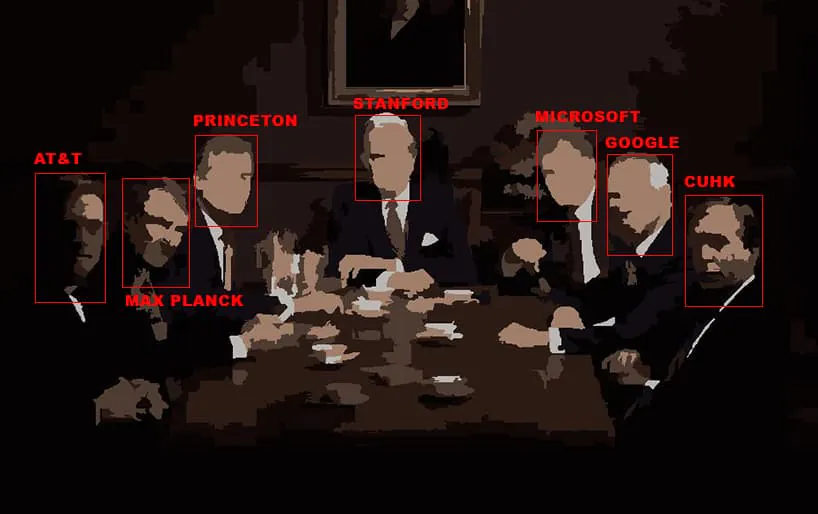

Dominujące instytucje obejmują Uniwersytet Stanforda, Microsoft, Princeton, Facebook, Google, Instytut Maxa Plancka i AT&T. Cztery z dziesięciu najlepszych źródeł zbiorów danych to instytucje korporacyjne.

Artykuł charakteryzuje również rosnące użycie tych elitarnych zbiorów danych jako ‘pojazd nierówności w nauce’. Jest to spowodowane tym, że zespoły badawcze poszukujące społecznej akceptacji są bardziej zmotywowane do osiągnięcia wyników na poziomie stanu sztuki (SOTA) w odniesieniu do spójnego zbioru danych niż do generowania oryginalnych zbiorów danych, które nie mają takiego samego statusu i wymagają, aby ich koledzy dostosowali się do nowych miar zamiast standardowych wskaźników.

W każdym razie, jak przyznaje artykuł, tworzenie własnego zbioru danych jest zbyt kosztownym przedsięwzięciem dla mniej zasobnych instytucji i zespołów.

‘Prima facie naukowa ważność przyznana przez SOTA benchmarking jest ogólnie sprzeczna z wiarygodnością społeczną, którą badacze uzyskują, pokazując, że mogą konkurować na powszechnie rozpoznawanym zbiorze danych, nawet jeśli bardziej kontekstowy benchmark może być bardziej technicznie odpowiedni.

‘Uważamy, że te dynamiki tworzą “Efekt Mateusza” (tj. “bogaci stają się bogatsi, a biedni – biedniejsi”), gdzie udane benchmarki i elitarnych instytucji, które je wprowadzają, zyskują niewspółmiernie dużą pozycję w dziedzinie.

Artykuł artykuł nosi tytuł Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research, i pochodzi od Bernarda Kocha i Jacoba G. Fostera z UCLA, oraz Emily Denton i Alex Hannę z Google Research.

Praca podnosi szereg kwestii związanych z rosnącym trendem konsolidacji, który dokumentuje, i spotkała się z powszechną aprobatą w Open Review. Jeden z recenzentów z NeurIPS 2021 skomentował, że praca jest ‘bardzo istotna dla każdego, kto jest zaangażowany w badania nad sztuczną inteligencją.’ i przewiduje jej włączenie jako obowiązkowe czytanie na uniwersyteckich kursach.

Od konieczności do korupcji

Autorzy zauważają, że obecna kultura “pobij-benchmark” powstała jako lekarstwo na brak obiektywnych narzędzi oceny, które spowodowały, że zainteresowanie i inwestycje w sztuczną inteligencję załamały się po raz drugi ponad trzydzieści lat temu, po spadku entuzjazmu biznesu wobec nowych badań w “systemach ekspertowych”:

‘Benchmarki zwykle formalizują określone zadanie za pomocą zbioru danych i skojarzonej ilościowej miary oceny. Praktyka ta została pierwotnie wprowadzona do badań nad sztuczną inteligencją po “zimie sztucznej inteligencji” w latach 80. przez rządowych fundatorów, którzy starali się dokładniej ocenić wartość otrzymaną na granty.’

Artykuł twierdzi, że początkowe zalety tej nieformalnej kultury standaryzacji (zmniejszanie barier dla udziału, spójne miary i więcej możliwości rozwoju) zaczynają być przeważane przez wady, które naturalnie występują, gdy ciało danych staje się wystarczająco potężne, aby skutecznie definiować swoje “warunki użytkowania” i zakres wpływu.

Autorzy sugerują, w zgodzie z wieloma ostatnimi myślami przemysłowymi i akademickimi na ten temat, że społeczność badawcza nie stawia już nowych problemów, jeśli nie mogą one być rozwiązane za pomocą istniejących benchmarków zbiorów danych.

Dodatkowo zauważają, że ślepe przestrzeganie tego niewielkiego liczby “złotych” zbiorów danych zachęca badaczy do osiągania wyników, które są przeuczone (tj. które są specyficzne dla zbioru danych i nie mają szans na osiągnięcie podobnych wyników w danych rzeczywistych, nowych akademickich lub oryginalnych zbiorach danych, lub nawet koniecznie na innych zbiorach danych w “złotym standardzie”).

‘Uwzględniając obserwowaną wysoką koncentrację badań nad niewielką liczbą benchmarków zbiorów danych, uważamy, że różnicowanie form oceny jest szczególnie ważne, aby uniknąć przeuczenia istniejących zbiorów danych i nieprawidłowego przedstawiania postępów w dziedzinie.’

Wpływ rządu w badaniach nad widzeniem komputerowym

Zgodnie z artykułem, badania nad widzeniem komputerowym są szczególnie bardziej dotknięte zespołem, który opisują, a autorzy zauważają, że badania nad przetwarzaniem języka naturalnego (NLP) są o wiele mniej dotknięte. Autorzy sugerują, że może to być spowodowane tym, że społeczności NLP są ‘bardziej spójne’ i większe, oraz że zbiory danych NLP są bardziej dostępne i łatwiejsze do opracowania, a także mniejsze i mniej wymagające pod względem zbierania danych.

W badaniach nad widzeniem komputerowym, a w szczególności w odniesieniu do zbiorów danych rozpoznawania twarzy (FR), autorzy twierdzą, że korporacyjne, państwowe i prywatne interesy często kolidują:

‘Korporacyjne i rządowe instytucje mają cele, które mogą być sprzeczne z prywatnością (np. nadzorem), a ich ważenie tych priorytetów jest prawdopodobnie inne niż te, które są utrzymywane przez akademików lub szerszych interesariuszy sztucznej inteligencji.’

Dla zadań rozpoznawania twarzy badacze stwierdzili, że incydent czysto akademickich zbiorów danych spada dramatycznie w porównaniu ze średnią:

‘[Cztery] z ośmiu zbiorów danych (33,69% wszystkich użycia) były wyłącznie finansowane przez korporacje, wojsko USA lub rząd chiński (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M został ostatecznie wycofany z powodu kontrowersji wokół wartości prywatności dla różnych interesariuszy.’

Najlepsze zbiory danych używane w społecznościach badawczych generowania obrazów i rozpoznawania twarzy.

Na powyższym wykresie, jak zauważają autorzy, widzimy również, że stosunkowo nowa dziedzina generowania obrazów (lub syntezy obrazu) jest silnie uzależniona od istniejących, o wiele starszych zbiorów danych, które nie zostały pierwotnie zaprojektowane do tego celu.

W rzeczywistości artykuł obserwuje rosnący trend “migracji” zbiorów danych poza ich pierwotnym celem, co podnosi pytania o ich przydatność do potrzeb nowych lub peryferyjnych sektorów badawczych, oraz o stopień, w jakim ograniczenia budżetowe mogą “uogólniać” zakres ambicji badaczy w węższy zakres zapewniony przez dostępne materiały i kulturę tak obsesyjnie skupioną na rocznych ocenach benchmarków, że nowe zbiory danych mają trudności z uzyskaniem przyczółka.

‘Nasze wyniki wskazują również, że zbiory danych regularnie przenoszą się między różnymi społecznościami zadań. Na najbardziej ekstremalnym końcu, większość benchmarków zbiorów danych w obiegu dla niektórych społeczności zadań została stworzona dla innych zadań.’

W odniesieniu do luminarzy sztucznej inteligencji (w tym Andrew Ng), którzy coraz częściej domagają się większej różnorodności i opracowania zbiorów danych w ostatnich latach, autorzy popierają ten pogląd, ale uważają, że taki wysiłek, nawet jeśli byłby udany, mógłby potencjalnie zostać podważony przez obecnie panującą kulturę zależności od wyników SOTA i ustanowionych zbiorów danych:

‘Nasze badania sugerują, że proste wezwanie badaczy sztucznej inteligencji do opracowania większej liczby zbiorów danych i przesunięcie struktur zachęt, aby rozwój zbioru danych był ceniony i nagradzany, może nie być wystarczające do zróżnicowania użycia zbiorów danych i perspektyw, które ostatecznie kształtują i ustalają agendy badań nad sztuczną inteligencją.

‘Oprócz zachęcania do rozwoju zbiorów danych, opowiadamy się za interwencjami politycznymi ukierunkowanymi na równość, które priorytetowo traktują znaczne finansowanie dla osób z mniej zasobnych instytucji w celu tworzenia wysokiej jakości zbiorów danych. To zróżnicuje – z perspektywy społecznej i kulturowej – benchmarki zbiorów danych używanych do oceny nowoczesnych metod sztucznej inteligencji.’

6 grudnia 2021, 16:49 – Poprawiono posiadanie w nagłówku. – MA