Kunstig intelligens

Hvorfor kan ikke generative videosystemer lage komplette filmer?

Fremkomsten og fremgangen av generativ AI-video har ført til at mange tilfeldige observatører har spådd at maskinlæring vil vise seg å være døden for filmindustrien som vi kjenner den – i stedet vil enkelt skapere kunne lage Hollywood-stil filmer hjemme, enten på lokale eller skybaserte GPU-systemer.

Er dette mulig? Selv om det er mulig, er det forestående, som så mange tror?

At enkelt personer til slutt vil kunne lage filmer, i den formen vi kjenner dem, med konsistente karakterer, narrative kontinuitet og total fotorealisme, er ganske mulig – og kanskje sogar uunngåelig.

Men det er flere fundamentale grunner til at dette ikke er sannsynlig å skje med videosystemer basert på Latent Diffusion Models.

Dette siste faktum er viktig fordi, på dette tidspunktet, denne kategorien inkluderer hver populær tekst-til-video (T2) og bilde-til-video (I2V) system tilgjengelig, inkludert Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (og, så langt vi kan se, Adobe Fireflys forestående videofunksjonalitet); blant mange andre.

Her vurderer vi prospektet av sanne auteur full-lengde gen-AI-produksjoner, skapt av enkelt personer, med konsistente karakterer, cinematografi og visuelle effekter på minst like høy nivå som den nåværende tilstanden i Hollywood.

La oss se på noen av de største praktiske hindringene for utfordringene involvert.

1: Du kan ikke få en nøyaktig oppfølgende skudd

Narrative inkonsistens er den største av disse hindringene. Faktum er at ingen nåværende video-genereringssystem kan lage et virkelig nøyaktig ‘oppfølgende skudd’.

Dette skyldes at denoising diffusion model i hjertet av disse systemene avhenger av tilfeldig støy, og denne grunnleggende prinsippet er ikke åpne for å tolke nøyaktig samme innhold to ganger (dvs. fra forskjellige vinkler, eller ved å utvikle det foregående skuddet til et oppfølgende skudd som opprettholder konsistens med det foregående skuddet).

Hvor tekstpromter brukes, alene eller sammen med lastet opp ‘seed’-bilder (multimodal innputt), vil tokene som er avledet fra prompten fremkalle semantisk passende innhold fra den trente latente rom i modellen.

Men, ytterligere hemmet av ’tilfeldig støy’-faktoren, vil den aldri gjøre det samme måten to ganger.

Dette betyr at identitetene til personer i videoen vil tendere til å skifte, og objekter og miljøer vil ikke matche det innledende skuddet.

Dette er hvorfor virale klipp som viser ekstraordinære visuelle effekter og Hollywood-nivå utgang tenderer til å være enten enkelt skudd, eller en ‘showcase-montasje’ av systemets muligheter, hvor hvert skudd viser forskjellige karakterer og miljøer.

Utdrag fra en generativ AI-montasje fra Marco van Hylckama Vlieg – kilde: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Implikasjonen i disse samlingene av ad hoc video-genereringer (som kan være uærlig i tilfelle av kommersielle systemer) er at det underliggende systemet kan lage sammenhengende og konsistente narrativer.

Analogen som utnyttes her er en film-trailer, som bare viser en eller to minutter med filmklipp, men gir publikum grunn til å tro at hele filmen eksisterer.

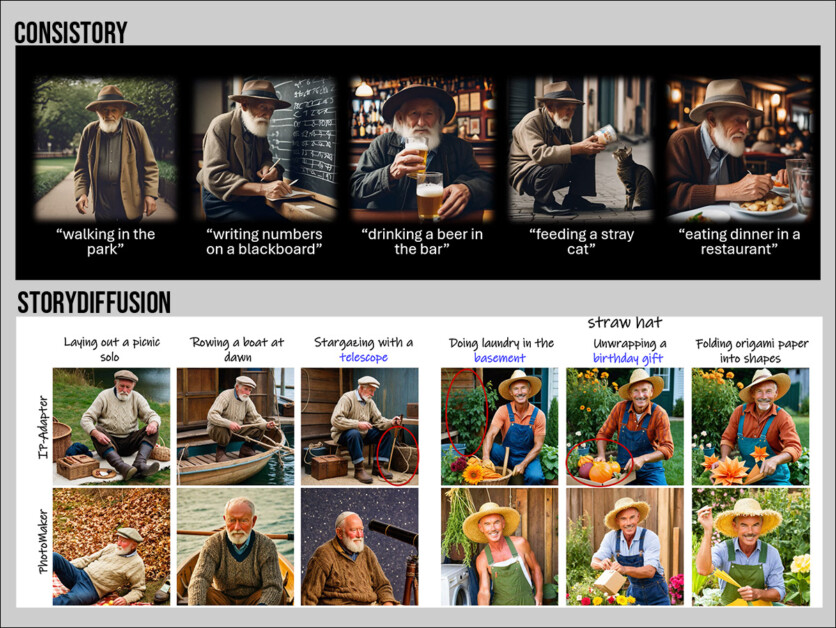

De eneste systemene som for øyeblikket tilbyr narrative konsistens i en diffusjonsmodell er de som produserer stille bilder. Disse inkluderer NVIDIA’s ConsiStory, og diverse prosjekter i den vitenskapelige litteraturen, som TheaterGen, DreamStory, og StoryDiffusion.

To eksempler på ‘statiske’ narrative konsistens, fra nyere modeller:: Kilder: https://research.nvidia.com/labs/par/consistory/ og https://arxiv.org/pdf/2405.01434

I teorien kunne man bruke en bedre versjon av slike systemer (ingen av disse er virkelig konsistente) til å lage en serie bilde-til-video-skudd, som kunne kombineres til en sekvens.

Ved nåværende stand av kunnskap, produserer denne tilnærmingen ikke plausibele oppfølgende skudd; og, i tillegg, har vi allerede forlatt auteur-drømmen ved å legge til et lag av kompleksitet.

Vi kan, i tillegg, bruke Low Rank Adaptation (LoRA) modeller, spesifikt trent på karakterer, ting eller miljøer, for å opprettholde bedre konsistens over skudd.

Men, hvis en karakter ønsker å dukke opp i en ny drakt, vil en helt ny LoRA vanligvis trenes som inkorporerer karakteren kledd i den fasjonen (selv om underkonsepter som ‘rød kjole’ kan trenes inn i enkelt LoRAs, sammen med passende bilder, er de ikke alltid enkle å arbeide med).

Dette legger til betydelig kompleksitet, selv til en åpningsscene i en film, hvor en person kommer ut av sengen, tar på seg en morgenkåpe, gjesper, ser ut av soveromsvinduet, og går til badet for å børste tennene.

En slik scene, som inneholder omtrent 4-8 skudd, kan filmes på en morgen med konvensjonelle filmprosedyrer; ved nåværende stand av kunnskap i generativ AI, representerer den potensielt uker med arbeid, multiple trent LoRAs (eller andre hjelpesystemer), og en betydelig mengde post-prosessering

Alternativt kan video-til-video brukes, hvor hverdagslige eller CGI-bilder transformeres gjennom tekst-promter til alternative tolkninger. Runway tilbyr slike systemer, for eksempel.

CGI (venstre) fra Blender, tolket i en tekst-aided Runway video-til-video-eksperiment av Mathieu Visnjevec – Kilde: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Det er to problemer her: du må allerede lage den grunnleggende filmklippet, så du lager allerede filmen to ganger, selv om du bruker et syntetisk system som UnReals MetaHuman.

Hvis du lager CGI-modeller (som i klippet ovenfor) og bruker disse i en video-til-bilde-transformasjon, kan deres konsistens over skudd ikke pålitest.

Dette skyldes at video-diffusjonsmodeller ikke ser det ‘store bildet’ – i stedet lager de en ny ramme basert på forrige ramme/r, og, i noen tilfeller, vurdere en nærliggende fremtidig ramme; men, til å sammenligne prosessen med et sjakkspill, kan de ikke tenke ‘ti trekk fremover’, og kan ikke huske ti trekk bakover.

For det andre vil en diffusjonsmodell fortsatt slite med å opprettholde en konsistent utseende over skuddene, selv om du inkluderer multiple LoRAs for karakter, miljø og lysstil, av grunner nevnt i starten av denne delen.

2: Du kan ikke redigere et skudd lett

Hvis du avbilder en karakter som går ned en gate med gamle CGI-metoder, og du bestemmer deg for å endre noe aspekt av skuddet, kan du justere modellen og rendre den igjen.

Hvis det er en virkelig innspilling, kan du bare nullstille og filme det igjen, med de nødvendige endringene.

Men, hvis du produserer et gen-AI-video-skudd som du elsker, men ønsker å endre ett aspekt av det, kan du bare oppnå dette ved smertefulle post-prosessering metoder utviklet over de siste 30-40 årene: CGI, rotoscoping, modellering og matting – alle arbeidskrevende og dyre, tidskrevende prosedyrer.

Måten diffusjonsmodellene fungerer på, vil enkelt endring av ett aspekt av en tekst-prompt (selv i en multimodal prompt, hvor du tilbyr et fullstendig kilde-bilde) endre flere aspekter av det genererte utgangen, og føre til en spill av prompting ‘whack-a-mole’.

3: Du kan ikke stole på fysikkens lover

Tradisjonelle CGI-metoder tilbyr en rekke algoritmbaserte fysikk-baserte modeller som kan simulere ting som fluid dynamikk, gassbevegelser, inverse kinematik (nøyaktig modellering av menneskelig bevegelse), klesdynamikk, eksplosjoner og diverse andre virkelige fenomener.

Men, diffusjonsbaserte metoder, som vi har sett, har kort minne, og også en begrenset rekke bevegelses-priorer (eksempler på slike handlinger, inkludert i treningsdatasettet) å trekke på.

I en tidligere versjon av OpenAIs landingsside for den anerkjente Sora-generative systemet, innrømmet selskapet at Sora har begrensninger i denne henseende (selv om denne teksten har blitt fjernet):

‘[Sora] kan slite med å simulere fysikken i en kompleks scene, og kan ikke forstå bestemte eksempler på årsak og virkning (for eksempel: en kjeks kan ikke vise et merke etter at en karakter biter det).

‘Modellen kan også forvirre romlige detaljer inkludert i en prompt, som å skille venstre fra høyre, eller slite med nøyaktige beskrivelser av hendelser som utvikler seg over tid, som bestemte kamera-bevegelser.’

Den praktiske bruk av ulike API-baserte generative video-systemer avslører lignende begrensninger i å avbilde nøyaktig fysikk.

Noen bevegelses-prior-embedding, enten trent inn i den generative modellen eller matet inn fra en kildevideo, tar en stund å fullføre (som en person som utfører en kompleks og ikke-repetitiv danssekvens i en intrikat drakt) og, igjen, vil diffusjonsmodellens kortvarige vindu av oppmerksomhet sannsynligvis transformere innholdet (ansikts-ID, drakt-detaljer osv.) når bevegelsen er ferdig.

Men, LoRAs kan mildne dette, til en viss grad.

Fixing It in Post

Det er andre mangler ved ren ‘enkel bruker’ AI-video-generering, som vanskeligheten de har i å avbilde raske bevegelser, og det generelle og langt mer presserende problemet med å oppnå tidskonsistens i utgangsvideo.

I tillegg er det vanskelig å skape bestemte ansiktsuttrykk og lip-sync for dialog i generativ video, og dette er ofte et spørsmål om flaks.

I begge tilfeller er bruk av hjelpesystemer som LivePortrait og AnimateDiff blir stadig mer populært i VFX-samfunnet, ettersom dette tillater overføring av minst ansiktsuttrykk og lip-sync til eksisterende generert utgang.

Et eksempel på uttrykks-overføring (drivende video i nedre venstre) påført en målvideo med LivePortrait. Videoen er fra Generative Z TunisiaGenerative. Se den fullstendige versjonen i bedre kvalitet på https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Videre, en mengde komplekse løsninger, som inkorporerer verktøy som Stable Diffusion GUI ComfyUI og den profesjonelle komposisjons- og manipulasjonsapplikasjonen Nuke, samt latente rom-manipulering, tillater AI-VFX-utøvere å få større kontroll over ansiktsuttrykk og holdning.

Selv om han beskriver prosessen med ansiktsanimasjon i ComfyUI som ‘pinlig’, har VFX-proff Francisco Contreras utviklet en slik prosess, som tillater påføring av lip-fonemer og andre aspekter av ansikts-/hode-avbildning

Stable Diffusion, hjulpet av en Nuke-drevet ComfyUI-arbeidsflyt, tillot VFX-proff Francisco Contreras å få usædvanlig kontroll over ansiktsaspekter. For den fullstendige videoen, i bedre oppløsning, gå til https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Konklusjon

Ingenting av dette er lovende for prospektet av en enkelt bruker som genererer kohesive og fotorealistiske blockbuster-stil full-lengde filmer, med realistisk dialog, lip-sync, prestasjoner, miljøer og kontinuitet.

Videre, de hindringer som er beskrevet her, at minst i forhold til diffusjonsbaserte generative video-modeller, er ikke nødvendigvis løsbare ‘noen gang’ nå, til tross for forum-kommentarer og mediapublisering som hevder dette. Begrensningene som er beskrevet, synes å være innebygget i arkitekturen.

I AI-syntese-forskning, som i all vitenskapelig forskning, skinner geniale ideer periodisk oss med deres potensiale, bare for videre forskning å avdekke deres grunnleggende begrensninger.

I generativ/syntese-rommet, har dette allerede skjedd med Generative Adversarial Networks (GANs) og Neural Radiance Fields (NeRF), begge som til slutt viste seg å være svært vanskelige å instrumentaliserer til performant kommersielle systemer, til tross for år med akademisk forskning mot dette målet. Disse teknologiene viser nå opp mest hyppig som hjelpekomponenter i alternative arkitekturer.

Like mye som filmstudioer kan håpe at trening på legitimt lisensiert filmkataloger kunne eliminere VFX-artister, legger AI faktisk til roller til arbeidsstyrken på dette tidspunktet.

Hvorvidt diffusjonsbaserte video-systemer kan virkelig transformeres til narrativt konsistente og fotorealistiske film-genereringer, eller hvorvidt hele forretningsvirksomheten bare er et annet alkymisk forsøk, burde bli åpenbart over de neste 12 månedene.

Det kan hende at vi trenger en helt ny tilnærming; eller det kan hende at Gaussian Splatting (GSplat), som ble utviklet i begynnelsen av 1990-årene og nylig har tatt av i bilde-syntese-rommet, representerer en potensiell alternativ til diffusjonsbasert video-generering.

Ettersom GSplat tok 34 år å komme til fremtredende, er det mulig at eldre konkurrenter som NeRF og GANs – og selv latent diffusjonsmodeller – ennå ikke har hatt sin dag.

* Kaibers AI Storyboard-funksjon tilbyr denne type funksjonalitet, men resultater jeg har sett er ikke produksjonskvalitet.

Martin Anderson er tidligere sjef for vitenskapelig forskningsinnhold ved metaphysic.ai

Først publisert mandag, 23. september 2024