Andersons vinkel

Fjerning av objekter og personer fra video med AI

Nei, barnet forblir ikke i bildet, hvis AI har noe å si til det.

Fjerning av personer og objekter fra bilder og video er en populær undergren av forskning i VFX-sentrert AI-litteratur, med en økende mengde dedikerte datasett og rammer som adresserer utfordringen. Den siste av disse, fra Instituttet for stor data ved Kinas Fudan Universitet, er EffectErase, et ‘effekt-bevisst’ videosystem for objektfjerning som, forfatterne hevder, forbedrer betydelig på tilstanden for kunsten i tester:

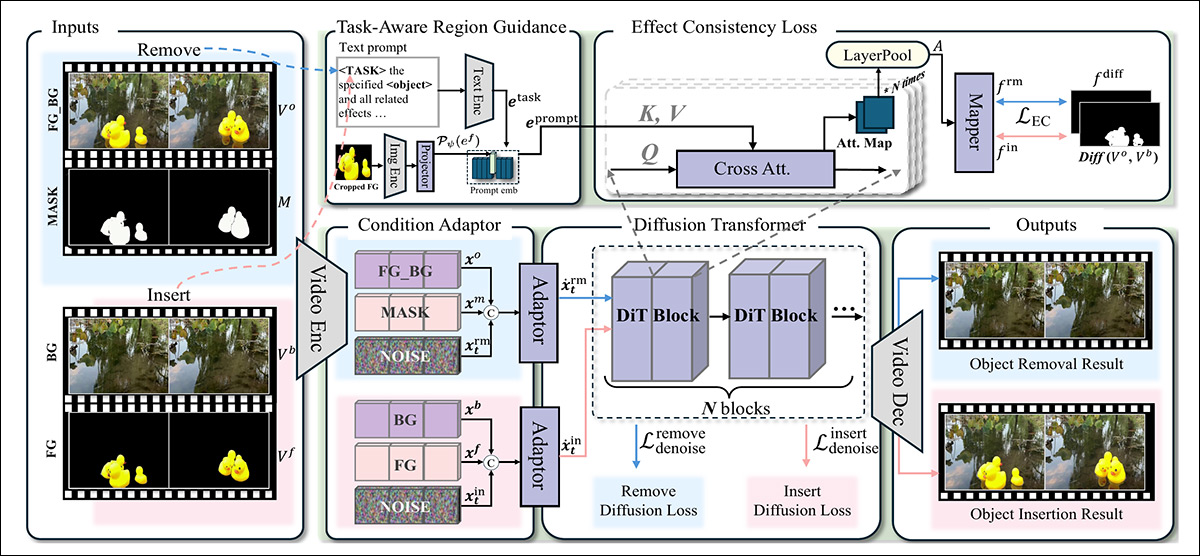

Sammensatt fra materiale på prosjektets nettsted, eksempler på EffectErase-metoden (vær oppmerksom på at selv om vi gir en lenke, inneholder kilde-nettstedet så mange høyoppløselige og ikke-optimerte autoplay-videoer at det kan påvirke stabiliteten til nettleseren din. Den tilhørende YouTube-videoen er en enklere og fullere referanse, og er innlemmet i slutten av denne artikkelen). Kilde

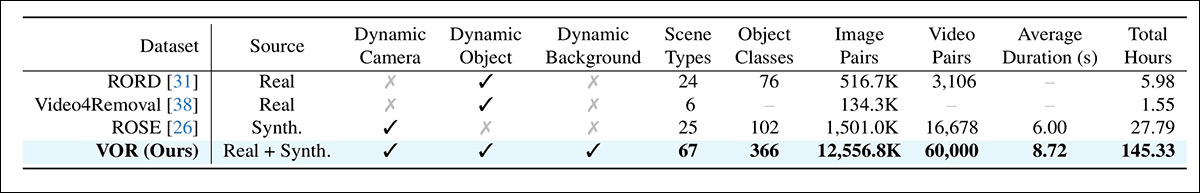

Det nye arbeidet innebar skaping/ kurering av et semi-nyt datasett som består av nesten 350 originale virkelige og syntetiske scener (med bruk av offentlige repositorier*), enten fanget med dedikert utstyr eller hentet og gjort om til en arbeidsflyt som er bygget rundt det åpne kildekods-rammeverket Blender 3D.

Hybrid Video Object Removal (VOR)-datasettet danner grunnlaget for EffectErase-applikasjonen selv, som er bygget over Wan2.1-video-genereringssystemet. Systemet definerer også to nye relaterte benchmark: VOR Eval og VOR Wild – henholdsvis, for prøver med og uten bakgrunns-sannhet.

(Selv om papiret har en tilhørende prosjekt-side, er den ganske overbelastet med multiple høyoppløselige videoer, og vanskelig å laste; så vennligst se på utdragene jeg har kurert i den innlemmede videoen ovenfor, hvis du finner prosjekt-siden vanskelig å bruke)

En sammenligning av mengder over sammenlignbare tidligere datasett, med hensyn til det nye tilbudet. Kilde

Forskerne hevder at deres tilnærming gir state-of-the-art-ytelse, både i kvantitative mål og i kvalitative resultater som avgjøres gjennom en menneske-studie.

De merker at tidligere arbeider ikke alltid har lykkes i å fjerne tilhørende effekter av et objekt, som skygge og refleksjoner, og at deres datasett har blitt nøye skapt for å rette opp denne mangelen:

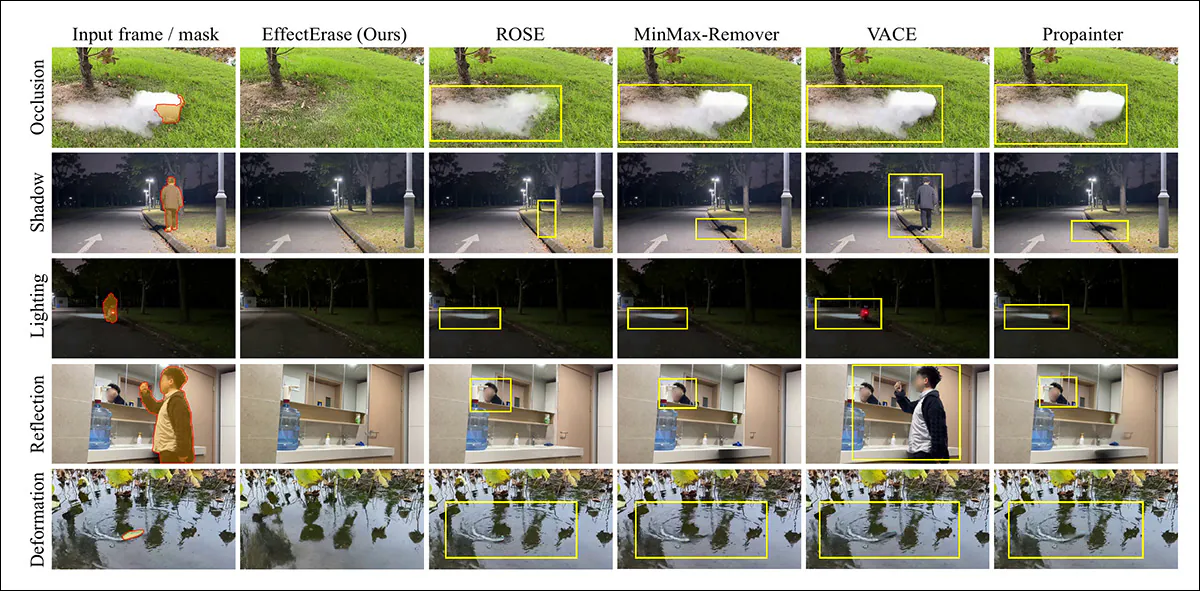

Eksempler på tidligere tilnærminger som ikke ser bortenfor objektet som skal fjernes, til sekundære indikasjoner, som refleksjoner og skygger.

Den nye artikkelen heter EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing, og kommer fra fire forskere ved Fudan Universitets College of Computer Science and Artificial Intelligence.

Metode

Hybrid VOR-datasettet var designet for å omfatte en tilstrekkelig bred variasjon av scenarioer for å dekke alle implikasjonene av å prøve å fjerne en person eller et objekt fra video:

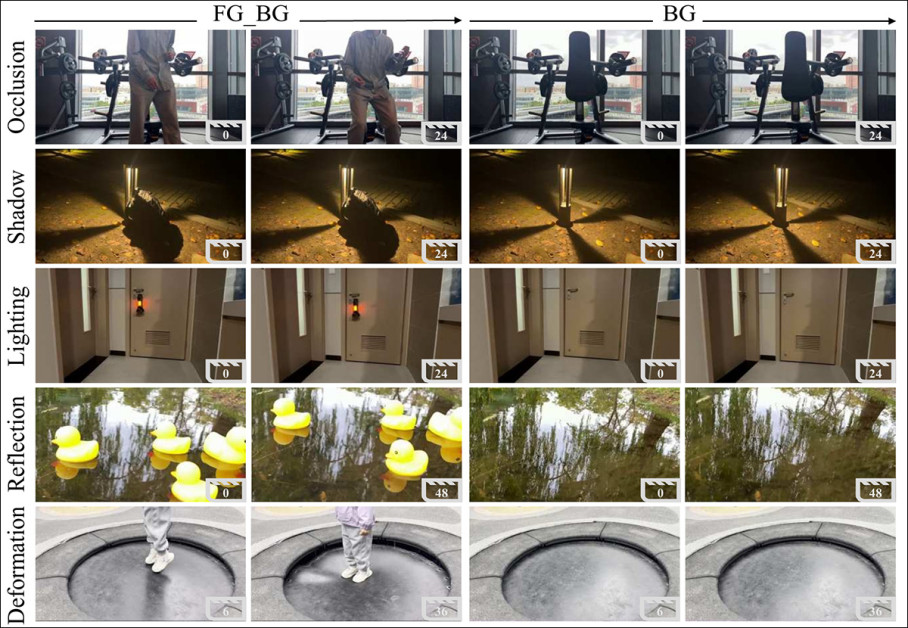

Parrede ramer fra VOR-datasettet illustrerer hvordan objektfjerning må gå utover det synlige subjektet til dets induserte effekter, med eksempler som viser okklusjon, skygge, lys-skift, refleksjoner og fysisk deformasjon, hver presentert som inndata (objekt til stede) sammen med den tilhørende rene bakgrunnen etter fjerning. For flere eksempler, se den tilhørende YouTube-videoen innlemmet i slutten av denne artikkelen.

De fem representative typene ‘forstyrrelser’ som skal håndteres, er definert av forfatterne som okklusjon, inkludert ulike typer glass- og røyk-okklusjon; skygge; lys (for eksempel, når et objekt som skal fjernes skaper eller endrer lysensbane); refleksjon; og deformasjon (for eksempel, avtrykket av en bruker på en pute, som ikke skal overleve personens fjerning).

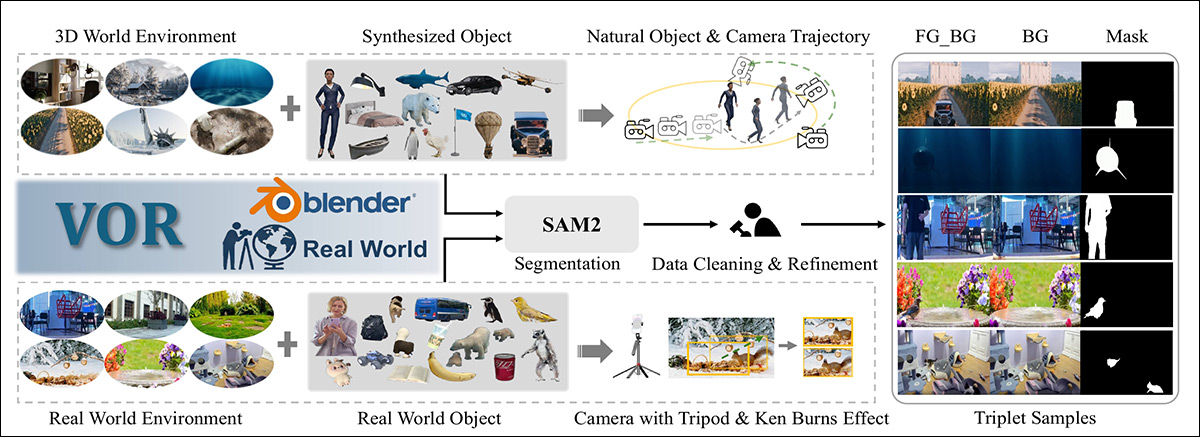

Dataset-konstruksjons-pipeline for VOR, som kombinerer Blender-genererte syntetiske scener med virkelige innspillinger, hvor syntetisk data er bygget fra kurerte 3D-miljøer, objekter og kamera-trafektorier, og virkelig film innspilt over diverse scener, forbedret med Ken Burns-bevegelse. SAM2-segmentering og manuell finjustering produserer så alignerte forgrunn- og bakgrunn-video-tripletter med tilhørende masker.

For de virkelige originale dataene, brukte forskerne faste kameraer for å innspille ‘med’ og ‘uten’ scener som dekket et bredt spekter av miljøer, tid på dagen og værforhold.

For de syntetiske dataene, ble multiple perspektiver renderet, og multi-objekt-scenarier skapt, med bevisst komplekse og utfordrende typer kamera-bevegelser, som kunne forekomme i virkelige innspillinger; og forskerne observerer at denne tilnærmingen er mer sofistikert og krævende enn den som ble brukt for det ellers lignende Remove Objects with Side Effects in Videos (ROSE)-datasettet.

For å øke bevegelses-mangfold, ble Ken Burns-effekten brukt på kamera-innspilte par, med kontrollerte panoreringer, zoom og lett håndholdt bevegelse under fjorten forhåndsdefinerte regler, med fem bevegelses-mønster prøvet per par mens de holdt innenfor den opprinnelige rammen.

Skala og mangfold ble ytterligere utvidet ved å kombinere syntetiske objekter med multiple kamera-oppsstillinger. Masker ble generert ved å plassere manuelle punkt-prompter på nøkkel-rammer, propagerte segmentering med Segment Anything 2 (SAM2), renset og finjustert resultater, og samlet validerte forgrunn-, bakgrunn- og mask-tripletter for trening.

Den endelige samlingen består av 145 timer med video over 60 000 parrede videoer, virkelige og syntetiske, som dekker 366 objekt-klasse i 443 scener.

EffectErase-netverket selv tar imot materiale via en Variational Auto-Encoder (VAE†), med latent støy-håndtering håndtert av Wan2.1. Over denne ryggraden, opererer EffectErase Fjerning-Insertion Joint Learning, som trener begge oppgaver sammen på samme regioner; Task-Aware Region Guidance (TARG), som bruker objekt- og oppgave-token med kryss-oppmerksomhet for å modellere rom-tid-linke mellom objekter og deres effekter og tillate oppgave-skifting; og Effect Consistency Loss, som alignerer effekt-regioner over fjerning- og insertions-oppgaver:

Skjema for EffectErase-rammeverket. Under trening, blir parrede videoer kodet inn i et delt latent-rom, fusjonert med støy, og prosessert av en diffusjon-transformer guidet av oppgave-bevisst kryss-oppmerksomhet, mens en effekt-konsistens-tap alignerer fjerning- og insertions-regioner så begge oppgaver fokuserer på samme område.

I seg selv, er fjerning- og insertions-prosessene trent sammen, med en delt diffusjon-ryggrad, så modellen lærer å fokusere på samme berørte regioner og struktur-klarheter.

Videoer med objekter, bakgrunn-videoer og masker, blir først kodet inn i et latent-rom; støy blir så lagt til for diffusjon-trening, og modellen lærer å gjenopprette rene representasjoner under oppgave-spesifikk veiledning. En lett adapter fusjonerer så de støyende funksjonene med fjerning- eller insertions-betingelser, og tillater begge oppgaver å dele veiledning, mens de forblir kontrollerbare.

Task-Aware Region Guidance skaper en oppgave-spesifikk signal ved å kombinere språk-token med visuelle funksjoner ekstrahert fra forgrunns-objektet, ved å bruke CLIP, erstatter en generisk objekt-token med en innkapsling avledet fra det faktiske bilde-innholdet. Denne fusjonerte representasjonen injiseres i ryggraden gjennom kryss-oppmerksomhet, og tillater modellen å spore hvordan et objekt og dets visuelle effekter utvikler seg over rom og tid, mens den aktiverer fleksibel skifting mellom fjerning og insertions.

Effect Consistency Loss tvinger fjerning- og insertions-prosessene til å fokusere på samme endrede områder, siden begge oppgaver handler om samme objekt og dets visuelle effekter. Oppmerksomhets-kart fra hver gren blir kombinert i myke region-kart, og alignert med en forskjell-kart beregnet fra objekt- og bakgrunn-videoer, så subtile endringer som lys og skygger blir bevart. Denne ekstra tap hjelper insertions å guide fjerning og holder begge oppgaver konsistente.

Data og tester

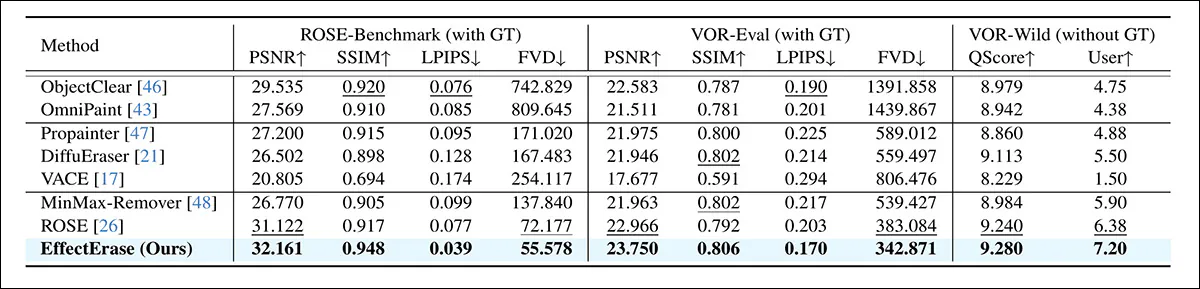

Forskerne testet sin tilnærming mot ulike innfylling-, video-innfylling- og objektfjerning-metoder: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; og MiniMax-Remover.

Wan2.1 ble finjustert med LoRA†† ved å bruke VOR-datasettet med en oppløsning på 832x480px. 81 påfølgende ramer (den effektive grensen for WAN, utover hvilken feil tenderer å oppstå) ble tilfeldig valgt for trening, som skjedde over 129 000 iterasjoner med en batch-størrelse på 8, på åtte H100-GPUer, hver med 80GB VRAM. Lærings-raten ble satt til 1×102, og LoRA-rank til 256.

ROSE-Benchmark-samlingen var den eneste eksterne datasettet som ble testet; de to andre var VOR-Eval, VOR-datasettets test split; og VOR-Wild, en test-sett som består av 195 virkelige videoer skrapet fra internettet, med ‘dynamiske objekter’.

Målinger som ble brukt, var Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Lærte Perceptual Image Patch Similarity (LPIPS); og Fréchet Video Distance (FVD). En bruker-studie av 195 genererte videoer fra VOR-Wild ble også vurdert, med gjennomsnittlige vurderinger fra 20 frivillige tatt i betraktning.

I tillegg utviklet forfatterne QScore, en måling som utnytter Qwen-VL-multimodalt modell, for å evaluere kvaliteten på objektfjernet video-utgang, i termer av gjenværende artefakter eller manglende miljø-fjerning, som skygger og lys-effekter:

Kvantitativ sammenligning på ROSE- og VOR-benchmark, med beste og nest beste resultater vist i uthevet og understreket, henholdsvis.

Med hensyn til disse resultater, merker forfatterne:

‘[Nåværende] bilde-innfylling-metoder opererer på enkelt-rammer ved å bruke 2D-modeller uten tids-modellering, og derfor ikke kan opprettholde tids-konsistens i videoer.

Senere video-innfylling-metoder modellerer ikke eksplisitt objekt-side-effekter, og resulterer i unaturlig fjerning. Eksisterende video-objektfjerning-metoder mangler rom-tid-korrelasjon-modellering mellom objektet og dets side-effekter, og produserer ofte artefakter og rester av de fjernede objektene.

‘Totalt sett oppnår EffectErase state-of-the-art-ytelse over alle datasett og evaluering-mål. Det oppnår de beste poengene på video-kvalitets-målet FVD, og demonstrerer overlegen tids-glatt og konsistens i de genererte videoene.

‘Metoden vår oppnår også den høyeste QScore og bruker-tilbakemelding-vurderinger, og demonstrerer ytterligere effektivitet i å produsere visuelt overbevisende fjerning-resultater.’

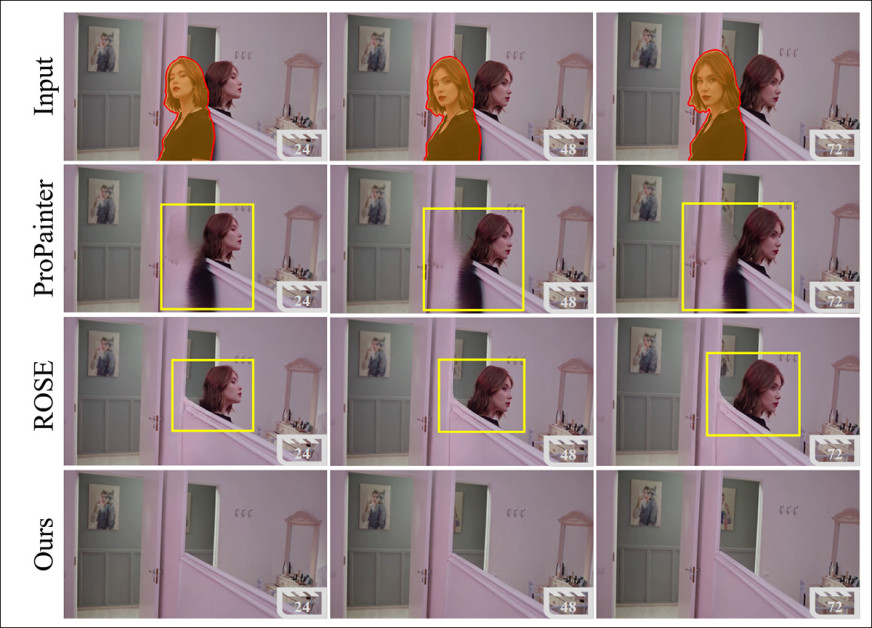

For den kvalitative evalueringen, er statiske resultater tilgjengelige i papiret (vist) direkte under, samt mobile resultater som er tilgjengelige på prosjekt-siden og den tilhørende YouTube-video-presentasjonen:

Kvalitativ sammenligning på VOR-Eval over okklusjon, skygge, lys, refleksjon og deformasjon-tilfeller. Innfylling-metoder sliter med å fjerne effekter utenfor masken, mens fjerning-modeller ofte etterlater synlige artefakter. EffectErase fjerner både mål-objektene og deres assosierte effekter mer renhet. Vennligst se på kilde-papiret for bedre oppløsning, og på prosjekt-siden for video-eksempler.

Vi henviser også til diverse relaterte eksempler på prosjekt-siden, forhåndsvisning nedenfor, samt den offisielle YouTube-videoen innlemmet i slutten av denne artikkelen:

Klikk for å spille. Et eksempel-sammenligning fra EffectErase-prosjekt-siden. Vennligst se på siden for bedre oppløsning (med de ovennevnte forbehold) og for flere eksempler.

Forfatterne kommenterer:

‘Video-innfylling-metoder produserer ofte artefakter i maskerte regioner og sliter med å fullstendig fjerne side-effekter forårsaket av de fjernede objektene. Tidligere objektfjerning-tilnærminger, som [ROSE] og [MinMax-Remover], fungerer godt i å fjerne mål-objektene, men sliter fortsatt med side-effekter, spesielt i okklusjon, skygge, lys, refleksjon og deformasjon-scenarier.

‘I motsetning til dette fjerner EffectErase både mål-objektene og deres assosierte effekter, og resulterer i rene, konsistente og høykvalitets-resultater.’

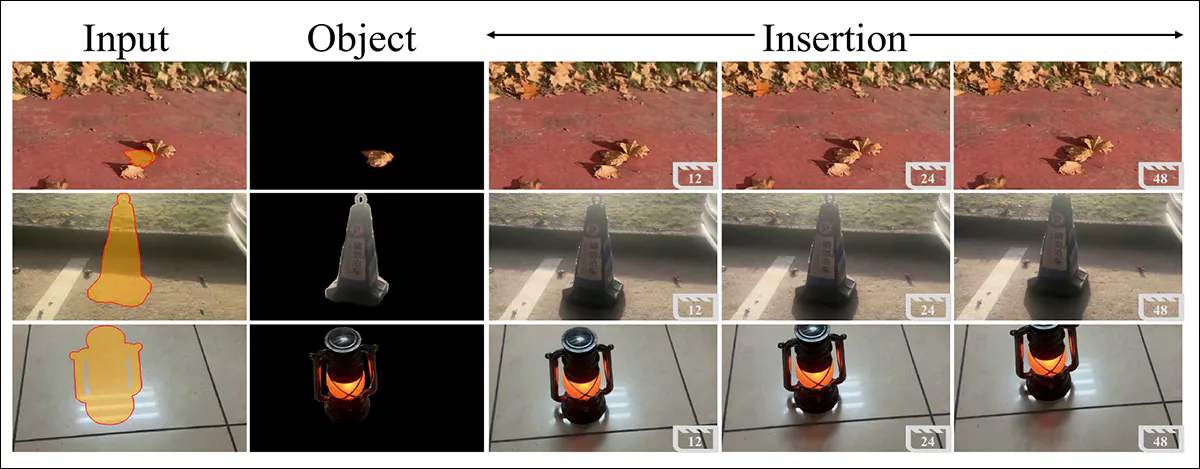

I slutten observerer forskerne at deres metode også kan tilpasses for insertions i stedet for fjerning, uten behov for ekstra trening:

Video-objekt-insertions-resultater. EffectErase inserterer objekter mens den bevarer bakgrunn-innhold og genererer konsistente objekt-induserte effekter som skygger og refleksjoner over rammer.

Video-resultater for insertions-oppgaven kan ses i den (tidsspesifikke) YouTube-video-eksemplene (også innlemmet uten tidsspesifikke på slutten av artikkelen).

Konklusjon

En gjennomgang av lignende prosjekter i litteraturen avslører at mange fortsatt håper at generelle VFX-modeller til slutt vil kunne foldet denne type funksjonalitet inn i en generell ‘verktøykasse’-modell designet for en rekke effekter, i stedet for bare denne spesifikke oppgaven.

Men, på ‘jack of all trades’-prinsippet, synes det rimelig å anta at dedikerte systemer som EffectErase vil fortsette å holde en kant over mer generelle tilnærminger; med den forbehold at gapet kan til slutt kontrahere nok til å gjøre forskjellen ikke verd å ekstra anstrengelse for å trene en diskret modell.

* En ville håpe, med økende bekymringer rundt IP-proveniens-problemer, at alle slike kilder ville bli sitert; men hvis de tilgjengelige materialet fra det nye arbeidet lister kilden til de 3D-modellene, var jeg ikke i stand til å finne denne referansen.

† Referansen som er gitt, synes å være en generisk forklarende tekst fra 2013, med den spesifikke VAE ikke detaljert.

†† Tatt fra papiret, er dette en semantisk uklar beskrivelse, siden finjustering og LoRA er forskjellige prosesser med svært forskjellige krav.

Først publisert lørdag, 21. mars 2026