Andersons vinkel

Vibe-koding liderer når AI sin rolle utvides

En ny studie finner at vibe-koding forbedres når mennesker gir instruksjoner, men forverres når AI gjør det, med den beste hybridoppsettet som holder mennesker fremst, med AI som en dommer eller avgjørelse.

Ny forskning fra USA, som undersøker hva som skjer når AI-systemer tillates å styre vibe-koding, i stedet for bare å utføre menneskelige instruksjoner, har funnet at når store språkmodeller (LLM) tar på seg en større retningssrolle, er resultater nesten alltid dårligere.

Selv om forskerne brukte OpenAI’s GPT-5 som rammeverk for deres menneske/AI-samarbeids eksperimenter, bekreftet de senere at både Anthropic’s Claude Opus 4.5 og Google Gemini 3 Pro var underlagt samme forverringsskurve som ansvar vokste, og uttalte at ‘selv begrenset menneskelig involvering stadig forbedrer ytelsen’:

‘[Mennesker] gir unikt effektive høynivå-veiledning over iterasjoner, [hvor] AI-veiledning ofte leder til ytelses-kollaps. Og, vi finner at en forsiktig rollefordeling som holder mennesker ansvarlige for retning mens utkontrakterer evaluering til AI kan forbedre hybrid-ytelse.’

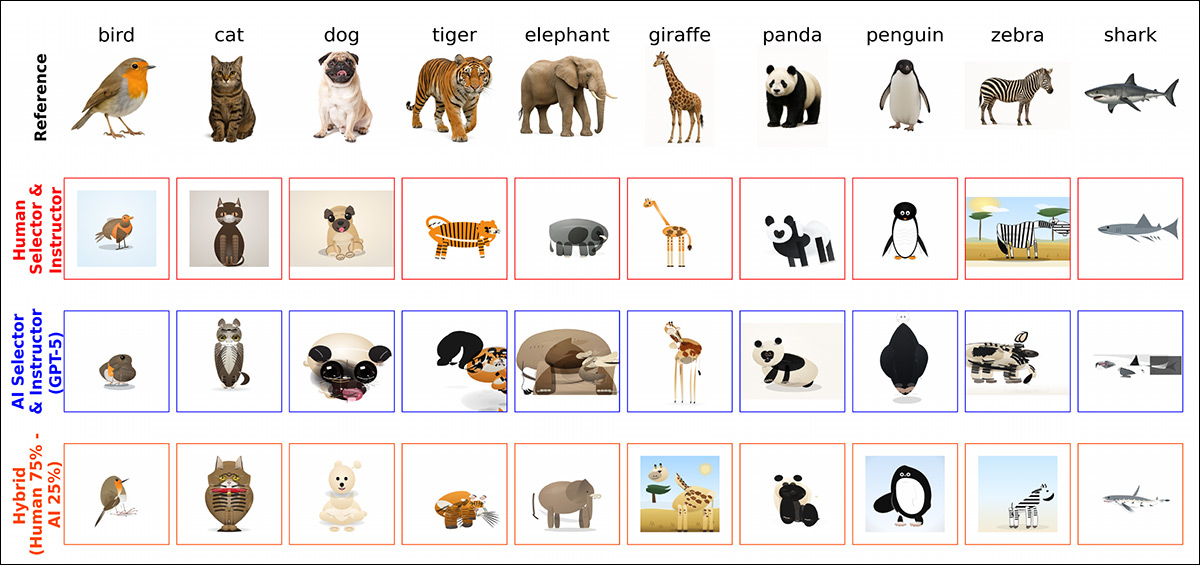

For å gi en konsistent test som kunne vurderes like av mennesker som av AI, ble et kontrollert eksperimentelt rammeverk bygget rundt en iterativ kodeoppgave hvor en referansebilde – med et foto av en katt, hund, tiger, fugl, elefant, pingvin, hai, sebra, giraff, eller panda – måtte rekreeres ved hjelp av skalerbare vektorgrafikker (SVG), og den rekreasjonen ble vurdert mot foto-kilden som den var avledet fra:

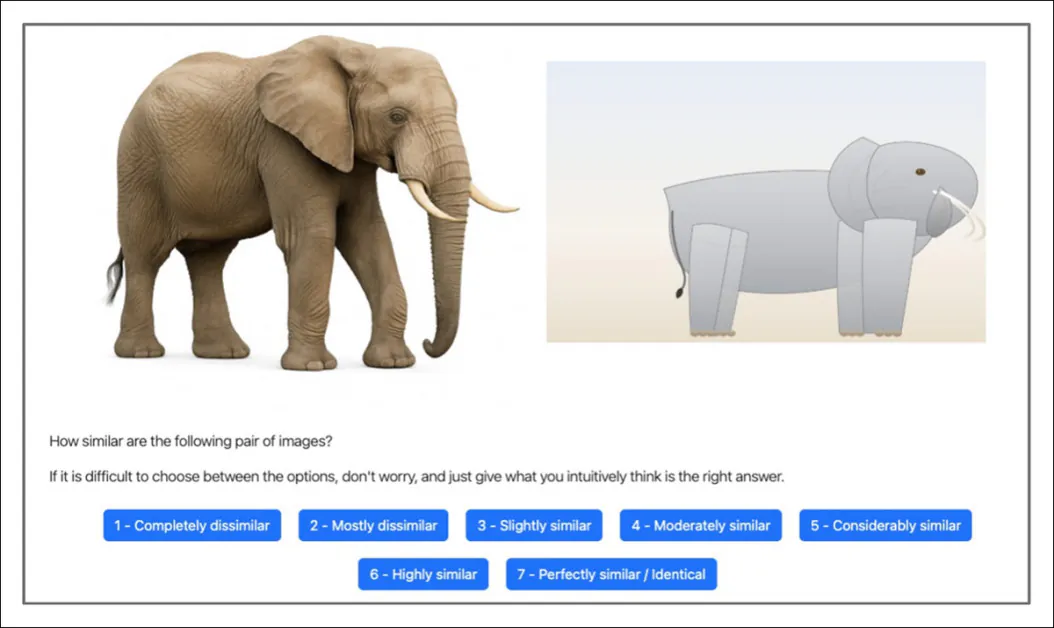

Både menneskelige og AI-deltakere ble vist et fotografisk referansebilde sammen med en AI-generert SVG-rekonstruksjon, og ble bedt om å vurdere hvor lik de to var på en syv-punkts skala. Kilde

I hver runde ga en agent høynivå-naturlege instruksjoner for å guide en kodegenerator, og en annen bestemte om å beholde den nye versjonen eller gå tilbake til den forrige – en strukturert løkke som speiler virkelige samarbeidsflyter.

Over 16 eksperimenter med 604 deltakere og tusenvis av API-forespørsler, ble fullt menneske-ledet testrunde sammenlignet direkte med fullt AI-ledet runde, under ellers identiske forhold.

Noen av de varierende løsningene som ble nådd av forskjellige kombinasjoner av menneske/AI-samarbeidsprosenter og typer (tatt fra en større illustrasjon i kildepapiret, som vi henviser leseren til).

Selv om mennesker og AI utførte på lignende nivå ved starten av testene, divergerte deres baner over tid: når mennesker ga instruksjoner og tok valg, økte likhetsskorene over iterasjoner, med stadig kumulativ forbedring; men når AI-systemer fylte begge roller, viste ytelsen ingen konsistente gevinster, og ofte forverret over runder – selv om samme underliggende modell ble brukt for kodegenerering, og AI hadde tilgang til samme informasjon som menneskelige deltakere.

Den prolixe effekten

Resultatene viste også at menneskelige instruksjoner vanligvis var korte og handle-orienterte, fokusert på hva som skulle endres neste i gjeldende bilde; motsatt, AI-instruksjoner var mye lengre og tungt beskrevende (en faktor som var parametrert for GPT-5), detaljert visuelle attributter i stedet for å prioritere inkrementell korreksjon.

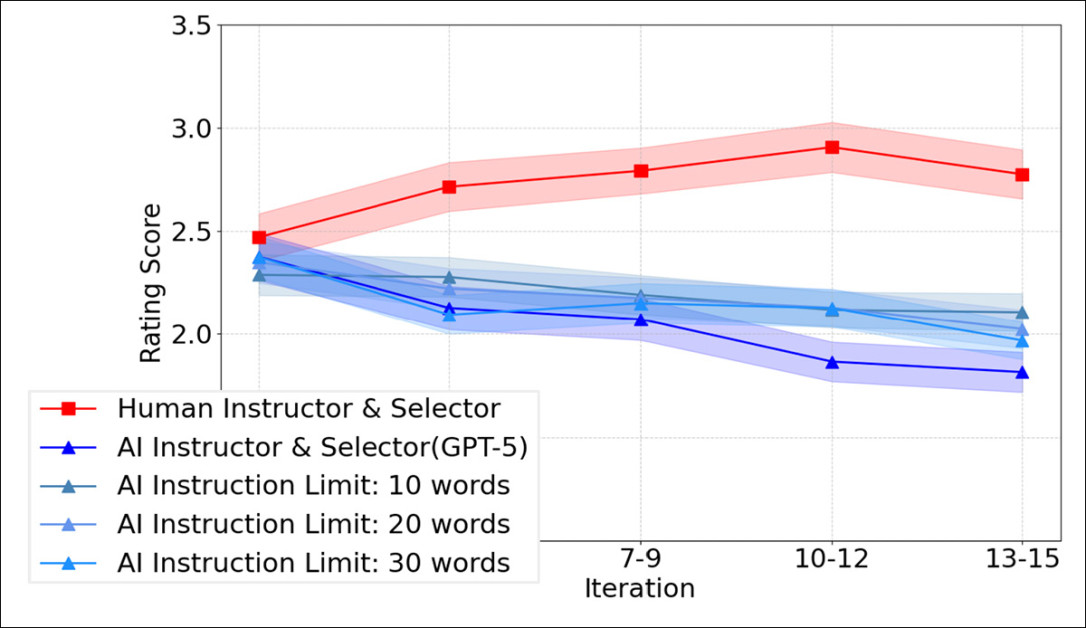

Men, som vist i grafen nedenfor, hadde pålegg av strenge ordgrenser på AI-instruksjoner ikke omvendt mønsteret; selv når begrenset til 10, 20 eller 30 ord, AI-ledet kjeder fortsatte å ikke forbedre over tid:

Likhetsskore over iterasjoner for menneske-ledet runder sammenlignet med fullt AI-ledet runder begrenset til 10, 20 eller 30-ord instruksjoner. Det er tydelig at forkortelse av AI-prompter ikke forhindrer den iterative ytelsesnedgangen observert når AI dirigerer både instruks og valg.

Hybrid-eksperimenter gjorde mønsteret tydeligere, viser at tilføyelse av bare litt menneskelig involvering forbedret resultater, sammenlignet med fullt AI-ledet oppsett; men ytelse sank vanligvis når AI-veiledningens andel økte.

Når rollene ble skilt, kunne evaluering og valg håndteres av AI med relativt liten kvalitetsTap; men erstattelse av menneskelig høynivå-instruks med AI-veiledning ledet til merkbare kvalitetstap, hvilket antyder at det som betyr mest er ikke hvem genererer koden, men hvem setter og opprettholder retningen over iterasjoner.