Andersons vinkel

Legg til dialog i ekte video med AI

Et nytt AI-rammeverk kan omskrive, fjerne eller legge til en persons ord i en video uten omfilming, i et enkelt sluttpunktssystem.

For tre år siden ville internettet ha vært sjokkert av noen av de 20-30 AI-videoendringsrammeverkene som publiseres på akademiske portalene ukentlig; som det er, har denne populære forskningsstranden nå blitt så omfattende at den nesten utgjør en egen gren av ‘AI-slop’, og jeg dekker langt færre slike utgivelser enn jeg ville for to eller tre år siden.

Likevel fanget en nåværende utgivelse i denne rekken mitt øye: et integrert system som kan gripe inn i ekte videoklipp og sette inn nytt tale i den eksisterende videoen (i stedet for å lage et helt generativt klipp fra et ansikt eller ramme, som er mye mer vanlig).

I eksemplene nedenfor, som jeg har redigert sammen fra en mengde eksempelvideoer tilgjengelige på utgivelsens prosjektwebside, ser vi først den ekte kildeklippet, og deretter, under, det påførte AI-talet midt i klippet, inkludert talesyntese og leppesynk:

Trykk for å spille av. Lokal redigering med sying – en av flere modaliteter tilbudt av FacEDiT. Vennligst se kildewebsiden for bedre oppløsning. Kilde – https://facedit.github.io/

Dette tilnærmingen er en av tre utviklet for den nye metoden, denne tittelen ‘lokal redigering med sying’, og den som interesserer forfatterne (så vel som meg). I virkeligheten utvides klippet ved å bruke en av midt-rammene som utgangspunkt for ny AI-tolkning, og dens påfølgende (ekte) rammene som et mål som det generative innførte klippet skal prøve å matche opp til. I klippene over, representeres disse ‘frø’- og ‘mål’-rammene av den øverste videoen som stopper mens den redigerte videoen under gir generativ infylling.

Forfatterne rammer denne ansikts- og vokalsyntese-tilnærmingen som den første fullt integrerte sluttpunktmetoden for AI-videoendringer av denne typen, og observerer potensialet for et fullt utviklet rammeverk som dette for TV- og filmproduksjon:

‘Filmskapere og medieprodusenter trenger ofte å revidere bestemte deler av innspilte videoer – kanskje var et ord feiluttalt eller manuskriptet endret etter innspilling. For eksempel, i den ikoniske scenen fra Titanic (1997) hvor Rose sier, “I’ll never let go, Jack,” kan regissøren senere bestemme at det skal være “I’ll never forget you, Jack”.

‘Tradisjonelt, slike endringer krever omfilming av hele scenen, som er kostbart og tidskrevende. Talking face synthesis tilbyr en praktisk alternativ ved å automatisk modifisere ansiktsbevegelse for å matche revidert tale, og eliminere behovet for omfilming.’

Selv om AI-innskudd av denne typen kan møte kulturelle eller industrielle motstand, kan de også utgjøre en ny type funksjonalitet i menneskeledede VFX-systemer og verktøyssamlinger. Uansett, for øyeblikket, er utfordringene strengt tekniske.

Foruten å utvide et klipp gjennom tilleggs AI-generert dialog, kan det nye systemet også endre eksisterende tale:

Trykk for å spille av. Et eksempel på å endre eksisterende dialog i stedet for å legge til ekstra dialog. Vennligst se kildewebsiden for bedre oppløsning.

Tilstand for kunnskap

Det finnes for øyeblikket ingen sluttpunktssystemer som tilbyr denne type syntese-kapasitet; selv om en voksende mengde generative AI-plattformer som Google’s Veo-serie, kan generere lyd, og diverse andre rammeverk kan lage deepfaked audio, må man for øyeblikket lage en ganske komplisert pipeline av diverse arkitekturer og triks for å intervenere i ekte fotage på samme måte som det nye systemet – tittelen FacEDiT – kan oppnå.

Systemet bruker Diffusion Transformers (DiT) i kombinasjon med Flow Matching for å lage ansiktsbevegelser betinget av omgivende (kontekstuelle) bevegelser og talelydinnhold. Systemet utnytter eksisterende populære pakker som håndterer ansiktsrekonstruksjon, inkludert LivePortrait (nylig overtatt av Kling).

I tillegg til denne metoden, gitt at deres tilnærming er den første til å integrere disse utfordringene i en enkelt løsning, har forfatterne skapt en ny benchmark kalt FacEDiTBench, sammen med flere helt nye evalueringssmetrikk apposite for denne svært spesifikke oppgaven.

Det nye arbeidet er tittelen FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, og kommer fra fire forskere på Koreas Pohang University of Science and Technology (POSTECH ), Korea Advanced Institute of Science & Technology (KAIST), og The University of Texas at Austin.

Metode

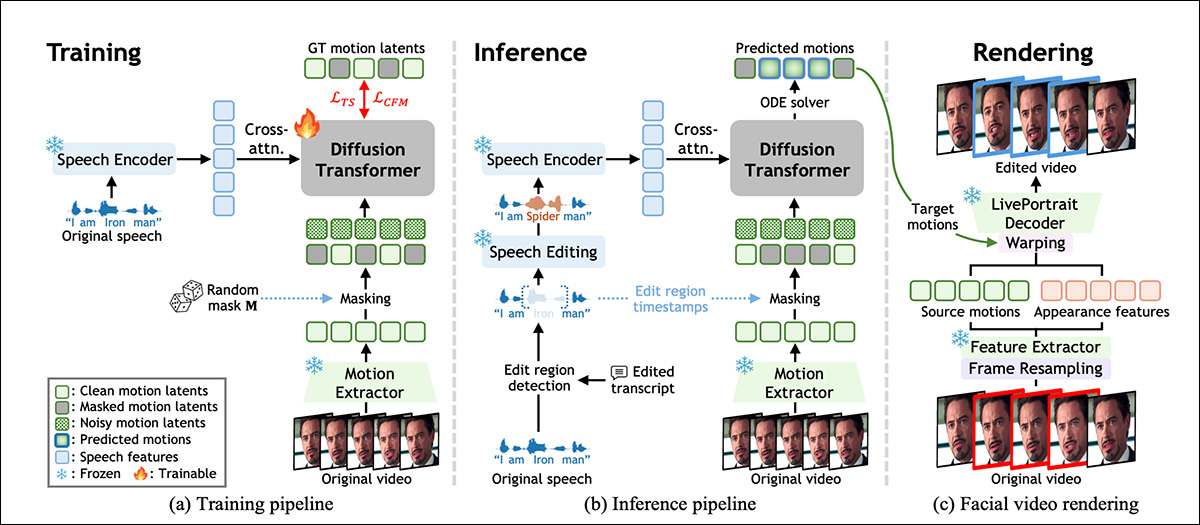

FacEDiT er trent for å rekonstruere ansiktsbevegelse ved å lære hvordan fylle inn manglende deler av en skuespillers opprinnelige ytelse, basert på omgivende bevegelse og talelyd. Som vist i skjemaet nedenfor, tillater denne prosessen modellen å fungere som en gap-fyller under trening, og forutsi ansiktsbevegelser som matcher stemmen mens den holder seg konsistent med den opprinnelige videoen:

Oversikt over FacEDiT-systemet, som viser hvordan ansiktsbevegelse læres gjennom selv-overvåket infylling under trening, guidet av redigert tale under slutning, og til slutt rendre tilbake til video ved å gjenbruke utseende fra den opprinnelige filmen, mens kun erstatter den målrettede bevegelsen. Kilde

Under slutning støtter samme arkitektur to forskjellige utdata avhengig av hvor mye av videoen som er maskert: delvise redigeringer, hvor bare en frase er endret og resten forblir urørt; eller full-setningsgenerering, hvor ny bevegelse syntetiseres helt fra scratch.

Modellen er trent via flow matching, som behandler videoendringer som en type vei mellom to versjoner av ansiktsbevegelse.

I stedet for å lære å gjette hvordan et redigert ansikt skal se ut fra scratch, lærer flow matching å flytte gradvis og jevnt mellom en støyende placeholder og den korrekte bevegelsen. For å lette dette, representerer systemet ansiktsbevegelse som en kompakt sett av tall trukket fra hver rammene ved hjelp av en versjon av ovennevnte LivePortrait-system (se skjema ovenfor).

Disse bevegelsesvektorene er designet for å beskrive uttrykk og hodepose uten å sammenflette identitet, så taleendringer kan lokaliseres uten å påvirke personens overordnede utseende.

FacEDiT-trening

For å trene FacEDiT, ble hver videoklipp delt inn i en serie av ansiktsbevegelsessnapshot, og hver rammene parret med den tilhørende delen av lyd. Tilfeldige deler av bevegelsesdataene ble deretter skjult, og modellen ble bedt om å gjette hva de manglende bevegelsene skulle se ut som, ved å bruke både tale og omgivende umaskerte bevegelse som kontekst.

Fordi de maskerte spenner og deres posisjoner varierer fra en treningseksempel til den neste, lærer modellen gradvis å håndtere både små interne redigeringer og lengre hull, for full-sekvensgenerering, avhengig av hvor mye informasjon den får.

Systemets ovennevnte Diffusion Transformer lærer å gjenopprette maskert bevegelse ved å forbedre støyende inndata over tid. I stedet for å mata inn tale og bevegelse i modellen på en gang, trådes lyden inn i hver prosesseringsblokk gjennom cross-attention, og hjelper systemet å matche leppebevegelser mer nøyaktig til talelyden.

For å bevare realisme over redigeringer, er oppmerksomheten biaset mot naboframer i stedet for hele tidslinjen, og tvinger modellen til å fokusere på lokal kontinuitet, og forhindre flimring eller bevegelseshopp ved kantene av endrede regioner. Posisjonelle innlegg (som forteller modellen hvor hver rammene vises i sekvensen) hjelper også modellen til å opprettholde naturlig tidsflyt og kontekst.

Under trening lærer systemet å forutsi manglende ansiktsbevegelse ved å rekonstruere maskerte spenner basert på tale og nærliggende umaskerte bevegelse. Under slutning gjenbrukes denne samme oppsettet, men med maskene nå guidet av redigeringer i tale.

Når et ord eller en frase er satt inn, fjernet eller endret, lokalisere systemet den berørte regionen, maskerer den og regenererer bevegelse som matcher den nye lyden. Full-sekvensgenerering behandles som en spesialtilfelle, hvor hele regionen maskeres og syntetiseres fra scratch.

Data og tester

Systemets bakgrunn består av 22 lag for Diffusion Transformer, hver med 16 oppmerksomhets-hoder og feedforward-dimensjoner på 1024 og 2024px. Bevegelses- og utseendefunksjoner trekkes ut ved hjelp av frosne LivePortrait-komponenter, og tale kodet via WavLM og modifisert ved hjelp av VoiceCraft.

En dedikert prosjekteringslag kartlegger 786-dimensjonale tale-funksjoner inn i DiT’s latente rom, med bare DiT og prosjekteringsmodulene trent fra scratch.

Trening ble utført under AdamW-optimalisator med et mål-læringsrate på 1e‑4, for en million steg, på to A6000-GPUer (hver med 48GB VRAM), ved en total batch-størrelse på åtte.

FacEDiTBench

FacEDiTBench-datasettet inneholder 250 eksempler, hver med en videoklipp av den opprinnelige og redigerte tale, og transkripsjonene for begge. Videoklippene kommer fra tre kilder, med 100 klipp fra HDTF, 100 fra Hallo3, og 50 fra CelebV-Dub. Hver ble manuelt sjekket for å bekrefte at både lyd og video var tydelig nok for evaluering.

GPT‑4o ble brukt til å revidere hver transkripsjon for å lage grammatisk gyldige redigeringer. Disse reviderte transkripsjonene, sammen med den opprinnelige tale, ble sendt til VoiceCraft for å produsere ny lyd; og på hvert stadium ble både transkripsjonen og den genererte lyden manuelt gjennomgått for kvalitet.

Hver prøve ble merket med redigeringstypen, tidspunktet for endringen og lengden på den modifiserte spenner, og redigeringer klassifisert som innsettinger, slettinger eller erstatter. Antallet ord som ble endret varierte fra korte redigeringer på 1 til 3 ord, medium redigeringer på 4 til 6 ord og lengre redigeringer på 7 til 10 ord.

Tre egendefinerte metrikk ble definert for å evaluere redigeringskvalitet. Fotometrisk kontinuitet, for å måle hvor godt lyset og fargen på en redigert sekvens blander seg med den omgivende videoen, ved å sammenligne piksel-nivå-forskjeller på grensene; bevegelseskontinuitet, for å vurdere konsistensen av ansiktsbevegelse, ved å måle optisk flyt-forandring over redigerte og uredigerte rammene; og identitetsbevaring, for å anslå om subjektets utseende forblir konsistent etter redigering, ved å sammenligne ansikts-embeddings fra den opprinnelige og genererte sekvensene ved hjelp av ArcFace-ansiktsgjenkjenningmodellen.

Tester

Testmodellen ble trent på materiale fra de tre ovennevnte datasettene, totalt rundt 200 timer med videoinnhold, inkludert vlogger og filmer, samt høyoppløselige YouTube-videoklipp.

For å evaluere talking face-redigering, ble FacEDiTBench brukt, i tillegg til HDTF-testdelen, som har blitt en standard for benchmarking for denne rekken av oppgaver.

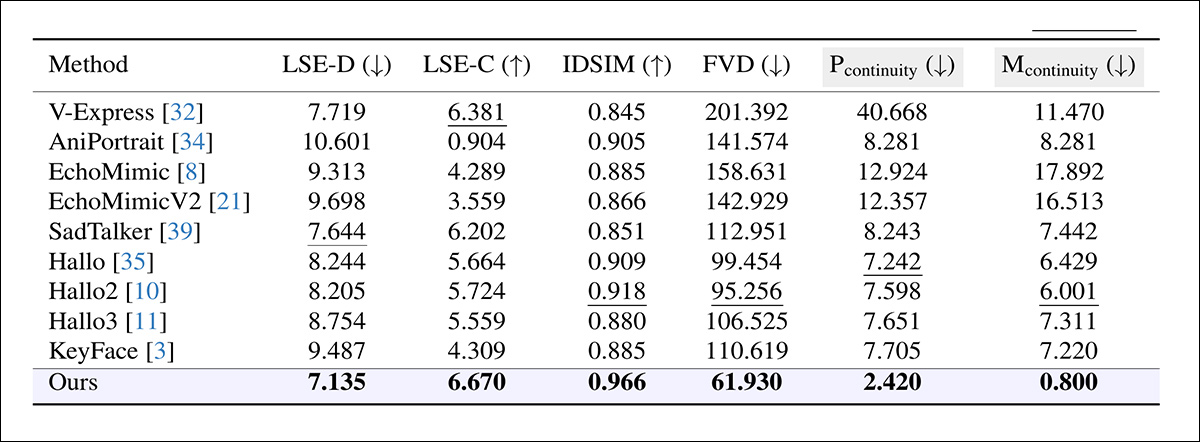

Ettersom det ikke fantes noen direkte sammenlignbare systemer som kunne omfatte denne type sluttpunkt-funksjonalitet, valgte forfatterne en rekke rammeverk som reproduserte minst noen av målfunksjonaliteten, og som kunne fungere som referanse; nemlig, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; og SadTalker.

Flere etablerte metrikk ble også brukt for å vurdere genererings- og redigeringskvalitet, med leppesynk-nøyaktighet evaluert gjennom SyncNet, og rapporterte både den absolutte feilen mellom leppebevegelser og lyd (LSE-D) og en konfidensscore (LSE-C); Fréchet Video Distance (FVD) kvantifiserer hvor realistisk videoen ser ut som helhet; og Lærte Perseptuelle Likhet-metrikker (LPIPS), som måler perseptuell likhet mellom genererte og opprinnelige rammene.

For redigering, ble alle metrikk brukt bare på den modifiserte sekvensen; for generering, ble hele videoen evaluert, med grensekontinuitet ekskludert.

Hver modell ble bedt om å syntetisere en tilsvarende videosekvens, som deretter ble innført i den opprinnelige klippet (forskerne merker seg at denne metoden ofte introduserte synlige diskontinuiteter, der den redigerte sekvensen møtte den omgivende filmen). En annen tilnærming ble også testet, hvor hele videoen ble regenerert fra den modifiserte lyden – men dette overskrev uendret regioner, og klarte ikke å bevare den opprinnelige ytelsen:

Sammenligning av redigeringsytelse over systemer opprinnelig designet for talking face-generering, med FacEDiT som overgår alle referanser over hver enkelt metrikk, oppnår lavere leppesynk-feil (LSE-D), høyere synkroniseringskonfidens (LSE-C), sterkere identitetsbevaring (IDSIM), større perseptuell realisme (FVD), og jevnere overganger over redigeringsgrenser (Pcontinuity, Mcontinuity). Gråskumt kolonner høydepunkter viktige kriterier for å vurdere grensekvalitet; fet og underlinjet verdier indikerer beste og nest beste resultater, henholdsvis

Med hensyn til disse resultater, kommenterer forfatterne:

‘[Vår] modell overgår eksisterende metoder på redigeringsoppgaven. Den oppnår sterk grensekontinuitet og høy identitetsbevaring, og demonstrerer evnen til å opprettholde tidsmessig og visuell konsistens under redigering. I tillegg reflekterer dens overlegne leppesynk-nøyaktighet og lav FVD realismen i den syntetiske videoen.’

Trykk for å spille av. Resultater, satt sammen av denne forfatteren fra de publiserte videoene på prosjektets støtte-nettside. Vennligst se kilde-websiden for bedre oppløsning.

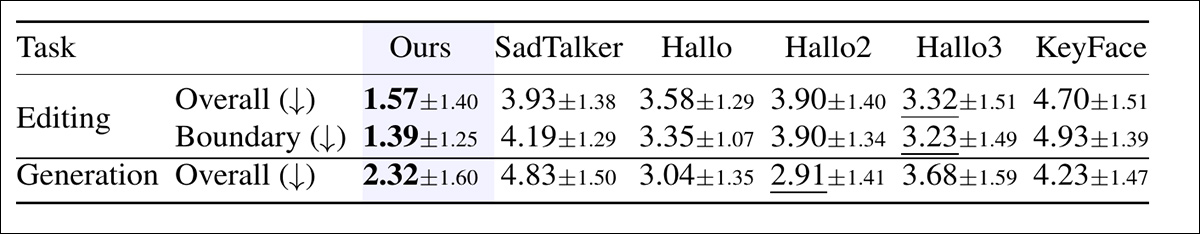

Videre ble en menneskestudie utført for å evaluere oppfattet kvalitet over både redigering og generering.

For hver sammenligning, så deltakerne seks videoer og rangerte dem etter generell kvalitet, med hensyn til leppesynk-nøyaktighet, naturalitet og realismen i hodebevegelse. I redigeringsforsøk, rangerte deltakerne også jevnheten i overganger mellom redigerte og uredigerte segmenter:

Gjennomsnittlige rangeringer tildelt av menneskelige evaluatorene, hvor lavere betyr bedre. I både redigering og generering, vurderte deltakerne hvor naturlig og godt synkronisert hver video så ut. For redigering, rangerte de også hvor jevn overgangen var mellom redigert og uredigert tale. Fet og underlinjet tall viser de to beste scorene.

I studien, ble FacEDiT konsekvent rangert høyest med et tydelig forsprang, både for redigeringskvalitet og overgangsjevnhet, og mottok også sterke poeng i genereringssettingen, noe som tyder på at dens målte fordeler oversettes til perseptuelt foretrukne utdata.

Pga. manglende plass, henviser vi leseren til kilde-papiret for ytterligere detaljer om ablasjonsstudier og andre tester som ble kjørt og rapportert i det nye arbeidet. I virkeligheten, sliter prototypiske forskningsbidrag av denne typen med å generere meningsfulle testresultater, ettersom selve kjernebidraget selv er uunngåelig en potensiell referanse for senere arbeid.

Konklusjon

Selv for slutning, kan systemer som dette kreve betydelige beregningsressurser under slutning, og gjøre det vanskelig for nedstrømsbrukere – her, antageligvis VFX-butikker – å holde arbeidet på egne premisser. Derfor vil tilnærminger som kan tilpasses realistiske lokale ressurser alltid være foretrukket av leverandører, som er under juridisk forpliktelse til å beskytte klients fotografi og generell IP.

Dette er ikke å kritisere det nye tilbudet, som kan fungere perfekt under kvantiserte vekter eller andre optimeringer, og som er det første tilbudet av denne typen som har trukket meg tilbake til denne forskningsavenyen på ganske lang tid.

Først publisert onsdag, 17. desember 202. Redigert 20.10 EET, samme dag, for ekstra plass i første tekst-avsnitt.