Andersons vinkel

Den ‘Survey Paper DDoS-angrep’ som overvelder vitenskapelig forskning

Generative AI-modeller som ChatGPT flomer akademiske publikasjonsplattformer med AI-genererte survey-papirer i et slikt omfang at signal-til-støy-forholdet blir kritisk. En ny studie hevder at denne flommen overvelder forskerne, forvrenger sitater og undergraver tillit til den vitenskapelige rekorden, og sammenligner strømmen av AI-assisterte papirer med en ‘DDoS-angrep’ på vitenskapen selv.

(Delvis) mening Forrige uke, for første gang på syv år med å holde meg oppdatert med den vitenskapelige litteraturen relatert til AI, måtte jeg innrømme nederlag og innse at, i alle fall på toppunktene, måtte jeg nå velge mellom å holde meg på toppen av nye publikasjoner eller ha noen tid igjen til å skrive om noen av dem.

Antall innførsler i en svært begrenset mengde relevante kategorier (Computer Vision, Machine Learning, Language Models, og noen få andre mindre abonnerte seksjoner) lå på betegnende over tusen – bare for en dags innførsler.

På et slikt volum, ville selv å skumme alle nye titler og bare av og til nyte noen av de abstrakte sammenfattningene, gjort for en uproduktiv dag.

Dette var tirsdag 7. oktober. I motsetning til dette, i Machine Learning-kategorien, tilbød denne tirsdagen (14. oktober) en publikasjonsvolum som var litt mindre intens enn de 400-odd innførslene for tirsdag i den foregående uken; den hadde en 354 innførsler:

354 innførsler for Machine Learning-kategorien på en dag. Kilde: https://arxiv.org/

Du måtte ha lest Arxiv hver dag, i noen år, for å innse hvor gale disse tallene blir.

Innrømmet, tirsdag er Arxivs ‘rush hour’ for innførsler, kanskje fordi det er den første arbeidsdagen som skjer utenfor noen lange helger som forskerne håper å nå; og Machine Learning-kategorien er en ‘catch-all’-seksjon med et lavere antall unike papirer (papirer som ikke samtidig publiseres i mer spesialiserte kanaler) enn de fleste andre kategoriene.

Likevel er økningen i papirinnsendelser allerede et notert fenomen i akademia og i media.

Kanskje det mest sjokkerende aspektet ved denne eskaleringen er hvordan alle andre tilstøtende kategorier er mer eller mindre uendret i deres frekvens over de siste tre årene, mens Computer Science-kategorien (se om du kan spore den i Arxivs offisielle tall nedenfor) er på en alvorlig oppadgående trajektorie:

Stigningen i computer science-papirer (CS) over de siste tre årene. Kilde: https://info.arxiv.org/about/reports/submission_category_by_year.html

Bare over tre år siden var Arxivs AI-papirinnsendelser estimert å doble seg hver få år; og det vil være interessant å lese Arxivs egen årlige sammendrag av trender ved slutten av 2025.

Volum på 11

De to mest åpenbare grunnene til at dette skjer er a) utenkelig finansiell forpliktelse til generativ AI tiltrekker massive mengder forskningsinvesteringer i private og akademiske sektorer, som ofte samarbeider; og b) det faktum at AI-språkmodell-systemer som ChatGPT nå gjør det nesten mulig å industrialisere prosessen med å sende inn forskningspapirer (inkludert papirer om AI).

Men kvaliteten på forskningsinnsendelser øker ikke i takt med volumet (selv om AI-utmatningens feilpregede utgang tenderer til å gjøre flere overskrifter i den juridiske sektoren enn den akademiske, ikke minst fordi konsekvensene er mer åpenbare der).

En nulltoleransepolitikk er vanskelig å implementere i dette tilfelle, selv om å gjenkjenne AI-generert innhold var enklere; foruten det faktum at AI i seg selv er en manifest fordel for vitenskapelig forskning generelt, har dens bruk i forskningspapirinnsendelser generelt* forbedret tydeligheten av arbeid fra mange ikke-engelske innsendere – personer og lag som har fungert med en ulempe til nå operert med en ulempe.

Men problemet med å senke språkbarrieren på denne måten er at det også øker det rene antallet globale innsendere, uten å øke nivået av menneskelig tilsyn som gir verdi til slikt arbeid.

Hvis nivået på innsendelser fortsetter å stige eksponentielt, vil signal-til-støy-forholdet bli så ustyrlig at bare AI selv kunne muligens navigere de nye flommene og sideelvene av AI-papirer; en oppgave som det ikke er bedre egnet til å gjøre enn å kontrollere sin egen utgang. Ironisk nok er vitenskapelig forskning en intensivt menneskelig bedrift.

Et angrep på forskning

Årsaken til denne refleksjonen er en interessant nytt samarbeid fra Kina med tittelen Stop DDoS-angrep på forskningsfellesskapet med AI-genererte survey-papirer.

Den nye stillingspapiren konsentrerer seg spesielt om survey-innsendelser – høyinnsats rundinger av bestemte tråder i forskning, som tradisjonelt både har listet og kontekstualisert, tolket trender og gjort informerte forutsigelser:

En brøkdel av den enorme og voksende mengden av survey-papirer tilgjengelig i seksjoner relatert til maskinlæring og AI, på arxiv.org

Siden survey-papirer kuraterer fremfor å opphav, er de usedvanlig lette å automatisere med AI, og forfatterne av det nye arbeidet karakteriserer spredningen av lav-innsats survey-papirer som en sikkerhetstrussel mot forskningssektoren†:

‘[Den] nylige økningen av AI-genererte survey-papirer, spesielt muliggjort av store språkmodeller (LLM), har omdannet denne tradisjonelt arbeidskrevende sjangeren til en lav-innsats, høy-volumutgang. Mens en slik automatisering senker inngangsbarrierer, introduserer den også en kritisk trussel: fenomenet vi betegner som “survey-papir DDoS-angrep” mot forskningsfellesskapet.

‘Dette viser til den ukontrollerte spredningen av overfladisk komplette, men ofte redundante, lavkvalitets- eller til og med hallusinerte survey-manuskripter, som flomer forhåndsutgivelsesplattformer, overvelder forskere og undergraver tillit til den vitenskapelige rekorden.

‘[Vi] argumenterer for at vi må stoppe å laste opp massive mengder AI-genererte survey-papirer (dvs. survey-papir DDoS-angrep) til forskningsfellesskapet, ved å etablere sterke normer for AI-assistert gjennomgangsskriving.’

Forfatterne hevder at denne uhemmede akselerasjonen av survey-produksjon truer med å oversvømme forskningsekosystemet med polerte rapporter som likevel mangler kritisk dybde, og som sannsynligvis vil spre faktiske feil og/eller hallusinerte sitater.

Papiret advarer mot at uten bedre regler eller tilsyn, kan AI-genererte survey-papirer bli til overflatiske kopier som misrepresenterer hvilke emner som er viktige, skjuler meningsfull analyse og gjør litteraturgjennomgang mindre pålitelig:

‘Konsekvensene for forskningskvalitet og tillit er dyptgående. Først risikerer ekte fremgang å bli skjult av algoritmer genererte gjentakelser av eksisterende arbeid.

‘Nykommerne og tverrfaglige forskere kan slite med å finne pålitelige oversikter midt i støyen. Dessuten kan feil eller fordommer introdusert av automatisert utkast spre seg ukontrollert, og sålede påfølgende forskning med feilaktige premisser.

‘Samlet sett, oversvømmelsen av ikke fagfellevurderte AI-genererte survey-papirer truer både rigor av litteraturgjennomgang og troverdigheten av den vitenskapelige rekorden.’

‘Abnormale’ forfattere

Forskerne bak det nye papiret presenterer noen interessante analyser på utviklingen av survey-innsendelser:

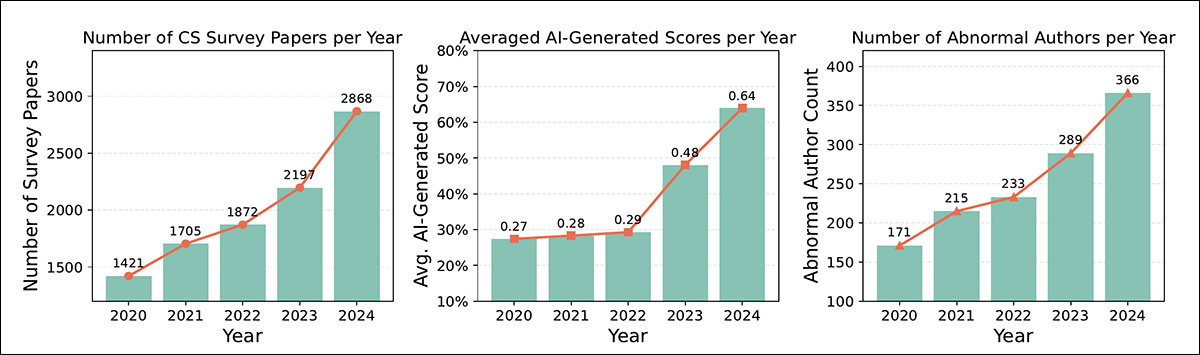

Venstre: den årlige tellingen av computer science-survey-papirer fra 2020 til 2024. Midten: gjennomsnittlige AI-genereringspoeng for disse papirene over samme periode. Høyre: antall forfattere som er merket som abnorme (de med usedvanlig høy survey-utgang, begrenset medforfatterdiversitet og gjentakende institusjonelle mønster) hvert år. Alle tre trender viser en skarp økning fra 2023, sammenfallende med lanseringen av ChatGPT og andre store språkmodeller.

I den første kolonnen ser vi veksttrender: kurven begynner å stige rundt 2022, nettopp når ChatGPT dukket opp og store språkmodeller begynte å bli mainstream, og oppfølgingsmodeller som Claude, PaLM og Gemini ville holde denne momentum gående gjennom 2023.

Den midterste grafen viser en skarp økning i innsendelser etter 2022, sammenfallende med lanseringen av ChatGPT. En forskergruppe fant at ved 2024, var over 10% av vitenskapelige abstrakter blitt kjørt gjennom en LLM. En separat rapport fra en AI-oppdager virksomhet satte hoppet etter ChatGPT til 72% for papirer på arXiv som kunne ha blitt skrevet med AI-hjelp. Antallet papirer med høye AI-genereringspoeng doblet også på ett år, fra 3,6% til 6,2%.

Den tredje, høyre grafen viser en jevn økning i antallet ‘abnorme’ forfattermønster (forskere som sender inn tre eller flere survey-papirer innen en måned mens de arbeider med færre enn to medforfattere), med en skarpere økning fra 2022.

Forfatterne hevder at mange av disse survey-papirene kan ha blitt skrevet av AI, av ulike årsaker; noen er skrevet av solo-forfattere eller små grupper som sender inn flere survey-papirer på kort tid; mange dekker urelaterte emner; og i noen tilfeller har forfatterne ingen tidligere rekord i feltene de summerer.

I tillegg er noen publisert under anonyme kollektiver uten klare institusjonelle bånd – mønster som antyder en koordinert flomming av feltet med rask survey, kanskje for å få sitater eller forbedre akademiske profiler, fremfor å bidra med noe reelt til litteraturen.

Problemer

Selv om vi ikke kan dekke alle kontroversene i det nye papiret, bør vi se på noen av de mest bemerkelsesverdige observasjonene, samt kaste et kritisk øye over forfatternes foreslåtte løsninger på disse problemene.

Kvalitet og originalitet

Problemet er ikke bare volum: mange AI-skrevne survey-papirer hopper over hva som gjør en god survey nyttig: tydelig struktur, dypt analyse, riktig og omhyggelig kreditering og ekte innsikt. I stedet foreslår papiret at AI-genererte/assisterte survey-papirer ofte ligner sammenføyde sammenfatninger, uten noen av de nødvendige omsorg eller kurasjon.

Forfatterne observerer videre at AI-skrevne survey-papirer ofte mangler struktur, men i stedet bare lister papirer uten tydelig retning, hopper over nøkkelavsnitt og klarer ikke å skape kontekst. Menneskeskrevne survey-papirer, på den andre siden, tenderer til å etablere korrekte kategorier og fortelle en mer sammentrekkelig historie.

Også mange potensielt AI-assisterte survey-papirer ser ut til å bare kopiere eksisterende emneoppdelinger, noen ganger rett fra Wikipedia. For eksempel bemerker papiret at flere survey-papirer om Vision Transformers inneholder felles seksjonsoverskrifter og struktur, som avslører mal-basert AI-utgang:

‘I motsetning til dette kan en godt skrevet menneskeskrevet survey-papir introdusere en ny taksonomi, f.eks. kategorisere ViT etter effisiensstrategier. Mangel på en slik original struktur i mange nylige survey-forhåndsutgivelser våker bekymring for at de kan ha blitt generert av AI med begrenset menneskelig innsikt.’

Citater

Kanskje det mest offentlig pinlige er at AI-skrevne survey-papirer ofte får sitater feil, mangler nøkkelartikler, inkluderer ikke-relevante artikler og noen ganger sogar eksisterende artikler – feil som antyder at referansene stammer fra overfladisk mønsteravkjenning, fremfor ekte ekspertise.

Forfatterne peker også på at noen nylige survey-papirer, ofte fra helt forskjellige lag, deler så mye som 70% av sine referanselister – et nivå av overlap som er så høyt at det hinte om en felles avhengighet av LLM, som trekker fra samme smale kildebasen.

Dette er faktisk noe som casual brukere av ChatGPT vil kjenne igjen: jo mer obskure emnet er, jo færre diverse kilder er det for modellen å ha generalisert; veldig ofte er å finne modellens egne begrensede kilder på nettet mer nyttig enn å prøve å samhandle med denne informasjonen via en AI som ikke hadde adekvat data i et bestemt domene.

En ‘homogen’ stil

Forfatterne bemerker også at mange AI-skrevne survey-papirer på samme emne ser og hører nesten identiske ut, da LLM gjenbruker frasering og struktur, spesielt for populære emner, noe som resulterer i en strøm av nesten identiske papirer som tilfører lite verdi og også tilfører betydelig støy til forskere som søker etter domene-svar*:

‘Når flere forfattere ber en LLM om å “skrive en litteraturgjennomgang på X,” produserer modellen ofte svært like svar, spesielt for vanlige definisjoner eller velkjente fakta. Nylig forskning har vist en skarp økning i bruken av bestemte skriverimønster knyttet til LLM, noe som antyder at mange papirer nå deler samme stil.’

Din ChatGPT vises

Papiret observerer at en rask måte å spore AI-skrevne survey-papirer er gjennom tilstedeværelsen av fraser som ‘som en AI-språkmodell’ eller ‘min kunnskapskutt‘, noe som antyder minimal eller til og med ingen kurasjon av utgangen fra språkmodellene før papirene ble sendt inn (selv om en målrettet søk på skrivetid ikke avslørte noen slike tegn i Google-søk).

Papiret bemerker at mange ‘mistenkte’ survey-papirer viser lavere orddiversitet og gjentakende frasering, for eksempel ved å starte flere avsnitt med Fortsatt. Dette mønsteret, foreslår forfatterne, er typisk for GPT-lignende skriving, og kunne være et nyttig flagg for å oppdage auto-generert tekst.

(Min personlige kommentar på dette er at struktureringen av nettjournalistikk ofte krever at en forfatter lister opp mange punkter i en prosa-basert, ikke-stilform; derfor er ChatGPT og dens like sannsynligvis å ha lært denne dårlige vanen fra menneskelige forfattere som ble møtt med en begrenset mengde leksikalske alternativer. I tillegg viser forfatternes konjektur at de dabbler i grunnleggende prinsipper for AI-innholdsgjenkjenning, som er et komplekst og utviklende felt med få varige konstanter av den type som forfatterne foreslår)

Selv om forskerne går videre med å utvikle en fascinerende diskurs om den negative innvirkningen av AI-survey-papirer på forskningskultur og tillit, må vi henvisende leseren til kilde-papiret for større dybde på dette.

Løsninger?

Papirets løsning er fascinerende, radikal og samtidig underlig uoriginal: at nyttien av survey-papirer bør erstattes av en Dynamisk Live Survey – ved tolkning, en slags hybrid mellom en Wiki og en GitHub-side, konstant født med ny data fra LLM og andre AI-systemer, men med commits som bare gjøres av mennesker, så AI ikke kan essensielt ‘auto-publisere’ oppdateringer.

Det foreslåtte systemet ville dele versjonering og branching av GitHub, essensielt omdanne en informasjonsressurs til en konstant oppdaterende liste lignende ‘awesome’-typen kurerte lister på GitHub:

‘Under dette rammeverket etablerer en fellesskapsmedlem først en survey-tema-wiki ved å spesifisere omfanget, nøkkel-forskningsspørsmål og seminale referanser, som deretter setter en tydelig tematisk grense og initial struktur.

‘Deretter overvåker en LLM-basert innsugningsagent kontinuerlig forhåndsutgivelsesarkiv, konferanseprosedyrer og benchmark-ledertavler. Den trekker automatisk ut abstrakter, figurer og nøkkel-ytelsesmetrikker; syntetiserer konsise sammenfatninger av nye resultater; oppdaterer sitatgraf til å reflektere inter-papir-relasjoner; og flagger fremvoksende forskningstrender for videre gjennomgang.

‘Ved design, skjer disse automatiske oppdateringene innen få timer etter publikasjon, og sikrer at repositoriet forblir på forkant.’

‘Menneskelige bidragsytere trer deretter inn for å gi den tolkende dybden som maskiner alene ikke kan tilby. De finjusterer utviklende taksonomier for å fange subtile metodiske distinksjoner, koordinerer motstridende tolkninger av algoritmer innen ulike underfelt, og gir dypere kritiske sammenligninger av dokumentet.’

Boken om endringer

Forfatterne utdyper entusiastisk og i detalj dette forslaget, og rettferdiggjør det i hovedsak med noe som er svært sant: høyinnsats menneskeskrevne survey-papirer om flyktige emner rundt AI aldrer så raskt at de knapt er verdt å skrive; og papiret bemerker at en tre-måneders omgang på et nytt survey-papir sannsynligvis vil bety at det vil være foreldet (eller alvorlig foreldet) ved tidspunktet for planlagt publikasjon:

‘Året etter år blir fellesskapene flomet med repetitive eller overflatiske oversikter som raskt mister relevans, og etterlater praktikere og nykommer like å slite med å skille signal fra støy. Den tradisjonelle publikasjonscyklen (dvs. utkast, send inn, gjennomgang og publisere) kan vare flere måneder, og på det tidspunktet kan kritiske gjennombrudd allerede ha endret landskapet.

‘Dessuten bidrar den økende mengden av statiske survey-papirer til kognitivt overbelastning, ettersom lesere må gjennomse flere overlappende dokumenter for å finne substansielle innsikter.’

Uheldigvis deler papirets løsning mange av de verste og mest kritiserte kvalitetene til Discord: mest av alt at det ville være en konstant skiftende og endrende ressurs.

Ettersom noen deler av en Dynamisk Live Survey kan forsvinne eller bli endret når som helst, ville det være umulig å bruke det som en sitert, stabil kilde; unntatt kanskje ved å lenke til en ‘tidligere commit’, på samme måte som archive.is og Wayback Machine, blant andre arkivsider, tilbyr lenkbare øyeblikksbilder av innhold, frozen på et bestemt tidspunkt. Men hva slags ressurser ville en slik commit trenge, og kunne den stole på å forbli aktiv over tid?

I tillegg ville en plattform/Wiki med konstant endrende definisjoner og innhold være utfordrende å indeksere, enten av tradisjonelle søkemotorer eller LLM.

Kanskje det svakeste punktet i det foreslåtte systemet er ideen om at ekte mennesker bør overvåke commits fra LLM-agenter; som alltid er ekte mennesker dyre. Hva som foreslås, er noe mellom et museum og et bibliotek – begge vil trenge kjøtt- og blod-besetning proportionert med datamengden og antall emner dekket.

Hvis ‘bruk ekte mennesker‘ er det eneste svaret på et AI-utviklingsproblem, er det rettferdig å si at problemet forblir åpent og uløst.

Konklusjon

For øyeblikket er den korte holdbarheten av survey-papirer om AI irriterende; hvis den nåværende trenden mot høy-skala automatisert skriving og innsending fortsetter, som avbildet i det nye papiret, vil signal-til-støy-forholdet bli kronisk, og litteraturen ustyrlig.

I en slik situasjon ville det være enda vanskeligere enn det er nå for mindre, sub-FAANG-stemmer å bli hørt i stormen av innsendelser, og store markedsledere ville sannsynligvis få enda større fremtreden.

Foruten live-survey, foreslår det nye papiret at forfattere ikke bare bør begrenses til å erklære når AI brukes i noen del av en innsending, men også at AI-assisterte avsnitt bør være eksplisitt merket innenfor en papir (kanskje med en side-JSON-fil…?).

Ettersom dette er et tungt prospekt, foreslår papiret alternativt hva jeg bare kan karakterisere som en ‘AI-getto’ – en distinkt seksjon i innsendingen som er satt avsides for AI-bidrag.

Kort sagt, det nye arbeidet har, i alle fall i min mening, ingen realistiske løsninger å tilby; men forfatterne har utført en nyttig tjeneste i å ramme ut utfordringene fremover.

Papiret Stop DDoS-angrep på forskningsfellesskapet med AI-genererte survey-papirer kan finnes på https://arxiv.org/abs/2510.09686, og er skrevet av seks forfattere på avdelinger ved Shanghai Jiao Tong University.

___________________________________

* Ikke alle føler at dette er tilfelle.

†Forfatterens betoning, ikke min. Og, hvor aktuelt, min konvertering av forfatterens inline-citater til hyperlenker.

Først publisert fredag, 17. oktober 2025