Andersons vinkel

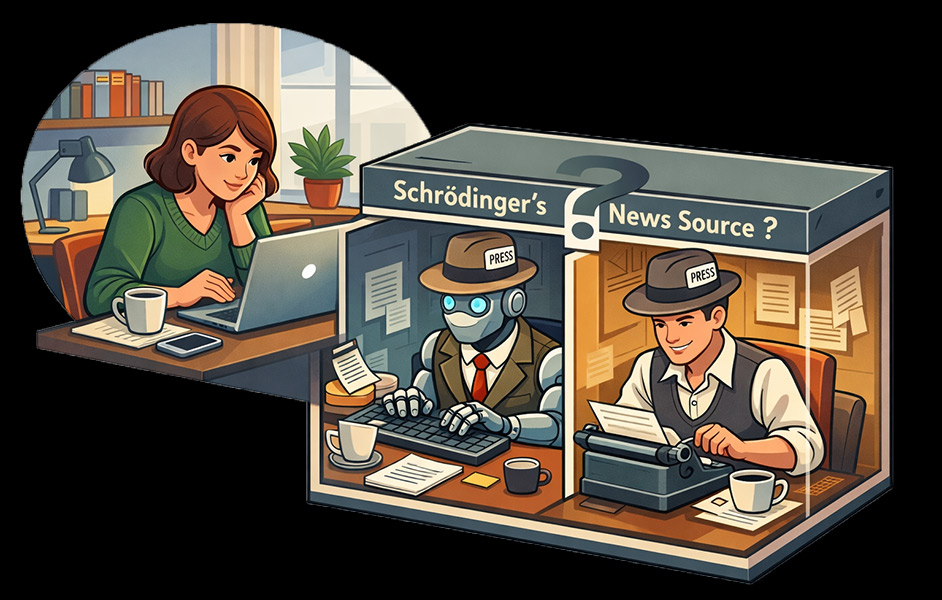

Even Basic AI Can Now Write News That Passes as Human

Nye forskning indikerer at selv små lokale AI-modeller nå kan skrive nyheter som mennesker ikke kan skille fra ekte journalistikk, og matcher toppsystemer, og etterlater lesere uten å kunne si hvem som skrev hva.

Ifølge en ny forskningssamarbeid mellom Tyskland og Frankrike, kan mennesker ikke si om en nyhetsartikkel er skrevet av AI eller en menneske – selv når det er skrevet av åpne kildekodemodeller som kan lastes ned og kjøres på relativt gjennomsnittlige forbruker-nivå datamaskiner.

I en annen indikasjon på at liten AI er på fremmarsj, viste en undersøkelse av 2 318 dommer fra 1 054 deltakere i et dedikert akademisk studieportal at menneskelige lesere ikke kunne identifisere opphavet til en artikkel på et høyere nivå enn tilfeldighet, selv når det var utgangspunkt for relativt beskjedne modeller med så få som syv milliarder parametre, inkludert Mistral og Llama-varianter:

Gjennomsnittlig kilde- og autentisitetspoeng for LLM-tester. GPT-4o sine 200 milliarder parametre overstiger ikke massivt de 7 milliarder parameterne til mindre modeller. De testede modellene var Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o og GPT-3.5. Kilde

Forfatterne returnerer til et emne som de først undersøkte i 2024 utgivelse Blessing or curse? A survey on the Impact of Generative AI on Fake News. Funnet selv er nyutgitt resultater fra et større prosjekt som først ble announcert i januar, og gjør bruk av forfatternes eget JudgeGPT-nettbasert deltakende rammeverk.

Lettvint makt

Tittelen Can Humans Tell? A Dual-Axis Study of Human Perception of LLM-Generated News, og kommer fra tre forskere på Frankfurt University of Applied Sciences og IRISA-forskningsenheten i Nantes, den nye studien sin metode gjør en viktig forskjell mellom ‘falske nyheter’ og ‘AI-skrevne nyheter’ (siden falske nyheter kan være skrevet av mennesker eller av AI, og de to aspektene er ikke nødvendigvis synonyme).

Imidlertid er kanskje det mest interessante aspektet papirets konklusjon at små modeller, inkludert Mistral 7B og Gemma 7B, kan, med bare syv milliarder parametre, matche mot de større modellene som ChatGPT-modellen (4o) med 200 milliarder parametre:

‘Åpne vektmodeller med så få som 7 milliarder parametre produserer tekst som blir vurdert likt som GPT-4o-utgang, og indikerer at evnen til å generere menneske-umulig å skille tekst ikke lenger er begrenset til de største modellene.’

Imidlertid kan ‘AI-generert nyheter’ representere mange forskjellige typer menneske-AI-samarbeid, fra stavekontroll til fullstendig karriere-avgjørende innsats, og studien gjør det ikke klart hva slags AI-innhold som ble produsert for testene (selv om den beskriver metoden for å produsere det – se under).

Metode

For deltakerne som var engasjert i JudgeGPT-plattformen, ble hver nyhetsfragment vurdert ved hjelp av en dobbel akse-rammeverk hvor de ga tre uavhengige vurderinger på kontinuerlige 0-100 skalaer:

JudgeGPT-portalen GUI, hvor vurdererne vurderer materiale basert på kildeattribuering; autentisitet; og emnebeklagelse. Se kildepaperet for bedre oppløsning.

Kildevurdering fanget om en passasje syntes maskin-skrevet eller menneske-skrevet; autentisitetsvurdering, om det ble oppfattet som falskt eller legitimt; og emnebeklagelse, hvor godt leseren kjente emnet.

Kontinuerlige skalaer ble brukt i stedet for en Likert-skala, for å fange gradene av sikkerhet mer nøyaktig, og for å støtte statistisk analyse, inkludert Pearson-korrelasjon og klustering.

Maskin-generert tekst-fragmenter ble produsert av forfatternes eget RogueGPT-rammeverk, som er innmatingsarkitekturen for JudgeGPT. RogueGPT orkestrerer bidrag fra seks store språkmodeller (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; og Mistral 7B.

Persona-basert prompting ble brukt til å generere tekstene, og AI-genereringene var basert på faktiske nyhetsemner, og ble faktakontrollert av mennesker.

Omvisst, menneske-skrevne fragmenter ble samplet fra ‘etablerte nyhetskilder’ og uspesifiserte ‘informasjonsdatabaser’.