Andersons vinkel

AI-generert skriving blir aldri ‘trøtt’, og avslører seg selv

ChatGPT-liknende AI avslører seg selv ved å øke i konsistens, mens menneskelig skriving forblir ustabil gjennom hele teksten.

Den begrensede kontekstvindu for de fleste forbrukerrettede store språkmodeller (LLM) er en av faktorene som kan gjøre at de glemmer eller husker feil tidligere deler av brukerens samtaler – feil i gjennkalling som kan gradvis gjøre utgangen til totalt nonsens – eller, verre, bedragersk koherent-utseende tekst som inneholder subtile feil.

Siden disse omstendighetene fører til hallusinasjoner, og siden hallusinasjoner fortsatt er det største hindret for AIens totale markedsgang, har mye forskningsinnsats blitt brukt på å skape generative AI-systemer som kan lage lengre, men mer konsistente tekststykker.

I virkeligheten er så mye fremgang blitt gjort at gjenkjennelse av langform AI-innhold (dvs. innhold som er rent generert av AI, med – antageligvis – minimal eller ingen menneskelig etterbehandling) anses å være en voksende problem.

Busting en AI-filibuster

Likevel hevder nyere empiriske studier at jo mer output AI-tekstgeneratorer produserer i ett slag, jo enklere er det å bestemme om teksten var skrevet av en menneske; men den aksepterte visdommen i forhold til denne deteksjons-‘ankre’ har antatt at AI kan skilles fra menneskelig skriving fordi uansett hva det gjør annerledes enn mennesker, får det en sjanse til å gjøre mer ofte i lengre tekststykker.

Ingen antagelser gjøres om fordelingen av disse ‘avsløringer’ i teksten selv.

For å utfordre dette, og utvide problemstillingen, tilbyr en interessant ny forskningsstudie fra Kina en ny metode for å skille den nye generasjonen av langform AI-innholdsgenerering fra ekte menneskelige forfattere. Forskerne bak arbeidet hevder at token-på-token-naturen som AI-tekst genereres med, gjør at den blir mer konsistent med økende lengde, mens menneskers egne eksentrisiteter ikke avtar med lengde.

På denne måten foreslår forfatterne at deres innsikt tilbyr en potensiell ny målestokk for AI-tekstdeteksjonssystemer*:

‘AI-genererte token i den senere delen av teksten viser mindre og mer stabil sannsynlighetsfluktuasjon når modellens prediksjoner blir mer konsistente som kontekst akkumuleres.

‘Vi betegner dette mønsteret Sen-fase Volatilitetsnedgang. Dette fenomenet reflekterer den innebygde atferden til autoregressiv generering: når mer kontekst blir tilgjengelig, skjerper modellens prediksjonsfordeling, noe som fører til redusert variasjon i token-nivå-statistikk.

‘Menneskelig skriving, på den andre siden, fortsetter å introdusere uventede leksikalske valg og opprettholder høyere volatilitet gjennom hele teksten.’

For å fange denne underlige ‘glattheten’ som akkumulerer i AI-tekst mot slutten, definerer forskerne to enkle egenskaper: den første måler hvor mye skrivings statistiske atferd ‘hopper rundt’ mellom token; den andre sjekker hvor stabil ting forblir over korte strekninger av tekst.

Begge beregnes kun fra den andre halvdelen av utgangen, der AI blir merkbart mer regulær og menneskelig skriving ikke er. Forfatterne påpeker at mens disse signalene fungerer godt på egen hånd, er de enda mer effektive når de kombineres med eldre deteksjonsmetoder som skanner etter bredere mønster. De påpeker også at denne tilnærmingen fungerer best på lengre tekster, der kontrasten kan bli mer tydelig.

Den nye artikkelen tilbyr en metode for å teste ‘AI-aktig’ via andre-halvdel temporær analyse, som ikke krever noen ekstra trening eller finjustering, eller privilegert modelltilgang.

Den nye studien heter Når AI setter seg ned: Sen-fase-stabilitet som en signatur for AI-generert tekstdeteksjon, og kommer fra fire forfattere ved Westlake University i Hangzhou.

Metode

For å fange den økende glattheten i AI-generert tekst, designet forskerne to målinger som fokuserer kun på den andre halvdelen av en passage. Disse målinger er basert på log-sannsynlighetspoeng fra en standard språkmodell og krever ingen finjustering, om-trening eller ekstra prøver:

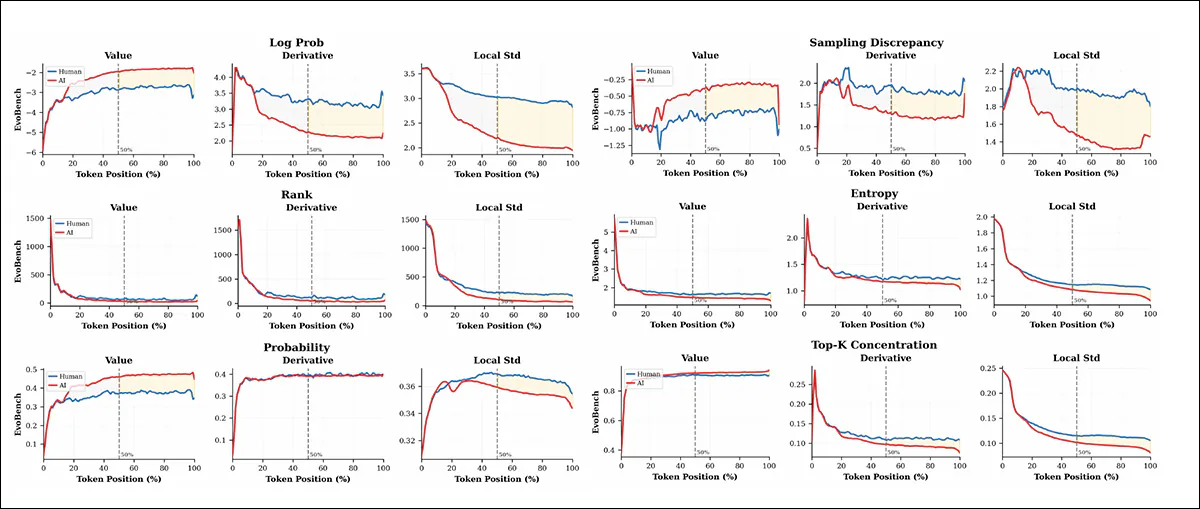

Fra den nye studien – hver rad viser atferden til en base-målestokk fra EvoBench over token-sekvensen: råverdi (venstre), absolutt derivat (midten) og lokal standardavvik (høyre). Menneskelig og AI-linjer er vist i blått og rødt. De fleste avvikene vises i den andre halvdelen av teksten, særlig for Log-sannsynlighet og Sampling-feil, som viser økende separasjon og glattere AI-utgang. Entropi og Top-K-konsentrasjon viser liten endring over tid. Kilde

Den første målingen, kalt Derivat-dispersjon (DD), sporer hvor skarpt modellens tillit endrer seg fra ett ord til det neste. AI-tekst tenderer å slutte seg til en rytme, så disse endringene blir mindre og mer forutsigbare i den andre halvdelen. I motsetning til dette forblir menneskelig skriving ‘uettet’.

Den andre målingen, Lokal volatilitet (LV), ser på hvor mye modellens tillit ‘hopper rundt’ innenfor et lite vindu av tekst. Igjen tenderer AI å bli mer stabil over tid, mens menneskelige valg forblir mer overraskende og mindre konsistente:

AI-tekst blir glattere etter hvert, mens menneskelig skriving forblir ujevn. Disse grafene sporer hvordan modellens tillit skifter over løpet av en passage, og reflekterer både skarpheten av endring mellom påfølgende ord og mengden variasjon innen lokale strekninger av tekst. I begge henseender er nedgangen mye brattere i maskin-generert utgang, med kontrasten som blir mer tydelig etter midtpunktet. De gule boksene fremhever denne økende gapet i den andre halvdelen, der AI-skriving når opp til 32% større stabilitet enn menneskelig skriving.

Igjen beregnes begge målinger kun fra den andre halvdelen av teksten, der forskjellen mellom menneskelig og maskin-skriving er mest tydelig. Disse målinger er deretter inkorporert i en enkelt verdi kalt Temporær Stabilitetsdeteksjon (TSD) -score – som er utsatt for å øke når skrivingen blir ‘glattere’ (og derfor mer sannsynlig å være AI-generert). En enkel terskelverdi brukes deretter til å bestemme om en gitt passage sannsynligvis er skrevet av en maskin.

Fordi disse egenskapene fokuserer på når et mønster oppstår, snarere enn bare hva mønsteret ser ut som, er de komplementert av eldre metoder som søker etter statistiske anomalier over hele passasjen. Ved å legge TSD-scoren til utgangen av Fast-DetectGPT (også i samarbeid med Westlake) tilbys en ytterligere forbedring av resultater (spesielt for langform-innhold der den sene-fase-glattningseffekten er sterkest).

Data og tester

Forfatterne utførte tester på to relaterte benchmark-datasett: EvoBench inneholder 32 000 menneskelig/AI-tekstpar generert over syv modellfamilier, inkludert GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; og Qwen, med totalt 29 modellversjoner presentert.

Det andre rammeverket var MAGE, som tilbyr 30 000 testpar over åtte modellfamilier, inkludert (men ikke begrenset til) GPT-serien fra OpenAI, og LLaMA-, OPT– og FLAN-T5-familiene.

Konkurrenter

Den nye metoden ble testet mot en rekke null-skudd-detektorer som bruker samme surrogatmodell. Sannsynlighet, Entropi, Rang og Log-Rang (DetectGPT) målte token-nivå-statistikk over hele passasjen; LLR (DetectLLM) anvendte normalisering for å tillate direkte sammenligning over modeller; og Fast-Detect estimerte lokal krumning gjennom sampling-basert perturbasjon.

Lastde analyserte diskriminerende subsekvenser i sannsynlighets-signalet, mens FourierGPT opererte i frekvensdomenet. Diveye fanget skift i ‘overraskelses’-mangfold over sekvensen.

Til slutt UCE evaluerte usikkerhetsprofilen til token-prediksjoner, for å identifisere unaturlige tillitsmønster.

Implementering og resultater

Alle deteksjonsmetodene ble kjørt ved å bruke Llama-3-8B-Instruct som en felles surrogatmodell, med inndata-sekvenser begrenset til 512 token. Temporære egenskaper ble ekstrahert kun fra den andre halvdelen av hver passage, ved å bruke et glidende vindu på 20 token for å måle volatilitet. En fusjonert versjon av metoden, kalt TSD+, kombinerte det foreslåtte signalet med Fast-DetectGPT.

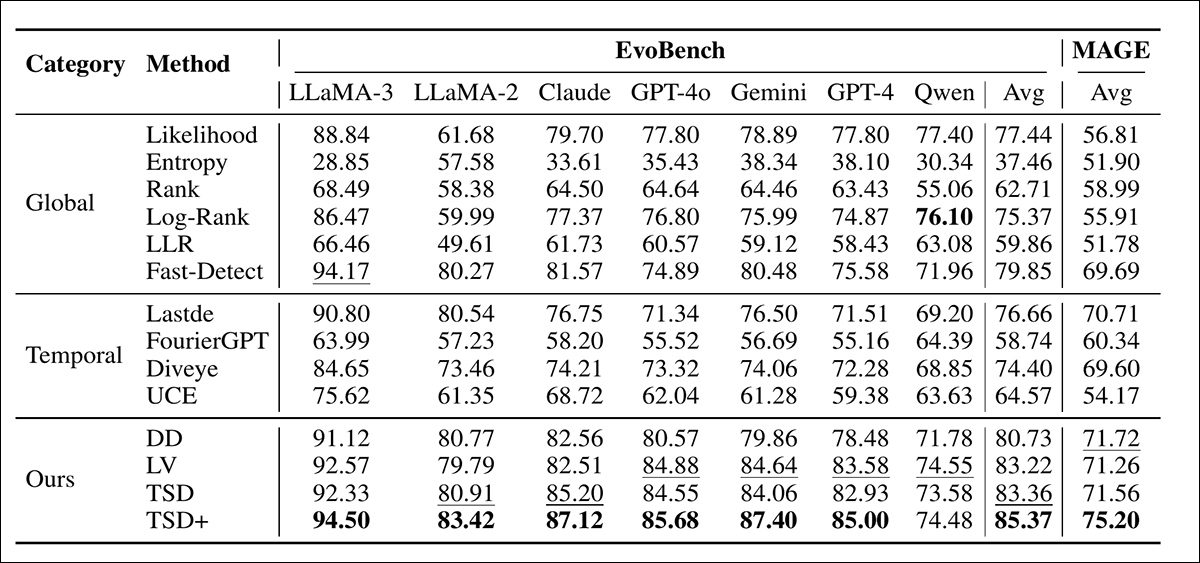

Område Under Mottaker Operasjon Kurve (AUROC) var den primære evaluering-målestokken†:

Diversert ytelse blant de ulike testede metodene mot AI-generert tekst. Detekteringsnøyaktighet vises over to benchmark-datasett: EvoBench, som dekker flere høyprofilerte LLM-er, og MAGE, et komplementært datasett. Målestokkene er gruppert etter metode-type: globale statistikker, temporære egenskaper og foreslåtte varianter. Gjennomsnittlige AUROC-poeng er gitt i de siste kolonnene. Resultatene fra forfatternes metodevarianter overstiger konsekvent tidligere baseline, med TSD+ som gir de høyeste poengene i nesten alle modell-innstillingene.

Av disse initielle resultater sier forfatterne:

‘Våre enkle temporære egenskaper oppnår state-of-the-art-ytelse blant selvstendige metoder, med TSD som oppnår 83,36% på EvoBench og 71,56% på MAGE, og overstiger alle baseline, inkludert Fast-DetectGPT.

‘Dette er bemerkelsesverdig gitt vår metodes enkelhet: vi beregner kun andre-ordens statistikk fra den andre halvdelen av sekvensene, uten perturbasjons-sampling eller frekvens-domene-transformasjoner.’

Den nye metoden fungerte spesielt godt på nyere AI-modeller som GPT-4 og GPT-4o, og identifiserte AI-skrevet tekst mer nøyaktig enn den nærmeste ledende detektoren, med en ytelsesforskjell på opptil 9,66%. Selv om nyere avanserte modeller produserer mindre åpenbart ‘konsistent’ tekst, som skjuler noen tegn på automatisering, er visse subtile tidsmønster likevel tydelig nær slutten.

Konkurrerende tilnærminger som fokuserer på brede struktur-egenskaper mislyktes i å fange disse sene-fase-mønstrene. Ved å integrere en global detektor, synes det hybrid-systemet å gjenopprette disse missede signalene, og forbedrer ytelsen, spesielt på benchmark-datasett der kortere AI-utgang kan svekke temporære signaler.

Konklusjon

En aspekt som ikke direkte er behandlet i den nye studien er tendensen hos menneskelige forfattere til å iterere sitt arbeid gjennom utkast og ulike lag med tilsyn – noen ganger inkludert ekstern tilsyn, som innputt fra redaktører og korrekturlesere, samt mulige foreslåtte endringer fra juridiske avdelinger, avhengig av konteksten.

De multiple interessentene involvert i dokumenter så enkle som en godt begravd avisartikkel kan alle sammen utradere de eksentrisitetene som den nye foreslåtte systemet er nøkkel på, og i virkeligheten utgjør en slags ‘analog versjon’ av en AI-assistert utkast-prosess.

En ytterligere og kontrasterende overveielse er at tekst-innhold som flere mennesker har bidratt til, også kan være blant de mest fragmenterte, feilfulle og repetitive prosastykker som går inn i en datasett, siden de ofte ikke har hatt fordelen av en sluttfellende forenende stemme, og etterlater den stykkevis utviklingen tydelig i prosa.

* Forfatternes original tekst-styling gjengitt fra papiret; ikke min vektlegging.

† Forfatterne sier ‘primær’, mens de lister ingen andre evaluering-målestokker.

Først publisert mandag, 26. januar 2026