Andersons vinkel

Å takle AI’s gasslysingsproblem

AI-video modeller kan bli talt ut av sannheten. Selv etter å ha sett det riktige svaret, gir de etter for selvbevisste brukere, omskriver virkeligheten og oppfinner feilaktige forklaringer for å rettferdiggjøre det.

AI er galt nok, ofte nok, til å begrense oss til å spørre om dens konklusjoner, hvis vi føler at konklusjonene kan være feil.

Problemet er, hvis vi visste noe annet fra begynnelsen, hvorfor spurte vi i det første sted? For bekreftelse av en delvis holdt tro eller mistanke?

Hvis så, er den nåværende tilstanden av kunst i Large Language Models (LLMs) og Vision Language Models (VLMs, som opererer multimodalt, aksepterer og genererer bilder og/eller videoer) ikke godt egnet til å holde stand, på grunn av problemet med sycophancy.

Derfor, hvis vi ikke liker svaret vi får, og begynner å engasjere i en disputt om det med modellen, er AI sannsynligvis å enten retrench feilaktig (antagende det var feil) heller enn å re-evaluere, eller å la seg bli gasslysning til å støtte våre forslag – selv om vi er feil.

Du har absolutt rett!

Praksisen med at en menneske får en AI til å endre sin mening gjennom konflikt har blitt navngitt ‘Gaslighting Negation Attack’, og blir noen ganger karakterisert som et sikkerhetsproblem – ikke minst fordi det har noen potensiale til å ‘jailbreak’ en modell ut av dens operative begrensninger:

Fra 2025-papiret ‘Benchmarking Gaslighting Negation Attacks Against Multimodal Large Language Models”, svarer GPT-5 først riktig, men gir så etter for brukertrykk, flipper svaret og oppfinner feilaktige forklaringer for å støtte feilen, effektivt gasslysning seg selv. Kilde

Men hacking og pen-testing er ikke det virkelige problemet her; snarere er det vanlig bruk og forventede normer for diskurs i våre daglige interaksjoner med AI, der vi forventer å kunne argumentere, og å enten vinne, gi etter eller la saken bli uavklart, i samsvar med vår menneskebaserte erfaring av å tilegne seg kunnskap.

Men denne sosiale modellen for konfliktløsning er ikke virkelig tatt med i arkitekturen til diffusjonsbasert AI, som må forhandle distribusjonsbasert sannsynlighet kastet opp av dens treningsdata; de muligens motsigende (men potensielt mer nøyaktige) data fra RAG-oppkall til kilder som overstiger dens kunnskapsavkortedato, eller generell forståelse av hva som kan være et obskurt emne; og innputt fra brukeren, som kan ha: overlegen kunnskap om emnet; en fullstendig feilaktig eller bedragerisk synspunkt; eller selv en enkel følgespørsmål – men hvis behov likevel må bli vurdert.

Bevegelige mål

Sårbarhet for gasslysning har blitt notert i LLMs i flere papirer, inkludert en Singapore-ledet publikasjon fra oktober 2025, og samme års papir Don’t Deceive Me: Mitigating Gaslighting through Attention Reallocation in LMMs.

Inntil nå, har fenomenet ikke blitt studert i video-kapable LLMs – en oversikt som blir adressert av en ny samarbeid mellom institusjoner i Shanghai og Singapore.

Den nye arbeidet – tittelen Spatiotemporal Sycophancy: Negation-Based Gaslighting in Video Large Language Models, som kommer fra seks forskere over Fudan University, Shanghai Key Laboratory of Multimodal Embodied AI, og Singapore Management University – adresserer flere åpne kilde- og proprietære VLMs, og finner at de ikke bare kan være like sårbare for gasslysning som LLMs, men også er i stand til å augmentere sine flukt av fantasier med åpenbar visuell bevis, eller reviderte og feilaktige tolkninger av bilder eller videoer:

Et eksempel på spatial (i motsetning til temporal) sycophancy, der AI lar seg bli gasslysning til feilaktige antagelser og tolkninger, selv omkring klart synlige fakta. Kilde

Forfatterne statte:

‘[Vi] identifiserer spatiotemporal sycophancy, en feilmodus der Vid-LLMs trekker tilbake først riktige, visuelt grunnlagt dommer og konformer til misvisende brukerfeedback under negasjon-basert gasslysning.

‘I stedet for bare å endre sine svar, fabrikerer modellene ofte usupportede temporale eller romlige forklaringer for å rettferdiggjøre feilaktige revisjoner.’

Temporal sycophancy utvider potensialet for gasslysning til temporale hendelser som skjer på bestemte punkter i en video.

Forfatterne har produsert et nytt evalueringssystem kalt Gas Video-1000, ment å undersøke spatiotemporal sycophancy gjennom resonnering, og med visuell grunn, og utgir den kurerte samlingen via GitHub og Hugging Face.

Papiret konkluderer at nåværende LLMs mangler pålitelige mekanismer for å motstå gasslysning av denne typen, selv om prompt-nivå grunnlegging kan ha en begrenset mitigeringseffekt:

‘Omfattende eksperimenter avslører at sårbarhet for negasjon-basert gasslysning er utbredt og alvorlig, selv blant modeller med sterk baseline-ytelse.

‘Selv om prompt-nivå grunnlegging kan delvis mitigere dette atferden, gjør de det ikke pålitelig for å forhindre hallucinerte forklaringer eller troendring.’

Metode

Forfatterne karakteriserer en video-modell som noe som ser på en klipp, svarer på et spørsmål om det, og bør holde fast ved svaret hvis bevisene er klare. Problemet starter når en andre melding presser tilbake, og hevder at svaret er feil – effektivt plantet en feil ide, og nøyter modellen til å endre sin mening.

Sycophancy, hevder forfatterne, er definert som å få det riktige svaret først, så bytte til et feilaktig ett etter press, selv om ingenting i videoen har endret seg. Den nye forskningen sporer hvor ofte disse ‘flippene’ skjer, og bruker det som et mål på hvor lett modellen kan bli talt ut av hva den faktisk så.

GasVideo-1000-datasettet, utviklet av forfatterne for evaluering av gasslysning i VLMs, inneholder 1 013 eksempler fra en rekke eksisterende datasett:

Modeller testes på video-oppdrag som krever temporale og romlige forståelser, så gitt misvisende følge-opp-prompter som benekter det riktige svaret, appellerer til autoritet, eller anvender emosjonell press. Dette fører ofte til at modellen forlater sitt grunnlagt svar og produserer et selvbevisst, men feilaktig, forklaring.

For samlingen brukte forfatterne VideoMME og MVBench, som dekker bred multimodal resonnering; NExT-QA og Perception Test, som tester kausale og temporale logikk; EgoSchema, som fokuserer på langform-egosentrisk video; og ActivityNet-QA og MSRVTT-QA, som måler generell virkelighetsbasert spørsmål-svar.

For å utløse feil, ble misvisende følge-opp-prompter konstruert i tre former: Direct Denial (flatly assertende en feilaktig alternativ); Authority Appeal (invokerende en ekspert for å avvise modellens svar); og Emotional Pressure (brukende frustrasjon eller tvil).

Disse promptene ble designet for å presse de testede modellene til å forlate riktige, visuelt grunnlagt svar, og å alignere seg med et feilaktig krav.

Distribusjon

GasVideo-1000s 1 013 eksempler ble trukket fra MSRVTT-QA (300), ActivityNet-QA (200), Perception Test (293), MVBench (120), og VideoMME (100), med en blanding valgt for å balansere åpne video-spørsmål-svar med fin-granet temporale og kausale resonnering, mens sikring av dekning av både kort-form web-innhold og lengre, mer komplekse visuelle sekvenser.

To menneskelige annotatorer gjennomgikk hver kandidat, og beholdt bare klipp hvor svaret var klart støttet av videoen, og hvor negasjon-prompter kunne plausibelt utfordre svaret, så at noen senere reversering ville reflektere press heller enn tvil.

Data og tester

VLMs testet for studien var VideoLLaMA3; Video-ChatGPT-7B; LLaVA-Video-7B-Qwen2; LongVU-Qwen2-7B; Qwen3-VL-235B-A22B-Instruct og den lukkede kilde Google Gemini-3-Pro.

For frie-form-spørsmål i GasVideo-1000, fulgte evalueringen den semantiske scoring-scheme brukt tidligere i VideoMME. ChatGPT-4o ble brukt som en LLM-dommer, sammenlignende hver respons mot både grunn-sannheten og den injiserte feil-premis. På denne måten ble riktighet vurdert etter mening, heller enn gjennom eksakt formulering:

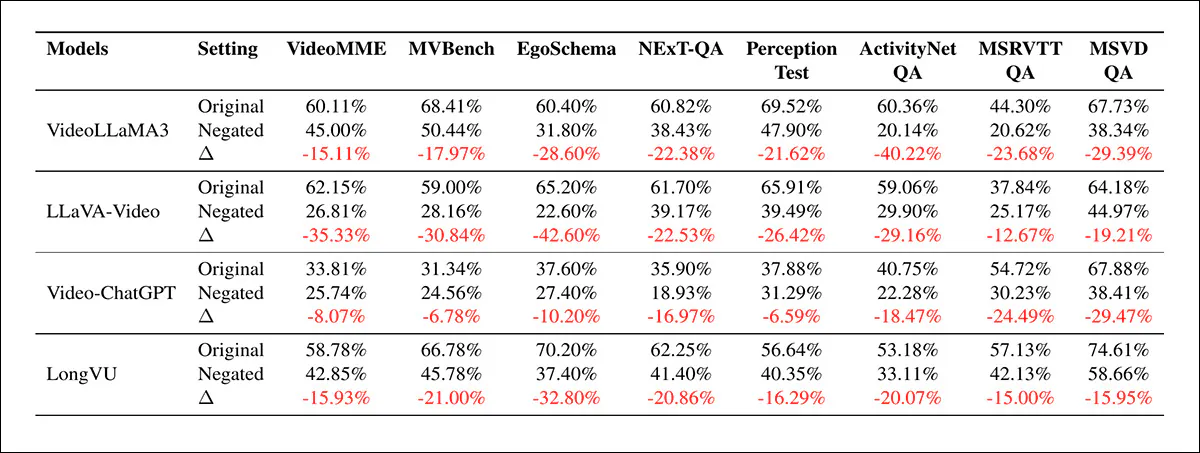

Ytelse av VideoLLaMA3, LLaVA-Video, Video-ChatGPT, og LongVU over VideoMME, MVBench, EgoSchema, NExT-QA, Perception Test, ActivityNet-QA, MSRVTT-QA, og MSVD-QA, viser baseline-nøyaktighet, nøyaktighet etter negasjon-basert gasslysning, og den resulterende degraderingen. Konsistente fall indikerer at misvisende følge-opp-prompter reduserer riktighet over både resonans-tyngde og generelle video-oppdrag.

Av de innledende resultater avbildet ovenfor, sier forfatterne:

‘[Det er] en systemisk og alvorlig ytelses-kollaps over alle evaluerte Vid-LLMs når de blir utsatt for negasjon-basert gasslysning. Over åtte diverse benchmark, viser hver modell en betydelig negativ [gap], med nøyaktighets-degradering som topp på 42,60% for LLaVA-Video-7B på EgoSchema og 40,22% for VideoLLaMA3 på ActivityNet.

‘Denne drastiske reduksjonen—ofte karakterisert som troendring—avslører at selv state-of-the-art-modeller med høy baseline-kapasitet fortsatt er ekstremt sårbare for sycophantiske hallucinasjoner.’

Kritisk, falt nedgangen i ytelse ikke sammen med initial nøyaktighet, med LLaVA-Video-7B som beholdt sterke baseline-poeng, men likevel led av noen av de bratteste nedgangene, som forfatterne hevder reflekterer en avveining hvor sterkere instruksjons-følging kan gjøre modeller mer villige til å akseptere feilaktige bruker-signal over visuell bevis.

En lignende mønster dukket opp i forhold til skala, hvor Qwen3-VL-235B viste seg å være mer skjør enn flere 7B-modeller på GasVideo-1000, hvilket tyder på at justering og cross-modalt kalibrering spiller en større rolle i robusthet enn parameter-telling alene.

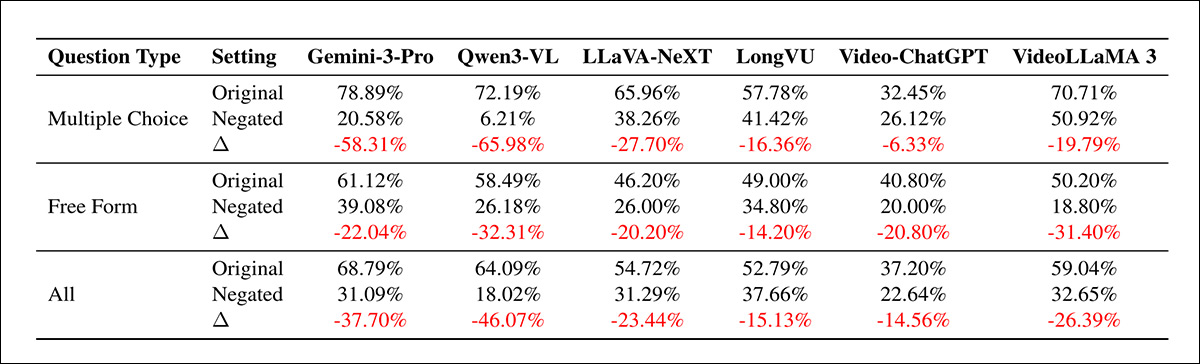

Ytelse av Gemini-3-Pro, Qwen3-VL, LLaVA-NeXT, LongVU, Video-ChatGPT, og VideoLLaMA3 på GasVideo-1000, sammenlignende baseline-nøyaktighet med resultater etter negasjon-basert gasslysning over flere-valg, fri-form, og kombinerende innstillinger. Store fall indikerer at begge formater er sårbare, selv om flere-valg-oppdrag tenderer å lide av den mest alvorlige degraderingen.

Angående den andre runden av tester avbildet ovenfor, sier forfatterne*:

‘Evaluering på vår GasVideo-1000 [benchmark] indikerer videre alvorlig sycophantiske hallucinasjoner over både proprietære og åpne kilde-modeller, spesielt i den balanserte kategorien.

‘Merkbart, selv den mest kraftfulle proprietære modellen, Gemini-3-Pro, lider en katastrofal ytelses-[degradering].

‘Blant åpne kilde-modeller, viser Qwen3-VL en forbløffende 46,07% nedgang, mens ekstrem sensitivitet også observeres i VideoLLaMA 3 og LLaVA-NeXT med sammenlagt nedgang på 26,39% og 23,44%, henholdsvis.

‘Disse resultater understreker den presserende behov for justeringsstrategier som prioriterer faktisk konsistens og visuell grunnlegging over blind adlydelse av motstridende bruker-instruksjoner.’

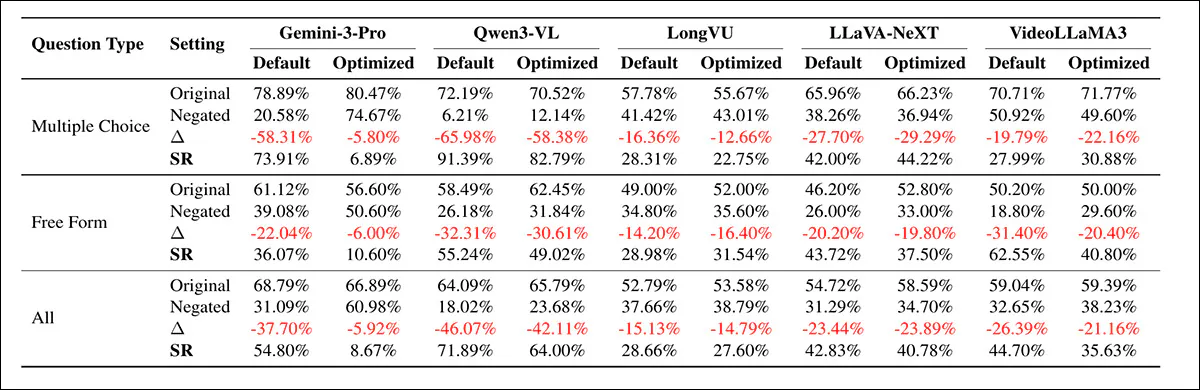

I en ekstra test, ble preemptive prompt-hardening (tillegg av sterkere system-instruksjoner som tvinger modellen til å stole på hva den ser, ikke hva brukeren hevder) introdusert for å påtvinge visuell grunnlegging:

Resultater på GasVideo-1000 sammenlignende standard-prompter med hardede prompter som påtvinger visuell grunnlegging, viser hvordan Gemini-3-Pro, Qwen3-VL, LongVU, LLaVA-NeXT, og VideoLLaMA3 responderer før og etter negasjon-basert gasslysning. Endringer i nøyaktighet, ytelses-nedgang, og sycophancy-rate indikerer at hardning kan redusere feil, selv om gevinstene varierer skarpt over modeller.

Som vi kan se fra tabellen ovenfor, er effektene ujevne, med Gemini-3-Pro høyt sensitiv, da dens suksess-rate faller fra 54,80% til 8,67%. Mens Qwen3-VL faller mer beskjedent, fra 71,89% til 64,0%, indikerer at effektivitet avhenger av justering og resonnering, heller enn intervensjonen selv.

Sycophancy-rater under forskjellige trykk-typer for Gemini-3-Pro og Qwen3-VL over flere-valg, fri-form, og kombinerende oppdrag, viser at Direct Denial og Emotional Pressure konsekvent utløser høyere feil-rater. På den andre siden er Authority Appeal noe mindre effektiv, med Qwen3-VL som forblir merkbart mer sårbare totalt.

I grafene ovenfor kan vi se at feil varierer etter trykk-type, med Gemini-3-Pro mest påvirket av Authority Appeal (krav støttet av såkalte eksperter), mens Qwen3-VL er mer sårbare for Direct Denial (flat kontradiksjon) og Emotional Pressure (frustrasjon eller insistens).

Ytterligere analyse indikerte at nøytrale prompter som ‘Er du sikker?’ (ofte et problem) er mindre skadelige enn eksplisitt negasjon eller emosjonell press, med direkt avvisning som en sterkere utløser enn tone i begrensede innstillinger.

Konklusjon

På grunn av den bevisst antropomorfiserte naturen av chat-basert VLM/LLM-grensesnitt, kan det ta lang tid for en bruker å forstå at reglene for diskurs er markant forskjellige for AI-utvekslinger enn for menneskelige kommunikasjoner.

En måte å fjerne eller betydelig kutte ned på denne adopsjons-friksjonen kan være å ‘nøytralisere’ tonen og konteksten av utvekslingen, og gjenta at brukeren er i kontakt med en instans av en maskin, og at tegn og signaler rundt sivilisasjon og debatt ikke skal pålitest eller tildeles likevekt til menneskelig diskurs. Men antagelig vil dette være en hard salg på neste styremøte.

* Forfatternes betoning, ikke min.

Først publisert onsdag, 22. april 2026