Andersons vinkel

Fremtiden for RAG-forbedret bildegenerering

Generative diffusjonsmodeller som Stable Diffusion, Flux og videomodeller som Hunyuan er avhengige av kunnskap tilegnet under en enkelt, ressursintensiv treningsøkt med et fast datasett. Alle konsepter introdusert etter denne treningsøkten – referert til som kunnskapsavkorting – er fraværende fra modellen med mindre den suppleres gjennom finjustering eller eksterne tilpasningsmetoder som Low Rank Adaptation (LoRA).

Det ville derfor være ideelt hvis et generativt system som utsteder bilder eller videoer kunne kontakte onlinekilder og bringe dem inn i genereringsprosessen etter behov. På denne måten, for eksempel, kunne en diffusjonsmodell som ikke vet noe om den aller siste Apple- eller Tesla-utgivelsen likevel produsere bilder som inneholder disse nye produktene.

I forhold til språkmodeller er de fleste av oss kjent med systemer som Perplexity, Notebook LM og ChatGPT-4o, som kan inkorporere ny ekstern informasjon i en Retrieval Augmented Generation (RAG)-modell.

RAG-prosesser gjør ChatGPT 4o’s svar mer relevante. Kilde: https://chatgpt.com/

Men dette er en uvanlig fasilitet når det gjelder bildegenerering, og ChatGPT vil innrømme sine egne begrensninger i denne sammenhengen:

ChatGPT 4o har gjettet godt på visualiseringen av en helt ny klokkeutgivelse, basert på den generelle linjen og på beskrivelser den har tolket; men den kan ikke ‘absorbere’ og integrere nye bilder i en DALL-E-basert generering.

Inkorporering av eksternt hentet data i en generert bilde er utfordrende fordi det innkommende bildet må først brytes ned i tokens og innlejring, som deretter kartlegges til modellens nærmeste treningsdomenekunnskap om emnet.

Denne prosessen fungerer effektivt for post-treningsverktøy som ControlNet, men slike manipulasjoner er i stor grad overflatiske, og fungerer i stor grad som en rendering-pipeline, men uten å integrere det dypt i modellens interne representasjon.

Som følge mangler modellen evnen til å generere nye perspektiver på samme måte som neurale renderingssystemer som NeRF kan, som konstruerer scener med sanne romlige og strukturelle forståelser.

Moden Logikk

En lignende begrensning gjelder for RAG-baserte spørsmål i store språkmodeller (LLM), som Perplexity. Når en modell av denne typen prosesserer eksternt hentet data, fungerer den mye som en voksen som tegner på en livslang kunnskap for å slutte seg til sannsynligheter om et emne.

Men likevel som en person ikke kan retroaktivt integrere ny informasjon i den kognitive rammen som formede deres grunnleggende verdenssyn – når deres fordommer og forestillinger ennå var under utvikling – kan en LLM ikke sammenføye ny kunnskap i sin forhånds treningsstruktur.

I stedet kan den bare ‘påvirke’ eller plassere den nye data mot sin eksisterende internaliserte kunnskap, ved å bruke lært prinsipper til å analysere og gjetting, snarere enn å syntetisere på et grunnleggende nivå.

Denne mangelen på ekvivalens mellom juxtaposed og internalized generering er sannsynligvis mer tydelig i en generert bilde enn i en språkbasert generering: de dypere nettverksforbindelsene og økte kreativiteten til ‘native’ (i motsetning til RAG-basert) generering er etablert i forskjellige studier.

Skjulte Risikoer for RAG-Kapasitiv BildeGenerering

Selv om det var teknisk mulig å sammenføye hentet internettbilder i nye syntetiske bilder på en RAG-stil, ville sikkerhetsrelaterte begrensninger fremme en ytterligere utfordring.

Mange datasett brukt for å trene generative modeller er kuratert for å minimere tilstedeværelsen av eksplisitt, rasistisk eller voldelig innhold, blant andre sensitive kategorier. Men denne prosessen er ikke perfekt, og residual assosiasjoner kan fortsette å eksistere. For å mildne dette, avhenger systemer som DALL·E og Adobe Firefly av sekundære filtermekanismer som skanner både innledende promter og genererte utdata for forbudt innhold.

Som følge ville en enkel NSFW-filter – en som primært blokkerer åpenbart eksplisitt innhold – være utilstrekkelig for å vurdere akseptabiliteten av hentet RAG-basert data. Slike innhold kunne fortsatt være offensive eller skadelige på måter som faller utenfor modellens forhåndsdefinerte modereringsparametere, potensielt introduserer materiale som AI mangler kontekstuell bevissthet til å korrekt vurdere.

Oppdagelsen av en nylig sårbarhet i CCP-produsert DeepSeek, designet for å undertrykke diskusjoner om forbudt politisk innhold, har høylysnet hvordan alternative inngangsveier kan utnyttes for å omgå en modells etiske sikkerhetssystemer; dette gjelder også for vilkårlig ny data hentet fra internettet, når det er ment å inkorporeres i en ny bildegenerering.

RAG for BildeGenerering

Til tross for disse utfordringene og tornefulle politiske aspekter, har en rekke prosjekter dukket opp som forsøker å bruke RAG-baserte metoder til å inkorporere ny data i visuelle generasjoner.

ReDi

2023 Retrieval-basert Diffusjon (ReDi)-prosjektet er et læring-fritt rammeverk som akselererer diffusjonsmodell-inferens ved å hente lignende baner fra en forhåndskalkulert kunnskapsbase.

Verdier fra et datasett kan ‘lånes’ for en ny generering i ReDi. Kilde: https://arxiv.org/pdf/2302.02285

I sammenheng med diffusjonsmodeller er en bane den trinnviske vei som modellen tar for å generere et bilde fra rent støy. Vanligvis skjer denne prosessen gradvis over mange trinn, med hvert trinn som refinerer bildet litt mer.

ReDi akselererer dette ved å hoppe over en del av disse trinnene. I stedet for å beregne hvert enkelt trinn, henter den en lignende tidligere bane fra en database og hopper frem til et senere punkt i prosessen. Dette reduserer antallet beregninger som trengs, og gjør diffusjonsbasert bildegenerering mye raskere, samtidig som kvaliteten holdes høy.

ReDi modifiserer ikke diffusjonsmodellens vekt, men bruker i stedet kunnskapsbasen for å hoppe over mellomliggende trinn, og reduserer dermed antallet funksjonsEstimater som trengs for sampling.

Selvfølgelig er dette ikke det samme som å inkorporere bestemte bilder når som helst i en genereringsforespørsel; men det relaterer til lignende typer generering.

Utgitt i 2022, året da latente diffusjonsmodeller fanget den offentlige fantasien, ser ReDi ut til å være blant de tidligste diffusjonsbaserte tilnærmingene til å bruke en RAG-metodologi.

Til tross for at det i 2021 ble utgitt Instance-Conditioned GAN fra Facebook Research, som forsøkte å kondisjonere GAN-bilder på nye bildeinndata, er denne typen prosjektering i latente rom meget vanlig i litteraturen, både for GAN og diffusjonsmodeller; utfordringen er å gjøre en slik prosess treningsfri og funksjonell i sanntid, som LLM-fokuserte RAG-metoder er.

RDM

En annen tidlig innføring i RAG-forbedret bildegenerering er Retrieval-Augmented Diffusion Models (RDM), som introduserer en semi-parametrisk tilnærming til generativ bilde-syntese. I motsetning til tradisjonelle diffusjonsmodeller som lagrer all lært visuell kunnskap innenfor deres neurale nettverksparametre, avhenger RDM av en ekstern bilde-database:

Hentede nærmeste naboer i en illustrativ pseudo-spørsmål i RDM*.

Under treningsprosessen henter modellen nærmeste naboer (visuelt eller semantisk like bilder) fra den eksterne database, for å guide genereringsprosessen. Dette tillater modellen å kondisjonere sine utdata på virkelige visuelle eksempler.

Hentingsprosessen er drevet av CLIP-innlejring, designet for å tvinge de hentede bildene til å dele meningsfulle likheter med spørsmålet, og også å gi ny informasjon for å forbedre genereringen.

Dette reduserer avhengigheten av parametre, og muliggjør mindre modeller som oppnår konkurranse-resultater uten behov for omfattende treningsdatasett.

RDM-tilnærmingen støtter post-hoc-modifikasjoner: forskere kan bytte ut database ved inferenstid, og tillate null-skudd-tilpasning til nye stiler, domener eller helt andre oppgaver som stilisering eller klassisk betinget syntese:

I de nedre radene ser vi nærmeste naboer trekkes inn i diffusjonsprosessen i RDM*.

En nøkkel fordelen med RDM er dens evne til å forbedre bildegenerering uten å treningsmodellen på nytt. Ved å bare endre hentingsdatabase, kan modellen generalisere til nye konsepter den aldri ble eksplisitt trenet på. Dette er spesielt nyttig for applikasjoner hvor domene-skift skjer, som generering av medisinske bilder basert på utviklende datasett, eller tilpasning av tekst-til-bilde-modeller for kreative applikasjoner.

Negativt er hentingsbaserte metoder av denne typen avhengige av kvaliteten og relevansen av den eksterne database, som gjør datakurering en viktig faktor for å oppnå høykvalitetsgenerering; og denne tilnærmingen er langt ifra en bilde-syntese-ekvivalent av den type RAG-baserte interaksjoner som er typiske i kommersielle LLM.

ReMoDiffuse

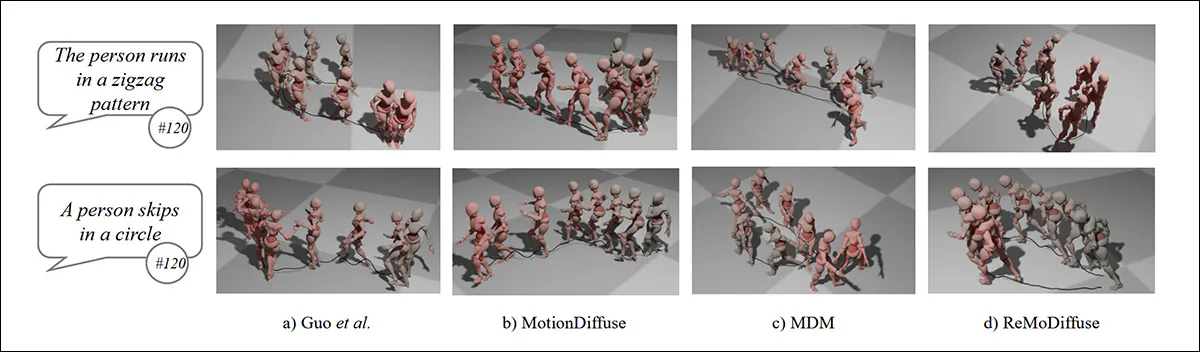

ReMoDiffuse er et hentingsforbedret bevegelsesdiffusjonsmodell designet for 3D-menneskebevegelsesgenerering. I motsetning til tradisjonelle bevegelsesgenereringsmodeller som bare avhenger av lært representasjoner, henter ReMoDiffuse relevante bevegelsesprøver fra et stort bevegelsesdatasett og integrerer dem i støyprosessen, i et skjema lignende RDM (se over).

Sammenligning av RAG-forbedret ReMoDiffuse (høyre) med tidligere metoder. Kilde: https://arxiv.org/pdf/2304.01116

Dette tillater modellen å generere bevegelsessekvenser som er mer naturlige og diverse, samt semantisk tro mot brukerens tekstpromter.

ReMoDiffuse bruker en innovativ hybrid hentingsmekanisme, som velger bevegelsessekvenser basert på både semantiske og kinematiske likheter, med intensjonen å sikre at de hentede bevegelsene ikke bare er tematisk relevante, men også fysisk plausibelt når de integreres i den nye genereringen.

Modellen refinerer deretter disse hentede prøvene ved å bruke en Semantikk-Modulert Transformer, som selektivt inkorporerer kunnskap fra de hentede bevegelsene samtidig som den opprettholder de karakteristiske kvalitetene til den genererte sekvensen:

Skjema for ReMoDiffuse’s pipeline.

Prosjektets Betingelsesblandings-teknikk forbedrer modellens evne til å generalisere over forskjellige promter og hentingsbetingelser, og balanserer hentede bevegelsesprøver med tekstpromter under generering, og justerer hvor mye vekt hver kilde får i hvert trinn.

Dette kan hjelpe til å forhindre urealistiske eller repetitive utdata, selv for sjeldne promter. Det adresserer også skala-følsomhetsproblemet som ofte oppstår i klassifikator-frie veilednings-teknikker som vanligvis brukes i diffusjonsmodeller.

RA-CM3

Stanfords 2023 papir Retrieval-Augmented Multimodal Language Modeling (RA-CM3) tillater systemet å få tilgang til virkelige verdensinformasjon på inferenstid:

Stanfords Retrieval-Augmented Multimodal Language Modeling (RA-CM3)-modell bruker internett-hentede bilder for å forbedre genereringsprosessen, men er fortsatt en prototype uten offentlig tilgang. Kilde: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 inkorporerer hentet tekst og bilder i genereringspipelinen, og forbedrer både tekst-til-bilde- og bilde-til-tekst-syntese. Ved å bruke CLIP for henting og en Transformer som generatoren, henviser modellen til relevante multimodale dokumenter før den komponerer en utgang.

Benchmark på MS-COCO viser merkede forbedringer over DALL-E og lignende systemer, og oppnår en 12-punkts Fréchet Inception Distance (FID)-reduksjon, med langt lavere beregningskostnader.

Men, som med andre hentingsforbedrede tilnærminger, inkorporerer RA-CM3 ikke sømløst sin hentede kunnskap. I stedet overlagrer den ny data mot sin forhånds treningsnettverk, mye som en LLM som forbedrer svar med søke-resultater. Selv om denne metoden kan forbedre faktisk nøyaktighet, erstatter den ikke behovet for treningsoppdateringer i domener hvor dyp syntese er nødvendig.

Fortsatt er det ikke offentliggjort noen praktisk implementering av dette systemet, selv ikke på en API-basert plattform.

RealRAG

En ny utgivelse fra Kina, og den som har utløst denne oversikten over RAG-forbedret generativ bilde-systemer, er kalt Retrieval-Augmented Realistisk BildeGenerering (RealRAG).

Eksterne bilder hentet inn i RealRAG (nederst midten). Kilde: https://arxiv.o7rg/pdf/2502.00848

RealRAG henter faktiske bilder av relevante objekter fra en database kuratert fra offentlig tilgjengelige datasett som ImageNet, Stanford Cars, Stanford Dogs, og Oxford Flowers. Den inkorporerer deretter de hentede bildene i genereringsprosessen, og adresserer kunnskapsgap i modellen.

En nøkkelkomponent i RealRAG er selv-refleksiv kontrastiv læring, som trener en hentingsmodell for å finne informasjonsgivende referansebilder, snarere enn bare å velge visuelt like bilder.