Kunstig intelligens

Mindre er mer: Hvorfor henting av færre dokumenter kan forbedre AI-svar

Retrieval-Augmented Generation (RAG) er en tilnærming til å bygge AI-systemer som kombinerer et språkmodell med en ekstern kunnskapskilde. I enkle termer søker AI-en først etter relevante dokumenter (som artikler eller nettsider) relatert til en brukers spørring, og bruker deretter disse dokumentene til å generere et mer nøyaktig svar. Denne metoden har blitt feiret for å hjelpe store språkmodeller (LLM) å forbli faktiske og redusere hallucinasjoner ved å grunne deres svar i virkelige data.

Intuitivt kan en tenke at jo flere dokumenter en AI henter, jo bedre informert vil svaret være. Imidlertid viser ny forskning en overraskende vending: når det kommer til å mata informasjon til en AI, er det noen ganger mindre som er mer.

Færre dokumenter, bedre svar

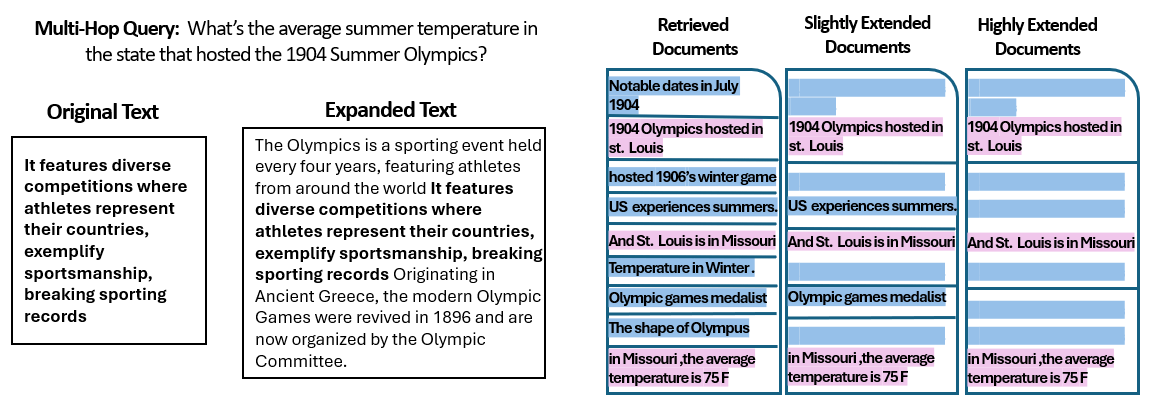

En ny studie utført av forskere ved Hebrew University of Jerusalem undersøkte hvordan antallet dokumenter gitt til et RAG-system påvirkte dens ytelse. Kritisk holdt de det totale tekstmengden konstant – det vil si at hvis færre dokumenter ble gitt, ble disse dokumentene litt utvidet for å fylle samme lengde som mange dokumenter ville. På denne måten kunne eventuelle ytelsesforskjeller tilskrives mengden dokumenter snarere enn bare å ha en kortere inndata.

Forskerne brukte et spørsmål-svar-datasett (MuSiQue) med trivia-spørsmål, hvor hvert spørsmål opprinnelig var parret med 20 Wikipedia-avsnitt (bare noen av dem faktisk inneholdt svaret, mens resten var distraktorer). Ved å kutte antallet dokumenter fra 20 ned til bare de 2-4 virkelig relevante – og fylle disse med litt ekstra kontekst for å opprettholde en konstant lengde – skapte de scenarier der AI-en hadde færre stykker å vurdere, men likevel omtrent samme totale ord å lese.

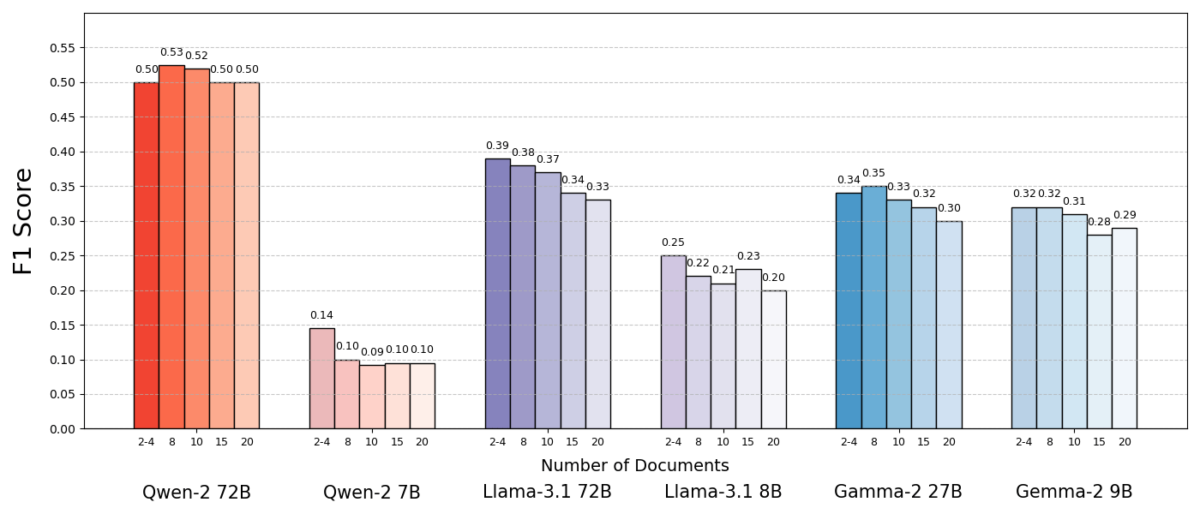

Resultatene var slående. I de fleste tilfeller svarte AI-modellene mer nøyaktig når de ble gitt færre dokumenter enn den fullstendige samlingen. Ytelsen forbedret seg betydelig – i noen tilfeller med opptil 10% i nøyaktighet (F1-score) når systemet brukte bare de få støttende dokumentene i stedet for en stor samling. Denne motintuitive forbedringen ble observert over flere forskjellige åpne kilde-språkmodeller, inkludert varianter av Meta’s Llama og andre, noe som indikerer at fenomenet ikke er knyttet til en enkelt AI-modell.

En modell (Qwen-2) var en merkbart unntak som håndterte multiple dokumenter uten noen nedgang i score, men nesten alle testede modeller fungerte bedre med færre dokumenter totalt. Med andre ord, å legge til mer referansemateriale utover de nøkkel-relevante delene forverret faktisk deres ytelse oftere enn det hjalp.

Kilde: Levy et al.

Hvorfor er dette så overraskende? Vanligvis er RAG-systemer designet under antagelsen at henting av en bredere stripe informasjon kan bare hjelpe AI-en – etter all, hvis svaret ikke er i de første få dokumentene, kan det være i det tiende eller tyvende.

Denne studien snur skriptet, og viser at å udiscriminerende stable på ekstra dokumenter kan backfire. Selv når den totale tekstlengden ble holdt konstant, gjorde den blotte nærværet av mange forskjellige dokumenter (hver med sine egne kontekst og egenheter) oppgaven mer utfordrende for AI-en. Det ser ut til at utover et visst punkt, introduserte hver ekstra dokument mer støy enn signal, forvirret modellen og hindret dens evne til å trekke ut det riktige svaret.

Hvorfor mindre kan være mer i RAG

Dette “mindre er mer”-resultatet gjør mening når vi vurdere hvordan AI-språkmodeller prosesserer informasjon. Når en AI bare får de mest relevante dokumentene, er konteksten den ser fokusert og fri for distraksjoner, mye som en student som har fått bare de riktige sidene å studere.

I studien fungerte modellene betydelig bedre når de bare fikk de støttende dokumentene, med irrelevant materiale fjernet. Den gjenværende konteksten var ikke bare kortere, men også renere – den inneholdt fakta som direkte pekte mot svaret og ingenting annet. Med færre dokumenter å jonglere, kunne modellen konsentrere sin fulle oppmerksomhet om den pertinente informasjonen, og gjøre det mindre sannsynlig at den ble forvirret eller distraheret.

På den andre siden, når mange dokumenter ble hentet, måtte AI-en si igjennom en blanding av relevante og irrelevante innhold. Ofte var disse ekstra dokumentene “like, men ulike” – de delte en emne eller nøkkelord med spørsmålet, men inneholdt ikke faktisk svaret. Slik innhold kan misle modellen. AI-en kunne spille bort anstrengelse med å forsøke å koble punkter over dokumenter som ikke faktisk ledet til et riktig svar, eller verre, den kunne slå sammen informasjon fra multiple kilder feilaktig. Dette øker risikoen for hallucinasjoner – tilfeller der AI-en genererer et svar som lyder plausibelt, men ikke er grunnlagt i noen enkelt kilde.

I essensen, å mata for mange dokumenter til modellen kan utvatne den nyttige informasjonen og introdusere motstridende detaljer, og gjøre det harder for AI-en å bestemme hva som er sant.

Det er også interessant at forskerne fant at hvis de ekstra dokumentene var åpenbart irrelevante (for eksempel, tilfeldig ubeslektet tekst), var modellene bedre til å ignorere dem. Den virkelige ulempen kommer fra distraherende data som ser relevante ut: når alle hentede tekstene er på lignende emner, antar AI-en at den skal bruke alle, og den kan slite med å bestemme hvilke detaljer som faktisk er viktige. Dette stemmer overens med studiens observasjon at tilfeldige distraktorer forårsaket mindre forvirring enn realistiske distraktorer i inndata. AI-en kan filtrere ut åpenbart nonsens, men subtilt avsporet informasjon er en glatt felle – den sniker inn under forkledning av relevans og avsporer svaret. Ved å redusere antallet dokumenter til bare de virkelig nødvendige, unngår vi å sette disse feller fra første sted.

Det er også en praktisk fordel: å hente og prosessere færre dokumenter senker den komputasjonelle overhodet for et RAG-system. Hvert dokument som hentes inn, må analyseres (innbeddet, lest og oppmerksomt fulgt av modellen), noe som bruker tid og beregningsressurser. Å eliminere overflødig dokumenter gjør systemet mer effektivt – det kan finne svarene raskere og til en lavere kostnad. I scenarier der nøyaktigheten forbedret seg ved å fokusere på færre kilder, får vi en gevinst: bedre svar og en slankere, mer effektiv prosess.

Kilde: Levy et al.

Omtenkning av RAG: Fremtidige retninger

Dette nye beviset på at kvalitet ofte slår kvantitet i henting, har viktige implikasjoner for fremtiden til AI-systemer som avhenger av ekstern kunnskap. Det antyder at designerne av RAG-systemer bør prioritere smart filtrering og rangering av dokumenter over ren mengde. I stedet for å hente 100 mulige passasjer og håpe at svaret er begravd der et sted, kan det være klokt å hente bare de topp få høyt relevante.

Studiens forfattere understreker behovet for hentingsmetoder som kan “finne en balanse mellom relevans og mangfold” i informasjonen de forsyner modellen med. Med andre ord, vi ønsker å gi nok dekning av emnet for å svare på spørsmålet, men ikke så mye at de sentrale faktene druknes i en hav av overflødig tekst.

I fremtiden er det sannsynlig at forskere vil utforske teknikker som hjelper AI-modeller å håndtere multiple dokumenter mer elegant. En tilnærming er å utvikle bedre hentingsystemer eller om-rankere som kan identifisere hvilke dokumenter faktisk tilfører verdi og hvilke som bare introduserer konflikt. En annen vinkel er å forbedre språkmodellene selv: hvis en modell (som Qwen-2) klarte å håndtere mange dokumenter uten å tape nøyaktighet, kunne en undersøkelse av hvordan den ble trent eller strukturert gi ledetråder for å gjøre andre modeller mer robuste. Kanskje fremtidige store språkmodeller vil inkorporere mekanismer for å gjenkjenne når to kilder sier det samme (eller motsier hverandre) og fokusere deretter. Målet ville være å enable modellene til å utnytte en rik variasjon av kilder uten å falle for forvirring – effektivt å få det beste av begge verdener (bredde av informasjon og klarhet av fokus).

Det er også verdt å merke seg at når AI-systemer får større kontekstvinduer (evnen til å lese mer tekst på en gang), er det ikke nok å bare dumpe mer data i prompten. Større kontekst betyr ikke automatisk bedre forståelse. Denne studien viser at selv om en AI kan teknisk sett lese 50 sider på en gang, å gi den 50 sider med blandet kvalitet informasjon, kan ikke nødvendigvis gi et godt resultat. Modellen nyter fortsatt av å ha kuratert, relevant innhold å arbeide med, snarere enn en udiscriminerende dump. Faktisk kan intelligent henting bli enda mer kritisk i æraen med gigantiske kontekstvinduer – for å sikre at den ekstra kapasiteten brukes til verdifull kunnskap snarere enn støy.

Funndene fra “More Documents, Same Length” (det passende tittel på papiret) oppmuntrer en gjenundersøkelse av våre antakelser i AI-forskning. Noen ganger er det ikke like effektivt å mate en AI all dataen vi har, som vi tror. Ved å fokusere på de mest relevante delene av informasjonen, forbedrer vi ikke bare nøyaktigheten av AI-genererte svar, men gjør også systemene mer effektive og enklere å stole på. Det er en motintuitiv lek, men en med spennende implikasjoner: fremtidige RAG-systemer kan være både smartere og slankere ved å velge nøye færre, bedre dokumenter å hente.