Kunstig intelligens

RigNeRF: En ny deepfakes-metode som bruker Neural Radiance Fields

Ny forskning utviklet hos Adobe tilbyr den første brukbare og effektive deepfakes-metoden basert på Neural Radiance Fields (NeRF) – kanskje den første virkelige innovasjonen i arkitektur eller tilnærming i de fem årene siden deepfakes dukket opp i 2017.

Metoden, tittelen RigNeRF, bruker 3D-morfeble ansiktsmodeller (3DMMs) som en midlertidig instrumentell lag mellom ønsket innputt (dvs. identiteten som skal påtvynes i NeRF-renderingen) og neurale rom, en metode som har blitt vidt akseptert i de senere årene av Generative Adversarial Network (GAN) ansikts-syntese-tilnærming, ingen av dem har ennå produsert funksjonelle og nyttige ansikts-erstatnings-rammer for video.

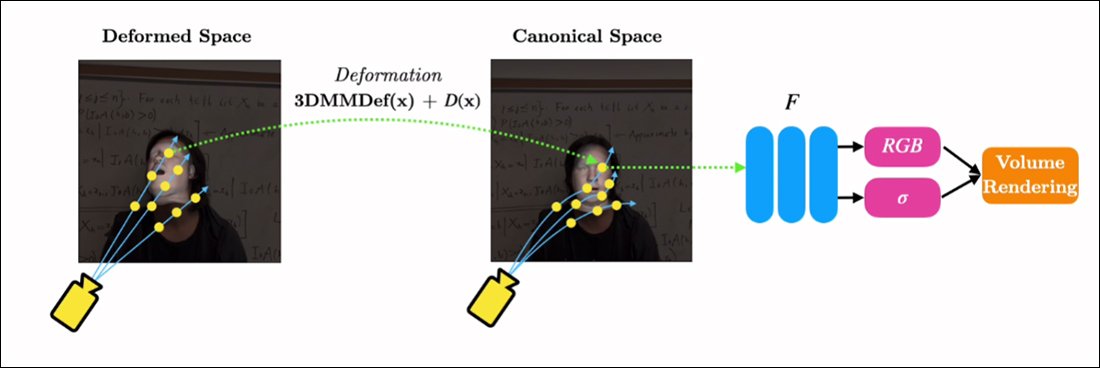

I motsetning til tradisjonelle deepfake-videoer, er ingen av den bevegelige innholdet avbildet her ‘ekte’, men heller et utforskbart neuralt rom som ble trent på kort fotografering. På høyresiden ser vi 3D-morfeble ansiktsmodellen (3DMM) som fungerer som en grensesnitt mellom ønskede manipulasjoner (‘smile’, ‘se til venstre’, ‘se opp’, osv.) og de vanligvis utilgjengelige parameterne til en Neural Radiance Field-visualisering. For en høyoppløselig versjon av denne klippet, samt andre eksempler, se prosjektets side, eller de innlejrede videoene ved slutten av denne artikkelen. Kilde: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs er i virkeligheten CGI-modeller av ansikter, der parameterne kan tilpasses mer abstrakte bilde-syntese-systemer, som NeRF og GAN, som ellers er vanskelige å kontrollere.

Hva du ser i bildet ovenfor (midten, mannen i blå skjorte), samt bildet rett under (venstre, mannen i blå skjorte), er ikke en ‘ekte’ video der en liten del ‘falsk’ ansikt er pålagt, men en helt syntetisk scene som eksisterer kun som en volumetrisk neural rendering – inkludert kropp og bakgrunn:

I eksempelet rett over, brukes den virkelige videoen på høyresiden (kvinnen i rød kjole) til å ‘styre’ den fanget identiteten (mannen i blå skjorte) på venstresiden via RigNeRF, som (forfatterne hevder) er det første NeRF-baserte systemet som oppnår separasjon av posisjon og uttrykk samtidig som det kan utføre nye visningssynteser.

Den mannlige figuren på venstresiden i bildet ovenfor ble ‘fanget’ fra en 70-sekunders smarttelefonvideo, og innputtdataene (inkludert hele sceneninformasjonen) ble deretter trent over 4 V100 GPUs for å oppnå scenen.

Siden 3DMM-stil parametrisk rigging også er tilgjengelig som hele-kropp parametrisk CGI-proxies (i stedet for bare ansikts-rigging), åpner RigNeRF potensielt opp muligheten for full-kropp deepfakes hvor ekte menneskelig bevegelse, tekstur og uttrykk overføres til CGI-basert parametrisk lag, som deretter ville oversette handling og uttrykk til renderet NeRF-miljøer og videoer.

Som for RigNeRF – kvalifiserer det som en deepfakes-metode i den nåværende forståelsen av begrepet? Eller er det bare en annen semi-handicappet også-ran til DeepFaceLab og andre laborieuse, 2017-æra autoencoder deepfake-systemer?

Forskerne bak den nye artikkelen er uambisiøse på dette punktet:

‘Som en metode som er i stand til å gjenanimere ansikter, er RigNeRF utsatt for misbruk av dårlige aktører for å generere deep-fakes.’

Den nye artikkelen har tittelen RigNeRF: Fullstendig kontrollerbare neurale 3D-portretter, og kommer fra ShahRukh Atha fra Stonybrook University, en intern ved Adobe under RigNeRF-utviklingen, og fire andre forfattere fra Adobe Research.

Bortenfor autoencoder-basert deepfakes

Majoriteten av virale deepfakes som har fanget overskriftene de siste årene er produsert av autoencoder-baserte systemer, avledet fra koden som ble publisert på det raskt-forbudte r/deepfakes subreddit i 2017 – selv om ikke før det ble kopiert over til GitHub, der det nå er forket over en tusen ganger, ikke minst inn i den populære (om enn kontroversielle) DeepFaceLab-distribusjonen, og også FaceSwap-prosjektet.

Foruten GAN og NeRF, har autoencoder-rammeverk også eksperimentert med 3DMMs som ‘veiledninger’ for bedret ansikts-syntese-rammeverk. Et eksempel på dette er HifiFace-prosjektet fra juli 2021. Imidlertid synes ingen brukbare eller populære initiativer å ha utviklet fra denne tilnærmingen til dags dato.

Data for RigNeRF-scener blir innhentet ved å fange korte smarttelefonvideoer. For prosjektet, brukte RigNeRF-forskerne en iPhone XR eller en iPhone 12 for alle eksperimenter. For den første halvdelen av innhenting, blir subjektet bedt om å utføre en rekke ansiktsuttrykk og tale mens de holder hodet stille, mens kameraet beveger seg rundt dem.

For den andre halvdelen av innhenting, holder kameraet en fast posisjon mens subjektet må bevege hodet rundt mens de uttrykker en rekke uttrykk. De resulterende 40-70 sekundene med fotografering (omkring 1200-2100 ramer) representerer hele datasettet som vil bli brukt til å trene modellen.

Redusere datagjøring

I motsetning til dette, krever autoencoder-systemer som DeepFaceLab en relativt møysommelig innhenting og kurasjon av tusenvis av diverse bilder, ofte tatt fra YouTube-videoer og andre sosiale medier, samt fra filmer (i tilfelle av celebrity deepfakes).

De resulterende trente autoencoder-modellene er ofte ment å bli brukt i en rekke situasjoner. Imidlertid kan de mest omhyggelige ‘celebrity’-deepfakers trene hele modeller fra scratch for en enkelt video, til tross for at trening kan ta en uke eller mer.

Til tross for advarselsnotatet fra den nye artikkelen, synes det ‘lappete’ og bredt sammensatte datasettene som driver AI-porn og populære YouTube/TikTok ‘deepfake-omkasting’ å være usannsynlig å produsere akseptable og konsistente resultater i et deepfake-system som RigNeRF, som har en scene-spesifikk metode. Gitt begrensningene på datagjøring som er angitt i den nye artikkelen, kan dette vise seg å være en ekstra sikkerhet mot casual misbruk av identitet av dårlige deepfakers.

Tilpasse NeRF til deepfake-video

NeRF er en fotogrammetri-basert metode hvor et lite antall kildebilder tatt fra ulike vinkler blir sammensatt til et utforskbart 3D neuralt rom. Denne tilnærmingen kom til prominens tidligere i år da NVIDIA lanserte sitt Instant NeRF-system, som kan kutte den ekstreme trenings tid for NeRF ned til minutter, eller selv sekunder:

Instant NeRF. Kilde: https://www.youtube.com/watch?v=DJ2hcC1orc4

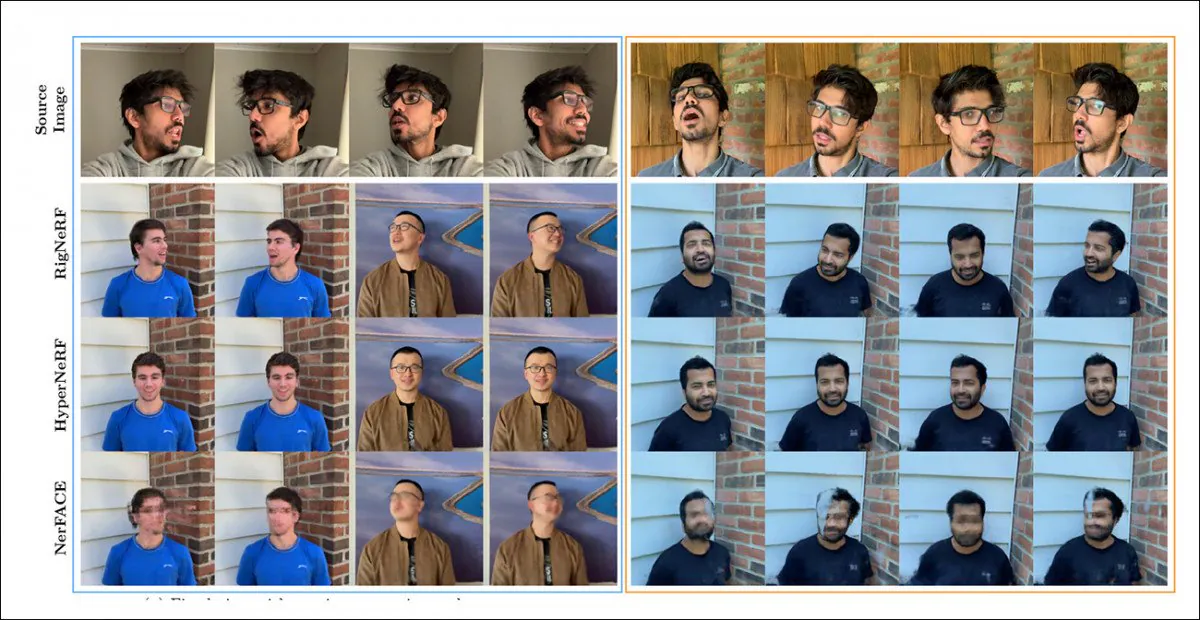

Det resulterende Neural Radiance Field-scenen er i virkeligheten en statisk miljø som kan bli utforsket, men som er vanskelig å redigere. Forskerne merker at to tidligere NeRF-baserte initiativ – HyperNeRF + E/P og NerFACE – har tatt et forsøk på ansiktsvideo-syntese, og (apparat for skyld og flid) har satt RigNeRF mot disse to rammeverkene i en testrunde:

En kvalitativ sammenligning mellom RigNeRF, HyperNeRF og NerFACE. Se de lenkede kildevideoene og PDF for høyere kvalitetsversjoner. Statiske bilde kilde: https://arxiv.org/pdf/2012.03065.pdf

Imidlertid er resultater, som favoriserer RigNeRF, ganske anomale, av to grunner: først og fremst observerer forfatterne at ‘det ikke finnes noen eksisterende arbeid for en apple-til-apple-sammenligning’; for det andre har dette nødvendiggjort å begrense RigNeRFs funksjonalitet til å minst delvis matche den mer begrensede funksjonaliteten til de tidligere systemene.

Ettersom resultater ikke er en inkrementell forbedring av tidligere arbeid, men heller representerer et ‘gjennombrudd’ i NeRF-redigering og nytte, vil vi la testrunden bli satt til side, og heller se hva RigNeRF gjør annerledes enn sine forgjengere.

Kombinerte styrker

Den primære begrensningen til NerFACE, som kan skape posisjon/uttrykk-kontroll i et NeRF-miljø, er at det antar at kildefotografering vil bli tatt med en statisk kamera. Dette betyr i virkeligheten at det ikke kan produsere nye visninger som går ut over dens innhentingsbegrensninger. Dette produserer et system som kan skape ‘bevegelige portretter’, men som er uegnet for deepfake-stil video.

HyperNeRF, på den andre siden, mens det kan generere nye og hyper-realistiske visninger, har ingen instrumentell som tillater det å endre hodeposisjoner eller ansiktsuttrykk, noe som igjen ikke resulterer i noen slags konkurrent for autoencoder-basert deepfakes.

RigNeRF er i stand til å kombinere disse to isolerte funksjonalitetene ved å skape en ‘kanonisk rom’, en standard-baselinje fra hvilken avvik og deformasjoner kan bli utført via innputt fra 3DMM-modulen.

Skape en ‘kanonisk rom’ (ingen posisjon, ingen uttrykk), på hvilken deformasjonene (dvs. posisjoner og uttrykk) produsert via 3DMM kan virke.

Ettersom 3DMM-systemet ikke vil bli nøyaktig matchet til den fanget subjektet, er det viktig å kompensere for dette i prosessen. RigNeRF oppnår dette med en deformasjonsfelt-prior som blir beregnet fra en Multilayer Perceptron (MLP) avledet fra kildefotograferingen.

Kamera-parameterne nødvendige for å beregne deformasjoner blir innhentet via COLMAP, mens uttrykk- og form-parameterne for hver ramme blir innhentet fra DECA.

Posisjonen blir ytterligere optimert gjennom landmark-fitting og COLMAPs kamera-parametre, og, på grunn av begrensninger i datamaskin-resursene, blir video-utgangen nedskalert til 256×256-oppløsning for trening (en hardvar-begrenset krympningsprosess som også plager autoencoder deepfaking-scenen).

Etter dette blir deformasjons-nettverket trent på de fire V100s – imponerende hardvar som ikke er sannsynlig å være innenfor rekkevidde for casual-entusiaster (imidlertid, der maskinlæring-trening er involvert, er det ofte mulig å bytte kraft for tid, og bare akseptere at modell-trening vil bli en sak om dager eller selv uker).