Andersons vinkel

Kan AI Utvikle En Nese For Nyheter?

AI blir bedre til å skrive nyhetsartikler, men blir ikke mye bedre til å identifisere dem.

Mening I de fem årene siden jeg sist tok en titt på AI sin evne til å finne en het nyhetssak, har landskapet endret seg betraktelig, med økte nivåer av AI-drevet automatisering sammen med de uunngåelige vekstsmertene og kontroverser.

Nylig presenterte en WSJ-rapport om en produktiv, AI-assistert Fortune-bidragsyter den fremtidige journalisten som frigjort fra skitjobb som å translitterere pressemeldinger, og lar dem scope til å skrive artiklene og gjøre gravingen som bare større publikasjoner vanligvis har budsjett for.

Men hva vi hører mye mindre om er AI sin evne til å spore en nyhetssak.

Støyredusering

I 2021-artikkelen konsentrerte jeg meg om forfattere som dekket forskningsfeltet, siden det er der jeg tilbringer mest av min tid; og kanskje den største effekten av den nye AI-revolusjonen har hatt på det er at den skapte en ukontrollerbar snøstorm av AI-drevne forskningspapirinnsendelser, og økte signal-til-støy-forholdet så høyt at selv å dekke Arxiv AI-relaterte domener komprehensivt er nå utenfor en enkelt persons kapasitet.

Sikkerheten er at dette er hvor AI utmerker seg – ved å iterere gjennom enorme mengder data som mennesker ikke kan løse, for å finne ‘outlierne’ (som vi kommer til å se på snart) i sekunder som ville ha tatt mennesker dager, hvis de kunne ha gjort det i det hele tatt.

Hvorfor er AI da fortsatt så dårlig til å identifisere en het nyhetssak fra de tusenvis, ja til og med titusenvis, av daglige kandidater?

Bakovervendt AI

Denne massive proliferasjonen av AI-generert innhold skjer langt utenfor den akademiske sektoren som jeg diskuterte tidligere. Sent i fjor ble det estimert at halvparten av all ny skriving på nettet er nå ‘skrevet av AI’, med enda større akselerasjon av denne trenden antatt å komme. Derfor er støyen øredøvende overalt, ikke bare i akademia.

Selv om det har vært noen fremgang i AI/algoritmisk identifisering av en ‘het’ sak i de siste årene, tenderer disse systemene til å konsentrere seg om stratifiserte og prediktivt organiserte datastrømmer, noe som betyr at de bare kan operere i en ganske skjør kontekst.

I denne sammenhengen har Stanford-postdoktorand og tidligere New York Times-journalist Alexander Spangher gjort flere forsøk på å definere ‘nyhetsverdi’ i termer som kan anvendes på maskinlæringsprosesser og statistisk analyse; og har produsert bevis for automatisert lead-generering i korpus slik som rettsdokumenter, statlige lover, og byråds møter, samt generelle offentlige dokumenter – den type skjema-drevne utgang som Fortune’s produktive AI-drevne skribent kan omdanne til 6-7 nyhetsartikler om dagen:

Ordfordelingens ‘varme’ hentet fra korpus av offentlige dokumenter. I dette tilfelle kan vi se at ‘authorizing’ har en høy score, kanskje fordi det representerer beslutning, endring og nyskaping. Kilde

Men problemet med tilnærminger som Spangher-ledende 2023 tilbud Tracking the Newsworthiness of Public Documents, er at de i typisk AI-stil, sentrerer seg på observerte trender i dataene. Med andre ord, de observerer ting som gjorde god nyhet før, og går videre for å se etter mer av samme.

I den virkelige verden, er uventede kilder nesten alltid en ‘one hit wonder’; og for hvor obskure de var, kunne ingen ha forutsatt deres plutselige prominens. Så, etter å ha vært fruktbare en gang, og til tross for noen forsøk på å kapitalisere på flyktig berømmelse/rykte, vil de vanligvis aldri produsere noe nyttig igjen.

Tegn på tiden

Derfor, siden overvåking av denne type ‘one-and-done’-nyhetskilde vanligvis bare vil legge til mer støy til den generelle snøstormen, kunne AI i stedet ikke identifisere signifikatorene for en kilde som en dag kommer til å bli fruktbare? Hvis en kunne finne ut hva type kilde kan en dag bli nyhetsverdig, kunne en fokusere på dens egenskaper rather enn dens kontekst, eller dens metoder.

Ved denne logikken, kunne en slutte fra Edward Snowden-avsløringene i 2010-årene at hvem som helst som nylig forlot CIA (eller en lignende organisasjon) ville være verdt å følge som en potensiell kilde til en fremtidig sak.

Men, det er ingen RSS-feeder eller API-er som sannsynligvis kan automatisere denne type kontinuerlig overvåking, siden LinkedIn og mange andre tidligere åpne datakilder trekker seg tilbake i møte med rapacious og scofflaw AI-web-skrapere. Selv om det var, ville hyppighet være et problem, fordi du ikke kan avhøre en API eller en nettside hver femte sekund; bortsett fra ressurskostnaden, ville IP-blokkeringssvar fra plattformene gjøre dette til en uholdbar aktivitet.

Og, det er tydeligvis en ‘menneskelig dimensjon’ til slike avsløringer som er vanskelig å automatisere.

Nyhetssamling med personlig berøring: opptak fra en disk-utgave av 1976 Alan J. Pakula-filmen ‘All The President’s Men’, med informant som kommer ut av skyggen. Kilde

Og, i den virkelige verden, er det forferdelig vanskelig å identifisere definering egenskaper av en fremtidig nyhetskilde. Det er kanskje ikke ‘personer som forlot CIA nylig’, og det er absolutt ikke definert av en protokoll: plattformer som X eller GitHub utgjør langt for mye signal i seg selv, og selv å snevre inn på søkeord eller postkategorier gjør liten forskjell – bare hvis du er involvert i problemet, og engasjert med samfunnet (eller repo, osv.), er du virkelig sannsynlig å gjenkjenne betydningen av en utvikling.

Selv et uttrykk slik som ‘sikkerhetsvarsel’ kan ikke kontekstualisere den sanne alvorligheten eller nyhetsverdien av en hendelse, siden referanser av denne typen kastes rundt daglig, tusenvis av ganger, i slike samfunn – og selv om en begrenser denne type overvåking til engelsk språk alene, ville variasjoner i idiom, sammen med bruk av skjeve språk, gjøre det svært å parsere en ‘i villmarken’-post til en sannt nyhetsvarsel.

Den smale vei

Den nåværende skaren av AI-drevne nyhetsverdi-detteksjonssystemer avhenger av formaliserte datastrukturer (slik som JSON-utgang fra en API), eller også på uformelle datastrukturer som AI-utviklede algoritmer har en sjanse til å parsere til en strukturert skjema (slik som pressemeldinger fra en bestemt organisasjon):

En parslet RSS/XML-feed, som avslører den stramme hierarkiet av datacontainere. Kilde

Det er tydelig at tilnærminger av denne typen er godt egnet for programmatisk utgang, slik som det rutinemessige arbeidet som den ovennevnte WSJ-reporter erklærer at AI har frigjort ham fra, inkludert vær, aksjer og sportsresultater, samt rutinemessige pressemeldinger fra kommunale og andre offentlige organisasjoner.

Selv om det er mulig å feste ‘menneskelig-alarm’-utløsere til statistiske strømmer som vær (plutselige stormer), aksjer (plutselige fall) og sport (uventede seire/tap, med noen forberedelser), ville menneskelig oppmerksomhet likevel være nødvendig, selv for svært stratifiserte regjeringsutgivelser, for å vurdere nyhetsverdi.

Selv om uttrykk som ‘død’, ‘uventet sykdom’, ‘lekkasje’ og ‘ulykke’ alle kan hjelpe til å bore ned til nyhetsverdige hendelser, kan de bare håndtere ‘rutinemessige’ eventualiteter, og kan ikke regne med alternativ språk (eller språk).

Return of the Elite Writers?

I de siste årene har data-drevet journalistikk blitt en stigende plank i nyhetsdekning, med redaksjoner som ikke lenger er begrenset til søte ‘scoop’-avtaler som gir dem tidlig utgivelse på spesielle rapporter og hvitpapirer fra store forlag; i stedet kan de knuse tallene selv.

Men dette er ingen gratis lunch; da den åpenbare verdien av å parsere offentlige data med AI på denne måten har vokst, har en leie-søkende/AI-blokkerende respons fulgt – eller til og med forutsatt – etterspørselen, og driver de data-hungrende store AI-aktørene inn i skjulte taktikker.

Den ekstra friksjonen av den nye tilbaketrekningen restaurerer kanskje en viss makt fra ‘borgerjournalister’ tilbake til etablerte medier – eller i hvert fall, godt finansierte nyhetsorganisasjoner som har bredbåndet til å absorbere det ekstra manuelle arbeidet som kreves for å samle inn, finjustere og evaluere data, i en æra hvor utgivere og domener stadig begrenser casual tilgang.

Så, på en måte, kanskje i ånden av tiden, den praktiske manifestasjonen av AI i journalistikk, i forhold til hvordan store aktører og markeder har reagert på AI-basert innovasjon og tilpasning, kan faktisk ta oss tilbake i tid: de-demokratisere midlene for nyhetsproduksjon, og legge til hindringer for meningsfulle data-drevne nyhetsverdi-vurderingssystemer.

Felles instinkter

Disse begrensningene fører oss tilbake til ‘gut feeling’ som en uunngåelig komponent i å vurdere nyhetsverdien av en sak.

Naturlijk er dette trøstende for de som er engasjert profesjonelt i denne aspekten; men selvtilfredshet ville være en feil, siden denne instinkten kan, til en viss grad, destilleres og operasjonaliseres på en svært generell måte som ikke avhenger av å studere obsessjonene eller hobbyhestene til enkeltpersoner eller organisasjoner: i en 2022 studie, brukte forskere fra Northwestern University crowd-sourced evalueringer av potensielt nyhetsverdige historier til å trene en prediktiv modell, spesifikt opptatt av nyhetsverdien av nylig publiserte Arxiv-forskningspapirer:

Spørsmål som ble gitt til studie-deltagere for å få treningdata for en ‘nyhetsverdi-prediksjons’-AI-modell. Kilde

Systemet rangerer kandidatene ganske bra, med omtrent 80% av dens topp ti valg også vurdert som nyhetsverdige av eksperter. Men enighet med eksperter viste seg bare moderat, med resultater som manglet faktorer som ramming, eller publikum-tilpasning.

Systemet er basert på prinsippene i 2020-papiret Computational News Discovery: Towards Design Considerations for Editorial Orientation Algorithms in Journalism. Som med de fleste lignende prosjekt, tar dette arbeidet tak i vitenskapsjournalistikk snarere enn abstrakt nyhetsinnhenting – kanskje fordi den vitenskapelige litteraturen tenderer mot malte utgang som potensielt kan parsere til trenbare og tolkbare datapunkter.

Vel, som jeg observerte tilbake i 2021, ville dette være tilfelle, bortsett fra at forskningsvitenskapsmenn ofte misbruker konvensjonene for forskningspapirinnsending til å skjule eller nedtone uimponerende resultater, eller til og med åpenbart fiasko.

Enda mer av en utfordring er den store vanskeligheten som AI-systemer har i å tolke figurer og tabeller i vitenskapelige papirer, til den grad at denne forfølgelsen nylig har blitt en aktiv tråd i litteraturen:

Fra papiret ‘SciFigDetect: A Benchmark for AI-Generated Scientific Figure Detection’, som viser ekte vitenskapelige figurer, deres genereringspromter, og syntetiske motparter produsert av Nano Banana og GPT over tre kategorier: illustrasjon, oversikt og eksperimentelle figurer. Kilde

Det er ofte tilfelle at en graf eller en tabel vil inneholde resultater som hoveddelen av papiret vil enten rapportere med selektiv bias, eller også hvor det vil rett og slett ignorere noen negative konsekvenser implisitt i tabellens/grafens resultater. Derfor er denne hindringen i AI-drevet vitenskapsjournalistikk ikke en minor.

Alene igjen, naturlig

Den crowd-sourced-metoden ovenfor antyder en viss enighet mellom felles konsensus på potensielle nyhetsartikler, og profesjonell evaluering av de samme. Men uten kontekst, kan bare de bredeste strekene av nyhetsverdi tydelig bestemmes.

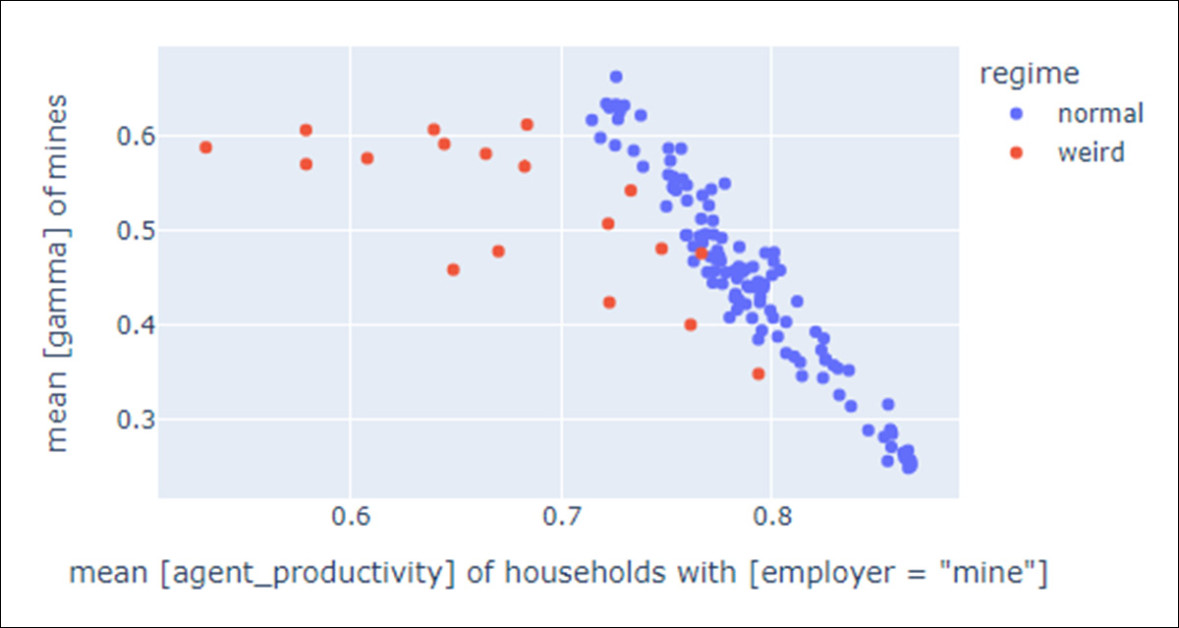

Den aller sterkeste styrken til AI ligger i dens evne, avhengig av konfigurasjon, til å isolere outlierne – enten for å kaste dem som en kurve-blowing og meningsløs unntak til en trend i en datasett, eller (mer relevant for nyhetsinnhenting) til å identifisere meningsfulle og verdifulle usædvanlige hendelser og forekomster:

Outlierne (i rødt) i en spredningsplot. Kilde

På prinsippet at lyn sjelden slår to ganger, er nesten alle hit-nyhetsartikler outlierne. I tilfeller hvor de kommer fra en aktiv og volatil domene, som en pågående krig, kan denne domenen bli nøye skannet med en høy sannsynlighet for nyhetsverdige artikler som oppstår – men til en kostnad av massiv konkurranse, siden felles oppmerksomhet sannsynligvis også er fokusert på domenen.

Mange nyhetsverdige vitenskapelige ledetråder er, per definisjon, ikke i sentrum av språkdistribusjonen. De er sjeldne kombinasjoner av metoder, overraskende negative resultater eller anomale reproduserte resultater. Hvis modellens kompetanse nedgraderes uforholdsmessig på disse lavfrekvens-grupperingene, så blir området hvor en redaktørs ‘nese’ trenger å være skarp, området hvor modellen er minst pålitelig.

Tillitsproblemer

I søket etter nye artikler, balanserer journalister flere begrensninger, inkludert tid, tilgang, troverdighet, publikum og organisatoriske prioriteringer), noe som fører til ikke-åpenlyse valg. En 2022 litteraturgjennomgang fra Danmark karakteriserte journalister som balanserende flere bekymringer, akutt klar over at kilder kan ha agender eller være misinformatert; og ofte unnviker direkte sjekking til fordel for indirekte tillitskriterier når de opererer under press.

Disse samme ’tillitsproblemer’ ville være en utviklingshinder i enhver avgjørende AI-drevet nyhetsverdi-identifiseringsystem, siden engasjement med en slik plattform krever at brukeren stoler på at noen algoritmer som kastes bort av artiklene virkelig ikke er verdt skribentens tid.

Omfattende beta-testing og om-trening eller finjustering, med menneskelig tilsyn som plukker opp stragglere og strøere, kunne til slutt forbedre påliteligheten av en slik tilnærming; men en skifte i nasjonal eller global kultur – som overraskende endringer i det politiske landskapet, eller utbruddet av krig – kunne uunngåelig snu alle de grunnleggende prioriteringene av en slik fint justert system, og la AI-avhengige skribenter bygge sine nødvendige ‘interne domene-modeller’ nesten fra scratch.

Først publisert mandag, 20. april 2026